Was sind Vektoreinbettungen?

Vektoreinbettungen sind numerische Darstellungen, die die Beziehungen und die Bedeutung von Wörtern, Phrasen und anderen Datentypen erfassen. Durch Vektoreinbettungen werden wesentliche Merkmale oder Merkmale eines Objekts in eine prägnante und organisierte Reihe von Zahlen übersetzt, was Computern hilft, Informationen schnell abzurufen. Ähnliche Datenpunkte werden nach der Umwandlung in Punkte in einem mehrdimensionalen Raum näher beieinander gruppiert.

Wird in einer Vielzahl von Anwendungen verwendet, insbesondere in der Verarbeitung natürlicher Sprache (NLP) und maschinelles Lernen (ML), Vektoreinbettungen helfen bei der Manipulation und Verarbeitung von Daten für Aufgaben wie Ähnlichkeitsvergleiche, Clustering und Klassifizierung. Wenn Sie beispielsweise Textdaten betrachten, werden Wörter wie z Katze und Kätzchen vermitteln trotz unterschiedlicher Buchstabenzusammensetzung ähnliche Bedeutungen. Eine effektive semantische Suche beruht auf präzisen Darstellungen, die diese semantische Ähnlichkeit zwischen Begriffen angemessen erfassen.

[Eingebetteten Inhalt]

Sind Einbettungen und Vektoren dasselbe?

Die Begriffe Vektoren und Einbettungen kann im Zusammenhang mit Vektoreinbettungen austauschbar verwendet werden. Beide beziehen sich auf numerische Datendarstellungen, in denen jeweils Datenpunkt wird als Vektor in einem hochdimensionalen Raum dargestellt.

Vektor bezieht sich auf ein Array von Zahlen mit einer definierten Dimension, während Vektoreinbettungen diese Vektoren verwenden, um Datenpunkte in einem kontinuierlichen Raum darzustellen.

Dieser Artikel ist Teil von

Einbettungen beziehen sich auf das Ausdrücken von Daten als Vektoren zur Erfassung wichtiger Informationen, semantischer Verknüpfungen, kontextueller Qualitäten oder der organisierten Darstellung von Daten, die über Trainingsalgorithmen oder gelernt wurden Modelle des maschinellen Lernens.

Arten von Vektoreinbettungen

Vektoreinbettungen gibt es in verschiedenen Formen, jede mit einer eigenen Funktion zur Darstellung verschiedener Arten von Daten. Im Folgenden sind einige gängige Arten von Vektoreinbettungen aufgeführt:

- Worteinbettungen. Worteinbettungen sind Vektordarstellungen einzelner Wörter in einem kontinuierlichen Raum. Sie werden häufig verwendet, um semantische Verbindungen zwischen Wörtern in Aufgaben wie zu erfassen Sentiment-Analyse, Sprachübersetzung und Wortähnlichkeit.

- Satzeinbettungen. Vektordarstellungen vollständiger Sätze werden Satzeinbettungen genannt. Sie sind hilfreich für Aufgaben wie Stimmungsanalyse, Textkategorisierung und Informationsabruf, da sie die Bedeutung und den Kontext des Satzes erfassen.

- Einbettungen von Dokumenten. Dokumenteinbettungen sind Vektordarstellungen ganzer Dokumente, beispielsweise Artikel oder Berichte. Sie werden typischerweise für Aufgaben wie Dokumentenähnlichkeit, Clustering und Empfehlungssysteme verwendet und erfassen die allgemeine Bedeutung und den Inhalt des Dokuments.

- Benutzerprofilvektoren. Hierbei handelt es sich um Vektordarstellungen der Vorlieben, Aktionen oder Eigenschaften eines Benutzers. Sie werden verwendet Kundensegmentierung, personalisierte Empfehlungssysteme und gezielte Werbung zur Erfassung benutzerspezifischer Daten.

- Bildvektoren. Hierbei handelt es sich um Vektordarstellungen visueller Elemente wie Bilder oder Videobilder. Sie werden für Aufgaben wie z. B. verwendet Objekterkennung, Bildsuche und inhaltsbasierte Empfehlungssysteme zur Erfassung visueller Merkmale.

- Produktvektoren. Sie stellen Produkte oder Artikel als Vektoren dar und werden in Produktsuchen, Produktklassifizierungs- und Empfehlungssystemen verwendet, um Merkmale und Ähnlichkeiten zwischen Produkten zu erfassen.

- Benutzerprofilvektoren. Benutzerprofilvektoren repräsentieren die Vorlieben, Aktionen oder Eigenschaften eines Benutzers. Sie werden in der Benutzersegmentierung, in personalisierten Empfehlungssystemen usw. verwendet gezielte Werbung um benutzerspezifische Daten zu sammeln.

Wie werden Vektoreinbettungen erstellt?

Vektoreinbettungen werden mithilfe eines ML-Ansatzes generiert, der ein Modell trainiert, Daten in numerische Vektoren umzuwandeln. Typischerweise eine tiefe Faltungs neuronales Netzwerk wird zum Trainieren dieser Art von Modellen verwendet. Die resultierenden Einbettungen sind oft dicht – alle Werte sind ungleich Null – und hochdimensional – bis zu 2,000 Dimensionen. Beliebte Modelle wie Word2Vec, GLoVE und BERT Konvertieren Sie Wörter, Phrasen oder Absätze in Vektoreinbettungen für Textdaten.

Der Prozess umfasst üblicherweise die folgenden Schritte:

- Stellen Sie einen großen Datensatz zusammen. Es wird ein Datensatz zusammengestellt, der die spezifische Datenkategorie erfasst, für die Einbettungen vorgesehen sind – unabhängig davon, ob es sich um Text oder Bilder handelt.

- Verarbeiten Sie die Daten vor. Abhängig von der Art der Daten erfolgt die Reinigung, Aufbereitung u Datenvorverarbeitung Dazu gehört die Beseitigung von Rauschen, die Größenänderung von Fotos, die Normalisierung von Text und die Durchführung zusätzlicher Vorgänge.

- Trainiere das Modell. Um Zusammenhänge und Muster in den Daten zu erkennen, wird das Modell anhand des Datensatzes trainiert. Um die Diskrepanz zwischen den Ziel- und den vorhergesagten Vektoren zu verringern, werden die Parameter des vorab trainierten Modells während der Trainingsphase geändert.

- Generieren Sie Vektoreinbettungen. Nach dem Training kann das Modell neue Daten in numerische Vektoren umwandeln und so eine aussagekräftige und strukturierte Darstellung präsentieren, die die semantischen Informationen der Originaldaten effektiv kapselt.

Vektoreinbettungen können für eine Vielzahl von Datentypen vorgenommen werden, darunter Zeitreihendaten, Text, Bilder, Audio usw. dreidimensionale (3D) Modelle und Video. Aufgrund der Art und Weise, wie die Einbettungen gebildet werden, haben Objekte mit ähnlicher Semantik Vektoren im Vektorraum, die nahe beieinander liegen.

Wo werden Vektoreinbettungen gespeichert?

Vektoreinbettungen werden in speziellen Datenbanken namens gespeichert Vektordatenbanken. Bei diesen Datenbanken handelt es sich um hochdimensionale mathematische Darstellungen von Datenmerkmalen. Im Gegensatz zu standardmäßigen skalaren Datenbanken oder unabhängigen Vektorindizes bieten Vektordatenbanken besondere Effizienz beim Speichern und Abrufen von Vektoreinbettungen im großen Maßstab. Sie bieten die Möglichkeit, große Datenmengen für Vektorsuchfunktionen effektiv zu speichern und abzurufen.

Vektordatenbanken umfassen mehrere Schlüsselkomponenten, darunter Leistung und Fehlertoleranz. Um sicherzustellen, dass Vektordatenbanken fehlertolerant sind, sind Replikations- und sharding Techniken eingesetzt werden. Bei der Replikation werden Datenkopien über zahlreiche Knoten hinweg erstellt, während beim Sharding Daten auf mehrere Knoten verteilt werden. Dies sorgt für Fehlertoleranz und unterbrechungsfreie Leistung, selbst wenn ein Knoten ausfällt.

Vektordatenbanken sind effektiv beim maschinellen Lernen und der künstlichen Intelligenz (AI) Anwendungen, da sie auf die Verwaltung spezialisiert sind unstrukturierte und halbstrukturierte Daten.

Anwendungen von Vektoreinbettungen

Es gibt verschiedene Einsatzmöglichkeiten für die Vektoreinbettung in verschiedenen Branchen. Zu den gängigen Anwendungen von Vektoreinbettungen gehören die folgenden:

- Empfehlungssysteme. Vektoreinbettungen spielen eine entscheidende Rolle in den Empfehlungssystemen von Branchenriesen, darunter Netflix und Amazon. Mithilfe dieser Einbettungen können Unternehmen die Ähnlichkeiten zwischen Benutzern und Artikeln berechnen und Benutzerpräferenzen und Artikelmerkmale in Vektoren übersetzen. Dieser Prozess hilft bei der Bereitstellung personalisierter Vorschläge, die auf den individuellen Geschmack des Benutzers zugeschnitten sind.

- Suchmaschinen. Suchmaschinen Nutzen Sie Vektoreinbettungen in großem Umfang, um die Effektivität und Effizienz des Informationsabrufs zu verbessern. Da Vektoreinbettungen über den Keyword-Abgleich hinausgehen, helfen sie Suchmaschinen dabei, die Bedeutung von Wörtern und Sätzen zu interpretieren. Selbst wenn die genauen Phrasen nicht übereinstimmen, können Suchmaschinen dennoch Dokumente oder andere Informationen finden und abrufen, die kontextuell relevant sind, indem sie Wörter als Vektoren in einem semantischen Raum modellieren.

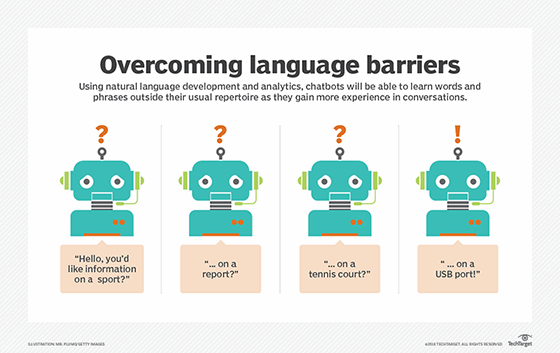

- Chatbots und Frage-Antwort-Systeme. Vektor-Einbettungshilfe Chatbots und generative KI-basierte Frage-Antwort-Systeme beim Verstehen und Hervorrufen menschenähnlicher Reaktionen. Durch die Erfassung des Kontexts und der Bedeutung von Text helfen Einbettungen Chatbots dabei, sinnvoll und logisch auf Benutzeranfragen zu reagieren. Zum Beispiel Sprachmodelle und KI-Chatbots, darunter GPT-4 und Bildprozessoren wie z Dall-E2, erfreuen sich großer Beliebtheit, weil sie menschenähnliche Gespräche und Antworten produzieren.

- Betrugserkennung und Ausreißererkennung. Vektoreinbettungen können verwendet werden, um Anomalien oder betrügerische Aktivitäten zu erkennen, indem die Ähnlichkeit zwischen Vektoren bewertet wird. Ungewöhnliche Muster werden durch die Bewertung des Abstands zwischen Einbettungen und Lokalisierung identifiziert Ausreißer.

- Datenvorverarbeitung. Transformieren unverarbeitete Daten in ein für ML geeignetes Format und Deep-Learning-Modelle werden Einbettungen in Datenvorverarbeitungsaktivitäten verwendet. Worteinbettungen werden beispielsweise verwendet, um Wörter als Vektoren darzustellen, was die Verarbeitung und Analyse von Textdaten erleichtert.

- One-Shot- und Zero-Shot-Lernen. One-Shot- und Zero-Shot-Learning sind Ansätze zur Vektoreinbettung, die maschinellen Lernmodellen dabei helfen, Ergebnisse für neue Klassen vorherzusagen, selbst wenn nur begrenzte gekennzeichnete Daten zur Verfügung stehen. Modelle können selbst mit einer kleinen Anzahl von Trainingsinstanzen verallgemeinern und Vorhersagen generieren, indem sie die in Einbettungen enthaltenen semantischen Informationen verwenden.

- Semantische Ähnlichkeit und Clustering. Vektoreinbettungen erleichtern die Einschätzung, wie ähnlich zwei Objekte in einer hochdimensionalen Umgebung sind. Dadurch ist es möglich, Operationen wie die Berechnung semantischer Ähnlichkeit, das Clustering und das Zusammensetzen verwandter Dinge auf der Grundlage ihrer Einbettungen durchzuführen.

Was für Dinge können eingebettet werden?

Mithilfe von Vektoreinbettungen können viele verschiedene Arten von Objekten und Datentypen dargestellt werden. Zu den gängigen Arten von Dingen, die eingebettet werden können, gehören:

Text

Wörter, Phrasen oder Dokumente werden mithilfe von Texteinbettungen als Vektoren dargestellt. NLP-Aufgaben – einschließlich Sentimentanalyse, semantische Suche und Sprachübersetzung – nutzen häufig Einbettungen.

Der Universal Sentence Encoder ist eines der beliebtesten Open-Source-Einbettungsmodelle und kann einzelne Sätze und ganze Textabschnitte effizient kodieren.

Bilder

Bildeinbettungen erfassen und stellen visuelle Eigenschaften von Bildern als Vektoren dar. Zu ihren Anwendungsfällen gehören die Objektidentifizierung, die Bildklassifizierung und die umgekehrte Bildsuche, oft auch als „Reverse Image Search“ bezeichnet Suche nach Bild.

Bildeinbettungen können auch verwendet werden, um visuelle Suchfunktionen zu ermöglichen. Durch Extrahieren von Einbettungen aus Datenbankbildern kann ein Benutzer die Einbettungen eines Abfragebilds mit den Einbettungen der Datenbankfotos vergleichen, um visuell ähnliche Übereinstimmungen zu finden. Dies wird häufig in verwendet e-commerce Apps, in denen Benutzer nach Artikeln suchen können, indem sie Fotos ähnlicher Produkte hochladen.

Google Lens ist eine Bildsuchanwendung, die Kamerafotos mit optisch ähnlichen Produkten vergleicht. Beispielsweise können damit Internetprodukte abgeglichen werden, die einem Paar Turnschuhen oder einem Kleidungsstück ähneln.

Audio

Audioeinbettungen sind Vektordarstellungen von Audiosignalen. Vektoreinbettungen erfassen akustische Eigenschaften und ermöglichen es Systemen, Audiodaten effektiver zu interpretieren. Audioeinbettungen können beispielsweise für Musikempfehlungen, Genreklassifizierungen, Suche nach Audioähnlichkeiten, Spracherkennung und Sprecherüberprüfung verwendet werden.

Während KI für verschiedene Arten von Einbettungen verwendet wird, hat Audio-KI weniger Aufmerksamkeit erhalten als Text- oder Bild-KI. Google Speech-to-Text und OpenAI Whisper sind Audio-Einbettungsanwendungen, die in Organisationen wie Callcentern, Medizintechnik, Barrierefreiheit und Sprach-zu-Text-Anwendungen eingesetzt werden.

Graphs

Diagrammeinbettungen verwenden Vektoren, um Knoten und Kanten in einem Diagramm darzustellen. Sie sind Wird bei Aufgaben im Zusammenhang mit der Diagrammanalyse verwendet wie Linkvorhersage, Community-Erkennung und Empfehlungssysteme.

Jeder Knoten stellt eine Entität dar, beispielsweise eine Person, eine Webseite oder ein Produkt, und jede Kante symbolisiert die Verbindung oder Verbindung, die zwischen diesen Entitäten besteht. Diese Vektoreinbettungen können alles erreichen, von der Empfehlung von Freunden bis hin zur Empfehlung von Freunden soziale Netzwerke zur Erkennung von Cybersicherheitsproblemen.

Zeitreihendaten und 3D-Modelle

Zeitreiheneinbettungen erfassen zeitliche Muster in sequentiellen Daten. Sie werden verwendet Internet der Dinge Anwendungen, Finanzdaten und Sensordaten für Aktivitäten einschließlich Anomalieerkennung, Zeitreihenprognose und Mustererkennung.

Geometrische Aspekte von 3D-Objekten können mithilfe von 3D-Modelleinbettungen auch als Vektoren ausgedrückt werden. Sie werden bei Aufgaben wie der 3D-Rekonstruktion, der Objekterkennung und dem Formabgleich eingesetzt.

Moleküle

Moleküleinbettungen repräsentieren chemische Verbindungen als Vektoren. Sie werden bei der Arzneimittelentdeckung, der Suche nach chemischen Ähnlichkeiten und der Vorhersage molekularer Eigenschaften eingesetzt. Diese Einbettungen werden auch in der Computerchemie und der Arzneimittelentwicklung verwendet, um die strukturellen und chemischen Eigenschaften von Molekülen zu erfassen.

Was ist Word2Vec?

Word2Vec ist ein beliebter NLP-Ansatz zur Einbettung von Wortvektoren. Word2Vec wurde von Google entwickelt und ist darauf ausgelegt, Wörter als dichte Vektoren in einem kontinuierlichen Vektorraum darzustellen. Es kann den Kontext eines Wortes in einem Dokument erkennen und wird häufig bei NLP-Aufgaben wie Textkategorisierung, Stimmungsanalyse usw. verwendet Maschinenübersetzung um Maschinen dabei zu helfen, natürliche Sprache besser zu verstehen und zu verarbeiten.

Word2Vec basiert auf dem Prinzip, dass Wörter mit ähnlicher Bedeutung ähnliche Vektordarstellungen haben sollten, wodurch das Modell semantische Verbindungen zwischen Wörtern erfassen kann.

Word2Vec verfügt über zwei grundlegende Architekturen: CBOW (Continuous Bag of Words) und Skip-Gram:

- CBOW. Diese Architektur sagt das Zielwort basierend auf den Kontextwörtern voraus. Das Modell erhält einen Kontext oder umgebende Wörter und hat die Aufgabe, das Zielwort in der Mitte vorherzusagen. Im Satz „Der schnelle Braunfuchs springt über den faulen Hund“ verwendet CBOW beispielsweise den Kontext oder die umgebenden Wörter zur Vorhersage Fuchs als Zielwort.

- Skip-Gramm. Im Gegensatz zu CBOW sagt die Skip-Gram-Architektur die Kontextwörter basierend auf dem Zielwort voraus. Das Modell erhält ein Zielwort und wird gebeten, die umgebenden Kontextbegriffe vorherzusagen. Mit dem obigen Beispielsatz „Der schnelle Braunfuchs springt über den faulen Hund“ übernimmt Skip-Gram das Zielwort Fuchs und entdecken Sie Kontextwörter wie „The“, „quick“, „brown“, „jumps“, „over“, „the“, „lazy“ und „dog“.

Eine Vielzahl von Unternehmen beginnen, generative KI zu nutzen, und stellen ihr disruptives Potenzial unter Beweis. Prüfen wie sich generative KI entwickelt, in welche Richtung es in Zukunft gehen wird und welche Herausforderungen sich ergeben könnten.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://www.techtarget.com/searchenterpriseai/definition/vector-embeddings

- :hast

- :Ist

- :Wo

- $UP

- 000

- 1

- 26

- 27

- 31

- 360

- 3d

- 40

- 43

- a

- oben

- Zugänglichkeit

- erreichen

- über

- Aktionen

- Aktivitäten

- Zusätzliche

- angemessen

- Marketings

- Nach der

- AI

- Hilfe

- AIDS

- Algorithmen

- Alle

- ebenfalls

- Amazon

- an

- Analyse

- und

- Anomalieerkennung

- Ein anderer

- jedem

- Anwendung

- Anwendungen

- angewandt

- Ansatz

- Ansätze

- angemessen

- Apps

- Architektur

- SIND

- entstehen

- Feld

- Artikel

- Artikel

- künstlich

- künstliche Intelligenz

- AS

- Aspekte

- montiert

- Beurteilung

- At

- Aufmerksamkeit

- Audio-

- beutel

- Tasche der Wörter

- basierend

- basic

- BE

- weil

- Anfang

- Sein

- zwischen

- Beyond

- beide

- braun

- Unternehmen

- by

- Berechnen

- rufen Sie uns an!

- namens

- Kamera

- CAN

- Fähigkeiten

- Kapazität

- Erfassung

- Capturing

- Tragen

- Fälle

- Kategorie

- Center

- Centers

- Herausforderungen

- geändert

- Charakteristik

- Chatbots

- chemisch

- Chemie

- Unterricht

- Einstufung

- Reinigung

- Menu

- näher

- Bekleidung

- Clustering

- COM

- wie die

- gemeinsam

- häufig

- community

- vergleichen

- Vergleiche

- abschließen

- Komponenten

- Zusammensetzung

- begreifen

- rechnerisch

- Computer

- Computing

- prägnant

- Verbindung

- Inhalt

- Kontext

- kontextuelle

- kontinuierlich

- Gespräche

- verkaufen

- Kopien

- erstellt

- wichtig

- Internet-Sicherheit

- technische Daten

- Datenpunkte

- Datensatz

- Datenbase

- Datenbanken

- tief

- tiefe Lernen

- definiert

- Definition

- Lieferanten

- demonstrieren

- dicht

- Abhängig

- entworfen

- Trotz

- entdecken

- Entdeckung

- Entwicklung

- Unterschiede

- anders

- Abmessungen

- Größe

- Richtung

- entdeckt,

- Entdeckung

- störend

- Abstand

- deutlich

- do

- Dokument

- Unterlagen

- Hund

- Don

- Medikament

- Arzneimittelentwicklung

- Wirkstoffforschung

- im

- jeder

- einfacher

- Edge

- Effektiv

- effektiv

- Wirksamkeit

- Wirkungsgrade

- Effizienz

- effizient

- eliminieren

- eingebettet

- Einbettung

- umarmen

- ermöglichen

- ermöglichen

- kapselt

- Motor (en)

- gewährleisten

- Entitäten

- Einheit

- Arbeitsumfeld

- insbesondere

- essential

- Äther (ETH)

- Auswerten

- Sogar

- alles

- untersuchen

- Beispiel

- existiert

- zum Ausdruck gebracht

- Ausdruck

- ausführlich

- erleichtert

- scheitert

- Eigenschaften

- Revolution

- Finanzdaten

- Finden Sie

- Folgende

- Aussichten für

- unten stehende Formular

- Format

- gebildet

- Formen

- Fuchs

- betrügerisch

- häufig

- frisch

- Freunde

- für

- Funktion

- Funktionen

- Zukunft

- gewonnen

- sammeln

- Spur

- Allgemeines

- erzeugen

- erzeugt

- generativ

- Generative KI

- Geschlecht

- Riesen

- gegeben

- Handschuh

- Go

- Graph

- Haben

- Hilfe

- hilfreich

- Unternehmen

- GUTE

- Ultraschall

- HTTPS

- riesig

- ICON

- Login

- identifiziert

- identifizieren

- if

- Image

- Bildersuche

- Bilder

- immens

- zu unterstützen,

- in

- das

- inklusive

- Einschließlich

- unabhängig

- Indizes

- Krankengymnastik

- Branchen

- Energiegewinnung

- Information

- Anfragen

- innerhalb

- Instanz

- Instanzen

- Intelligenz

- beabsichtigt

- Internet

- in

- beteiligt

- beinhaltet

- Probleme

- IT

- Artikel

- SEINE

- Sprünge

- Wesentliche

- bekannt

- Sprache

- grosse

- gelernt

- lernen

- Lens

- weniger

- lassen

- Brief

- Vermietung

- Limitiert

- LINK

- Links

- logisch

- suchen

- Maschine

- Maschinelles Lernen

- Maschinen

- gemacht

- um

- MACHT

- flächendeckende Gesundheitsprogramme

- Weise

- Spiel

- Streichhölzer

- Abstimmung

- mathematisch

- Bedeutung

- sinnvoll

- Bedeutungen

- sowie medizinische

- könnte

- ML

- Modell

- Modellieren

- für

- Molekular-

- mehr

- vor allem warme

- Am beliebtesten

- Musik

- Natürliche

- Natürliche Sprache

- Verarbeitung natürlicher Sprache

- Netflix

- Neural

- Neu

- Nlp

- Knoten

- Fiber Node

- Lärm

- Anzahl

- Zahlen

- und viele

- Objekt

- Objekterkennung

- Objekte

- of

- bieten

- vorgenommen,

- on

- EINEM

- XNUMXh geöffnet

- Open-Source-

- Einkauf & Prozesse

- or

- Organisationen

- Organisiert

- Original

- Andere

- Ergebnisse

- Ausreißer

- übrig

- Seite

- Paar

- Parameter

- Teil

- Schnittmuster

- Muster

- Leistung

- person

- Personalisiert

- Phase

- Fotos

- Sätze

- ein Bild

- Fotos

- Stück

- Plato

- Datenintelligenz von Plato

- PlatoData

- Play

- Punkte

- Beliebt

- Popularität

- möglich

- Potenzial

- präzise

- vorhersagen

- vorhergesagt

- Vorhersage

- Prognose

- Prognosen

- sagt voraus,

- Vorlieben

- Vorbereitung

- Prinzip

- Prozessdefinierung

- Verarbeitung

- Prozessoren

- Herstellung

- Produkt

- Produktion

- Produkte

- Profil

- immobilien

- Resorts

- die

- bietet

- Qualitäten

- Direkt

- Angebot

- schnell

- RE

- Received

- Anerkennung

- erkennen

- Software Empfehlungen

- Empfehlungen

- empfehlen

- Veteran

- siehe

- bezieht sich

- bezogene

- Beziehungen

- relevant

- Replikation

- Meldungen

- vertreten

- Darstellung

- vertreten

- Darstellen

- representiert

- Reagieren

- Antworten

- was zu

- Abruf

- rückgängig machen

- Rollen

- s

- gleich

- Skalieren

- Suche

- Suchmaschinen

- Suchbegriffe

- Suche

- Abschnitt

- Segmentierung

- semantisch

- Semantik

- Sensor

- Satz

- Gefühl

- Modellreihe

- kompensieren

- Sets

- mehrere

- sharding

- sollte

- zeigt

- Signale

- signifikant

- ähnlich

- Ähnlichkeiten

- da

- klein

- Sneakers

- einige

- Quelle

- Raumfahrt

- Speaker

- spezialisieren

- spezialisiert

- spezifisch

- Rede

- Spracherkennung

- Speech-to-Text

- Standard

- Shritte

- Immer noch

- speichern

- gelagert

- strukturell

- strukturierte

- so

- geliefert

- Umgebung

- symbolisiert

- Systeme und Techniken

- T

- zugeschnitten

- Nehmen

- Einnahme

- Target

- gezielt

- und Aufgaben

- Techniken

- Technologie

- AGB

- Text

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Zukunft

- ihr

- Diese

- vom Nutzer definierten

- Ding

- fehlen uns die Worte.

- diejenigen

- Durch

- Zeit

- Zeitfolgen

- zu

- gemeinsam

- Toleranz

- Training

- trainiert

- Ausbildung

- schult Ehrenamtliche

- Transformieren

- Übersetzungen

- WENDE

- XNUMX

- tippe

- Typen

- typisch

- Ungewöhnlich

- Verständnis

- ununterbrochen

- Universal-

- nicht wie

- Uploading

- -

- benutzt

- Mitglied

- Nutzer

- verwendet

- Verwendung von

- Werte

- Vielfalt

- verschiedene

- Verification

- Video

- visuell

- visuell

- Weg..

- Netz

- Was

- Was ist

- wann

- während

- ob

- welche

- während

- Flüstern

- ganze

- breit

- Große Auswahl

- werden wir

- mit

- Word

- Worte

- Youtube

- Zephyrnet

- Zero-Shot-Lernen