In der heutigen datengesteuerten Welt ist die Fähigkeit, Daten mühelos über verschiedene Plattformen hinweg zu verschieben und zu analysieren, von entscheidender Bedeutung. Amazon App-Flow, ein vollständig verwalteter Datenintegrationsdienst, war Vorreiter bei der Optimierung der Datenübertragung zwischen AWS-Diensten, Software-as-a-Service-Anwendungen (SaaS) und jetzt Google BigQuery. In diesem Blogbeitrag erkunden Sie das Neue Google BigQuery-Connector in Amazon AppFlow und entdecken Sie, wie es den Prozess der Datenübertragung aus dem Data Warehouse von Google vereinfacht Einfacher Amazon-Speicherdienst (Amazon S3)Dies bietet erhebliche Vorteile für Datenexperten und -organisationen, einschließlich der Demokratisierung des Multi-Cloud-Datenzugriffs.

Übersicht über Amazon AppFlow

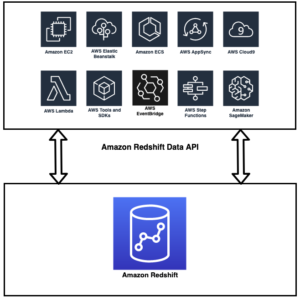

Amazon App-Flow ist ein vollständig verwalteter Integrationsdienst, mit dem Sie Daten sicher zwischen SaaS-Anwendungen wie Google BigQuery, Salesforce, SAP, Hubspot und ServiceNow und AWS-Diensten wie Amazon S3 und übertragen können Amazon RedShift, mit nur wenigen Klicks. Mit Amazon AppFlow können Sie Datenflüsse in nahezu jedem Maßstab und in der von Ihnen gewählten Häufigkeit ausführen – nach einem Zeitplan, als Reaktion auf ein Geschäftsereignis oder nach Bedarf. Sie können Datentransformationsfunktionen wie Filterung und Validierung konfigurieren, um ohne zusätzliche Schritte umfangreiche, gebrauchsfertige Daten als Teil des Flows selbst zu generieren. Amazon AppFlow verschlüsselt automatisch Daten in Bewegung und ermöglicht es Ihnen, den Datenfluss über das öffentliche Internet für integrierte SaaS-Anwendungen einzuschränken AWS PrivateLink, wodurch die Gefährdung durch Sicherheitsbedrohungen verringert wird.

Einführung des Google BigQuery-Connectors

The new Google BigQuery-Connector in Amazon AppFlow eröffnet Möglichkeiten für Unternehmen, die die Analysefunktionen des Data Warehouse von Google nutzen und Daten aus BigQuery mühelos integrieren, analysieren, speichern oder weiterverarbeiten und in umsetzbare Erkenntnisse umwandeln möchten.

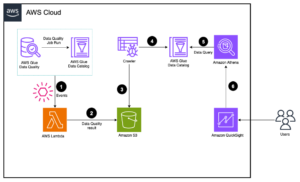

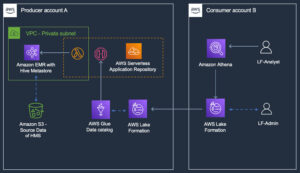

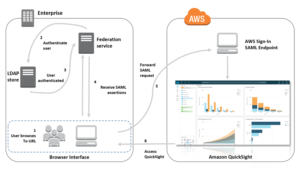

Architektur

Sehen wir uns die Architektur zum Übertragen von Daten von Google BigQuery an Amazon S3 mithilfe von Amazon AppFlow an.

- Wählen Sie eine Datenquelle aus: In Amazon App-Flow, wählen Sie Google BigQuery als Datenquelle aus. Geben Sie die Tabellen oder Datensätze an, aus denen Sie Daten extrahieren möchten.

- Feldzuordnung und -transformation: Konfigurieren Sie die Datenübertragung mithilfe der intuitiven visuellen Oberfläche von Amazon AppFlow. Sie können Datenfelder zuordnen und bei Bedarf Transformationen anwenden, um die Daten an Ihre Anforderungen anzupassen.

- Übertragungshäufigkeit: Entscheiden Sie, wie häufig Sie Daten übertragen möchten – z. B. täglich, wöchentlich oder monatlich – und unterstützen Sie so Flexibilität und Automatisierung.

- Ziel: Geben Sie einen S3-Bucket als Ziel für Ihre Daten an. Amazon AppFlow verschiebt die Daten effizient und macht sie in Ihrem Amazon S3-Speicher zugänglich.

- Verbrauch: Nutzung Amazonas Athena um die Daten in Amazon S3 zu analysieren.

Voraussetzungen:

Das in dieser Lösung verwendete Dataset wird generiert von Synthea, ein synthetischer Patientenpopulationssimulator und Open-Source-Projekt unter dem Apache-Lizenz 2.0. Laden Sie diese Daten in Google BigQuery oder verwenden Sie Ihren vorhandenen Datensatz.

Verbinden Sie Amazon AppFlow mit Ihrem Google BigQuery-Konto

Für diesen Beitrag verwenden Sie ein Google-Konto, einen OAuth-Client mit entsprechenden Berechtigungen und Google BigQuery-Daten. Um den Zugriff auf Google BigQuery über Amazon AppFlow zu ermöglichen, müssen Sie im Voraus einen neuen OAuth-Client einrichten. Anweisungen finden Sie unter Google BigQuery-Connector für Amazon AppFlow.

Richten Sie Amazon S3 ein

Jedes Objekt in Amazon S3 wird in einem Bucket gespeichert. Bevor Sie Daten in Amazon S3 speichern können, müssen Sie dies tun Erstellen Sie einen S3-Bucket um die Ergebnisse zu speichern.

Erstellen Sie einen neuen S3-Bucket für Amazon AppFlow-Ergebnisse

Führen Sie die folgenden Schritte aus, um einen S3-Bucket zu erstellen:

- Auf der AWS-Managementkonsole für Amazon S3, wählen Eimer erstellen.

- Geben Sie ein weltweit eindeutiges ein Name für Ihren Eimer; beispielsweise,

appflow-bq-sample. - Auswählen Eimer erstellen.

Erstellen Sie einen neuen S3-Bucket für Amazon Athena-Ergebnisse

Führen Sie die folgenden Schritte aus, um einen S3-Bucket zu erstellen:

- Auf der AWS-Managementkonsole für Amazon S3, wählen Eimer erstellen.

- Geben Sie ein weltweit eindeutiges ein Name für Ihren Eimer; beispielsweise,

athena-results. - Auswählen Eimer erstellen.

Benutzerrolle (IAM-Rolle) für AWS Glue Data Catalog

Um die Daten zu katalogisieren, die Sie mit Ihrem Flow übertragen, müssen Sie über die entsprechende Benutzerrolle verfügen AWS Identitäts- und Zugriffsverwaltung (IAM). Sie stellen Amazon AppFlow diese Rolle zur Verfügung, um die Berechtigungen zu erteilen, die zum Erstellen eines benötigt werden AWS Glue-Datenkatalog, Tabellen, Datenbanken und Partitionen.

Eine Beispiel-IAM-Richtlinie mit den erforderlichen Berechtigungen finden Sie unter Beispiele für identitätsbasierte Richtlinien für Amazon AppFlow.

Exemplarische Vorgehensweise zum Entwurf

Lassen Sie uns nun einen praktischen Anwendungsfall durchgehen, um zu sehen, wie der Amazon AppFlow Google BigQuery-zu-Amazon-S3-Connector funktioniert. Für den Anwendungsfall verwenden Sie Amazon AppFlow, um historische Daten von Google BigQuery zur Langzeitspeicherung und Analyse in Amazon S3 zu archivieren.

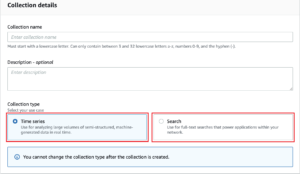

Richten Sie Amazon AppFlow ein

Erstellen Sie einen neuen Amazon AppFlow-Flow, um Daten von Google Analytics an Amazon S3 zu übertragen.

- Auf dem Amazon AppFlow-Konsole, wählen Fluss erzeugen.

- Geben Sie einen Namen für Ihren Flow ein. Zum Beispiel,

my-bq-flow. - Notwendig hinzufügen Schlüsselwörter; zum Beispiel für Wesentliche eingeben

envund für Wert eingebendev.

- Auswählen Weiter.

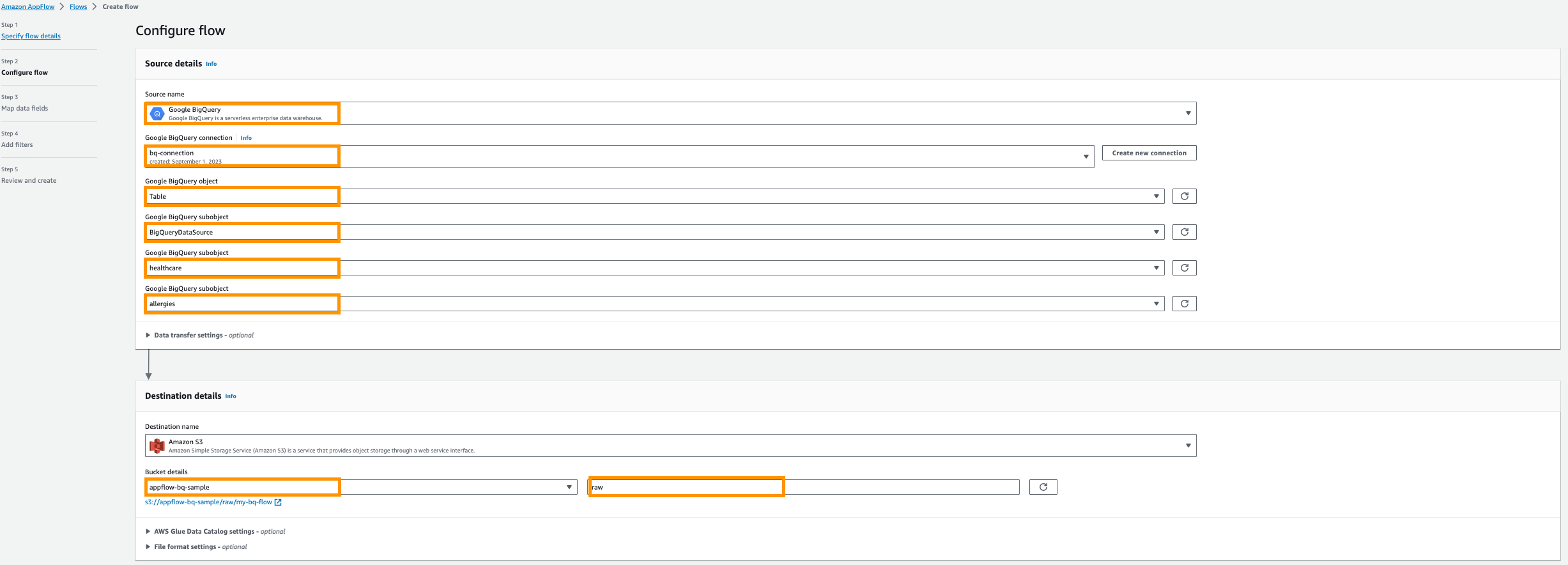

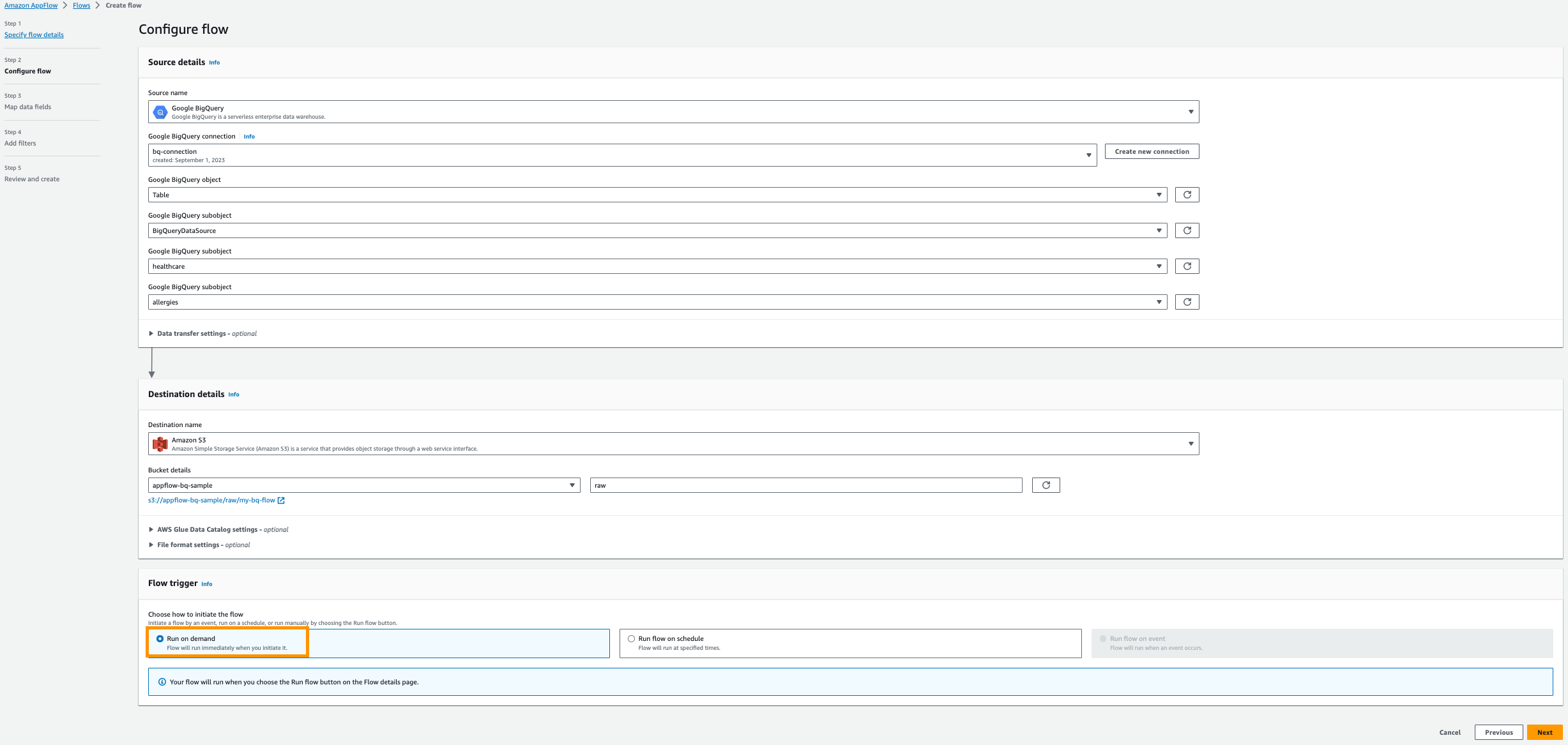

- Aussichten für Quellenname, wählen Google BigQuery.

- Auswählen Neue Verbindung erstellen.

- Geben Sie Ihren OAuth ein Kunden-ID und Kundengeheimnis, dann benennen Sie Ihre Verbindung; Zum Beispiel,

bq-connection.

- Wählen Sie im Popup-Fenster aus, ob Sie amazon.com Zugriff auf die Google BigQuery-API gewähren möchten.

- Aussichten für Wählen Sie das Google BigQuery-Objekt, wählen Tisch.

- Aussichten für Wählen Sie das Unterobjekt „Google BigQuery“ aus, wählen BigQueryProjectName.

- Aussichten für Wählen Sie das Unterobjekt „Google BigQuery“ aus, wählen Datenbankname.

- Aussichten für Wählen Sie das Unterobjekt „Google BigQuery“ aus, wählen Tabellenname.

- Aussichten für Zielname, wählen Amazon S3.

- Aussichten für Bucket-Details, wählen Sie den Amazon S3-Bucket aus, den Sie zum Speichern von Amazon AppFlow-Ergebnissen in den Voraussetzungen erstellt haben.

- Enter

rawals ein Präfix.

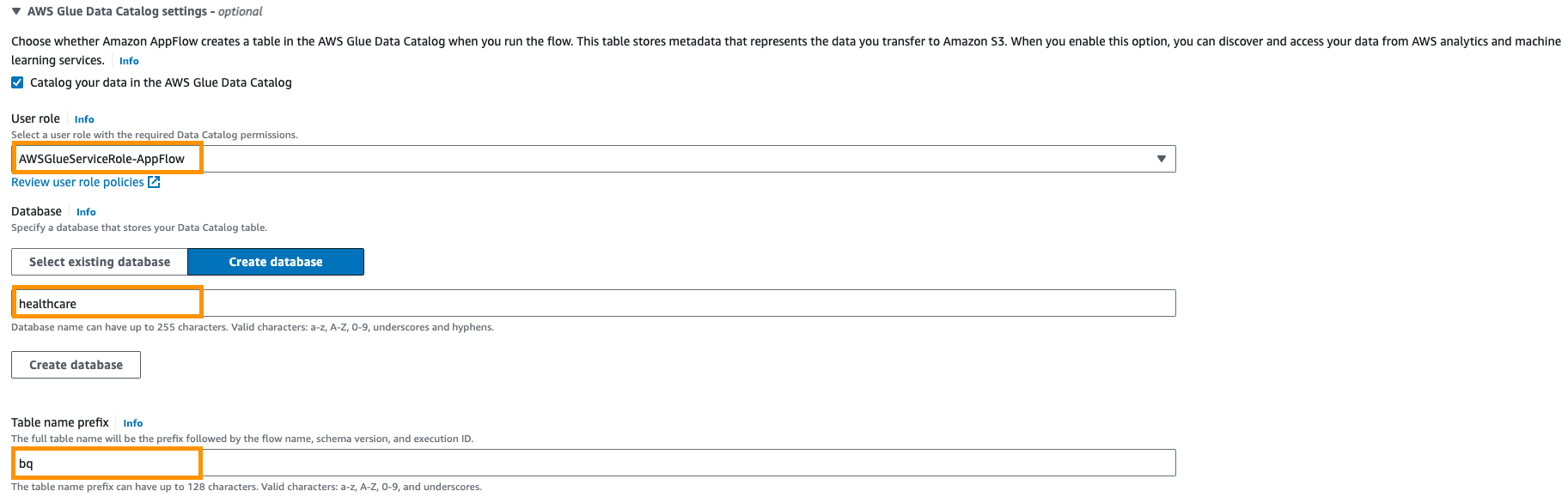

- Als nächstes stellen Sie bereit AWS Glue-Datenkatalog Einstellungen, um eine Tabelle für die weitere Analyse zu erstellen.

- Wähle aus Benutzer-Rolle (IAM-Rolle), die in den Voraussetzungen erstellt wurde.

- Neues Datenbank zum Beispiel,

healthcare. - Bieten eine Tabellenpräfix Einstellung zum Beispiel,

bq.

- Auswählen Bei Bedarf ausführen.

- Auswählen Weiter.

- Auswählen Felder manuell zuordnen.

- Wählen Sie die folgenden sechs Felder aus Quellfeldname Aus der Tabelle Allergien:

- Startseite

- Patient

- Code

- Beschreibung

- Typ

- Kategorie

- Auswählen Felder direkt zuordnen.

- Auswählen Weiter.

- In die Filter hinzufügen Wählen Sie im Abschnitt Weiter.

- Auswählen Fluss erzeugen.

Führen Sie den Flow aus

Nachdem Sie Ihren neuen Flow erstellt haben, können Sie ihn bei Bedarf ausführen.

- Auf dem Amazon AppFlow-Konsole, wählen

my-bq-flow. - Auswählen Ablauf ausführen.

Wählen Sie für diese exemplarische Vorgehensweise zum besseren Verständnis die Option „Auftrag bei Bedarf ausführen“. In der Praxis können Sie einen geplanten Job auswählen und regelmäßig nur neu hinzugefügte Daten extrahieren.

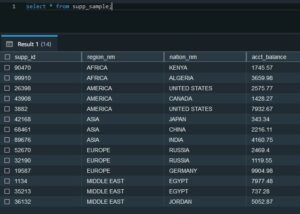

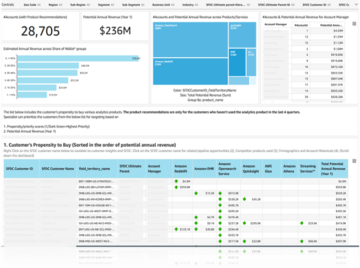

Abfrage über Amazon Athena

Wenn Sie die optionalen AWS Glue Data Catalog-Einstellungen auswählen, erstellt Data Catalog den Katalog für die Daten, sodass Amazon Athena Abfragen durchführen kann.

Wenn Sie aufgefordert werden, einen Speicherort für Abfrageergebnisse zu konfigurieren, navigieren Sie zu Einstellungen Tab und wählen Verwalten. Unter Einstellungen verwalten, wählen Sie den in den Voraussetzungen erstellten Athena-Ergebnis-Bucket aus und wählen Sie Speichern.

- Auf dem Amazon Athena-Konsole, wählen Sie die Datenquelle als aus

AWSDataCatalog. - Als nächstes wählen Sie Datenbase as

healthcare. - Jetzt können Sie die vom AWS Glue-Crawler erstellte Tabelle auswählen und eine Vorschau anzeigen.

- Sie können auch eine benutzerdefinierte Abfrage ausführen, um die zehn häufigsten Allergien zu finden, wie in der folgenden Abfrage dargestellt.

Note: Ersetzen Sie in der folgenden Abfrage den Tabellennamen bq_appflow_mybqflow_1693588670_latest, mit dem Namen der in Ihrem AWS-Konto generierten Tabelle.

- Auswählen Abfrage ausführen.

Dieses Ergebnis zeigt die Top-10-Allergien nach Fallzahlen.

Aufräumen

Um Gebühren zu vermeiden, bereinigen Sie die Ressourcen in Ihrem AWS-Konto, indem Sie die folgenden Schritte ausführen:

- Wählen Sie in der Amazon AppFlow-Konsole aus Fließt im Navigationsbereich.

- Wählen Sie aus der Flow-Liste den Flow aus

my-bq-flow, und löschen Sie es. - Geben Sie delete ein, um den Flow zu löschen.

- Auswählen Verbindungen im Navigationsbereich.

- Auswählen

Google BigQuery Wählen Sie aus der Liste der Konnektoren aus

bq-connector, und löschen Sie es. - Geben Sie delete ein, um den Connector zu löschen.

- Wählen Sie in der IAM-Konsole Rollen Wählen Sie dann auf der Navigationsseite die Rolle aus, die Sie für den AWS Glue-Crawler erstellt haben, und löschen Sie sie.

- Auf der Amazon Athena-Konsole:

- Löschen Sie die unter der Datenbank erstellten Tabellen

healthcareVerwendung des AWS Glue-Crawlers. - Löschen Sie die Datenbank

healthcare

- Löschen Sie die unter der Datenbank erstellten Tabellen

- Suchen Sie in der Amazon S3-Konsole nach dem von Ihnen erstellten Amazon AppFlow-Ergebnis-Bucket und wählen Sie „ leer um die Objekte zu löschen, löschen Sie dann den Bucket.

- Suchen Sie auf der Amazon S3-Konsole nach dem von Ihnen erstellten Amazon Athena-Ergebnis-Bucket und wählen Sie „ leer um die Objekte zu löschen, löschen Sie dann den Bucket.

- Bereinigen Sie die Ressourcen in Ihrem Google-Konto, indem Sie das Projekt löschen, das die Google BigQuery-Ressourcen enthält. Befolgen Sie die Dokumentation, um Bereinigen Sie die Google-Ressourcen.

Zusammenfassung

Der Google BigQuery-Connector in Amazon AppFlow optimiert den Prozess der Datenübertragung vom Google Data Warehouse zu Amazon S3. Diese Integration vereinfacht Analysen und maschinelles Lernen, Archivierung und Langzeitspeicherung und bietet erhebliche Vorteile für Datenexperten und Organisationen, die die Analysefunktionen beider Plattformen nutzen möchten.

Mit Amazon AppFlow entfällt die Komplexität der Datenintegration, sodass Sie sich darauf konzentrieren können, aus Ihren Daten umsetzbare Erkenntnisse abzuleiten. Unabhängig davon, ob Sie historische Daten archivieren, komplexe Analysen durchführen oder Daten für maschinelles Lernen vorbereiten, vereinfacht dieser Connector den Prozess und macht ihn einem breiteren Spektrum von Datenexperten zugänglich.

Wenn Sie sehen möchten, wie die Datenübertragung von Google BigQuery zu Amazon S3 mithilfe von Amazon AppFlow erfolgt, schauen Sie sich die Schritt-für-Schritt-Anleitung an Video-Tutorial. In diesem Tutorial durchlaufen wir den gesamten Prozess, vom Einrichten der Verbindung bis zum Ausführen des Datenübertragungsflusses. Weitere Informationen zu Amazon AppFlow finden Sie unter Amazon App-Flow.

Über die Autoren

Kartikay Khator ist Lösungsarchitekt für Global Life Science bei Amazon Web Services. Es ist ihm eine Leidenschaft, Kunden auf ihrer Cloud-Reise zu unterstützen, wobei der Schwerpunkt auf AWS-Analysediensten liegt. Er ist ein begeisterter Läufer und geht gerne wandern.

Kartikay Khator ist Lösungsarchitekt für Global Life Science bei Amazon Web Services. Es ist ihm eine Leidenschaft, Kunden auf ihrer Cloud-Reise zu unterstützen, wobei der Schwerpunkt auf AWS-Analysediensten liegt. Er ist ein begeisterter Läufer und geht gerne wandern.

Kamen Sharlandjiev ist Senior Big Data and ETL Solutions Architect und Amazon AppFlow-Experte. Seine Mission ist es, Kunden, die vor komplexen Herausforderungen bei der Datenintegration stehen, das Leben zu erleichtern. Seine Geheimwaffe? Vollständig verwaltete Low-Code-AWS-Services, die Ihre Arbeit mit minimalem Aufwand und ohne Programmieraufwand erledigen können.

Kamen Sharlandjiev ist Senior Big Data and ETL Solutions Architect und Amazon AppFlow-Experte. Seine Mission ist es, Kunden, die vor komplexen Herausforderungen bei der Datenintegration stehen, das Leben zu erleichtern. Seine Geheimwaffe? Vollständig verwaltete Low-Code-AWS-Services, die Ihre Arbeit mit minimalem Aufwand und ohne Programmieraufwand erledigen können.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/big-data/simplify-data-transfer-google-bigquery-to-amazon-s3-using-amazon-appflow/

- :hast

- :Ist

- $UP

- 10

- 100

- 14

- 16

- 17

- 22

- 321

- 8

- 9

- a

- Fähigkeit

- Über Uns

- Zugang

- zugänglich

- Konto

- über

- hinzufügen

- hinzugefügt

- Zusätzliche

- vorantreiben

- ausrichten

- Allergien

- erlauben

- Zulassen

- erlaubt

- ebenfalls

- Amazon

- Amazonas Athena

- Amazon Web Services

- Amazon.com

- an

- Analyse

- Analytische

- Analytik

- analysieren

- und

- jedem

- Bienen

- Anwendungen

- Bewerben

- angemessen

- Architektur

- Archiv

- SIND

- AS

- At

- Im Prinzip so, wie Sie es von Google Maps kennen.

- Automation

- vermeiden

- AWS

- AWS-Kleber

- AWS-Managementkonsole

- war

- Bevor

- unten

- Vorteile

- zwischen

- Big

- Big Data

- Bigquery

- Blog

- beide

- breiteres

- Geschäft

- by

- CAN

- Kann bekommen

- Fähigkeiten

- capability

- Häuser

- Fälle

- Katalog

- Kategorie

- Herausforderungen

- Gebühren

- Auswählen

- Auftraggeber

- Cloud

- Programmierung

- COM

- abschließen

- Abschluss

- Komplex

- Komplexität

- Verbindung

- Konsul (Console)

- enthält

- Crawler

- erstellen

- erstellt

- schafft

- Erstellen

- Original

- Kunden

- Unterricht

- technische Daten

- Datenzugriff

- Datenintegration

- Data Warehouse

- datengesteuerte

- Datenbase

- Datenbanken

- Datensätze

- entscheidet

- Demand

- Demokratisierung

- Beschreibung

- Reiseziel

- entdeckt,

- verschieden

- Dokumentation

- erledigt

- erleichtern

- einfacher

- effizient

- Anstrengung

- mühelos

- eliminiert

- ermöglichen

- ermöglichen

- Ganz

- essential

- Äther (ETH)

- Event

- Beispiel

- Beispiele

- vorhandenen

- Experte

- ERKUNDEN

- Belichtung

- Extrakt

- zugewandt

- wenige

- Feld

- Felder

- Filterung

- Finden Sie

- Flexibilität

- Fluss

- Fließen

- Fließt

- Setzen Sie mit Achtsamkeit

- folgen

- Folgende

- Aussichten für

- Vordergrund

- Frequenz

- häufig

- für

- voll

- weiter

- erzeugen

- erzeugt

- bekommen

- Global

- Global

- Google Analytics

- gewähren

- Gruppe an

- Geschirr

- Haben

- he

- Gesundheitswesen

- Unternehmen

- Wandern

- seine

- historisch

- Ultraschall

- HTML

- http

- HTTPS

- HubSpot

- IAM

- Identitätsschutz

- Identitäts- und Zugriffsverwaltung

- in

- Einschließlich

- Information

- Einblicke

- Anleitung

- integrieren

- integriert

- Integration

- interessiert

- Schnittstelle

- Internet

- in

- intuitiv

- IT

- selbst

- Job

- Reise

- nur

- lernen

- Lizenz

- Lebensdauer

- Life Science

- LIMIT

- Liste

- Belastung

- Standorte

- langfristig

- aussehen

- Maschine

- Maschinelles Lernen

- um

- Making

- verwaltet

- Management

- Karte

- Mapping

- minimal

- Ziel

- mehr

- Bewegung

- schlauer bewegen

- sollen

- Name

- Navigieren

- Menü

- fast

- notwendig,

- erforderlich

- Bedürfnisse

- Neu

- neu

- nicht

- jetzt an

- Anzahl

- oauth

- Objekt

- Objekte

- of

- on

- On-Demand

- einzige

- opensource

- or

- Auftrag

- Organisationen

- übrig

- Seite

- Brot

- Teil

- leidenschaftlich

- Vertrauen bei Patienten

- ausführen

- Durchführung

- Berechtigungen

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Datenschutzrichtlinien

- Pop-up

- Bevölkerung

- Möglichkeiten

- Post

- Praktisch

- Praxis

- Vorbereitung

- Voraussetzungen

- Vorspann

- Prozessdefinierung

- Profis

- Projekt

- die

- Bereitstellung

- Öffentlichkeit

- Abfragen

- Angebot

- Reduzierung

- ersetzen

- falls angefordert

- Voraussetzungen:

- Downloads

- Antwort

- eine Beschränkung

- Folge

- Die Ergebnisse

- Überprüfen

- Reiches

- Rollen

- Führen Sie

- Läufer

- Laufen

- SaaS

- salesforce

- Saft

- Skalieren

- Zeitplan

- vorgesehen

- Wissenschaft

- Suche

- Die Geheime

- Abschnitt

- sicher

- Sicherheitdienst

- Sicherheitsbedrohungen

- sehen

- auf der Suche nach

- ServiceNow

- Lösungen

- kompensieren

- Einstellung

- Einstellungen

- gezeigt

- Konzerte

- signifikant

- Einfacher

- vereinfachen

- Simulator

- SIX

- Software

- Software als Service

- Lösung

- Lösungen

- Quelle

- Shritte

- Lagerung

- speichern

- gelagert

- Rationalisierung

- so

- synthetisch

- Tabelle

- Nehmen

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- dann

- fehlen uns die Worte.

- Bedrohungen

- Durch

- zu

- heutigen

- Top

- Top 10

- privaten Transfer

- Übertragen

- Transformation

- Transformationen

- Transformieren

- Lernprogramm

- tippe

- für

- Verständnis

- einzigartiges

- Präsentiert

- -

- Anwendungsfall

- benutzt

- Mitglied

- Verwendung von

- Bestätigung

- Wert

- Besuchen Sie

- Spaziergang

- Walkthrough

- wollen

- Warehouse

- we

- Netz

- Web-Services

- wöchentlich

- ob

- WHO

- werden wir

- Fenster

- mit

- ohne

- Werk

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- U

- Ihr

- Youtube

- Zephyrnet