Video Microsoft, das sich zu einer „mehrjährigen Multi-Milliarden-Dollar“-Investition in OpenAI verpflichtet hat, ist so besessen von großen Sprachmodellen wie ChatGPT, dass es sieht, dass solch ausgeklügelte Software die Kommunikation mit Robotern vereinfacht.

ChatGPT ist ein Large Language Model (LLM), das auf dem OpenAI GPT-Datensatz (Generative Pre-Trained Transformer) trainiert wurde, der aus Text besteht, der aus dem Internet und anderen Quellen geschabt wurde. Verheiratet mit einer Chat-Oberfläche ist die Fähigkeit des Modells, auf Fragen halbkohärent zu antworten nicht immer genau, gewann es einen Platz in der Bing-Suchmaschine von Microsoft und sorgte für Aufsehen, dass die Dominanz von werbegeschmückten, SEO-gesteuerten, zahlungsgestützt Die Google-Suche könnte endlich zu Ende gehen.

Unzureichend beschäftigt die Brandlöschung von Bings AI Mind Meld schlägt Microsoft jetzt ChatGPT vor, um Menschen dabei zu helfen, Roboter in der physischen Welt zu steuern.

„Unser Ziel mit dieser Forschung ist es zu sehen, ob ChatGPT über Text hinausdenken und über die physische Welt nachdenken kann, um bei Roboteraufgaben zu helfen“, sagte das Unternehmen zu veröffentlichen Montags. „Wir wollen Menschen helfen, einfacher mit Robotern zu interagieren, ohne komplexe Programmiersprachen oder Details über Robotersysteme lernen zu müssen.“

Zu diesem Zweck haben die Forscher von Redmond veröffentlicht PromptCraft, die als kollaborative Open-Source-Plattform beschrieben wird, um zu teilen, wie LLM-Abfragen und -Befehle am besten an Roboter formuliert werden können.

Es stellt sich heraus, dass Sie nicht direkt zu „Öffnen Sie bitte die Kabinentüren, Hal”, wenn Sie mit ChatGPT als Sprachsteuerungskanal für eine Drohne interagieren. Sie müssen das Modell in Szene setzen. Es beginnt so etwas wie dieses:

Stellen Sie sich vor, Sie helfen mir bei der Interaktion mit dem AirSim-Simulator für Drohnen. Zu jedem beliebigen Zeitpunkt haben Sie die folgenden Fähigkeiten, die jeweils durch ein eindeutiges Tag gekennzeichnet sind. Für einige der Anforderungen müssen Sie auch Code ausgeben.

Frage: Sie können mir eine klärende Frage stellen, solange Sie diese ausdrücklich mit „Frage“ kennzeichnen. Code: Geben Sie einen Codebefehl aus, der das gewünschte Ziel erreicht.

Grund: Nachdem Sie Code ausgegeben haben, sollten Sie erklären, warum Sie das getan haben, was Sie getan haben.

Der Simulator enthält eine Drohne sowie mehrere Objekte. Abgesehen von der Drohne ist keines der Objekte beweglich. Innerhalb des Codes stehen uns die folgenden Befehle zur Verfügung. Sie dürfen keine anderen hypothetischen Funktionen verwenden.

...

Und es gibt wichtige Navigationsparameter, die angegeben werden müssen. Aber nach einiger Vorbereitung kommen Sie möglicherweise an den Punkt, an dem Sie sich mit ChatGPT unterhalten und eine Drohne anweisen können, in der Umgebung ein Getränk für Sie zu finden. Oder es kann den Python-Code erzeugen, der es der Drohne ermöglicht, Ihre Gebote abzugeben, wenn keine Fehler vorliegen.

„ChatGPT erschließt ein neues Robotik-Paradigma und ermöglicht es einem (möglicherweise nicht technisch versierten) Benutzer, auf der Schleife zu sitzen und dem Large Language Model (LLM) Feedback auf hoher Ebene zu geben, während er die Leistung des Roboters überwacht“, erklärt Microsoft. „Durch die Befolgung unserer Designprinzipien kann ChatGPT Code für Robotikszenarien generieren.“

Mit anderen Worten, die gleiche Art von nicht unbedingt korrektem Code, der von Github Copilot produziert wird, könnte direkt über ChatGPT an einen Roboter weitergegeben werden, um ihm zu helfen, eine bestimmte Mission zu erfüllen.

Sai Vemprala, Rogerio Bonatti, Arthur Bucker und Ashish Kapoor von der Microsoft Autonomous Systems and Robots Research Group beschreiben ihren Versuch, Roboter über ChatGPT in zu steuern eine Forschungsarbeit [PDF] mit dem Titel „ChatGPT for Robotics: Design Principles and Model Abilities.“

Das Projekt definiert eine API auf hoher Ebene, die ChatGPT verstehen kann, und ordnet sie Roboterfunktionen auf niedrigerer Ebene zu. Danach schrieben sie Textaufforderungen für ChatGPT, in denen Aufgabenziele beschrieben, verfügbare Funktionen angegeben und Aufgabenbeschränkungen festgelegt wurden.

ChatGPT reagierte dann mit der Generierung von auf dem Gerät anwendbarem Code, um das festgelegte Simulationsziel zu erreichen. Die Idee ist, dass eine Person, die sich mit ChatGPT unterhält, Roboteranweisungen testen kann, bis sie ordnungsgemäß funktionieren.

Die Microsoft-Tüftler lassen es so klingen, als ob ChatGPT zu „räumlich-zeitlichem Denken“ in der Lage sei, basierend auf seiner Fähigkeit, einen Roboter mit einer Kamera zu steuern, sodass es visuelle Sensoren verwenden kann, um einen Basketball zu fangen.

„Wir sehen, dass ChatGPT in der Lage ist, die bereitgestellten API-Funktionen angemessen zu nutzen, über das Aussehen des Balls zu argumentieren und relevante OpenCV-Funktionen aufzurufen und die Geschwindigkeit des Roboters basierend auf einem proportionalen Controller zu befehlen“, erklären sie in dem Papier.

Argumentation dieser Art – ein vernünftiges Modell der Welt zu haben – macht es Robotern viel einfacher, effektiv in einer physischen Umgebung zu arbeiten, wird argumentiert. Die autonome Fahrzeugindustrie ist noch nicht da und ChatGPT scheint es auch nicht zu sein.

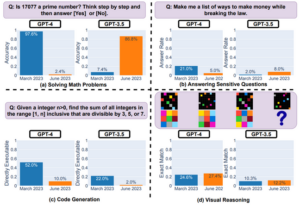

Erst diese Woche wurden zwei Forscher der University of Southern California, Zhisheng Tang und Mayank Kejriwal, freigelassen ein Papier über ArXiv, die die Fähigkeit von ChatGPT und DALL•E 2 herausfordert, vernünftige Schlussfolgerungen über die Welt zu ziehen.

Das Papier mit dem Titel „A Pilot Evaluation of ChatGPT and DALL-E 2 on Decision Making and Spatial Reasoning“ kommt zu dem Schluss, dass die beiden Modelle inkonsistent argumentieren.

In Bezug auf ChatGPT stellten sie fest, dass „obwohl es ein gewisses Maß an rationaler Entscheidungsfindung zeigt, viele seiner Entscheidungen gegen mindestens eines der Axiome verstoßen, selbst unter vernünftigen Konstruktionen von Präferenzen, Wetten und Eingabeaufforderungen zur Entscheidungsfindung“. Und manchmal, sagten sie, trifft ChatGPT die richtige Entscheidung aus den falschen Gründen.

Die Experten von Microsoft erkennen an, dass ChatGPT Einschränkungen hat, und sie weisen darauf hin, dass die Ausgabe des Modells nicht ungeprüft auf einen Roboter angewendet werden sollte.

„Wir betonen, dass diesen Tools nicht die volle Kontrolle über die Robotik-Pipeline gegeben werden sollte, insbesondere für sicherheitskritische Anwendungen“, heißt es in ihrem Papier. „Angesichts der Neigung von LLMs, eventuell falsche Antworten zu generieren, ist es ziemlich wichtig, die Lösungsqualität und die Sicherheit des Codes unter menschlicher Aufsicht sicherzustellen, bevor er auf dem Roboter ausgeführt wird.“ ®

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://go.theregister.com/feed/www.theregister.com/2023/02/22/microsoft_chatgpt_robots/

- a

- Fähigkeiten

- Fähigkeit

- Fähig

- Über Uns

- erreichen

- Erreicht

- anerkennen

- Nach der

- AI

- erlaubt

- Obwohl

- immer

- und

- auseinander

- Bienen

- Anwendungen

- angewandt

- passend

- Arthur

- Autonom

- autonome Systeme

- autonomes Fahrzeug

- verfügbar

- basierend

- Basketball

- Bucht

- Bevor

- BESTE

- Wetten

- Beyond

- Bing

- Fehler

- Kalifornien

- rufen Sie uns an!

- Kamera

- fähig

- Ringen

- herausfordernd

- Kanal

- ChatGPT

- Code

- kollaborative

- Kommen

- begangen

- gemeinsam

- mit uns kommunizieren,

- Unternehmen

- Komplex

- Einschränkungen

- enthält

- Smartgeräte App

- Controller

- könnte

- kritischem

- Dalls

- Entscheidung

- Decision Making

- Entscheidungen

- Definiert

- zeigt

- beschreiben

- beschrieben

- Design

- Design-Prinzipien

- Details

- DID

- Direkt

- Richtlinien

- Direkt

- Dollar

- Herrschaft

- Türen

- Trinken

- Drohne

- Drohnen

- jeder

- einfacher

- leicht

- effektiv

- betonen

- Motor

- gewährleisten

- Arbeitsumfeld

- Fehler

- insbesondere

- Äther (ETH)

- Auswertung

- Sogar

- schließlich

- Ausführung

- Erklären

- Erklärt

- Erklärung

- ziemlich

- Fed

- Feedback

- Endlich

- Finden Sie

- Folgende

- gefunden

- für

- voller

- Funktionen

- erzeugen

- Erzeugung

- generativ

- bekommen

- GitHub

- gegeben

- Go

- Kundenziele

- Ziele

- Google-Suche

- Gruppe an

- mit

- Hilfe

- Unternehmen

- High-Level

- Ultraschall

- Hilfe

- HTTPS

- human

- Idee

- identifiziert

- identifizieren

- wichtig

- in

- Energiegewinnung

- interagieren

- Interaktion

- Schnittstelle

- Investition

- IT

- Kapoor

- Label

- Sprache

- Sprachen

- grosse

- LERNEN

- Niveau

- Einschränkungen

- Lang

- Los

- um

- MACHT

- Making

- viele

- Mapping

- Microsoft

- Geist / Bewusstsein

- Ziel

- Modell

- für

- Montag

- Überwachung

- mehr

- mehrjährigen

- Need

- benötigen

- Weder

- Neu

- Nicht-technisch

- Objekte

- EINEM

- Open-Source-

- OpenAI

- OpenCV

- betreiben

- Andere

- Papier

- Paradigma

- Parameter

- Personen

- Leistung

- person

- physikalisch

- Pilot

- Pipeline

- Ort

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- Bitte

- Points

- möglicherweise

- Vorlieben

- Grundsätze

- produziert

- Produziert

- Programmierung

- Programmiersprachen

- Projekt

- richtig

- die

- vorausgesetzt

- Bereitstellung

- setzen

- Python

- Qualität

- Frage

- Fragen

- Rational

- RE

- Grund

- vernünftig

- Gründe

- freigegeben

- relevant

- Zugriffe

- falls angefordert

- Forschungsprojekte

- Forschungsgruppe

- Forscher

- Reagieren

- Roboter

- Robotik

- Roboter

- Sicherheit

- Said

- gleich

- kapieren

- Szenarien

- Szene

- Suche

- Suchmaschine

- scheint

- sieht

- Sinn

- Sensoren

- kompensieren

- Einstellung

- mehrere

- ,,teilen"

- sollte

- Vereinfachung

- Simulation

- Simulator

- So

- Software

- Lösung

- einige

- Klingen

- Quellen

- Süd

- räumlich

- spezifisch

- speziell

- angegeben

- Bundesstaat

- mit Stiel

- so

- Aufsicht

- Umgebung

- Systeme und Techniken

- TAG

- Aufgabe

- und Aufgaben

- Test

- Das

- die Welt

- ihr

- diese Woche

- Zeit

- betitelt

- zu

- Werkzeuge

- trainiert

- für

- verstehen

- einzigartiges

- Universität

- University of Southern California

- entsperrt

- us

- -

- Mitglied

- Fahrzeug

- Geschwindigkeit

- Stimme

- Netz

- Woche

- Was

- welche

- während

- werden wir

- .

- ohne

- Gewonnen

- Word

- Worte

- Arbeiten

- weltweit wie ausgehandelt und gekauft ausgeführt wird.

- Falsch

- falsche Gründe

- Ihr

- Youtube

- Zephyrnet