Bild vom Herausgeber

KI-Anwendungen verfügen über beispiellose Rechenkapazitäten, die den Fortschritt in einem beispiellosen Tempo vorantreiben können. Dennoch sind diese Tools für ihren Betrieb stark auf energieintensive Rechenzentren angewiesen, was zu einem besorgniserregenden Mangel an Energiesensibilität führt, der erheblich zu ihrem COXNUMX-Fußabdruck beiträgt. Überraschenderweise machen diese KI-Anwendungen bereits einen erheblichen Teil aus 2.5 bis 3.7 Prozent der weltweiten Treibhausgasemissionen aus und übersteigt damit die Emissionen der Luftfahrtindustrie.

Und leider nimmt dieser COXNUMX-Fußabdruck rasant zu.

Derzeit besteht die dringende Notwendigkeit darin, den COXNUMX-Fußabdruck von Anwendungen des maschinellen Lernens zu messen, wie Peter Drucker in seiner Weisheit betont: „Man kann nicht verwalten, was man nicht messen kann.“ Derzeit besteht ein erheblicher Mangel an Klarheit bei der Quantifizierung der Umweltauswirkungen von KI, und genaue Zahlen fehlen uns.

Neben der Messung des COXNUMX-Fußabdrucks müssen sich die Führungskräfte der KI-Branche auch aktiv auf dessen Optimierung konzentrieren. Dieser doppelte Ansatz ist von entscheidender Bedeutung, um die Umweltbedenken im Zusammenhang mit KI-Anwendungen anzugehen und einen nachhaltigeren Weg in die Zukunft sicherzustellen.

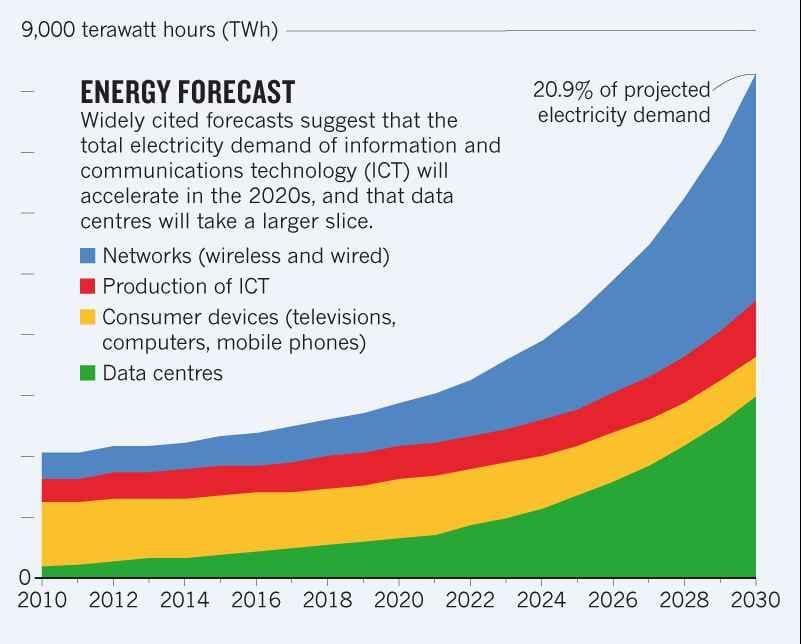

Der zunehmende Einsatz von maschinellem Lernen erfordert mehr Rechenzentren, von denen viele stromhungrig sind und daher einen erheblichen COXNUMX-Fußabdruck haben. Der weltweite Stromverbrauch von Rechenzentren betrug 0.9 um 1.3 Prozent .

A 2021 Studie Schätzungen zufolge kann dieser Verbrauch bis 1.86 auf 2030 Prozent steigen Abbildung stellt den steigenden Trend des Energiebedarfs aufgrund von Rechenzentren dar

© Entwicklung des Energieverbrauchs und Nutzungsanteil für Rechenzentren

Insbesondere gilt: Je höher der Energieverbrauch ist, desto höher ist der COXNUMX-Fußabdruck. Rechenzentren erhitzen sich während der Verarbeitung und können aufgrund von Überhitzung fehlerhaft werden oder sogar den Betrieb einstellen. Daher benötigen sie eine Kühlung, die zusätzliche Energie erfordert. Um 40 Prozent des von Rechenzentren verbrauchten Stroms entfallen auf die Klimatisierung.

Angesichts des zunehmenden Fußabdrucks der KI-Nutzung muss die COXNUMX-Intensität dieser Tools berücksichtigt werden. Derzeit beschränkt sich die Forschung zu diesem Thema auf die Analyse einiger weniger Modelle und berücksichtigt die Vielfalt der genannten Modelle nicht ausreichend.

Hier finden Sie eine weiterentwickelte Methodik und einige effektive Tools zur Berechnung der Kohlenstoffintensität von KI-Systemen.

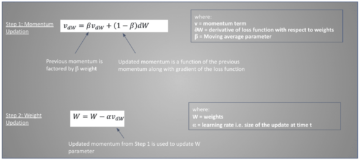

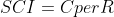

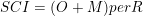

Die Software Carbon Intensity (SCI) Standard ist ein effektiver Ansatz zur Schätzung der Kohlenstoffintensität von KI-Systemen. Im Gegensatz zu den herkömmlichen Methoden, die den Ansatz der attributionalen COXNUMX-Bilanzierung verwenden, wird ein konsequenter Berechnungsansatz verwendet.

Der konsequente Ansatz versucht, die geringfügige Änderung der Emissionen zu berechnen, die sich aus einem Eingriff oder einer Entscheidung ergibt, beispielsweise der Entscheidung, eine zusätzliche Einheit zu erzeugen. Bei der Attribution hingegen handelt es sich um buchhalterische durchschnittliche Intensitätsdaten oder statische Emissionsinventare.

A Krepppapier zu „Measuring the Carbon Intensity of AI in Cloud Instances“ von Jesse Doge et al. hat diese Methodik eingesetzt, um fundiertere Forschung zu ermöglichen. Da ein erheblicher Teil des KI-Modelltrainings auf Cloud-Computing-Instanzen durchgeführt wird, kann es ein gültiger Rahmen für die Berechnung des COXNUMX-Fußabdrucks von KI-Modellen sein. Das Papier verfeinert die SCI-Formel für solche Schätzungen wie:

welches verfeinert wird aus:

das leitet sich von . ab

das leitet sich von . ab

wo:

E: Von einem Softwaresystem verbrauchte Energie, hauptsächlich von grafischen Verarbeitungseinheiten (GPUs), bei denen es sich um spezialisierte ML-Hardware handelt.

I: Standortbezogene marginale COXNUMX-Emissionen durch das Netz, das das Rechenzentrum mit Strom versorgt.

M: Eingebetteter oder verkörperter Kohlenstoff, also der Kohlenstoff, der bei der Nutzung, Herstellung und Entsorgung von Hardware freigesetzt wird.

R: Funktionseinheit, in diesem Fall eine Trainingsaufgabe für maschinelles Lernen.

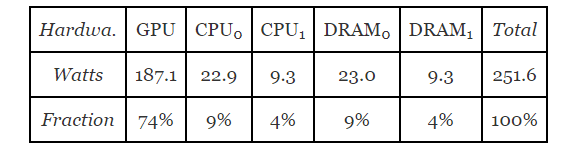

C= O+M, wobei O gleich E*I ist

Das Papier verwendet die Formel, um den Stromverbrauch einer einzelnen Cloud-Instanz zu schätzen. In ML-Systemen, die auf Deep Learning basieren, ist der Großteil des Stromverbrauchs auf die GPU zurückzuführen, die in dieser Formel enthalten ist. Sie trainierten ein BERT-basiertes Modell mit einer einzelnen NVIDIA TITAN Die folgende Abbildung zeigt die Ergebnisse dieses Experiments:

© Energieverbrauch und Aufteilung auf die Komponenten eines Servers

74 Prozent des Energieverbrauchs übernimmt die GPU. Obwohl die Autoren des Papiers immer noch behaupten, dass dies eine Unterschätzung sei, ist die Einbeziehung der GPU der Schritt in die richtige Richtung. Sie steht nicht im Mittelpunkt der herkömmlichen Schätztechniken, was bedeutet, dass ein wesentlicher Faktor für den COXNUMX-Fußabdruck in den Schätzungen außer Acht gelassen wird. Offensichtlich bietet SCI eine gesündere und zuverlässigere Berechnung der Kohlenstoffintensität.

Das Training von KI-Modellen wird oft auf Cloud-Computing-Instanzen durchgeführt, da die Cloud es flexibel, zugänglich und kosteneffizient macht. Cloud Computing bietet die Infrastruktur und Ressourcen, um KI-Modelle in großem Maßstab bereitzustellen und zu trainieren. Aus diesem Grund nimmt die Modellschulung zum Thema Cloud Computing schrittweise zu.

Es ist wichtig, die COXNUMX-Intensität von Cloud-Computing-Instanzen in Echtzeit zu messen, um Bereiche zu identifizieren, die für Minderungsmaßnahmen geeignet sind. Die Berücksichtigung zeitbasierter und ortsspezifischer Grenzemissionen pro Energieeinheit kann bei der Berechnung der betrieblichen COXNUMX-Emissionen helfen, wie es von a 2022 Papier.

An opensource Mit diesem Tool ist auch die Software Cloud Carbon Footprint (CCF) verfügbar, um die Auswirkungen von Cloud-Instanzen zu berechnen.

Hier sind 7 Möglichkeiten, die Kohlenstoffintensität von KI-Systemen zu optimieren.

1. Schreiben Sie besseren und effizienteren Code

Optimierte Codes können den Energieverbrauch um reduzieren 30 Prozent durch geringere Speicher- und Prozessorauslastung. Das Schreiben eines COXNUMX-effizienten Codes umfasst die Optimierung von Algorithmen für eine schnellere Ausführung, die Reduzierung unnötiger Berechnungen und die Auswahl energieeffizienter Hardware, um Aufgaben mit weniger Stromverbrauch auszuführen.

Entwickler können Profilierungstools verwenden, um Leistungsengpässe und Optimierungsbereiche in ihrem Code zu identifizieren. Dieser Prozess kann zu energieeffizienterer Software führen. Erwägen Sie außerdem die Implementierung energiebewusster Programmiertechniken, bei denen der Code so konzipiert ist, dass er sich an die verfügbaren Ressourcen anpasst und energieeffiziente Ausführungspfade priorisiert.

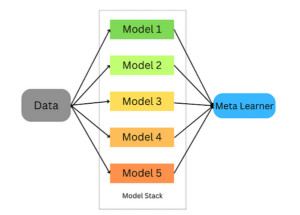

2. Wählen Sie ein effizienteres Modell

Die Wahl der richtigen Algorithmen und Datenstrukturen ist entscheidend. Entwickler sollten sich für Algorithmen entscheiden, die die Rechenkomplexität und damit den Energieverbrauch minimieren. Wenn das komplexere Modell nur eine Verbesserung von 3–5 % bringt, aber 2–3x mehr Zeit zum Trainieren benötigt; Wählen Sie dann das einfachere und schnellere Modell.

Die Modelldestillation ist eine weitere Technik zur Verdichtung großer Modelle in kleinere Versionen, um sie effizienter zu machen und gleichzeitig wesentliches Wissen beizubehalten. Dies kann erreicht werden, indem ein kleines Modell so trainiert wird, dass es das große Modell nachahmt, oder indem unnötige Verbindungen aus einem neuronalen Netzwerk entfernt werden.

3. Modellparameter anpassen

Optimieren Sie Hyperparameter für das Modell mithilfe der Dual-Objective-Optimierung, die die Modellleistung (z. B. Genauigkeit) und den Energieverbrauch in Einklang bringt. Dieser Ansatz mit zwei Zielen stellt sicher, dass Sie nicht das eine für das andere opfern, wodurch Ihre Modelle effizienter werden.

Nutzen Sie Techniken wie Parametereffiziente Feinabstimmung (PEFT), dessen Ziel es ist, eine Leistung zu erzielen, die der herkömmlichen Feinabstimmung ähnelt, jedoch mit einer reduzierten Anzahl trainierbarer Parameter. Dieser Ansatz beinhaltet die Feinabstimmung einer kleinen Teilmenge von Modellparametern, während der Großteil der vorab trainierten Large Language Models (LLMs) eingefroren bleibt, was zu einer erheblichen Reduzierung der Rechenressourcen und des Energieverbrauchs führt.

4. Daten komprimieren und energiesparenden Speicher nutzen

Implementieren Sie Datenkomprimierungstechniken, um die übertragene Datenmenge zu reduzieren. Komprimierte Daten erfordern weniger Energie für die Übertragung und belegen weniger Speicherplatz auf der Festplatte. Während der Modellbereitstellungsphase kann die Verwendung eines Caches dazu beitragen, die Anzahl der Aufrufe an die Online-Speicherschicht zu reduzieren und dadurch die Anzahl der Aufrufe zu verringern

Darüber hinaus kann die Auswahl der richtigen Speichertechnologie zu erheblichen Gewinnen führen. Zum Beispiel. AWS Glacier ist eine effiziente Datenarchivierungslösung und kann ein nachhaltigerer Ansatz als die Verwendung von S3 sein, wenn auf die Daten nicht häufig zugegriffen werden muss.

5. Trainieren Sie Modelle zu sauberer Energie

Wenn Sie einen Cloud-Dienst für das Modelltraining verwenden, können Sie die Region auswählen, in der die Berechnungen durchgeführt werden sollen. Wählen Sie eine Region, die zu diesem Zweck erneuerbare Energiequellen nutzt, und Sie können die Emissionen um bis zu reduzieren 30 mal. AWS Blog-Post skizziert die Balance zwischen der Optimierung von Geschäfts- und Nachhaltigkeitszielen.

Eine weitere Möglichkeit besteht darin, den passenden Zeitpunkt für die Ausführung des Modells auszuwählen. Zu bestimmten Tageszeiten; Die Energie ist sauberer und solche Daten können über einen kostenpflichtigen Dienst wie z. B. erfasst werden Stromkarte, das Zugriff auf Echtzeitdaten und Zukunftsvorhersagen zur Kohlenstoffintensität von Strom in verschiedenen Regionen bietet.

6. Nutzen Sie spezialisierte Rechenzentren und Hardware für das Modelltraining

Die Wahl effizienterer Rechenzentren und Hardware kann einen großen Unterschied bei der COXNUMX-Intensität machen. ML-spezifische Rechenzentren und Hardware können sein 1.4-2 und 2-5 mal energieeffizienter als die allgemeinen.

7. Verwenden Sie serverlose Bereitstellungen wie AWS Lambda und Azure Functions

Herkömmliche Bereitstellungen erfordern, dass der Server ständig eingeschaltet ist, was einen Energieverbrauch rund um die Uhr bedeutet. Serverlose Bereitstellungen wie AWS Lambda und Azure Functions funktionieren einwandfrei und weisen eine minimale CO24-Intensität auf.

Der KI-Sektor erlebt ein exponentielles Wachstum und durchdringt alle Facetten des Geschäftslebens und des täglichen Lebens. Diese Ausweitung hat jedoch ihren Preis – einen wachsenden CO1-Fußabdruck, der uns weiter von dem Ziel zu entfernen droht, den globalen Temperaturanstieg auf nur XNUMX °C zu begrenzen.

Dieser COXNUMX-Fußabdruck ist nicht nur ein aktuelles Problem; Ihre Auswirkungen können sich über Generationen hinweg erstrecken und diejenigen betreffen, die keine Verantwortung für ihre Entstehung tragen. Daher ist es unerlässlich, entschlossene Maßnahmen zu ergreifen, um die COXNUMX-Emissionen im Zusammenhang mit der KI zu verringern und nachhaltige Wege zur Nutzung ihres Potenzials zu erkunden. Es ist von entscheidender Bedeutung, sicherzustellen, dass die Vorteile der KI nicht auf Kosten der Umwelt und des Wohlergehens künftiger Generationen gehen.

Ankur Gupta ist ein führender Ingenieur mit einem Jahrzehnt Erfahrung in den Bereichen Nachhaltigkeit, Transport, Telekommunikation und Infrastruktur; bekleidet derzeit die Position des Engineering Managers bei Uber. In dieser Rolle spielt er eine entscheidende Rolle bei der Weiterentwicklung der Fahrzeugplattform von Uber und leitet den Weg in eine emissionsfreie Zukunft durch die Integration modernster elektrischer und vernetzter Fahrzeuge.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- PlatoData.Network Vertikale generative KI. Motiviere dich selbst. Hier zugreifen.

- PlatoAiStream. Web3-Intelligenz. Wissen verstärkt. Hier zugreifen.

- PlatoESG. Kohlenstoff, CleanTech, Energie, Umwelt, Solar, Abfallwirtschaft. Hier zugreifen.

- PlatoHealth. Informationen zu Biotechnologie und klinischen Studien. Hier zugreifen.

- Quelle: https://www.kdnuggets.com/greening-ai-7-strategies-to-make-applications-more-sustainable?utm_source=rss&utm_medium=rss&utm_campaign=greening-ai-7-strategies-to-make-applications-more-sustainable

- :hast

- :Ist

- :nicht

- :Wo

- $UP

- 1

- 1.3

- 12

- 15%

- 2021

- 2030

- 7

- 9

- a

- Zugang

- Zugriff

- zugänglich

- Konto

- entfielen

- Buchhaltung

- Genauigkeit

- erreicht

- ACM

- erworben

- über

- Aktionen

- aktiv

- automatisch

- Zusatz

- Zusätzliche

- Adresse

- Adressierung

- angemessen

- Förderung

- beeinflussen

- AI

- KI-Modelle

- KI-Systeme

- LUFT

- Klimaanlage

- AL

- Algorithmen

- bereits

- ebenfalls

- Obwohl

- immer

- Amazon

- Betrag

- an

- Analysen

- und

- und Infrastruktur

- Ein anderer

- Anwendung

- Anwendungen

- Ansatz

- SIND

- Bereiche

- um

- AS

- At

- erreichen

- Versuche

- Autoren

- verfügbar

- Alleen

- durchschnittlich

- Luftfahrt

- ein Weg

- AWS

- AWS Lambda

- Azure

- Balance

- basierend

- BE

- Denken Sie

- werden

- wird

- Sein

- Vorteile

- Besser

- zwischen

- Engpässe

- bringen

- Geschäft

- aber

- by

- Cache-Speicher

- Berechnen

- Aufrufe

- CAN

- Fähigkeiten

- Kohlenstoff

- Kohlenstoff-Emissionen

- Carbon Footprint

- Häuser

- Centers

- sicher

- Übernehmen

- berechnen

- Auswählen

- behauptet

- aus aller Welt

- Clarity

- Ultrascha

- Cloud

- Cloud Computing

- Code

- Codes

- wie die

- kommt

- Ware

- Komplex

- Komplexität

- Komponenten

- Berechnung

- rechnerisch

- Berechnungen

- Berechnen

- Computing

- Hautpflegeprobleme

- über

- Bedenken

- durchgeführt

- Sie

- Verbindungen

- konsequenterweise

- Folglich

- Geht davon

- verbraucht

- Verbrauch

- trägt dazu bei

- Beiträger

- konventionellen

- Schaffung

- wichtig

- Zur Zeit

- innovativ, auf dem neuesten Stand

- Unterricht

- technische Daten

- Rechenzentren

- Datacenter

- Tag

- Jahrzehnte

- Entscheidung

- entscheidend

- verringert

- tief

- tiefe Lernen

- Demand

- einsetzen

- Implementierungen

- entworfen

- Entwickler

- Unterschied

- anders

- Richtung

- Abfluss

- Diversität

- do

- die

- Doge

- Domains

- erledigt

- Fahren

- zwei

- im

- e

- E & T

- Effektiv

- effizient

- Bemühungen

- Die elektrische

- Strom

- Stromverbrauch

- Stromverbrauch

- eingebettet

- Emissionen

- betont

- beschäftigt

- beschäftigt

- Energie

- Energy Consumption

- Entwicklung

- gewährleisten

- sorgt

- Gewährleistung

- Arbeitsumfeld

- Umwelt-

- Umweltbelange

- Equals

- essential

- schätzen

- geschätzt

- Äther (ETH)

- Sogar

- Jedes

- entwickelt

- Ausführung

- existiert

- Expansion

- ERFAHRUNGEN

- erleben

- Experiment

- ERKUNDEN

- exponentiell

- Exponentielles Wachstum

- erweitern

- extra

- FAST

- beschleunigt

- fehlerhaft

- wenige

- Abbildung

- Zahlen

- Ende

- flexibel

- Setzen Sie mit Achtsamkeit

- Folgende

- Fußabdruck

- Aussichten für

- Formel

- vorwärts

- Unser Ansatz

- häufig

- für

- eingefroren

- funktional

- funktioniert

- Funktionen

- weiter

- Zukunft

- Gewinne

- GAS

- Allgemeines

- erzeugen

- Generationen

- Global

- Kundenziele

- Ziele

- GPU

- allmählich

- Treibhausgas

- Treibhausgasemissionen

- Gitter

- Wachstum

- Hardware

- Nutzen

- Haben

- he

- schwer

- Hilfe

- daher

- höher

- hält

- aber

- HTTPS

- riesig

- Hungrig

- identifizieren

- IEA

- if

- Impact der HXNUMXO Observatorien

- Imperativ

- Umsetzung

- wichtig

- Verbesserung

- in

- inklusive

- Aufnahme

- Erhöhung

- hat

- Steigert

- zunehmend

- Energiegewinnung

- informiert

- Infrastruktur

- Instanz

- Instanzen

- Integration

- Intel

- Intervention

- in

- beinhaltet

- IT

- SEINE

- jpg

- nur

- KDnuggets

- Aufbewahrung

- Wissen

- Mangel

- Sprache

- grosse

- Schicht

- führen

- Führer

- Führung

- führenden

- lernen

- weniger

- Gefällt mir

- Limitiert

- Ortsbasierend

- senken

- Maschine

- Maschinelles Lernen

- gemacht

- Dur

- Mehrheit

- um

- MACHT

- Making

- verwalten

- Manager

- viele

- Kann..

- Mittel

- messen

- Messen

- Memory

- Methodologien

- Methodik

- minimal

- minimieren

- Mildern

- Milderung

- ML

- Modell

- für

- mehr

- effizienter

- sollen

- Need

- Bedürfnisse

- Netzwerk

- Neural

- neuronale Netzwerk

- dennoch

- nicht

- Anzahl

- Nvidia

- besetzt

- of

- Angebote

- vorgenommen,

- on

- EINEM

- Einsen

- Online

- einzige

- betreiben

- Betriebs-

- Einkauf & Prozesse

- rechtzeitig

- Optimierung

- Optimieren

- Optimierung

- Option

- or

- Andere

- Umrissen

- Frieden

- bezahlt

- Papier

- Parameter

- Weg

- für

- Prozent

- ausführen

- Leistung

- Jürgen

- Phase

- wählen

- zentrale

- Plattform

- Plato

- Datenintelligenz von Plato

- PlatoData

- spielt

- Position

- besitzen

- Potenzial

- Werkzeuge

- Powering

- präzise

- Prognosen

- Gegenwart

- Drücken

- in erster Linie

- Priorität einräumen

- Prozessdefinierung

- Verarbeitung

- Prozessor

- Profiling

- Programmierung

- Fortschritt

- Treiben

- bietet

- Zweck

- RAM

- Echtzeit

- Echtzeitdaten

- Veteran

- Reduziert

- Reduzierung

- Ermäßigungen

- bezieht sich

- raffiniert

- in Bezug auf

- Region

- Regionen

- zuverlässig

- verlassen

- Entfernen

- Erneuerbar

- erneuerbare Energie

- Auswirkungen

- representiert

- erfordern

- erfordert

- Forschungsprojekte

- Downloads

- Verantwortung

- Folge

- was zu

- Die Ergebnisse

- Halte

- Recht

- Rollen

- Führen Sie

- s

- opfern

- Said

- Skalieren

- SCI

- Bibliotheken

- Auswahl

- Sensitivität

- Server

- Serverlos

- Dienst

- Teilen

- sollte

- Konzerte

- signifikant

- bedeutend

- ähnlich

- da

- Single

- klein

- kleinere

- Software

- Lösung

- Quellen

- Raumfahrt

- überspannend

- spezialisiert

- gespalten

- steuern

- Schritt

- Immer noch

- Stoppen

- Lagerung

- Strategien

- Strukturen

- Fach

- wesentlich

- so

- geeignet

- übertreffen

- Umgebung

- Nachhaltigkeit

- nachhaltiger

- System

- Systeme und Techniken

- T

- Nehmen

- nimmt

- Aufgabe

- und Aufgaben

- Technik

- Techniken

- Technologie

- Telekommunikations

- als

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- ihr

- Sie

- dann

- Dort.

- damit

- deswegen

- Diese

- vom Nutzer definierten

- fehlen uns die Worte.

- diejenigen

- droht

- Durch

- So

- Zeit

- mal

- Titan

- zu

- Werkzeug

- Werkzeuge

- gegenüber

- traditionell

- Training

- trainiert

- Ausbildung

- privaten Transfer

- , des Transports

- Trend

- XNUMX

- Uber

- Unglücklicherweise

- Einheit

- nicht wie

- beispiellos

- beispiellos

- us

- Anwendungsbereich

- -

- verwendet

- Verwendung von

- gültig

- Fahrzeuge

- lebenswichtig

- Wege

- Was

- während

- welche

- während

- WHO

- deren

- warum

- werden wir

- Weisheit

- mit

- Arbeiten

- schreiben

- Schreiben

- X

- Erträge

- U

- Ihr

- Zephyrnet