Betydningen af datavarehuse og analyser udført på datavarehusplatforme er steget støt gennem årene, hvor mange virksomheder er kommet til at stole på disse systemer som missionskritiske for både kortsigtet operationel beslutningstagning og langsigtet strategisk planlægning. Traditionelt opdateres datavarehuse i batch-cyklusser, for eksempel månedligt, ugentligt eller dagligt, så virksomheder kan få forskellige indsigter fra dem.

Mange organisationer er klar over, at dataindtagelse næsten i realtid sammen med avancerede analyser åbner op for nye muligheder. For eksempel kan et finansielt institut forudsige, om en kreditkorttransaktion er svigagtig, ved at køre et program til registrering af uregelmæssigheder i næsten-realtidstilstand snarere end i batch-tilstand.

I dette indlæg viser vi hvordan Amazon rødforskydning kan levere streaming-indtagelse og maskinlæring (ML) forudsigelser på én platform.

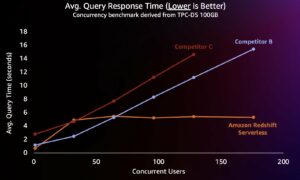

Amazon Redshift er et hurtigt, skalerbart, sikkert og fuldt administreret cloud-datavarehus, der gør det enkelt og omkostningseffektivt at analysere alle dine data ved hjælp af standard SQL.

Amazon Redshift ML gør det nemt for dataanalytikere og databaseudviklere at skabe, træne og anvende ML-modeller ved hjælp af velkendte SQL-kommandoer i Amazon Redshift-datavarehuse.

Vi er spændte på at lancere Amazon Redshift Streaming Indtagelse forum Amazon Kinesis datastrømme , Amazon administrerede streaming til Apache Kafka (Amazon MSK), som giver dig mulighed for at indtage data direkte fra en Kinesis-datastrøm eller Kafka-emne uden at skulle iscenesætte dataene i Amazon Simple Storage Service (Amazon S3). Amazon Redshift-streamingindtagelse giver dig mulighed for at opnå lav latenstid i størrelsesordenen sekunder, mens du indtager hundredvis af megabyte data i dit datavarehus.

Dette indlæg demonstrerer, hvordan Amazon Redshift, skydatavarehuset giver dig mulighed for at bygge ML-forudsigelser i næsten realtid ved at bruge Amazon Redshift-streamingindtagelse og Redshift ML-funktioner med velkendt SQL-sprog.

Løsningsoversigt

Ved at følge de trin, der er beskrevet i dette indlæg, vil du være i stand til at konfigurere en producer streamer-applikation på en Amazon Elastic Compute Cloud (Amazon EC2) instans, der simulerer kreditkorttransaktioner og skubber data til Kinesis Data Streams i realtid. Du opsætter en Amazon Redshift Streaming Ingestion materialiseret visning på Amazon Redshift, hvor streamingdata modtages. Du træner og bygger en Redshift ML-model til at generere realtidsslutninger mod streamingdataene.

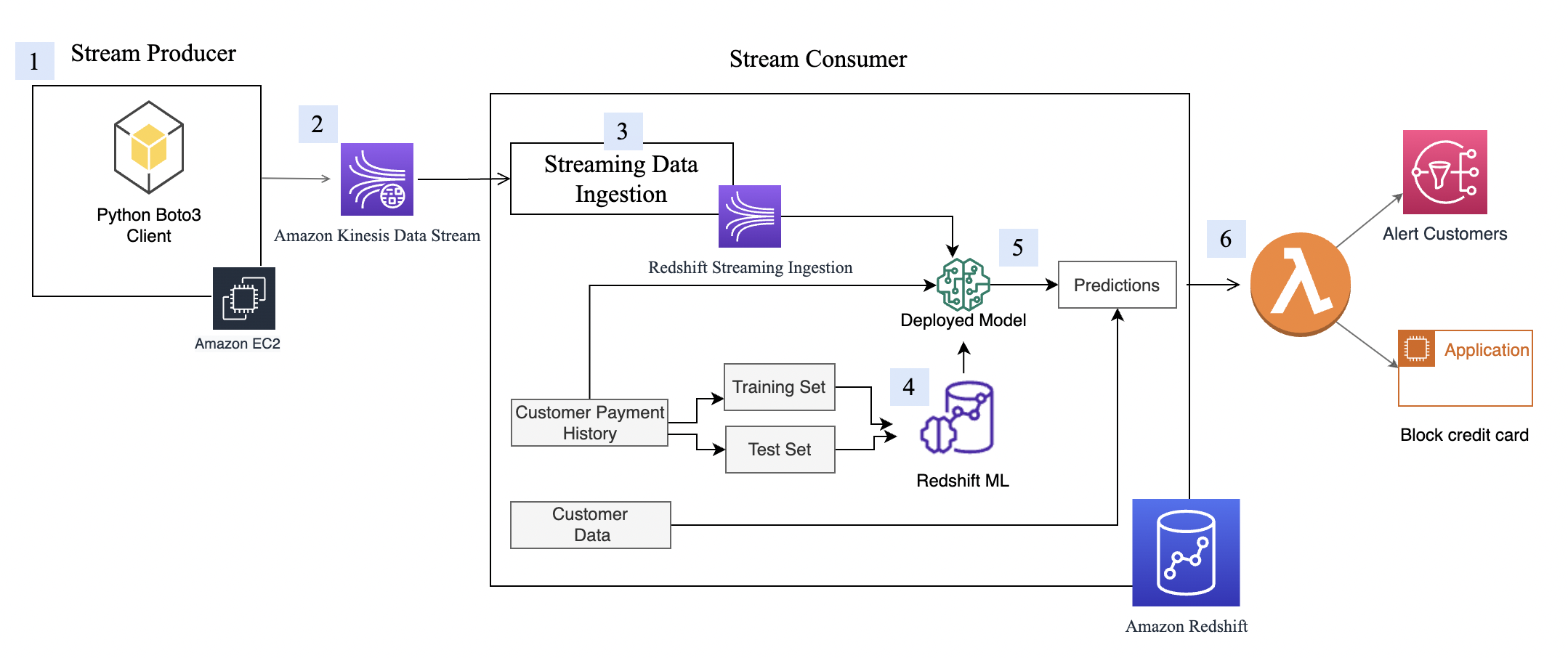

Følgende diagram illustrerer arkitekturen og procesflowet.

Trin-for-trin processen er som følger:

- EC2-instansen simulerer en kreditkorttransaktionsapplikation, som indsætter kreditkorttransaktioner i Kinesis-datastrømmen.

- Datastrømmen gemmer de indgående kreditkorttransaktionsdata.

- En Amazon Redshift Streaming Ingestion materialiseret visning oprettes oven på datastrømmen, som automatisk indtager streaming data i Amazon Redshift.

- Du bygger, træner og implementerer en ML-model ved hjælp af Redshift ML. Redshift ML-modellen trænes ved hjælp af historiske transaktionsdata.

- Du transformerer streamingdataene og genererer ML-forudsigelser.

- Du kan advare kunder eller opdatere applikationen for at mindske risikoen.

Denne gennemgang bruger streamingdata for kreditkorttransaktioner. Kreditkorttransaktionsdataene er fiktive og er baseret på en simulator. Kundedatasættet er også fiktivt og genereres med nogle tilfældige datafunktioner.

Forudsætninger

- Opret en Amazon Redshift-klynge.

- Konfigurer klyngen til at bruge Redshift ML.

- Opret an AWS identitets- og adgangsstyring (IAM) bruger.

- Opdater IAM-rollen knyttet til Redshift-klyngen for at inkludere tilladelser til at få adgang til Kinesis-datastrømmen. For mere information om den påkrævede politik, se Kom godt i gang med streaming.

- Opret en m5.4xlarge EC2-instans. Vi testede Producer-applikation med m5.4xlarge-instans, men du kan frit bruge en anden instanstype. Når du opretter forekomsten, skal du bruge amzn2-ami-kernel-5.10-hvm-2.0.20220426.0-x86_64-gp2 AMI.

- For at sikre, at Python3 er installeret i EC2-instansen, skal du køre følgende kommando for at verificere din Python-version (bemærk, at dataudtræksscriptet kun virker på Python 3):

- Installer følgende afhængige pakker for at køre simulatorprogrammet:

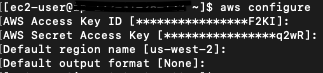

- Konfigurer Amazon EC2 ved hjælp af variabler som AWS-legitimationsoplysninger genereret til IAM-bruger oprettet i trin 3 ovenfor. Følgende skærmbillede viser et eksempel ved hjælp af aws konfigurere.

Konfigurer Kinesis Data Streams

Amazon Kinesis Data Streams er en massivt skalerbar og holdbar datastreamingtjeneste i realtid. Den kan kontinuerligt fange gigabyte data i sekundet fra hundredtusindvis af kilder, såsom website-klikstrømme, databasehændelsesstreams, økonomiske transaktioner, sociale medier-feeds, it-logfiler og placeringssporingshændelser. De indsamlede data er tilgængelige på millisekunder for at muliggøre brugssager med analyser i realtid, såsom dashboards i realtid, registrering af anomalier i realtid, dynamisk prissætning og mere. Vi bruger Kinesis Data Streams, fordi det er en serverløs løsning, der kan skaleres baseret på brug.

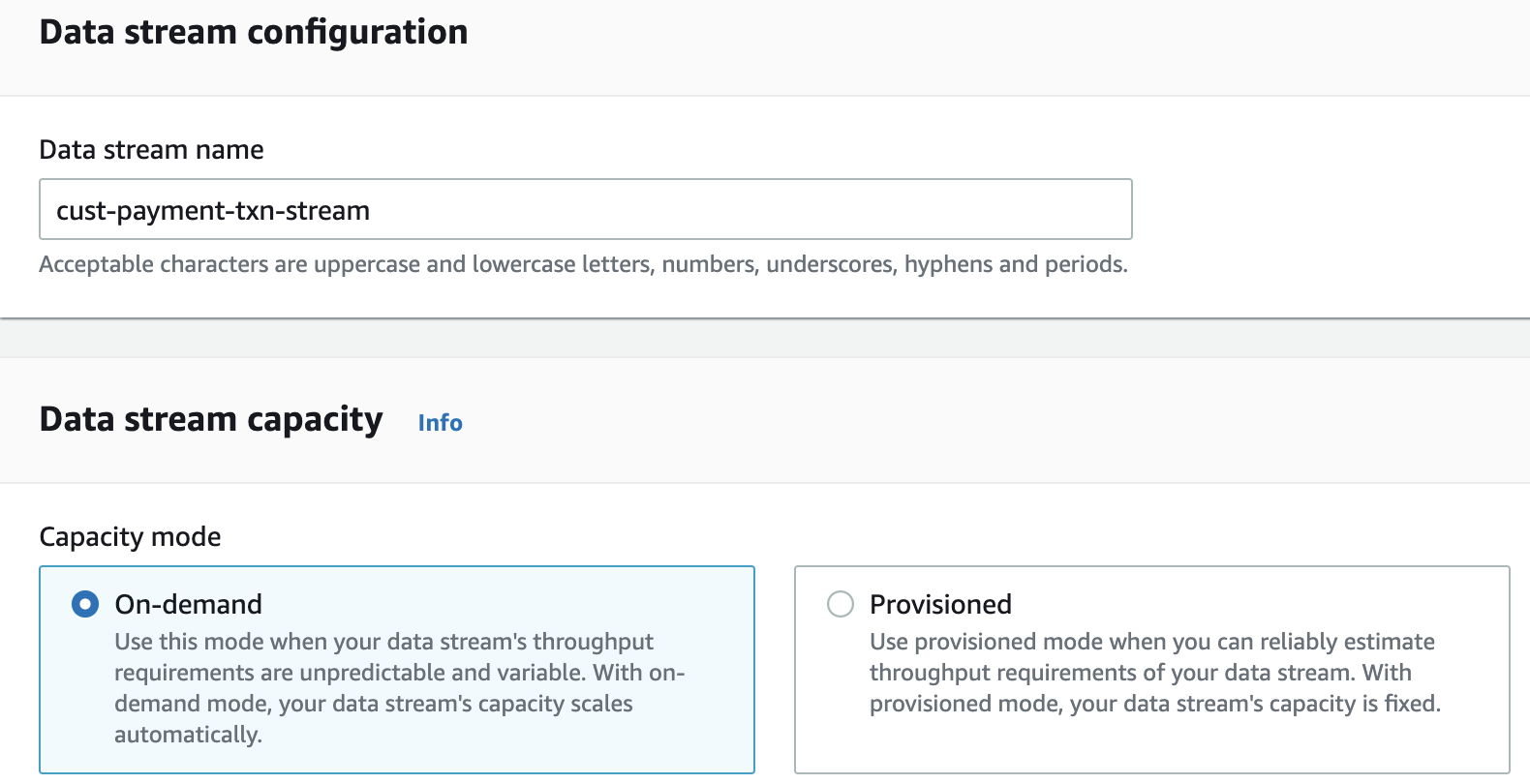

Opret en Kinesis-datastrøm

Først skal du oprette en Kinesis-datastrøm for at modtage streamingdataene:

- Vælg på Amazon Kinesis-konsollen Datastrømme i navigationsruden.

- Vælg Opret datastrøm.

- Til Navn på datastrøm, gå ind

cust-payment-txn-stream. - Til Kapacitetstilstand, Vælg On-demand.

- For resten af mulighederne skal du vælge standardindstillingerne og følge vejledningen for at fuldføre opsætningen.

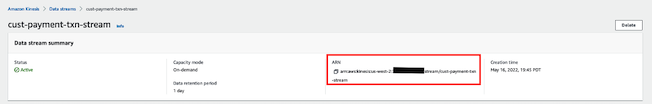

- Indfang ARN for den oprettede datastrøm til brug i næste afsnit, når du definerer din IAM-politik.

Konfigurer tilladelser

For at en streamingapplikation kan skrive til Kinesis Data Streams, skal applikationen have adgang til Kinesis. Du kan bruge følgende politikerklæring til at give simulatorprocessen, som du opsætter i næste afsnit, adgang til datastrømmen. Brug ARN for den datastrøm, du gemte i det foregående trin.

Konfigurer stream-producenten

Før vi kan forbruge streamingdata i Amazon Redshift, har vi brug for en streamingdatakilde, der skriver data til Kinesis-datastrømmen. Dette indlæg bruger en specialbygget datagenerator og AWS SDK til Python (Boto3) at offentliggøre dataene til datastrømmen. For opsætningsinstruktioner, se Producersimulator. Denne simulatorproces udgiver streamingdata til datastrømmen oprettet i det foregående trin (cust-payment-txn-stream).

Konfigurer stream-forbrugeren

Dette afsnit taler om konfiguration af stream-forbrugeren (Amazon Redshift-streamingindtagelsesvisningen).

Amazon Redshift Streaming Ingestion giver lav latens, højhastighedsindtagelse af streaming data fra Kinesis Data Streams til en Amazon Redshift materialiseret visning. Du kan konfigurere din Amazon Redshift-klynge til at aktivere streaming-indtagelse og skabe en materialiseret visning med automatisk opdatering ved hjælp af SQL-sætninger, som beskrevet i Oprettelse af materialiserede visninger i Amazon Redshift. Den automatiske materialiserede visningsopdateringsproces indtager streamingdata med hundredvis af megabyte data pr. sekund fra Kinesis Data Streams til Amazon Redshift. Dette resulterer i hurtig adgang til eksterne data, som hurtigt opdateres.

Når du har oprettet den materialiserede visning, kan du få adgang til dine data fra datastrømmen ved hjælp af SQL og forenkle dine datapipelines ved at oprette materialiserede visninger direkte oven på strømmen.

Fuldfør følgende trin for at konfigurere en Amazon Redshift streaming materialiseret visning:

- På IAM-konsollen skal du vælge politikker i navigationsruden.

- Vælg Lav politik.

- Opret en ny IAM-politik kaldet

KinesisStreamPolicy. For definitionen af streamingpolitikken, se Kom godt i gang med streaming. - Vælg i navigationsruden roller.

- Vælg Opret rolle.

- Type AWS-tjeneste Og vælg Redshift og Redshift kan tilpasses.

- Opret en ny rolle kaldet

redshift-streaming-roleog vedhæft politikkenKinesisStreamPolicy. - Opret et eksternt skema til at knytte til Kinesis Data Streams:

Nu kan du oprette en materialiseret visning for at forbruge strømdataene. Du kan bruge SUPER-datatypen til at gemme nyttelasten, som den er, i JSON-format, eller bruge Amazon Redshift JSON-funktioner til at parse JSON-dataene i individuelle kolonner. Til dette indlæg bruger vi den anden metode, fordi skemaet er veldefineret.

- Opret den materialiserede streamingoptagelsesvisning

cust_payment_tx_stream. Ved at angive AUTO OPDATERING JA i følgende kode, kan du aktivere automatisk opdatering af streamingindtagelsesvisningen, hvilket sparer tid ved at undgå at bygge datapipelines:

Bemærk, at json_extract_path_text har en længdebegrænsning på 64 KB. From_varbye filtrerer også poster større end 65KB.

- Opdater dataene.

Amazon Redshift streaming materialiseret visning opdateres automatisk af Amazon Redshift for dig. På denne måde behøver du ikke bekymre dig om forældet data. Med automatisk opdatering af materialiseret visning indlæses data automatisk i Amazon Redshift, når de bliver tilgængelige i strømmen. Hvis du vælger at udføre denne handling manuelt, skal du bruge følgende kommando:

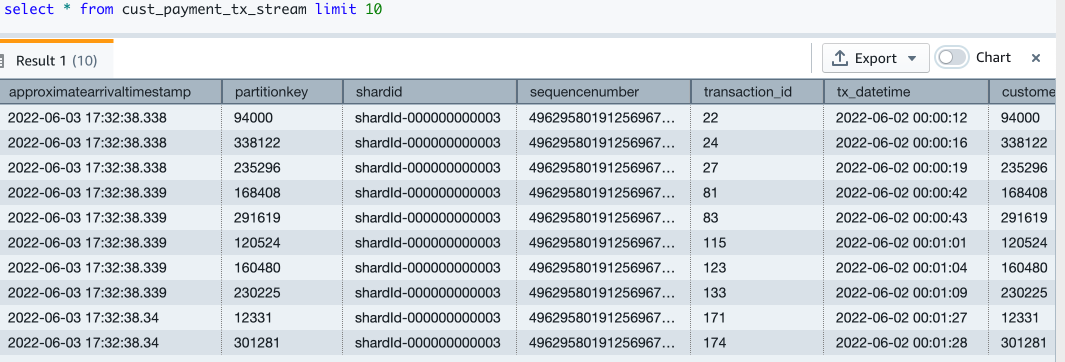

- Lad os nu forespørge på den streamingmaterialiserede visning for at se eksempeldata:

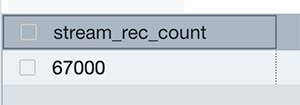

- Lad os se, hvor mange poster der er i streamingvisningen nu:

Nu er du færdig med at opsætte Amazon Redshift-streamingindtagelsesvisningen, som løbende opdateres med indgående kreditkorttransaktionsdata. I min opsætning kan jeg se, at omkring 67,000 poster er blevet trukket ind i streamingvisningen på det tidspunkt, hvor jeg kørte min forespørgsel om udvalgt antal. Dette nummer kan være anderledes for dig.

Rødforskydning ML

Med Redshift ML kan du medbringe en fortrænet ML-model eller bygge en native. For mere information, se Brug af maskinlæring i Amazon Redshift.

I dette indlæg træner og bygger vi en ML-model ved hjælp af et historisk datasæt. Dataene indeholder en tx_fraud felt, der markerer en historisk transaktion som svigagtig eller ej. Vi bygger en overvåget ML-model ved hjælp af Redshift Auto ML, som lærer af dette datasæt og forudsiger indgående transaktioner, når disse køres gennem forudsigelsesfunktionerne.

I de følgende afsnit viser vi, hvordan du opsætter det historiske datasæt og kundedata.

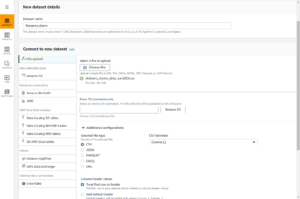

Indlæs det historiske datasæt

Den historiske tabel har flere felter end hvad streamingdatakilden har. Disse felter indeholder kundens seneste forbrug og terminalrisikoscore, såsom antallet af svigagtige transaktioner beregnet ved at transformere streamingdata. Der er også kategoriske variabler som weekendtransaktioner eller natlige transaktioner.

For at indlæse de historiske data skal du køre kommandoerne ved hjælp af Amazon Redshift forespørgselseditor.

Opret transaktionshistoriktabellen med følgende kode. DDL kan også findes på GitHub.

Lad os tjekke, hvor mange transaktioner der er indlæst:

Tjek trenden for månedlige og ikke-bedrageriske transaktioner:

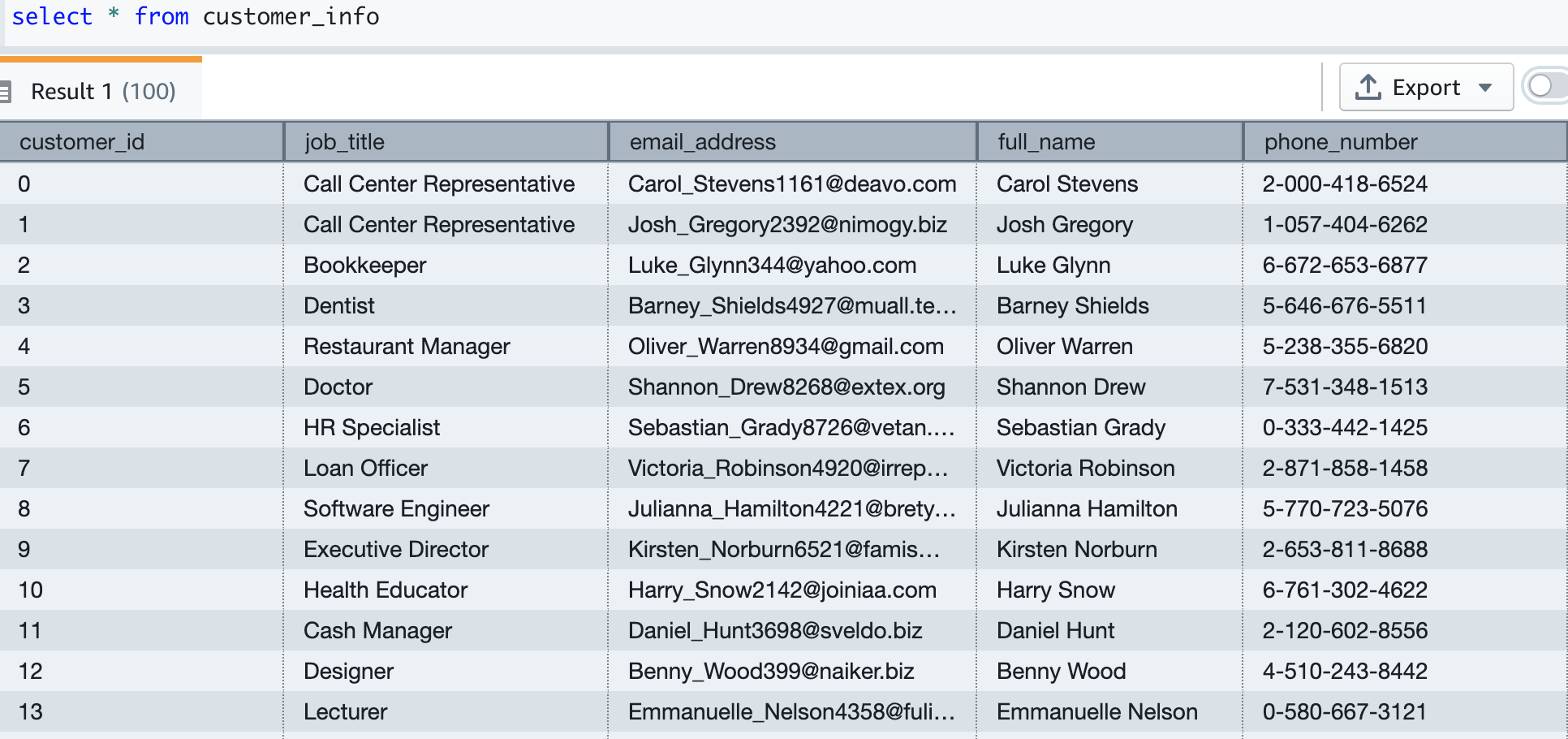

Opret og indlæs kundedata

Nu opretter vi kundetabellen og indlæser data, som indeholder e-mail og telefonnummer på kunden. Følgende kode opretter tabellen, indlæser dataene og prøver tabellen. Tabellen DDL er tilgængelig på GitHub.

Vores testdata har omkring 5,000 kunder. Følgende skærmbillede viser eksempler på kundedata.

Byg en ML-model

Vores historiske korttransaktionstabel har 6 måneders data, som vi nu bruger til at træne og teste ML-modellen.

Modellen tager følgende felter som input:

Vi får tx_fraud som output.

Vi opdeler disse data i trænings- og testdatasæt. Transaktioner fra 2022-04-01 til 2022-07-31 er for træningssættet. Transaktioner fra 2022-08-01 til 2022-09-30 bruges til testsættet.

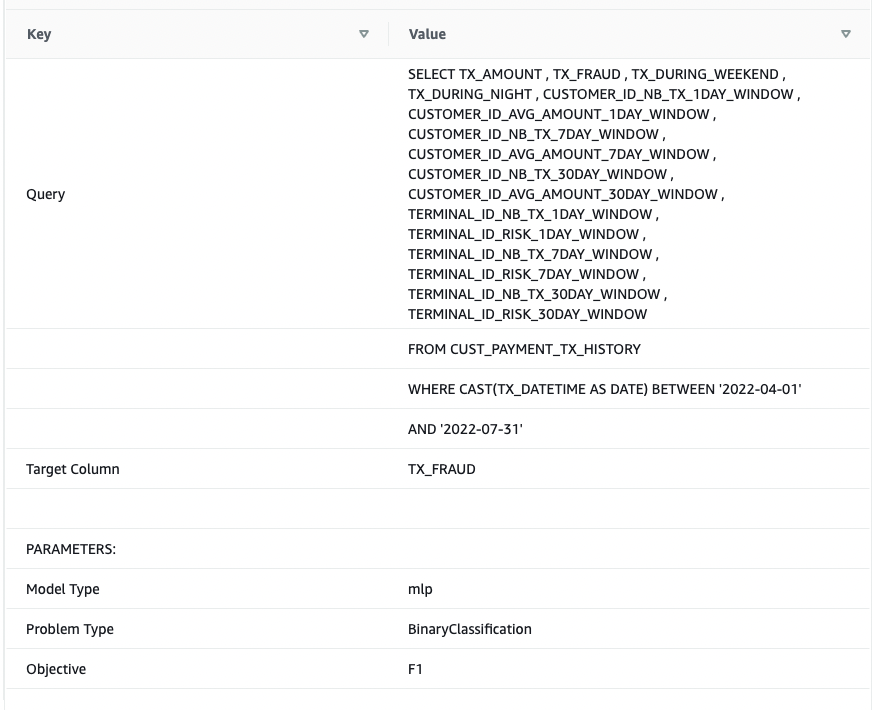

Lad os skabe ML-modellen ved hjælp af den velkendte SQL CREATE MODEL statement. Vi bruger en grundlæggende form for Redshift ML-kommandoen. Følgende metode bruger Amazon SageMaker Autopilot, som udfører dataforberedelse, feature engineering, modelvalg og træning automatisk for dig. Angiv navnet på din S3-spand, der indeholder koden.

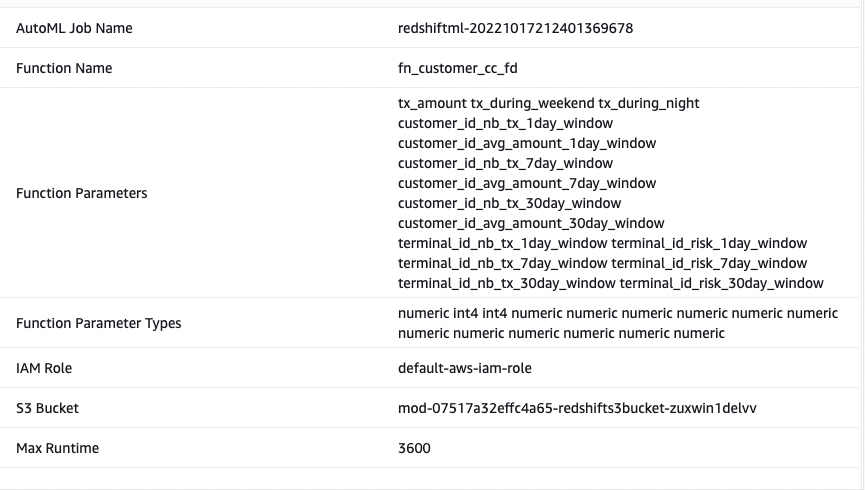

Jeg kalder ML-modellen som Cust_cc_txn_fd, og forudsigelsesfunktionen som fn_customer_cc_fd. FROM-sætningen viser inputkolonnerne fra den historiske tabel public.cust_payment_tx_history. Målparameteren er sat til tx_fraud, som er den målvariabel, som vi forsøger at forudsige. IAM_Role er indstillet til standard, fordi klyngen er konfigureret med denne rolle; hvis ikke, skal du give din Amazon Redshift-klynge IAM-rolle ARN. Jeg indstillede max_runtime til 3,600 sekunder, hvilket er den tid, vi giver SageMaker for at fuldføre processen. Redshift ML implementerer den bedste model, der er identificeret i denne tidsramme.

Afhængigt af modellens kompleksitet og mængden af data, kan det tage noget tid, før modellen er tilgængelig. Hvis du finder ud af, at dit modelvalg ikke er fuldført, skal du øge værdien for max_runtime. Du kan indstille en maksimal værdi på 9999.

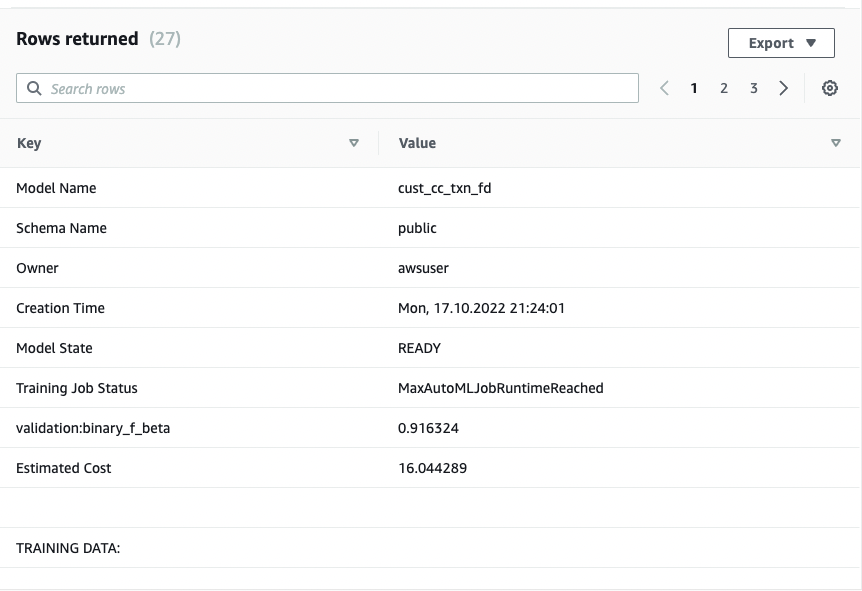

CREATE MODEL-kommandoen køres asynkront, hvilket betyder, at den kører i baggrunden. Du kan bruge VIS MODEL kommando for at se modellens status. Når status viser som Klar, betyder det, at modellen er trænet og implementeret.

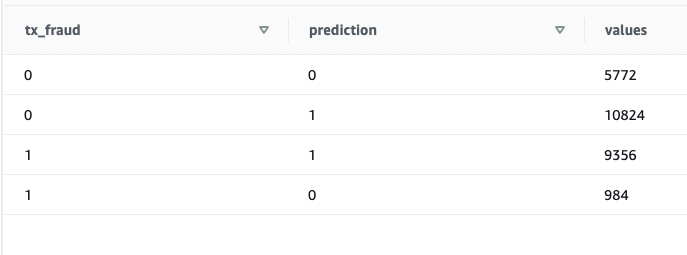

Følgende skærmbilleder viser vores output.

Ud fra outputtet kan jeg se, at modellen er blevet korrekt genkendt som BinaryClassification, og F1 er valgt som mål. Det f1 score er en metrik, der tager hensyn til begge dele præcision og genkaldelse. Det returnerer en værdi mellem 1 (perfekt præcision og genkaldelse) og 0 (lavest mulig score). I mit tilfælde er det 0.91. Jo højere værdi, jo bedre modelydelse.

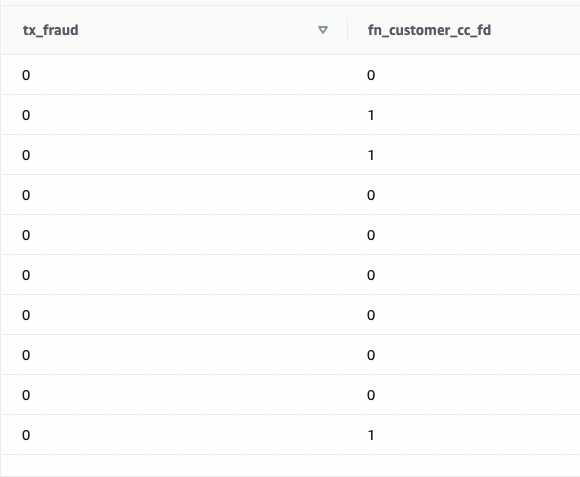

Lad os teste denne model med testdatasættet. Kør følgende kommando, som henter eksempelforudsigelser:

Vi ser, at nogle værdier matcher, og nogle gør det ikke. Lad os sammenligne forudsigelser med sandheden:

Vi validerede, at modellen virker, og F1-score er god. Lad os gå videre til at generere forudsigelser om streaming af data.

Forudsige svigagtige transaktioner

Fordi Redshift ML-modellen er klar til brug, kan vi bruge den til at køre forudsigelserne mod streamingdataindtagelse. Det historiske datasæt har flere felter, end hvad vi har i streamingdatakilden, men de er kun aktualitets- og frekvensmålinger omkring kunden og terminalrisikoen for en svigagtig transaktion.

Vi kan anvende transformationerne oven på streamingdataene meget nemt ved at indlejre SQL'en i visningerne. Opret første udsigt, som samler streamingdata på kundeniveau. Opret derefter anden udsigt, som samler streamingdata på terminalniveau, og tredje syn, som kombinerer indgående transaktionsdata med kunde- og terminalaggregerede data og kalder forudsigelsesfunktionen på ét sted. Koden til den tredje visning er som følger:

Kør en SELECT-sætning på visningen:

Når du kører SELECT-sætningen gentagne gange, gennemgår de seneste kreditkorttransaktioner transformationer og ML-forudsigelser i næsten realtid.

Dette demonstrerer kraften ved Amazon Redshift – med brugervenlige SQL-kommandoer kan du transformere streamingdata ved at anvende komplekse vinduesfunktioner og anvende en ML-model til at forudsige svigagtige transaktioner i ét trin uden at bygge komplekse datapipelines eller bygge og administrere yderligere infrastruktur.

Udvid løsningen

Fordi datastrømmene ind og ML-forudsigelser er lavet i næsten realtid, kan du opbygge forretningsprocesser til at advare din kunde vha. Amazon Simple Notification Service (Amazon SNS), eller du kan låse kundens kreditkortkonto i et driftssystem.

Dette indlæg går ikke ind på detaljerne i disse operationer, men hvis du er interesseret i at lære mere om at bygge begivenhedsdrevne løsninger ved hjælp af Amazon Redshift, henvises til følgende GitHub repository.

Ryd op

For at undgå fremtidige gebyrer skal du slette de ressourcer, der blev oprettet som en del af dette indlæg.

Konklusion

I dette indlæg demonstrerede vi, hvordan man konfigurerer en Kinesis-datastrøm, konfigurerer en producent og udgiver data til streams og derefter opretter en Amazon Redshift Streaming-indtagelsesvisning og forespørger dataene i Amazon Redshift. Efter at dataene var i Amazon Redshift-klyngen, demonstrerede vi, hvordan man træner en ML-model og bygger en forudsigelsesfunktion og anvender den mod streamingdataene for at generere forudsigelser næsten i realtid.

Hvis du har feedback eller spørgsmål, bedes du efterlade dem i kommentarerne.

Om forfatterne

Bhanu Pittampally er en Analytics Specialist Solutions Architect baseret i Dallas. Han har specialiseret sig i at bygge analytiske løsninger. Hans baggrund er i datavarehuse – arkitektur, udvikling og administration. Han har været inden for data- og analyseområdet i over 15 år.

Bhanu Pittampally er en Analytics Specialist Solutions Architect baseret i Dallas. Han har specialiseret sig i at bygge analytiske løsninger. Hans baggrund er i datavarehuse – arkitektur, udvikling og administration. Han har været inden for data- og analyseområdet i over 15 år.

Praveen Kadipikonda er en Senior Analytics Specialist Solutions Architect hos AWS med base i Dallas. Han hjælper kunder med at bygge effektive, effektive og skalerbare analytiske løsninger. Han har arbejdet med opbygning af databaser og data warehouse-løsninger i over 15 år.

Praveen Kadipikonda er en Senior Analytics Specialist Solutions Architect hos AWS med base i Dallas. Han hjælper kunder med at bygge effektive, effektive og skalerbare analytiske løsninger. Han har arbejdet med opbygning af databaser og data warehouse-løsninger i over 15 år.

Ritesh Kumar Sinha er en Analytics Specialist Solutions Architect baseret i San Francisco. Han har hjulpet kunder med at bygge skalerbar data warehousing og big data-løsninger i over 16 år. Han elsker at designe og bygge effektive end-to-end-løsninger på AWS. I sin fritid elsker han at læse, gå og lave yoga.

Ritesh Kumar Sinha er en Analytics Specialist Solutions Architect baseret i San Francisco. Han har hjulpet kunder med at bygge skalerbar data warehousing og big data-løsninger i over 16 år. Han elsker at designe og bygge effektive end-to-end-løsninger på AWS. I sin fritid elsker han at læse, gå og lave yoga.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. Adgang her.

- Kilde: https://aws.amazon.com/blogs/big-data/near-real-time-fraud-detection-using-amazon-redshift-streaming-ingestion-with-amazon-kinesis-data-streams-and-amazon-redshift-ml/

- 000

- 000 kunder

- 1

- 10

- 100

- 11

- 15 år

- 67

- 7

- 9

- a

- I stand

- Om

- over

- adgang

- Konto

- opnå

- Handling

- Yderligere

- administration

- fremskreden

- Efter

- mod

- Alert

- Alle

- tillader

- Amazon

- Amazon EC2

- Amazon Kinesis

- beløb

- Analytikere

- Analytisk

- analytics

- analysere

- ,

- afsløring af anomalier

- Apache

- Anvendelse

- Indløs

- Anvendelse

- arkitektur

- omkring

- vedhæfte

- auto

- Automatisk Ur

- automatisk

- til rådighed

- undgå

- AWS

- baggrund

- baseret

- grundlæggende

- fordi

- bliver

- BEDSTE

- Bedre

- mellem

- Big

- Big data

- bringe

- bygge

- Bygning

- virksomhed

- forretningsprocesser

- virksomheder

- ringe

- kaldet

- Opkald

- fange

- kort

- tilfælde

- tilfælde

- karakter

- afgifter

- kontrollere

- Vælg

- By

- Cloud

- Cluster

- kode

- Kolonner

- kombinerer

- kommer

- kommentarer

- sammenligne

- fuldføre

- færdiggøre

- komplekse

- kompleksitet

- Compute

- anser

- Konsol

- forbruge

- forbruger

- indeholder

- omkostningseffektiv

- kunne

- skabe

- oprettet

- skaber

- Oprettelse af

- Legitimationsoplysninger

- kredit

- kreditkort

- kunde

- kundedata

- Kunder

- cykler

- dagligt

- Dallas

- data

- Dataforberedelse

- datalager

- datavarehuse

- Database

- databaser

- datasæt

- Dato

- Beslutningstagning

- Standard

- definere

- levere

- demonstreret

- afhængig

- indsætte

- indsat

- udruller

- beskrevet

- Design

- detaljer

- Detektion

- udviklere

- Udvikling

- forskellige

- direkte

- Er ikke

- gør

- Dont

- dow

- dynamisk

- nemt

- nem at bruge

- effekt

- effektiv

- muliggøre

- muliggør

- ende til ende

- Engineering

- Indtast

- Ether (ETH)

- begivenhed

- begivenheder

- eksempel

- ophidset

- ekstern

- udvinding

- f1

- bekendt

- FAST

- Feature

- Funktionalitet

- tilbagemeldinger

- felt

- Fields

- Filtre

- finansielle

- Finde

- flag

- flow

- følger

- efter

- følger

- formular

- format

- fundet

- FRAME

- Francisco

- bedrageri

- bedrageri afsløring

- Gratis

- Frekvens

- fra

- fuldt ud

- funktion

- funktioner

- fremtiden

- generere

- genereret

- generere

- generator

- få

- Giv

- Go

- godt

- indrømme

- Ground

- gruppe

- have

- hjulpet

- hjælper

- højere

- Fremhæv

- historisk

- historie

- Hvordan

- How To

- HTML

- HTTPS

- Hundreder

- IAM

- identificeret

- Identity

- betydning

- in

- omfatter

- Indgående

- Forøg

- stigende

- individuel

- oplysninger

- Infrastruktur

- indgang

- Indsætter

- indsigt

- installere

- instans

- Institut

- anvisninger

- interesseret

- IT

- deltage

- json

- Kafka

- Kinesis datastrømme

- Sprog

- større

- Latency

- seneste

- lancere

- læring

- Forlade

- Længde

- Niveau

- GRÆNSE

- begrænsning

- belastning

- belastninger

- langsigtet

- Lav

- maskine

- machine learning

- lavet

- lave

- maerker

- lykkedes

- styring

- manuelt

- mange

- kort

- massivt

- matchende

- matplotlib

- max

- midler

- Medier

- metode

- metrisk

- Metrics

- afbøde

- ML

- tilstand

- model

- modeller

- månedligt

- måned

- mere

- mest

- bevæge sig

- navn

- Navigation

- Behov

- behov

- Ny

- næste

- underretning

- nummer

- bedøvet

- objektiv

- ONE

- åbner

- drift

- operationelle

- Produktion

- Muligheder

- Indstillinger

- ordrer

- organisationer

- Andet

- skitseret

- pakker

- pandaer

- brød

- parameter

- del

- perfekt

- udføre

- ydeevne

- udfører

- Tilladelser

- telefon

- Place

- planlægning

- perron

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- Vær venlig

- politikker

- politik

- mulig

- Indlæg

- magt

- Precision

- forudsige

- forudsigelse

- Forudsigelser

- forudser

- tidligere

- prissætning

- behandle

- Processer

- producent

- Program

- give

- giver

- offentlige

- offentliggøre

- Python

- Spørgsmål

- hurtigt

- tilfældig

- Læsning

- klar

- ægte

- realtid

- data i realtid

- realisere

- modtage

- modtaget

- nylige

- anerkendt

- optegnelser

- GENTAGNE GANGE

- erstatte

- påkrævet

- ressource

- Ressourcer

- REST

- Resultater

- afkast

- Risiko

- roller

- Kør

- kører

- sagemaker

- San

- San Francisco

- skalerbar

- Scale

- screenshots

- SDK

- søfødt

- Anden

- sekunder

- Sektion

- sektioner

- sikker

- valgt

- valg

- Serverless

- tjeneste

- sæt

- indstilling

- indstillinger

- setup

- kort sigt

- Vis

- Shows

- Simpelt

- forenkle

- simulator

- So

- Social

- sociale medier

- løsninger

- Løsninger

- nogle

- Kilde

- Kilder

- specialist

- specialiseret

- tilbringe

- delt

- SQL

- Stage

- standard

- påbegyndt

- Tilstand

- Statement

- udsagn

- Status

- Trin

- Steps

- opbevaring

- butik

- forhandler

- Strategisk

- strøm

- streaming

- streaming service

- vandløb

- sådan

- Super

- systemet

- Systemer

- bord

- Tag

- tager

- Talks

- mål

- terminal

- prøve

- Tredje

- tusinder

- Gennem

- tid

- tidsstempel

- til

- top

- emne

- traditionelt

- Tog

- uddannet

- Kurser

- transaktion

- transaktionsbeslutning

- Transaktioner

- Transform

- transformationer

- omdanne

- Trend

- Opdatering

- opdateret

- Brug

- brug

- Bruger

- valideret

- værdi

- Værdier

- forskellige

- Verity

- udgave

- Specifikation

- visninger

- gå

- går igennem

- Warehouse

- Warehousing

- Hjemmeside

- weekend

- ugentlig

- Hvad

- som

- mens

- Wikipedia

- vilje

- uden

- arbejdede

- arbejder

- virker

- skriver

- år

- Yoga

- Din

- zephyrnet