1滑铁卢大学物理系,滑铁卢,ON,N2L 3G1,加拿大

2量子计算研究所,滑铁卢,ON,N2L 3G1,加拿大

3加拿大安大略省滑铁卢理论物理周边研究所,加拿大N2L 2Y5

4Xanadu,多伦多,ON,M5G 2C8,加拿大

觉得本文有趣或想讨论? 在SciRate上发表评论或发表评论.

抽象

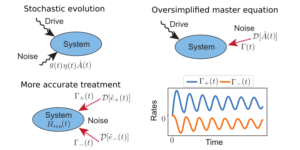

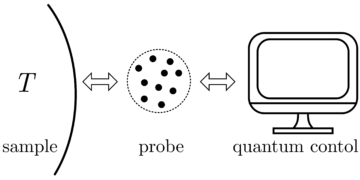

深度神经网络的广泛成功揭示了经典机器学习的一个惊喜:非常复杂的模型通常能够很好地概括,同时过度拟合训练数据。人们已经针对各种经典模型研究了这种良性过度拟合现象,目的是更好地理解深度学习背后的机制。在量子机器学习的背景下描述这一现象可能同样会提高我们对过度拟合、过度参数化和泛化之间关系的理解。在这项工作中,我们提供了量子模型中良性过度拟合的表征。为此,我们推导了用于噪声信号回归的经典插值傅立叶特征模型的行为,并展示了一类量子模型如何表现出类似的特征,从而将量子电路的结构(例如数据编码和状态准备操作)联系起来)导致量子模型中的过度参数化和过度拟合。我们根据量子模型插入具有局部“尖峰”行为的噪声数据的能力来直观地解释这些特征,并提供良性过度拟合的具体演示示例。

►BibTeX数据

►参考

[1] 迈克尔·A·尼尔森. “神经网络和深度学习”。决心出版社。 (2015)。网址:http://neuralnetworksanddeeplearning.com/。

http:// https://neuralnetworksanddeeplearning.com/

[2] Stuart Geman、Elie Bienenstock 和 René Doursat。 “神经网络和偏差/方差困境”。神经计算。 4, 1–58 (1992)。

https:///doi.org/10.1162/neco.1992.4.1.1

[3] 特雷弗·哈斯蒂、罗伯特·蒂布希拉尼、杰罗姆·H·弗里德曼、杰罗姆·H·弗里德曼。 “统计学习的要素:数据挖掘、推理和预测”。第 2 卷。施普林格。 (2009)。

https://doi.org/10.1007/978-0-387-84858-7

[4] 彼得·巴特利特、安德里亚·蒙塔纳里和亚历山大·拉赫林。 “深度学习:统计观点”。数值学报 30, 87–201 (2021)。

https:/ / doi.org/ 10.1017 / S0962492921000027

[5] 米哈伊尔·贝尔金. “无所畏惧地适应:通过插值棱镜进行深度学习的非凡数学现象”。数值学报 30, 203–248 (2021)。

[6] 彼得·L·巴特利特、菲利普·M·朗、加博尔·卢戈西和亚历山大·齐格勒。 “线性回归中的良性过度拟合”。过程。国家。阿卡德。科学。 117, 30063–30070 (2020)。

https:/ / doi.org/ 10.1073 / pnas.1907378117

[7] 米哈伊尔·贝尔金、丹尼尔·许、马思远和苏米克·曼达尔。 “协调现代机器学习实践和经典的偏差-方差权衡”。过程。国家。阿卡德。科学。 116, 15849–15854 (2019)。

https:/ / doi.org/ 10.1073 / pnas.1903070116

[8] 米哈伊尔·贝尔金、亚历山大·拉赫林和亚历山大·B·齐巴科夫。 “数据插值是否与统计最优性相矛盾?”。机器学习研究论文集。第 89 卷,第 1611-1619 页。 PMLR(2019)。网址:https://proceedings.mlr.press/v89/belkin19a.html。

https://proceedings.mlr.press/v89/belkin19a.html

[9] Vidya Muthukumar、Kailas Vodrahalli、Vignesh Subramanian 和 Anant Sahai。 “回归中噪声数据的无害插值”。 IEEE 信息论选定领域杂志 1, 67–83 (2020)。

https:/ / doi.org/ 10.1109 / ISIT.2019.8849614

[10] Vidya Muthukumar、Adhyyan Narang、Vignesh Subramanian、Mikhail Belkin、Daniel Hsu 和 Anant Sahai。 “过度参数化方案中的分类与回归:损失函数重要吗?”。 J.马赫.学习。资源。 22, 1–69 (2021)。网址:http://jmlr.org/papers/v22/20-603.html。

http:/ / jmlr.org/papers/v22/20-603.html

[11] 耶胡达·达尔、维迪亚·穆图库玛尔和理查德·G·巴拉尼克。 “告别偏差与方差的权衡?过度参数化机器学习理论概述”(2021)。 arXiv:2109.02355。

的arXiv:2109.02355

[12] 马塞洛·贝内代蒂、埃里卡·劳埃德、斯特凡·萨克和马蒂亚·菲奥伦蒂尼。 “参数化量子电路作为机器学习模型”。量子科学。技术。 4、043001(2019)。

https://doi.org/10.1088/2058-9565/ab4eb5

[13] K. Mitarai、M. Negoro、M. Kitagawa 和 K. Fujii。 “量子电路学习”。 物理。 修订版 A 98, 032309 (2018)。

https:///doi.org/10.1103/physreva.98.032309

[14] Maria Schuld、Ville Bergholm、Christian Gogolin、Josh Izaac 和 Nathan Killoran。 “评估量子硬件上的分析梯度”。 物理。 修订版 A 99, 032331 (2019)。

https:///doi.org/10.1103/physreva.99.032331

[15] 玛丽亚舒尔德和内森基洛兰。 “特征希尔伯特空间中的量子机器学习”。 物理。 牧师莱特。 122, 040504 (2019)。

https:///doi.org/10.1103/physrevlett.122.040504

[16] Vojtěch Havlíček、Antonio D. Córcoles、Kristan Temme、Aram W. Harrow、Abhinav Kandala、Jerry M. Chow 和 Jay M. Gambetta。 “具有量子增强特征空间的监督学习”。 自然 567, 209–212 (2019)。

https://doi.org/10.1038/s41586-019-0980-2

[17] 塞思·劳埃德和克里斯蒂安·威德布鲁克。 “量子生成对抗性学习”。物理。莱特牧师。 121, 040502 (2018)。

https:///doi.org/10.1103/physrevlett.121.040502

[18] 皮埃尔-吕克·达莱尔-德默斯和内森·基洛兰。 “量子生成对抗网络”。物理。修订版 A 98, 012324 (2018)。

https:///doi.org/10.1103/physreva.98.012324

[19] 阿米拉·阿巴斯、大卫·萨特、克里斯塔·祖法尔、奥雷利安·卢奇、阿莱西奥·菲加利和斯特凡·沃尔纳。 “量子神经网络的力量”。纳特。计算。科学。 1, 403–409 (2021)。

https://doi.org/10.1038/s43588-021-00084-1

[20] 洛根·G·赖特 (Logan G. Wright) 和彼得·L·麦克马洪 (Peter L. McMahon)。 “量子神经网络的能力”。 2020 年激光与电光会议 (CLEO)。第 1-2 页。 (2020)。网址:https://ieeexplore.ieee.org/document/9193529。

https://ieeexplore.ieee.org/âdocument/â9193529

[21] Sukin Sim、Peter D. Johnson 和 Alán Aspuru-Guzik。 “用于混合量子经典算法的参数化量子电路的可表达性和纠缠能力”。 进阶量子技术。 2, 1900070 (2019).

https:/ / doi.org/ 10.1002 / qute.201900070

[22] 托马斯·胡布雷特森 (Thomas Hubregtsen)、约瑟夫·皮切尔迈尔 (Josef Pichlmeier)、帕特里克·斯特彻 (Patrick Stecher) 和科恩·贝特尔 (Koen Bertels)。 “参数化量子电路的评估:关于分类精度、可表达性和纠缠能力之间的关系”。量子马赫。英特尔。 3, 1 (2021)。

https:/ / doi.org/ 10.1007 / s42484-021-00038-w

[23] Jarrod R McClean、Sergio Boixo、Vadim N Smelyanskiy、Ryan Babbush 和 Hartmut Neven。 “量子神经网络训练领域的贫瘠高原”。 纳特。 交流。 9、4812(2018)。

https://doi.org/10.1038/s41467-018-07090-4

[24] Marco Cerezo、Akira Sone、Tyler Volkoff、Lukasz Cincio 和 Patrick J Coles。 “浅参数化量子电路中成本函数依赖的贫瘠平台”。纳特。交流。 12 年 1791 月 (2021)。

https:/ / doi.org/ 10.1038 / s41467-021-21728-w

[25] 马蒂亚斯·C·卡罗、埃利斯·吉尔·福斯特、约翰内斯·雅各布·迈耶、延斯·艾塞特和瑞安·斯韦克。 “参数化量子电路的编码相关泛化界限”。量子 5, 582 (2021)。

https://doi.org/10.22331/q-2021-11-17-582

[26] 黄心源、迈克尔·布劳顿、马苏德·莫森尼、瑞安·巴布什、塞尔吉奥·博伊索、哈特穆特·内文和贾罗德·R·麦克莱恩。 “量子机器学习中数据的力量”。纳特。交流。 12, 2631 (2021)。

https://doi.org/10.1038/s41467-021-22539-9

[27] Matthias C. Caro、Hsin-Yuan Huang、M. Cerezo、Kunal Sharma、Andrew Sornborger、Lukasz Cincio 和 Patrick J. Coles。 “从少量训练数据中推广量子机器学习”。纳特。交流。 13, 4919 (2022)。

https://doi.org/10.1038/s41467-022-32550-3

[28] 莱昂纳多·班奇、杰森·佩雷拉和斯特凡诺·皮兰多拉。 “量子机器学习的泛化:量子信息的观点”。 PRX 量子 2, 040321 (2021)。

https:/ / doi.org/ 10.1103 / PRXQuantum.2.040321

[29] 弗朗西斯科·哈维尔·吉尔·维达尔和德克·奥利弗·泰斯。 “参数化量子电路的输入冗余”。 正面。 物理。 8, 297 (2020).

https:///doi.org/10.3389/fphy.2020.00297

[30] Maria Schuld、Ryan Sweke 和 Johannes Jakob Meyer。 “数据编码对变分量子机器学习模型表达能力的影响”。 物理。 修订版 A 103, 032430 (2021)。

https:///doi.org/10.1103/physreva.103.032430

[31] David Wierichs、Josh Izaac、Cody Wang 和 Cedric Yen-Yu Lin。 “量子梯度的一般参数转移规则”。量子 6, 677 (2022)。

https://doi.org/10.22331/q-2022-03-30-677

[32] 肯德尔·E·阿特金森。 “数值分析简介”。约翰·威利父子。 (2008)。

[33] 阿里·拉希米和本杰明·雷希特。 “大规模内核机器的随机特征”。神经信息处理系统的进展。第 20 卷。(2007 年)。网址:https://papers.nips.cc/paper_files/paper/2007/hash/013a006f03dbc5392effeb8f18fda755-Abstract.html。

https://papers.nips.cc/paper_files/paper/2007/hash/013a006f03dbc5392effeb8f18fda755-Abstract.html

[34] 沃尔特·鲁丁. “傅里叶分析的基本定理”。约翰·威利父子公司 (1990)。

https:/ / doi.org/ 10.1002 / 9781118165621.ch1

[35] 宋梅和安德里亚·蒙塔纳里。 “随机特征回归的泛化误差:精确渐近和双下降曲线”。交流。纯应用。数学。 75, 667–766 (2022)。

https:///doi.org/10.1002/cpa.22008

[36] 特雷弗·哈斯蒂、安德里亚·蒙塔纳里、萨哈伦·罗塞特和瑞安·J·提布希拉尼。 “高维无脊最小二乘插值中的惊喜”。安.统计。 50, 949 – 986 (2022)。

https:/ / doi.org/ 10.1214 / 21-AOS2133

[37] 梁腾元、亚历山大·拉赫林、翟希宇。 “关于最小范数插值的多重下降和核的受限下等距”。机器学习研究论文集。第 125 卷,第 1-29 页。 PMLR(2020)。网址:http://proceedings.mlr.press/v125/liang20a.html。

http://proceedings.mlr.press/v125/liang20a.html

[38] Edward Farhi 和 Hartmut Neven。 “近期处理器上的量子神经网络分类”(2018 年)。 arXiv:1802.06002。

的arXiv:1802.06002

[39] 玛丽亚·舒尔德、亚历克斯·博恰洛夫、克里斯塔·M·斯沃尔和内森·维贝。 “以电路为中心的量子分类器”。 物理。 修订版 A 101, 032308 (2020)。

https:///doi.org/10.1103/physreva.101.032308

[40] Adrián Pérez-Salinas、Alba Cervera-Lierta、Elies Gil-Fuster 和 José I. Latorre。 “通用量子分类器的数据重新上传”。 量子 4, 226 (2020)。

https://doi.org/10.22331/q-2020-02-06-226

[41] Sofiene Jerbi、Lukas J Fiderer、Hendrik Poulsen Nautrup、Jonas M Kübler、Hans J Briegel 和 Vedran Dunjko。 “超越核方法的量子机器学习”。纳特。交流。 14, 517 (2023)。

https:/ / doi.org/ 10.1038 / s41467-023-36159-y

[42] Casper Gyurik、Dyon Vreumingen、van 和 Vedran Dunjko。 “量子线性分类器的结构风险最小化”。量子 7, 893 (2023)。

https://doi.org/10.22331/q-2023-01-13-893

[43] 玛丽亚舒尔德。 “监督量子机器学习模型是内核方法”(2021 年)。 arXiv:2101.11020。

的arXiv:2101.11020

[44] S.Shin、Y.S.Teo 和 H.Jeong。 “量子监督学习的指数数据编码”。物理。修订版 A 107, 012422 (2023)。

https:/ / doi.org/ 10.1103 / PhysRevA.107.012422

[45] 苏菲·皮卡德. “关于欧几里得空间点的距离合奏。”。纳沙泰尔大学回忆录。大学秘书处。 (1939)。

[46] 戴夫·韦克、马修·B·黑斯廷斯、内森·韦伯、布莱恩·K·克拉克、切坦·纳亚克和马蒂亚斯·特罗耶。 “在量子计算机上求解强相关电子模型”。物理。修订版 A 92, 062318 (2015)。

https:/ / doi.org/ 10.1103 / PhysRevA.92.062318

[47] Ian D. Kivlichan、Jarrod McClean、Nathan Wiebe、Craig Gidney、Alán Aspuru-Guzik、Garnet Kin-Lic Chan 和 Ryan Babbush。 “具有线性深度和连通性的电子结构的量子模拟”。 物理。 牧师莱特。 120, 110501 (2018)。

https:/ / doi.org/ 10.1103 / PhysRevLett.120.110501

[48] 马丁·拉罗卡、弗雷德里克·索瓦奇、法里斯·M·斯巴希、纪尧姆·韦尔东、帕特里克·J·科尔斯和 M.塞雷佐。 “群不变量子机器学习”。 PRX 量子 3, 030341 (2022)。

https:/ / doi.org/ 10.1103 / PRXQuantum.3.030341

[49] Johannes Jakob Meyer、Marian Mularski、Elies Gil-Fuster、Antonio Anna Mele、Francesco Arzani、Alissa Wilms 和 Jens Eisert。 “在变分量子机器学习中利用对称性”。 PRX 量子 4, 010328 (2023)。

https:/ / doi.org/ 10.1103 / PRXQuantum.4.010328

[50] 马丁·拉罗卡、内森·朱、迭戈·加西亚-马丁、帕特里克·J·科尔斯和马可·塞雷佐。 “量子神经网络中的过参数化理论”。纳特。计算。科学。 3, 542–551 (2023)。

https://doi.org/10.1038/s43588-023-00467-6

[51] 杜宇轩、谢敏秀、刘铜良、陶大成。 “参数化量子电路的表达能力”。物理。修订版研究。 2、033125(2020)。

https:///doi.org/10.1103/physrevresearch.2.033125

[52] Zoë Holmes、Kunal Sharma、M. Cerezo 和 Patrick J. Coles。 “将 ansatz 表达能力与梯度幅度和贫瘠高原联系起来”。 PRX 量子 3, 010313 (2022)。

https:/ / doi.org/ 10.1103 / PRXQuantum.3.010313

[53] Samson Wang、Enrico Fontana、Marco Cerezo、Kunal Sharma、Akira Sone、Lukasz Cincio 和 Patrick J Coles。 “变分量子算法中噪声引起的贫瘠高原”。纳特。交流。 12、6961(2021)。

https://doi.org/10.1038/s41467-021-27045-6

[54] 阿卜杜勒卡迪尔·卡纳塔、埃文·彼得斯、Cengiz Pehlevan、斯特凡·M·怀尔德和鲁斯兰·谢杜林。 “带宽使得量子内核模型的泛化成为可能”。机器学习研究汇刊 (2023)。网址:https://openreview.net/forum?id=A1N2qp4yAq。

https://openreview.net/forum?id=A1N2qp4yAq

[55] Hsin-Yuan Huang、Michael Broughton、Jordan Cotler、Sitan Chen、Jerry Li、Masoud Mohseni、Hartmut Neven、Ryan Babbush、Richard Kueng、John Preskill 和 Jarrod R. McClean。 “从实验中学习的量子优势”。科学 376, 1182–1186 (2022)。

https:// / doi.org/ 10.1126/ science.abn7293

[56] 陈斯坦、乔丹·科特勒、黄心源和杰瑞·李。 “有和没有量子记忆的学习之间的指数级分离”。 2021 年 IEEE 第 62 届计算机科学基础年度研讨会 (FOCS)。第 574-585 页。 (2022)。

https:/ / doi.org/ 10.1109/ FOCS52979.2021.00063

[57] Hsin-Yuan Huang、Richard Kueng 和 John Preskill。 “机器学习中量子优势的信息论界限”。 物理。 牧师莱特。 126、190505(2021 年)。

https:/ / doi.org/ 10.1103 / PhysRevLett.126.190505

[58] Ville Bergholm、Josh Izaac、Maria Schuld、Christian Gogolin、M. Sohaib Alam、Shahnawaz Ahmed、Juan Miguel Arrazola、Carsten Blank、Alain Delgado、Soran Jahangiri、Keri McKiernan、Johannes Jakob Meyer、Zeyue Niu、Antal Száva 和 Nathan Killoran。 “Pennylane:混合量子经典计算的自动微分”(2018)。 arXiv:1811.04968。

的arXiv:1811.04968

[59] 彼得·L·巴特利特、菲利普·M·朗、加博尔·卢戈西和亚历山大·齐格勒。 “线性回归中的良性过度拟合”。过程。国家。阿卡德。科学。 117, 30063–30070 (2020)。

https:/ / doi.org/ 10.1073 / pnas.1907378117

[60] 弗拉基米尔·科尔钦斯基和卡里姆·卢尼奇。 “样本协方差算子的浓度不等式和矩界限”。伯努利 23, 110 – 133 (2017)。

https://doi.org/10.3150/15-BEJ730

[61] 兹比格涅夫·普查瓦 (Zbigniew Puchała) 和雅罗斯瓦夫·亚当·米什恰克 (Jarosław Adam Miszczak)。 “关于酉群的 haar 度量的符号积分”。公牛。波尔。阿卡德。科学。 65, 21–27 (2017)。

https:/ / doi.org/ 10.1515 / bpasts-2017-0003

[62] 丹尼尔·A·罗伯茨和吉田贝尼。 “设计造成的混乱和复杂性”。 J.高能物理学。 2017,121(2017)。

https:/ / doi.org/ 10.1007/ jhep04(2017)121

[63] 华莱士·C·巴布科克。 “无线电系统中互调干扰的发生频率和通过信道选择的控制”。贝尔系统。技术。 j。 32, 63–73 (1953)。

https:///doi.org/10.1002/j.1538-7305.1953.tb01422.x

[64] M.阿特金森、N.桑托罗和 J.乌鲁蒂亚。 “具有不同和与差的整数集以及非线性中继器的载波频率分配”。 IEEE 传输。交流。 34, 614–617 (1986)。

https:/ / doi.org/ 10.1109/ TCOM.1986.1096587

[65] J.罗宾逊和A.伯恩斯坦。 “一类具有有限错误传播的二进制循环码”。 IEEE 传输。信息。 13, 106–113 (1967)。

https:///doi.org/10.1109/TIT.1967.1053951

[66] R. J. F. Fang 和 W. A. Sandrin。 “非线性中继器的载波频率分配”。 COMSAT 技术评论 7, 227–245 (1977)。

被引用

[1] Alexey Melnikov、Mohammad Kordzanganeh、Alexander Alodjants 和 Ray-Kuang Lee,“量子机器学习:从物理到软件工程”, 物理学进展 X 8 1, 2165452 (2023).

[2] Mo Kordzanganeh、Pavel Sekatski、Leonid Fedichkin 和 Alexey Melnikov,“呈指数增长的通用量子电路系列”, 机器学习:科学与技术 4 3, 035036 (2023).

[3] Stefano Mangini,“机器学习的变分量子算法:理论与应用”, 的arXiv:2306.09984, (2023).

[4] Ben Jaderberg、Antonio A. Gentile、Youssef Achari Berrada、Elvira Shishenina 和 Vincent E. Elfving,“让量子神经网络选择自己的频率”, 的arXiv:2309.03279, (2023).

[5] 杜宇轩、杨一波、陶大成、谢敏秀,“多类分类中量子神经网络的问题相关能力”, 体检信131 14,140601(2023).

[6] S. Shin、Y. S. Teo 和 H. Jeong,“量子监督学习的指数数据编码”, 物理评论A 107 1,012422(2023).

[7] Elies Gil-Fuster、Jens Eisert 和 Carlos Bravo-Prieto,“理解量子机器学习也需要重新思考泛化”, 的arXiv:2306.13461, (2023).

[8] Jason Iaconis 和 Sonika Johri,“基于张量网络的图像高效量子数据加载”, 的arXiv:2310.05897, (2023).

[9] Alice Barthe 和 Adrián Pérez-Salinas,“量子重新上传模型的梯度和频率分布”, 的arXiv:2311.10822, (2023).

[10] Tobias Haug 和 MS Kim,“用量子几何进行泛化学习酉”, 的arXiv:2303.13462, (2023).

[11] Jonas Landman、Slimane Thabet、Constantin Dalyac、Hela Mhiri 和 Elham Kashefi,“具有随机傅里叶特征的经典逼近变分量子机器学习”, 的arXiv:2210.13200, (2022).

[12] Berta Casas 和 Alba Cervera-Lierta,“具有量子电路的多维傅立叶级数”, 物理评论A 107 6,062612(2023).

[13] Elies Gil-Fuster、Jens Eisert 和 Vedran Dunjko,“关于嵌入量子内核的表现力”, 的arXiv:2309.14419, (2023).

[14] Lucas Slattery、Ruslan Shaydulin、Shouvanik Chakrabarti、Marco Pistoia、Sami Khairy 和 Stefan M. Wild,“反对经典数据上量子保真核优势的数值证据”, 物理评论A 107 6,062417(2023).

[15] Mo Kordzanganeh、Daria Kosichkina 和 Alexey Melnikov,“并行混合网络:量子和经典神经网络之间的相互作用”, 的arXiv:2303.03227, (2023).

[16] Aikaterini、Gratsea 和 Patrick Huembeli,“处理和测量算子对量子模型表达能力的影响”, 的arXiv:2211.03101, (2022).

[17] Shun Okumura和Masayuki Ohzeki,“参数化量子电路的傅里叶系数与贫瘠高原问题”, 的arXiv:2309.06740, (2023).

[18] Massimiliano Incudini、Michele Grossi、Antonio Mandarino、Sofia Vallecorsa、Alessandra Di Pierro 和 David Windridge,“量子路径内核:用于深度量子机器学习的广义量子神经正切内核”, 的arXiv:2212.11826, (2022).

[19] Jorja J. Kirk、Matthew D. Jackson、Daniel J. M. King、Philip Intallura 和 Mekena Metcalf,“伊辛自旋模型经典数据表示中的紧急顺序”, 的arXiv:2303.01461, (2023).

[20] Francesco Scala、Andrea Ceschini、Massimo Panella 和 Dario Gerace,“量子神经网络中 Dropout 的通用方法”, 的arXiv:2310.04120, (2023).

[21] Julian Berberich、Daniel Fink、Daniel Pranjić、Christian Tutschku 和 Christian Holm,“训练稳健且可推广的量子模型”, 的arXiv:2311.11871, (2023).

以上引用来自 SAO / NASA广告 (最近成功更新为2023-12-21 00:40:54)。 该列表可能不完整,因为并非所有发布者都提供合适且完整的引用数据。

On Crossref的引用服务 找不到有关引用作品的数据(上一次尝试2023-12-21 00:40:53)。

该论文发表在《量子》杂志上 国际知识共享署名署名4.0(CC BY 4.0) 执照。 版权归原始版权持有者所有,例如作者或其所在机构。

- :具有

- :是

- :不是

- 1

- 10

- 107

- 11

- 110

- 116

- 12

- 120

- 121

- 125

- 13

- 14

- 15%

- 16

- 17

- 1791

- 19

- 20

- 2008

- 2015

- 2017

- 2018

- 2019

- 2020

- 2021

- 2022

- 2023

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 35%

- 36

- 39

- 40

- 41

- 43

- 46

- 49

- 50

- 51

- 52

- 53

- 54

- 58

- 60

- 65

- 66

- 7

- 75

- 8

- 9

- 98

- a

- 阿巴斯

- 对,能力--

- 以上

- 摘要

- ACCESS

- 根据

- Adam

- 进步

- 优点

- 对抗

- 背景

- 驳

- 艾哈迈德

- 亚历克斯

- 亚历山大

- 算法

- 爱丽丝

- 所有类型

- 还

- an

- 分析

- 解析

- 和

- 安德鲁

- 安娜

- 全年

- 应用领域

- 的途径

- 保健

- 地区

- AS

- 尝试

- 作者

- 作者

- 自动表

- b

- 荒芜

- 基于

- 基本包

- BE

- 很

- 行为

- 背后

- 钟

- 本

- 本杰明

- 更好

- 之间

- 超越

- 空白

- 界限

- 午休

- 布莱恩

- 公牛

- by

- 能力

- 容量

- 卡洛斯

- 卡斯帕尔

- 陈

- 渠道

- 陈

- 粻

- 基督教

- 引用

- 程

- 分类

- 代码

- 评论

- 共享

- 完成

- 复杂

- 复杂

- 计算

- 一台

- 计算机科学

- 计算

- 具体

- 研讨会 首页

- 连接方式

- 上下文

- 控制

- 版权

- 相关

- 克雷格

- 曲线

- 丹尼尔

- data

- 数据挖掘

- 戴夫

- David

- 十二月

- 深

- 深入学习

- 深度神经网络

- 它

- 依赖的

- 深度

- 漂移

- 设计

- 尽管

- 决心

- 迭戈

- 差异

- 讨论

- 不同

- do

- 不

- 翻番

- e

- 爱德华·

- 效果

- 高效

- 电子

- 分子

- 嵌入

- 使

- 编码

- 能源

- 工程师

- 埃里卡

- 错误

- 醚(ETH)

- 证据

- 例子

- 展品

- 实验

- 说明

- 指数

- 表现的

- 家庭

- 告别

- 恐惧

- 专栏

- 特征

- 少数

- 保真度

- 针对

- 发现

- Foundations

- 旧金山

- 频率

- 止

- 前

- 功能

- 其他咨询

- 生成的

- 生成对抗网络

- 几何

- 目标

- 渐变

- 团队

- 硬件

- 哈佛

- 高

- 持有人

- 创新中心

- HTML

- HTTP

- HTTPS

- 黄

- 杂交种

- 混合量子经典

- i

- IEEE

- 图片

- 改善

- in

- 不平等

- 信息

- 研究所

- 机构

- 积分

- 有趣

- 干扰

- 国际

- 介绍

- 杰克逊

- JavaScript的

- 杰罗姆

- John

- 约翰逊

- 约旦

- 日志

- 约翰

- 卡里姆

- 肯德尔

- Kim

- 国王

- 柯克

- 大规模

- 激光器

- 名:

- 学习用品

- 学习

- 最少

- 离开

- 李

- 让

- li

- 执照

- 有限

- 林

- 链接

- 清单

- 装载

- 当地

- 洛根

- 长

- 离

- 降低

- 公司

- 机

- 机器学习

- 机

- 马尔科

- 玛丽亚

- 马丁

- 数学

- 数学的

- 问题

- 马修

- 马蒂亚斯

- 可能..

- 麦克莱恩

- 衡量

- 数据监测

- 机制

- 内存

- 梅特卡夫

- 方法

- 迈耶

- Michael (中国)

- 可能

- 米哈伊尔

- 最小化

- 采矿

- 模型

- 模型

- 现代

- 时刻

- 月

- 多

- 自然

- 近

- 网络

- 网络

- 神经

- 神经网络

- 神经网络

- 没有

- 发生

- of

- 经常

- 奥利弗

- on

- 安大略

- 打开

- 运营

- 运营商

- or

- 秩序

- 原版的

- 我们的

- 简介

- 己

- 网页

- 纸类

- 并行

- 径

- 帕特里克

- 彼得

- 现象

- 物理

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 点

- 功率

- 在练习上

- 精确的

- 预测

- 准备

- express

- 市场问题

- PROC

- Proceedings

- 处理

- 处理器

- 简介

- 传播

- 提供

- 出版

- 发行人

- 出版商

- 量子

- 量子优势

- 量子算法

- 量子计算机

- 量子计算

- 量子信息

- 量子机器学习

- R

- 广播电台

- 随机

- 经常性的

- 引用

- 饮食

- 回归

- 关系

- 关系

- 遗迹

- 卓越

- 需要

- 研究

- 尊重

- 受限

- 揭密

- 检讨

- 理查德

- 风险

- ROBERT

- 健壮

- 定位、竞价/采购和分析/优化数字媒体采购,但算法只不过是解决问题的操作和规则。

- 瑞安

- s

- 斯卡拉

- SCI

- 科学

- 科学与技术

- 选

- 选择

- 系列

- 套数

- 浅

- 夏尔马

- 显示

- 信号

- SIM

- 同样

- 模拟

- 同时

- 软件

- 软件工程

- 歌曲

- 剩余名额

- 纺

- 广场

- 立场

- 州/领地

- 统计

- 斯特凡

- 非常

- 结构体

- 研究

- 成功

- 顺利

- 这样

- 合适的

- 总和

- 监督学习

- 惊

- 专题研讨会

- 产品

- 科技

- 文案

- 专业技术

- 术语

- 其

- 理论

- 理论

- 从而

- 博曼

- Free Introduction

- 通过

- 标题

- 至

- 多伦多

- 产品培训

- 反

- 交易

- 特雷弗

- 泰勒

- UN

- 下

- 理解

- 普遍

- 大学

- 更新

- 网址

- 各种

- 非常

- 文森特

- 体积

- vs

- W

- 旺

- 想

- 是

- we

- 井

- 而

- 广泛

- Wild!!!

- 也完全不需要

- 工作

- 合作

- 赖特

- X

- 年

- 和风网