اس پوسٹ میں، ہم یہ ظاہر کرتے ہیں کہ ماڈل کی کارکردگی کو بہتر بنانے اور تخمینے کے اوقات کو کم کرنے کے لیے ایک عمدہ BERT ماڈل کو کمپریس کرنے کے لیے نیورل آرکیٹیکچر سرچ (NAS) پر مبنی ساختی کٹائی کا استعمال کیسے کیا جائے۔ پہلے سے تربیت یافتہ لینگویج ماڈلز (PLMs) پیداواری ٹولز، کسٹمر سروس، تلاش اور سفارشات، کاروباری عمل آٹومیشن، اور مواد کی تخلیق کے شعبوں میں تیزی سے تجارتی اور انٹرپرائز اپنانے سے گزر رہے ہیں۔ PLM انفرنس اینڈ پوائنٹس کی تعیناتی عام طور پر زیادہ تاخیر اور زیادہ بنیادی ڈھانچے کے اخراجات کے ساتھ منسلک ہوتی ہے کیونکہ کمپیوٹ کی ضروریات اور پیرامیٹرز کی بڑی تعداد کی وجہ سے کمپیوٹیشنل کارکردگی میں کمی۔ PLM کی کٹائی اس کی پیشین گوئی کی صلاحیتوں کو برقرار رکھتے ہوئے ماڈل کے سائز اور پیچیدگی کو کم کرتی ہے۔ کٹے ہوئے PLM ایک چھوٹا میموری فوٹ پرنٹ اور کم تاخیر حاصل کرتے ہیں۔ ہم یہ ظاہر کرتے ہیں کہ PLM کو کاٹ کر اور ایک مخصوص ہدف کے کام کے لیے پیرامیٹر کی گنتی اور توثیق کی غلطی کو ٹریڈ کر کے، اور بنیادی PLM ماڈل کے مقابلے میں تیز تر رسپانس اوقات حاصل کرنے کے قابل ہیں۔

کثیر مقصدی اصلاح فیصلہ سازی کا ایک ایسا شعبہ ہے جو ایک سے زیادہ معروضی افعال کو بہتر بناتا ہے، جیسے کہ میموری کی کھپت، تربیت کا وقت، اور حسابی وسائل، کو بیک وقت بہتر بنایا جائے۔ ساختی کٹائی ایک تکنیک ہے جس میں ماڈل کی درستگی کو محفوظ رکھنے کی کوشش کرتے ہوئے پرتوں یا نیوران/نوڈس کی کٹائی کرکے PLM کے سائز اور کمپیوٹیشنل ضروریات کو کم کیا جاتا ہے۔ تہوں کو ہٹانے سے، ساختی کٹائی زیادہ کمپریشن ریٹ حاصل کرتی ہے، جس سے ہارڈ ویئر کے موافق ڈھانچہ جاتی ہے جو رن ٹائم اور رسپانس ٹائم کو کم کرتی ہے۔ PLM ماڈل میں ساختی کٹائی کی تکنیک کو لاگو کرنے کے نتیجے میں ایک ہلکے وزن والے ماڈل کا نتیجہ ہوتا ہے جس میں میموری کا نشان کم ہوتا ہے جسے SageMaker میں انفرنس اینڈ پوائنٹ کے طور پر میزبانی کرنے پر، اصل فائن ٹیونڈ PLM کے مقابلے میں وسائل کی بہتر کارکردگی اور کم لاگت کی پیشکش کرتا ہے۔

اس پوسٹ میں بیان کردہ تصورات کا اطلاق ان ایپلی کیشنز پر کیا جا سکتا ہے جو PLM کی خصوصیات استعمال کرتی ہیں، جیسے کہ سفارشی نظام، جذبات کا تجزیہ، اور سرچ انجن۔ خاص طور پر، آپ اس نقطہ نظر کو استعمال کر سکتے ہیں اگر آپ کے پاس مشین لرننگ (ML) اور ڈیٹا سائنس ٹیمیں ہیں جو ڈومین کے لیے مخصوص ڈیٹا سیٹس کا استعمال کرتے ہوئے اپنے PLM ماڈلز کو ٹھیک کرتی ہیں اور بڑی تعداد میں انفرنس اینڈ پوائنٹس کو استعمال کرتی ہیں۔ ایمیزون سیج میکر. ایک مثال ایک آن لائن خوردہ فروش ہے جو متن کے خلاصے، پروڈکٹ کیٹلاگ کی درجہ بندی، اور پروڈکٹ فیڈ بیک کے جذبات کی درجہ بندی کے لیے بڑی تعداد میں انفرنس اینڈ پوائنٹس تعینات کرتا ہے۔ ایک اور مثال صحت کی دیکھ بھال فراہم کرنے والا ہو سکتا ہے جو کلینیکل دستاویز کی درجہ بندی کے لیے PLM انفرنس اینڈ پوائنٹس کا استعمال کرتا ہے، میڈیکل رپورٹس، میڈیکل چیٹ بوٹس، اور مریض کے خطرے کی سطح بندی سے ہستی کی شناخت۔

حل جائزہ

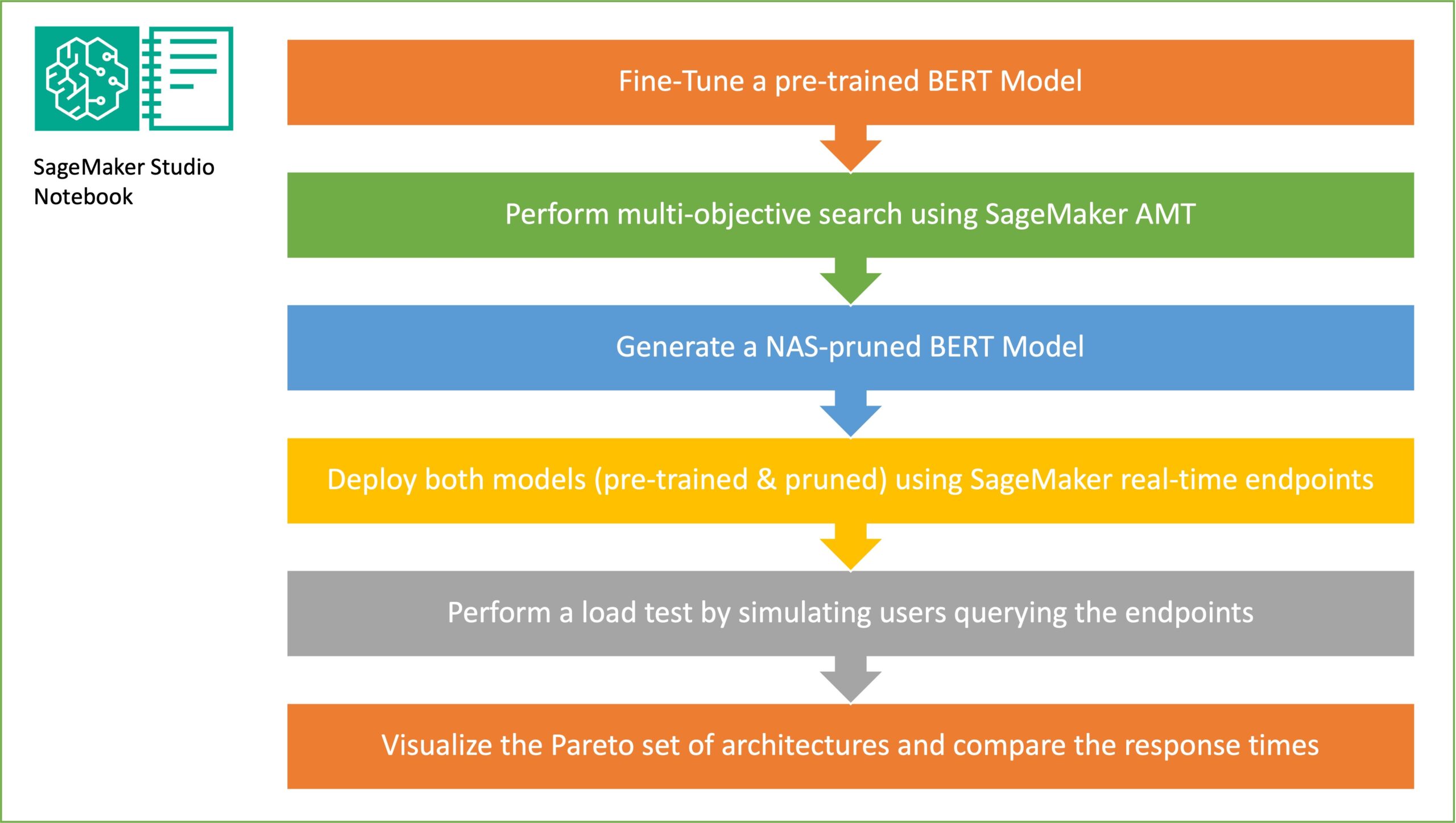

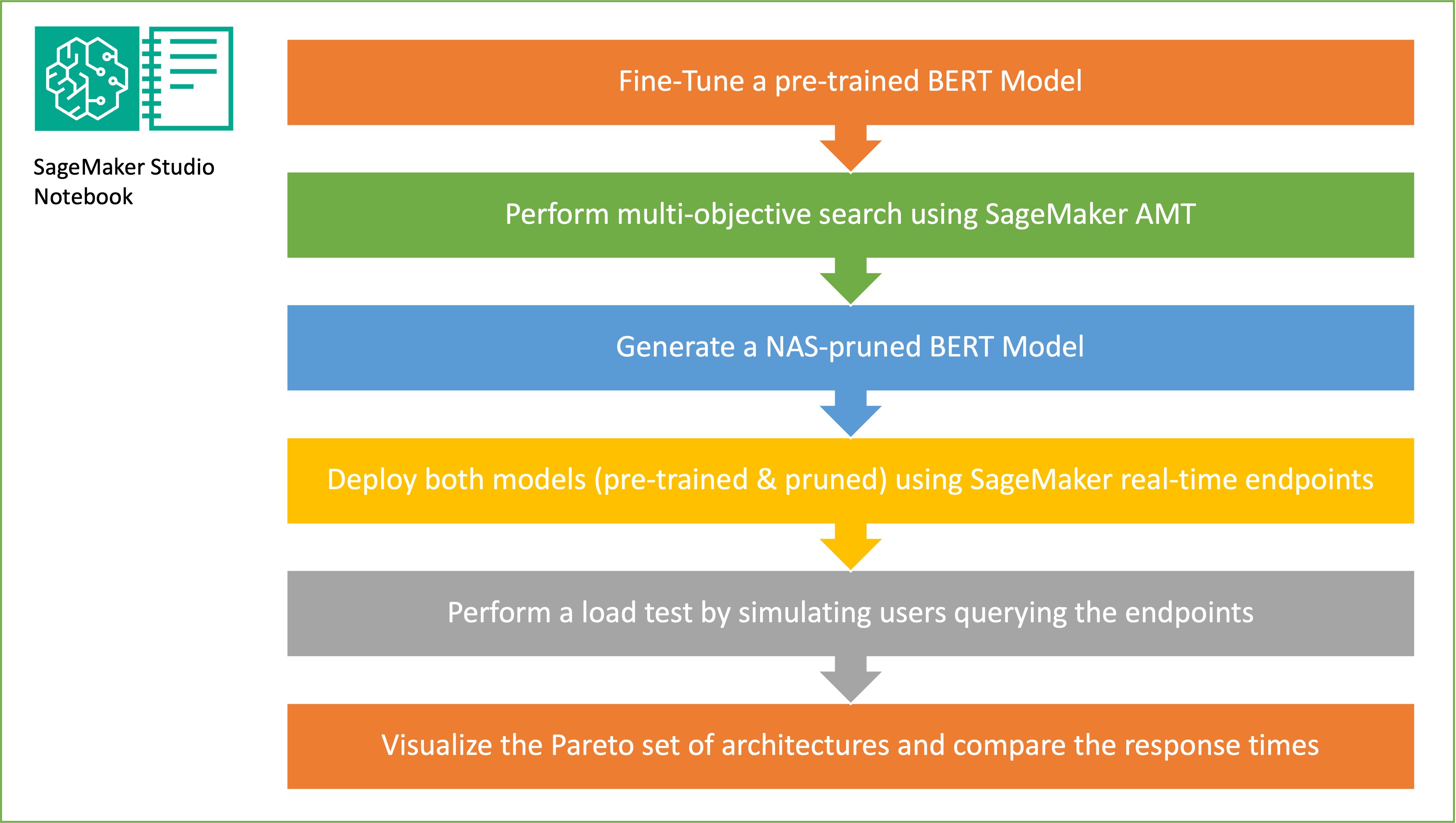

اس سیکشن میں، ہم مجموعی ورک فلو پیش کرتے ہیں اور طریقہ کار کی وضاحت کرتے ہیں۔ سب سے پہلے، ہم ایک استعمال کرتے ہیں ایمیزون سیج میکر اسٹوڈیو نوٹ بک ڈومین کے لیے مخصوص ڈیٹاسیٹ کا استعمال کرتے ہوئے ٹارگٹ ٹاسک پر پہلے سے تربیت یافتہ BERT ماڈل کو ٹھیک کرنے کے لیے۔ برٹ (ٹرانسفارمرز سے دو طرفہ انکوڈر نمائندگان) ایک پہلے سے تربیت یافتہ زبان کا ماڈل ہے جس کی بنیاد پر ٹرانسفارمر فن تعمیر قدرتی زبان کی پروسیسنگ (NLP) کے کاموں کے لیے استعمال کیا جاتا ہے۔ نیورل آرکیٹیکچر سرچ (NAS) مصنوعی عصبی نیٹ ورکس کے ڈیزائن کو خودکار بنانے کا ایک نقطہ نظر ہے اور اس کا گہرا تعلق ہائپر پیرامیٹر آپٹیمائزیشن سے ہے، جو مشین لرننگ کے میدان میں وسیع پیمانے پر استعمال ہونے والا طریقہ ہے۔ NAS کا مقصد کسی مخصوص مسئلے کے لیے بہترین فن تعمیر کو تلاش کرنا ہے جیسے کہ گریڈینٹ فری آپٹیمائزیشن جیسی تکنیکوں کا استعمال کرتے ہوئے امیدواروں کے فن تعمیر کے ایک بڑے سیٹ کو تلاش کرکے یا مطلوبہ میٹرکس کو بہتر بنا کر۔ فن تعمیر کی کارکردگی کو عام طور پر توثیق کے نقصان جیسے میٹرکس کا استعمال کرتے ہوئے ماپا جاتا ہے۔ سیج میکر خودکار ماڈل ٹیوننگ (AMT) ML ماڈل کے ہائپر پیرامیٹرس کے بہترین امتزاج کو تلاش کرنے کے مشکل اور پیچیدہ عمل کو خودکار بناتا ہے جو ماڈل کی بہترین کارکردگی پیش کرتے ہیں۔ AMT ذہین تلاش کے الگورتھم اور تکراری تشخیصات کا استعمال کرتے ہوئے آپ کے بیان کردہ ہائپر پیرامیٹرس کی ایک رینج کا استعمال کرتا ہے۔ یہ ہائپر پیرامیٹر اقدار کا انتخاب کرتا ہے جو ایک ایسا ماڈل تخلیق کرتا ہے جو بہترین کارکردگی کا مظاہرہ کرتا ہے، جیسا کہ کارکردگی کے میٹرکس جیسے درستگی اور F-1 سکور سے ماپا جاتا ہے۔

اس پوسٹ میں بیان کردہ فائن ٹیوننگ اپروچ عام ہے اور کسی بھی ٹیکسٹ بیسڈ ڈیٹاسیٹ پر لاگو کیا جا سکتا ہے۔ BERT PLM کو تفویض کردہ کام متن پر مبنی کام ہو سکتا ہے جیسے جذبات کا تجزیہ، متن کی درجہ بندی، یا سوال و جواب۔ اس ڈیمو میں، ہدف کا کام ایک بائنری درجہ بندی کا مسئلہ ہے جہاں BERT کو شناخت کرنے کے لیے استعمال کیا جاتا ہے، ایک ڈیٹاسیٹ سے جو متن کے ٹکڑوں کے جوڑے پر مشتمل ہوتا ہے، آیا ایک متن کے ٹکڑے کا مطلب دوسرے ٹکڑے سے لگایا جا سکتا ہے۔ ہم استعمال کرتے ہیں ٹیکسچوئل انٹیلمنٹ ڈیٹاسیٹ کو پہچاننا GLUE بینچ مارکنگ سوٹ سے۔ ہم SageMaker AMT کا استعمال کرتے ہوئے ایک کثیر مقصدی تلاش کرتے ہیں تاکہ ان ذیلی نیٹ ورکس کی شناخت کی جا سکے جو ہدف کے کام کے لیے پیرامیٹر کی گنتی اور پیشین گوئی کی درستگی کے درمیان بہترین تجارت کی پیشکش کرتے ہیں۔ کثیر مقصدی تلاش کرتے وقت، ہم درستگی اور پیرامیٹر کی گنتی کو ان مقاصد کے طور پر بیان کرنے کے ساتھ شروع کرتے ہیں جنہیں ہم بہتر بنانا چاہتے ہیں۔

BERT PLM نیٹ ورک کے اندر، ماڈیولر، خود ساختہ ذیلی نیٹ ورکس ہو سکتے ہیں جو ماڈل کو زبان کی تفہیم اور علم کی نمائندگی جیسی خصوصی صلاحیتوں کی اجازت دیتے ہیں۔ BERT PLM ایک ملٹی ہیڈ سیلف اٹینشن سب نیٹ ورک اور فیڈ فارورڈ سب نیٹ ورک استعمال کرتا ہے۔ متعدد سروں والی، خود دھیان دینے والی پرت BERT کو ایک ہی ترتیب کی مختلف پوزیشنوں کو منسلک کرنے کی اجازت دیتی ہے تاکہ ایک سے زیادہ سروں کو متعدد سیاق و سباق کے اشاروں میں شرکت کی اجازت دے کر ترتیب کی نمائندگی کا حساب لگایا جا سکے۔ ان پٹ کو متعدد ذیلی جگہوں میں تقسیم کیا گیا ہے اور ہر ذیلی جگہ پر الگ الگ خود توجہ دی جاتی ہے۔ ایک ٹرانسفارمر PLM میں ایک سے زیادہ ہیڈز ماڈل کو مشترکہ طور پر مختلف نمائندگی کے ذیلی مقامات سے معلومات حاصل کرنے کی اجازت دیتے ہیں۔ فیڈ فارورڈ سب نیٹ ورک ایک سادہ نیورل نیٹ ورک ہے جو ملٹی ہیڈ سیلف اٹینشن سب نیٹ ورک سے آؤٹ پٹ لیتا ہے، ڈیٹا پر کارروائی کرتا ہے، اور انکوڈر کی حتمی نمائندگی واپس کرتا ہے۔

بے ترتیب ذیلی نیٹ ورک کے نمونے لینے کا مقصد چھوٹے BERT ماڈلز کو تربیت دینا ہے جو ہدف کے کاموں پر اچھی کارکردگی کا مظاہرہ کر سکتے ہیں۔ ہم فائن ٹیونڈ بیس BERT ماڈل سے 100 بے ترتیب ذیلی نیٹ ورکس کا نمونہ لیتے ہیں اور بیک وقت 10 نیٹ ورکس کا جائزہ لیتے ہیں۔ تربیت یافتہ ذیلی نیٹ ورکس کا معروضی میٹرکس کے لیے جائزہ لیا جاتا ہے اور حتمی ماڈل کا انتخاب مقصدی میٹرکس کے درمیان پائے جانے والے ٹریڈ آف کی بنیاد پر کیا جاتا ہے۔ ہم تصور کرتے ہیں۔ پاریٹو سامنے نمونے والے ذیلی نیٹ ورکس کے لیے، جس میں کٹا ہوا ماڈل ہوتا ہے جو ماڈل کی درستگی اور ماڈل کے سائز کے درمیان بہترین تجارت کی پیشکش کرتا ہے۔ ہم امیدوار ذیلی نیٹ ورک (NAS-pruned BERT ماڈل) کو ماڈل کے سائز اور ماڈل کی درستگی کی بنیاد پر منتخب کرتے ہیں جسے ہم تجارت کرنے کے لیے تیار ہیں۔ اس کے بعد، ہم SageMaker کا استعمال کرتے ہوئے اختتامی نقطوں، پہلے سے تربیت یافتہ BERT بیس ماڈل، اور NAS سے کٹے ہوئے BERT ماڈل کی میزبانی کرتے ہیں۔ لوڈ ٹیسٹنگ انجام دینے کے لیے، ہم استعمال کرتے ہیں۔ ٹڈڈی، ایک اوپن سورس لوڈ ٹیسٹنگ ٹول جسے آپ Python استعمال کر کے لاگو کر سکتے ہیں۔ ہم Locust کا استعمال کرتے ہوئے دونوں اینڈ پوائنٹس پر لوڈ ٹیسٹنگ چلاتے ہیں اور دونوں ماڈلز کے ردعمل کے اوقات اور درستگی کے درمیان تجارت کو واضح کرنے کے لیے Pareto فرنٹ کا استعمال کرتے ہوئے نتائج کا تصور کرتے ہیں۔ مندرجہ ذیل خاکہ اس پوسٹ میں بیان کردہ ورک فلو کا ایک جائزہ فراہم کرتا ہے۔

شرائط

اس پوسٹ کے لیے درج ذیل شرائط درکار ہیں:

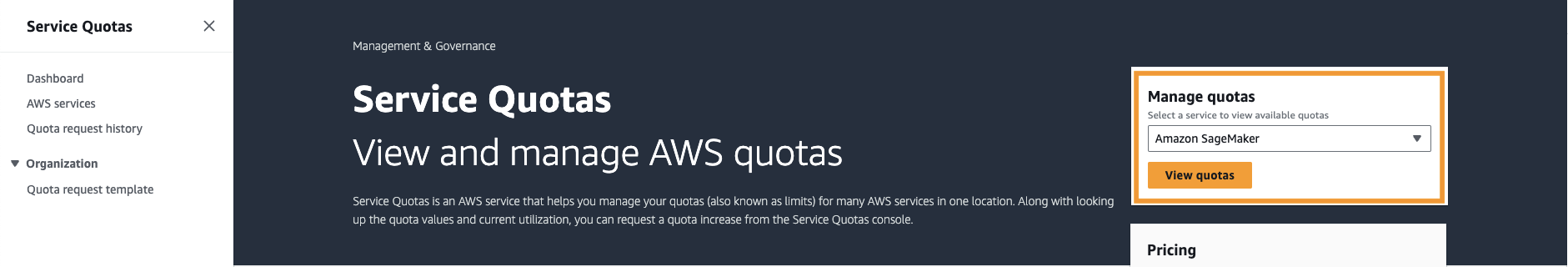

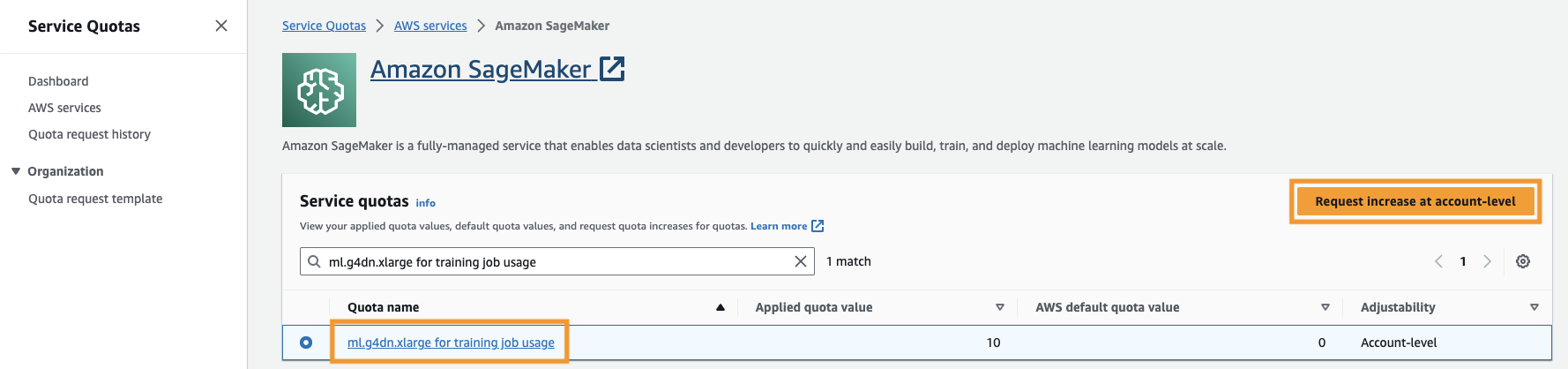

آپ کو بھی بڑھانے کی ضرورت ہے۔ سروس کوٹہ سیج میکر میں ml.g4dn.xlarge کی کم از کم تین مثالوں تک رسائی حاصل کرنے کے لیے۔ مثال کی قسم ml.g4dn.xlarge لاگت سے موثر GPU مثال ہے جو آپ کو مقامی طور پر PyTorch چلانے کی اجازت دیتی ہے۔ سروس کوٹہ بڑھانے کے لیے درج ذیل مراحل کو مکمل کریں:

- کنسول پر، سروس کوٹاس پر جائیں۔

- کے لئے کوٹے کا انتظام کریں۔منتخب کریں ایمیزون سیج میکر، پھر منتخب کریں کوٹہ دیکھیں.

- "ملازمت کے استعمال کے لیے ml-g4dn.xlarge" تلاش کریں اور کوٹہ آئٹم منتخب کریں۔

- میں سے انتخاب کریں اکاؤنٹ کی سطح پر اضافہ کی درخواست کریں۔.

- کے لئے کوٹہ کی قیمت میں اضافہ کریں۔5 یا اس سے زیادہ کی قدر درج کریں۔

- میں سے انتخاب کریں کی درخواست.

اکاؤنٹ کی اجازتوں کے لحاظ سے درخواست کردہ کوٹہ کی منظوری کو مکمل ہونے میں کچھ وقت لگ سکتا ہے۔

- سیج میکر کنسول سے سیج میکر اسٹوڈیو کھولیں۔

- میں سے انتخاب کریں سسٹم ٹرمینل کے تحت افادیت اور فائلیں۔.

- کلون کرنے کے لیے درج ذیل کمانڈ کو چلائیں۔ GitHub repo سیج میکر اسٹوڈیو مثال کے طور پر:

- پر تشریف لے جائیں

amazon-sagemaker-examples/hyperparameter_tuning/neural_architecture_search_llm. - فائل کھولیں

nas_for_llm_with_amt.ipynb. - ماحول کو ایک کے ساتھ ترتیب دیں۔

ml.g4dn.xlargeمثال کے طور پر اور منتخب کریں منتخب کریں.

پہلے سے تربیت یافتہ BERT ماڈل ترتیب دیں۔

اس سیکشن میں، ہم ڈیٹاسیٹ لائبریری سے Recognizing Textual Entailment ڈیٹاسیٹ درآمد کرتے ہیں اور ڈیٹاسیٹ کو تربیت اور توثیق کے سیٹ میں تقسیم کرتے ہیں۔ یہ ڈیٹا سیٹ جملوں کے جوڑے پر مشتمل ہے۔ BERT PLM کا کام دو متن کے ٹکڑوں کو پہچاننا ہے، آیا ایک متن کے ٹکڑے کا مطلب دوسرے ٹکڑے سے نکالا جا سکتا ہے۔ درج ذیل مثال میں، ہم دوسرے فقرے سے پہلے فقرے کے معنی نکال سکتے ہیں:

ہم سے متنی پہچاننے والے انٹیلمنٹ ڈیٹاسیٹ کو لوڈ کرتے ہیں۔ گلو بینچ مارکنگ سویٹ کے ذریعے ڈیٹاسیٹ لائبریری ہمارے تربیتی اسکرپٹ کے اندر ہیگنگ فیس سے (./training.py)۔ ہم GLUE سے اصل تربیتی ڈیٹاسیٹ کو تربیت اور توثیق کے سیٹ میں تقسیم کرتے ہیں۔ اپنے نقطہ نظر میں، ہم تربیتی ڈیٹاسیٹ کا استعمال کرتے ہوئے بیس BERT ماڈل کو ٹھیک بناتے ہیں، پھر ہم ذیلی نیٹ ورکس کے سیٹ کی شناخت کے لیے ایک کثیر مقصدی تلاش کرتے ہیں جو مقصدی میٹرکس کے درمیان بہترین توازن رکھتے ہیں۔ ہم ٹریننگ ڈیٹاسیٹ کو خصوصی طور پر BERT ماڈل کو ٹھیک کرنے کے لیے استعمال کرتے ہیں۔ تاہم، ہم ہولڈ آؤٹ توثیق ڈیٹاسیٹ پر درستگی کی پیمائش کرکے کثیر مقصدی تلاش کے لیے توثیق کا ڈیٹا استعمال کرتے ہیں۔

ڈومین کے لیے مخصوص ڈیٹاسیٹ کا استعمال کرتے ہوئے BERT PLM کو ٹھیک بنائیں

خام BERT ماڈل کے استعمال کے عام معاملات میں اگلے جملے کی پیشن گوئی یا نقاب پوش زبان کی ماڈلنگ شامل ہے۔ بنیادی BERT ماڈل کو ڈاون اسٹریم کے کاموں کے لیے استعمال کرنے کے لیے جیسے کہ ٹیکسٹچوئل ریکگنائزنگ انٹیلمنٹ، ہمیں ڈومین کے لیے مخصوص ڈیٹاسیٹ کا استعمال کرتے ہوئے ماڈل کو مزید ٹھیک کرنا ہوگا۔ آپ ترتیب کی درجہ بندی، سوالوں کے جوابات، اور ٹوکن کی درجہ بندی جیسے کاموں کے لیے ایک عمدہ BERT ماڈل استعمال کر سکتے ہیں۔ تاہم، اس ڈیمو کے مقاصد کے لیے، ہم بائنری درجہ بندی کے لیے فائن ٹیونڈ ماڈل استعمال کرتے ہیں۔ ہم پہلے سے تربیت یافتہ BERT ماڈل کو تربیتی ڈیٹاسیٹ کے ساتھ ٹھیک بناتے ہیں جو ہم نے پہلے تیار کیا تھا، درج ذیل ہائپر پیرامیٹرس کا استعمال کرتے ہوئے:

ہم ماڈل ٹریننگ کی چوکی کو محفوظ کرتے ہیں۔ ایمیزون سادہ اسٹوریج سروس (ایمیزون S3) بالٹی، تاکہ ماڈل کو NAS پر مبنی کثیر مقصدی تلاش کے دوران لوڈ کیا جا سکے۔ اس سے پہلے کہ ہم ماڈل کو تربیت دیں، ہم میٹرکس کی وضاحت کرتے ہیں جیسے کہ عہد، تربیت کا نقصان، پیرامیٹرز کی تعداد، اور توثیق کی خرابی:

ٹھیک ٹیوننگ کا عمل شروع ہونے کے بعد، تربیتی کام کو مکمل ہونے میں تقریباً 15 منٹ لگتے ہیں۔

ذیلی نیٹ ورکس کو منتخب کرنے اور نتائج کو دیکھنے کے لیے کثیر مقصدی تلاش کریں۔

اگلے مرحلے میں، ہم SageMaker AMT کا استعمال کرتے ہوئے بے ترتیب ذیلی نیٹ ورکس کے نمونے لے کر فائن ٹیونڈ بیس BERT ماڈل پر کثیر مقصدی تلاش کرتے ہیں۔ سپر نیٹ ورک (فائن ٹیونڈ BERT ماڈل) کے اندر ذیلی نیٹ ورک تک رسائی حاصل کرنے کے لیے، ہم PLM کے ان تمام اجزاء کو ماسک کر دیتے ہیں جو سب نیٹ ورک کا حصہ نہیں ہیں۔ PLM میں ذیلی نیٹ ورکس کو تلاش کرنے کے لیے سپر نیٹ ورک کو ماسک کرنا ایک تکنیک ہے جو ماڈل کے رویے کے نمونوں کو الگ کرنے اور شناخت کرنے کے لیے استعمال ہوتی ہے۔ نوٹ کریں کہ ہگنگ فیس ٹرانسفارمرز کو سروں کی تعداد کے متعدد ہونے کے لیے پوشیدہ سائز کی ضرورت ہوتی ہے۔ ٹرانسفارمر PLM میں پوشیدہ سائز پوشیدہ اسٹیٹ ویکٹر اسپیس کے سائز کو کنٹرول کرتا ہے، جو ڈیٹا میں پیچیدہ نمائندگیوں اور نمونوں کو سیکھنے کی ماڈل کی صلاحیت کو متاثر کرتا ہے۔ BERT PLM میں، پوشیدہ حالت کا ویکٹر ایک مقررہ سائز (768) کا ہوتا ہے۔ ہم چھپے ہوئے سائز کو تبدیل نہیں کر سکتے، اور اس لیے سروں کی تعداد [1، 3، 6، 12] میں ہونی چاہیے۔

واحد مقصدی اصلاح کے برعکس، کثیر مقصدی ترتیب میں، ہمارے پاس عام طور پر ایک ہی حل نہیں ہوتا ہے جو بیک وقت تمام مقاصد کو بہتر بناتا ہو۔ اس کے بجائے، ہمارا مقصد حلوں کا ایک مجموعہ جمع کرنا ہے جو کم از کم ایک مقصد (جیسے توثیق کی خرابی) میں دیگر تمام حلوں پر حاوی ہو۔ اب ہم اے ایم ٹی کے ذریعے کثیر مقصدی تلاش شروع کر سکتے ہیں ان میٹرکس کو ترتیب دے کر جسے ہم کم کرنا چاہتے ہیں (تصدیق کی خرابی اور پیرامیٹرز کی تعداد)۔ بے ترتیب ذیلی نیٹ ورکس کی وضاحت پیرامیٹر کے ذریعے کی جاتی ہے۔ max_jobs اور بیک وقت ملازمتوں کی تعداد کی وضاحت پیرامیٹر سے ہوتی ہے۔ max_parallel_jobs. ماڈل چیک پوائنٹ کو لوڈ کرنے اور ذیلی نیٹ ورک کا جائزہ لینے کا کوڈ میں دستیاب ہے۔ evaluate_subnetwork.py سکرپٹ.

AMT ٹیوننگ کام کو چلنے میں تقریباً 2 گھنٹے اور 20 منٹ لگتے ہیں۔ اے ایم ٹی ٹیوننگ جاب کے کامیابی سے چلنے کے بعد، ہم جاب کی ہسٹری کو پارس کرتے ہیں اور ذیلی نیٹ ورک کی کنفیگریشنز کو جمع کرتے ہیں، جیسے ہیڈز کی تعداد، پرتوں کی تعداد، اکائیوں کی تعداد، اور متعلقہ میٹرکس جیسے توثیق کی خرابی اور پیرامیٹرز کی تعداد۔ مندرجہ ذیل اسکرین شاٹ AMT ٹونر کے کامیاب کام کا خلاصہ دکھاتا ہے۔

اس کے بعد، ہم Pareto سیٹ (جسے Pareto frontier یا Pareto optimal set بھی کہا جاتا ہے) کا استعمال کرتے ہوئے نتائج کا تصور کرتے ہیں، جو ہمیں ذیلی نیٹ ورکس کے بہترین سیٹوں کی شناخت میں مدد کرتا ہے جو مقصدی میٹرک (توثیق کی خرابی) میں دیگر تمام ذیلی نیٹ ورکس پر غالب ہیں:

سب سے پہلے، ہم AMT ٹیوننگ جاب سے ڈیٹا اکٹھا کرتے ہیں۔ پھر ہم Pareto سیٹ کا استعمال کرتے ہوئے پلاٹ کرتے ہیں۔ matplotlob.pyplot x محور میں پیرامیٹرز کی تعداد اور y محور میں توثیق کی خرابی کے ساتھ۔ اس کا مطلب یہ ہے کہ جب ہم Pareto سیٹ کے ایک ذیلی نیٹ ورک سے دوسرے نیٹ ورک پر جاتے ہیں، تو ہمیں یا تو کارکردگی یا ماڈل سائز کو قربان کرنا چاہیے لیکن دوسرے کو بہتر کرنا چاہیے۔ بالآخر، Pareto سیٹ ہمیں ذیلی نیٹ ورک کا انتخاب کرنے کی لچک فراہم کرتا ہے جو ہماری ترجیحات کے مطابق ہو۔ ہم فیصلہ کر سکتے ہیں کہ ہم اپنے نیٹ ورک کے سائز کو کتنا کم کرنا چاہتے ہیں اور کتنی کارکردگی کو قربان کرنے کو تیار ہیں۔

سیج میکر کا استعمال کرتے ہوئے فائن ٹیونڈ BERT ماڈل اور NAS-آپٹمائزڈ ذیلی نیٹ ورک ماڈل کو تعینات کریں۔

اس کے بعد، ہم اپنے پیریٹو سیٹ میں سب سے بڑا ماڈل تعینات کرتے ہیں جو کارکردگی کی سب سے کم مقدار میں انحطاط کا باعث بنتا ہے۔ سیج میکر اینڈ پوائنٹ. بہترین ماڈل وہ ہے جو توثیق کی خرابی اور ہمارے استعمال کے کیس کے لیے پیرامیٹرز کی تعداد کے درمیان بہترین تجارت فراہم کرتا ہے۔

ماڈل مقابلے

ہم نے پہلے سے تربیت یافتہ بیس BERT ماڈل لیا، ڈومین کے مخصوص ڈیٹاسیٹ کا استعمال کرتے ہوئے اسے ٹھیک بنایا، مقصدی میٹرکس کی بنیاد پر غالب ذیلی نیٹ ورکس کی شناخت کے لیے NAS تلاش کی، اور کٹے ہوئے ماڈل کو SageMaker اینڈ پوائنٹ پر تعینات کیا۔ اس کے علاوہ، ہم نے پہلے سے تربیت یافتہ بیس BERT ماڈل لیا اور بیس ماڈل کو دوسرے SageMaker اینڈ پوائنٹ پر تعینات کیا۔ اگلا، ہم بھاگ گئے لوڈ ٹیسٹنگ Locust کا استعمال کرتے ہوئے دونوں انفرنس اینڈ پوائنٹس پر اور جوابی وقت کے لحاظ سے کارکردگی کا جائزہ لیا۔

سب سے پہلے، ہم ضروری Locust اور Boto3 لائبریریاں درآمد کرتے ہیں۔ پھر ہم ایک درخواست کا میٹا ڈیٹا بناتے ہیں اور لوڈ ٹیسٹنگ کے لیے استعمال ہونے والے آغاز کا وقت ریکارڈ کرتے ہیں۔ پھر پے لوڈ کو بوٹو کلائنٹ کے ذریعے سیج میکر اینڈ پوائنٹ انووک API کو منتقل کیا جاتا ہے تاکہ صارف کی حقیقی درخواستوں کی تقلید کی جا سکے۔ ہم متعدد ورچوئل صارفین کو متوازی طور پر درخواستیں بھیجنے اور لوڈ کے نیچے اختتامی نقطہ کی کارکردگی کی پیمائش کرنے کے لیے Locust کا استعمال کرتے ہیں۔ ٹیسٹ بالترتیب ہر دو اینڈ پوائنٹس کے لیے صارفین کی تعداد میں اضافہ کر کے چلائے جاتے ہیں۔ ٹیسٹ مکمل ہونے کے بعد، Locust ہر تعینات کردہ ماڈلز کے لیے درخواست کے اعداد و شمار کی CSV فائل کو آؤٹ پٹ کرتا ہے۔

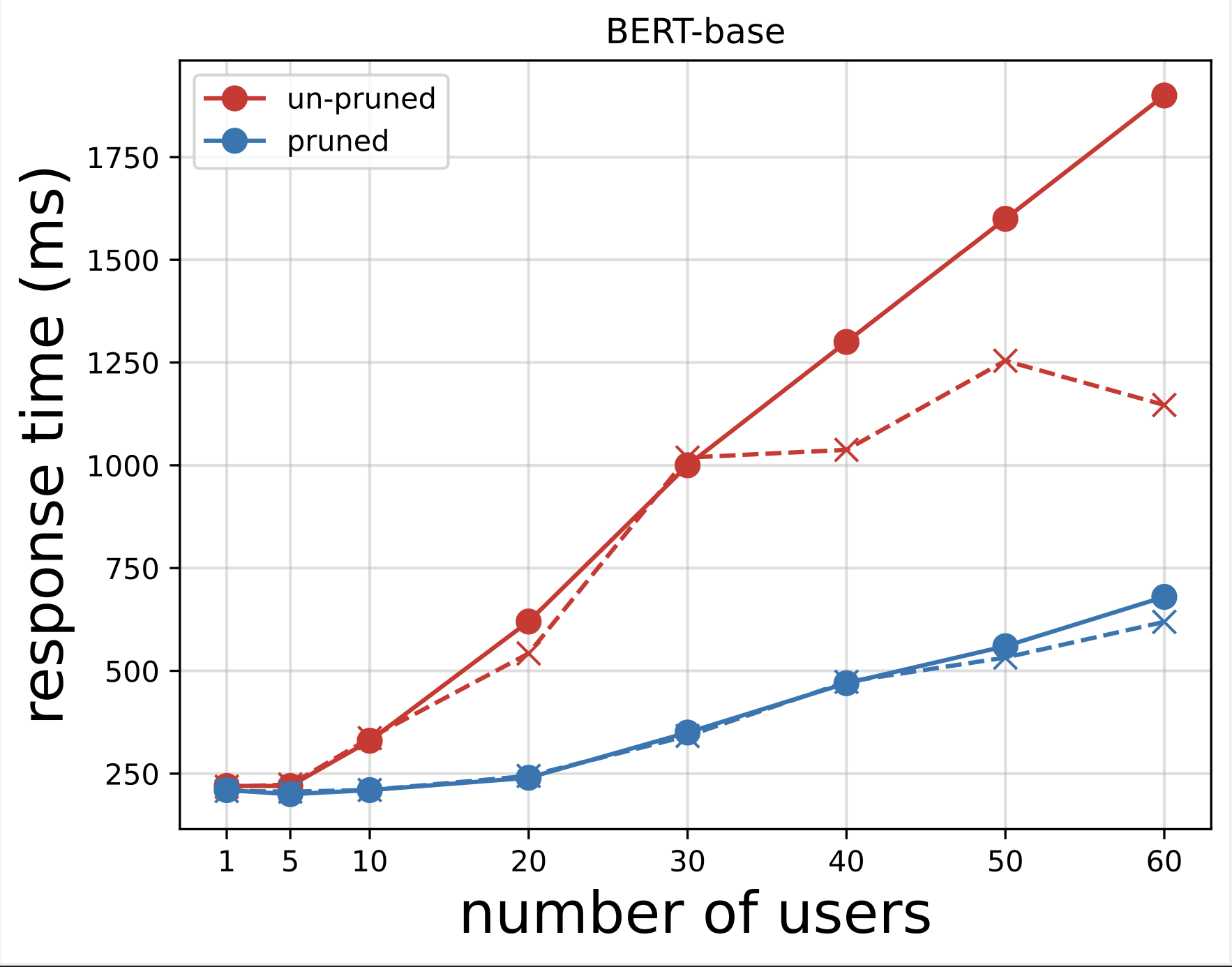

اگلا، ہم Locust کے ساتھ ٹیسٹ چلانے کے بعد ڈاؤن لوڈ کی گئی CSV فائلوں سے رسپانس ٹائم پلاٹ تیار کرتے ہیں۔ رسپانس ٹائم بمقابلہ صارفین کی تعداد کی منصوبہ بندی کرنے کا مقصد ماڈل اینڈ پوائنٹس کے رسپانس ٹائم کے اثرات کو دیکھ کر لوڈ ٹیسٹنگ کے نتائج کا تجزیہ کرنا ہے۔ مندرجہ ذیل چارٹ میں، ہم دیکھ سکتے ہیں کہ NAS-پرونڈ ماڈل اینڈ پوائنٹ بیس BERT ماڈل اینڈ پوائنٹ کے مقابلے میں کم رسپانس ٹائم حاصل کرتا ہے۔

دوسرے چارٹ میں، جو کہ پہلے چارٹ کی توسیع ہے، ہم مشاہدہ کرتے ہیں کہ تقریباً 70 صارفین کے بعد، سیج میکر بیس بی ای آر ٹی ماڈل کے اختتامی نقطے کو ختم کرنا شروع کر دیتا ہے اور ایک استثناء کو پھینک دیتا ہے۔ تاہم، NAS کے کٹے ہوئے ماڈل اینڈ پوائنٹ کے لیے، تھروٹلنگ 90-100 صارفین کے درمیان اور کم رسپانس ٹائم کے ساتھ ہوتی ہے۔

دو چارٹوں سے، ہم مشاہدہ کرتے ہیں کہ کٹے ہوئے ماڈل میں تیز ردعمل کا وقت ہوتا ہے اور غیر کٹے ہوئے ماڈل کے مقابلے میں بہتر ترازو ہوتا ہے۔ جیسا کہ ہم انفرنس اینڈ پوائنٹس کی تعداد کو پیمانہ کرتے ہیں، جیسا کہ ان صارفین کے ساتھ ہوتا ہے جو اپنی PLM ایپلیکیشنز کے لیے بڑی تعداد میں انفرنس اینڈ پوائنٹس لگاتے ہیں، لاگت کے فوائد اور کارکردگی میں بہتری کافی حد تک ہونے لگتی ہے۔

صاف کرو

Fine-tuned بیس BERT ماڈل اور NAS-pruned ماڈل کے SageMaker اینڈ پوائنٹس کو حذف کرنے کے لیے، درج ذیل مراحل کو مکمل کریں:

- سیج میکر کنسول پر، منتخب کریں۔ ارادہ اور اختتامی نکات نیوی گیشن پین میں.

- اختتامی نقطہ کو منتخب کریں اور اسے حذف کریں۔

متبادل طور پر، سیج میکر اسٹوڈیو نوٹ بک سے، اختتامی نقطہ کے نام فراہم کرکے درج ذیل کمانڈز چلائیں:

نتیجہ

اس پوسٹ میں، ہم نے اس بات پر تبادلہ خیال کیا کہ NAS کو ٹھیک ٹیونڈ BERT ماڈل کی کٹائی کے لیے کیسے استعمال کیا جائے۔ ہم نے پہلے ڈومین کے مخصوص ڈیٹا کا استعمال کرتے ہوئے ایک بیس BERT ماڈل کو تربیت دی اور اسے SageMaker اینڈ پوائنٹ پر تعینات کیا۔ ہم نے ٹارگٹ ٹاسک کے لیے SageMaker AMT کا استعمال کرتے ہوئے فائن ٹیونڈ بیس BERT ماڈل پر کثیر مقصدی تلاش کی۔ ہم نے Pareto فرنٹ کا تصور کیا اور Pareto بہترین NAS-pruned BERT ماڈل کا انتخاب کیا اور ماڈل کو دوسرے SageMaker اینڈ پوائنٹ پر تعینات کیا۔ ہم نے Locust کا استعمال کرتے ہوئے لوڈ ٹیسٹنگ انجام دی تاکہ صارفین دونوں اختتامی نقطوں سے استفسار کر سکیں، اور CSV فائل میں جوابی اوقات کو ماپا اور ریکارڈ کیا۔ ہم نے دونوں ماڈلز کے لیے جوابی وقت بمقابلہ صارفین کی تعداد کی منصوبہ بندی کی۔

ہم نے مشاہدہ کیا کہ کٹے ہوئے BERT ماڈل نے رسپانس ٹائم اور مثال کے طور پر تھروٹلنگ تھریشولڈ دونوں میں نمایاں طور پر بہتر کارکردگی کا مظاہرہ کیا۔ ہم نے یہ نتیجہ اخذ کیا کہ NAS کا کٹا ہوا ماڈل اختتامی نقطہ پر بڑھے ہوئے بوجھ کے لیے زیادہ لچکدار تھا، جوابی وقت کو کم برقرار رکھتا ہے یہاں تک کہ زیادہ صارفین نے بیس BERT ماڈل کے مقابلے سسٹم پر زور دیا۔ آپ اس پوسٹ میں بیان کردہ NAS تکنیک کو کسی بھی بڑے زبان کے ماڈل پر لاگو کر سکتے ہیں تاکہ ایک کٹا ہوا ماڈل تلاش کیا جا سکے جو نمایاں طور پر کم رسپانس ٹائم کے ساتھ ہدف کا کام انجام دے سکے۔ آپ توثیق کے نقصان کے علاوہ پیرامیٹر کے طور پر تاخیر کا استعمال کرکے نقطہ نظر کو مزید بہتر بنا سکتے ہیں۔

اگرچہ ہم اس پوسٹ میں NAS کا استعمال کرتے ہیں، لیکن کوانٹائزیشن ایک اور عام طریقہ ہے جو PLM ماڈلز کو بہتر اور کمپریس کرنے کے لیے استعمال کیا جاتا ہے۔ کوانٹائزیشن ایک تربیت یافتہ نیٹ ورک میں وزن اور ایکٹیویشن کی درستگی کو 32 بٹ فلوٹنگ پوائنٹ سے کم بٹ چوڑائی جیسے 8 بٹ یا 16 بٹ انٹیجرز تک کم کرتی ہے، جس کے نتیجے میں ایک کمپریسڈ ماڈل ہوتا ہے جو تیز تر اندازہ پیدا کرتا ہے۔ کوانٹائزیشن پیرامیٹرز کی تعداد کو کم نہیں کرتی ہے۔ اس کے بجائے یہ کمپریسڈ ماڈل حاصل کرنے کے لیے موجودہ پیرامیٹرز کی درستگی کو کم کرتا ہے۔ NAS کی کٹائی PLM میں بے کار نیٹ ورکس کو ہٹاتی ہے، جو کم پیرامیٹرز کے ساتھ ایک ویرل ماڈل بناتا ہے۔ عام طور پر، ماڈل کی درستگی کو برقرار رکھنے، کارکردگی کو بہتر بنانے کے دوران توثیق کے نقصانات کو کم کرنے، اور ماڈل کے سائز کو کم کرنے کے لیے NAS کی کٹائی اور کوانٹائزیشن کو ایک ساتھ استعمال کیا جاتا ہے۔ PLMs کے سائز کو کم کرنے کے لیے عام طور پر استعمال ہونے والی دوسری تکنیکوں میں شامل ہیں۔ علم کشید, میٹرکس فیکٹرائزیشن، اور آسون جھرن.

بلاگ پوسٹ میں تجویز کردہ نقطہ نظر ان ٹیموں کے لیے موزوں ہے جو SageMaker کا استعمال کرتے ہوئے ڈومین کے مخصوص ڈیٹا کا استعمال کرتے ہوئے ماڈلز کو تربیت دینے اور ٹھیک کرنے کے لیے استعمال کرتی ہیں اور نتیجہ اخذ کرنے کے لیے اختتامی نقطوں کو تعینات کرتی ہیں۔ اگر آپ ایک مکمل طور پر منظم سروس کی تلاش کر رہے ہیں جو اعلی کارکردگی کا مظاہرہ کرنے والے فاؤنڈیشن ماڈلز کا انتخاب پیش کرتی ہے جن کی تخلیقی AI ایپلی کیشنز کی تعمیر کے لیے ضروری ہے، استعمال کرنے پر غور کریں۔ ایمیزون بیڈرک. اگر آپ وسیع پیمانے پر کاروباری استعمال کے معاملات کے لیے پہلے سے تربیت یافتہ، اوپن سورس ماڈلز تلاش کر رہے ہیں اور حل ٹیمپلیٹس اور مثال کے نوٹ بک تک رسائی حاصل کرنا چاہتے ہیں، تو استعمال کرنے پر غور کریں۔ ایمیزون سیج میکر جمپ اسٹارٹ. Hugging Face BERT بیس کیسڈ ماڈل کا ایک پہلے سے تربیت یافتہ ورژن جسے ہم نے اس پوسٹ میں استعمال کیا ہے SageMaker JumpStart سے بھی دستیاب ہے۔

مصنفین کے بارے میں

اپراجیتھن ویدیا ناتھن AWS میں پرنسپل انٹرپرائز سلوشنز آرکیٹیکٹ ہیں۔ وہ ایک کلاؤڈ آرکیٹیکٹ ہے جس کے پاس انٹرپرائز، بڑے پیمانے پر اور تقسیم شدہ سافٹ ویئر سسٹمز کو ڈیزائن اور تیار کرنے کا 24+ سال کا تجربہ ہے۔ وہ جنریٹو اے آئی اور مشین لرننگ ڈیٹا انجینئرنگ میں مہارت رکھتا ہے۔ وہ میراتھن کا خواہشمند رنر ہے اور اس کے مشاغل میں پیدل سفر، بائیک چلانا اور اپنی بیوی اور دو لڑکوں کے ساتھ وقت گزارنا شامل ہے۔

اپراجیتھن ویدیا ناتھن AWS میں پرنسپل انٹرپرائز سلوشنز آرکیٹیکٹ ہیں۔ وہ ایک کلاؤڈ آرکیٹیکٹ ہے جس کے پاس انٹرپرائز، بڑے پیمانے پر اور تقسیم شدہ سافٹ ویئر سسٹمز کو ڈیزائن اور تیار کرنے کا 24+ سال کا تجربہ ہے۔ وہ جنریٹو اے آئی اور مشین لرننگ ڈیٹا انجینئرنگ میں مہارت رکھتا ہے۔ وہ میراتھن کا خواہشمند رنر ہے اور اس کے مشاغل میں پیدل سفر، بائیک چلانا اور اپنی بیوی اور دو لڑکوں کے ساتھ وقت گزارنا شامل ہے۔

ایرون کلین AWS میں ایک Sr Applied Scientist ہے جو ڈیپ نیورل نیٹ ورکس کے لیے خودکار مشین لرننگ طریقوں پر کام کر رہا ہے۔

ایرون کلین AWS میں ایک Sr Applied Scientist ہے جو ڈیپ نیورل نیٹ ورکس کے لیے خودکار مشین لرننگ طریقوں پر کام کر رہا ہے۔

جیسیک گولبیوسکی AWS میں ایک Sr Applied Scientist ہے۔

جیسیک گولبیوسکی AWS میں ایک Sr Applied Scientist ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/reduce-inference-time-for-bert-models-using-neural-architecture-search-and-sagemaker-automated-model-tuning/

- : ہے

- : ہے

- : نہیں

- :کہاں

- ][p

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 15٪

- 17

- 19

- 20

- 26

- 30

- 31

- 320

- 7

- 70

- 72

- 8

- 9

- a

- کی صلاحیت

- قابلیت

- تک رسائی حاصل

- اکاؤنٹ

- درستگی

- حاصل

- حاصل کرتا ہے

- ایکٹیویشنز

- اس کے علاوہ

- منہ بولابیٹا بنانے

- کے بعد

- AI

- مقصد

- مقصد

- یلگوردمز

- تمام

- کی اجازت

- اجازت دے رہا ہے

- کی اجازت دیتا ہے

- بھی

- ایمیزون

- ایمیزون ویب سروسز

- رقم

- an

- تجزیہ

- تجزیاتی

- تجزیے

- اور

- ایک اور

- جواب

- کوئی بھی

- اے پی آئی

- ایپلی کیشنز

- اطلاقی

- کا اطلاق کریں

- درخواست دینا

- نقطہ نظر

- منظوری

- تقریبا

- فن تعمیر

- کیا

- رقبہ

- علاقوں

- دلائل

- ارد گرد

- مصنوعی

- مصنوعی اعصابی نیٹ ورک

- AS

- خواہشمند

- تفویض

- منسلک

- At

- کوشش کرنا

- توقع

- آٹومیٹڈ

- خودکار مشین لرننگ

- خودکار

- خودکار

- خودکار

- میشن

- دستیاب

- AWS

- محور

- متوازن

- بیس

- کی بنیاد پر

- BE

- بن

- اس سے پہلے

- رویے

- بینچ مارکنگ

- فوائد

- BEST

- بہتر

- کے درمیان

- بٹ

- جسم

- دونوں

- تعمیر

- کاروبار

- کاروبار کے عمل

- بزنس پروسیس آٹومیشن

- لیکن

- by

- کر سکتے ہیں

- امیدوار

- صلاحیتوں

- کیس

- مقدمات

- کیٹلوگ

- تبدیل

- چارٹ

- چارٹس

- چیٹ بٹس

- انتخاب

- میں سے انتخاب کریں

- منتخب کیا

- طبقے

- درجہ بندی

- کلینکل

- قریب سے

- بادل

- کوڈ

- جمع

- مجموعہ

- کے مجموعے

- تجارتی

- کامن

- عام طور پر

- مقابلے میں

- مکمل

- مکمل

- پیچیدہ

- پیچیدگی

- اجزاء

- کمپیوٹیشنل

- کمپیوٹنگ

- تصورات

- یہ نتیجہ اخذ کیا

- غور کریں

- مشتمل

- کنسول

- رکاوٹوں

- تعمیر

- کھپت

- پر مشتمل ہے

- مواد

- مواد کی تخلیق

- سیاق و سباق

- جاری

- اس کے برعکس

- کنٹرول

- اسی کے مطابق

- قیمت

- اخراجات

- شمار

- تخلیق

- پیدا

- مخلوق

- گاہک

- کسٹمر سروس

- اعداد و شمار

- ڈیٹا سائنس

- ڈیٹاسیٹس

- تاریخ کے وقت

- فیصلہ کرنا

- فیصلہ کرنا

- وقف

- گہری

- گہرے عصبی نیٹ ورک

- وضاحت

- کی وضاحت

- وضاحت

- ڈیمو

- مظاہرہ

- منحصر ہے

- تعیناتی

- تعینات

- تعینات

- تعینات کرتا ہے

- بیان کیا

- ڈیزائن

- ڈیزائننگ

- مطلوبہ

- ترقی

- مختلف

- بات چیت

- تقسیم کئے

- دستاویز

- نہیں کرتا

- غالب

- غلبہ

- نہیں

- دو

- کے دوران

- e

- ہر ایک

- کارکردگی

- ہنر

- یا تو

- اختتام پوائنٹ

- اختتام

- انجنیئرنگ

- انجن

- کافی

- درج

- انٹرپرائز

- انٹرپرائز گود لینے

- انٹرپرائز کے حل

- ہستی

- اندراج

- ماحولیات

- عہد

- خرابی

- Ether (ETH)

- اندازہ

- اندازہ

- اندازہ

- بھی

- واقعات

- مثال کے طور پر

- اس کے علاوہ

- رعایت

- خاص طور سے

- موجودہ

- تجربہ

- وضاحت

- وضاحت کی

- مدت ملازمت میں توسیع

- چہرہ

- جھوٹی

- تیز تر

- خصوصیات

- آراء

- کم

- میدان

- فائل

- فائلوں

- فائنل

- مل

- تلاش

- پہلا

- مقرر

- لچک

- سچل

- کے بعد

- فوٹ پرنٹ

- کے لئے

- ملا

- فاؤنڈیشن

- سے

- سامنے

- فرنٹیئر

- مکمل طور پر

- تقریب

- مزید

- پیدا

- پیدا ہوتا ہے

- پیداواری

- پیداواری AI۔

- حاصل

- دی

- مقصد

- GPU

- بھوری رنگ

- ہوتا ہے

- ہے

- he

- سر

- سر

- صحت کی دیکھ بھال

- مدد کرتا ہے

- پوشیدہ

- اعلی کارکردگی

- اعلی

- لمبی پیدل سفر

- ان

- تاریخ

- درجہ

- میزبان

- میزبانی کی

- HOURS

- کس طرح

- کیسے

- تاہم

- HTML

- HTTP

- HTTPS

- گلے لگانے والا چہرہ

- ہائپر پیرامیٹر کی اصلاح

- ہائپر پیرامیٹر ٹیوننگ

- i

- شناخت

- IDX

- if

- وضاحت

- اثر

- اثرات

- پر عملدرآمد

- درآمد

- کو بہتر بنانے کے

- بہتر

- بہتری

- کو بہتر بنانے کے

- in

- شامل

- اضافہ

- اضافہ

- اضافہ

- معلومات

- انفراسٹرکچر

- ان پٹ

- مثال کے طور پر

- واقعات

- کے بجائے

- انٹیلجنٹ

- میں

- IT

- میں

- ایوب

- نوکریاں

- فوٹو

- JSON

- علم

- جانا جاتا ہے

- زبان

- بڑے

- بڑے پیمانے پر

- سب سے بڑا

- تاخیر

- پرت

- تہوں

- لیڈز

- جانیں

- سیکھنے

- کم سے کم

- دو

- لائبریریوں

- لائبریری

- لائن

- لوڈ

- لاگ ان کریں

- لاگ ان

- تلاش

- بند

- نقصانات

- کم

- مشین

- مشین لرننگ

- برقرار رکھنے کے

- برقرار رکھنے

- آدمی

- میں کامیاب

- میراتھن

- ماسک

- matplotlib

- زیادہ سے زیادہ

- مئی..

- مطلب

- پیمائش

- ماپا

- پیمائش

- طبی

- سے ملو

- یاد داشت

- میٹا ڈیٹا

- طریقوں

- میٹرک۔

- پیمائش کا معیار

- شاید

- کم سے کم

- منٹ

- ML

- ماڈل

- ماڈلنگ

- ماڈل

- ماڈیولر

- زیادہ

- منتقل

- بہت

- ایک سے زیادہ

- ضروری

- نام

- نامزد

- نام

- میں

- قدرتی

- قدرتی زبان

- قدرتی زبان عملیات

- تشریف لے جائیں

- سمت شناسی

- ضروری

- ضرورت ہے

- ضرورت

- ضروریات

- نیٹ ورک

- نیٹ ورک

- عصبی

- عصبی نیٹ ورک

- نیند نیٹ ورک

- اگلے

- ویزا

- کوئی بھی نہیں

- براہ مہربانی نوٹ کریں

- نوٹ بک

- نوٹ بک

- اب

- تعداد

- اعتراض

- مقصد

- مقاصد

- مشاہدہ

- مشاہدہ

- of

- بند

- پیش کرتے ہیں

- تجویز

- on

- ایک

- آن لائن

- آن لائن خوردہ فروش

- صرف

- کھول

- اوپن سورس

- زیادہ سے زیادہ

- اصلاح کے

- کی اصلاح کریں

- اصلاح

- اصلاح کرتا ہے

- اصلاح

- or

- حکم

- اصل

- دیگر

- ہمارے

- باہر

- پیداوار

- نتائج

- پر

- مجموعی طور پر

- مجموعی جائزہ

- خود

- جوڑے

- پین

- متوازی

- پیرامیٹر

- پیرامیٹرز

- پیرو

- حصہ

- منظور

- راستہ

- مریض

- پیٹرن

- انجام دینے کے

- کارکردگی

- کارکردگی

- کارکردگی کا مظاہرہ

- کارکردگی کا مظاہرہ

- اجازتیں

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- پوائنٹ

- پوائنٹس

- پوزیشنوں

- پوسٹ

- صحت سے متعلق

- کی پیشن گوئی

- پیشن گوئی

- پیش گو

- ترجیحات

- تیار

- ضروریات

- حال (-)

- پہلے

- پرنسپل

- مسئلہ

- عمل

- عمل آٹومیشن

- عمل

- پروسیسنگ

- مصنوعات

- پیداوری

- پروڈکٹیوٹی، فورم کے اوزار

- مجوزہ

- فراہم کنندہ

- فراہم کرتا ہے

- فراہم کرنے

- ھیںچو

- ھیںچتی

- مقصد

- مقاصد

- ازگر

- pytorch

- سوال و جواب

- سوال

- بہت

- بے ترتیب

- رینج

- تیزی سے

- قیمتیں

- خام

- اصلی

- تسلیم

- تسلیم

- تسلیم کرنا

- سفارش

- سفارشات

- ریکارڈ

- درج

- ریڈ

- کو کم

- کم

- کم

- رجعت

- متعلقہ

- ہٹاتا ہے

- کو ہٹانے کے

- رپورٹیں

- نمائندگی

- درخواست

- درخواست کی

- درخواستوں

- ضرورت

- ضروریات

- لچکدار

- وسائل

- وسائل

- بالترتیب

- جواب

- نتائج کی نمائش

- خوردہ فروش

- برقرار رکھنے

- واپسی

- سوار

- رسک

- ROW

- رن

- دوسرے نمبر پر

- چل رہا ہے

- چلتا ہے

- s

- قربان

- sagemaker

- سیج میکر کا اندازہ

- محفوظ کریں

- پیمانے

- ترازو

- سائنس

- سائنسدان

- سکور

- اسکرپٹ

- تلاش کریں

- تلاش کے انجن

- تلاش

- دوسری

- سیکشن

- دیکھنا

- منتخب

- منتخب

- SELF

- بھیجنے

- سزا

- جذبات

- تسلسل

- سروس

- سروسز

- اجلاس

- مقرر

- سیٹ

- قائم کرنے

- شوز

- سگنل

- نمایاں طور پر

- سادہ

- ساتھ ساتھ

- بیک وقت

- ایک

- سائز

- چھوٹے

- So

- سافٹ ویئر کی

- حل

- حل

- کچھ

- ماخذ

- خلا

- سپون

- خصوصی

- مہارت دیتا ہے

- مخصوص

- خاص طور پر

- خرچ کرنا۔

- تقسیم

- شروع کریں

- شروع ہوتا ہے

- حالت

- کے اعداد و شمار

- مرحلہ

- مراحل

- ذخیرہ

- ساختی

- منظم

- سٹوڈیو

- کافی

- کامیاب

- کامیابی کے ساتھ

- اس طرح

- موزوں

- سویٹ

- خلاصہ

- کے نظام

- سسٹمز

- T

- لے لو

- لیتا ہے

- ہدف

- ٹاسک

- کاموں

- ٹیموں

- تکنیک

- تکنیک

- سانچے

- شرائط

- ٹیسٹنگ

- ٹیسٹ

- متن

- متن کی درجہ بندی

- متنی

- سے

- کہ

- ۔

- ان

- تو

- وہاں.

- لہذا

- یہ

- اس

- تین

- حد

- کے ذریعے

- وقت

- اوقات

- کرنے کے لئے

- مل کر

- ٹوکن

- لیا

- کے آلے

- اوزار

- تجارت

- ٹریڈنگ

- ٹرین

- تربیت یافتہ

- ٹریننگ

- ٹرانسفارمر

- ٹرانسفارمرز

- سچ

- کوشش

- دو

- قسم

- اقسام

- ٹھیٹھ

- عام طور پر

- آخر میں

- کے تحت

- گزر رہا ہے

- افہام و تفہیم

- یونٹس

- us

- استعمال کی شرائط

- استعمال کیس

- استعمال کیا جاتا ہے

- رکن کا

- صارفین

- استعمال

- کا استعمال کرتے ہوئے

- توثیق

- قیمت

- اقدار

- ورژن

- کی طرف سے

- مجازی

- تصور کرنا

- vs

- چاہتے ہیں

- تھا

- we

- ویب

- ویب خدمات

- اچھا ہے

- جب

- چاہے

- جس

- جبکہ

- ڈبلیو

- وسیع

- وسیع رینج

- بڑے پیمانے پر

- بیوی

- وکیپیڈیا

- گے

- تیار

- ساتھ

- کے اندر

- کام

- کام کا بہاؤ

- کام کر

- X

- سال

- پیداوار

- آپ

- اور

- زیفیرنیٹ