اوپن اے آئی سرگوشی MIT لائسنس کے ساتھ ایک اعلی درجے کی خودکار اسپیچ ریکگنیشن (ASR) ماڈل ہے۔ ASR ٹیکنالوجی ٹرانسکرپشن سروسز، صوتی معاونین، اور سماعت سے محروم افراد کے لیے رسائی کو بڑھانے میں افادیت تلاش کرتی ہے۔ یہ جدید ترین ماڈل ویب سے جمع کردہ کثیر لسانی اور ملٹی ٹاسک زیر نگرانی ڈیٹا کے وسیع اور متنوع ڈیٹاسیٹ پر تربیت یافتہ ہے۔ اس کی اعلیٰ درستگی اور موافقت اسے آواز سے متعلق کاموں کی ایک وسیع صف کے لیے ایک قیمتی اثاثہ بناتی ہے۔

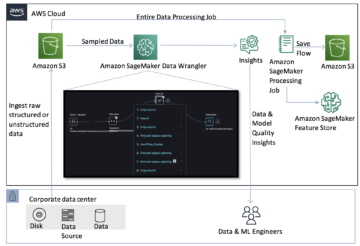

مشین لرننگ اور مصنوعی ذہانت کے ابھرتے ہوئے منظر نامے میں، ایمیزون سیج میکر ایک جامع ماحولیاتی نظام فراہم کرتا ہے۔ SageMaker ڈیٹا سائنسدانوں، ڈویلپرز، اور تنظیموں کو بڑے پیمانے پر مشین لرننگ ماڈل تیار کرنے، تربیت دینے، تعینات کرنے اور ان کا نظم کرنے کا اختیار دیتا ہے۔ ٹولز اور صلاحیتوں کی ایک وسیع رینج پیش کرتے ہوئے، یہ پورے مشین لرننگ ورک فلو کو آسان بناتا ہے، ڈیٹا پری پروسیسنگ اور ماڈل ڈیولپمنٹ سے لے کر آسان تعیناتی اور نگرانی تک۔ سیج میکر کا صارف دوست انٹرفیس اسے مصنوعی ذہانت کے دائرے میں گیم بدلنے والے حل کے طور پر قائم کرتے ہوئے AI کی مکمل صلاحیت کو کھولنے کا ایک اہم پلیٹ فارم بناتا ہے۔

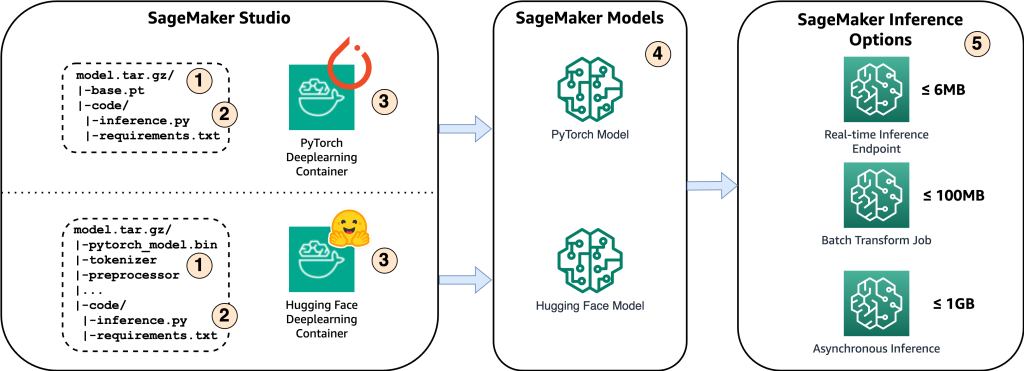

اس پوسٹ میں، ہم SageMaker کی صلاحیتوں کی تلاش شروع کرتے ہیں، خاص طور پر Whisper ماڈلز کی میزبانی پر توجہ مرکوز کرتے ہوئے۔ ہم ایسا کرنے کے لیے دو طریقوں کی گہرائی میں غوطہ لگائیں گے: ایک Whisper PyTorch ماڈل کا استعمال کرنا اور دوسرا Whisper ماڈل کے Hugging Face نفاذ کو استعمال کرنا۔ مزید برآں، ہم SageMaker کے انفرنس کے اختیارات کا گہرائی سے جائزہ لیں گے، ان کا موازنہ رفتار، لاگت، پے لوڈ سائز، اور اسکیل ایبلٹی جیسے پیرامیٹرز میں کریں گے۔ یہ تجزیہ صارفین کو باخبر فیصلے کرنے کا اختیار دیتا ہے جب Whisper ماڈل کو ان کے مخصوص استعمال کے معاملات اور سسٹمز میں ضم کرتے ہیں۔

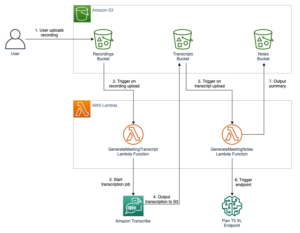

حل جائزہ

مندرجہ ذیل خاکہ اس حل کے اہم اجزاء کو دکھاتا ہے۔

- ایمیزون سیج میکر پر ماڈل کی میزبانی کرنے کے لیے، پہلا قدم ماڈل کے نمونے کو محفوظ کرنا ہے۔ یہ نمونے مختلف ایپلی کیشنز کے لیے درکار مشین لرننگ ماڈل کے ضروری اجزاء کا حوالہ دیتے ہیں، بشمول تعیناتی اور دوبارہ تربیت۔ ان میں ماڈل پیرامیٹرز، کنفیگریشن فائلز، پری پروسیسنگ اجزاء کے ساتھ ساتھ میٹا ڈیٹا، جیسے ورژن کی تفصیلات، تصنیف، اور اس کی کارکردگی سے متعلق کوئی بھی نوٹس شامل ہوسکتا ہے۔ یہ نوٹ کرنا ضروری ہے کہ PyTorch اور Hugging Face کے نفاذ کے لیے Whisper ماڈلز مختلف ماڈل کے نمونے پر مشتمل ہوتے ہیں۔

- اگلا، ہم اپنی مرضی کے مطابق انفرنس اسکرپٹ بناتے ہیں۔ ان اسکرپٹس کے اندر، ہم اس بات کی وضاحت کرتے ہیں کہ ماڈل کو کس طرح لوڈ کیا جانا چاہیے اور انفرنس کے عمل کی وضاحت کرتے ہیں۔ یہ وہ جگہ ہے جہاں ہم ضرورت کے مطابق حسب ضرورت پیرامیٹرز کو شامل کر سکتے ہیں۔ مزید برآں، آپ مطلوبہ ازگر پیکجوں کو a

requirements.txtفائل ماڈل کی تعیناتی کے دوران، یہ Python پیکجز خود بخود ابتدائی مرحلے میں انسٹال ہو جاتے ہیں۔ - اس کے بعد ہم یا تو PyTorch یا Hugging Face ڈیپ لرننگ کنٹینرز (DLC) کا انتخاب کرتے ہیں جو فراہم کردہ اور دیکھ بھال کرتے ہیں۔ AWS. یہ کنٹینرز پہلے سے تیار کردہ ڈوکر امیجز ہیں جن میں ڈیپ لرننگ فریم ورک اور دیگر ضروری Python پیکجز ہیں۔ مزید معلومات کے لیے، آپ اسے چیک کر سکتے ہیں۔ لنک.

- ماڈل آرٹفیکٹس، حسب ضرورت انفرنس اسکرپٹس اور منتخب ڈی ایل سی کے ساتھ، ہم بالترتیب PyTorch اور Hugging Face کے لیے Amazon SageMaker ماڈل بنائیں گے۔

- آخر میں، ماڈلز کو SageMaker پر تعینات کیا جا سکتا ہے اور درج ذیل اختیارات کے ساتھ استعمال کیا جا سکتا ہے: ریئل ٹائم انفرنس اینڈ پوائنٹس، بیچ ٹرانسفارم جابز، اور غیر مطابقت پذیر انفرنس اینڈ پوائنٹس۔ ہم بعد میں اس پوسٹ میں ان اختیارات میں مزید تفصیل سے غور کریں گے۔

اس حل کے لیے مثال نوٹ بک اور کوڈ اس پر دستیاب ہے۔ GitHub ذخیرہ.

تصویر 1. کلیدی حل کے اجزاء کا جائزہ

واک تھرو

ایمیزون سیج میکر پر وسپر ماڈل کی میزبانی کرنا

اس سیکشن میں، ہم بالترتیب PyTorch اور Hugging Face Frameworks کا استعمال کرتے ہوئے Amazon SageMaker پر Whisper ماڈل کی میزبانی کرنے کے اقدامات کی وضاحت کریں گے۔ اس حل کے ساتھ تجربہ کرنے کے لیے، آپ کو AWS اکاؤنٹ اور Amazon SageMaker سروس تک رسائی کی ضرورت ہے۔

PyTorch فریم ورک

- ماڈل نمونے کو محفوظ کریں۔

ماڈل کی میزبانی کرنے کا پہلا آپشن استعمال کرنا ہے۔ Whisper آفیشل ازگر پیکج، جس کا استعمال کرتے ہوئے انسٹال کیا جاسکتا ہے۔ pip install openai-whisper. یہ پیکج ایک PyTorch ماڈل فراہم کرتا ہے۔ مقامی ریپوزٹری میں ماڈل کے نمونے محفوظ کرتے وقت، پہلا قدم یہ ہے کہ ماڈل کے سیکھنے کے قابل پیرامیٹرز، جیسے کہ ماڈل کے وزن اور نیورل نیٹ ورک میں ہر پرت کے تعصبات کو بطور 'pt' فائل محفوظ کرنا ہے۔ آپ مختلف ماڈل سائزوں میں سے انتخاب کر سکتے ہیں، بشمول 'چھوٹا،' 'بیس،' 'چھوٹا،' 'میڈیم' اور 'بڑا۔' بڑے ماڈل کے سائز زیادہ درستگی کی کارکردگی پیش کرتے ہیں، لیکن زیادہ قیاس میں تاخیر کی قیمت پر آتے ہیں۔ مزید برآں، آپ کو ماڈل اسٹیٹ ڈکشنری اور ڈائمینشن ڈکشنری کو محفوظ کرنے کی ضرورت ہے، جس میں ایک Python ڈکشنری ہے جو PyTorch ماڈل کی ہر پرت یا پیرامیٹر کو اس کے متعلقہ سیکھنے کے قابل پیرامیٹرز کے ساتھ، دیگر میٹا ڈیٹا اور حسب ضرورت کنفیگریشنز کے ساتھ نقشہ بناتی ہے۔ ذیل کا کوڈ دکھاتا ہے کہ کس طرح Whisper PyTorch نمونے کو محفوظ کیا جائے۔

- DLC منتخب کریں۔

اگلا مرحلہ اس میں سے پہلے سے تیار کردہ DLC کو منتخب کرنا ہے۔ لنک. درج ذیل ترتیبات پر غور کرتے ہوئے درست تصویر کا انتخاب کرتے وقت محتاط رہیں: فریم ورک (PyTorch)، فریم ورک ورژن، ٹاسک (تخلیق)، Python ورژن، اور ہارڈ ویئر (یعنی GPU)۔ جب بھی ممکن ہو فریم ورک اور ازگر کے لیے تازہ ترین ورژن استعمال کرنے کی سفارش کی جاتی ہے، کیونکہ اس کے نتیجے میں بہتر کارکردگی ہوتی ہے اور پچھلی ریلیز سے معلوم مسائل اور کیڑے دور ہوتے ہیں۔

- ایمیزون سیج میکر ماڈل بنائیں

اگلا، ہم استعمال کرتے ہیں SageMaker Python SDK PyTorch ماڈل بنانے کے لیے۔ PyTorch ماڈل بناتے وقت ماحولیاتی متغیرات کو شامل کرنا یاد رکھنا ضروری ہے۔ پہلے سے طے شدہ طور پر، TorchServe صرف 6MB تک فائل کے سائز پر کارروائی کر سکتا ہے، قطع نظر اس کے کہ استعمال شدہ تخمینہ کی قسم۔

مندرجہ ذیل جدول PyTorch کے مختلف ورژنز کی ترتیبات کو ظاہر کرتا ہے۔

| فریم ورک | ماحولیاتی تغیرات |

| PyTorch 1.8 (TorchServe پر مبنی) | 'TS_MAX_REQUEST_SIZE': '100000000'' TS_MAX_RESPONSE_SIZE': '100000000'' TS_DEFAULT_RESPONSE_TIMEOUT': '1000' |

| PyTorch 1.4 (MMS پر مبنی) | 'MMS_MAX_REQUEST_SIZE': '1000000000'' MMS_MAX_RESPONSE_SIZE': '1000000000'' MMS_DEFAULT_RESPONSE_TIMEOUT': '900' |

- inference.py میں ماڈل لوڈنگ کے طریقہ کی وضاحت کریں۔

رواج میں inference.py اسکرپٹ، ہم سب سے پہلے CUDA کے قابل GPU کی دستیابی کی جانچ کرتے ہیں۔ اگر ایسا GPU دستیاب ہے، تو ہم تفویض کرتے ہیں۔ 'cuda' کو آلہ DEVICE متغیر دوسری صورت میں، ہم تفویض کرتے ہیں 'cpu' آلہ یہ قدم اس بات کو یقینی بناتا ہے کہ ماڈل کو موثر حساب کے لیے دستیاب ہارڈ ویئر پر رکھا گیا ہے۔ ہم Whisper Python پیکیج کا استعمال کرتے ہوئے PyTorch ماڈل لوڈ کرتے ہیں۔

گلے لگانا چہرے کا فریم ورک

- ماڈل نمونے کو محفوظ کریں۔

دوسرا آپشن استعمال کرنا ہے۔ گلے ملتے ہوئے چہرے کی سرگوشی نفاذ ماڈل کا استعمال کرتے ہوئے لوڈ کیا جا سکتا ہے AutoModelForSpeechSeq2Seq ٹرانسفارمر کلاس. سیکھنے کے قابل پیرامیٹرز کو استعمال کرتے ہوئے بائنری (بن) فائل میں محفوظ کیا جاتا ہے۔ save_pretrained طریقہ ٹوکنائزر اور پری پروسیسر کو بھی الگ سے محفوظ کرنے کی ضرورت ہے تاکہ یہ یقینی بنایا جا سکے کہ Hugging Face ماڈل ٹھیک سے کام کرتا ہے۔ متبادل طور پر، آپ دو ماحولیاتی متغیرات کو ترتیب دے کر براہ راست Hugging Face Hub سے Amazon SageMaker پر ایک ماڈل تعینات کر سکتے ہیں: HF_MODEL_ID اور HF_TASK. مزید معلومات کے لیے اس سے رجوع کریں۔ ویب کے صفحے.

- DLC منتخب کریں۔

PyTorch فریم ورک کی طرح، آپ اسی سے پہلے سے بنے ہوئے Hugging Face DLC کا انتخاب کر سکتے ہیں۔ لنک. ایک ایسا DLC منتخب کرنا یقینی بنائیں جو جدید ترین Hugging Face ٹرانسفارمرز کو سپورٹ کرتا ہو اور اس میں GPU سپورٹ شامل ہو۔

- ایمیزون سیج میکر ماڈل بنائیں

اسی طرح، ہم استعمال کرتے ہیں SageMaker Python SDK گلے لگانے والے چہرے کے ماڈل بنانے کے لیے۔ Hugging Face Whisper ماڈل کی ایک ڈیفالٹ حد ہوتی ہے جہاں یہ صرف 30 سیکنڈ تک آڈیو سیگمنٹس پر کارروائی کر سکتا ہے۔ اس حد کو حل کرنے کے لیے، آپ شامل کر سکتے ہیں۔ chunk_length_s Hugging Face ماڈل بناتے وقت ماحولیاتی متغیر میں پیرامیٹر، اور بعد میں ماڈل لوڈ کرتے وقت اس پیرامیٹر کو کسٹم انفرنس اسکرپٹ میں منتقل کریں۔ آخر میں، ہگنگ فیس کنٹینر کے لیے پے لوڈ سائز اور رسپانس ٹائم آؤٹ کو بڑھانے کے لیے ماحولیاتی متغیرات سیٹ کریں۔

| فریم ورک | ماحولیاتی تغیرات |

|

HuggingFace Inference کنٹینر (MMS پر مبنی) |

'MMS_MAX_REQUEST_SIZE': '2000000000'' MMS_MAX_RESPONSE_SIZE': '2000000000'' MMS_DEFAULT_RESPONSE_TIMEOUT': '900' |

- inference.py میں ماڈل لوڈنگ کے طریقہ کی وضاحت کریں۔

Hugging Face ماڈل کے لیے حسب ضرورت انفرنس اسکرپٹ بناتے وقت، ہم ایک پائپ لائن کا استعمال کرتے ہیں، جس سے ہمیں chunk_length_s ایک پیرامیٹر کے طور پر. یہ پیرامیٹر ماڈل کو قیاس کے دوران لمبی آڈیو فائلوں کو مؤثر طریقے سے پروسیس کرنے کے قابل بناتا ہے۔

ایمیزون سیج میکر پر مختلف تخمینے کے اختیارات کی تلاش

PyTorch اور Hugging Face دونوں ماڈلز کے لیے قیاس کے اختیارات کو منتخب کرنے کے اقدامات یکساں ہیں، لہذا ہم ذیل میں ان میں فرق نہیں کریں گے۔ تاہم، یہ بات قابل غور ہے کہ، اس پوسٹ کو لکھنے کے وقت، سرور کے بغیر اندازہ SageMaker سے آپشن GPUs کو سپورٹ نہیں کرتا ہے، اور اس کے نتیجے میں، ہم اس آپشن کو استعمال کے اس کیس کے لیے خارج کر دیتے ہیں۔

ہم ماڈل کو ریئل ٹائم اینڈ پوائنٹ کے طور پر تعینات کر سکتے ہیں، ملی سیکنڈز میں جوابات فراہم کر سکتے ہیں۔ تاہم، یہ نوٹ کرنا ضروری ہے کہ یہ اختیار 6 MB سے کم ان پٹ پر کارروائی کرنے تک محدود ہے۔ ہم سیریلائزر کی تعریف ایک آڈیو سیریلائزر کے طور پر کرتے ہیں، جو ان پٹ ڈیٹا کو تعینات ماڈل کے لیے موزوں فارمیٹ میں تبدیل کرنے کا ذمہ دار ہے۔ ہم آڈیو فائلوں کی تیز رفتار پروسیسنگ کی اجازت دیتے ہوئے اندازہ لگانے کے لیے ایک GPU مثال استعمال کرتے ہیں۔ انفرنس ان پٹ ایک آڈیو فائل ہے جو مقامی ریپوزٹری سے ہے۔

دوسرا انفرنس آپشن بیچ ٹرانسفارم جاب ہے، جو 100 MB تک ان پٹ پے لوڈ پر کارروائی کرنے کی صلاحیت رکھتا ہے۔ تاہم، اس طریقہ کار میں چند منٹ کی تاخیر لگ سکتی ہے۔ ہر مثال ایک وقت میں صرف ایک بیچ کی درخواست کو ہینڈل کر سکتی ہے، اور مثال کے آغاز اور شٹ ڈاؤن میں بھی چند منٹ درکار ہوتے ہیں۔ تخمینہ کے نتائج ایک Amazon Simple Storage Service میں محفوظ کیے جاتے ہیں (ایمیزون S3) بیچ ٹرانسفارم کام کی تکمیل پر بالٹی۔

بیچ ٹرانسفارمر کی تشکیل کرتے وقت، شامل کرنے کا یقین رکھیں max_payload = 100 بڑے پے لوڈز کو مؤثر طریقے سے ہینڈل کرنے کے لیے۔ انفرنس ان پٹ آڈیو فائل کا Amazon S3 راستہ ہونا چاہیے یا Amazon S3 بالٹی فولڈر جس میں آڈیو فائلوں کی فہرست ہو، ہر ایک کا سائز 100 MB سے چھوٹا ہو۔

بیچ ٹرانسفارم ان پٹ میں Amazon S3 آبجیکٹ کو کلید کے ذریعے تقسیم کرتا ہے اور Amazon S3 اشیاء کو مثالوں میں نقشہ بناتا ہے۔ مثال کے طور پر، جب آپ کے پاس متعدد آڈیو فائلیں ہیں، تو ایک مثال input1.wav پر کارروائی کر سکتی ہے، اور دوسری مثال input2.wav نامی فائل پر کارروائی کر سکتی ہے تاکہ اسکیل ایبلٹی کو بہتر بنایا جا سکے۔ بیچ ٹرانسفارم آپ کو کنفیگر کرنے کی اجازت دیتا ہے۔ max_concurrent_transforms ہر انفرادی ٹرانسفارمر کنٹینر پر کی جانے والی HTTP درخواستوں کی تعداد میں اضافہ کرنے کے لیے۔ تاہم، یہ نوٹ کرنا ضروری ہے کہ (کی قدرmax_concurrent_transforms* max_payload) 100 MB سے زیادہ نہیں ہونا چاہیے۔

آخر میں، Amazon SageMaker Asynchronous Inference متعدد درخواستوں پر بیک وقت کارروائی کرنے، اعتدال پسند تاخیر کی پیشکش اور 1 GB تک کے ان پٹ پے لوڈ کو سپورٹ کرنے کے لیے مثالی ہے۔ یہ اختیار بہترین اسکیل ایبلٹی فراہم کرتا ہے، اختتامی نقطہ کے لیے آٹو اسکیلنگ گروپ کی ترتیب کو فعال کرتا ہے۔ جب درخواستوں میں اضافہ ہوتا ہے، تو یہ ٹریفک کو سنبھالنے کے لیے خود بخود ترازو کرتا ہے، اور ایک بار جب تمام درخواستوں پر کارروائی ہو جاتی ہے، تو لاگت بچانے کے لیے اختتامی نقطہ 0 تک گھٹ جاتا ہے۔

غیر مطابقت پذیر تخمینہ کا استعمال کرتے ہوئے، نتائج خود بخود Amazon S3 بالٹی میں محفوظ ہو جاتے ہیں۔ میں AsyncInferenceConfig، آپ کامیاب یا ناکام تکمیل کے لیے اطلاعات کو ترتیب دے سکتے ہیں۔ ان پٹ پاتھ آڈیو فائل کے ایمیزون S3 مقام کی طرف اشارہ کرتا ہے۔ مزید تفصیلات کے لیے، براہ کرم آن کوڈ سے رجوع کریں۔ GitHub کے.

: اختیاری جیسا کہ پہلے ذکر کیا گیا ہے، ہمارے پاس غیر مطابقت پذیر انفرنس اینڈ پوائنٹ کے لیے آٹو اسکیلنگ گروپ کو ترتیب دینے کا اختیار ہے، جو اسے قیاس کی درخواستوں میں اچانک اضافے کو سنبھالنے کی اجازت دیتا ہے۔ اس میں کوڈ کی مثال دی گئی ہے۔ GitHub ذخیرہ. درج ذیل خاکہ میں، آپ ایک لائن چارٹ کا مشاہدہ کر سکتے ہیں جس میں سے دو میٹرکس دکھائے گئے ہیں۔ ایمیزون کلاؤڈ واچ: ApproximateBacklogSize اور ApproximateBacklogSizePerInstance. ابتدائی طور پر، جب 1000 درخواستوں کو متحرک کیا گیا تھا، صرف ایک مثال ہینڈل کرنے کے لیے دستیاب تھی۔ تین منٹ تک، بیک لاگ کا سائز مسلسل تین سے تجاوز کر گیا (براہ کرم نوٹ کریں کہ ان نمبروں کو کنفیگر کیا جا سکتا ہے)، اور آٹو سکیلنگ گروپ نے بیک لاگ کو مؤثر طریقے سے صاف کرنے کے لیے اضافی مثالیں گھما کر جواب دیا۔ اس کے نتیجے میں اس میں نمایاں کمی واقع ہوئی۔ ApproximateBacklogSizePerInstance, بیک لاگ درخواستوں پر ابتدائی مرحلے کے مقابلے میں بہت تیزی سے کارروائی کرنے کی اجازت دیتا ہے۔

تصویر 2. لائن چارٹ ایمیزون کلاؤڈ واچ میٹرکس میں وقتی تبدیلیوں کو ظاہر کرتا ہے

تخمینہ کے اختیارات کے لیے تقابلی تجزیہ

مختلف قیاس کے اختیارات کا موازنہ آڈیو پروسیسنگ کے عام استعمال کے معاملات پر مبنی ہے۔ ریئل ٹائم انفرنس تیز ترین انفرنس سپیڈ پیش کرتا ہے لیکن پے لوڈ سائز کو 6 MB تک محدود کرتا ہے۔ یہ انفرنس قسم آڈیو کمانڈ سسٹم کے لیے موزوں ہے، جہاں صارف صوتی کمانڈز یا بولی جانے والی ہدایات کا استعمال کرتے ہوئے آلات یا سافٹ ویئر کو کنٹرول کرتے ہیں یا ان کے ساتھ تعامل کرتے ہیں۔ صوتی کمانڈز عام طور پر سائز میں چھوٹے ہوتے ہیں، اور اس بات کو یقینی بنانے کے لیے کہ نقل کردہ کمانڈز فوری طور پر بعد میں ہونے والی کارروائیوں کو متحرک کر سکتے ہیں۔ جب ہر آڈیو فائل کا سائز 100 MB سے کم ہوتا ہے تو بیچ ٹرانسفارم طے شدہ آف لائن کاموں کے لیے مثالی ہے، اور تیز رفتار قیاس کے جوابی اوقات کے لیے کوئی خاص ضرورت نہیں ہے۔ غیر مطابقت پذیر تخمینہ 1 GB تک کے اپ لوڈز کی اجازت دیتا ہے اور اعتدال پسند قیاس میں تاخیر پیش کرتا ہے۔ یہ تخمینہ قسم موویز، ٹی وی سیریز، اور ریکارڈ شدہ کانفرنسوں کو نقل کرنے کے لیے اچھی طرح سے موزوں ہے جہاں بڑی آڈیو فائلوں پر کارروائی کی ضرورت ہوتی ہے۔

ریئل ٹائم اور غیر مطابقت پذیر انفرنس دونوں آپشنز آٹو اسکیلنگ کی صلاحیتیں فراہم کرتے ہیں، جس سے اینڈ پوائنٹ کی مثالیں درخواستوں کے حجم کی بنیاد پر خود بخود اوپر یا نیچے کی جاسکتی ہیں۔ ایسی صورتوں میں جن کی کوئی درخواست نہیں ہے، آٹو اسکیلنگ غیر ضروری مثالوں کو ہٹا دیتی ہے، جس سے آپ کو فراہم کردہ مثالوں سے وابستہ اخراجات سے بچنے میں مدد ملتی ہے جو فعال طور پر استعمال میں نہیں ہیں۔ تاہم، ریئل ٹائم انفرنس کے لیے، کم از کم ایک مستقل مثال کو برقرار رکھا جانا چاہیے، جس کی وجہ سے زیادہ لاگت آسکتی ہے اگر اختتامی نقطہ مسلسل کام کرتا ہے۔ اس کے برعکس، غیر مطابقت پذیر تخمینہ استعمال میں نہ ہونے پر مثال کے حجم کو 0 تک کم کرنے کی اجازت دیتا ہے۔ بیچ ٹرانسفارم جاب کو کنفیگر کرتے وقت، کام پر کارروائی کرنے کے لیے متعدد مثالوں کا استعمال کرنا اور max_concurrent_transforms کو ایڈجسٹ کرنا ممکن ہے تاکہ ایک مثال کو متعدد درخواستوں کو ہینڈل کرنے کے قابل بنایا جا سکے۔ لہذا، تینوں قیاس کے اختیارات زبردست اسکیل ایبلٹی پیش کرتے ہیں۔

صفائی ستھرائی

ایک بار جب آپ حل کا استعمال مکمل کر لیں، اضافی اخراجات کو روکنے کے لیے SageMaker کے اختتامی نقطوں کو ہٹانا یقینی بنائیں۔ آپ فراہم کردہ کوڈ کو بالترتیب ریئل ٹائم اور غیر مطابقت پذیر انفرنس اینڈ پوائنٹس کو حذف کرنے کے لیے استعمال کر سکتے ہیں۔

نتیجہ

اس پوسٹ میں، ہم نے آپ کو دکھایا کہ کس طرح مختلف صنعتوں میں آڈیو پروسیسنگ کے لیے مشین لرننگ ماڈلز کی تعیناتی تیزی سے ضروری ہو گئی ہے۔ Whisper ماڈل کو ایک مثال کے طور پر لیتے ہوئے، ہم نے دکھایا کہ PyTorch یا Hugging Face اپروچز کا استعمال کرتے ہوئے Amazon SageMaker پر اوپن سورس ASR ماڈلز کی میزبانی کیسے کی جائے۔ ایکسپلوریشن میں ایمیزون سیج میکر پر مختلف تخمینے کے اختیارات شامل ہیں، جو آڈیو ڈیٹا کو مؤثر طریقے سے ہینڈل کرنے، پیشین گوئیاں کرنے، اور لاگت کا مؤثر طریقے سے انتظام کرنے کے بارے میں بصیرت پیش کرتے ہیں۔ اس پوسٹ کا مقصد محققین، ڈویلپرز، اور ڈیٹا سائنسدانوں کے لیے علم فراہم کرنا ہے جو آڈیو سے متعلق کاموں کے لیے وسپر ماڈل کا فائدہ اٹھانے اور تخمینہ کی حکمت عملیوں کے بارے میں باخبر فیصلے کرنے میں دلچسپی رکھتے ہیں۔

SageMaker پر ماڈلز کی تعیناتی کے بارے میں مزید تفصیلی معلومات کے لیے، براہ کرم اس سے رجوع کریں۔ ڈویلپر گائیڈ. مزید برآں، Whisper ماڈل کو SageMaker JumpStart کا استعمال کرتے ہوئے تعینات کیا جا سکتا ہے۔ مزید تفصیلات کے لیے، برائے مہربانی چیک کریں۔ ایمیزون سیج میکر جمپ سٹارٹ میں خودکار تقریر کی شناخت کے لیے سرگوشی کے ماڈل اب دستیاب ہیں۔ پوسٹ

بلا جھجھک اس پروجیکٹ کے لیے نوٹ بک اور کوڈ چیک کریں۔ GitHub کے اور اپنا تبصرہ ہمارے ساتھ شیئر کریں۔

مصنف کے بارے میں

ینگ ہو، پی ایچ ڈی، AWS میں مشین لرننگ پروٹو ٹائپنگ آرکیٹیکٹ ہے۔ اس کی دلچسپی کے بنیادی شعبے ڈیپ لرننگ پر محیط ہیں، جن میں GenAI، کمپیوٹر ویژن، NLP، اور ٹائم سیریز ڈیٹا کی پیشن گوئی پر توجہ دی گئی ہے۔ اپنے فارغ وقت میں، وہ اپنے خاندان کے ساتھ معیاری لمحات گزارنے، خود کو ناولوں میں غرق کرنے، اور برطانیہ کے قومی پارکوں میں پیدل سفر کرنے کا مزہ لیتی ہے۔

ینگ ہو، پی ایچ ڈی، AWS میں مشین لرننگ پروٹو ٹائپنگ آرکیٹیکٹ ہے۔ اس کی دلچسپی کے بنیادی شعبے ڈیپ لرننگ پر محیط ہیں، جن میں GenAI، کمپیوٹر ویژن، NLP، اور ٹائم سیریز ڈیٹا کی پیشن گوئی پر توجہ دی گئی ہے۔ اپنے فارغ وقت میں، وہ اپنے خاندان کے ساتھ معیاری لمحات گزارنے، خود کو ناولوں میں غرق کرنے، اور برطانیہ کے قومی پارکوں میں پیدل سفر کرنے کا مزہ لیتی ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/host-the-whisper-model-on-amazon-sagemaker-exploring-inference-options/

- : ہے

- : ہے

- : نہیں

- :کہاں

- $UP

- 1

- 10

- 100

- 12

- 14

- 16

- 19

- 30

- 32

- 8

- a

- تیز

- تک رسائی حاصل

- رسائی پذیری

- اکاؤنٹ

- درستگی

- کے پار

- اعمال

- فعال طور پر

- شامل کریں

- ایڈیشنل

- اس کے علاوہ

- پتہ

- ایڈجسٹ

- اعلی درجے کی

- AI

- مقصد ہے

- تمام

- اجازت دے رہا ہے

- کی اجازت دیتا ہے

- ساتھ

- بھی

- ایمیزون

- ایمیزون سیج میکر

- ایمیزون ویب سروسز

- an

- تجزیہ

- اور

- ایک اور

- کوئی بھی

- ایپلی کیشنز

- نقطہ نظر

- کیا

- علاقوں

- لڑی

- مصنوعی

- مصنوعی ذہانت

- AS

- اثاثے

- اسسٹنٹ

- منسلک

- At

- آڈیو

- تصنیف

- خودکار

- خود کار طریقے سے

- دستیابی

- دستیاب

- سے اجتناب

- AWS

- بیس

- کی بنیاد پر

- BE

- بن

- نیچے

- بہتر

- کے درمیان

- باضابطہ

- بن

- دونوں

- کیڑوں

- لیکن

- by

- کر سکتے ہیں

- صلاحیتوں

- صلاحیت رکھتا

- ہوشیار

- مقدمات

- تبدیلیاں

- چارٹ

- چیک کریں

- میں سے انتخاب کریں

- منتخب کریں

- طبقے

- واضح

- کوڈ

- کس طرح

- تبصرہ

- کامن

- موازنہ

- موازنہ

- مکمل

- تکمیل

- اجزاء

- وسیع

- حساب

- کمپیوٹر

- کمپیوٹر ویژن

- سلوک

- کانفرنسوں

- ترتیب

- تشکیل شدہ

- ترتیب دیں

- پر غور

- مسلسل

- پر مشتمل ہے

- کنٹینر

- کنٹینر

- مسلسل

- اس کے برعکس

- کنٹرول

- تبدیل کرنا

- درست

- اسی کے مطابق

- قیمت

- اخراجات

- سکتا ہے

- CPU

- تخلیق

- تخلیق

- اہم

- اپنی مرضی کے

- اعداد و شمار

- فیصلے

- کمی

- گہری

- گہری سیکھنے

- پہلے سے طے شدہ

- وضاحت

- demonstrated,en

- تعیناتی

- تعینات

- تعینات

- تعیناتی

- تفصیل

- تفصیلی

- تفصیلات

- ترقی

- ڈویلپرز

- ترقی

- آلہ

- کے الات

- مختلف

- فرق کرنا

- طول و عرض

- براہ راست

- دکھانا

- ڈوبکی

- متنوع

- میں Docker

- نہیں کرتا

- کر

- نیچے

- کے دوران

- e

- ہر ایک

- اس سے قبل

- ماحول

- مؤثر طریقے

- ہنر

- مؤثر طریقے سے

- بے سہل

- یا تو

- اور

- سوار ہونا

- بااختیار بنانا

- کو چالو کرنے کے

- کے قابل بناتا ہے

- کو فعال کرنا

- احاطہ

- اختتام پوائنٹ

- اختتام

- بڑھانے کے

- بڑھانے

- کو یقینی بنانے کے

- یقینی بناتا ہے

- پوری

- ماحولیات

- ضروری

- قیام

- Ether (ETH)

- امتحان

- مثال کے طور پر

- حد سے تجاوز

- حد سے تجاوز کر

- بہترین

- تجربہ

- وضاحت

- کی تلاش

- ایکسپلور

- چہرہ

- ناکام

- جھوٹی

- خاندان

- فاسٹ

- تیز تر

- سب سے تیزی سے

- چند

- فائل

- فائلوں

- پتہ ہے

- پہلا

- توجہ مرکوز

- توجہ مرکوز

- کے بعد

- کے لئے

- فارمیٹ

- فریم ورک

- فریم ورک

- مفت

- سے

- مکمل

- GPU

- GPUs

- عظیم

- گروپ

- ہینڈل

- ہینڈلنگ

- ہارڈ ویئر

- ہے

- سماعت

- مدد

- اس کی

- ہائی

- اعلی

- لمبی پیدل سفر

- میزبان

- ہوسٹنگ

- کس طرح

- کیسے

- تاہم

- HTML

- HTTP

- HTTPS

- حب

- گلے لگانے والا چہرہ

- i

- مثالی

- if

- نمائش

- تصویر

- تصاویر

- نفاذ

- عمل درآمد

- درآمد

- اہم

- in

- میں گہرائی

- شامل

- شامل ہیں

- سمیت

- شامل

- اضافہ

- دن بدن

- انفرادی

- افراد

- صنعتوں

- معلومات

- مطلع

- ابتدائی

- ابتدائی طور پر

- شروع

- ان پٹ

- آدانوں

- بصیرت

- انسٹال

- مثال کے طور پر

- واقعات

- ہدایات

- انضمام کرنا

- انٹیلی جنس

- بات چیت

- دلچسپی

- دلچسپی

- انٹرفیس

- میں

- مسائل

- IT

- میں

- ایوب

- نوکریاں

- فوٹو

- کلیدی

- علم

- جانا جاتا ہے

- زمین کی تزئین کی

- بڑے

- آخر میں

- تاخیر

- بعد

- تازہ ترین

- پرت

- قیادت

- سیکھنے

- کم سے کم

- لیورنگنگ

- لائسنس

- حد کے

- لمیٹڈ

- لائن

- لسٹ

- لوڈ

- لوڈ کر رہا ہے

- مقامی

- محل وقوع

- لانگ

- اب

- لو

- مشین

- مشین لرننگ

- بنا

- مین

- بنا

- بناتا ہے

- بنانا

- انتظام

- مینیجنگ

- نقشہ جات

- مئی..

- ذکر کیا

- میٹا ڈیٹا

- طریقہ

- طریقوں

- پیمائش کا معیار

- شاید

- ملیسیکنڈ

- منٹ

- ایم ائی ٹی

- ML

- ماڈل

- ماڈل

- اعتدال پسند

- لمحات

- نگرانی

- زیادہ

- فلم

- بہت

- ایک سے زیادہ

- ضروری

- نامزد

- قومی

- قومی پارک

- ضروری

- ضرورت ہے

- ضرورت

- نیٹ ورک

- عصبی

- عصبی نیٹ ورک

- اگلے

- ویزا

- نہیں

- براہ مہربانی نوٹ کریں

- نوٹ بک

- نوٹس

- نوٹیفیکیشن

- اطلاعات

- اشارہ

- اب

- تعداد

- تعداد

- اعتراض

- اشیاء

- مشاہدہ

- of

- پیش کرتے ہیں

- کی پیشکش

- تجویز

- سرکاری

- آف لائن

- on

- ایک بار

- ایک

- صرف

- اوپن سورس

- چل رہا ہے

- اختیار

- آپشنز کے بھی

- or

- حکم

- تنظیمیں

- OS

- دیگر

- دوسری صورت میں

- باہر

- مجموعی جائزہ

- پیکج

- پیکجوں کے

- پیرامیٹر

- پیرامیٹرز

- پارکوں

- منظور

- راستہ

- انجام دینے کے

- کارکردگی

- مرحلہ

- پائپ لائن

- اہم

- رکھ دیا

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- مہربانی کرکے

- پوائنٹس

- ممکن

- پوسٹ

- ممکنہ

- کی پیشن گوئی

- پیشن گوئی

- کی روک تھام

- پچھلا

- پرائمری

- عمل

- عملدرآمد

- پروسیسنگ

- پروسیسر

- منصوبے

- مناسب طریقے سے

- prototyping کے

- فراہم

- فراہم

- فراہم کرتا ہے

- فراہم کرنے

- ازگر

- pytorch

- معیار

- رینج

- اصل وقت

- دائرے میں

- تسلیم

- سفارش کی

- درج

- کم

- کا حوالہ دیتے ہیں

- بے شک

- متعلقہ

- ریلیز

- یاد

- ہٹا

- ہٹاتا ہے

- ذخیرہ

- درخواست

- درخواستوں

- کی ضرورت

- ضرورت

- ضرورت

- محققین

- بالترتیب

- جواب

- جوابات

- ذمہ دار

- نتیجہ

- نتیجے

- نتائج کی نمائش

- برقرار رکھا

- دوبارہ پڑھنا

- واپسی

- sagemaker

- اسی

- محفوظ کریں

- محفوظ

- بچت

- اسکیل ایبلٹی

- پیمانے

- ترازو

- شیڈول کے مطابق

- سائنسدانوں

- اسکرپٹ

- سکرپٹ

- دوسری

- سیکنڈ

- سیکشن

- حصوں

- منتخب

- منتخب

- منتخب

- سیریز

- سروس

- سروسز

- مقرر

- قائم کرنے

- ترتیبات

- سیکنڈ اور

- وہ

- ہونا چاہئے

- سے ظاہر ہوا

- شوز

- شٹ ڈاؤن

- اہم

- سادہ

- آسان بناتا ہے۔

- سائز

- سائز

- چھوٹے

- چھوٹے

- So

- سافٹ ویئر کی

- حل

- مخصوص

- خاص طور پر

- مخصوص

- تقریر

- تقریر کی شناخت

- تیزی

- خرچ کرنا۔

- بات

- شروع کریں

- حالت

- ریاستی آرٹ

- مرحلہ

- مراحل

- ذخیرہ

- حکمت عملیوں

- بعد میں

- کامیاب

- اس طرح

- اچانک

- موزوں

- حمایت

- امدادی

- کی حمایت کرتا ہے

- اس بات کا یقین

- اضافے

- سسٹمز

- ٹیبل

- لے لو

- لینے

- ٹاسک

- کاموں

- ٹیکنالوجی

- سے

- کہ

- ۔

- برطانیہ

- ان

- ان

- تو

- وہاں.

- لہذا

- یہ

- وہ

- اس

- تین

- وقت

- وقت کا سلسلہ

- اوقات

- کرنے کے لئے

- اوزار

- مشعل

- ٹریفک

- ٹرین

- تربیت یافتہ

- تبدیل

- ٹرانسفارمر

- ٹرانسفارمرز

- ٹرگر

- متحرک

- tv

- ٹی وی سیریز

- دو

- قسم

- عام طور پر

- Uk

- کے تحت

- غیر مقفل

- صلی اللہ علیہ وسلم

- us

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- صارف دوست

- صارفین

- کا استعمال کرتے ہوئے

- کی افادیت

- استعمال

- استعمال کرنا۔

- قیمتی

- قیمت

- متغیر

- مختلف

- وسیع

- ورژن

- نقطہ نظر

- وائس

- آواز کا حکم دیتا ہے

- حجم

- انتظار

- چاہتے ہیں

- تھا

- we

- ویب

- ویب خدمات

- اچھا ہے

- تھے

- جب

- جب بھی

- جس

- کسبی

- وسیع

- وسیع رینج

- ساتھ

- کے اندر

- کام کا بہاؤ

- کام کرتا ہے

- قابل

- تحریری طور پر

- آپ

- اور

- زیفیرنیٹ