Meta випустила ще одну модель відкритого машинного навчання, цього разу налаштовану на генерування вихідного коду програмного забезпечення.

Код Лама це сімейство великих мовних моделей – звідси випадкове використання великої літери «LLaMA» – на основі моделі Llama 2 випущений в липні. Він був точно налаштований і навчений розподіляти та обговорювати вихідний код у відповідь на текстові підказки, замість прози, як його прабатько.

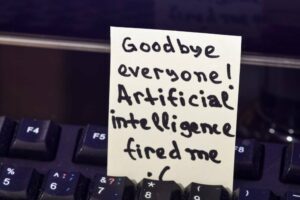

Як і з усіма передовими технологіями, Code Llama має ризики

«Code Llama має потенціал для використання як продуктивного та освітнього інструменту, щоб допомогти програмістам писати більш надійне, добре задокументоване програмне забезпечення», — заявив Мета в оголошення Четвер

Якщо ви попросите Code Llama написати функцію, яка створює послідовність Фібоначчі, модель створить і код, і природну мову, що пояснює джерело, каже Мета. І модель AI може робити це в Python, C++, Java, PHP, Typescript (Javascript), C#, Bash та інших мовах.

Однак користувачів просять звернутись до Code Llama англійською мовою, оскільки модель не перевірялася на безпеку іншими мовами та може просто сказати щось жахливе, якщо її запитати в виходить за рамки мова.

«Як і з усіма передовими технологіями, Code Llama пов’язана з ризиками», — пояснює Мета, зазначаючи, що під час власного тестування червоною командою на створення шкідливого коду Code Llama відповіла безпечнішими відповідями, ніж ChatGPT (GPT3.5 Turbo).

За даними Meta, Code Llama перевершує LLM з відкритим вихідним кодом і свій власний батьківський Llama 2 за двома тестами: HumanEval і переважно базове програмування на Python (MBPP) – і відповідає продуктивності ChatGPT OpenAI.

Code Llama доступний у трьох розмірах – параметри 7B, 13B і 34B – і кожен варіант був навчений за допомогою 500B токенів коду та пов’язаних із кодом даних. Один токен — це приблизно чотири символи англійською мовою. Найбільша версія Codex OpenAI, коли вона була випущена, мала 12B параметри.

Мета каже, що дві найменші моделі Code Llama були навчені заповнювати відсутні джерела, що дозволяє використовувати їх для завершення коду без подальшого тонкого налаштування. Кажуть, що версія 34B забезпечує найкращі результати, але дві менші реагують швидше, що робить їх кращими для таких завдань, як завершення коду, де помітна затримка.

Є також два варіанти: Code Llama – Python і Code Llama – Instruct. Перше походить від тонкого налаштування Code Llama з додатковими 100 Б маркерами коду Python. Останній був точно налаштований для дотримання шаблонів введення та виведення, що робить його кращим для генерації коду.

Надійність, хтось?

LLM часто надають неправильний Відповіді до підказок програмування, хоча вони все ж використовуються багатьма розробниками для повторення шаблонів запам’ятовування та параметрів API або уникнення пошукових запитів і перевірок документації.

Одним із переваг Code Llama є те, що він може обробляти введення та виведення кодових послідовностей, які складаються з до 100,000 XNUMX токенів. Тобто ви можете підказати модель багатьма рядками коду, і ви можете отримати докладну відповідь.

«Крім того, що це обов’язкова умова для створення довших програм, наявність довших послідовностей введення відкриває нові захоплюючі сценарії використання коду LLM», — пояснив Мета. «Наприклад, користувачі можуть надати моделі більше контексту зі своєї кодової бази, щоб зробити покоління більш відповідними. Це також допомагає у сценаріях налагодження у великих кодових базах, де для розробників може бути складно залишатися в курсі всього коду, пов’язаного з конкретною проблемою».

Користувачі можуть надати моделі більше контексту зі своєї кодової бази, щоб зробити покоління більш відповідними

Code Llama приєднується до зростаючого поля моделей, що розуміють код, спочатку створених Codex OpenAI та асоційованим GitHub судово-обтяжений Служба підказок щодо програмування Copilot (2021). Позитивні моделі програмування, які згодом з'явилися, включають DeepMind Альфа-код (2022), GPT-4 OpenAI (2023), Amazon Шептун коду (2023) і Google Bard (2023), налаштований у квітні генерувати вихідний код.

Крім того, існували різні програми LLM з відкритим кодом (або на кшталт відкритих). StarCoder та XGen, щоб назвати два.

Meta випустила Code Llama під тим же ліцензія спільноти як Llama 2, посилаючись на переконання мегакорпорації у «відкритому підході до штучного інтелекту» як найкращому способі розробки інструментів, які є інноваційними, безпечними та відповідальними.

Але, як було широко відмічено з Llama 2, ліцензія спільноти є не є ліцензією з відкритим кодом. «Відкритий підхід» Meta до штучного інтелекту закритий для конкуренції – ліцензія явно забороняє використовувати програмне забезпечення «для покращення будь-якої іншої великої мовної моделі».

І хоча ліцензія спільноти Meta дозволяє комерційне використання різноманітних лам, вона обмежує сервіси з «понад 700 мільйонами активних користувачів щомісяця».

Це швидше виберіть групу мега-сервісів – YouTube, WeChat, TikTok, LinkedIn, Telegram, Snapchat і Douyin, серед платформ соціальних медіа, які ще не керуються Meta, і, ймовірно, компанії, які використовують платформи на основі операційної системи, такі як Apple, Google і Microsoft – «повинні запитувати ліцензія від Meta, яку Meta може надати вам на власний розсуд…” ®

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. Автомобільні / електромобілі, вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- ChartPrime. Розвивайте свою торгову гру за допомогою ChartPrime. Доступ тут.

- BlockOffsets. Модернізація екологічної компенсаційної власності. Доступ тут.

- джерело: https://go.theregister.com/feed/www.theregister.com/2023/08/25/meta_lets_code_llama_run/

- : має

- :є

- : ні

- :де

- $UP

- 000

- 100

- 2021

- 2022

- 2023

- 700

- a

- активний

- доповнення

- адреса

- дотримуватися

- AI

- ВСІ

- дозволяє

- вже

- Також

- Amazon

- серед

- an

- та

- Інший

- Відповіді

- будь-який

- будь

- API

- Apple

- підхід

- квітня

- ЕСТЬ

- AS

- асоційований

- At

- уникає

- заснований

- бити

- основний

- BE

- було

- буття

- віра

- тести

- КРАЩЕ

- Краще

- обидва

- але

- by

- C + +

- CAN

- Капіталізація

- випадків

- складні

- символи

- ChatGPT

- Перевірки

- стверджував,

- закрито

- CO

- код

- Кодова база

- приходить

- комерційний

- співтовариство

- Компанії

- конкурс

- завершення

- контекст

- створення

- різання

- дані

- Deepmind

- розвивати

- розробників

- DID

- обговорювати

- do

- документація

- Дуїна

- малює

- під час

- кожен

- край

- освітній

- англійська

- Ефір (ETH)

- приклад

- захоплюючий

- пояснені

- пояснюючи

- Пояснює

- додатково

- сім'я

- швидше

- FB

- Fibonacci

- поле

- заповнювати

- кінець

- потім

- для

- Колишній

- чотири

- від

- функція

- далі

- породжувати

- породжує

- покоління

- покоління

- отримати

- GitHub

- надавати

- великий

- Зростання

- було

- обробляти

- Мати

- має

- допомога

- допомагає

- отже

- Однак

- HTTPS

- if

- удосконалювати

- in

- В інших

- включати

- спочатку

- інноваційний

- вхід

- замість

- питання

- IT

- ЙОГО

- Java

- JavaScript

- з'єднання

- JPG

- липень

- просто

- мова

- мови

- великий

- більше

- найбільших

- Затримка

- вивчення

- дозволяє

- ліцензія

- як

- Лінія

- ліній

- Лама

- довше

- машина

- навчання за допомогою машини

- зробити

- Робить

- багато

- Може..

- Медіа

- Meta

- Microsoft

- може бути

- мільйона

- відсутній

- модель

- Моделі

- щомісячно

- більше

- в основному

- повинен

- ім'я

- Природний

- Природна мова

- Нові

- зазначив,

- відзначивши,

- іноді

- of

- часто

- on

- ONE

- відкрити

- з відкритим вихідним кодом

- OpenAI

- операційний

- or

- Інше

- Переважає

- вихід

- власний

- параметри

- моделі

- продуктивність

- PHP

- Платформи

- plato

- Інформація про дані Платона

- PlatoData

- точок

- потенціал

- випускає

- продуктивність

- прародитель

- Програмісти

- Програмування

- програми

- забезпечувати

- put

- Python

- запити

- швидше

- RE

- червоний

- пов'язаний

- випущений

- доречний

- запросити

- Реагувати

- відповідь

- відповідальний

- результати

- Бунт

- ризики

- міцний

- грубо

- прогін

- біг

- s

- сейф

- безпечніше

- Безпека

- Зазначений

- то ж

- say

- говорить

- сценарії

- Пошук

- Продаж

- Послідовність

- обслуговування

- Послуги

- розміри

- менше

- Snapchat

- So

- соціальна

- соціальні медіа

- соціальні медіа-платформи

- Софтвер

- що в сім'ї щось

- Source

- вихідні

- T

- завдання

- команда

- Технологія

- Telegram

- terms

- Тестування

- ніж

- Що

- Команда

- Джерело

- їх

- Їх

- Там.

- вони

- це

- хоча?

- три

- через

- четвер, четвер

- Tik Tok

- час

- до

- знак

- Жетони

- інструмент

- інструменти

- топ

- навчений

- два

- Машинопис

- при

- розблокує

- використання

- використовуваний

- користувачі

- використання

- варіант

- різний

- версія

- було

- шлях..

- коли

- який

- в той час як

- широко

- Вікіпедія

- волі

- з

- без

- запис

- ще

- ви

- YouTube

- зефірнет