Зображення від автора | Bing Image Creator

Доллі 2.0 це велика мовна модель (LLM) із відкритим вихідним кодом, що виконується інструкціями, яка була налаштована на створеному людиною наборі даних. Його можна використовувати як для дослідницьких, так і для комерційних цілей.

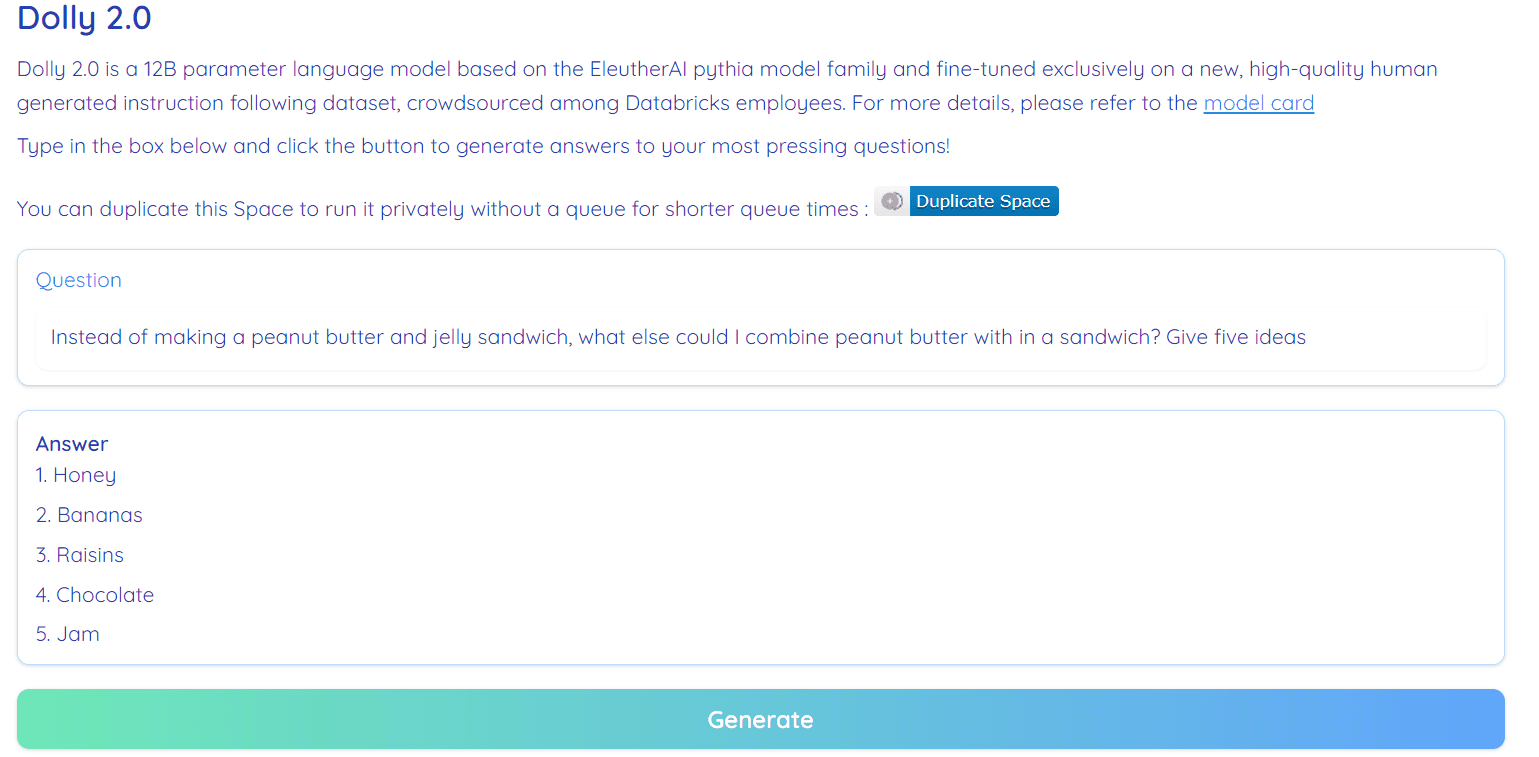

Зображення з Hugging Face Space від RamAnanth1

Раніше команда Databricks випустила Доллі 1.0, LLM, яка демонструє здатність дотримуватись інструкцій, схожу на ChatGPT, і коштує менше 30 доларів США за навчання. Він використовував набір даних групи Stanford Alpaca, який діяв під обмеженою ліцензією (тільки для дослідження).

Dolly 2.0 вирішила цю проблему шляхом точного налаштування моделі мови параметрів 12B (Піфія) на високоякісну інструкцію, створену людиною, у наступному наборі даних, яку позначив співробітник Datbricks. І модель, і набір даних доступні для комерційного використання.

Dolly 1.0 було навчено на наборі даних Stanford Alpaca, створеному за допомогою OpenAI API. Набір даних містить вихідні дані ChatGPT і не дозволяє будь-кому використовувати його для конкуренції з OpenAI. Коротше кажучи, ви не можете створити комерційний чат-бот або мовний додаток на основі цього набору даних.

Більшість останніх моделей, випущених за останні кілька тижнів, страждали від тих самих проблем, таких як моделі Альпака, коала, GPT4All та Вікуна. Для цього нам потрібно створити нові високоякісні набори даних, які можна використовувати для комерційного використання, і саме це команда Databricks зробила з набором даних databricks-dolly-15k.

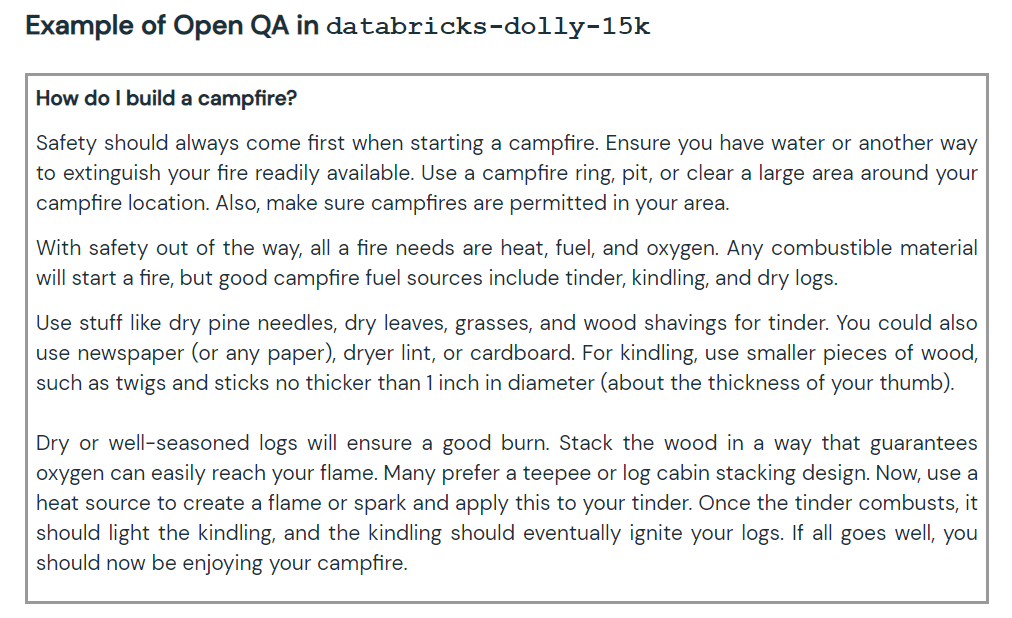

Новий набір даних містить 15,000 XNUMX високоякісних позначених людиною пар підказка/відповідь, які можна використовувати для розробки інструкцій, налаштовуючи великі мовні моделі. The databricks-dolly-15k набір даних поставляється з Неперенесена ліцензія Creative Commons Attribution-ShareAlike 3.0, що дозволяє будь-кому використовувати його, змінювати та створювати на ньому комерційну програму.

Як вони створили набір даних databricks-dolly-15k?

Дослідження OpenAI папір стверджує, що оригінальну модель InstructGPT було навчено на 13,000 13 запитах і відповідях. Використовуючи цю інформацію, команда Databricks почала над нею працювати, і виявилося, що створити 5,000 тисяч запитань і відповідей було складним завданням. Вони не можуть використовувати синтетичні дані або генеративні дані штучного інтелекту, і вони повинні генерувати оригінальні відповіді на кожне запитання. Саме тут вони вирішили залучити XNUMX співробітників Databricks для створення даних, створених людьми.

Databricks організували конкурс, у якому 20 найкращих етикеток отримають велику нагороду. У цьому конкурсі взяли участь 5,000 співробітників Databricks, які були дуже зацікавлені в LLM

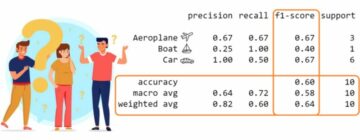

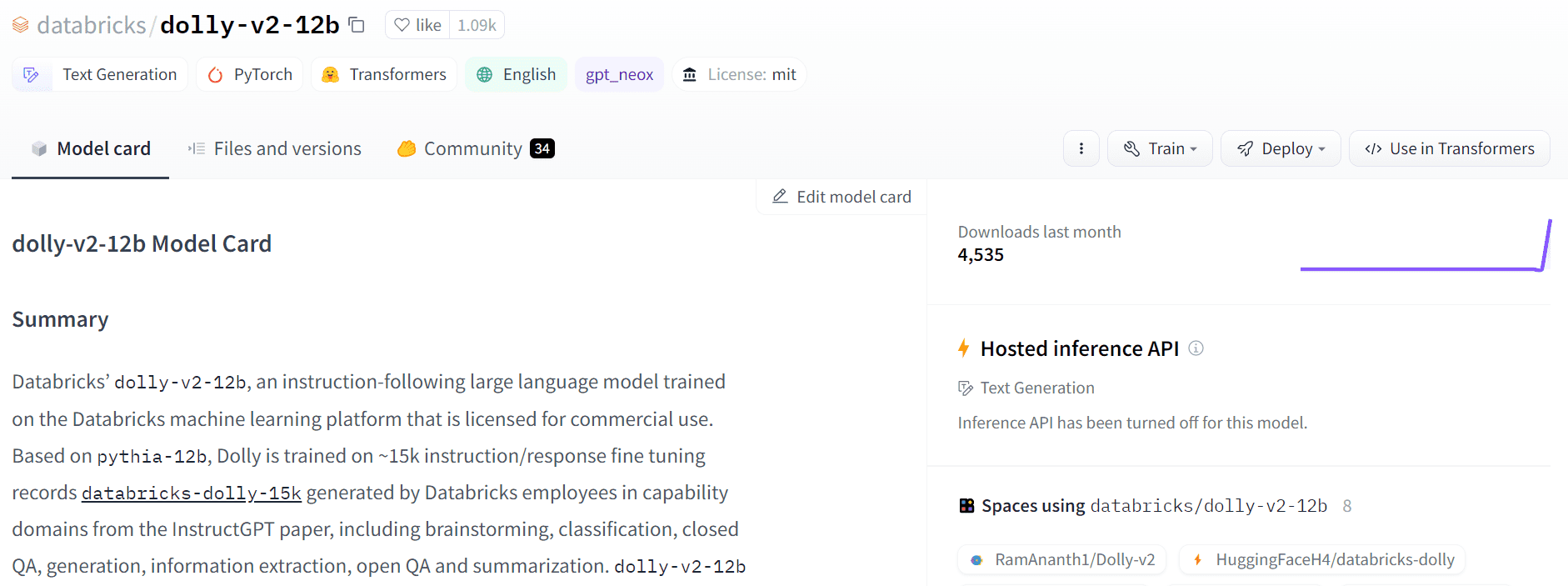

Dolly-v2-12b не є найсучаснішою моделлю. Він поступається dolly-v1-6b у деяких тестах оцінювання. Це може бути пов’язано зі складом і розміром базових наборів даних тонкого налаштування. Сімейство моделей Dolly знаходиться в стадії активної розробки, тому в майбутньому ви можете побачити оновлену версію з кращою продуктивністю.

Коротше кажучи, модель dolly-v2-12b працює краще, ніж EleutherAI/gpt-neox-20b і EleutherAI/pythia-6.9b.

Зображення з Вільна Доллі

Dolly 2.0 є 100% відкритим кодом. Він поставляється з навчальним кодом, набором даних, ваговими коефіцієнтами моделі та конвеєром висновків. Всі компоненти придатні для комерційного використання. Ви можете спробувати модель на Hugging Face Spaces Dolly V2 від RamAnanth1.

Зображення з Обіймати обличчя

Ресурс:

Демо Dolly 2.0: Dolly V2 від RamAnanth1

Абід Алі Аван (@1abidaliawan) є сертифікованим фахівцем із дослідження даних, який любить створювати моделі машинного навчання. Зараз він зосереджується на створенні контенту та написанні технічних блогів про технології машинного навчання та науки про дані. Абід має ступінь магістра з управління технологіями та ступінь бакалавра в галузі телекомунікаційної інженерії. Його бачення полягає в тому, щоб створити продукт AI з використанням нейронної мережі графа для студентів, які борються з психічними захворюваннями.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- Платоблокчейн. Web3 Metaverse Intelligence. Розширені знання. Доступ тут.

- Карбування майбутнього з Адріенн Ешлі. Доступ тут.

- джерело: https://www.kdnuggets.com/2023/04/dolly-20-chatgpt-open-source-alternative-commercial.html?utm_source=rss&utm_medium=rss&utm_campaign=dolly-2-0-chatgpt-open-source-alternative-for-commercial-use

- : має

- :є

- : ні

- $UP

- 000

- 1

- 20

- a

- здатність

- активний

- AI

- ВСІ

- дозволяє

- альтернатива

- an

- та

- Відповіді

- будь

- API

- додаток

- ЕСТЬ

- навколо

- автор

- доступний

- нагорода

- заснований

- BE

- тести

- Берклі

- Краще

- Великий

- Bing

- блоги

- обидва

- будувати

- Створюємо

- by

- CAN

- не може

- Сертифікований

- Chatbot

- ChatGPT

- код

- комерційний

- Commons

- конкурувати

- Компоненти

- містить

- зміст

- контент-створення

- конкурс

- витрати

- створювати

- створений

- створення

- В даний час

- дані

- наука про дані

- вчений даних

- Збір даних

- набори даних

- вирішене

- Ступінь

- Демонстрація

- дизайн

- розробка

- DID

- важкий

- Доллі

- Співробітник

- співробітників

- Машинобудування

- оцінка

- Кожен

- експонати

- Face

- сім'я

- кілька

- фокусування

- після

- для

- від

- майбутнє

- породжувати

- породжує

- генеративний

- отримати

- графік

- Графік нейронної мережі

- Мати

- he

- високоякісний

- тримає

- HTML

- HTTPS

- хвороба

- зображення

- in

- інформація

- зацікавлений

- питання

- питання

- IT

- JPG

- KDnuggets

- мова

- великий

- останній

- останній

- вивчення

- ліцензія

- як

- машина

- навчання за допомогою машини

- управління

- майстер

- психічний

- Психічні розлади

- може бути

- модель

- Моделі

- змінювати

- Необхідність

- мережу

- Нейронний

- нейронної мережі

- Нові

- of

- on

- тільки

- відкрити

- з відкритим вихідним кодом

- OpenAI

- or

- оригінал

- вихід

- пар

- параметр

- участь

- продуктивність

- трубопровід

- plato

- Інформація про дані Платона

- PlatoData

- Product

- професійний

- цілей

- питання

- питань

- випущений

- дослідження

- вирішене

- обмежений

- s

- то ж

- наука

- вчений

- комплект

- Короткий

- Розмір

- So

- деякі

- Source

- Простір

- пробіли

- Станфорд

- почалася

- впроваджений

- Штати

- Бореться

- Студентам

- підходящий

- синтетичний

- синтетичні дані

- Завдання

- команда

- технічний

- Технології

- Технологія

- телекомунікації

- ніж

- Що

- Команда

- Майбутнє

- вони

- це

- до

- топ

- поїзд

- навчений

- Навчання

- при

- що лежить в основі

- оновлений

- використання

- використовуваний

- використання

- версія

- бачення

- було

- we

- тижня

- були

- Що

- який

- ВООЗ

- з

- Work

- б

- лист

- ви

- зефірнет