У цьому епізоді Віджай Панде розмовляє з Якобом Ушкорейтом, співзасновником і генеральним директором Inceptive. Разом вони обговорюють усе, що стосується ШІ.

Нижче ми публікуємо стенограму повністю, якщо ви захочете прочитати.

***

Олівія Вебб: Вітаю! Ласкаво просимо в Bio Eats World, подкаст на перетині біо, охорони здоров’я та технологій. Я Олівія Вебб, керівник редакції Bio + Health на a16z. У цьому епізоді ми спілкувалися з Якобом Ушкорейтом, колишнім співробітником Google Brain і співзасновником Inceptive. Якоб також є одним із авторів основоположної дослідницької роботи зі штучного інтелекту «Увага — це все, що вам потрібно», посилання на яку ми дамо в примітках до шоу. Джейкоб зустрівся з Віджаєм Панде, партнером-засновником a16z Bio + Health, щоб поговорити про все, що стосується штучного інтелекту: від його роботи в Google Brain до того, як люди й комп’ютери обробляють мову, до віри Inceptive у перспективність РНК і того, як Якоб вірить, що ми входите на територію точки перегину за допомогою ШІ.

Це епізод, який ви не хочете пропустити, але це також обговорення ШІ на рівні випускників, тому ми опублікуємо стенограму разом із епізодом. Давайте розпочнемо.

Застосовні алгоритми

Віджай Панде: Отже, Джейкобе, велике спасибі за те, що ви на Bio Eats World. Чудово мати тебе.

Якоб Ушкорейт: Чудово бути тут. Дякую, що ви мене отримали.

Віджай Панде: Тим паче, що у вас така захоплююча історія як спеціаліста з інформатики, підприємця та засновника, я хотів би, щоб ви розповіли нам про свою кар’єру, починаючи з будь-якого місця, але те, що привело вас до Google Brain, мабуть, гарне місце для початку .

Якоб Ушкорейт: Я певною мірою справді пам’ятаю, що зіткнувся з цією проблемою машинного навчання, можливо, у найширшому сенсі, [і] розумінням мови, дещо більш конкретно, як проблемою, яка є сімейною. Тож мій тато — комп’ютерний науковець і комп’ютерний лінгвіст, і, знаєте, такі речі, як машини Тьюрінга, не обов’язково були зовсім чужими концепціями досить рано.

Віджай Панде: Так, схоже, насправді це була розмова за обіднім столом.

Якоб Ушкорейт: Це були розмови за обіднім столом. І тому особливо скінченні автомати та те, як вони насправді пов’язані з торговими автоматами, були, знаєте, поширеними темами. Чим старшим я ставав, тим більше мені хотілося переконатися, що я справді зроблю щось інше. І тому я зрештою придивився до чистої математики та пов’язаних із нею сфер. [Я] справді багато зосереджувався на оптимізації, на алгоритмах оптимізації, алгоритмах загалом, ширше на теорії складності, перш ніж зрозуміти, що, можливо, це не найпрактичніша річ і не найбільш застосовна річ, яка, знаєте, начебто стала трохи червоною ниткою через мою кар'єру. А потім буквально наткнувся на стажування в Google у 2005 році.

Мені було запропоновано кілька різних варіантів [щодо] того, до яких дослідницьких проектів приєднатися, [і] серед них були різні зусилля з комп’ютерного зору, а також проект машинного перекладу, який фактично став Google Translate. Приблизно в той час або трохи раніше [Translate] запустив свій перший продукт, який справді базувався на внутрішніх системах Google, які були розроблені, і в певному сенсі, на мій розчарування, виявилося, що Google Translate на час, безсумнівно, мав найцікавіші великомасштабні проблеми з алгоритмами.

У той час це було справді цікаво спостерігати, тому що те, що переконало мене перервати докторську дисертацію та повернутися до Google після того стажування, насправді стало очевидним, коли я хотів працювати над чимось у машинне навчання, яке було не тільки цікавим і, скажімо так, інтелектуально та науково, захоплюючим, складним і стимулюючим, але яке також покладало великі надії на те, щоб негайно зрушити голку в промисловості та продуктах. Насправді в той час у світі було не дуже багато місць. І, звичайно, на той час це були не академічні лабораторії, а багато в чому такі місця, як Google. І Google тут і тоді був насправді дуже в авангарді цього. І тому, знаєте, у той час я думав, що це дивовижно запустити мої перші великомасштабні алгоритми кластеризації на тисячі машин, і це було просто, абсолютно неможливо зробити це деінде.

Віджай Панде: Коли ви розмовляєте з нашими старшими колегами, ви відчуваєте багато романтики часів розквіту Bell Labs, і я завжди думав, чи може Google Brain бути одним із ближчих варіантів сьогодні. Яким було середовище?

Якоб Ушкорейт: Тож я відчуваю, що між тим часом і моментом, коли Google Brain справді почав працювати, тобто приблизно через п’ять років, відбулися значні зміни. До того, як Brain and Translate розпочалися, вони набагато більше керувалися продуктами, які справді зробили різницю, ніж я вважаю Bell Labs. Звичайно, серед нас була велика кількість випускників Bell Labs, але це було набагато більше мотивовано прямим застосуванням.

Мені було справді неймовірно спостерігати, як машинний переклад перетворився [з чогось, що] було добре для сміху на вечірці, буквально. Якби вас запитали, де ви працюєте? А ви сказали Google. А потім сказали, що ти там робиш? І вони спочатку були вражені. А потім ви сказали: о, я працюю над Google Translate. А потім вони сміялися і запитували, чи це колись спрацює? Я так не думаю. Але в той же час я б сказав, що хвиля машинного навчання, хвиля ренесансу машинного навчання перед глибоким навчанням, почала спадати. Ви знаєте, глибоке навчання — це те, чим я займався раніше в школі, і мені це подобалося, але в ті часи це було не те, що можна було б реально застосувати.

Віджай Панде: Так, особливо тому, що в академічних колах у вас не було достатнього масштабу, щоб виконати розрахунки, які вам потрібно зробити.

Якоб Ушкорейт: Звісно, не в академічних колах, але навіть у Google. Незважаючи на те, що на той час у Translate насправді найцікавішою відмінною рисою була, я б сказав, те, що ми справді вірили в абсолютну силу даних у кінці дня.

Тож ми намагалися не створювати складніші та витонченіші алгоритми, а натомість максимально спростити та масштабувати їх, а потім дозволити їм навчатися на все більшій кількості даних. Але ми просто досягли стелі. Спрощення, які вам довелося зробити, щоб масштабувати їх до того, що було на той час у масштабі Google, це справді було нашою метою. Але тоді, і це було начебто одним із цих маятникових рухів, повертаючи назад, поза академічним середовищем, купу людей із купою графічних процесорів — глибоке навчання в певному сенсі повернулося з помстою. І раптом середовище адаптувалося, тому що було незрозуміло, яким буде прямий шлях у масштабне виробництво.

І тому все середовище змінилося з більш орієнтованого на застосування та продукт на щось, що принаймні здавалося протягом кількох років, набагато більш академічне. Це все ще трохи відрізняється від академічних лабораторій, тому що ми могли дозволити собі значно більше графічних процесорів, але набагато більше відповідали, у певному сенсі, цій ідеї [бути] керованими публікаціями, керованими стрибками, а не кроками. [Це] перетворилося на дуже, дуже продуктивне — і справді дивовижне — але набагато більш відкрите [середовище].

Увага це все, що вам потрібно

Віджай Панде: Ну, знаєте, якщо говорити про публікації, природне місце, про яке варто подумати, це коли ви та ваша команда опублікували Attention is All You Need. І, ви знаєте, це була така основоположна стаття для великої частини генеративного штучного інтелекту, оскільки саме тоді було вперше викладено алгоритм трансформатора.

Якоб Ушкорейт: За два роки до публікації цієї статті ми зрозуміли [що] те, що на той час було найсучаснішим для таких проблем, як машинний переклад, або [що] з’являлося як найсучасніше, а саме LSTM або RNN , Seq2Seq загалом як парадигма навчання та налаштування, а також як мережева архітектура — мав неймовірні проблеми навіть на найсучасніших графічних процесорах того часу, коли справа доходила до масштабування з точки зору даних.

Наприклад, найперша нейронна система машинного перекладу, яку Google запустив, GNMT, насправді, наскільки мені відомо, ніколи не навчалася на всіх наявних у нас навчальних даних, які ми раніше збирали для статистичних систем на основі фраз. І це було тому, що алгоритми просто погано масштабувалися з точки зору обсягу даних. Коротше кажучи, у той час ми розглядали не машинний переклад, а проблеми, де всередині Google у нас була ще більша кількість навчальних даних. Отже, це були проблеми, які виникли в результаті пошуку, де у вас є ще три-чотири порядки величини. Ви знаєте, зараз більше не мільярди слів, а легко трильйони, і раптом ми зіткнулися з цією моделлю, де прості мережі прямого зв’язку, навіть незважаючи на те, що вони зробили смішні спрощені припущення, наприклад, це просто мішок слів або це просто мішок біграм , і ви начебто усереднюєте їх і надсилаєте їх через великий MNLP, вони фактично перевершують RNN та LSTM, принаймні, якщо їх навчити на більшій кількості даних.

[І вони були] в п разів швидшими, легко в 10, 20 разів швидше, щоб тренуватися. І щоб ви могли навчити їх набагато більше даних. У деяких випадках [вони] навчалися в сто разів швидше. І тому ми постійно отримували простіші моделі, які не могли виразити чи охопити певні явища, які, як ми знаємо, безперечно поширені в мові.

І все ж, знаєте, у підсумку їх було дешевше тренувати, і [вони] показали кращі результати.

Віджай Панде: Давайте просто наведемо приклад для людей, які не знайомі. Отже, якщо я скажу, покажи мені всі ресторани поблизу, окрім італійських, тобі покажуть усі італійські ресторани, так?

Якоб Ушкорейт: точно. Насправді те, що ви сказали, можливо, можна змінити, щоб показати мені всі італійські ресторани, окрім найближчих. Це просто набір слів, і ви можете перевпорядкувати їх у щось, що точно означає щось інше.

Віджай Панде: Так.

Якоб Ушкорейт: І тоді ви наближено отримуєте структуру та отримуєте більш глобальні явища, додаючи біграми. Отже, в основному групи з двох послідовних слів тощо. Але зрозуміло, що, звичайно, у таких мовах, як німецька, де ви можете в основному поставити дієслово в самому кінці речення...

Віджай Панде: І це повністю змінює сенс, чи не так?

Якоб Ушкорейт: Змінює весь сенс, точно, так. Незалежно від розміру ваших n-грамів або ваших маленьких груп слів, ви, зрештою, не досягнете успіху. І нам стало ясно, що має бути інший спосіб, який не потребує повторення RNN у довжині чи повторенні послідовності, скажімо, слів чи пікселів, але який фактично обробляє вхідні та вихідні дані більш паралельним способом і дійсно врешті-решт задовольнити сильні сторони сучасного обладнання прискорювача.

Віджай Панде: Подумайте про це, як мішок слів - це слова в довільному порядку. LSTM, або довготривала короткочасна пам’ять, можливо, дає вам якусь [здатність] трохи зазирнути [в] минуле, чи не так? Але Transformers робить щось кардинально інше. Як Transformers підіймають це на новий рівень?

Якоб Ушкорейт: Завжди є два погляди на це. Один — крізь призму ефективності, але інший, можливо, трохи інтуїтивніший спосіб — поглянути на це з точки зору, знаєте, скільки контексту ви можете зберегти. І, як ви сказали, LSTM, або рекурентні нейронні мережі загалом, вони переміщуються через свої вхідні дані крок за кроком, загалом кажучи, і хоча вони, теоретично, здатні підтримувати довільно довгі контекстні вікна у вхідні дані — минуле — що на практиці це те, що їм насправді дуже важко ідентифікувати події, скажімо, слова чи пікселі, які є дуже далекими в минулому, які дійсно впливають на значення в кінці дня. Вони схильні зосереджуватися на речах, які знаходяться поблизу.

Трансформатор, з іншого боку, просто перевертає це з ніг на голову і каже: ні, на кожному кроці те, що ми робимо, не рухається через вхід. На кожному кроці ми розглядаємо весь вхідний або вихідний сигнал, і в основному ми поступово переглядаємо представлення кожного слова, кожного пікселя, кожного фрагмента або кожного кадру відео, у міру того, як ми в основному рухаємося, а не в просторі введення , але в просторі представлення.

Віджай Панде: Так.

Якоб Ушкорейт: І ця ідея мала певні недоліки з точки зору того, як її можна було б розмістити на сучасному апаратному забезпеченні, але порівняно з рекурентними нейронними мережами вона мала переваги, перш за все, тому що тепер ви фактично не були зобов’язані послідовно обчислювати представлення, скажімо, слово в слово. Те, чим ви були пов’язані, насправді, наскільки хорошими вони повинні бути? Скільки шарів такого роду паралельної обробки всіх позицій, де все, де всі пари слів або всі пари зображень можуть взаємодіяти одразу? Скільки переглядів цих уявлень я можу собі «дозволити»?

Віджай Панде: Що дійсно цікаво, так це те, що, очевидно, джерелом натхнення є природна мова, але є багато структур, які ви хотіли б ввести, де ви не хочете просто вивчати їх послідовно, як послідовність ДНК, і ми перейдемо до біології досить скоро — що ви захочете мати модель усієї речі.

Це якось смішно з мовою. Коли я говорю або слухаю вас, я обробляю кожне слово, але врешті-решт мені потрібно не просто розділити слова на окремі значення, але я маю якось розробити це представлення. Так? Я б хотів, щоб ми могли зробити це так, як це роблять трансформери. І, можливо, в цьому полягає фішка в тому, що LSTM ближче до того, як це робимо ми, люди, а трансформери, можливо, саме те, як ми повинні це робити, або я б хотів, щоб ми могли це зробити.

Якоб Ушкорейт: Зовні я вважаю, що це правда, хоча, зрештою, такі інтроспективні аргументи витончені й хитрі.

Тому я думаю, що багатьом із нас відомий такий феномен, коли ви кричите або кричите з кимось, намагаючись щось повідомити на жвавій вулиці. І ось ви чуєте щось, що вони говорять, і це не коротка послідовність слів, і ви, по суті, нічого не розумієте. Але через півсекунди ви раптом зрозуміли все речення. Це фактично натякає на той факт, що хоча ми змушені писати й вимовляти мову послідовно — лише через стрілу часу — не так зрозуміло, що наше глибше розуміння справді відбувається таким послідовним способом.

Створення команди

Віджай Панде: Якщо хтось вивчає хоча б папір «Увага — це все, що вам потрібно» або як працює трансформатор, у цьому є багато частин. І здається, що вже минуло межу, коли одна людина могла ефективно виконувати цю роботу самостійно за будь-який короткий проміжок часу.

Якоб Ушкорейт: Абсолютно

Віджай Панде: Тож тепер вам дійсно потрібна команда людей, щоб робити такі речі. Яка тут соціологія? Як щось подібне виникає?

Якоб Ушкорейт: Особисто я вважаю, що цей окремий випадок є справді чудовим прикладом того, що надзвичайно добре підходить до більш, скажімо так, промислового підходу до наукових досліджень. Тому що ти абсолютно правий. Це була не єдина велика іскра уяви та креативності, яка запустила все це.

Це була справді ціла купа внесків, які, зрештою, були необхідними. Наявність середовища, бібліотеки, яка пізніше також була відкритою під назвою Tensor2Tensor, яка фактично включала реалізації. І не будь-які реалізації, а винятково хороші реалізації, швидкі реалізації всіляких прийомів глибокого навчання.

Але також і всі ці механізми уваги, які виникли з попередніх публікацій, як-от розкладна модель уваги, [яка] була опублікована раніше, але потім були фактично поєднані з удосконаленнями та інноваціями, винаходами навколо оптимізаторів. Я вважаю, що ви не знайдете людей, які справді є одними з провідних світових експертів у всіх цих аспектах одночасно і які дійсно однаково захоплені всіма цими аспектами.

Віджай Панде: І особливо є початкова ідея, є її реалізація, є її масштабування. Досягти такого масштабу в будь-якому іншому місці, окрім великої компанії, прямо зараз, ймовірно, неможливо зробити лише через вартість.

Якоб Ушкорейт: Я думаю, що, можливо, аспект великої компанії не такий вже й вирішальний.

Віджай Панде: Так?

Якоб Ушкорейт: Аспект компанії є тим, що я б цінував вище. Велика компанія точно не завадить, якщо вам потрібні тисячі і тисячі TPU або GPU або що у вас є. Глибокі кишені ніколи не завадять для такого роду речей. Але в той же час я вважаю, що структура стимулів навколо такого роду пошукових досліджень у промисловості набагато краще підходить для таких проектів. І я думаю, що це те, що ми бачимо, дивлячись на проекти генеративного штучного інтелекту в усіх напрямках.

Віджай Панде: так Як на вашу думку, це може бути стартап.

Якоб Ушкорейт: Це точно може бути стартап. І я думаю, що зараз ми бачимо, що використання апаратного прискорювача стає принаймні доступнішим. І є стартапи, які сильно конкурують, коли справа доходить до генеративного штучного інтелекту, націленого на створення зображень або тексту.

Перехід до наук про життя

Віджай Панде: Я хотів би перейти до того, що ви зараз робите. Ви генеральний директор Inceptive, компанії, яка застосовує штучний інтелект до біології РНК для РНК-терапії. Як ви перейшли до наук про життя? Поверхнево, якщо говорити про мовні моделі за обідом [за столом], а потім у кафетерії Google… здається, що це може бути переходом до наступного покоління терапевтичних засобів. Як це все сталося?

Якоб Ушкорейт: Я не можу погодитись. З мого боку це чудовий досвід навчання. Вже досить давно біологія вважала мене такою проблемою, де не здавалося немислимим, що існують обмеження щодо того, як далеко ми можемо зайти в плані, скажімо, розробки ліків і прямого дизайну з традиційною біологією як основою того, як ми розробляти — або відкривати методи розробки — ліків майбутнього.

Здається, глибоке навчання, зокрема масштабне, є, з низки причин, потенційно дуже підходящим інструментом тут. І одна з цих причин насправді полягає в тому, що часто не обов’язково називають перевагою, а це те, що це великий чорний ящик, який ви можете просто кинути на щось. І неправда, що його можна просто кинути. Це те, що ви повинні знати, як це кинути.

Віджай Панде: І він теж не зовсім чорний. Ми можемо посперечатися про це пізніше.

Якоб Ушкорейт: Так точно. точно. Але, зрештою, повертаючись до аналогії з мовою, нам ніколи не вдавалося повністю, в цьому сенсі, зрозуміти й концептуалізувати мову до такої міри, щоб ви могли сказати: о, я зараз піду і скажу вам Ця теорія лежить в основі мови, а потім ви зможете реалізувати алгоритм, який її «розуміє». Ми ніколи не доходили до цього. Натомість нам довелося перервати і зробити крок назад і, на мою думку, певною мірою визнати собі, що це, можливо, був не найпрагматичніший підхід. Натомість ми повинні спробувати підходи, які не вимагають такого рівня концептуального розуміння. І я думаю, що те саме може стосуватися окремих частин біології.

Використовуйте штучний інтелект, щоб перенести біографію далі

Віджай Панде: Цікаво, ми вже говорили про такі речі. Ви думаєте про минуле століття, [яке було] багато в чому століттям фізики та математики. Існує певний менталітет, коли є спосіб дуже елегантного спрощення речей, що ви можете мати єдине рівняння, як рівняння поля Ейнштейна, яке описує так багато, і це дуже просте рівняння дуже складною мовою. Ви говорили про те, що підхід Фейнмана, майже як соціологія фізики, може не застосовуватися тут, у біології, чи не так?

Якоб Ушкорейт: Це може не застосовуватися, принаймні з двох причин, які я бачу на даний момент. По-перше, задіяно занадто багато гравців. І хоча це правда, що, можливо, ми можемо просто звести все це до рівняння Шредінгера і просто розв’язати його, це просто так сталося, що не тільки важко розв’язати обчислення, але також нам потрібно знати про всіх цих різних гравців, а ми зараз цього не знаємо . Навіть близько не. Тож це один аспект.

І тоді другий — це, в основному, обчислювальна нерозв’язність, де скорочення, у певному сенсі, зайшло настільки далеко, що, хоча воно повертає все до однієї речі, це нам не допомагає, оскільки наші обчислювальні підходи в основному використовують ці основи, щоб робити прогнози, надто повільні, щоб робити ці прогнози для систем, достатньо великих, щоб справді мати значення для життя.

Віджай Панде: так Отже, це не рівняння з n-тілом, але все ж є відчуття формалізму — можливо, це більш керований даними формалізм або більш байєсівський формалізм. Як це впливає на те, що ви хотіли б робити? Як це впливає на застосування ШІ та інших типів нових алгоритмів?

Якоб Ушкорейт: Я думаю, що є кілька різних аспектів. Зрештою, на мій погляд, одним із важливих висновків із того, що ми зараз бачимо в генеративному штучному інтелекті, є те, що нам більше не потрібно тренуватися на даних, які є не лише ідеально чистими, але й саме з домену і від видів завдань, які ви хотіли б вирішити пізніше. Але натомість це насправді може бути більш корисним або навіть єдиним способом, який ми наразі знайшли, щоб фактично спробувати потренуватися на всьому, що ви знайдете, що навіть віддалено пов’язане. А потім ефективно використовуйте інформацію, зібрану з цих даних, щоб отримати так звані базові моделі, які потім можна точно налаштувати для всіляких конкретних завдань, використовуючи набагато менші, набагато більш сприйнятливі обсяги чистіших даних.

Я думаю, що ми трохи недооцінюємо те, що нам потрібно знати про явища в цілому. Щоб побудувати дуже хорошу велику мовну модель, ви повинні розуміти, що існує така штука, яка називається Інтернет і містить багато тексту. Насправді вам потрібно досить добре розуміти, як знайти цей текст, що не є текстом і так далі, щоб потім, по суті, виділити з нього навчальні дані, які ви потім використовуєте.

Я вважаю, що навколо біології будуть дуже схожі проблеми. Велике питання полягає в тому, які експерименти ми можемо масштабувати, щоб ми могли спостерігати життя в достатньому масштабі майже з достатньою точністю, але з набагато меншою точністю, пам’ятаючи про проблеми, які ви намагаєтеся вирішити врешті-решт, щоб ми могли в основному взяти з цього дані, які нам потрібні для того, щоб почати будувати ці базові моделі, які потім ми можемо використовувати, точно налаштовані та спеціально розроблені, щоб справді підійти до проблем, які ми хочемо вирішити.

Частина генерування даних, безумовно, одна з них. Архітектури та фактично наявні моделі та мережеві архітектури, які імітують те, що ми знаємо, скажімо, про фізику, що лежить в основі, залишатимуться неймовірно потужним способом фактичної економії обчислень, а також зменшення все ще величезного апетиту до даних, які ці моделі повинні будуть мати , до можливого рівня. І тому одна річ, яку я вважаю насправді цікавою, полягає в тому, що багато поточних застосувань моделей, скажімо, трансформаторів, які [було] досить добре масштабовані в інших модальностях, інших областях, мові, баченні, створенні зображень, і т.д., і т.д., і застосування їх до біології в основному ігнорує той факт, що ми знаємо, що існує така річ, як час, і що закони фізики, принаймні, наскільки нам відомо, не змінюються просто так. через деякий час.

Процес згортання білка, ігноруючи той факт, що існує безліч гравців — шаперонів і багато чого іншого — насправді, у певному сенсі, досить довільно відокремлена проблема від решти білкової кінетики. Це така ж кінетика, як і залишок кінетики або залишок життя цього білка, цієї молекули. І чому ми намагаємося навчити моделі спеціально для одного й, можливо, принаймні, ігноруємо дані, які ми можемо мати про інший? У цьому випадку, можливо, точніше, чи деякі з моделей прогнозування структури білка, які ми маємо сьогодні, вони вже дізналися щось про кінетику неявно через те, що вони повільно починають охоплювати, знаєте, існування часу?

Розробка нових архітектур

Віджай Панде: Одна з цікавих речей, які я думаю про ваше становище зараз, полягає в тому, що, за кількома рідкісними винятками, більшість глибоких нейронних мереж або інших типів штучного інтелекту в біології відчувають себе так, ніби вони беруть щось, винайдене десь ще, і переносять це. Наприклад, ми будемо використовувати згорточні нейронні мережі для зображень. Можливо, для малих молекул… у моїй лабораторії в Стенфорді ми використовували графові нейронні мережі та декілька згорткових нейронних мереж. Але справді розробити алгоритм для біологічної проблеми досить рідко. І я завжди вважав, що це тому, що просто важко мати набір навичок у команді, сильній у галузі біології та інформатики. Але мені цікаво дізнатися вашу думку. Чи це просто рідкість для розробки нових архітектур?

Якоб Ушкорейт: Ну, я думаю, зрештою, те, що ми бачимо, полягає в тому, що нові архітектури, мотивовані конкретними проблемами, якщо вони справді змінюють ситуацію, тоді вони також мають тенденцію бути застосовними в інших місцях. З іншого боку, це не означає, що на шляху до цього ретельний вибір мотивуючих програм і доменів не матиме великого значення. І я думаю, що це точно так.

Я вважаю, що одним із ключових викликів тут є те, що ми ще не перебуваємо в режимі біології, коли ми маємо величезну кількість даних, хоча, порівняно з тим, що ми мали деякий час тому, це дивовижно. Але ми ще не в такому режимі, де це просто сидить у еквіваленті Інтернету, і ми можемо трохи відфільтрувати це, завантажити та покінчити з цим. Але натомість я вважаю, що ми повинні створити його в розумно великому обсязі. І цього не зроблять експерти з глибокого навчання, принаймні більшість із них.

І я вважаю, що це має відбуватися разом із розумінням особливостей зазначених даних, чи не так? Види шуму, з якими ви там стикаєтеся. Той факт, що вони фактично створюються в дуже великих масштабованих пулах, експериментах з високою пропускною здатністю, але все ж експерименти, які проводяться в різні дні різними експериментаторами і так далі і тому подібне. І там, де люди з глибокими знаннями досить тісно співпрацюють з людьми з біологією, дізнаються достатньо про те, що ми знаємо про основні явища, [вони] в основному отримають натхнення спробувати цікаві нові підходи.

Віджай Панде: Ну, мені сподобалося, коли ви говорили лише про приклад статті «Увага — це все, що вам потрібно», про те, як ви хотіли зібрати цю різноманітну групу людей, чиї пристрасті були, знаєте, досить ортогональні одне одному. І в певному сенсі, коли ви робите це в біології та особливо для того, що ви робите в Inceptive, ви також повинні вкласти всю цю роботу в генерацію даних. І генерування даних насправді означає, якщо говорити дуже чітко, проведення масштабних біологічних експериментів. Вхідна частина сама по собі дуже дорога і дуже технічна, і, як ви сказали, має багато способів піти не так. Але схоже, що ви розвиваєте культуру, яку ви створювали раніше, а тепер це просто більше експертів з різними пристрастями, які координують роботу аналогічним чином.

Якоб Ушкорейт: Мені справді потрібно, [і] це потрібно людям. Наскільки я можу судити, це найперспективніший шлях. [Це] не має на меті, у певному сенсі, конвеєрну модель, де певні дані в лабораторії, в якій вони були створені, враховуючи найкращі наші знання, про глибинні аспекти життя. А потім починати запускати на ньому існуючі підходи глибокого навчання, а потім налаштовувати їх. Але замість того, щоб дійсно мати людей, які, у певному сенсі, вони могли б бути одними з перших людей, які дійсно працюють у дисципліні, яка наразі ще не має особливого імені.

Можливо, найменшим спільним знаменником є цікавість, яка виходить за рамки того, що ви знаєте, чого ви навчилися раніше і на що, можливо, витратили більшу частину свого часу. Ми бачимо, що, як і в багатьох інших сферах, ми прагнемо до групи людей із дуже різним досвідом, але які мають спільну цікавість.

Куди рухається ШІ?

Віджай Панде: Як ви думаєте, де зараз ШІ для складніших проблем, для розробки ліків, охорони здоров’я тощо? Що потрібно зробити? Коли це буде там?

Якоб Ушкорейт: Я б сподівався — а робити прогнози щодо майбутнього завжди дуже небезпечно — я був би дуже здивований, якби протягом наступних трьох років ми фактично не помітили [переломний] момент, коли справа доходить до наслідків реального світу машинне навчання, широкомасштабне глибоке навчання в розробці ліків, дизайн ліків. Звичайно, де саме вони будуть першими, я вважаю, що багато з них відбудеться навколо РНК, РНК-терапевтичних засобів і вакцин. Це, звичайно, не єдина сфера, яка постраждає від цього, але я точно вважаю, що ми прямуємо до території точки перегину.

Віджай Панде: Ви зробили цікаву думку. Чим відрізняється РНК? Тому що я вважаю, що це особливо цікаво, не тільки те, що ви перейшли від Google Brain до біології, а й конкретно до РНК. Що приваблює вас у РНК, особливо, можливо, з точки зору ШІ чи МЛ?

Якоб Ушкорейт: Одна річ, яка є цікавою щодо РНК, це комбінація між, як ми бачили, дуже широкою застосовністю, хоча вона все ще вузька в сенсі єдиного показання, але просто дивлячись на цю хвилю процесів схвалення, яка починається і вже почалася, це досить зрозуміло, що застосовність дуже, дуже широка, у поєднанні з (це трохи неоднозначно) структурно простою проблемою. І це структурно просто не в тому реченні, що передбачення структури РНК просте, а структурно просте в тому сенсі, що це біополімер із чотирма різними основами. Ми не говоримо про понад 20 амінокислот. Це те, що можна виробляти досить ефективно.

Тут є певні труднощі, але синтез — це те, що може масштабуватися і швидко масштабується, і ці речі об’єднуються, щоб увімкнути цю швидку петлю зворотного зв’язку, про яку, я думаю, часто згадують, але дуже рідко, принаймні з того, що я знаю, насправді реалізують і можна реалізувати в кінці дня.

Віджай Панде: Так, ймовірно, це швидший цикл зворотного зв’язку, особливо з огляду на те, як ви за ним йдете.

Якоб Ушкорейт: Так. І враховуючи, що я вважаю, що нам потрібно створити левову частку даних для навчання моделей, які ми навчаємо, ми справді інвестуємо Inceptive у створення таких даних у великих масштабах. І я б сказав, що відносно досить великий масштаб, враховуючи, що РНК, здається, є найкращою комбінацією, коли справа доходить до структурної простоти, а також масштабованості синтезу та цього експерименту. Тут є величезний потенціал, який поки що невикористаний.

Віджай Панде: Так, і я вважаю, що це особливо потенційна здатність мати ці швидкі цикли, як доклінічні, так і швидше дістатися до клініки та бути в клініці [коротший період часу].

Якоб Ушкорейт: Абсолютно. Це те, на що ми сподіваємося. Ми також бачимо, можливо, ранні натяки, які вказують на те, що це може бути так, і це, звичайно, дуже, дуже схвильовано.

Віджай Панде: Думати про останні 10 років було дивовижно, знаєте, з 2012 року до сьогодні. Як ви думаєте, як виглядатимуть наступні 10 років? Як ви думаєте, де ми будемо через 10 років з ШІ? Або широко, чи особливо для біографії?

Якоб Ушкорейт: Я думаю, якщо це правда, що ми вступаємо на цю територію точки перегину, коли ми озирнемося назад через 10 років, це буде здаватися революцією, принаймні такою ж великою та експансивною, як та, яку, як ми думаємо, бачили в останні 10 років. Принаймні. Тепер я думаю, що буде суттєва різниця, а саме те, що не зовсім зрозуміло, наскільки широко революція, свідками якої ми були протягом останніх 10 років, впливає на життя кожного. Є певні сфери, пошукові системи чи допоміжне письмо тощо, де це очевидно, але незрозуміло, наскільки широко застосовна ця революція. Я вірю, що це дуже так, але ми цього ще не бачимо. Я думаю, що революція, яку ми спостерігатимемо саме навколо біології протягом наступних 10 років, або на яку ми збираємося озирнутися через 10 років, справді відрізнятиметься з точки зору її глибокого впливу на все наше життя .

Навіть якщо відкинути осторонь програми розробки та відкриття ліків, є такі дивовижні програми в області наукових відкриттів, де ви тепер можете уявити, що за допомогою веб-інтерфейсу ви можете створити молекули, які в певних організмах з дуже високою ймовірністю збираються відповідати на певні запитання, створюючи більш надійні дані, ніж, знаєте, те, що ви могли отримати раніше. Отже, навіть якщо не згадати всю складність того, як це в кінцевому підсумку вплине на пацієнтів і всіх, я вважаю цілком зрозумілим, що ці інструменти просто швидко прискорять такі галузі, як біологія.

Віджай Панде: Це здається чудовим місцем для завершення. Щиро дякую, Джейкобе, за приєднання до Bio Eats World.

Якоб Ушкорейт: Дуже дякую за те, що у мене є.

Олівія Вебб: Дякуємо, що приєдналися до Bio Eats World. «Bio Eats World» ведеться та продюсується мною, Олівією Вебб, за допомогою команди «Bio + Health» на a16z та редагується Філом Хегсетом. Bio Eats World є частиною мережі подкастів a16z.

Якщо у вас є запитання щодо епізоду або ви хочете запропонувати теми для майбутнього епізоду, надішліть електронний лист І останнє, але не менш важливе: якщо вам подобається Bio Eats World, будь ласка, залиште нам оцінку та відгук, де б ви не слухали подкасти.

Зауважте, що наведений тут вміст лише в інформаційних цілях, його не можна сприймати як юридичну, ділову, податкову чи інвестиційну консультацію або використовувати для оцінки будь-яких інвестицій чи цінних паперів, і він не спрямований на будь-яких інвесторів або потенційних інвесторів у будь-який фонд a16z . Для отримання додаткової інформації відвідайте a16z.com/disclosures.

***

Погляди, висловлені тут, є поглядами окремих співробітників AH Capital Management, LLC («a16z»), які цитуються, і не є поглядами a16z або його філій. Певна інформація, що міститься тут, була отримана зі сторонніх джерел, зокрема від портфельних компаній фондів, якими керує a16z. Хоча отримано з джерел, які вважаються надійними, a16z не перевіряв таку інформацію незалежно та не робить жодних заяв щодо тривалої точності інформації чи її відповідності певній ситуації. Крім того, цей вміст може містити рекламу третіх сторін; a16z не переглядав такі оголошення та не схвалює будь-який рекламний вміст, що міститься в них.

Цей вміст надається лише в інформаційних цілях, і на нього не можна покладатися як на юридичну, ділову, інвестиційну чи податкову консультацію. Ви повинні проконсультуватися з власними радниками щодо цих питань. Посилання на будь-які цінні папери чи цифрові активи наведено лише з метою ілюстрації та не є інвестиційною рекомендацією чи пропозицією надати інвестиційні консультаційні послуги. Крім того, цей вміст не призначений для будь-яких інвесторів чи потенційних інвесторів і не призначений для використання ними, і за жодних обставин на нього не можна покладатися при прийнятті рішення інвестувати в будь-який фонд, яким керує a16z. (Пропозиція інвестувати у фонд a16z буде зроблена лише на підставі меморандуму про приватне розміщення, угоди про підписку та іншої відповідної документації будь-якого такого фонду, і її слід читати повністю.) Будь-які інвестиційні чи портфельні компанії, згадані, згадані або описані не є репрезентативними для всіх інвестицій у транспортні засоби, якими керує a16z, і не може бути гарантії, що інвестиції будуть прибутковими або що інші інвестиції, здійснені в майбутньому, матимуть подібні характеристики чи результати. Список інвестицій, здійснених фондами під управлінням Andreessen Horowitz (за винятком інвестицій, щодо яких емітент не надав дозволу a16z на оприлюднення, а також неоголошених інвестицій у публічні цифрові активи) доступний за адресою https://a16z.com/investments /.

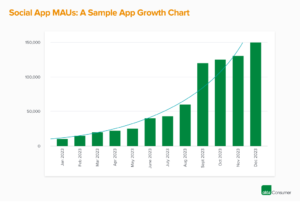

Наведені в ньому діаграми та графіки призначені виключно для інформаційних цілей, і на них не слід покладатися під час прийняття інвестиційних рішень. Минулі результати не вказують на майбутні результати. Зміст відповідає лише вказаній даті. Будь-які прогнози, оцінки, прогнози, цілі, перспективи та/або думки, висловлені в цих матеріалах, можуть бути змінені без попередження та можуть відрізнятися або суперечити думкам, висловленим іншими. Додаткову важливу інформацію можна знайти на сторінці https://a16z.com/disclosures.

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- Платоблокчейн. Web3 Metaverse Intelligence. Розширені знання. Доступ тут.

- джерело: https://a16z.com/2023/01/11/bio-eats-world-using-ai-to-take-bio-farther/

- 10

- 2012

- a

- a16z

- здатність

- Здатний

- МЕНЮ

- про це

- абсолют

- абсолютно

- Академія

- академічний

- прискорювати

- прискорювач

- точність

- через

- насправді

- пристосований

- доповнення

- Додатковий

- визнати

- Перевага

- Переваги

- реклама

- рада

- консультативний

- консультативні послуги

- впливати

- Філії

- доступний

- після

- Угода

- AI

- ai дослідження

- алгоритм

- алгоритми

- ВСІ

- пліч-о-пліч

- вже

- хоча

- завжди

- дивовижний

- серед

- серед нас

- кількість

- суми

- та

- Андрієссен

- Андреессен Горовиц

- Інший

- відповідь

- будь

- де-небудь

- апетит

- застосовно

- додаток

- застосування

- Застосовувати

- Застосування

- підхід

- підходи

- твердження

- APT

- ПЛОЩА

- області

- сперечатися

- аргументація

- навколо

- зовнішній вигляд

- аспекти

- Активи

- передбачається

- гарантія

- увагу

- Приваблює

- authors

- доступний

- Проспект

- середній

- назад

- Хребет

- фон

- фони

- сумка

- Мішок слів

- В основному

- Байєсівський

- оскільки

- ставати

- становлення

- перед тим

- за

- буття

- віра

- Вірити

- вважається,

- вважає,

- Дзвін

- нижче

- корисний

- КРАЩЕ

- Краще

- між

- За

- Великий

- мільярди

- біо + здоров'я

- біологія

- Біт

- Black

- рада

- дно

- пов'язаний

- Box

- Brain

- Приносить

- широкий

- широко

- будувати

- Створюємо

- гроно

- бізнес

- званий

- капітал

- захоплення

- кар'єра

- обережно

- проведення

- випадок

- випадків

- стелю

- Століття

- Генеральний директор

- певний

- звичайно

- проблеми

- складні

- зміна

- Зміни

- характеристика

- більш дешевий

- Вибираючи

- обставин

- стверджувати

- ясно

- клініка

- близько

- тісно

- ближче

- Кластеризація

- співзасновник

- колеги

- поєднання

- комбінований

- Приходити

- майбутній

- загальний

- спілкуватися

- Компанії

- компанія

- порівняльно

- порівняний

- конкурують

- комплекс

- складність

- складний

- обчислення

- обчислення

- комп'ютер

- Інформатика

- Комп'ютерне бачення

- комп'ютери

- поняття

- концептуальний

- поспіль

- складати

- зміст

- контекст

- навпаки

- внески

- Розмова

- розмови

- координуючи

- Коштувати

- може

- Пара

- з'єднаний

- курс

- створювати

- створений

- створення

- креативність

- вирішальне значення

- культура

- цікавість

- цікавий

- Поточний

- В даний час

- циклів

- Папа

- Небезпечний

- дані

- керовані даними

- Дата

- день

- Днів

- рішення

- глибокий

- глибоке навчання

- глибокі нейронні мережі

- глибше

- безумовно

- описаний

- дизайн

- призначений

- деталі

- розвивати

- розвиненою

- розробка

- DID

- відрізняються

- різниця

- різний

- важкий

- цифровий

- Цифрові активи

- Вечеря

- прямий

- безпосередньо

- Розкрити

- відкриття

- відкриття

- обговорювати

- обговорення

- Віддалений

- Різне

- ДНК

- документація

- Ні

- справи

- домен

- домени

- Не знаю

- вниз

- скачати

- недоліки

- керований

- наркотик

- розробка ліків

- Наркотики

- кожен

- Рано

- легко

- Редакційний

- фактично

- ефекти

- ефективність

- зусилля

- або

- в іншому місці

- обійняти

- з'являються

- включіть

- зіткнення

- стикаючись

- схвалювати

- витривалий

- Двигуни

- величезний

- досить

- забезпечувати

- Весь

- повністю

- цілісність

- Підприємець

- Навколишнє середовище

- рівняння

- Еквівалент

- особливо

- Оцінки

- і т.д.

- оцінювати

- Навіть

- Події

- врешті-решт

- НІКОЛИ

- все

- все

- точно

- приклад

- Крім

- збуджений

- захоплюючий

- виключення

- існуючий

- експансивний

- дорогий

- досвід

- experts

- експрес

- виражений

- достатньо

- знайомий

- сім'я

- захоплюючий

- ШВИДКО

- швидше

- реально

- особливість

- зворотний зв'язок

- кілька

- поле

- Поля

- фільтрувати

- знайти

- кінець

- Перший

- відповідати

- Сфокусувати

- увагу

- передній край

- іноземні

- раніше

- знайдений

- фонд

- засновник

- заснування

- FRAME

- від

- Повний

- повністю

- фонд

- Основи

- засоби

- смішний

- Крім того

- майбутнє

- Загальне

- породжує

- покоління

- генеративний

- Генеративний ШІ

- німецька

- отримати

- отримання

- Давати

- даний

- дає

- Глобальний

- Go

- буде

- добре

- Google Translate

- Google,

- Графічні процесори

- випускник

- графік

- графік нейронних мереж

- графіки

- великий

- Group

- Групи

- Зростання

- Половина

- траплятися

- відбувається

- Жорсткий

- апаратні засоби

- має

- голова

- очолював

- здоров'я

- охорона здоров'я

- допомога

- тут

- Високий

- вище

- підказки

- хіт

- сподівається,

- сподіваючись

- Горовіц

- відбувся

- Як

- How To

- HTTPS

- величезний

- Людей

- Біль

- ідея

- ідентифікувати

- зображення

- генерація зображень

- зображень

- уяву

- Impact

- здійснювати

- реалізація

- реалізовані

- важливо

- неможливе

- вражений

- поліпшення

- in

- В інших

- Стимул

- включати

- включені

- У тому числі

- неймовірний

- неймовірно

- самостійно

- індивідуальний

- промислові

- промисловість

- Точка перегину

- інформація

- Інформаційний

- початковий

- інновації

- вхід

- натхнення

- натхненний

- замість

- взаємодіяти

- цікавий

- інтерфейс

- внутрішній

- інтернет

- перетин

- інтуїтивний

- Винайдений

- винаходи

- Invest

- інвестування

- інвестиції

- інвестиції

- Інвестори

- залучений

- питання

- Емітент

- питання

- IT

- італійська

- сам

- приєднатися

- приєднання

- подорож

- стрибати

- зберігання

- ключ

- Дитина

- Знати

- знання

- lab

- Labs

- мова

- мови

- великий

- масштабний

- більше

- останній

- запущений

- Законодавство

- шарів

- вести

- провідний

- стрибки

- УЧИТЬСЯ

- вчений

- вивчення

- Залишати

- догляд

- легальний

- довжина

- об'єктив

- здавати

- рівень

- життя

- Life Sciences

- Лінія

- LINK

- список

- Прослуховування

- трохи

- Місце проживання

- Довго

- подивитися

- шукати

- ВИГЛЯДИ

- серія

- любов

- улюблене

- машина

- навчання за допомогою машини

- машинний переклад

- Машинки для перманенту

- made

- підтримувати

- зробити

- РОБОТИ

- Робить

- вдалося

- управління

- манера

- багато

- масивний

- Матеріали

- математики

- Матерія

- Питання

- сенс

- засоби

- Меморандум

- пам'ять

- згаданий

- методика

- може бути

- mind

- видобувається

- ML

- модель

- Моделі

- сучасний

- молекули

- більше

- найбільш

- мотивовані

- рухатися

- руху

- переміщення

- ім'я

- а саме

- Природний

- Природна мова

- обов'язково

- необхідно

- Необхідність

- мережі

- мережу

- мереж

- Нейронний

- нейронні мережі

- Нові

- наступний

- шум

- примітки

- номер

- спостерігати

- отриманий

- пропонувати

- пропонує

- ONE

- відкрити

- Думка

- Думки

- оптимізація

- Опції

- порядок

- замовлень

- Інше

- інші

- загальний

- власний

- пар

- Папір

- парадигма

- Паралельні

- частина

- приватність

- особливо

- партнер

- частини

- партія

- пристрасний

- Минуле

- пластир

- Патчі

- шлях

- pacientes

- Викрійки

- Люди

- продуктивність

- period

- дозвіл

- людина

- Особисто

- Персонал

- явище

- ФІЛ

- Фізика

- трубопровід

- піксель

- місце

- місця

- plato

- Інформація про дані Платона

- PlatoData

- гравці

- будь ласка

- кишені

- Подкаст

- подкасти

- точка

- Точка зору

- Басейни

- портфель

- позиції

- це можливо

- потенціал

- потенційно

- влада

- Харчування

- потужний

- Практичний

- практика

- прагматичний

- точно

- прогноз

- Прогнози

- досить

- попередній

- раніше

- в першу чергу

- попередній

- приватний

- ймовірно

- Проблема

- проблеми

- процес

- процеси

- обробка

- Вироблений

- Product

- Production

- Продукти

- прибутковий

- проект

- Прогнози

- проектів

- обіцянку

- перспективний

- перспективи

- захищений

- Білок

- забезпечувати

- за умови

- публікаціям

- публічно

- опублікований

- Видавничий

- цілей

- put

- Поклавши

- питання

- питань

- радикально

- випадковий

- швидко

- швидко

- РІДНІ

- рейтинг

- досягати

- Читати

- читайте разом

- реальний

- Реальний світ

- зрозумів,

- розуміючи,

- Причини

- Рекомендація

- рецидив

- червоний

- зменшити

- зниження

- посилання

- називають

- режим

- пов'язаний

- доречний

- надійний

- залишатися

- запам'ятати

- Renaissance

- подання

- представник

- вимагати

- дослідження

- ресторан

- результати

- огляд

- відгуки

- перегляди

- Революція

- РНК

- прогін

- біг

- Зазначений

- то ж

- економія

- масштабованість

- шкала

- Масштабування

- Школа

- наука

- НАУКИ

- Наукове дослідження

- вчений

- Пошук

- Пошукові системи

- другий

- Securities

- безпеку

- бачачи

- Здається,

- старший

- сенс

- пропозиція

- Послідовність

- Послуги

- комплект

- набори

- установка

- кілька

- Поділитись

- зсув

- Короткий

- короткий термін

- Повинен

- Показувати

- значний

- аналогічний

- Аналогічно

- простий

- простота

- спростити

- спрощення

- одночасно

- з

- один

- Сидячий

- ситуація

- Розмір

- сповільнювати

- Повільно

- невеликий

- менше

- So

- так далеко

- ВИРІШИТИ

- деякі

- Хтось

- що в сім'ї щось

- кілька

- десь

- Скоро

- складний

- Джерела

- Простір

- Іскритися

- розмова

- Говорить

- конкретний

- конкретно

- специфічність

- відпрацьований

- стояти

- Станфорд

- старт

- почалася

- Починаючи

- введення в експлуатацію

- Стартапи

- впроваджений

- статистичний

- Крок

- заходи

- Як і раніше

- Історія

- вулиця

- сильний

- структурний

- структура

- Дослідження

- Вивчення

- каменем

- тема

- передплата

- процвітати

- такі

- достатній

- здивований

- система

- Systems

- таблиця

- Приймати

- Takeaways

- взяття

- балаканина

- говорити

- цільове

- цілі

- завдання

- податок

- команда

- технології

- технічний

- terms

- генерація тексту

- Команда

- Майбутнє

- інформація

- світ

- їх

- самі

- терапевтичні засоби

- Там.

- отже

- в ньому

- річ

- речі

- Мислення

- третя сторона

- думка

- тисячі

- три

- через

- по всьому

- пропускна здатність

- час

- times

- до

- сьогодні

- разом

- токенізувати

- Тон

- занадто

- інструмент

- інструменти

- теми

- торгував

- традиційний

- поїзд

- навчений

- Навчання

- Розшифровка

- Трансформатори

- перехід

- переводити

- Переклад

- трильйони

- правда

- турінг

- Опинився

- Типи

- Зрештою

- при

- що лежить в основі

- розуміти

- розуміння

- зрозуміла

- невикористані

- us

- використання

- вакцини

- значення

- Транспортні засоби

- торгові автомати

- перевірено

- дуже різноманітні

- Відео

- вид

- думки

- бачення

- хотів

- хвиля

- способи

- Web

- ласкаво просимо

- Що

- Що таке

- Чи

- який

- в той час як

- ВООЗ

- волі

- windows

- в

- без

- свідок

- спостереження

- чудовий

- слово

- слова

- Work

- робочий

- працює

- світ

- світі

- б

- запис

- лист

- Неправильно

- років

- вашу

- зефірнет