Veri mühendisliği giderek daha karmaşık hale geldikçe kuruluşlar, veri işleme iş akışlarını kolaylaştırmanın yeni yollarını arıyor. Günümüzde pek çok veri mühendisi veri hatlarını oluşturmak, planlamak ve izlemek için Apache Airflow'u kullanıyor.

Ancak veri hacmi büyüdükçe bu işlem hatlarını yönetmek ve ölçeklendirmek göz korkutucu bir görev haline gelebilir. Apache Airflow için Amazon Tarafından Yönetilen İş Akışları (Amazon MWAA), veri işlem hatlarını oluşturma, çalıştırma ve yönetme sürecini basitleştirmeye yardımcı olabilir. Amazon MWAA, Apache Airflow'u tam olarak yönetilen bir platform olarak sunarak veri mühendislerinin altyapı konusunda endişelenmek yerine veri iş akışları oluşturmaya odaklanmasına olanak tanır.

Günümüzde işletmeler ve kuruluşlar, büyük miktarda veriyi işlemek için uygun maliyetli ve verimli yöntemlere ihtiyaç duymaktadır. Amazon EMR Sunucusuz Büyük hacimli verileri işleyebilen büyük veri işlemeye yönelik uygun maliyetli ve ölçeklenebilir bir çözümdür. Apache Airflow'taki Amazon Sağlayıcısı, EMR Sunucusuz operatörlerle birlikte gelir ve halihazırda Amazon MWAA'ya dahil edilmiştir; bu da veri mühendislerinin ölçeklenebilir ve güvenilir veri işleme ardışık düzenleri oluşturmasını kolaylaştırır. Veriler üzerinde Spark işlerini çalıştırmak için EMR Serverless'ı kullanabilir ve bu işler arasındaki iş akışlarını ve bağımlılıkları yönetmek için Amazon MWAA'yı kullanabilirsiniz. Bu entegrasyon aynı zamanda verileri işlemek için gereken kaynakları otomatik olarak ölçeklendirerek maliyetlerin azaltılmasına da yardımcı olabilir.

Amazon Athena, açık kaynak çerçeveleri üzerine kurulu, açık tablo ve dosya formatlarını destekleyen sunucusuz, etkileşimli bir analiz hizmetidir. Verilerle etkileşimde bulunmak için standart SQL'i kullanabilirsiniz. Sunucusuz ve etkileşimli bir analiz hizmeti olan Athena, karmaşık altyapıyı yönetmeye gerek kalmadan bunu mümkün kılıyor.

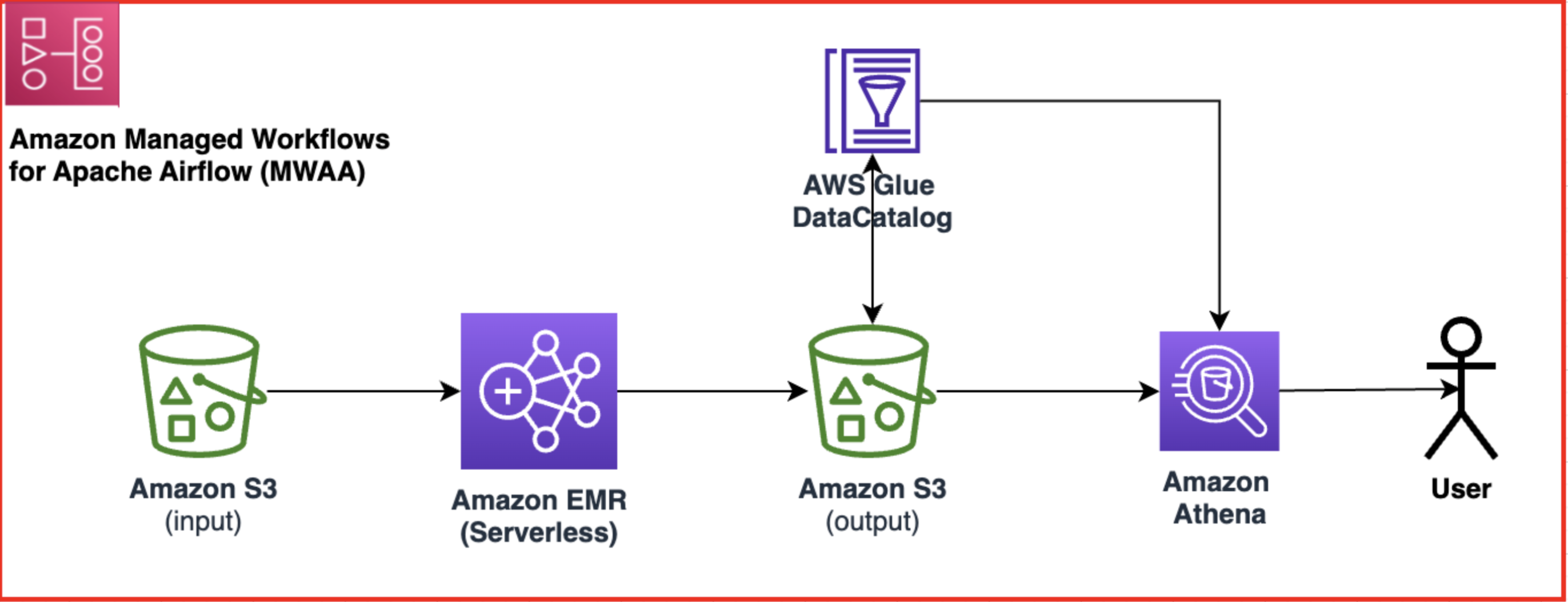

Bu yazıda eksiksiz bir uçtan uca veri işleme hattı oluşturmak için Amazon MWAA, EMR Serverless ve Athena'yı kullanıyoruz.

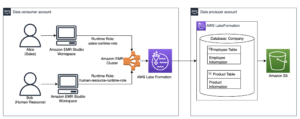

Çözüme genel bakış

Aşağıdaki şemada çözüm mimarisi gösterilmektedir.

İş akışı aşağıdaki adımları içerir:

- Girişinizden veri alan bir Amazon MWAA iş akışı oluşturun Amazon Basit Depolama Hizmeti (Amazon S3) kovası.

- Amazon S3'te depolanan verileri işlemek için EMR Serverless'ı kullanın. EMR Serverless, iş yüküne bağlı olarak ölçeği otomatik olarak artırır veya azaltır; böylece herhangi bir altyapının sağlanması veya yönetilmesi konusunda endişelenmenize gerek kalmaz.

- Verileri PySpark kodunu kullanarak dönüştürmek için EMR Serverless'ı kullanın ve ardından dönüştürülen verileri tekrar S3 klasörünüzde saklayın.

- S3 veri kümesini temel alan harici bir tablo oluşturmak ve dönüştürülen verileri analiz etmek üzere sorgular çalıştırmak için Athena'yı kullanın. Athena bunu kullanıyor AWS Tutkal Tablo meta verilerini depolamak için Veri Kataloğu.

Önkoşullar

Aşağıdaki ön koşullara sahip olmalısınız:

Veri Hazırlama

Amazon MWAA aracılığıyla Apache Spark ile EMR Sunucusuz işlerin kullanımını ve Athena kullanarak veri doğrulamayı göstermek için halka açık NYC taksi veri kümesini kullanıyoruz. Aşağıdaki veri kümelerini yerel makinenize indirin:

- Yeşil taksi ve Sarı taksi yolculuk kayıtları – Sarı ve yeşil taksilerin biniş ve bırakılma tarih ve saatleri, konumları, yolculuk mesafeleri ve ödeme türleri gibi bilgileri içeren yolculuk kayıtları. Örneğimizde 2022 yılına ait en güncel Parke dosyalarını kullanıyoruz.

- Taksi bölgesi araması için veri kümesi – Taksiler için konum kimliklerini ve ilgili bölge ayrıntılarını sağlayan bir veri kümesi.

Daha sonraki adımlarda bu veri kümelerini Amazon S3'e yüklüyoruz.

Çözüm kaynakları oluşturun

Bu bölümde veri işleme ve dönüştürmeyi ayarlama adımları özetlenmektedir.

EMR Sunucusuz uygulama oluşturma

Apache Spark veya Apache Hive gibi açık kaynak analiz çerçevelerini kullanan bir veya daha fazla EMR Sunucusuz uygulama oluşturabilirsiniz. EC2'deki EMR'den farklı olarak EMR Sunucusuz uygulamalarını silmeniz veya sonlandırmanız gerekmez. EMR Serverless uygulaması yalnızca bir tanımdır ve oluşturulduktan sonra ihtiyaç duyulduğu sürece tekrar kullanılabilir. Bu, artık işleri önceden oluşturulmuş bir EMR Sunucusuz uygulamaya göndermeniz gerektiğinden MWAA hattını daha basit hale getiriyor.

Varsayılan olarakEMR Sunucusuz uygulaması, maliyet verimliliği sağlamak için varsayılan olarak iş gönderiminde otomatik olarak başlayacak ve 15 dakika boşta kaldığında otomatik olarak duracaktır. Boşta kalma süresi miktarını değiştirebilir veya özelliği kapatmayı seçebilirsiniz.

EMR Sunucusuz konsolunu kullanarak uygulama oluşturmak için “ bölümündeki talimatları izleyin.EMR Sunucusuz uygulama oluşturma anlayışının sonucu olarak, buzdolabında iki üç günden fazla durmayan küçük şişeler elinizin altında bulunur. Aşağıdaki adımlarda kullanacağımız için uygulama kimliğini not edin.

![]()

Bir S3 paketi ve klasörler oluşturun

S3 klasörünüzü ve klasörlerinizi ayarlamak için aşağıdaki adımları tamamlayın:

- Amazon S3 konsolunda, S3 paketi oluştur veri kümesini saklamak için.

- Daha sonraki adımlarda kullanmak üzere S3 paketinin adını not edin.

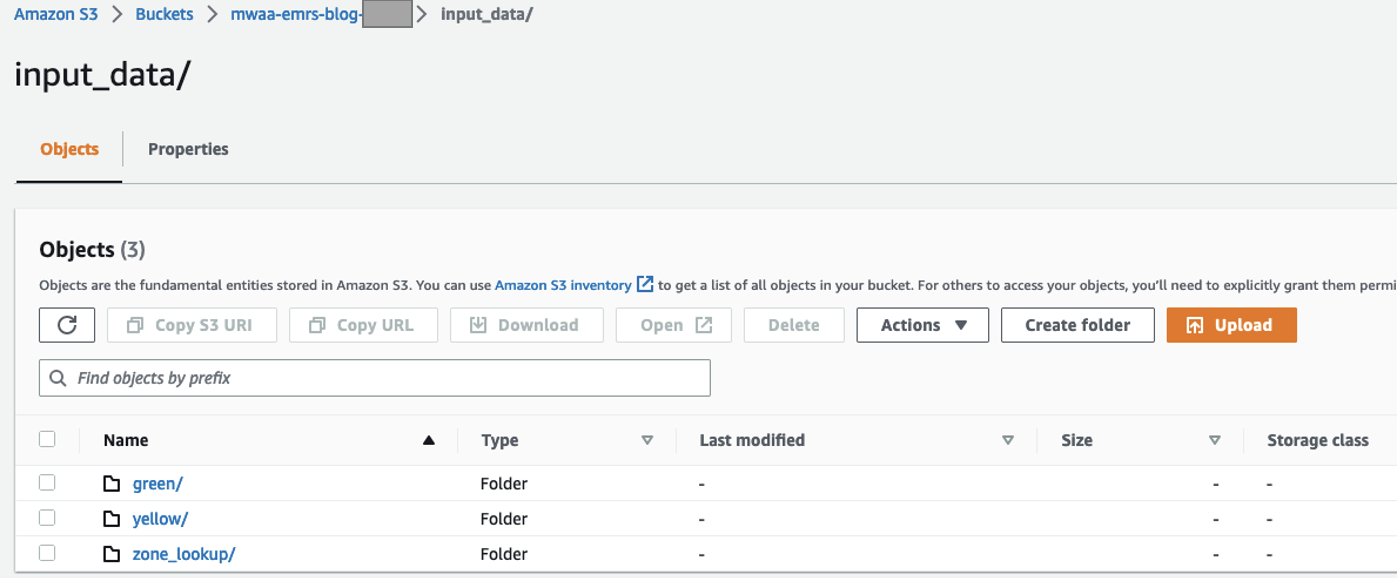

- Bir oluşturma

input_dataGiriş verilerini depolamak için klasör. - Bu klasör içinde, her veri kümesi için bir tane olmak üzere üç ayrı klasör oluşturun:

green,yellow, vezone_lookup.

Mevcut en yeni veri kümelerini indirebilir ve bunlarla çalışabilirsiniz. Testlerimiz için aşağıdaki dosyaları kullanıyoruz:

- The

green/klasörde dosya vargreen_tripdata_2022-06.parquet - The

yellow/klasörde dosya varyellow_tripdata_2022-06.parquet - The

zone_lookup/klasörde dosya vartaxi_zone_lookup.csv

Amazon MWAA DAG komut dosyalarını ayarlama

DAG komut dosyalarınızı ayarlamak için aşağıdaki adımları tamamlayın:

- Aşağıdaki komut dosyalarını yerel makinenize indirin:

- gereksinimler.txt – Python bağımlılığı, Amazon MWAA ortamınızdaki Apache Airflow sürümünüz için Apache Airflow temel kurulumuna dahil olmayan herhangi bir paket veya dağıtımdır. Bu yazı için Boto3 kullanıyoruz

version >=1.23.9. - blog_dag_mwaa_emrs_ny_taxi.py – Bu komut dosyası Amazon MWAA DAG'ın bir parçasıdır ve aşağıdaki görevlerden oluşur:

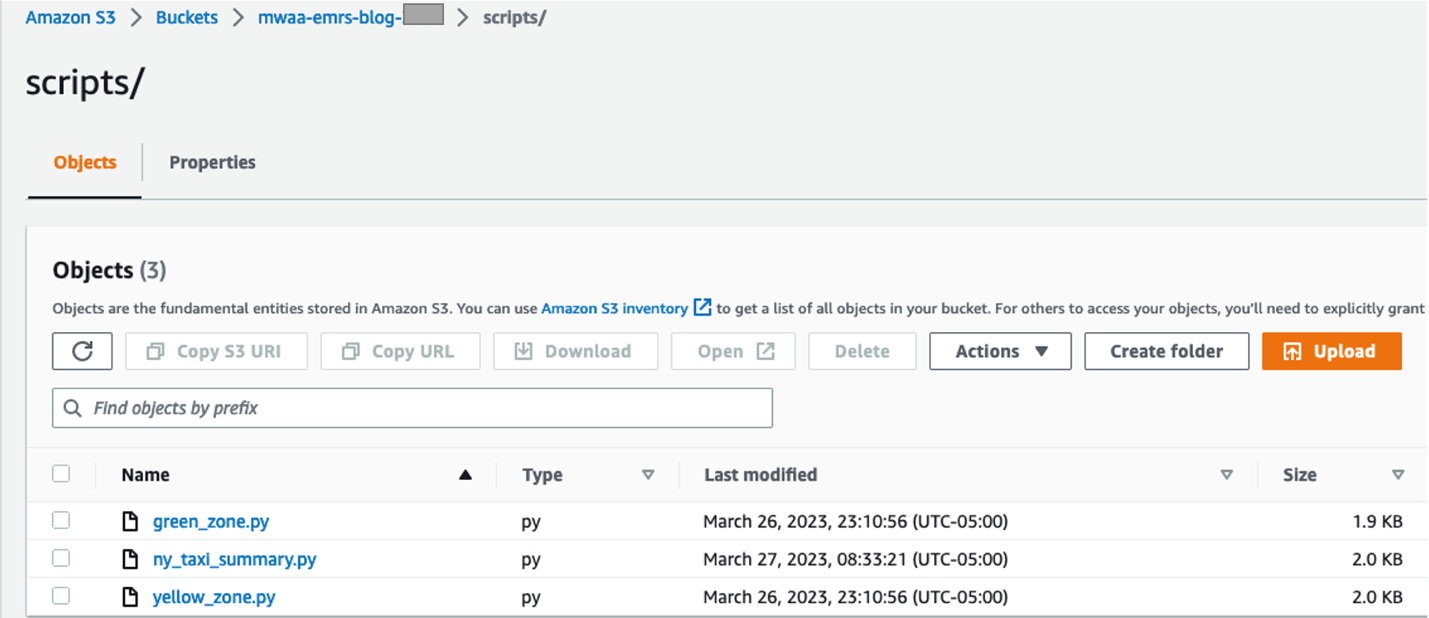

yellow_taxi_zone_lookup,green_taxi_zone_lookup, veny_taxi_summary,. Bu görevler, Spark işlerinin taksi bölgelerini aramak için çalıştırılmasını ve bir veri özeti oluşturulmasını içerir. - green_zone.py – Bu PySpark betiği, yeşil taksi yolculukları ve bölge araması için veri dosyalarını okur, bunları birleştirmek için bir birleştirme işlemi gerçekleştirir ve bölge bilgisine sahip yeşil taksi yolculuklarını içeren bir çıktı dosyası oluşturur. için geçici görünümlerden yararlanır.

df_greenvedf_zoneveri çerçeveleri oluşturur, sütun bazlı birleştirmeler gerçekleştirir ve yolcu sayısı, yolculuk mesafesi ve ücret tutarı gibi verileri toplar. Son olarak şunu yaratır:output_dataortaya çıkan veri çerçevesini yazmak için belirtilen S3 klasöründeki klasör,df_green_zone, Parke dosyaları olarak. - Yellow_zone.py – Bu PySpark betiği, sarı taksi yolculuğu ve bölge arama veri dosyalarını, bölge bilgisine sahip sarı taksi yolculuklarını içeren bir çıktı dosyası oluşturmak için bunları birleştirerek işler. Betik, kullanıcı tarafından sağlanan bir S3 klasör adını kabul eder ve uygulama adıyla bir Spark oturumu başlatır.

yellow_zone. Belirtilen S3 klasöründeki sarı taksi dosyalarını ve bölge arama dosyasını okur, geçici görünümler oluşturur, konum kimliğine göre birleştirme gerçekleştirir ve yolcu sayısı, yolculuk mesafesi ve ücret tutarı gibi istatistikleri hesaplar. Son olarak şunu yaratır:output_dataortaya çıkan veri çerçevesini yazmak için belirtilen S3 klasöründeki klasör,df_yellow_zone, Parke dosyaları olarak. - ny_taxi_summary.py – Bu PySpark betiği şunları işler:

green_zoneveyellow_zoneTaksi yolculuklarına ilişkin istatistikleri toplamak, verileri hizmet bölgelerine ve konum kimliklerine göre gruplamak için dosyalar. Komut satırı bağımsız değişkeni olarak bir S3 klasör adı gerektirir, adında bir SparkSession oluşturur.ny_taxi_summary, S3'teki dosyaları okur, bir birleştirme gerçekleştirir ve adlı yeni bir veri çerçevesi oluşturur.ny_taxi_summary. Ortaya çıkan veri çerçevesini yeni Parquet dosyalarına yazmak için belirtilen S3 klasöründe bir Output_data klasörü oluşturur.

- gereksinimler.txt – Python bağımlılığı, Amazon MWAA ortamınızdaki Apache Airflow sürümünüz için Apache Airflow temel kurulumuna dahil olmayan herhangi bir paket veya dağıtımdır. Bu yazı için Boto3 kullanıyoruz

- Yerel makinenizde güncelleyin

blog_dag_mwaa_emrs_ny_taxi.pyaşağıdaki bilgileri içeren komut dosyası:- S3 klasörünüzün adını aşağıdaki iki satırda güncelleyin:

- ARN rol adınızı güncelleyin:

- EMR Sunucusuz Uygulama Kimliğini güncelleyin. Daha önce oluşturulan Uygulama Kimliğini kullanın.

- Yükle

requirements.txtdosyayı daha önce oluşturulan S3 klasörüne aktarın

- S3 klasöründe adlı bir klasör oluşturun.

dagsve güncelleneni yükleyinblog_dag_mwaa_emrs_ny_taxi.pyYerel makinenizden dosya.

- Amazon S3 konsolunda adlı yeni bir klasör oluşturun.

scriptsS3 klasörüne yerleştirin ve komut dosyalarını yerel makinenizden bu klasöre yükleyin.

Bir Amazon MWAA ortamı oluşturun

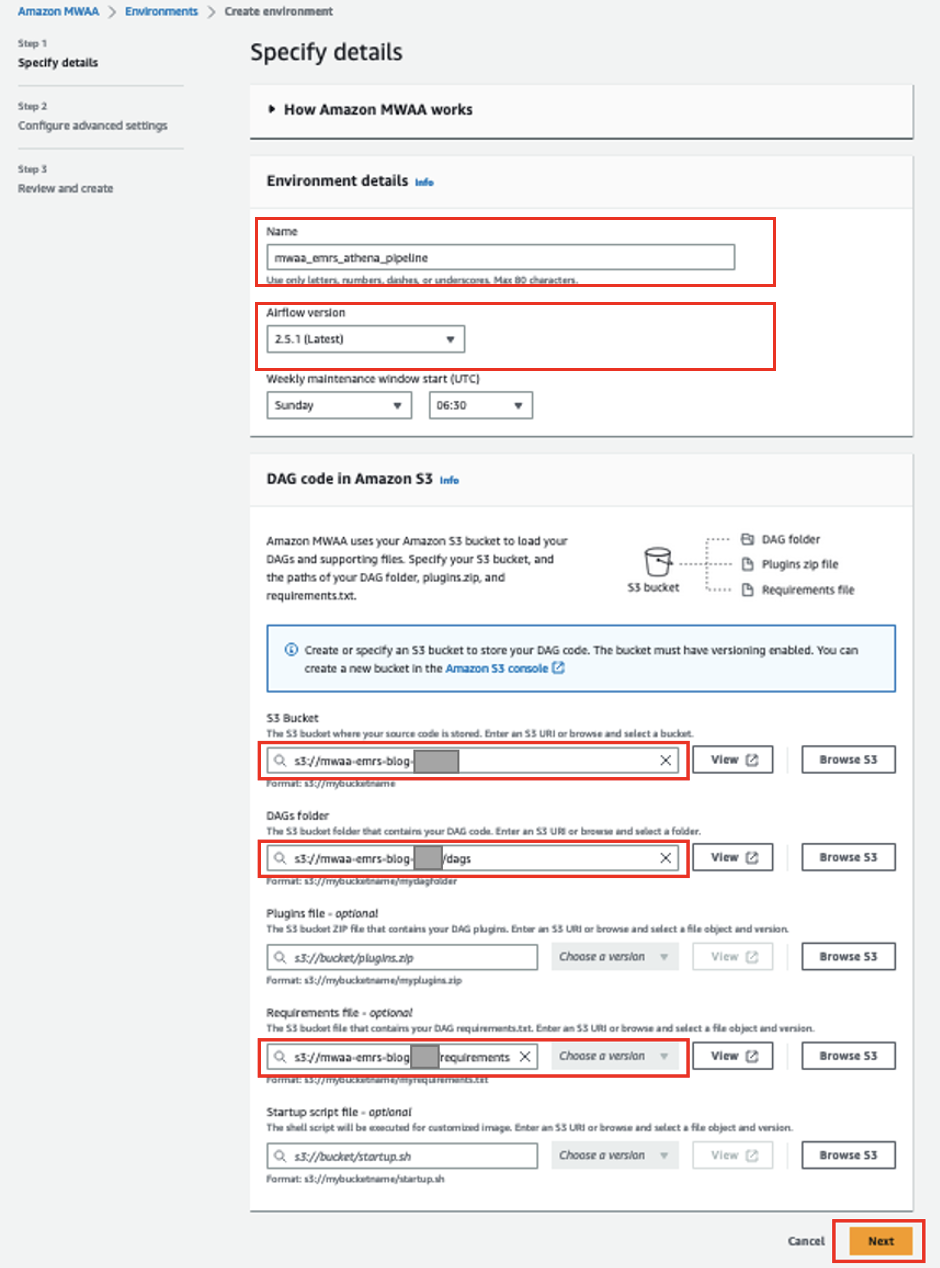

Airflow ortamı oluşturmak için aşağıdaki adımları tamamlayın:

- Amazon MWAA konsolunda şunu seçin: Ortam oluştur.

- İçin Name, girmek

mwaa_emrs_athena_pipeline. - İçin Hava akımı versiyonu, en son sürümü seçin (bu yazı için 2.5.1).

- İçin S3 Kova, S3 klasörünüze giden yolu girin.

- İçin DAG'ler klasörü, size giden yolu girin

dagsklasör. - İçin Gereksinimler dosyası, yolunu girin

requirements.txtdosyası. - Klinik Sonraki.

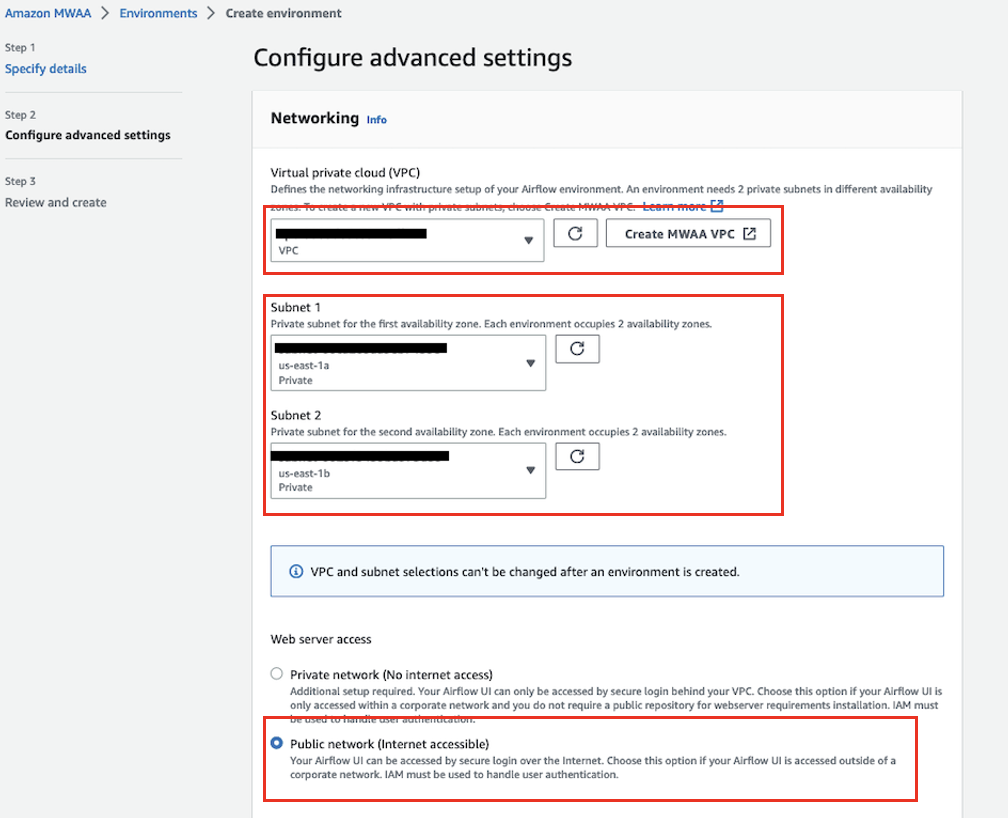

- İçin Sanal özel bulut (VPC), en az iki özel alt ağa sahip bir VPC seçin.

Bu, VPC'nizdeki özel alt ağlardan ikisini dolduracaktır.

- Altında Web sunucusu erişimiseçin Genel ağ.

Bu, Apache Airflow kullanıcı arayüzüne, erişim izni verilen kullanıcılar tarafından internet üzerinden erişilebilmesini sağlar. Ortamınız için IAM politikası.

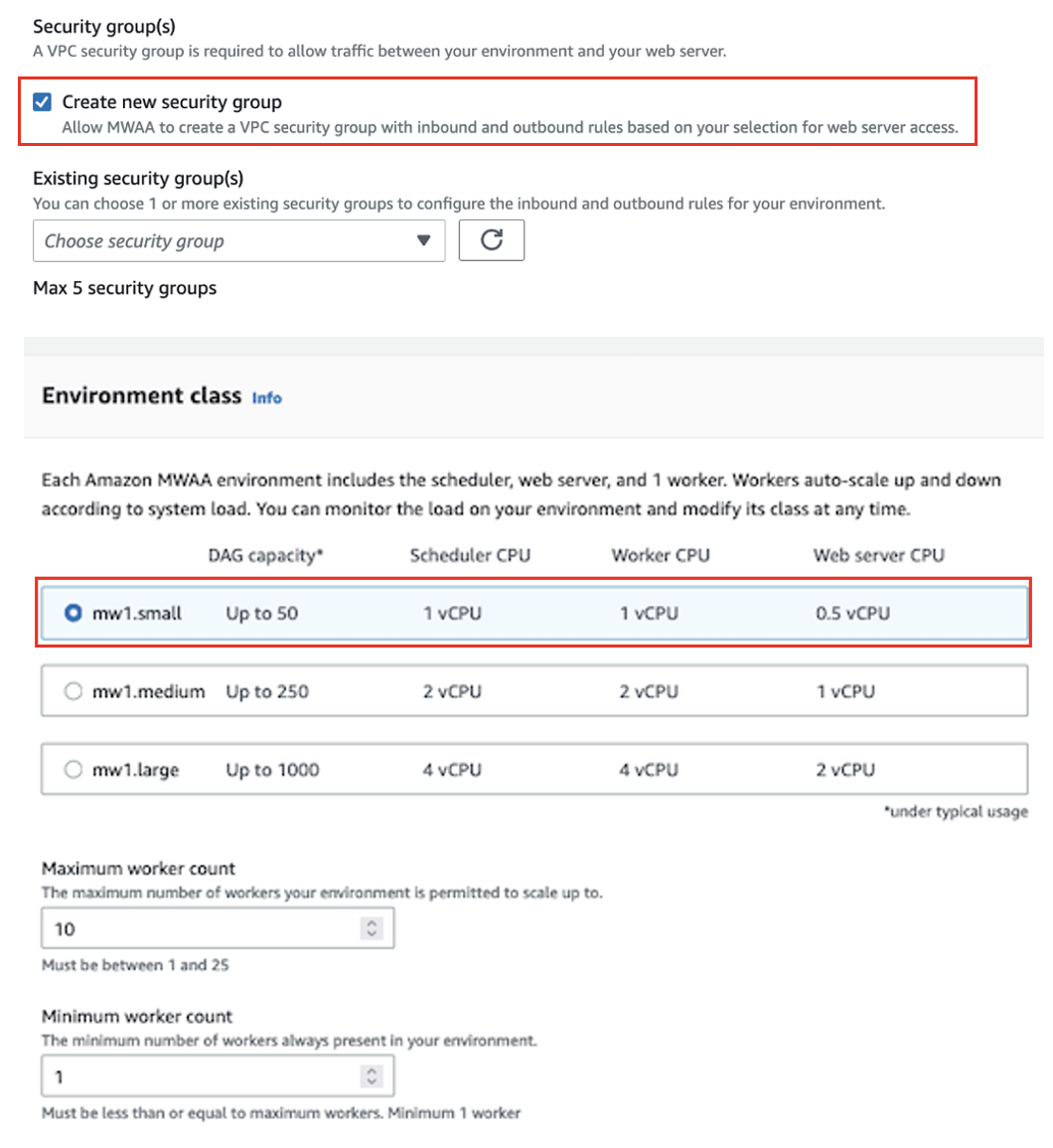

- İçin Güvenlik gruplarıseçin Yeni güvenlik grubu oluştur.

- İçin çevre sınıfıseçin mw1.küçük.

- İçin Yürütme rolü, seçmek Yeni bir rol oluştur.

- İçin Rol ismi, isim girin.

- Diğer yapılandırmaları varsayılan olarak bırakın ve Sonraki.

- Bir sonraki sayfada, seçin oluşturmak çevre.

Amazon MWAA ortamınızı oluşturmak yaklaşık 20-30 dakika sürebilir.

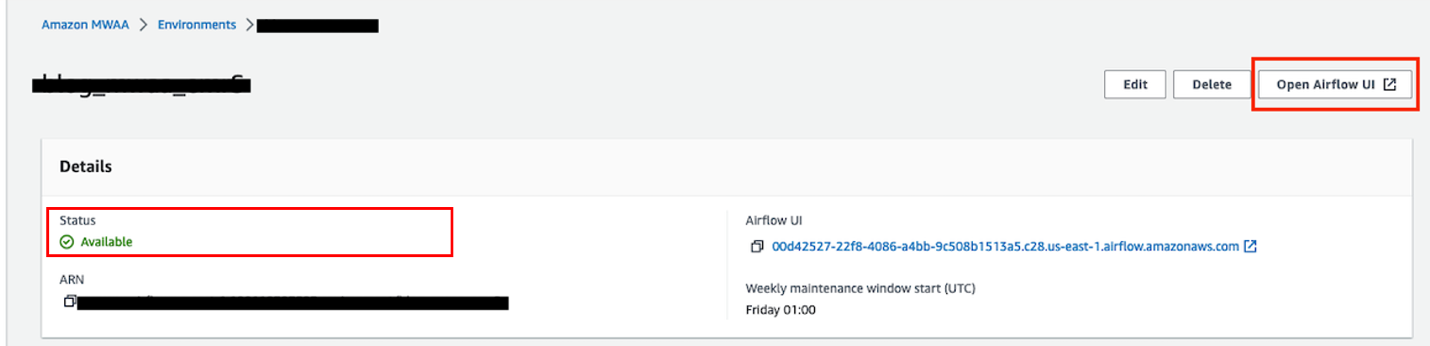

- Amazon MWAA ortam durumu olarak değiştiğinde Mevcut, IAM konsoluna gidin ve eklemek için küme yürütme rolünü güncelleyin rol ayrıcalıklarını geçirme için

emr_serverless_execution_role.

Amazon MWAA DAG'ı tetikleyin

DAG'yi tetiklemek için aşağıdaki adımları tamamlayın:

- Amazon MWAA konsolunda şunu seçin: <span style="font-size:14px;">ortamları</span> Gezinti bölmesinde.

- Ortamınızı açın ve seçin Hava Akışı Kullanıcı Arayüzünü Aç.

- seç

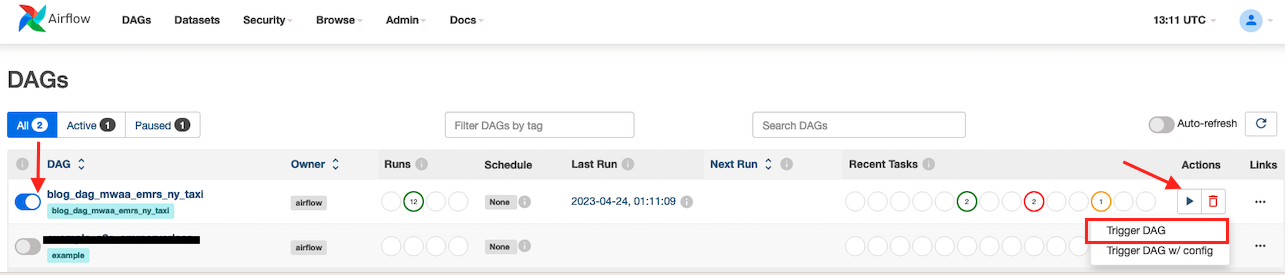

blog_dag_mwaa_emr_ny_taxi, oynat simgesini seçin ve Tetikleyici DAG.

- DAG çalışırken DAG'ı seçin

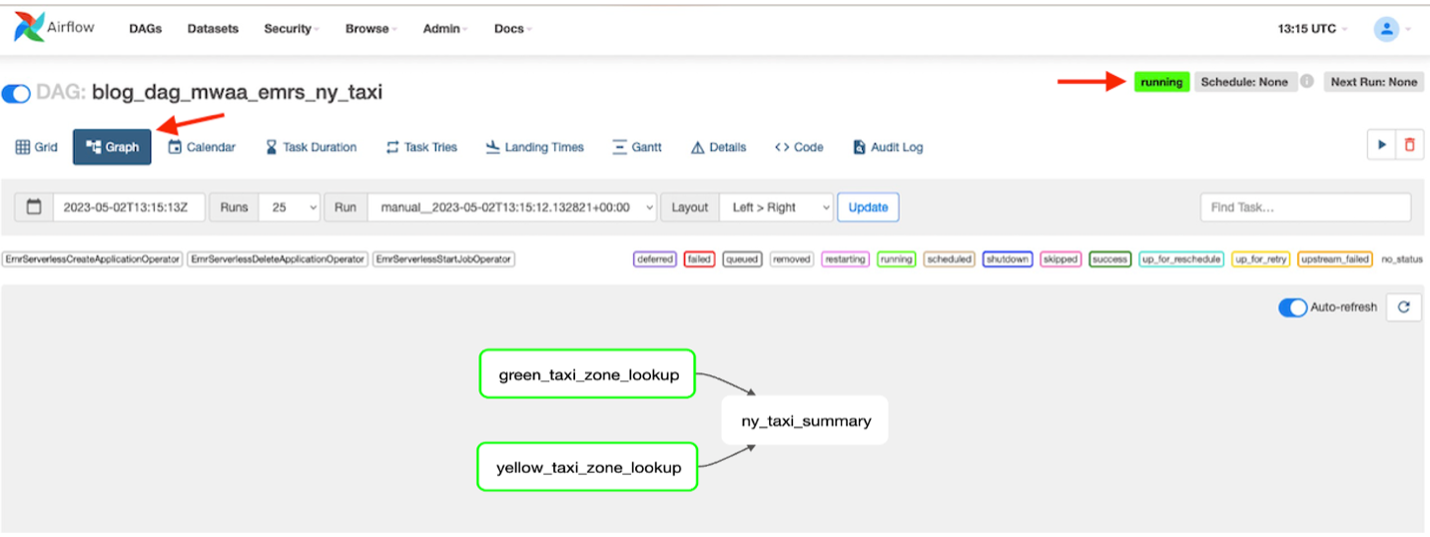

blog_dag_mwaa_emrs_ny_taxiVe seç grafik DAG çalıştırma iş akışınızı bulmak için.

DAG'ın tüm komut dosyalarını çalıştırması yaklaşık 4-6 dakika sürecektir. Tüm tamamlanmış görevleri göreceksiniz ve DAG'ın genel durumu şu şekilde gösterilecektir: başarı.

DAG'yi yeniden çalıştırmak için kaldırın s3://<<your_s3_bucket here >>/output_data/.

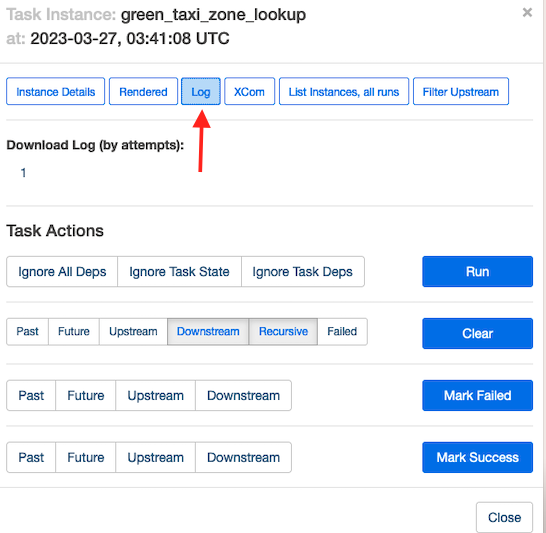

İsteğe bağlı olarak Amazon MWAA'nın bu görevleri nasıl çalıştırdığını anlamak için incelemek istediğiniz görevi seçin.

Klinik koşmak Görev çalıştırma ayrıntılarını görüntülemek için.

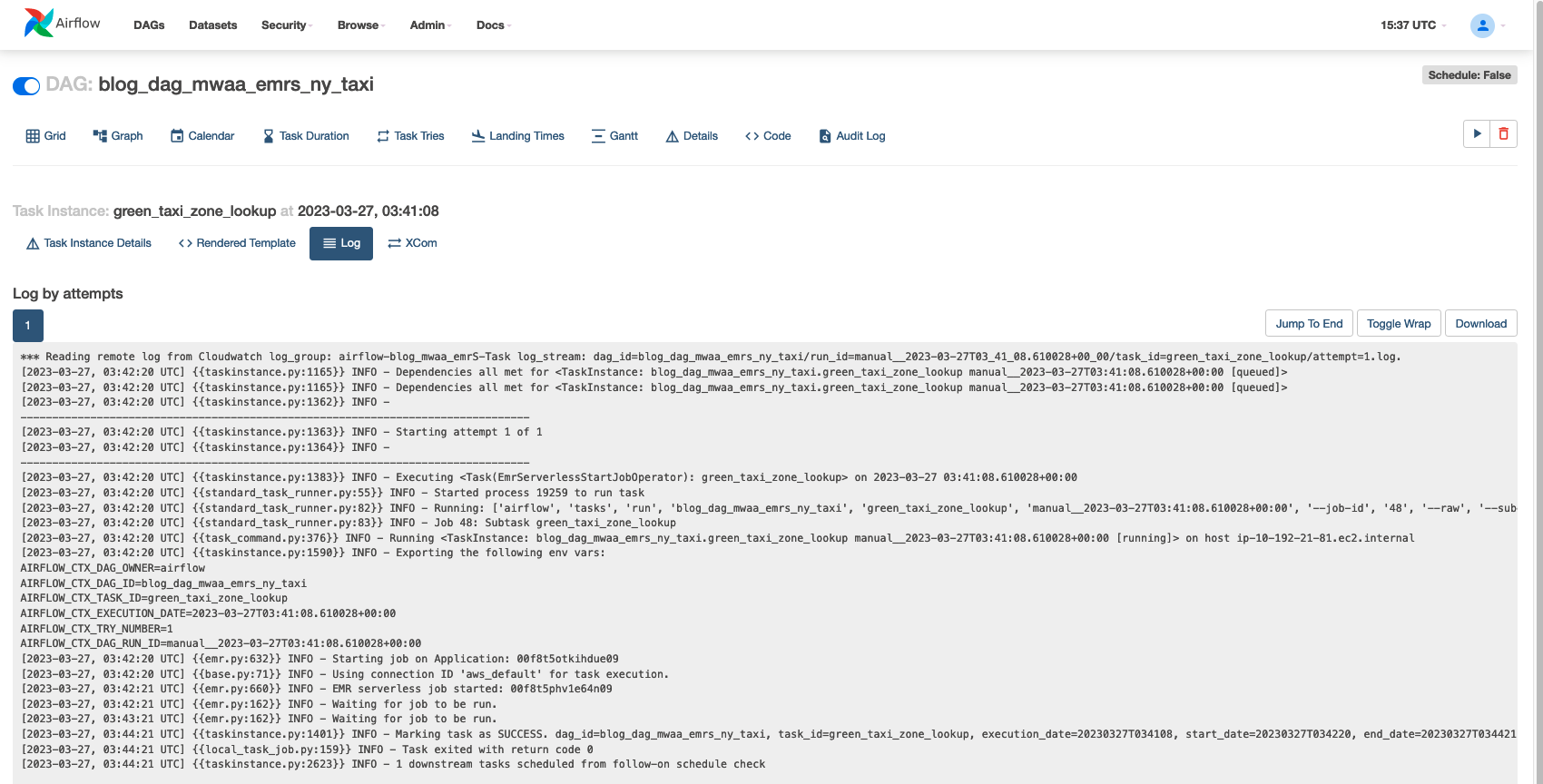

Aşağıdaki ekran görüntüsünde görev günlüklerinin bir örneği gösterilmektedir.

Yürütme günlüklerinin derinliklerine dalmak istiyorsanız EMR Sunucusuz konsolunda "Uygulamalar"a gidin. Apache Spark sürücü günlükleri, EMR Serverless tarafından oluşturulan uygulayıcılara, aşamalara ve görevlere ilişkin ayrıntıların yanı sıra işinizin başlangıcını da gösterecektir. Bu günlükler iş ilerlemenizi izlemenize ve arızaları gidermenize yardımcı olabilir.

Varsayılan olarak EMR Serverless, uygulama günlüklerini Amazon EMR tarafından yönetilen depolama alanında 30 günlük bir süre boyunca güvenli bir şekilde saklar. Ancak şunu da belirtebilirsiniz: Amazon S3 veya Amazon CloudWatch iş gönderimi sırasında günlük teslim seçenekleriniz olarak.

Nihai sonuç kümesini Athena ile doğrulayın

İşlemin yüklediği verileri Athena SQL sorgularını kullanarak doğrulayalım.

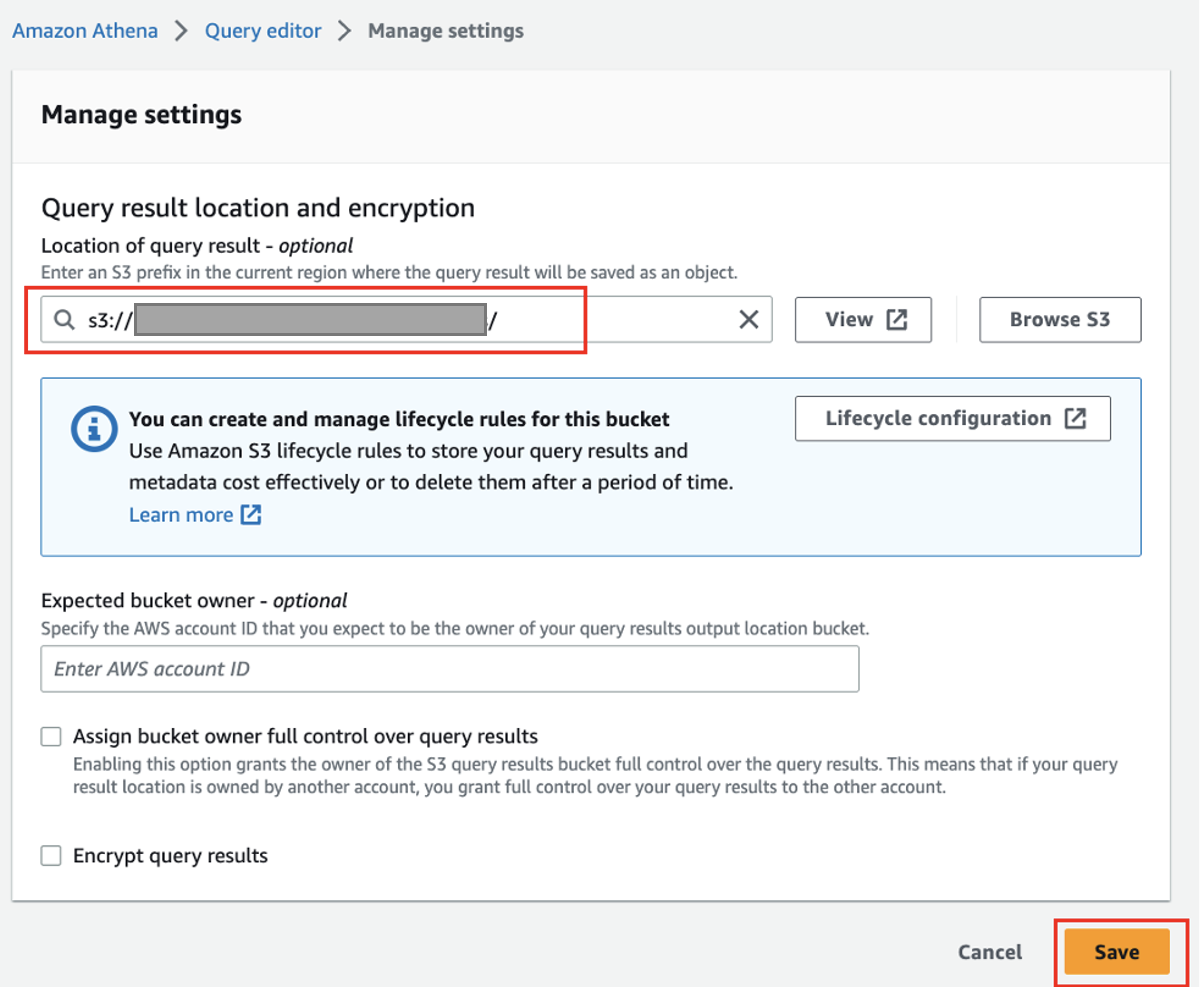

- Athena konsolunda, seçin sorgu düzenleyici Gezinti bölmesinde.

- Athena'yı ilk kez kullanıyorsanız, Ayarlar, seçmek Yönet ve daha önce oluşturduğunuz S3 grup konumunu girin (

<S3_BUCKET_NAME>/athena), ardından İndirim.

- Harici bir tablo oluşturmak için sorgu düzenleyicide aşağıdaki sorguyu girin:

Son oluşturulan sorguda aşağıdaki sorguyu çalıştırın ny_taxi_summary verileri doğrulamak için ilk 10 satırı almak için tablo:

Temizlemek

Gelecekteki ödemeleri önlemek için aşağıdaki adımları tamamlayın:

- Amazon S3 konsolunda Amazon MWAA DAG'ı, komut dosyalarını ve günlükleri depolamak için oluşturduğunuz S3 klasörünü silin.

- Athena konsolunda oluşturduğunuz tabloyu bırakın:

- Amazon MWAA konsolunda oluşturduğunuz ortama gidin ve Sil.

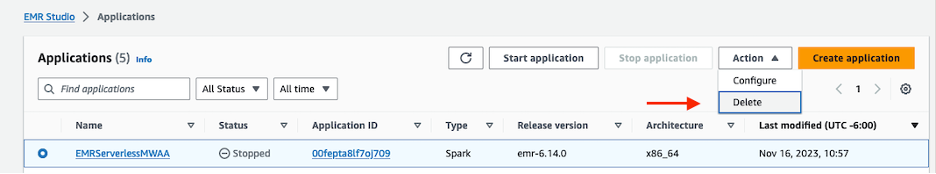

- EMR Studio konsolunda uygulamayı silin.

Uygulamayı silmek için şuraya gidin: Uygulamaları listeleyin sayfa. Oluşturduğunuz uygulamayı seçin ve Eylemler → Durdur uygulamayı durdurmak için. Uygulama DURDURULDU durumuna geçtikten sonra aynı uygulamayı seçin ve Eylemler → Sil.

Sonuç

Veri mühendisliği birçok kuruluşun kritik bir bileşenidir ve veri hacimleri büyümeye devam ettikçe veri işleme iş akışlarını kolaylaştırmanın yollarını bulmak hayati önem taşır. Amazon MWAA, EMR Serverless ve Athena'nın birleşimi, veri işlem hatlarını verimli bir şekilde oluşturmak, çalıştırmak ve yönetmek için güçlü bir çözüm sunar. Bu uçtan uca veri işleme hattıyla veri mühendisleri, karmaşık altyapıyı yönetmeye gerek kalmadan büyük miktardaki verileri hızlı ve uygun maliyetli bir şekilde kolayca işleyebilir ve analiz edebilir. Bu AWS hizmetlerinin entegrasyonu, veri işleme için sağlam ve ölçeklenebilir bir çözüm sunarak kuruluşların veri öngörülerine dayanarak bilinçli kararlar almasına yardımcı olur.

Artık Spark işlerini Amazon MWAA aracılığıyla EMR Sunucusuz'a nasıl göndereceğinizi gördüğünüze göre, PySpark işlerini EMR Sunucusuz aracılığıyla çalıştıracak bir iş akışı oluşturmak için Amazon MWAA'yı kullanmanızı öneririz.

Geri bildirimlerinizi ve sorularınızı memnuniyetle karşılıyoruz. Herhangi bir sorunuz veya yorumunuz varsa lütfen bizimle iletişime geçmekten çekinmeyin.

yazarlar hakkında

Rahul Sonawane uzmanlık alanı AI/ML ve Analytics olan AWS'de Ana Analitik Çözümleri Mimarıdır.

Rahul Sonawane uzmanlık alanı AI/ML ve Analytics olan AWS'de Ana Analitik Çözümleri Mimarıdır.

Gaurav Parekh AWS müşterilerinin büyük ölçekli modern mimari oluşturmasına yardımcı olan bir Çözüm Mimarıdır. Veri analitiği ve ağ oluşturma konusunda uzmandır. Gaurav iş dışında kriket, futbol ve voleybol oynamayı seviyor.

Gaurav Parekh AWS müşterilerinin büyük ölçekli modern mimari oluşturmasına yardımcı olan bir Çözüm Mimarıdır. Veri analitiği ve ağ oluşturma konusunda uzmandır. Gaurav iş dışında kriket, futbol ve voleybol oynamayı seviyor.

Denetim Geçmişi

Aralık 2023: Bu gönderi, teknik doğruluk açısından Kıdemli Teknik Hesap Yöneticisi Santosh Gantaram tarafından incelendi.

- SEO Destekli İçerik ve Halkla İlişkiler Dağıtımı. Bugün Gücünüzü Artırın.

- PlatoData.Network Dikey Üretken Yapay Zeka. Kendine güç ver. Buradan Erişin.

- PlatoAiStream. Web3 Zekası. Bilgi Genişletildi. Buradan Erişin.

- PlatoESG. karbon, temiz teknoloji, Enerji, Çevre, Güneş, Atık Yönetimi. Buradan Erişin.

- PlatoSağlık. Biyoteknoloji ve Klinik Araştırmalar Zekası. Buradan Erişin.

- Kaynak: https://aws.amazon.com/blogs/big-data/orchestrate-amazon-emr-serverless-spark-jobs-with-amazon-mwaa-and-data-validation-using-amazon-athena/

- :vardır

- :dır-dir

- :olumsuzluk

- $UP

- 1

- 10

- 100

- 118

- İNDİRİM

- 16

- 2022

- 2023

- 23

- 25

- 30

- 300

- 7

- 700

- 8

- 9

- 990

- a

- Hakkımızda

- Kabul eder

- erişim

- erişilen

- Hesap

- doğruluk

- eklemek

- Sonra

- toplam

- AI / ML

- Türkiye

- veriyor

- boyunca

- zaten

- Ayrıca

- Amazon

- Amazon Atina

- Amazon EMR'si

- Amazon Web Servisleri

- miktar

- tutarları

- an

- analytics

- çözümlemek

- ve

- herhangi

- Apache

- Apache Spark

- Uygulama

- uygulamaları

- yaklaşık olarak

- mimari

- ARE

- ALAN

- tartışma

- AS

- At

- otomatik olarak

- mevcut

- AWS

- Arka

- baz

- merkezli

- BE

- müşterimiz

- olur

- arasında

- Büyük

- büyük Veri

- inşa etmek

- bina

- yapılı

- işletmeler

- by

- hesaplar

- CAN

- katalog

- değişiklik

- değişiklikler

- yükler

- Klinik

- sınıflandırma

- bulut

- Küme

- kod

- kombinasyon

- birleştirmek

- geliyor

- yorumlar

- tamamlamak

- karmaşık

- bileşen

- oluşur

- konsolos

- devam etmek

- uyan

- Ücret

- uygun maliyetli

- maliyetler

- yaratmak

- çevrimiçi kurslar düzenliyorlar.

- oluşturur

- kriket

- kritik

- Müşteriler

- DAG

- veri

- Veri Analizi

- veri işleme

- veri kümeleri

- Tarih

- Günler

- kararlar

- derin

- Varsayılan

- tanım

- teslim

- bağımlılıklar

- Bağımlılık

- ayrıntılar

- mesafe

- dağıtım

- dalış

- do

- Dont

- çift

- aşağı

- indir

- sürücü

- Damla

- sırasında

- e

- her

- Daha erken

- kolayca

- kolay

- editör

- verim

- verimli

- verimli biçimde

- teşvik etmek

- son uca

- Mühendislik

- Mühendisler

- sağlamak

- Keşfet

- çevre

- gerekli

- Eter (ETH)

- örnek

- infaz

- dış

- ekstra

- hataları

- Özellikler(Hazırlık aşamasında)

- geribesleme

- hissetmek

- fileto

- dosyalar

- son

- bulmak

- Ad

- ilk kez

- odak

- takip et

- takip etme

- İçin

- biçim

- ÇERÇEVE

- çerçeveler

- Ücretsiz

- itibaren

- tamamen

- gelecek

- oluşturmak

- üretir

- üreten

- verilmiş

- Yeşil

- Büyümek

- Büyür

- Hadoop'un

- sap

- Var

- he

- yardım et

- faydalı

- yardım

- okuyun

- onun

- kovan

- Ne kadar

- Nasıl Yapılır

- Ancak

- HTML

- http

- HTTPS

- IAM

- ICON

- ID

- boş

- kimlikleri

- if

- örneklemek

- göstermektedir

- in

- dahil

- dahil

- içerir

- giderek

- belirtmek

- bilgi

- bilgi

- Altyapı

- Başlattı

- başlatma

- giriş

- Araştırma

- içeride

- anlayışlar

- kurmak

- yerine

- talimatlar

- bütünleşme

- etkileşim

- interaktif

- Internet

- dahil

- IT

- İş

- Mesleki Öğretiler

- kaydol

- birleştirme

- Katıldı

- jpg

- sadece

- büyük

- son olarak

- sonra

- son

- sevmek

- LİMİT

- çizgi

- hatları

- yerel

- yer

- yerleri

- log

- Uzun

- bakıyor

- arama

- makine

- yapmak

- YAPAR

- Yapımı

- yönetmek

- yönetilen

- müdür

- yönetme

- çok

- Mayıs..

- Metadata

- asgari

- dakika

- Modern

- değiştirmek

- izlemek

- Daha

- isim

- adlı

- Gezin

- Navigasyon

- gerek

- gerekli

- ağ

- yeni

- sonraki

- Hayır

- şimdi

- NYC

- of

- kapalı

- on

- bir Zamanlar

- ONE

- bir tek

- açık

- açık kaynak

- operasyon

- operatörler

- Opsiyonlar

- or

- organizasyonlar

- Diğer

- bizim

- dışarı

- ana hatlar

- çıktı

- dışında

- tekrar

- tüm

- paket

- Kanal

- bölmesi

- Bölüm

- yol

- ödeme

- gerçekleştirir

- dönem

- boru hattı

- platform

- Platon

- Plato Veri Zekası

- PlatoVeri

- OYNA

- oynama

- Lütfen

- politika

- mümkün

- Çivi

- güçlü

- önkoşullar

- önlemek

- Anapara

- özel

- süreç

- Süreçler

- işleme

- Ilerleme

- sağlayan

- sağlar

- sağlama

- alenen

- Python

- sorgular

- Sorular

- hızla

- ulaşmak

- geçenlerde

- kayıtlar

- azaltmak

- güvenilir

- Kaldır

- gerektirir

- gerektirir

- Kaynaklar

- sonuç

- Ortaya çıkan

- Yorumlar

- Binmek

- gezintileri

- gürbüz

- Rol

- SIRA

- koşmak

- koşu

- ishal

- s

- aynı

- ölçeklenebilir

- ölçek

- terazi

- ölçekleme

- program

- senaryo

- scriptler

- Bölüm

- Güvenli

- güvenlik

- görmek

- görüldü

- seçmek

- ayrı

- sunucu

- Serverless

- hizmet

- Hizmetler

- Oturum

- set

- ayar

- meli

- şov

- Gösteriler

- Basit

- basitleştirmek

- So

- Futbol

- çözüm

- Çözümler

- Kaynak

- Kıvılcım

- uzmanlaşmış

- Uzmanlık

- Belirtilen

- SQL

- aşamaları

- standart

- Eyalet

- istatistik

- Durum

- Basamaklar

- dur

- durdu

- hafızası

- mağaza

- saklı

- kolaylaştırmak

- dizi

- stüdyo

- boyun eğme

- sunmak

- altağlar

- böyle

- ÖZET

- Destek

- tablo

- Bizi daha iyi tanımak için

- Görev

- görevleri

- Teknik

- geçici

- Test yapmak

- o

- The

- ve bazı Asya

- Onları

- sonra

- Bunlar

- Re-Tweet

- üç

- zaman

- zamanlar

- için

- bugün

- Dönüştürmek

- Dönüşüm

- transforme

- tetikleyebilir

- yolculuk

- DÖNÜŞ

- iki

- türleri

- ui

- altında

- anlamak

- aksine

- Güncelleme

- güncellenmiş

- us

- kullanım

- kullanıcılar

- kullanım

- kullanma

- kullanır

- DOĞRULA

- onaylama

- versiyon

- üzerinden

- Görüntüle

- Gösterim

- hacim

- hacimleri

- istemek

- oldu

- yolları

- we

- ağ

- web hizmetleri

- karşılama

- vardı

- ne zaman

- hangi

- irade

- ile

- olmadan

- İş

- iş akışı

- iş akışları

- endişe

- endişe verici

- yazmak

- Sarı

- sen

- zefirnet

- bölgeleri