เราทุกคนต้องการเห็นคุณค่าของมนุษย์ในอุดมคติที่สะท้อนให้เห็นในเทคโนโลยีของเรา เราคาดหวังว่าเทคโนโลยี เช่น ปัญญาประดิษฐ์ (AI) จะไม่โกหกเรา ไม่เลือกปฏิบัติ และปลอดภัยสำหรับเราและบุตรหลานของเราในการใช้งาน อย่างไรก็ตาม ผู้สร้าง AI จำนวนมากกำลังเผชิญกับการตอบโต้จากอคติ ความไม่ถูกต้อง และแนวทางปฏิบัติด้านข้อมูลที่เป็นปัญหาซึ่งถูกเปิดเผยในโมเดลของตน ปัญหาเหล่านี้ต้องการมากกว่าโซลูชันทางเทคนิค อัลกอริธึม หรือ AI ในความเป็นจริง จำเป็นต้องมีแนวทางทางสังคมและเทคนิคแบบองค์รวม

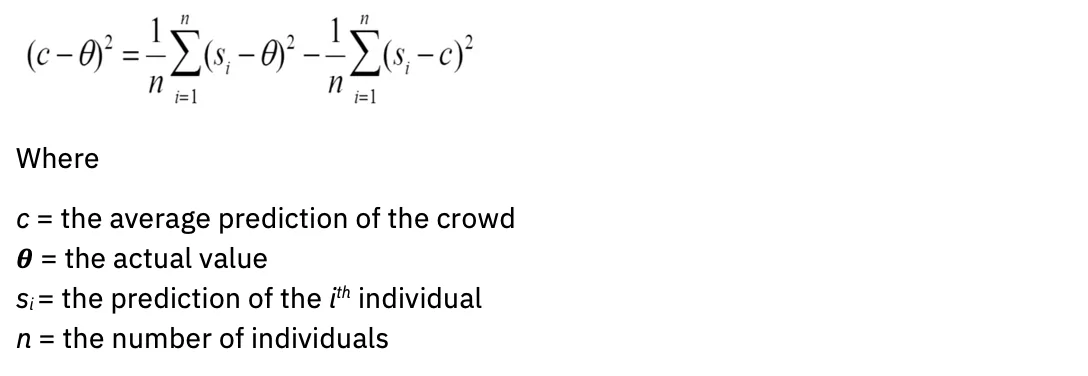

คณิตศาสตร์แสดงให้เห็นถึงความจริงอันทรงพลัง

โมเดลการคาดการณ์ทั้งหมด รวมถึง AI จะมีความแม่นยำมากขึ้นเมื่อรวมเอาความฉลาดและประสบการณ์ของมนุษย์ที่หลากหลาย นี่ไม่ใช่ความคิดเห็น มันมีความถูกต้องเชิงประจักษ์ พิจารณา ทฤษฎีบทการทำนายความหลากหลาย. พูดง่ายๆ ก็คือ เมื่อความหลากหลายในกลุ่มมีขนาดใหญ่ ข้อผิดพลาดของฝูงชนก็จะน้อย — สนับสนุนแนวคิดเรื่อง “ปัญญาของฝูงชน” ในการศึกษาที่มีอิทธิพล พบว่ากลุ่มนักแก้ปัญหาที่มีความสามารถต่ำหลายกลุ่มสามารถทำงานได้ดีกว่ากลุ่มนักแก้ปัญหาที่มีความสามารถสูง (หงส์และเพจ 2004).

ในภาษาคณิตศาสตร์: ยิ่งความแปรปรวนของคุณกว้างขึ้น ค่าเฉลี่ยของคุณก็จะยิ่งมีมาตรฐานมากขึ้น สมการมีลักษณะดังนี้:

A เรียนต่อ ให้การคำนวณเพิ่มเติมที่ขัดเกลาคำจำกัดความทางสถิติของกลุ่มผู้ชาญฉลาด รวมถึงการเพิกเฉยต่อการคาดการณ์ของสมาชิกคนอื่นๆ และรวมเอาคำทำนายเหล่านั้นด้วย แตกต่างกันมาก (ความสัมพันธ์เชิงลบ) การทำนายหรือการตัดสิน ดังนั้น ไม่ใช่แค่ปริมาณเท่านั้น แต่ความหลากหลายยังช่วยปรับปรุงการคาดการณ์อีกด้วย ข้อมูลเชิงลึกนี้อาจส่งผลต่อการประเมินโมเดล AI อย่างไร

โมเดล (ใน) ความแม่นยำ

อ้างคำพังเพยทั่วไปทุกรุ่นผิด สิ่งนี้ถือเป็นจริงในด้านสถิติ วิทยาศาสตร์ และ AI โมเดลที่สร้างขึ้นโดยขาดความเชี่ยวชาญด้านโดเมนสามารถนำไปสู่ ผิดพลาด เอาท์พุท

ทุกวันนี้ คนกลุ่มเล็กๆ ที่เป็นเนื้อเดียวกันตัดสินใจว่าจะใช้ข้อมูลใดในการฝึกโมเดล AI เชิงสร้างสรรค์ ซึ่งดึงมาจากแหล่งข้อมูลที่สื่อถึงภาษาอังกฤษมากเกินไป “สำหรับภาษาส่วนใหญ่มากกว่า 6,000 ภาษาในโลก ข้อมูลข้อความที่มีอยู่ไม่เพียงพอที่จะฝึกโมเดลพื้นฐานขนาดใหญ่” (จาก “ว่าด้วยโอกาสและความเสี่ยงของแบบจำลองพื้นฐาน” บอมมาซานี และคณะ 2022)

นอกจากนี้ ตัวแบบจำลองยังถูกสร้างขึ้นจากสถาปัตยกรรมที่จำกัด: “แบบจำลอง NLP ที่ล้ำสมัยเกือบทั้งหมดได้รับการดัดแปลงจากแบบจำลองพื้นฐานตัวใดตัวหนึ่ง เช่น BERT, RoBERTa, BART, T5 เป็นต้น ในขณะที่การทำให้เป็นเนื้อเดียวกันนี้ก่อให้เกิด เลเวอเรจที่สูงมาก (การปรับปรุงใด ๆ ในโมเดลพื้นฐานสามารถนำไปสู่ผลประโยชน์ทันทีใน NLP ทั้งหมด) ก็เป็นความรับผิดชอบเช่นกัน ระบบ AI ทั้งหมดอาจสืบทอดอคติที่เป็นปัญหาเดียวกันกับโมเดลพื้นฐานบางรุ่น (บอมมาซานี และคณะ) "

เพื่อให้ AI กำเนิดสามารถสะท้อนถึงชุมชนที่หลากหลายได้ดีขึ้น ข้อมูลของมนุษย์ที่หลากหลายยิ่งขึ้นจะต้องถูกนำเสนอในแบบจำลอง

การประเมินความแม่นยำของโมเดลไปพร้อมๆ กันกับการประเมินอคติ เราต้องถามว่าอะไรคือจุดประสงค์ของแบบจำลองและเหมาะสำหรับใคร? ตัวอย่างเช่น ลองพิจารณาว่าใครได้ประโยชน์มากที่สุดจากอัลกอริธึมการแนะนำเนื้อหาและอัลกอริธึมเครื่องมือค้นหา ผู้มีส่วนได้ส่วนเสียอาจมีความสนใจและเป้าหมายที่แตกต่างกันอย่างมาก อัลกอริทึมและแบบจำลองจำเป็นต้องมีเป้าหมายหรือพร็อกซีสำหรับข้อผิดพลาด Bayes ซึ่งเป็นข้อผิดพลาดขั้นต่ำที่แบบจำลองต้องปรับปรุง พร็อกซีนี้มักเป็นบุคคล เช่น ผู้เชี่ยวชาญเฉพาะด้านที่มีความเชี่ยวชาญด้านโดเมน

ความท้าทายของมนุษย์: การประเมินความเสี่ยงก่อนการจัดซื้อหรือการพัฒนาแบบจำลอง

กฎระเบียบและแผนปฏิบัติการ AI ที่เกิดขึ้นใหม่กำลังเน้นย้ำถึงความสำคัญของแบบฟอร์มการประเมินผลกระทบแบบอัลกอริทึมมากขึ้นเรื่อยๆ เป้าหมายของแบบฟอร์มเหล่านี้คือการรวบรวมข้อมูลที่สำคัญเกี่ยวกับโมเดล AI เพื่อให้ทีมกำกับดูแลสามารถประเมินและจัดการกับความเสี่ยงก่อนที่จะนำไปใช้งาน คำถามทั่วไปได้แก่:

- กรณีการใช้งานของโมเดลของคุณคืออะไร?

- ความเสี่ยงสำหรับผลกระทบที่แตกต่างกันคืออะไร?

- คุณประเมินความเป็นธรรมอย่างไร?

- คุณทำให้แบบจำลองของคุณอธิบายได้อย่างไร

แม้ว่าได้รับการออกแบบด้วยความตั้งใจที่ดี แต่ปัญหาก็คือเจ้าของโมเดล AI ส่วนใหญ่ไม่เข้าใจวิธีประเมินความเสี่ยงสำหรับกรณีการใช้งานของตน ประโยคทั่วไปอาจเป็น “แบบจำลองของฉันจะไม่ยุติธรรมได้อย่างไร หากไม่ได้รวบรวมข้อมูลส่วนบุคคล (PII)” ด้วยเหตุนี้ แบบฟอร์มจึงไม่ค่อยมีการกรอกด้วยความรอบคอบที่จำเป็นสำหรับระบบการกำกับดูแลในการระบุปัจจัยเสี่ยงอย่างแม่นยำ

ดังนั้นลักษณะทางสังคมและเทคนิคของการแก้ปัญหาจึงได้รับการเน้นย้ำ เจ้าของโมเดล—บุคคล—ไม่สามารถได้รับรายการช่องทำเครื่องหมายเพื่อประเมินว่ากรณีการใช้งานของพวกเขาจะก่อให้เกิดอันตรายหรือไม่ แต่สิ่งที่จำเป็นคือกลุ่มคนที่มีประสบการณ์โลกชีวิตที่แตกต่างกันอย่างกว้างขวางมารวมตัวกันในชุมชนที่ให้ความปลอดภัยทางจิตใจเพื่อสนทนาที่ยากลำบากเกี่ยวกับผลกระทบที่แตกต่างกัน

ยินดีต้อนรับมุมมองที่กว้างขึ้นสำหรับ AI ที่น่าเชื่อถือ

IBM® เชื่อมั่นในการใช้แนวทาง "client Zero" โดยนำคำแนะนำและระบบที่จะสร้างให้กับลูกค้าของตนเองผ่านการให้คำปรึกษาและโซลูชันที่นำโดยผลิตภัณฑ์ แนวทางนี้ขยายไปสู่หลักปฏิบัติด้านจริยธรรม ซึ่งเป็นสาเหตุที่ IBM สร้าง Trustworthy AI Center of Excellence (COE) ขึ้นมา

ตามที่อธิบายไว้ข้างต้น ความหลากหลายของประสบการณ์และชุดทักษะเป็นสิ่งสำคัญในการประเมินผลกระทบของ AI อย่างเหมาะสม แต่โอกาสในการเข้าร่วมในศูนย์ความเป็นเลิศอาจเป็นเรื่องน่ากังวลในบริษัทที่เต็มไปด้วยนักสร้างสรรค์นวัตกรรม AI ผู้เชี่ยวชาญ และวิศวกรที่มีชื่อเสียง ดังนั้นการปลูกฝังชุมชนด้านความปลอดภัยทางจิตจึงมีความจำเป็น IBM สื่อสารอย่างชัดเจนว่า “สนใจ AI ไหม? สนใจหลักจริยธรรมของ AI หรือไม่? คุณนั่งที่โต๊ะนี้”

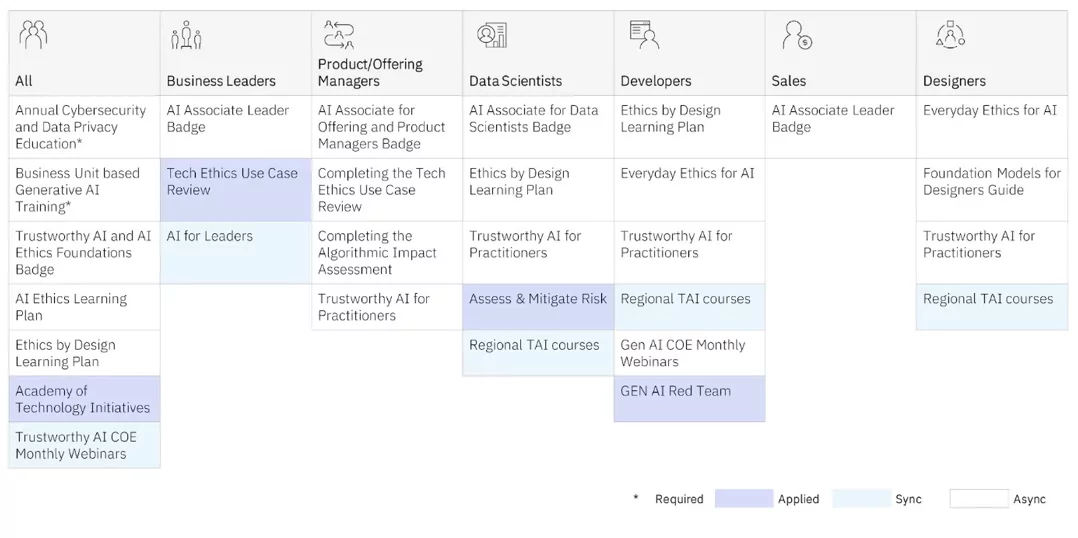

COE เสนอการฝึกอบรมด้านจริยธรรมด้าน AI แก่ผู้ปฏิบัติงานทุกระดับ มีทั้งการเรียนรู้แบบซิงโครนัส (ครูและนักเรียนในชั้นเรียน) และโปรแกรมอะซิงโครนัส (แนะนำตนเอง)

แต่มันเป็นของ COE ประยุกต์ การฝึกอบรมที่ให้ผู้ปฏิบัติงานของเราได้รับข้อมูลเชิงลึกที่ลึกซึ้งที่สุด เมื่อพวกเขาทำงานร่วมกับทีมจากหลากหลายสาขาวิชาจากทั่วโลก ในโครงการจริงเพื่อทำความเข้าใจผลกระทบที่แตกต่างกันได้ดียิ่งขึ้น พวกเขายังใช้ประโยชน์จากกรอบความคิดการออกแบบที่ไอบีเอ็ม การออกแบบสำหรับเอไอ group ใช้ภายในและกับลูกค้าเพื่อประเมินผลกระทบที่ไม่ได้ตั้งใจของโมเดล AI โดยคำนึงถึงผู้ที่มักถูกละเลยเป็นอันดับแรก (ดูของซิลเวีย ดักเวิร์ธ) วงล้อแห่งอำนาจและสิทธิพิเศษ สำหรับตัวอย่างของลักษณะส่วนบุคคลที่ตัดกันกับสิทธิ์พิเศษหรือการทำให้คนชายขอบ) IBM ยังบริจาคเฟรมเวิร์กจำนวนมากให้กับชุมชนโอเพ่นซอร์ส ออกแบบอย่างมีจริยธรรม.

ด้านล่างนี้คือรายงานบางส่วนที่ IBM เผยแพร่ต่อสาธารณะเกี่ยวกับโปรเจ็กต์เหล่านี้:

เครื่องมือกำกับดูแลโมเดล AI อัตโนมัติจำเป็นต้องรวบรวมข้อมูลเชิงลึกที่สำคัญเกี่ยวกับประสิทธิภาพของโมเดล AI ของคุณ แต่โปรดทราบว่า การจับความเสี่ยงก่อนที่แบบจำลองของคุณจะได้รับการพัฒนาและใช้งานจริงถือเป็นวิธีที่ดีที่สุด ด้วยการสร้างชุมชนของผู้ปฏิบัติงานที่หลากหลายและหลากหลายสาขาซึ่งเสนอพื้นที่ปลอดภัยให้ผู้คนได้สนทนากันอย่างดุเดือดเกี่ยวกับผลกระทบที่แตกต่างกัน คุณสามารถเริ่มต้นการเดินทางไปสู่การนำหลักการของคุณไปใช้และพัฒนา AI อย่างมีความรับผิดชอบ

ในทางปฏิบัติ เมื่อคุณจ้างผู้ปฏิบัติงานด้าน AI ให้พิจารณาว่ากว่า 70% ของความพยายามในการสร้างแบบจำลองคือการดูแลจัดการข้อมูลที่ถูกต้อง คุณต้องการจ้างคนที่รู้วิธีรวบรวมข้อมูลที่เป็นตัวแทนและรวบรวมโดยได้รับความยินยอมด้วย คุณยังต้องการให้ผู้ที่รู้จักทำงานอย่างใกล้ชิดกับผู้เชี่ยวชาญโดเมนเพื่อให้แน่ใจว่าพวกเขามีแนวทางที่ถูกต้อง การรับรองว่าผู้ปฏิบัติงานเหล่านี้มีความฉลาดทางอารมณ์ในการรับมือกับความท้าทายในการดูแลจัดการ AI อย่างมีความรับผิดชอบด้วยความอ่อนน้อมถ่อมตนและมีวิจารณญาณเป็นสิ่งสำคัญ เราต้องมีความตั้งใจที่จะเรียนรู้วิธีการรับรู้ว่าระบบ AI สามารถทำให้ความไม่เท่าเทียมรุนแรงขึ้นได้มากเท่ากับที่สามารถเพิ่มสติปัญญาของมนุษย์ได้อย่างไรและเมื่อใด

พลิกโฉมวิธีการทำงานธุรกิจของคุณด้วย AI

บทความนี้เป็นประโยชน์หรือไม่?

ใช่ไม่

เพิ่มเติมจากปัญญาประดิษฐ์

จดหมายข่าวไอบีเอ็ม

รับจดหมายข่าวและการอัปเดตหัวข้อที่นำเสนอความเป็นผู้นำทางความคิดล่าสุดและข้อมูลเชิงลึกเกี่ยวกับแนวโน้มที่เกิดขึ้น

สมัครสมาชิกวันนี้

จดหมายข่าวเพิ่มเติม

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- เพลโตสุขภาพ เทคโนโลยีชีวภาพและข่าวกรองการทดลองทางคลินิก เข้าถึงได้ที่นี่.

- ที่มา: https://www.ibm.com/blog/why-we-need-diverse-multidisciplinary-coes-for-model-risk/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 000

- 1

- 16

- 2022

- 2024

- 23

- 25

- 28

- 29

- 30

- 300

- 32

- 39

- 40

- 400

- 65

- 7

- 9

- a

- ความสามารถ

- เกี่ยวกับเรา

- ข้างบน

- AC

- เร่งความเร็ว

- ความถูกต้อง

- ถูกต้อง

- แม่นยำ

- ข้าม

- การกระทำ

- เหมาะ

- ที่อยู่

- ยอมรับ

- นำมาใช้

- การโฆษณา

- คำแนะนำ

- มีผลต่อ

- ตัวแทน

- AI

- โมเดล AI

- ระบบ AI

- จุดมุ่งหมาย

- AL

- อัลกอริทึม

- อัลกอริทึม

- ทั้งหมด

- ด้วย

- เสมอ

- amp

- an

- การวิเคราะห์

- และ

- ใด

- การใช้งาน

- การใช้งาน

- เข้าใกล้

- เป็น

- พื้นที่

- บทความ

- เทียม

- ปัญญาประดิษฐ์

- ปัญญาประดิษฐ์ (AI)

- AS

- ถาม

- ประเมินผล

- การประเมิน

- การประเมินผล

- ผู้ช่วย

- การให้ความช่วยเหลือ

- At

- เสียง

- เสริม

- ผู้เขียน

- ใช้ได้

- หลีกเลี่ยง

- กลับ

- สมดุล

- BE

- รับ

- ก่อน

- เริ่ม

- กำลัง

- เชื่อ

- ประโยชน์ที่ได้รับ

- ดีกว่า

- เกิน

- อคติ

- อคติ

- บล็อก

- Blog

- สีน้ำเงิน

- บอสตัน

- ทั้งสอง

- ที่กว้างขึ้น

- การก่อสร้าง

- ธุรกิจ

- ฟังก์ชั่นทางธุรกิจ

- ธุรกิจ

- แต่

- ปุ่ม

- by

- CAN

- จับ

- จับ

- คาร์บอน

- บัตร

- การ์ด

- ซึ่ง

- กรณี

- แมว

- หมวดหมู่

- ก่อให้เกิด

- ศูนย์

- ศูนย์ความเป็นเลิศ

- ส่วนกลาง

- บาง

- ท้าทาย

- ลักษณะ

- chatbots

- ตรวจสอบ

- เด็ก

- เด็ก

- วงกลม

- CIS

- ชั้น

- อย่างเห็นได้ชัด

- ลูกค้า

- อย่างใกล้ชิด

- เมฆ

- สี

- การผสมผสาน

- มา

- ร่วมกัน

- ชุมชน

- ชุมชน

- บริษัท

- บริษัท

- เสร็จ

- แนวคิด

- ความยินยอม

- ดังนั้น

- พิจารณา

- การให้คำปรึกษา

- ภาชนะ

- ต่อ

- การสนทนา

- แกน

- แก้ไข

- มีความสัมพันธ์

- ราคา

- ได้

- ที่สร้างขึ้น

- การสร้าง

- ผู้สร้าง

- วิกฤติ

- ฝูงชน

- CSS

- curating

- ขณะนี้

- ประเพณี

- ลูกค้า

- ประสบการณ์ของลูกค้า

- ลูกค้า

- ข้อมูล

- วันที่

- การตัดสินใจ

- ที่ลึกที่สุด

- ค่าเริ่มต้น

- คำจำกัดความ

- ส่งมอบ

- แสดงให้เห็นถึง

- ปรับใช้

- ลักษณะ

- ออกแบบ

- คิดออกแบบ

- ได้รับการออกแบบ

- กำหนด

- พัฒนา

- พัฒนา

- ต่าง

- ยาก

- ดิจิตอล

- แปลงดิจิตอล

- ต่างกัน

- โดดเด่น

- หลาย

- ความหลากหลาย

- do

- โดเมน

- บริจาค

- วาด

- ขับรถ

- E&T

- ผลกระทบ

- ความพยายาม

- การกำจัด

- การฝัง

- โอบกอด

- กากกะรุน

- พนักงาน

- ทำให้สามารถ

- น่าสนใจ

- เครื่องยนต์

- วิศวกร

- ภาษาอังกฤษ

- พอ

- การสร้างความมั่นใจ

- เข้าสู่

- ความผิดพลาด

- ฯลฯ

- อีเธอร์ (ETH)

- ตามหลักจริยธรรม

- จริยธรรม

- ประเมินค่า

- การประเมินการ

- การประเมินผล

- แม้

- ทุกๆ

- ทุกที่

- ทำให้รุนแรง

- ตัวอย่าง

- ตัวอย่าง

- ความยอดเยี่ยม

- ทางออก

- คาดหวัง

- ประสบการณ์

- ประสบการณ์

- ชำนาญ

- ความชำนาญ

- ผู้เชี่ยวชาญ

- อธิบาย

- ที่เปิดเผย

- ขยาย

- อย่างยิ่ง

- Facebook messenger ได้

- อำนวยความสะดวก

- หันหน้าไปทาง

- ปัจจัย

- ความเป็นธรรม

- เท็จ

- ไกล

- FAST

- สองสาม

- หา

- โฟกัส

- ปฏิบัติตาม

- ดังต่อไปนี้

- แบบอักษร

- สำหรับ

- แถวหน้า

- รูปแบบ

- รากฐาน

- กรอบ

- ราคาเริ่มต้นที่

- ด้านหน้า

- ฟังก์ชั่น

- รวบรวม

- รวมตัวกัน

- การรวบรวม

- กำเนิด

- กำเนิด AI

- เครื่องกำเนิดไฟฟ้า

- ได้รับ

- กำหนด

- จะช่วยให้

- เหตุการณ์ที่

- เป้าหมาย

- เป้าหมาย

- ไป

- ดี

- การกำกับดูแล

- ไวยากรณ์

- อย่างมาก

- ตะแกรง

- บัญชีกลุ่ม

- กลุ่ม

- การเจริญเติบโต

- ให้คำแนะนำ

- อันตราย

- มี

- หัวข้อ

- ได้ยิน

- ความสูง

- ช่วย

- เป็นประโยชน์

- จุดสูง

- พระองค์

- จ้าง

- การว่าจ้าง

- ของเขา

- ถือ

- แบบองค์รวม

- หน้าแรก

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- ทำอย่างไร

- HTTPS

- เป็นมนุษย์

- สติปัญญาของมนุษย์

- ความนอบน้อม

- เป็นลูกผสม

- เมฆไฮบริด

- i

- ฉันเป็น

- ไอบีเอ็ม

- ICO

- ICON

- ในอุดมคติ

- ระบุ

- if

- ความไม่รู้

- ภาพ

- ทันที

- ส่งผลกระทบ

- ผลกระทบ

- การดำเนินการ

- การดำเนินการ

- ความสำคัญ

- สำคัญ

- ปรับปรุง

- การปรับปรุง

- ช่วยเพิ่ม

- in

- ประกอบด้วย

- รวมทั้ง

- รวม

- รวมเข้าด้วยกัน

- ขึ้น

- ที่เพิ่มขึ้น

- ดัชนี

- อุตสาหกรรม

- มีอิทธิพล

- ข้อมูล

- นักวิเคราะห์ส่วนบุคคลที่หาโอกาสให้เป็นไปได้มากที่สุด

- ประดิษฐ์

- อินพุต

- ความเข้าใจ

- ข้อมูลเชิงลึก

- ทันที

- แทน

- สถาบัน

- ประกัน

- ผู้ประกันตน

- Intelligence

- ฉลาด

- ความตั้งใจ

- โดยเจตนา

- ความตั้งใจ

- สนใจ

- ผลประโยชน์

- ภายใน

- ตัด

- การแทรกแซง

- ข่มขู่

- แท้จริง

- ISN

- ปัญหา

- ปัญหา

- IT

- ITS

- มกราคม

- ร่วม

- เข้าร่วมกับเรา

- การเดินทาง

- jpg

- เพียงแค่

- การเก็บรักษา

- คีย์

- ทราบ

- ที่รู้จักกัน

- ไม่มี

- ภาษา

- ภาษา

- ใหญ่

- ขนาดใหญ่

- ล่าสุด

- นำ

- ผู้นำ

- ความเป็นผู้นำ

- การเรียนรู้

- ให้

- ชั้น

- เลฟเวอเรจ

- ความรับผิดชอบ

- โกหก

- กดไลก์

- ถูก จำกัด

- รายการ

- ในประเทศ

- ในประเทศ

- LOOKS

- ทำ

- การทำ

- การจัดการ

- คู่มือ

- หลาย

- คณิตศาสตร์

- คณิตศาสตร์

- เรื่อง

- ความกว้างสูงสุด

- อาจ..

- me

- หมายความ

- พบ

- Messenger

- อาจ

- นาที

- ใจ

- ขั้นต่ำ

- นาที

- โทรศัพท์มือถือ

- แบบ

- โมเดล

- สร้างสรรค์สิ่งใหม่ ๆ

- ข้อมูลเพิ่มเติม

- มากที่สุด

- ย้าย

- มาก

- สหสาขาวิชาชีพ

- ต้อง

- my

- ธรรมชาติ

- การเดินเรือ

- จำเป็น

- จำเป็นต้อง

- จำเป็น

- ความต้องการ

- ในเชิงลบ

- ใหม่

- ผลิตภัณฑ์ใหม่

- จดหมายข่าว

- NLP

- ไม่

- หมายเหตุ

- ไม่มีอะไร

- ตอนนี้

- มากมาย

- of

- ปิด

- เสนอ

- เสนอ

- เสนอ

- มักจะ

- on

- ONE

- โอเพนซอร์ส

- ความคิดเห็น

- โอกาส

- ดีที่สุด

- การปรับให้เหมาะสม

- or

- องค์กร

- อื่นๆ

- ของเรา

- แนะ

- เอาท์พุท

- เกิน

- ของตนเอง

- เจ้าของ

- หน้า

- ที่เข้าร่วมโครงการ

- ส่ง

- รูปแบบไฟล์ PDF

- คน

- ที่มีประสิทธิภาพ

- คน

- ส่วนบุคคล

- ส่วนตัว

- มุมมอง

- PHP

- PII

- แผน

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- เสียบเข้าไป

- นโยบาย

- ตำแหน่ง

- โพสต์

- ที่มีศักยภาพ

- ผู้มีโอกาสเป็นลูกค้า

- อำนาจ

- ที่มีประสิทธิภาพ

- การปฏิบัติ

- การปฏิบัติ

- คำทำนาย

- การคาดการณ์

- ทำนาย

- ประถม

- หลักการ

- จัดลำดับความสำคัญ

- สิทธิพิเศษ

- ปัญหา

- จัดซื้อจัดจ้าง

- ผลิต

- การผลิต

- ผลผลิต

- ผลิตภัณฑ์

- โปรแกรม

- โครงการ

- อย่างถูกต้อง

- โอกาส

- ให้

- การให้

- ผู้รับมอบฉันทะ

- หนังสือมอบฉันทะ

- ทางด้านจิตใจ

- สาธารณชน

- การตีพิมพ์

- ใส่

- คำถาม

- อย่างรวดเร็ว

- หุ้น

- ไม่ค่อยมี

- การเตรียมความพร้อม

- การอ่าน

- จริง

- ความจริง

- รับรู้

- แนะนำ

- ลด

- ปรับแต่ง

- สะท้อน

- สะท้อนให้เห็นถึง

- กฎระเบียบ

- รายงาน

- ตัวแทน

- เป็นตัวแทนของ

- การร้องขอ

- ต้องการ

- จำเป็นต้องใช้

- การวิจัย

- การตอบสนอง

- รับผิดชอบ

- อย่างรับผิดชอบ

- การตอบสนอง

- รายได้

- การเติบโตของรายได้

- ขวา

- ความเสี่ยง

- ปัจจัยเสี่ยง

- ความเสี่ยง

- ถนน

- หุ่นยนต์

- ปลอดภัย

- ความปลอดภัย

- กล่าวว่า

- เดียวกัน

- คำพูด

- ขนาด

- ปรับ

- วิทยาศาสตร์

- จอภาพ

- สคริปต์

- ค้นหา

- เครื่องมือค้นหา

- ปลอดภัย

- เห็น

- SEO

- ให้บริการอาหาร

- การตั้งค่า

- น่า

- แสดง

- ง่ายดาย

- เว็บไซต์

- หย่อน

- เล็ก

- สมาร์ท

- ลำโพงอัจฉริยะ

- SMS

- So

- ทางออก

- โซลูชัน

- บาง

- แหล่งที่มา

- ช่องว่าง

- ลำโพง

- ผู้ให้การสนับสนุน

- สี่เหลี่ยม

- ผู้มีส่วนได้เสีย

- มาตรฐาน

- เริ่มต้น

- รัฐของศิลปะ

- ทางสถิติ

- สถิติ

- นักเรียน

- ศึกษา

- หรือ

- สมัครเป็นสมาชิก

- อย่างเช่น

- สนับสนุน

- ที่สนับสนุน

- SVG

- ระบบ

- T

- ตาราง

- การ

- เป้าหมาย

- ครู

- ทีม

- วิชาการ

- เทคโนโลยี

- ระดับอุดมศึกษา

- ข้อความ

- กว่า

- ขอบคุณ

- ที่

- พื้นที่

- โลก

- ของพวกเขา

- พวกเขา

- ชุดรูปแบบ

- ตัวเอง

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- คิด

- คิด

- นี้

- เหล่านั้น

- คิดว่า

- ความเป็นผู้นำทางความคิด

- สาม

- ตลอด

- เวลา

- ชื่อหนังสือ

- ไปยัง

- ร่วมกัน

- เครื่องมือ

- ด้านบน

- หัวข้อ

- ยาก

- รถไฟ

- การฝึกอบรม

- การแปลง

- แนวโน้ม

- จริง

- เชื่อถือได้

- พูดเบาและรวดเร็ว

- สอง

- ชนิด

- ตามแบบฉบับ

- เข้าใจ

- ไม่ยุติธรรม

- เป็นเอกลักษณ์

- ปลดล็อค

- การปรับปรุง

- เมื่อ

- URL

- us

- ใช้

- ใช้กรณี

- ใช้

- การใช้ประโยชน์

- ความคุ้มค่า

- ความคุ้มค่า

- ความหลากหลาย

- แตกต่างกัน

- มาก

- เสมือน

- ปริมาณ

- W

- ต้องการ

- คือ

- we

- ดี

- อะไร

- ความหมายของ

- เมื่อ

- ว่า

- ที่

- ในขณะที่

- WHO

- ใคร

- ทำไม

- อย่างกว้างขวาง

- กว้าง

- จะ

- ภูมิปัญญา

- WISE

- กับ

- คำ

- WordPress

- งาน

- โรงงาน

- โลก

- จะ

- เขียน

- ผิด

- ยัง

- เธอ

- ของคุณ

- ลมทะเล