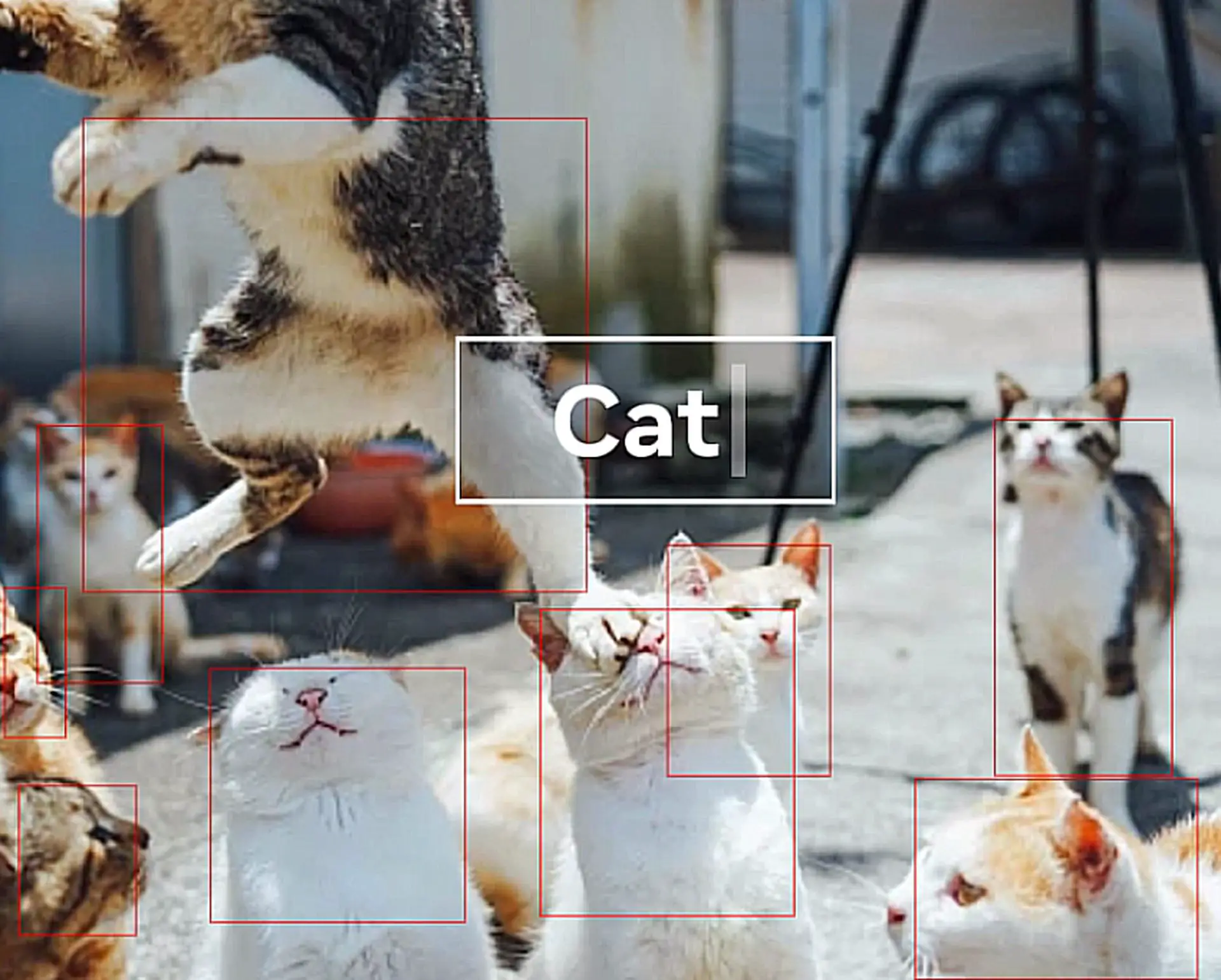

Metas nya Segment Anything Model avslöjades. SAM-modellen är ett nytt sätt att skapa masker av hög kvalitet för bildsegmentering.

Påminnelse: Bildsegmentering är en grundläggande uppgift inom datorseende som syftar till att dela upp en bild i regioner som motsvarar olika objekt eller semantiska kategorier och har många tillämpningar, såsom objektdetektering, scenförståelse, bildredigering och videoanalys.

Bildsegmentering är dock också ett utmanande problem, särskilt när man hanterar komplexa scener som innehåller flera objekt med olika former, storlekar och utseenden. Dessutom kräver de flesta befintliga bildsegmenteringsmetoder stora mängder annoterad data för utbildning, vilket kan vara kostsamt och tidskrävande att få fram. Meta vill lösa detta problem med SAM-modellen.

SAM-modell: Vad är Metas nya Segment Anything Model?

Segment Anything Model (SAM) är en ny och kraftfull artificiell intelligensmodell som kan segmentera vilket objekt som helst i en bild eller video med hög kvalitet och effektivitet. Segmentering är processen att separera ett objekt från dess bakgrund eller andra objekt och skapa en mask som beskriver dess form och gränser. Med SAM-modellen blir dina redigerings-, sammansättnings-, spårnings-, igenkännings- och analysuppgifter enklare.

SAM skiljer sig från andra segmenteringsmodeller på flera sätt, till exempel:

- SAM är promptbar, vilket innebär att det kan krävas olika inmatningsprompter, såsom punkter eller rutor, för att specificera vilket objekt som ska segmenteras. Du kan till exempel rita en ruta runt en persons ansikte, och Segment Anything Model kommer att generera en mask för ansiktet. Du kan också ge flera uppmaningar om att segmentera flera objekt samtidigt. SAM-modellen kan hantera komplexa scener med ocklusioner, reflektioner och skuggor.

- SAM är tränad på en massiv datauppsättning med 11 miljoner bilder och 1.1 miljarder masker, vilket är den största segmenteringsdatauppsättningen hittills. Denna datauppsättning täcker ett brett utbud av objekt och kategorier, såsom djur, växter, fordon, möbler, mat och mer. SAM kan segmentera objekt som den aldrig har sett förut, tack vare dess generaliseringsförmåga och datadiversitet.

- SAM har en stark noll-shot-prestanda på en mängd olika segmenteringsuppgifter. Zero-shot innebär att SAM kan segmentera objekt utan ytterligare träning eller finjustering på en specifik uppgift eller domän. Till exempel kan SAM segmentera ansikten, händer, hår, kläder och accessoarer utan några förkunskaper eller övervakning. SAM kan också segmentera objekt i olika modaliteter, såsom infraröda bilder eller djupkartor.

SAM-modellen uppnår imponerande resultat på olika riktmärken för bildsegmentering, såsom COCO. SAM överträffar eller matchar också tidigare helt övervakade metoder på flera noll-shot segmenteringsuppgifter, såsom segmentering av logotyper, text, ansikten eller skisser. Den visar sin mångsidighet och robusthet över olika domäner och scenarier.

I framtiden: Projektet Segment Anything Model (SAM-modellen) är fortfarande i början. Enligt Meta är det här några av de framtida tillämpningarna av Segment Anything Model:

- Framtida AR-glasögon kan använda SAM för att känna igen vanliga föremål och ge användbara påminnelser och instruktioner.

- SAM har förmågan att påverka många andra områden, såsom jordbruk och biologi. En dag kan det till och med gynna bönder och vetenskapsmän.

SAM-modellen kan bli ett genombrott inom datorseende och forskning om artificiell intelligens. Det visar potentialen hos grundmodeller för vision, som är modeller som kan lära av storskalig data och överföras till nya uppgifter och domäner.

Segment Anything Model (SAM-modell) funktioner

Här är några av SAM-modellens möjligheter:

- Med SAM-modellen kan användare snabbt och enkelt segmentera objekt genom att välja enskilda punkter att inkludera eller utelämna från segmenteringen. En gränslåda kan också användas som pekpinne för modellen.

- När osäkerhet råder angående artikeln som segmenteras kan SAM-modellen producera många giltiga masker, en avgörande och kritisk färdighet för att lösa segmentering i den verkliga världen.

- Automatisk objektdetektering och maskering är nu enkelt med Segment Anything Model.

- Efter förberäkning av bildinbäddningen kan Segment Anything-modellen tillhandahålla en segmenteringsmask för varje prompt omedelbart, vilket möjliggör realtidsinteraktion med modellen.

Imponerande, eller hur? Så vad är tekniken bakom?

Hur fungerar SAM-modellen?

En av de mest spännande upptäckterna inom NLP och, på senare tid, inom datorseende är användningen av "promptande" tillvägagångssätt för att möjliggöra noll- och få-shot-inlärning på nya datamängder och uppgifter med hjälp av grundmodeller. Meta hittade motivation inom detta område.

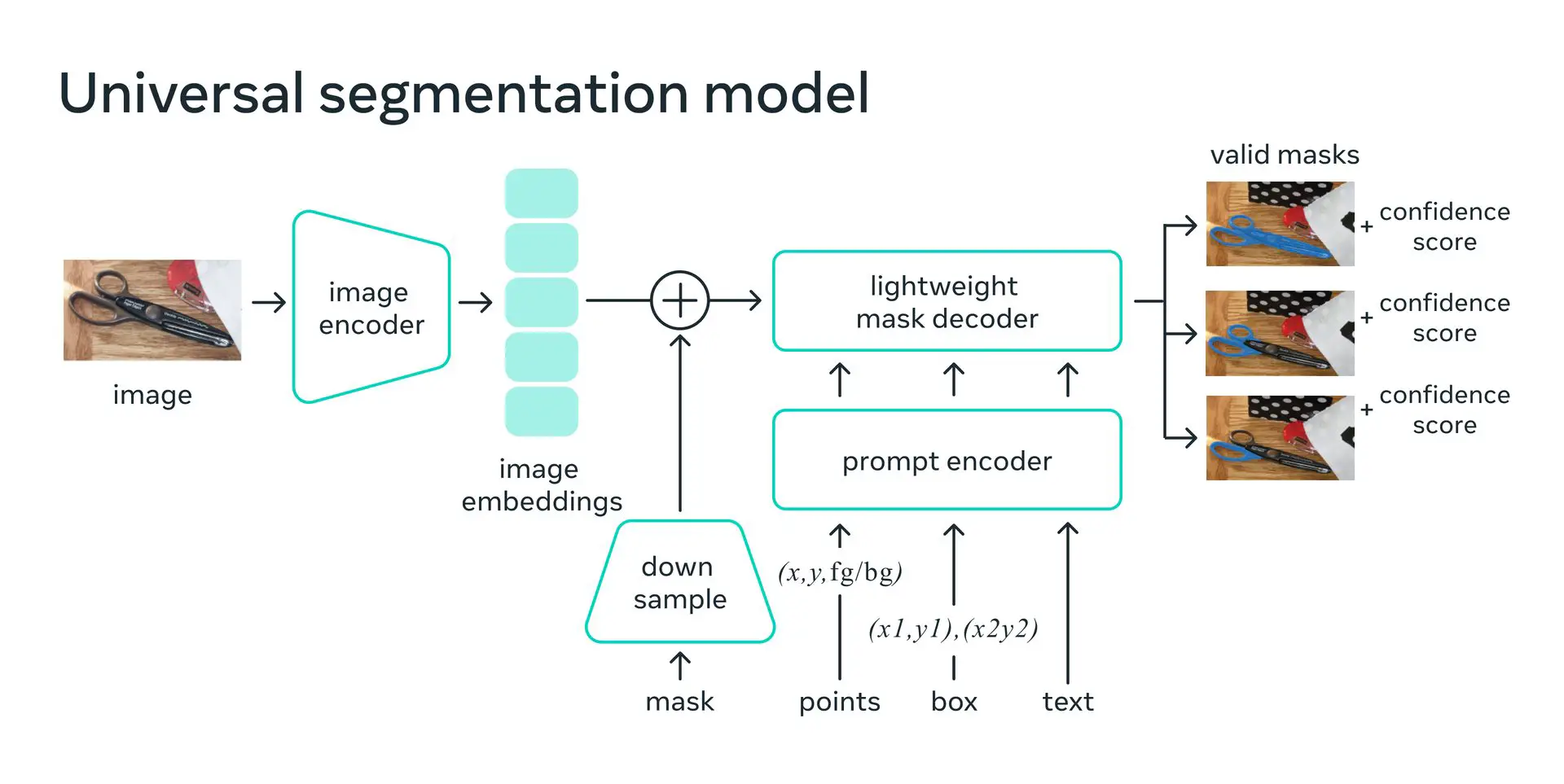

Om de ges förgrunds-/bakgrundspunkter, en grov ruta eller mask, friformstext eller någon annan inmatning som indikerar vad som ska segmenteras i en bild, lärde Meta AI-teamet Segment Anything Model att generera en riktig segmenteringsmask. Behovet av en ordentlig mask innebär bara att resultatet ska vara en lämplig mask för en av de saker som uppmaningen kan hänvisa till (till exempel kan en punkt på en skjorta representera antingen skjortan eller personen som bär den). Denna uppgift används för modellförutbildning och för att vägleda lösningen av generiska nedströmssegmenteringsproblem.

Meta märkte att förträningsuppgiften och interaktiv datainsamling medförde vissa begränsningar för modellkonstruktionen. I synnerhet måste deras annotatorer kunna använda Segment Anything Model i en webbläsare, interaktivt, i realtid, på en CPU för att det ska vara effektivt. Trots att det måste finnas en kompromiss mellan kvalitet och hastighet för att uppfylla kravet på körtid, upptäcker de att ett enkelt tillvägagångssätt ger tillfredsställande resultat.

På baksidan skapar en bildkodare en unik inbäddning för bilden, medan en lättviktskodare omedelbart kan omvandla vilken fråga som helst till en inbäddningsvektor. En lättviktsavkodare används sedan för att slå samman dessa två datakällor för att förutse segmenteringsmasker. Efter att bildinbäddningen har beräknats kan SAM svara på varje fråga i en webbläsare med ett segment på cirka 50 ms.

SAM är ett användbart verktyg för kreativa proffs och entusiaster som vill redigera bilder och videor med lätthet och flexibilitet. Men först måste du lära dig hur du kommer åt och använder den.

Hur använder man Segment Anything Model (SAM-modellen)?

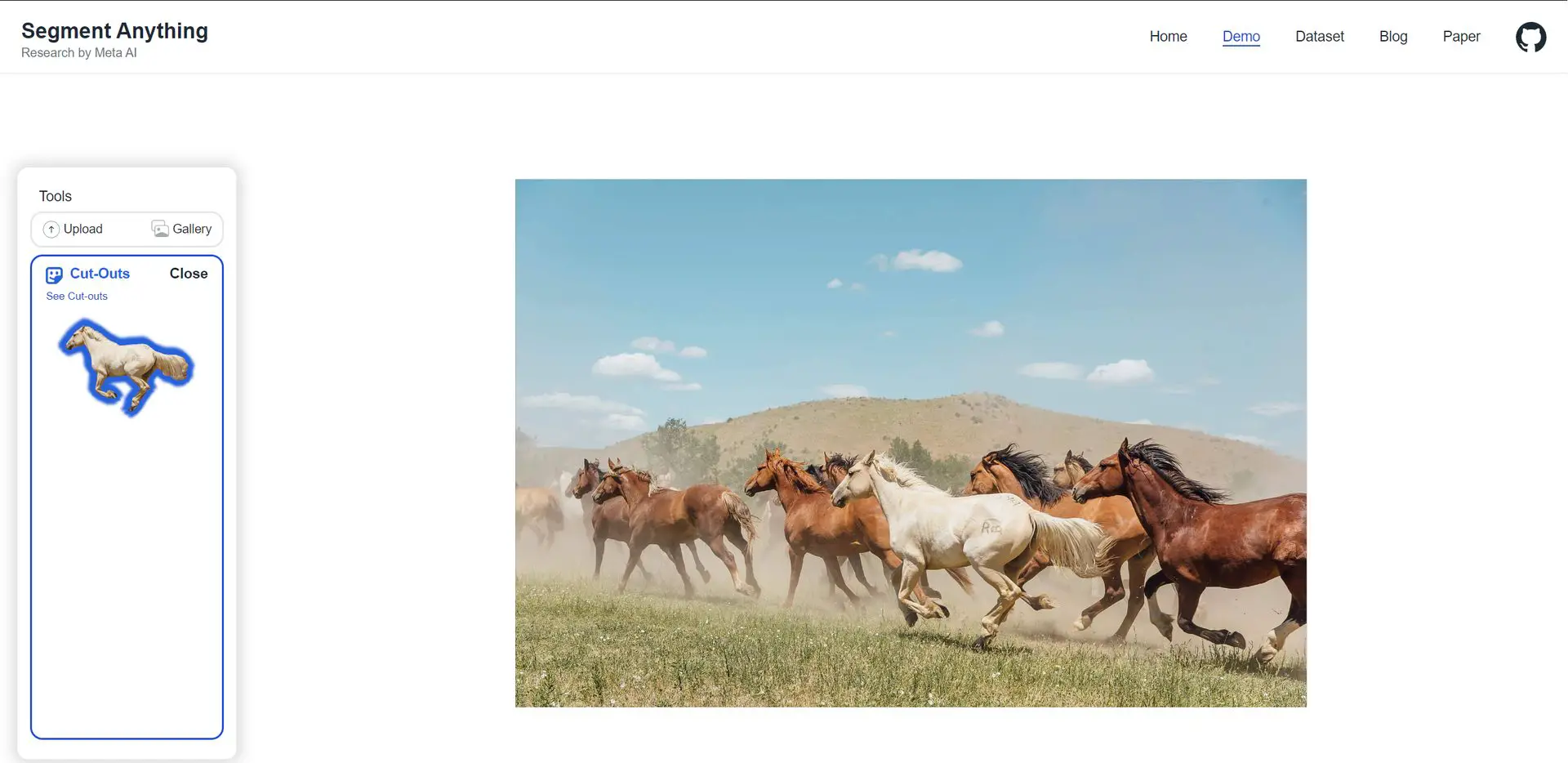

SAM är utvecklad av Meta AI Research (tidigare Facebook AI Research), och den är allmänt tillgänglig på GitHub. Du kan också prova SAM online med en demo eller ladda ner datasetet (SA-1B) med 1 miljard masker och 11 miljoner bilder. Modellen är ganska lätt att använda; följ bara dessa steg:

- Ladda ner demon eller gå till Segment Anything Model-demon.

- Ladda upp en bild eller välj en i galleriet.

- Lägg till och ämnesområden

- Maskera områden genom att lägga till punkter. Välj Lägg till område och välj sedan objektet. Förfina masken genom att välja Ta bort område och välj sedan området.

Slutför sedan din uppgift som du vill!

För mer information, klicka här..

Bild med tillstånd: meta

AI 101

Är du ny på AI? Du kan fortfarande gå på AI-tåget! Vi har skapat en detaljerad AI-ordlista för de vanligaste artificiell intelligens och förklara grunderna i artificiell intelligens samt risker och fördelar med AI. Använd dem gärna. Inlärning hur man använder AI är en game changer! AI-modeller kommer att förändra världen.

AI-verktyg som vi har granskat

Nästan varje dag dyker ett nytt verktyg, modell eller funktion upp och förändrar våra liv, precis som det nya OpenAI ChatGPT-plugins, och vi har redan recenserat några av de bästa:

- Text-till-text AI-verktyg

Vill du lära dig hur använder man ChatGPT effektivt? Vi har några tips och tricks för dig utan att byta till Chatta GPT Plus! När du vill använda AI-verktyget kan du få fel som "ChatGPT har kapacitet just nu" och "för många förfrågningar på 1 timme försök igen senare". Ja, de är verkligen irriterande fel, men oroa dig inte; vi vet hur man fixar dem. Är ChatGPT plagiat gratis? Det är en svår fråga att hitta ett enda svar. Om du är rädd för plagiat, använd gärna AI-plagiatkontroller. Du kan också kontrollera andra AI -chatbots och AI-uppsatsförfattare för bättre resultat.

- Text-till-bild AI-verktyg

Medan det fortfarande finns några debatter om bilder genererade av artificiell intelligens, folk letar fortfarande efter bästa AI art generatorer. Kommer AI att ersätta designers? Fortsätt läsa och ta reda på det.

- Andra AI-verktyg

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- Platoblockchain. Web3 Metaverse Intelligence. Kunskap förstärkt. Tillgång här.

- Källa: https://dataconomy.com/2023/04/sam-model-meta-segment-anything-model-mask/

- :är

- $UPP

- 1

- 11

- a

- förmåga

- Able

- Om oss

- tillgång

- tillbehör

- Enligt

- uppnår

- tvärs

- Annat

- påverka

- Efter

- jordbruket

- AI

- ai konst

- ai forskning

- AI-powered

- Syftet

- algoritmer

- redan

- mängd

- mängder

- analys

- analysera

- och

- djur

- svara

- förutse

- framträdanden

- tillämpningar

- tillvägagångssätt

- tillvägagångssätt

- lämpligt

- AR

- AR-glasögon

- ÄR

- OMRÅDE

- områden

- runt

- Konst

- konstgjord

- artificiell intelligens

- AS

- At

- automatisera

- tillgänglig

- tillbaka

- bakgrund

- BE

- innan

- bakom

- Där vi får lov att vara utan att konstant prestera,

- riktmärken

- fördel

- Fördelarna

- BÄST

- Bättre

- mellan

- Miljarder

- biologi

- gränser

- Box

- boxar

- genombrott

- webbläsare

- by

- beräknat

- KAN

- Kan få

- kapacitet

- Kapacitet

- kategorier

- vissa

- utmanande

- byta

- Förändringar

- ChatGPT

- ta

- Välja

- klick

- kläder

- Samla

- vanligen

- fullborda

- komplex

- kompromiss

- dator

- Datorsyn

- konstruktion

- kunde

- omfattar

- CPU

- skapa

- skapas

- skapar

- Skapa

- Kreativ

- kritisk

- avgörande

- datum

- datauppsättningar

- Datum

- dag

- Dagar

- som handlar om

- Erbjudanden

- demo

- demonstrerar

- djup

- Trots

- detaljerad

- Detektering

- utvecklade

- olika

- Upptäck

- Mångfald

- domän

- domäner

- inte

- ladda ner

- Tidig

- lättare

- lätt

- redigering

- Effektiv

- effektivt

- effektivitet

- ansträngning

- antingen

- möjliggöra

- möjliggör

- entusiaster

- miljöer

- fel

- speciellt

- UPPSATS

- Eter (ETH)

- Även

- Varje

- varje dag

- exempel

- befintliga

- finns

- Förklara

- Ansikte

- ytorna

- lantbrukare

- Leverans

- Funktioner

- fält

- Fält

- hitta

- Förnamn

- Fast

- Flexibilitet

- följer

- livsmedelsproduktion

- För

- förr

- hittade

- fundament

- Fri

- från

- fullständigt

- grundläggande

- framtida

- Galleri

- lek

- Gaming

- generera

- skaffa sig

- Ge

- ges

- glas

- Go

- styra

- Hår

- hantera

- händer

- Hård

- Har

- hjälpa

- hjälp

- Hög

- hög kvalitet

- Hur ser din drömresa ut

- How To

- HTTPS

- humant

- identifiera

- bild

- bildsegmentering

- bilder

- ålagts

- imponerande

- in

- innefattar

- indikerar

- individuellt

- informationen

- ingång

- instruktioner

- Intelligens

- interaktion

- interaktiva

- fråga

- IT

- DESS

- jpg

- Ha kvar

- Vet

- kunskap

- Large

- storskalig

- största

- LÄRA SIG

- inlärning

- lättvikt

- tycka om

- begränsningar

- Bor

- du letar

- många

- kartor

- mask

- Masker

- massiv

- max-bredd

- betyder

- Möt

- endast

- Sammanfoga

- meta

- metoder

- kanske

- miljon

- modell

- modeller

- mer

- Dessutom

- mest

- Motivation

- MS

- multipel

- Behöver

- Nya

- nlp

- roman

- objektet

- Objektdetektion

- objekt

- få

- of

- on

- ONE

- nätet

- beställa

- Övriga

- konturer

- utklassar

- produktion

- särskilt

- Personer

- prestanda

- personen

- växter

- plato

- Platon Data Intelligence

- PlatonData

- Punkt

- poäng

- Pops

- potentiell

- den mäktigaste

- Innan

- Problem

- problem

- process

- producera

- yrkesmän/kvinnor

- projektet

- rätt

- ge

- publicly

- syfte

- kvalitet

- fråga

- snabbt

- område

- Läsning

- verklig

- verkliga världen

- realtid

- realistisk

- nyligen

- erkännande

- känner igen

- reducerande

- förfina

- Reflektioner

- om

- regioner

- ta bort

- ersätta

- representerar

- förfrågningar

- kräver

- Obligatorisk

- krav

- forskning

- Svara

- Resultat

- avslöjade

- Granskad

- revolutionera

- robusthet

- s

- Sam

- scenarier

- scen

- scener

- vetenskapsmän

- segmentet

- segmentering

- väljer

- separerande

- flera

- Forma

- former

- skall

- Enkelt

- simulering

- enda

- storlekar

- skicklighet

- So

- lösning

- LÖSA

- Lösa

- några

- Källor

- specifik

- fart

- Steg

- Fortfarande

- okomplicerad

- stark

- ämne

- sådana

- övervakning

- Ta

- uppgift

- uppgifter

- grupp

- Teknologi

- den där

- Smakämnen

- Området

- Framtiden

- Galleriet

- världen

- deras

- Dem

- Dessa

- saker

- tidskrävande

- Tips

- tips och tricks

- till

- verktyg

- verktyg

- Spårning

- tränad

- Utbildning

- överföring

- Förvandla

- Osäkerhet

- förståelse

- unika

- användning

- användare

- utnyttja

- mängd

- olika

- fordon

- Video

- Video

- Virtuell

- syn

- Sätt..

- sätt

- webb

- webbläsare

- VÄL

- Vad

- Vad är

- som

- medan

- VEM

- bred

- Brett utbud

- kommer

- med

- utan

- Arbete

- världen

- Din

- zephyrnet