Bild av redaktör

Uppkomsten av Graphical Processing Units (GPU) och den exponentiella beräkningskraften de låser upp har varit en vattendelare för både nystartade företag och företag.

GPU:er ger imponerande beräkningskraft för att utföra komplexa uppgifter som involverar teknik som AI, maskininlärningoch 3D-rendering.

Men när det gäller att utnyttja detta överflöd av beräkningskraft, står teknikvärlden vid ett vägskäl när det gäller den idealiska lösningen. Ska du bygga en dedikerad GPU-maskin eller använda GPU-molnet?

Den här artikeln går in i hjärtat av den här debatten och analyserar kostnadskonsekvenserna, prestandamåtten och skalbarhetsfaktorerna för varje alternativ.

GPU:er (Graphical Processing Units) är datorchips som är designade för att snabbt återge grafik och bilder genom att utföra matematiska beräkningar nästan omedelbart. Historiskt sett var GPU:er ofta förknippade med personliga speldatorer, men de används också i professionell datoranvändning, med framsteg inom teknik som kräver ytterligare datorkraft.

GPU:er utvecklades ursprungligen för att minska arbetsbelastningen som läggs på CPU:n av moderna, grafikintensiva applikationer, som renderar 2D- och 3D-grafik med parallell bearbetning, en metod som innebär att flera processorer hanterar olika delar av en enda uppgift.

I affärer är denna metod effektiv för att accelerera arbetsbelastningen och tillhandahålla tillräckligt med processorkraft för att möjliggöra projekt som artificiell intelligens (AI) och maskininlärning (ML) modellering.

Användningsfall för GPU

GPU:er har utvecklats under de senaste åren och blivit mycket mer programmerbara än sina tidigare motsvarigheter, vilket gör att de kan användas i ett brett spektrum av användningsfall, som:

- Snabb rendering av 2D- och 3D-grafiska applikationer i realtid, med programvara som Blender och ZBrush

- Videoredigering och skapande av videoinnehåll, särskilt bitar som är i 4k, 8k eller har en hög bildfrekvens

- Ger den grafiska kraften för att visa videospel på moderna skärmar, inklusive 4k.

- Accelererande maskininlärningsmodeller, från grundläggande bildkonvertering till jpg att distribuera skräddarsydda modeller med fullfjädrade front-ends på några minuter

- Dela CPU-arbetsbelastningar för att leverera högre prestanda i en rad applikationer

- Tillhandahåller beräkningsresurser för att träna djupa neurala nätverk

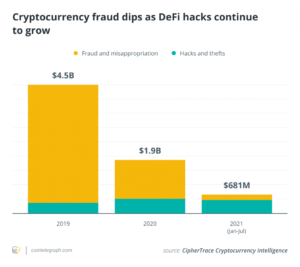

- Bryta kryptovalutor som Bitcoin och Ethereum

Med fokus på utvecklingen av neurala nätverk består varje nätverk av noder som var och en utför beräkningar som en del av en bredare analytisk modell.

GPU:er kan förbättra prestandan för dessa modeller i ett nätverk för djupinlärning tack vare den större parallella bearbetningen, vilket skapar modeller som har högre feltolerans. Som ett resultat finns det nu många GPU:er på marknaden som har byggts specifikt för djupinlärningsprojekt, som den nyligen annonserade H200.

Många företag, särskilt nystartade företag väljer att bygga sina egna GPU-maskiner på grund av deras kostnadseffektivitet, samtidigt som de erbjuder samma prestanda som en GPU molnlösning. Därmed inte sagt att ett sådant projekt inte kommer med utmaningar.

I det här avsnittet kommer vi att diskutera för- och nackdelar med att bygga en GPU-maskin, inklusive de förväntade kostnaderna och hanteringen av maskinen, vilket kan påverka faktorer som säkerhet och skalbarhet.

Varför bygga din egen GPU-maskin?

Den viktigaste fördelen med att bygga en GPU-maskin på plats är kostnaden, men ett sådant projekt är inte alltid möjligt utan betydande intern expertis. Pågående underhåll och framtida modifieringar är också överväganden som kan göra en sådan lösning olämplig. Men om en sådan konstruktion ligger inom ditt teams kapacitet, eller om du har hittat en tredjepartsleverantör som kan leverera projektet åt dig, kan de ekonomiska besparingarna bli betydande.

Att bygga en skalbar GPU-maskin för djupinlärningsprojekt rekommenderas, särskilt när man överväger hyreskostnaderna för moln-GPU-tjänster som t.ex. Amazon Web Services EC2, Google Cloud, eller Microsoft Azure. Även om en hanterad tjänst kan vara idealisk för organisationer som vill starta sitt projekt så snart som möjligt.

Låt oss överväga de två huvudsakliga fördelarna med en lokal, självbyggd GPU-maskin, kostnad och prestanda.

Kostar

Om en organisation utvecklar ett djupt neuralt nätverk med stora datamängder för artificiell intelligens och maskininlärningsprojekt, kan driftskostnaderna ibland skjuta i höjden. Detta kan hindra utvecklare från att leverera de avsedda resultaten under modellträning och begränsa projektets skalbarhet. Som ett resultat kan de ekonomiska konsekvenserna resultera i en nedskalad produkt, eller till och med en modell som inte är lämplig för ändamålet.

Att bygga en GPU-maskin som är på plats och självstyrd kan bidra till att minska kostnaderna avsevärt, vilket ger utvecklare och dataingenjörer de resurser de behöver för omfattande iteration, testning och experiment.

Detta skrapar dock bara på ytan när det gäller lokalt byggda och körda GPU-maskiner, speciellt för LLM:er med öppen källkod, som blir mer populära. Med tillkomsten av faktiska användargränssnitt kan du snart träffa din vänliga granntandläkare kör ett par 4090s i bakrummet för saker såsom försäkringsverifiering, schemaläggning, datakorsreferenser och mycket mer.

prestanda

Omfattande träningsmodeller/algoritmer för djupinlärning och maskininlärning kräver mycket resurser, vilket innebär att de behöver extremt högpresterande bearbetningsmöjligheter. Detsamma kan sägas om organisationer som behöver göra videor av hög kvalitet, med anställda som kräver flera GPU-baserade system eller en toppmodern GPU-server.

Självbyggda GPU-drivna system rekommenderas för produktionsdatamodeller och deras utbildning, med vissa GPU:er som kan ge dubbel precision, en funktion som representerar tal som använder 64 bitar, vilket ger ett större värdeintervall och bättre decimalprecision. Denna funktionalitet krävs dock endast för modeller som förlitar sig på mycket hög precision. Ett rekommenderat alternativ för ett dubbelprecisionssystem är Nvidias lokala Titan-baserade GPU-server.

Verksamhet

Många organisationer saknar expertis och förmåga att hantera GPU-maskiner och servrar på plats. Detta beror på att ett internt IT-team skulle behöva experter som kan konfigurera GPU-baserad infrastruktur för att uppnå högsta prestandanivå.

Dessutom kan hans bristande expertis leda till bristande säkerhet, vilket resulterar i sårbarheter som kan riktas mot cyberbrottslingar. Behovet av att skala systemet i framtiden kan också utgöra en utmaning.

Lokala GPU-maskiner ger tydliga fördelar vad gäller prestanda och kostnadseffektivitet, men bara om organisationer har de nödvändiga experterna internt. Det är därför många organisationer väljer att använda GPU-molntjänster, såsom Saturn Cloud som är helt hanterat för ökad enkelhet och sinnesfrid.

Cloud GPU-lösningar gör djupinlärningsprojekt mer tillgängliga för ett bredare utbud av organisationer och industrier, med många system som kan matcha prestandanivåerna hos egenbyggda GPU-maskiner. Framväxten av GPU-molnlösningar är en av de främsta anledningarna till att människor är det investera i AI-utveckling mer och mer, speciellt öppen källkodsmodeller som Mistral, vars öppen källkod är skräddarsydd för "uthyrningsbart vRAM" och kör LLM:er utan att vara beroende av större leverantörer, som OpenAI eller Anthropic.

Kostar

Beroende på organisationens behov eller modellen som utbildas, a cloud GPU-lösning skulle kunna fungera billigare, förutsatt att de timmar som behövs varje vecka är rimliga. För mindre, mindre datatunga projekt, finns det förmodligen inget behov av att investera i ett par kostsamma H100:or, med GPU-molnlösningar tillgängliga på kontraktsbasis, såväl som i form av olika månadsplaner, för att tillgodose alla entusiasten. vägen till företagande.

prestanda

Det finns en mängd CPU-molnalternativ som kan matcha prestandanivåerna för en DIY GPU-maskin, vilket ger optimalt balanserade processorer, exakt minne, en högpresterande disk och åtta GPU:er per instans för att hantera individuella arbetsbelastningar. Naturligtvis kan dessa lösningar komma till en kostnad, men organisationer kan ordna timfakturering för att säkerställa att de bara betalar för det de använder.

Verksamhet

Den viktigaste fördelen med en moln-GPU jämfört med en GPU-konstruktion ligger i dess verksamhet, med ett team av expertingenjörer tillgängliga för att hjälpa till med alla problem och ge teknisk support. En lokal GPU-maskin eller server måste hanteras internt, annars måste ett tredjepartsföretag hantera den på distans, mot en extra kostnad.

Med en GPU-molntjänst kan alla problem som nätverksavbrott, programuppdateringar, strömavbrott, utrustningsfel eller otillräckligt diskutrymme åtgärdas snabbt. Faktum är att med en helt hanterad lösning är det osannolikt att dessa problem uppstår alls eftersom GPU-servern kommer att vara optimalt konfigurerad för att undvika överbelastningar och systemfel. Detta innebär att IT-team kan fokusera på verksamhetens kärnbehov.

Att välja mellan att bygga en GPU-maskin eller använda GPU-molnet beror på användningsfallet, med stora dataintensiva projekt som kräver extra prestanda utan att det ådrar sig betydande kostnader. I det här scenariot kan ett självbyggt system erbjuda den prestanda som krävs utan höga månatliga kostnader.

Alternativt, för organisationer som saknar intern expertis eller kanske inte kräver toppprestanda, kan en hanterad cloud GPU-lösning vara att föredra, där maskinens hantering och underhåll tas om hand av leverantören.

Nahla Davies är en mjukvaruutvecklare och teknikskribent. Innan hon ägnade sitt arbete heltid åt tekniskt skrivande lyckades hon – bland annat spännande – att fungera som ledande programmerare på en Inc. 5,000 XNUMX erfarenhetsbaserad varumärkesorganisation vars kunder inkluderar Samsung, Time Warner, Netflix och Sony.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://www.kdnuggets.com/building-a-gpu-machine-vs-using-the-gpu-cloud?utm_source=rss&utm_medium=rss&utm_campaign=building-a-gpu-machine-vs-using-the-gpu-cloud

- : har

- :är

- :inte

- 000

- 2D

- 3d

- 3D-rendering

- 4k

- 8k

- a

- Able

- överflöd

- accelererande

- tillgänglig

- exakt

- Uppnå

- tvärs

- faktiska

- lagt till

- Annat

- framsteg

- Fördel

- fördelar

- första advent

- rådde

- AI

- algoritmer

- lika

- Alla

- tillåta

- nästan

- också

- Även

- alltid

- amason

- mängd

- an

- Analytisk

- och

- meddelade

- Antropisk

- vilken som helst

- tillämpningar

- ÄR

- array

- Artikeln

- konstgjord

- artificiell intelligens

- Konstgjord intelligens (AI)

- Konstgjord intelligens och maskininlärning

- AS

- bistå

- associerad

- At

- tillgänglig

- undvika

- Balanserad

- grundläggande

- grund

- BE

- därför att

- passande

- varit

- innan

- Där vi får lov att vara utan att konstant prestera,

- fördel

- Fördelarna

- Bättre

- mellan

- fakturering

- Bitcoin

- bitcoin och ethereum

- Blandare

- branding

- Fördelning

- SLUTRESULTAT

- Byggnad

- byggt

- företag

- företag

- men

- by

- KAN

- kapacitet

- kapabel

- vilken

- Vid

- fall

- catering

- utmanar

- utmaningar

- billigare

- Pommes frites

- Välja

- klar

- klienter

- cloud

- molntjänster

- CNBC

- COM

- komma

- kommer

- kommande

- företag

- fullborda

- komplex

- beräkningar

- beräkningskraft

- dator

- datorer

- databehandling

- beräkningskraft

- konfigurerad

- konfigurering

- Nackdelar

- Tänk

- överväganden

- med tanke på

- består

- innehåll

- innehållsskapande

- avtals

- Konvertering

- Kärna

- Pris

- kostsam

- Kostar

- kunde

- motsvarigheter

- Par

- Naturligtvis

- CPU

- Skapa

- skapande

- korsreferenser

- Vägkorsning

- cryptocurrencies

- nätbrottslingar

- datum

- datauppsättningar

- diskussion

- dedicerad

- djup

- djupt lärande

- djupt neuralt nätverk

- djupa neurala nätverk

- leverera

- leverera

- beroende

- beror

- utplacera

- utformade

- utvecklade

- Utvecklare

- utvecklare

- utveckla

- Utveckling

- olika

- diskutera

- Visa

- displayer

- diy

- gör

- grund

- under

- varje

- Tidigare

- redigering

- Effektiv

- uppkomst

- anställda

- möjliggöra

- Ingenjörer

- förbättra

- tillräckligt

- säkerställa

- Företag

- entusiast

- Utrustning

- speciellt

- ethereum

- Även

- utvecklats

- förväntat

- erfarenhetsmässig

- expert

- expertis

- experter

- exponentiell

- omfattande

- extremt

- Faktum

- faktorer

- Misslyckande

- misslyckanden

- Leverans

- finansiella

- passa

- fixerad

- Fokus

- För

- För nystartade

- formen

- hittade

- RAM

- vänliga

- från

- full

- fullfjädrad

- fullständigt

- funktionalitet

- framtida

- Games

- Gaming

- GPU

- GPUs

- grafik

- större

- Odling

- hantera

- Arbetsmiljö

- Utnyttja

- Har

- Hjärta

- hjälpa

- här

- Hög

- högpresterande

- högpresterande

- hög kvalitet

- högre

- högsta

- hindra

- hans

- historiskt

- ÖPPETTIDER

- Men

- html

- http

- HTTPS

- idealisk

- if

- bilder

- Inverkan

- implikationer

- imponerande

- in

- Inc.

- innefattar

- Inklusive

- individuellt

- industrier

- Infrastruktur

- initialt

- exempel

- ögonblickligen

- försäkring

- Intelligens

- avsedd

- in

- fängslande

- Invest

- engagera

- innebär

- problem

- IT

- iteration

- DESS

- KDnuggets

- Nyckel

- Brist

- Large

- större

- leda

- inlärning

- mindre

- Nivå

- nivåer

- tycka om

- BEGRÄNSA

- lokalt

- du letar

- Lot

- Maskinen

- maskininlärning

- Maskiner

- Huvudsida

- underhåll

- göra

- hantera

- förvaltade

- ledning

- många

- marknad

- Match

- matematisk

- Materia

- Maj..

- betyder

- betyder

- Minne

- metod

- Metodik

- Metrics

- Microsoft

- kanske

- emot

- ML

- modell

- modellering

- modeller

- Modern Konst

- modifieringar

- ögonblick

- månad

- mer

- mycket

- multipel

- Natur

- Behöver

- behövs

- behov

- Netflix

- nät

- nätverk

- neural

- neurala nätverk

- neurala nätverk

- Nej

- noder

- nu

- nummer

- talrik

- Nvidia

- inträffa

- of

- erbjudanden

- erbjuda

- Ofta

- on

- ONE

- pågående

- endast

- öppen källkod

- OpenAI

- drift

- Verksamhet

- Alternativet

- Tillbehör

- or

- organisation

- organisationer

- Övriga

- ut

- avbrott

- utfall

- över

- egen

- par

- Parallell

- del

- reservdelar till din klassiker

- Betala

- fred

- Personer

- för

- utföra

- prestanda

- personlig

- bitar

- placeras

- planer

- plato

- Platon Data Intelligence

- PlatonData

- möjlig

- kraft

- Precision

- bättre

- presentera

- förmodligen

- bearbetning

- Process kraft

- processorer

- Produkt

- professionell

- programmerbar

- Programmerare

- projektet

- projekt

- PROS

- ge

- leverantör

- leverantörer

- tillhandahålla

- Syftet

- snabbt

- område

- snabbt

- Betygsätta

- realtid

- rimlig

- skäl

- senaste

- nyligen

- rekommenderas

- minska

- förlita

- distans

- rendering

- kräver

- Obligatorisk

- Resurser

- resultera

- resulterande

- Körning

- rinnande

- Nämnda

- Samma

- Samsung

- Saturn

- Besparingar

- säga

- skalbarhet

- skalbar

- Skala

- scenario

- schemaläggning

- §

- säkerhet

- se

- tjänar

- server

- servrar

- service

- Tjänster

- hon

- skall

- signifikant

- enkelhet

- enda

- raket

- mindre

- Mjukvara

- lösning

- Lösningar

- några

- ibland

- Sony

- Alldeles strax

- Utrymme

- specifikt

- står

- starta

- Startups

- state-of-the-art

- Fortfarande

- sådana

- stödja

- yta

- system

- System

- tagen

- riktade

- uppgift

- uppgifter

- grupp

- lag

- tech

- Teknisk

- teknisk support

- Teknologi

- villkor

- Testning

- än

- tack

- den där

- Smakämnen

- Framtiden

- deras

- Dem

- sedan

- Där.

- Dessa

- de

- saker

- tredje part

- detta

- tid

- till

- tolerans

- Tåg

- tränad

- Utbildning

- två

- enheter

- osannolik

- låsa

- Uppdateringar

- användning

- användningsfall

- Begagnade

- med hjälp av

- utnyttja

- Värden

- olika

- leverantör

- mycket

- Video

- videospel

- Video

- vs

- sårbarheter

- Warner

- Sätt..

- we

- webb

- webbservice

- vecka

- VÄL

- były

- Vad

- när

- som

- medan

- VEM

- vars

- varför

- bred

- Brett utbud

- bredare

- kommer

- med

- inom

- utan

- Arbete

- träna

- världen

- skulle

- författare

- skrivning

- år

- dig

- Din

- zephyrnet