Generativ artificiell intelligens (AI)-applikationer byggda kring stora språkmodeller (LLM) har visat potentialen att skapa och accelerera ekonomiskt värde för företag. Exempel på applikationer är konversationssökning, hjälp med kundsupport, kundsupportanalys, virtuella självbetjäningsassistenter, chatbots, rik media generation, innehållsmått, kodningskamrater för att påskynda säker, högpresterande mjukvaruutveckling, djupare insikter från multimodala innehållskällor, acceleration av din organisations säkerhetsutredningar och begränsningar, och mycket mer. Många kunder letar efter vägledning om hur man hanterar säkerhet, integritet och efterlevnad när de utvecklar generativa AI-applikationer. Att förstå och hantera LLM-sårbarheter, hot och risker under design- och arkitekturfaserna hjälper teamen att fokusera på att maximera de ekonomiska och produktivitetsfördelar som generativ AI kan ge. Att vara medveten om risker främjar transparens och förtroende för generativa AI-tillämpningar, uppmuntrar ökad observerbarhet, hjälper till att uppfylla efterlevnadskrav och underlättar välgrundat beslutsfattande för ledare.

Målet med det här inlägget är att ge AI och maskininlärning (ML) ingenjörer, datavetare, lösningsarkitekter, säkerhetsteam och andra intressenter möjlighet att ha en gemensam mental modell och ramverk för att tillämpa bästa praxis för säkerhet, så att AI/ML-team kan flytta snabbt utan att byta ut säkerhet mot hastighet. Specifikt syftar det här inlägget till att hjälpa AI/ML och datavetare som kanske inte tidigare har varit utsatta för säkerhetsprinciper att få en förståelse för bästa praxis för kärnsäkerhet och integritet i samband med att utveckla generativa AI-applikationer med hjälp av LLM. Vi diskuterar också vanliga säkerhetsproblem som kan undergräva förtroendet för AI, som identifierats av Öppna Worldwide Application Security Project (OWASP) Topp 10 för LLM-applikationer, och visa hur du kan använda AWS för att öka din säkerhetsställning och ditt självförtroende samtidigt som du förnyar med generativ AI.

Det här inlägget ger tre guidade steg för att utforma riskhanteringsstrategier samtidigt som man utvecklar generativa AI-applikationer med hjälp av LLM. Vi fördjupar oss först i sårbarheterna, hoten och riskerna som uppstår vid implementering, driftsättning och användning av LLM-lösningar, och ger vägledning om hur du börjar förnya med säkerhet i åtanke. Vi diskuterar sedan hur det är viktigt att bygga på en säker grund för generativ AI. Slutligen kopplar vi samman dessa med ett exempel på LLM-arbetsbelastning för att beskriva ett tillvägagångssätt för arkitektur med försvarsdjupgående säkerhet över förtroendegränser.

I slutet av detta inlägg, AI/ML-ingenjörer, datavetare och säkerhetsinriktade teknologer kommer att kunna identifiera strategier för att skapa skiktade försvar för sina generativa AI-applikationer, förstå hur man kartlägger OWASP Top 10 för LLMs säkerhetsproblem till vissa motsvarande kontroller och bygger grundläggande kunskap mot besvara följande vanliga AWS-kundfrågor för deras applikationer:

- Vilka är några av de vanliga säkerhets- och integritetsriskerna med att använda generativ AI baserad på LLM i mina applikationer som jag kan påverka mest med den här vägledningen?

- Vilka är några sätt att implementera säkerhets- och integritetskontroller i utvecklingslivscykeln för generativa AI LLM-applikationer på AWS?

- Vilka operativa och tekniska bästa praxis kan jag integrera i hur min organisation bygger generativa AI LLM-applikationer för att hantera risker och öka förtroendet för generativa AI-applikationer som använder LLM?

Förbättra säkerhetsresultaten samtidigt som du utvecklar generativ AI

Innovation med generativ AI med hjälp av LLM:er kräver att man börjar med säkerhet i åtanke för att utveckla organisatorisk motståndskraft, bygga på en säker grund och integrera säkerhet med ett försvar på djupet. Säkerhet är en delat ansvar mellan AWS och AWS kunder. Alla principer för AWS Shared Responsibility Model är tillämpliga på generativa AI-lösningar. Uppdatera din förståelse för AWS Shared Responsibility Model som den gäller för infrastruktur, tjänster och data när du bygger LLM-lösningar.

Börja med säkerhet i åtanke för att utveckla organisatorisk motståndskraft

Börja med säkerhet i åtanke för att utveckla organisatorisk motståndskraft för att utveckla generativa AI-applikationer som uppfyller dina säkerhets- och efterlevnadsmål. Organisatorisk motståndskraft bygger på och förlänger definition av resiliens i AWS Well-Architected Framework att inkludera och förbereda en organisations förmåga att återhämta sig från störningar. Tänk på din säkerhetsställning, styrning och operativa excellens när du bedömer den övergripande beredskapen att utveckla generativ AI med LLM:er och din organisations motståndskraft mot eventuella effekter. När din organisation utvecklar sin användning av framväxande teknologier som generativ AI och LLM, bör övergripande organisatorisk motståndskraft betraktas som en hörnsten i en defensiv strategi för att skydda tillgångar och affärsområden från oavsiktliga konsekvenser.

Organisatorisk motståndskraft har stor betydelse för LLM-applikationer

Även om alla riskhanteringsprogram kan dra nytta av motståndskraft, är organisatorisk motståndskraft väsentligt för generativ AI. Fem av de OWASP-identifierade topp 10-riskerna för LLM-applikationer är beroende av att definiera arkitektoniska och operativa kontroller och genomdriva dem i en organisatorisk skala för att hantera risker. Dessa fem risker är osäker utdatahantering, sårbarheter i försörjningskedjan, avslöjande av känslig information, överdriven byråkrati och övertillit. Börja öka den organisatoriska motståndskraften genom att socialisera dina team för att betrakta AI, ML och generativ AI-säkerhet som ett kärnverksamhetskrav och högsta prioritet under hela produktens livscykel, från idéstart till forskning, till applikationens utveckling, implementering och använda sig av. Förutom medvetenhet bör dina team vidta åtgärder för att ta hänsyn till generativ AI i förvaltnings-, garanti- och efterlevnadsvalideringsmetoder.

Bygg organisatorisk motståndskraft kring generativ AI

Organisationer kan börja anta sätt att bygga sin kapacitet och kapacitet för AI/ML och generativ AI-säkerhet inom sina organisationer. Du bör börja med att utöka dina befintliga säkerhets-, garanti-, efterlevnads- och utvecklingsprogram för att ta hänsyn till generativ AI.

Följande är de fem nyckelområdena av intresse för organisatorisk AI, ML och generativ AI-säkerhet:

- Förstå AI/ML-säkerhetslandskapet

- Inkludera olika perspektiv i säkerhetsstrategier

- Vidta åtgärder proaktivt för att säkra forsknings- och utvecklingsaktiviteter

- Anpassa incitament till organisatoriska resultat

- Förbered dig på realistiska säkerhetsscenarier i AI/ML och generativ AI

Utveckla en hotmodell genom hela din generativa AI-livscykel

Organisationer som bygger med generativ AI bör fokusera på riskhantering, inte riskeliminering, och inkludera hotmodellering in och affärs kontinuitetsplanering planering, utveckling och drift av generativa AI-arbetsbelastningar. Arbeta bakåt från produktionsanvändning av generativ AI genom att utveckla en hotmodell för varje applikation med traditionella säkerhetsrisker såväl som generativa AI-specifika risker. Vissa risker kan vara acceptabla för ditt företag, och en hotmodelleringsövning kan hjälpa ditt företag att identifiera vad din acceptabla riskaptit är. Till exempel kanske ditt företag inte kräver 99.999 % drifttid på en generativ AI-applikation, så den extra återhämtningstiden som är kopplad till återställning med hjälp av AWS backup med Amazon S3-glaciären kan vara en acceptabel risk. Omvänt kan data i din modell vara extremt känsliga och mycket reglerade, så avvikelse från AWS nyckelhanteringstjänst (AWS KMS) kundhanterad nyckel (CMK) rotation och användning av AWS nätverksbrandvägg Att hjälpa till att upprätthålla Transport Layer Security (TLS) för inkommande och utgående trafik för att skydda mot dataexfiltrering kan vara en oacceptabel risk.

Utvärdera riskerna (inneboende kontra resterande) med att använda den generativa AI-applikationen i en produktionsmiljö för att identifiera rätt grundläggande kontroller och kontroller på applikationsnivå. Planera för återställning och återhämtning från produktionssäkerhetshändelser och serviceavbrott som snabb injektion, utbildningsdataförgiftning, modellnedsättning av service och modellstöld tidigt, och definiera de begränsningar du kommer att använda när du definierar applikationskrav. Att lära sig om de risker och kontroller som måste införas kommer att hjälpa till att definiera den bästa implementeringsmetoden för att bygga en generativ AI-applikation, och ge intressenter och beslutsfattare information för att fatta välgrundade affärsbeslut om risker. Om du inte är bekant med det övergripande AI- och ML-arbetsflödet, börja med att granska 7 sätt att förbättra säkerheten för dina maskininlärningsbelastningar för att öka förtrogenhet med de säkerhetskontroller som behövs för traditionella AI/ML-system.

Precis som att bygga vilken ML-applikation som helst, innebär att bygga en generativ AI-applikation att gå igenom en uppsättning forsknings- och utvecklingsstadier. Du kanske vill granska AWS Generativ AI Security Scoping Matrix för att hjälpa till att bygga en mental modell för att förstå de viktigaste säkerhetsdisciplinerna som du bör överväga beroende på vilken generativ AI-lösning du väljer.

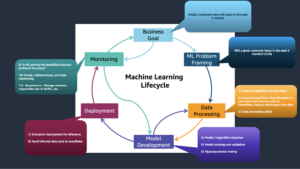

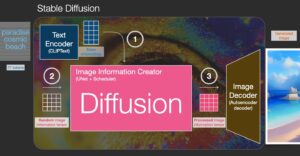

Generativa AI-applikationer som använder LLM:er utvecklas och drivs vanligtvis enligt beställda steg:

- Ansökningskrav – Identifiera affärsmål, krav och framgångskriterier för användningsfall

- Modellval – Välj en grundmodell som överensstämmer med användningsfallskraven

- Modellanpassning och finjustering – Förbered data, konstruera meddelanden och finjustera modellen

- Modellutvärdering – Utvärdera grundmodeller med användningsfallsspecifika mätetal och välj den modell som ger bäst resultat

- Implementering och integration – Implementera den valda grundmodellen på din optimerade infrastruktur och integrera med din generativa AI-applikation

- Applikationsövervakning – Övervaka applikations- och modellprestanda för att möjliggöra rotorsaksanalys

Se till att teamen förstår säkerhetens kritiska natur som en del av design- och arkitekturfaserna i din mjukvaruutvecklingslivscykel på dag 1. Det innebär att diskutera säkerheten på varje lager av din stack och livscykel, och placera säkerhet och integritet som möjliggörare för att uppnå affärsmål. Arkitekt kontrollerar för hot innan du startar din LLM-applikation och överväg om den data och information du kommer att använda för modellanpassning och finjustering garanterar implementeringen i forsknings-, utvecklings- och utbildningsmiljöer. Som en del av kvalitetssäkringstester, introducera syntetiska säkerhetshot (som att försöka förgifta träningsdata eller försöka extrahera känslig data genom skadlig snabbteknik) för att testa ditt försvar och din säkerhetsställning regelbundet.

Dessutom bör intressenter upprätta en konsekvent granskningsfrekvens för produktions-AI, ML och generativa AI-arbetsbelastningar och sätta organisatorisk prioritet på att förstå avvägningar mellan mänsklig och maskinkontroll och fel före lansering. Att validera och säkerställa att dessa avvägningar respekteras i de utplacerade LLM-applikationerna kommer att öka sannolikheten för framgång för riskreducering.

Bygg generativa AI-applikationer på säkra molnfundament

Hos AWS är säkerhet vår högsta prioritet. AWS är utformad för att vara den säkraste globala molninfrastrukturen för att bygga, migrera och hantera applikationer och arbetsbelastningar. Detta stöds av vår djupa uppsättning av över 300 molnsäkerhetsverktyg och förtroendet från våra miljontals kunder, inklusive de mest säkerhetskänsliga organisationerna som myndigheter, sjukvård och finansiella tjänster. När du bygger generativa AI-applikationer med hjälp av LLM:er på AWS får du säkerhetsfördelar med säker, pålitlig och flexibel AWS Cloud computing-miljö.

Använd en global AWS-infrastruktur för säkerhet, integritet och efterlevnad

När du utvecklar dataintensiva applikationer på AWS kan du dra nytta av en AWS global region-infrastruktur, utformad för att tillhandahålla kapacitet för att möta dina kärnsäkerhets- och efterlevnadskrav. Detta förstärks av vårt AWS digitala suveränitetslöfte, vårt åtagande att erbjuda dig den mest avancerade uppsättningen suveränitetskontroller och funktioner som finns tillgängliga i molnet. Vi är fast beslutna att utöka våra möjligheter så att du kan möta dina digital suveränitet behov, utan att kompromissa med AWS-molnets prestanda, innovation, säkerhet eller skala. För att förenkla implementeringen av bästa praxis för säkerhet och integritet, överväg att använda referensdesigner och infrastruktur som kodresurser, t.ex. AWS Security Reference Architecture (AWS SRA) och AWS Privacy Reference Architecture (AWS PRA). Läs mer om utforma sekretesslösningar, suveränitet genom designoch efterlevnad av AWS och använda tjänster som t.ex AWS -konfigur, AWS artefaktoch AWS revisionschef för att stödja dina behov av integritet, efterlevnad, revision och observerbarhet.

Förstå din säkerhetsställning med hjälp av AWS Well-Architected och Cloud Adoption Frameworks

AWS erbjuder bästa praxis-vägledning utvecklad från många års erfarenhet av att stödja kunder i att utforma sina molnmiljöer med AWS välarkitekterade ramverk och i att utvecklas för att realisera affärsvärde från molnteknologier med AWS Cloud Adoption Framework (AWS CAF). Förstå säkerhetsställningen för dina AI-, ML- och generativa AI-arbetsbelastningar genom att utföra en Well-Architected Framework-granskning. Granskningar kan utföras med hjälp av verktyg som AWS välbyggt verktyg, eller med hjälp av ditt AWS-team genom AWS Enterprise Support. AWS välbyggda verktyg integrerar automatiskt insikter från AWS Trusted Advisor att utvärdera vilka bästa praxis som finns och vilka möjligheter som finns för att förbättra funktionalitet och kostnadsoptimering. AWS Well-Architected Tool erbjuder också skräddarsydda linser med specifika bästa praxis som Maskininlärningsobjektiv för att du regelbundet ska mäta dina arkitekturer mot bästa praxis och identifiera förbättringsområden. Kontrollera din resa på vägen till värdeförverkligande och molnmognad genom att förstå hur AWS-kunder antar strategier för att utveckla organisatoriska kapaciteter i AWS Cloud Adoption Framework för artificiell intelligens, maskininlärning och generativ AI. Du kan också ha nytta av att förstå din övergripande molnberedskap genom att delta i en AWS Cloud Readiness Assessment. AWS erbjuder ytterligare möjligheter till engagemang – fråga ditt AWS-kontoteam för mer information om hur du kommer igång med Generativt AI Innovation Center.

Accelerera din säkerhet och AI/ML-inlärning med vägledning, utbildning och certifiering av bästa praxis

AWS kurerar också rekommendationer från Bästa praxis för säkerhet, identitet och efterlevnad och AWS säkerhetsdokumentation för att hjälpa dig att identifiera sätt att säkra din utbildning, utveckling, testning och operativa miljöer. Om du precis har börjat, dyka djupare på säkerhetsutbildning och certifiering, överväg att börja med Grunderna för AWS-säkerhet och AWS Security Learning Plan. Du kan också använda AWS säkerhetsmognadsmodell för att hjälpa dig att hitta och prioritera de bästa aktiviteterna i olika faser av mognad på AWS, med början med snabba vinster, genom grundläggande, effektiva och optimerade stadier. När du och dina team har en grundläggande förståelse för säkerhet på AWS rekommenderar vi starkt att du granskar dem Hur man närmar sig hotmodellering och sedan leda en hotmodelleringsövning med dina team som börjar med Workshop för hotmodellering för byggare träningsprogram. Det finns många andra AWS Säkerhetsutbildning och certifieringsresurser tillgängliga.

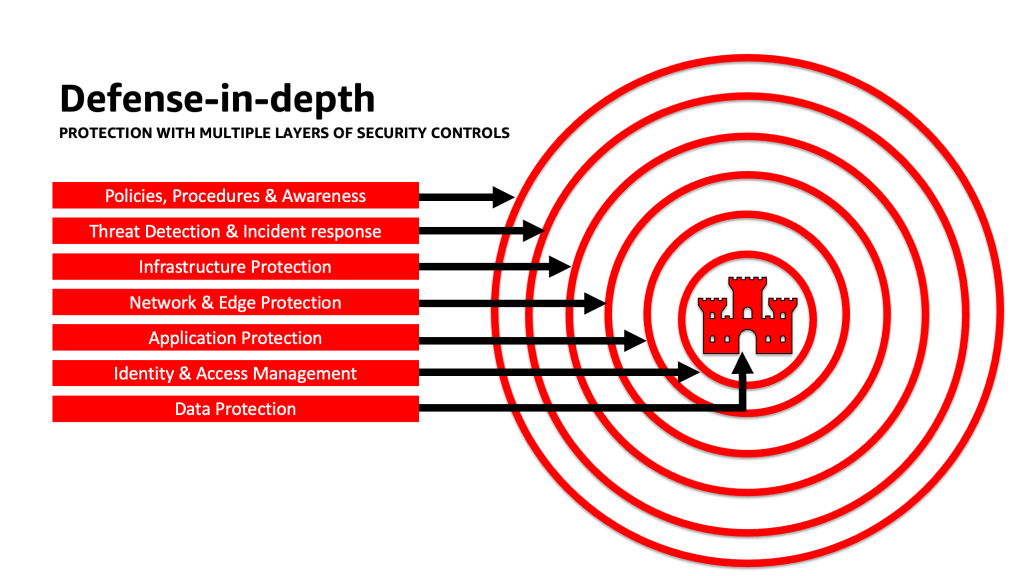

Tillämpa ett försvarsdjupgående tillvägagångssätt för att säkra LLM-applikationer

Att tillämpa en försvarsdjupgående säkerhetsstrategi för dina generativa AI-arbetsbelastningar, data och information kan bidra till att skapa de bästa förutsättningarna för att uppnå dina affärsmål. Bästa metoder för djupförsvarssäkerhet minskar många av de vanliga riskerna som alla arbetsbelastningar står inför, och hjälper dig och dina team att accelerera din generativa AI-innovation. En djupgående säkerhetsstrategi använder flera redundanta försvar för att skydda dina AWS-konton, arbetsbelastningar, data och tillgångar. Det hjälper till att säkerställa att om någon säkerhetskontroll äventyras eller misslyckas, finns ytterligare lager för att hjälpa till att isolera hot och förhindra, upptäcka, svara och återställa från säkerhetshändelser. Du kan använda en kombination av strategier, inklusive AWS-tjänster och -lösningar, på varje lager för att förbättra säkerheten och motståndskraften för dina generativa AI-arbetsbelastningar.

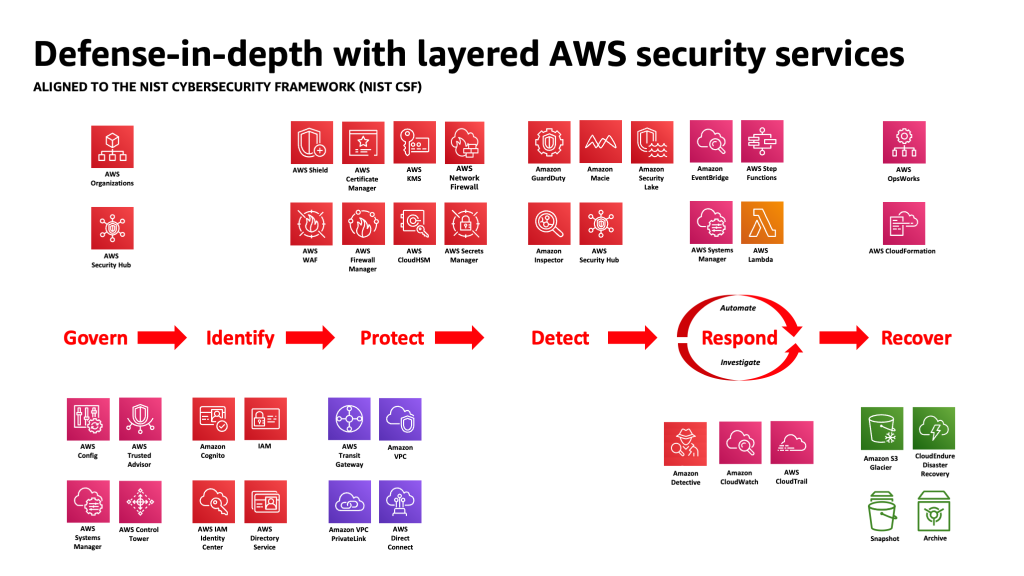

Många AWS-kunder anpassar sig till industristandardramverk, såsom NIST Cybersecurity Framework. Detta ramverk hjälper till att säkerställa att dina säkerhetsförsvar har skydd över pelarna Identify, Protect, Detect, Response, Recover och senast tillagda, Govern. Detta ramverk kan sedan enkelt mappas till AWS Security-tjänster och de från integrerade tredje parter för att hjälpa dig att validera adekvat täckning och policyer för alla säkerhetshändelser som din organisation stöter på.

Försvar på djupet: Säkra din miljö och lägg sedan till förbättrad AI/ML-specifik säkerhet och sekretessfunktioner

En djupgående försvarsstrategi bör börja med att skydda dina konton och organisation först, och sedan lägga på de ytterligare inbyggda säkerhets- och integritetsförbättrade funktionerna i tjänster som t.ex. Amazonas berggrund och Amazon SageMaker. Amazon har över 30 tjänster i portföljen säkerhet, identitet och efterlevnad som är integrerade med AWS AI/ML-tjänster och kan användas tillsammans för att säkra dina arbetsbelastningar, konton, organisation. För att försvara sig mot OWASP Top 10 för LLM bör dessa användas tillsammans med AWS AI/ML-tjänsterna.

Börja med att implementera en policy för minst privilegier, med hjälp av tjänster som IAM Access Analyzer till leta efter alltför tillåtande konton, roller och resurser för att begränsa åtkomst med kortvariga autentiseringsuppgifter. Se sedan till att all data i vila är krypterad med AWS KMS, inklusive med tanke på användningen av CMK:er, och att alla data och modeller är versionerade och säkerhetskopierade med Amazon enkel lagringstjänst (Amazon S3) versionering och applicering av oföränderlighet på objektnivå med Amazon S3 Objektlås. Skydda all data som transporteras mellan tjänster som använder AWS certifikathanterare och / eller AWS Privat CA, och förvara den inom VPC:er med hjälp av AWS PrivateLink. Definiera strikta regler för in- och utgående data för att skydda mot manipulation och exfiltrering med hjälp av VPC:er med AWS nätverksbrandvägg politik. Överväg att sätta in AWS Web Application Firewall (AWS WAF) framför till skydda webbapplikationer och API:er från skadliga bots, SQL-injektionsattacker, cross-site scripting (XSS), och kontouppköp med Bedrägerikontroll. Loggar med AWS CloudTrail, Amazon Virtual Private Cloud (Amazon VPC) flödesloggar och Amazon Elastic Kubernetes-tjänst (Amazon EKS) granskningsloggar hjälper till att tillhandahålla kriminalteknisk granskning av varje transaktion som är tillgänglig för tjänster som t.ex Amazon -detektiv. Du kan använda Amazon inspektör för att automatisera sårbarhetsupptäckt och -hantering för Amazon Elastic Compute Cloud (Amazon EC2) instanser, behållare, AWS Lambda funktioner och identifiera nätverkets tillgänglighet för dina arbetsbelastningar. Skydda dina data och modeller från misstänkt aktivitet med hjälp av Amazon Guard Dutys ML-drivna hotmodeller och intelligensflöden, och aktiverar dess ytterligare funktioner för EKS Protection, ECS Protection, S3 Protection, RDS Protection, Malware Protection, Lambda Protection och mer. Du kan använda tjänster som AWS Security Hub att centralisera och automatisera dina säkerhetskontroller för att upptäcka avvikelser från säkerhetspraxis och påskynda undersökningar och automatisera sanering av säkerhetsfynd med playbooks. Du kan också överväga att implementera en noll förtroende arkitektur på AWS för att ytterligare öka finkorniga autentiserings- och auktoriseringskontroller för vad mänskliga användare eller maskin-till-maskin-processer kan komma åt på en begäran. Överväg också att använda Amazon Security Lake för att automatiskt centralisera säkerhetsdata från AWS-miljöer, SaaS-leverantörer, lokaler och molnkällor till en specialbyggd datasjö som lagras i ditt konto. Med Security Lake kan du få en mer fullständig förståelse av dina säkerhetsdata i hela din organisation.

Efter att din generativa AI-arbetsmiljö har säkrats kan du lägga in AI/ML-specifika funktioner, som t.ex. Amazon SageMaker Data Wrangler för att identifiera potentiell fördom under databeredningen och Amazon SageMaker Clarify att upptäcka bias i ML-data och modeller. Du kan också använda Amazon SageMaker modellmonitor för att utvärdera kvaliteten på SageMaker ML-modeller i produktion, och meddela dig när det finns avvikelser i datakvalitet, modellkvalitet och funktionstillskrivning. Dessa AWS AI/ML-tjänster som arbetar tillsammans (inklusive SageMaker som arbetar med Amazon Bedrock) med AWS Security-tjänster kan hjälpa dig att identifiera potentiella källor till naturlig fördom och skydda mot skadlig datamanipulation. Upprepa denna process för var och en av OWASP Top 10 för LLM-sårbarheter för att säkerställa att du maximerar värdet av AWS-tjänster för att implementera försvar på djupet för att skydda dina data och arbetsbelastningar.

Som AWS Enterprise Strateg Clarke Rodgers skrev i sitt blogginlägg "CISO Insight: Varje AWS-tjänst är en säkerhetstjänst", "Jag skulle hävda att praktiskt taget varje tjänst inom AWS-molnet antingen möjliggör ett säkerhetsresultat i sig självt eller kan användas (enbart eller tillsammans med en eller flera tjänster) av kunder för att uppnå ett säkerhets-, risk- eller efterlevnadsmål." Och "Customer Chief Information Security Officers (CISOs) (eller deras respektive team) kanske vill ta sig tid att se till att de är väl insatta i alla AWS-tjänster eftersom det kan finnas ett säkerhets-, risk- eller efterlevnadsmål som kan uppfyllas, även om en tjänst inte faller inom kategorin "Säkerhet, identitet och efterlevnad".

Lagerförsvar vid förtroendegränser i LLM-applikationer

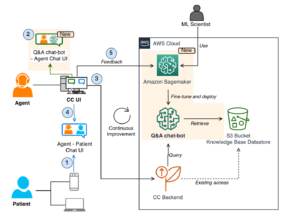

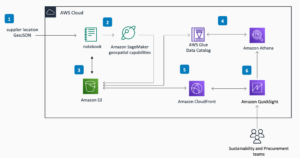

När du utvecklar generativa AI-baserade system och applikationer bör du överväga samma problem som med alla andra ML-applikationer, som nämns i MITRE ATLAS Machine Learning Threat Matrix, som att vara uppmärksam på ursprunget för programvara och datakomponenter (som att utföra en mjukvarugranskning med öppen källkod, granska mjukvaruförteckningar (SBOM) och analysera dataarbetsflöden och API-integrationer) och implementera nödvändiga skydd mot LLM-hot i leveranskedjan. Inkludera insikter från branschramverk och var medveten om sätt att använda flera källor till hotintelligens och riskinformation för att justera och utöka ditt säkerhetsförsvar för att ta hänsyn till AI, ML och generativa AI-säkerhetsrisker som är framväxande och inte ingår i traditionella ramverk. Sök efter medföljande information om AI-specifika risker från industri, försvar, statliga, internationella och akademiska källor, eftersom nya hot dyker upp och utvecklas i detta utrymme regelbundet och följeslagare och guider uppdateras ofta. Till exempel, när du använder en RAG-modell (Retrieval Augmented Generation) och om modellen inte innehåller den data den behöver, kan den begära den från en extern datakälla för användning under slutledning och finjustering. Källan som den frågar kan ligga utanför din kontroll och kan vara en potentiell källa till kompromisser i din leveranskedja. En djupgående försvarsstrategi bör utvidgas till externa källor för att etablera förtroende, autentisering, auktorisering, åtkomst, säkerhet, integritet och korrekthet för de data som den har tillgång till. För att dyka djupare, läs "Bygg en säker företagsapplikation med Generativ AI och RAG med Amazon SageMaker JumpStart"

Analysera och minska riskerna i dina LLM-applikationer

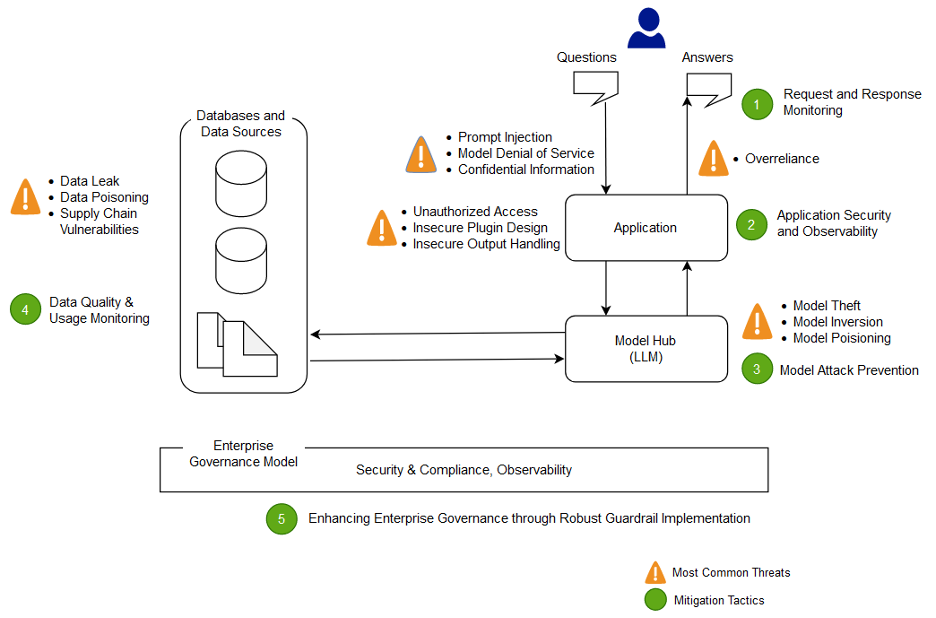

I det här avsnittet analyserar och diskuterar vi några riskreducerande tekniker baserade på förtroendegränser och interaktioner, eller distinkta områden av arbetsbelastningen med liknande lämplig kontrollomfattning och riskprofil. I denna exempelarkitektur för en chatbotapplikation finns det fem förtroendegränser där kontroller demonstreras, baserat på hur AWS-kunder vanligtvis bygger sina LLM-applikationer. Din LLM-applikation kan ha fler eller färre definierbara förtroendegränser. I följande exempelarkitektur definieras dessa förtroendegränser som:

- Användargränssnittsinteraktioner (förfrågan och svar)

- Applikationsinteraktioner

- Modellinteraktioner

- Datainteraktioner

- Organisatoriska interaktioner och användning

Interaktioner med användargränssnitt: Utveckla förfrågnings- och svarsövervakning

Upptäck och reagera på cyberincidenter relaterade till generativ AI i rätt tid genom att utvärdera en strategi för att hantera risker från indata och utdata från den generativa AI-applikationen. Till exempel kan ytterligare övervakning av beteenden och datautflöde behöva instrumenteras för att upptäcka avslöjande av känslig information utanför din domän eller organisation, om den används i LLM-applikationen.

Generativa AI-applikationer bör fortfarande upprätthålla de bästa säkerhetsrutinerna när det gäller att skydda data. Upprätta en säker dataperimeter och säkra känsliga datalager. Kryptera data och information som används för LLM-applikationer i vila och under transport. Skydda data som används för att träna din modell från att träna dataförgiftning genom att förstå och kontrollera vilka användare, processer och roller som tillåts bidra till datalagren, samt hur dataflöden i applikationen, övervaka för bias-avvikelser och använda versions- och oföränderlig lagring i lagringstjänster som Amazon S3. Upprätta strikta kontroller för in- och utgående data med tjänster som AWS Network Firewall och AWS VPC:er för att skydda mot misstänkt inmatning och risken för dataexfiltrering.

Under utbildningen, omskolningen eller finjusteringsprocessen bör du vara medveten om eventuella känsliga uppgifter som används. Efter att data har använts under en av dessa processer bör du planera för ett scenario där alla användare av din modell plötsligt kan extrahera data eller information tillbaka ut genom att använda snabba injektionstekniker. Förstå riskerna och fördelarna med att använda känslig data i dina modeller och slutsatser. Implementera robusta autentiserings- och auktoriseringsmekanismer för att etablera och hantera finkorniga åtkomstbehörigheter, som inte förlitar sig på LLM-applikationslogik för att förhindra avslöjande. Användarkontrollerad ingång till en generativ AI-applikation har under vissa förhållanden visat sig kunna tillhandahålla en vektor för att extrahera information från modellen eller eventuella icke-användarkontrollerade delar av ingången. Detta kan ske via snabbinjektion, där användaren ger indata som gör att utdata från modellen avviker från de förväntade skyddsräckena för LLM-applikationen, inklusive att ge ledtrådar till de datamängder som modellen ursprungligen tränades på.

Implementera åtkomstkvoter på användarnivå för användare som tillhandahåller input och tar emot utdata från en modell. Du bör överväga tillvägagångssätt som inte tillåter anonym åtkomst under förhållanden där modellens träningsdata och information är känslig, eller där det finns risk för att en motståndare utbildar en faksimil av din modell baserat på deras input och din anpassade modellutdata. I allmänhet, om en del av input till en modell består av godtycklig användartillhandahållen text, betrakta utdata som mottagligt för snabb injicering och se till att användningen av utdata inkluderar implementerade tekniska och organisatoriska motåtgärder för att mildra osäker utdatahantering, överdriven byråkrati , och övertillit. I exemplet tidigare relaterat till filtrering för skadlig indata med AWS WAF, överväg att bygga ett filter framför din applikation för sådan potentiell missbruk av uppmaningar, och utveckla en policy för hur man hanterar och utvecklar dessa när din modell och data växer. Överväg också en filtrerad granskning av resultatet innan det returneras till användaren för att säkerställa att det uppfyller standarder för kvalitet, noggrannhet eller innehållsmoderering. Du kanske vill anpassa detta ytterligare för din organisations behov med ett extra lager av kontroll på ingångar och utgångar framför dina modeller för att mildra misstänkta trafikmönster.

Applikationsinteraktioner: Applikationssäkerhet och observerbarhet

Granska din LLM-applikation med uppmärksamhet på hur en användare kan använda din modell för att kringgå standardauktorisering till ett nedströmsverktyg eller verktygskedja som de inte har behörighet att komma åt eller använda. Ett annat problem i det här skiktet involverar åtkomst till externa datalager genom att använda en modell som en attackmekanism med oförminskade tekniska eller organisatoriska LLM-risker. Till exempel, om din modell är utbildad för att komma åt vissa datalager som kan innehålla känslig data, bör du se till att du har korrekta behörighetskontroller mellan din modell och datalagren. Använd oföränderliga attribut om användare som inte kommer från modellen när du utför auktoriseringskontroller. Oförändrad osäker utdatahantering, osäker plugin-design och överdriven byrå kan skapa förhållanden där en hotaktör kan använda en modell för att lura auktoriseringssystemet att eskalera effektiva privilegier, vilket leder till att en nedströmskomponent tror att användaren är auktoriserad att hämta data eller ta en specifik handling.

När du implementerar ett generativt AI-plugin eller verktyg är det absolut nödvändigt att undersöka och förstå åtkomstnivån som beviljas, samt granska åtkomstkontrollerna som har konfigurerats. Att använda oförändrade osäkra generativa AI-plugin-program kan göra ditt system mottagligt för sårbarheter och hot i försörjningskedjan, vilket kan leda till skadliga åtgärder, inklusive körning av fjärrkod.

Modellinteraktioner: Modellattackförebyggande

Du bör vara medveten om ursprunget till alla modeller, plugins, verktyg eller data som du använder för att utvärdera och mildra sårbarheter i försörjningskedjan. Till exempel tillåter vissa vanliga modellformat inbäddning av godtycklig körbar kod i själva modellerna. Använd paketspeglar, skanning och ytterligare inspektioner som är relevanta för din organisations säkerhetsmål.

Datauppsättningarna du tränar och finjusterar dina modeller på måste också ses över. Om du ytterligare automatiskt finjusterar en modell baserat på användarfeedback (eller annan slutanvändarkontrollerbar information), måste du överväga om en illvillig hotaktör kan ändra modellen godtyckligt baserat på att manipulera deras svar och uppnå träningsdataförgiftning.

Datainteraktioner: Övervaka datakvalitet och användning

Generativa AI-modeller som LLM:er fungerar i allmänhet bra eftersom de har tränats på en stor mängd data. Även om dessa data hjälper LLM:s att utföra komplexa uppgifter, kan de också utsätta ditt system för risken för träningsdataförgiftning, vilket inträffar när olämplig data inkluderas eller utelämnas i en träningsdatauppsättning som kan ändra en modells beteende. För att minska denna risk bör du titta på din försörjningskedja och förstå datagranskningsprocessen för ditt system innan det används i din modell. Även om träningspipelinen är en primär källa för dataförgiftning, bör du också titta på hur din modell får data, till exempel i en RAG-modell eller datasjö, och om källan till denna data är pålitlig och skyddad. Använd AWS Security-tjänster som AWS Security Hub, Amazon GuardDuty och Amazon Inspector för att kontinuerligt övervaka efter misstänkt aktivitet i Amazon EC2, Amazon EKS, Amazon S3, Amazon Relational Databas Service (Amazon RDS), och nätverksåtkomst som kan vara indikatorer på nya hot, och använd Detective för att visualisera säkerhetsutredningar. Överväg även att använda tjänster som t.ex Amazon Security Lake att påskynda säkerhetsutredningar genom att skapa en specialbyggd datasjö för att automatiskt centralisera säkerhetsdata från AWS-miljöer, SaaS-leverantörer, i lokaler och molnkällor som bidrar till dina AI/ML-arbetsbelastningar.

Organisatorisk interaktion: Implementera skyddsräcken för företagsstyrning för generativ AI

Identifiera risker förknippade med användningen av generativ AI för dina företag. Du bör bygga upp din organisations riskklassificering och göra riskbedömningar för att fatta välgrundade beslut när du implementerar generativa AI-lösningar. Utveckla en affärskontinuitetsplan (BCP) som inkluderar AI, ML och generativa AI-arbetsbelastningar och som kan införas snabbt för att ersätta den förlorade funktionaliteten i en påverkad eller offline LLM-applikation för att uppfylla dina SLA:er.

Identifiera process- och resursluckor, ineffektivitet och inkonsekvenser och förbättra medvetenheten och ägandet i hela din verksamhet. Hotmodell alla generativa AI-arbetsbelastningar för att identifiera och mildra potentiella säkerhetshot som kan leda till affärspåverkande resultat, inklusive obehörig åtkomst till data, denial of service och resursmissbruk. Dra nytta av det nya AWS Threat Composer Modeling Tool för att hjälpa till att minska tid till värde när du utför hotmodellering. Överväg att inkludera en introduktion senare i dina utvecklingscykler säkerhet kaos ingenjörskonst felinjektionsexperiment för att skapa verkliga förhållanden för att förstå hur ditt system kommer att reagera på okända saker och bygga upp förtroende för systemets motståndskraft och säkerhet.

Inkludera olika perspektiv i utvecklingen av säkerhetsstrategier och riskhanteringsmekanismer för att säkerställa efterlevnad och täckning för AI/ML och generativ säkerhet för alla jobbroller och funktioner. Ta med ett säkerhetstänkande från starten och forskningen av alla generativa AI-applikationer för att anpassa sig till kraven. Om du behöver extra hjälp från AWS, be din AWS-kontoansvarige att se till att det finns lika stöd genom att be AWS Solutions Architects från AWS Security och AI/ML att hjälpa till samtidigt.

Se till att din säkerhetsorganisation rutinmässigt vidtar åtgärder för att främja kommunikation kring både riskmedvetenhet och förståelse för riskhantering bland generativa AI-intressenter såsom produktchefer, mjukvaruutvecklare, datavetare och verkställande ledarskap, vilket tillåter hotintelligens och kontrollvägledning för att nå de team som kan påverkas. Säkerhetsorganisationer kan stödja en kultur av ansvarsfull avslöjande och iterativ förbättring genom att delta i diskussioner och föra nya idéer och information till generativa AI-intressenter som relaterar till deras affärsmål. Lära sig mer om vårt engagemang för ansvarsfull AI och ytterligare ansvarsfulla AI-resurser att hjälpa våra kunder.

Få fördelar genom att möjliggöra bättre organisationsställning för generativ AI genom att avblockera tid till värde i de befintliga säkerhetsprocesserna i din organisation. Utvärdera proaktivt var din organisation kan kräva processer som är alltför betungande med tanke på den generativa AI-säkerhetskontexten och förfina dessa för att ge utvecklare och forskare en tydlig väg att lansera med rätt kontroller på plats.

Bedöm var det kan finnas möjligheter att anpassa incitament, förringa och ge en klar syn på de önskade resultaten. Uppdatering kontrollerar vägledning och försvar för att möta de växande behoven av AI/ML och generativ AI-applikationsutveckling för att minska förvirring och osäkerhet som kan kosta utvecklingstid, öka risken och öka effekten.

Se till att intressenter som inte är säkerhetsexperter både kan förstå hur organisationsstyrning, policyer och riskhanteringssteg gäller för deras arbetsbelastning, samt tillämpa riskhanteringsmekanismer. Förbered din organisation för att reagera på realistiska händelser och scenarier som kan inträffa med generativa AI-applikationer, och se till att generativa AI-byggarroller och svarsteam är medvetna om eskaleringsvägar och åtgärder vid oro för någon misstänkt aktivitet.

Slutsats

För att framgångsrikt kommersialisera innovation med någon ny och framväxande teknik krävs att man börjar med ett säkerhetstänk, att man bygger på en säker infrastruktur och tänker på hur man kan integrera säkerheten på varje nivå av teknikstacken tidigt med en djupgående försvarssäkerhet. närma sig. Detta inkluderar interaktioner på flera lager av din teknikstapel och integrationspunkter inom din digitala leveranskedja för att säkerställa organisatorisk motståndskraft. Även om generativ AI introducerar några nya säkerhets- och integritetsutmaningar, kan du hjälpa till att skydda din organisation från många vanliga problem och föränderliga hot om du följer grundläggande säkerhetspraxis som att använda djupgående försvar med säkerhetstjänster. Du bör implementera skiktade AWS-säkerhetstjänster över dina generativa AI-arbetsbelastningar och större organisation, och fokusera på integrationspunkter i dina digitala leveranskedjor för att säkra dina molnmiljöer. Sedan kan du använda de förbättrade säkerhets- och integritetsfunktionerna i AWS AI/ML-tjänster som Amazon SageMaker och Amazon Bedrock för att lägga till ytterligare lager av förbättrad säkerhet och integritetskontroller till dina generativa AI-applikationer. Att bädda in säkerhet från början kommer att göra det snabbare, enklare och mer kostnadseffektivt att förnya med generativ AI, samtidigt som det förenklar efterlevnaden. Detta kommer att hjälpa dig att öka kontrollerna, förtroendet och observerbarheten för dina generativa AI-applikationer för dina anställda, kunder, partners, tillsynsmyndigheter och andra berörda intressenter.

Ytterligare referenser

- Branschstandardramverk för AI/ML-specifik riskhantering och säkerhet:

Om författarna

Christopher Rae är en Global Global Security GTM-specialist fokuserad på att utveckla och genomföra strategiska initiativ som påskyndar och skalar införandet av AWS-säkerhetstjänster. Han brinner för skärningspunkten mellan cybersäkerhet och framväxande teknologier, med 20+ års erfarenhet av globala strategiska ledarroller som levererar säkerhetslösningar till media-, underhållnings- och telekomkunder. Han laddar om genom att läsa, resa, mat och vin, upptäcka ny musik och ge råd till startups i tidiga skeden.

Christopher Rae är en Global Global Security GTM-specialist fokuserad på att utveckla och genomföra strategiska initiativ som påskyndar och skalar införandet av AWS-säkerhetstjänster. Han brinner för skärningspunkten mellan cybersäkerhet och framväxande teknologier, med 20+ års erfarenhet av globala strategiska ledarroller som levererar säkerhetslösningar till media-, underhållnings- och telekomkunder. Han laddar om genom att läsa, resa, mat och vin, upptäcka ny musik och ge råd till startups i tidiga skeden.

Elia Winter är en senior säkerhetsingenjör inom Amazon Security, med en kandidatexamen i cybersäkerhetsteknik och fylld av kärlek till Harry Potter. Elijah utmärker sig i att identifiera och åtgärda sårbarheter i AI-system, och blanda teknisk expertis med en touch av trolldom. Elijah designar skräddarsydda säkerhetsprotokoll för AI-ekosystem, vilket ger digitala försvar en magisk känsla. Integritetsdriven, Elijah har en säkerhetsbakgrund i både offentliga och kommersiella organisationer med fokus på att skydda förtroende.

Elia Winter är en senior säkerhetsingenjör inom Amazon Security, med en kandidatexamen i cybersäkerhetsteknik och fylld av kärlek till Harry Potter. Elijah utmärker sig i att identifiera och åtgärda sårbarheter i AI-system, och blanda teknisk expertis med en touch av trolldom. Elijah designar skräddarsydda säkerhetsprotokoll för AI-ekosystem, vilket ger digitala försvar en magisk känsla. Integritetsdriven, Elijah har en säkerhetsbakgrund i både offentliga och kommersiella organisationer med fokus på att skydda förtroende.

Ram Vittal är Principal ML Solutions Architect på AWS. Han har över 3 decennier av erfarenhet av att bygga och bygga distribuerade, hybrid- och molnapplikationer. Han brinner för att bygga säkra och skalbara AI/ML- och big data-lösningar för att hjälpa företagskunder med deras molnintroduktion och optimeringsresa för att förbättra deras affärsresultat. På fritiden kör han motorcykel och promenerar med sin 3-åriga Sheepadoodle!

Ram Vittal är Principal ML Solutions Architect på AWS. Han har över 3 decennier av erfarenhet av att bygga och bygga distribuerade, hybrid- och molnapplikationer. Han brinner för att bygga säkra och skalbara AI/ML- och big data-lösningar för att hjälpa företagskunder med deras molnintroduktion och optimeringsresa för att förbättra deras affärsresultat. På fritiden kör han motorcykel och promenerar med sin 3-åriga Sheepadoodle!

Navneet Tuteja är en dataspecialist på Amazon Web Services. Innan han började på AWS arbetade Navneet som en facilitator för organisationer som ville modernisera sina dataarkitekturer och implementera omfattande AI/ML-lösningar. Hon har en ingenjörsexamen från Thapar University, samt en magisterexamen i statistik från Texas A&M University.

Navneet Tuteja är en dataspecialist på Amazon Web Services. Innan han började på AWS arbetade Navneet som en facilitator för organisationer som ville modernisera sina dataarkitekturer och implementera omfattande AI/ML-lösningar. Hon har en ingenjörsexamen från Thapar University, samt en magisterexamen i statistik från Texas A&M University.

Emily Soward är en dataforskare med AWS Professional Services. Hon har en Master of Science with Distinction in Artificiell Intelligens från University of Edinburgh i Skottland, Storbritannien med tonvikt på Natural Language Processing (NLP). Emily har arbetat i tillämpad vetenskap och ingenjörsroller med fokus på AI-aktiverad produktforskning och -utveckling, operationell excellens och styrning av AI-arbetsbelastningar inom organisationer i den offentliga och privata sektorn. Hon bidrar till kundvägledning som AWS Senior Speaker och nyligen som författare för AWS Well-Architected in the Machine Learning Lens.

Emily Soward är en dataforskare med AWS Professional Services. Hon har en Master of Science with Distinction in Artificiell Intelligens från University of Edinburgh i Skottland, Storbritannien med tonvikt på Natural Language Processing (NLP). Emily har arbetat i tillämpad vetenskap och ingenjörsroller med fokus på AI-aktiverad produktforskning och -utveckling, operationell excellens och styrning av AI-arbetsbelastningar inom organisationer i den offentliga och privata sektorn. Hon bidrar till kundvägledning som AWS Senior Speaker och nyligen som författare för AWS Well-Architected in the Machine Learning Lens.

- SEO-drivet innehåll och PR-distribution. Bli förstärkt idag.

- PlatoData.Network Vertical Generative Ai. Styrka dig själv. Tillgång här.

- PlatoAiStream. Web3 Intelligence. Kunskap förstärkt. Tillgång här.

- Platoesg. Kol, CleanTech, Energi, Miljö, Sol, Avfallshantering. Tillgång här.

- PlatoHealth. Biotech och kliniska prövningar Intelligence. Tillgång här.

- Källa: https://aws.amazon.com/blogs/machine-learning/architect-defense-in-depth-security-for-generative-ai-applications-using-the-owasp-top-10-for-llms/

- : har

- :är

- :inte

- :var

- $UPP

- 1

- 10

- 100

- 125

- 150

- 30

- 300

- a

- förmåga

- Able

- Om oss

- akademiska

- accelerera

- godtagbart

- tillgång

- Tillgång till data

- åtkomst

- i enlighet med detta

- Konto

- konton

- noggrannhet

- Uppnå

- uppnå

- tvärs

- Handling

- åtgärder

- aktiviteter

- aktivitet

- anpassning

- lägga till

- lagt till

- Dessutom

- Annat

- adress

- adresse

- efterlevnad

- justera

- anta

- Anta

- Antagande

- avancerat

- framsteg

- Fördel

- rådgivning

- Efter

- mot

- byrå

- Recensioner

- AI

- AI-modeller

- AI-system

- AI / ML

- rikta

- Justerat

- Justerar

- Alla

- tillåter

- tillåts

- tillåta

- ensam

- också

- Även

- amason

- Amazon EC2

- Amazon RDS

- Amazon SageMaker

- Amazon Web Services

- bland

- mängd

- an

- analysera

- analys

- och

- och infrastruktur

- Anonym

- Annan

- svar

- vilken som helst

- api

- aptit

- tillämplig

- Ansökan

- Application Development

- applikationssäkerhet

- tillämpningar

- tillämpas

- applicerar

- Ansök

- Tillämpa

- tillvägagångssätt

- tillvägagångssätt

- lämpligt

- arkitekter

- arkitektoniska

- arkitektur

- ÄR

- områden

- argumenterar

- stiga upp

- runt

- konstgjord

- artificiell intelligens

- Konstgjord intelligens (AI)

- AS

- be

- bedöma

- bedömningar

- Tillgångar

- Bistånd

- assistenter

- associerad

- försäkran

- At

- atlas

- attackera

- Attacker

- försök

- uppmärksamhet

- attribut

- revision

- augmented

- Autentisering

- Författaren

- tillstånd

- tillstånd

- automatisera

- automatiskt

- tillgänglig

- medveten

- medvetenhet

- AWS

- AWS kund

- AWS professionella tjänster

- tillbaka

- dragen tillbaka

- bakgrund

- baserat

- grundläggande

- grund

- BE

- därför att

- blir

- varit

- innan

- börja

- beteende

- Där vi får lov att vara utan att konstant prestera,

- tro

- fördel

- Fördelarna

- BÄST

- bästa praxis

- Bättre

- mellan

- förspänning

- Stor

- Stora data

- Bill

- blandning

- Blogg

- båda

- gränser

- föra

- Föra

- SLUTRESULTAT

- byggare

- byggare

- Byggnad

- bygger

- byggt

- inbyggd

- företag

- företag

- by

- bypass

- Kadens

- KAN

- Kan få

- kapacitet

- Kapacitet

- Vid

- Kategori

- Orsak

- Orsakerna

- centralisera

- vissa

- certifikat

- certifiering

- kedja

- kedjor

- utmaningar

- byta

- Kaos

- chatbot

- Kontroller

- chef

- klar

- cloud

- moln adoption

- moln applikationer

- cloud computing

- molninfrastruktur

- Cloud Security

- koda

- kombination

- komma

- kommer

- kommersiella

- kommersialisera

- engagemang

- engagerad

- Gemensam

- vanligen

- Kommunikation

- följeslagare

- följeslagare

- företag

- fullborda

- komplex

- Efterlevnad

- komponent

- Samman

- förstå

- omfattande

- kompromiss

- Äventyras

- komprometterande

- Compute

- databehandling

- Oro

- aktuella

- oro

- villkor

- Genomför

- förtroende

- konfigurerad

- förvirring

- förening

- Kontakta

- Konsekvenser

- Tänk

- anses

- med tanke på

- konsekvent

- består

- innehålla

- Behållare

- innehåll

- innehållsmått

- sammanhang

- kontinuitet

- kontinuerligt

- bidra

- bidrar

- kontroll

- styrning

- kontroller

- omvänt

- Kärna

- hörnstenen

- korrekt

- Motsvarande

- Pris

- kostnadseffektiv

- kunde

- täckning

- skapa

- Skapa

- kritisk

- kultur

- kurater

- kund

- Kunder

- skräddarsy

- kundanpassad

- cyber

- Cybersäkerhet

- Cybersäkerhet

- cykler

- datum

- datasjö

- Förberedelse av data

- Datakvalitet

- datavetare

- datamanipulering

- Databas

- datauppsättningar

- dag

- årtionden

- Beslutsfattande

- beslutsfattare

- beslut

- djup

- djupare

- Försvar

- defensiv

- definiera

- definierade

- definierande

- Examen

- leverera

- gräva

- demonstreras

- Denial of Service

- beroende

- distribuera

- utplacerade

- utplacera

- utplacering

- djup

- beskriva

- Designa

- mönster

- önskas

- upptäcka

- utveckla

- utvecklade

- utvecklare

- utveckla

- Utveckling

- avvika

- avvikelse

- olika

- digital

- discipliner

- avslöjande

- upptäcka

- Upptäckten

- diskutera

- diskutera

- diskussioner

- störningar

- distinkt

- skillnad

- distribueras

- Dyk

- flera

- olika perspektiv

- inte

- domän

- inte

- drar

- driven

- under

- varje

- Tidigare

- Tidig

- tidigt skede

- lättare

- lätt

- Ekonomisk

- ekonomiskt värde

- ekosystem

- edinburgh

- Effektiv

- effektiv

- antingen

- inbäddning

- framträda

- smärgel

- nya tekniker

- Emerging Technology

- vikt

- anställda

- ge

- möjliggöra

- möjliggör

- möjliggör

- uppmuntrar

- krypterad

- änden

- förstärka

- driva

- ingenjör

- Teknik

- Ingenjörer

- förbättrad

- säkerställa

- Företag

- företagskunder

- Underhållning

- Hela

- Miljö

- miljöer

- lika

- fel

- eskalering

- väsentlig

- etablera

- upprättandet

- Eter (ETH)

- utvärdera

- utvärdering

- utvärdering

- Även

- händelse

- händelser

- Varje

- utvecklas

- utvecklas

- undersöka

- exempel

- exempel

- Excellence

- överdriven

- exekvera

- verkställande

- Motionera

- exfiltrering

- existerar

- befintliga

- expanderande

- förväntat

- erfarenhet

- experiment

- expertis

- experter

- Exponering

- förlänga

- förlängas

- sträcker

- sträcker

- extern

- extra

- extrahera

- extrahera data

- extremt

- ytorna

- underlättar

- facilitator

- misslyckas

- Höst

- Förtrogenhet

- SNABB

- snabbare

- Leverans

- Funktioner

- återkoppling

- färre

- filtrera

- filtrering

- finansiella

- finansiella tjänster

- hitta

- finna

- resultat

- brandvägg

- Förnamn

- fem

- stil

- flexibel

- flöda

- flöden

- Fokus

- fokuserade

- följer

- efter

- livsmedelsproduktion

- För

- Forensic

- Foster

- Fosters

- fundament

- foundational

- Ramverk

- ramar

- ofta

- från

- främre

- funktionalitet

- funktioner

- grundläggande

- ytterligare

- Få

- luckor

- Allmänt

- allmänhet

- generering

- generativ

- Generativ AI

- skaffa sig

- få

- ges

- Välgörenhet

- Målet

- Mål

- kommer

- styra

- styrning

- Regeringen

- statliga

- beviljats

- Växer

- vägleda

- styra

- guidad

- Guider

- hade

- hantera

- Arbetsmiljö

- Har

- he

- hälso-och sjukvård

- hjälpa

- hjälpa

- hjälper

- högpresterande

- höggradigt

- hans

- innehav

- innehar

- Hur ser din drömresa ut

- How To

- html

- http

- HTTPS

- Nav

- humant

- Hybrid

- i

- Tanken

- idéer

- identifierade

- identifiera

- identifiera

- Identitet

- if

- oföränderlighet

- oföränderlig

- Inverkan

- påverkade

- Konsekvenser

- nödvändigt

- genomföra

- genomförande

- genomföras

- genomföra

- förbättra

- förbättring

- in

- incitament

- början

- incidenter

- innefattar

- ingår

- innefattar

- Inklusive

- inkonsekvenser

- Öka

- ökat

- ökande

- indikatorer

- industrin

- ineffektivitet

- informationen

- informationssäkerhet

- informeras

- Infrastruktur

- infuserad

- inneboende

- initiativ

- förnya

- nyskapande

- Innovation

- ingång

- ingångar

- osäkra

- inuti

- insikt

- insikter

- instanser

- integrera

- integrerade

- integrerar

- integrering

- integrationer

- integritet

- Intelligens

- interaktioner

- intresse

- Gränssnitt

- Internationell

- skärning

- in

- införa

- Introducerar

- införa

- Undersökningen

- Undersökningar

- innebär

- problem

- IT

- DESS

- sig

- Jobb

- sammanfogning

- resa

- jpg

- bara

- Ha kvar

- Nyckel

- Nyckelområden

- Kingdom

- kunskap

- Kubernetes

- sjö

- språk

- Large

- större

- slutligen

- senare

- lansera

- lager

- skiktad

- skikt

- leda

- ledare

- Ledarskap

- ledande

- LÄRA SIG

- inlärning

- t minst

- Lins

- linser

- Nivå

- livscykel

- tycka om

- sannolikhet

- linje

- rader

- skogsavverkning

- Logiken

- se

- du letar

- förlorat

- älskar

- Maskinen

- maskininlärning

- göra

- skadlig

- malware

- hantera

- förvaltade

- ledning

- chef

- chefer

- hantera

- manipulerings

- Manipulation

- sätt

- många

- karta

- Master

- master

- material

- Betyder Något

- förfall

- maximera

- Maj..

- betyder

- mäta

- mekanism

- mekanismer

- Media

- Möt

- möter

- mentala

- nämnts

- träffade

- Metrics

- kanske

- migrera

- miljoner

- emot

- Attityd

- missbruka

- Mildra

- begränsning

- ML

- modell

- modellering

- modeller

- måttfullhet

- modernisera

- Övervaka

- övervakning

- mer

- mest

- mc

- flytta

- mycket

- multipel

- Musik

- måste

- my

- Natural

- Naturligt språk

- Naturlig språkbehandling

- Natur

- nödvändigt för

- Behöver

- behövs

- behov

- nät

- Nätverkstillgång

- Nya

- Nästa

- NIST

- nlp

- objektet

- mål

- mål

- inträffa

- of

- sänkt

- erbjuda

- Erbjudanden

- officerare

- offline

- on

- ONE

- öppet

- öppen källkod

- drivs

- operativa

- Verksamhet

- möjligheter

- optimering

- optimerad

- or

- beställa

- organisation

- organisatoriska

- organisationer

- Ursprung

- ursprungligen

- ursprung

- Övriga

- vår

- ut

- Resultat

- utfall

- produktion

- utgångar

- utanför

- över

- övergripande

- alltför

- ägande

- paket

- del

- deltagande

- parter

- partner

- reservdelar till din klassiker

- brinner

- bana

- banor

- mönster

- prestanda

- utfört

- utför

- behörigheter

- perspektiv

- Faserna

- pelare

- rörledning

- Plats

- Planen

- planering

- plato

- Platon Data Intelligence

- PlatonData

- plugin

- insticksmoduler

- poäng

- gift

- Strategier

- policy

- positionering

- Inlägg

- potentiell

- potentiellt

- praktiken

- praxis

- beredning

- Förbered

- förhindra

- föregående

- Prime

- Principal

- Principerna

- Innan

- prioritering

- prioritet

- privatpolicy

- privat

- den privata sektorn

- privilegium

- privilegier

- process

- processer

- bearbetning

- Produkt

- Produktion

- produktivitet

- professionell

- Profil

- Program

- Program

- projektet

- prompter

- rätt

- ordentligt

- skydda

- skyddad

- skydda

- skydd

- protokoll

- ge

- leverantörer

- ger

- tillhandahålla

- allmän

- sätta

- kvalitet

- sökfrågor

- fråga

- Snabbt

- snabbt

- trasa

- nå

- Reagera

- Läsa

- Beredskap

- Läsning

- verkliga världen

- realistisk

- insikt

- inser

- mottagande

- nyligen

- rekommenderar

- rekommendationer

- Recover

- återvinning

- minska

- referens

- förfina

- region

- regelbunden

- regelbundet

- reglerad

- Tillsynsmyndigheter

- relaterad

- relevanta

- pålitlig

- förlita

- sanering

- avlägsen

- upprepa

- ersätta

- begära

- begärande

- kräver

- krav

- Krav

- Kräver

- forskning

- forskning och utveckling

- motståndskraft

- resurs

- Resurser

- respekterad

- att

- Svara

- respons

- svar

- ansvaret

- ansvarig

- REST

- begränsa

- omskolning

- hämtning

- översyn

- Granskad

- reviewing

- Omdömen

- åkattraktioner

- höger

- Risk

- riskaptit

- riskhanterings

- Riskreducering

- risker

- robusta

- rodgers

- roller

- rot

- rutinmässigt

- regler

- rinnande

- s

- SaaS

- sagemaker

- Samma

- skalbar

- Skala

- scanning

- scenario

- scenarier

- Vetenskap

- vetenskaplig

- Forskare

- vetenskapsmän

- omfattning

- Omfattning

- skottland

- Sök

- §

- sektor

- säkra

- Säkrad

- säkring

- säkerhet

- säkerhetsfördelar

- säkerhetshändelser

- säkerhetsrisker

- Säkerhetshot

- säkerhetsverktyg

- Seek

- söker

- Söker

- välj

- vald

- senior

- känslig

- eras

- service

- Tjänster

- in

- inställning

- delas

- hon

- skall

- show

- Syn

- liknande

- Enkelt

- förenkla

- förenkla

- So

- umgänge

- Mjukvara

- mjukvaruräkning

- Programutvecklare

- mjukvaruutveckling

- lösning

- Lösningar

- några

- Källa

- Källor

- suveränitet

- Utrymme

- Högtalare

- specialist

- specifik

- specifikt

- fart

- stapel

- stadier

- intressenter

- standard

- standarder

- starta

- igång

- Starta

- Startups

- statistik

- Steg

- Fortfarande

- förvaring

- lagras

- lagrar

- Strategisk

- strategier

- Strateg

- Strategi

- sträng

- starkt

- väsentligen

- framgång

- Framgångsrikt

- sådana

- leverera

- leveranskedjan

- Försörjningskedjor

- stödja

- Stödjande

- säker

- apt

- misstänksam

- syntetisk

- system

- System

- bord

- skräddarsydd

- Ta

- tar

- Tandem

- uppgifter

- taxonomi

- grupp

- lag

- Teknisk

- tekniker

- Tekniken

- tekniker

- Teknologi

- telecom

- testa

- Testning

- tester

- texas

- text

- den där

- Smakämnen

- källan

- stöld

- deras

- Dem

- teman

- sig själva

- sedan

- Där.

- Dessa

- de

- Tänkande

- Tredje

- utomstående

- detta

- de

- hot

- hot intelligence

- hot

- tre

- Genom

- hela

- tid

- tid

- TLS

- till

- tillsammans

- verktyg

- verktyg

- topp

- Top 10

- Rör

- mot

- Handel

- traditionell

- trafik

- Tåg

- tränad

- Utbildning

- transaktion

- transitering

- Öppenhet

- transport

- Traveling

- Litar

- betrodd

- typiskt

- obehörig

- Osäkerhet

- under

- Underminera

- förstå

- förståelse

- obekant

- United

- Storbritannien

- universitet

- renodlad

- Uppdatering

- uppdaterad

- upprätthålla

- upptid

- användning

- användningsfall

- Begagnade

- Användare

- användare

- användningar

- med hjälp av

- utnyttja

- utnyttjas

- Använda

- BEKRÄFTA

- validera

- godkännande

- värde

- bevandrad

- via

- Virtuell

- praktiskt taget

- visualisera

- vs

- sårbarheter

- sårbarhet

- promenader

- vill

- Teckningsoptioner

- var

- sätt

- we

- webb

- webbapplikation

- webbapplikationer

- webbservice

- VÄL

- Vad

- när

- om

- som

- medan

- VEM

- Hela

- kommer

- VIN

- Vinner

- med

- inom

- utan

- Arbete

- arbetade

- arbetsflöde

- arbetsflöden

- arbetssätt

- inom hela sverige

- skulle

- skrev

- XSS

- år

- dig

- Din

- zephyrnet