Ključni izdelki

- Razširjanje misli (TP) je nova metoda, ki izboljšuje kompleksne sposobnosti razmišljanja velikih jezikovnih modelov (LLM).

- TP izkorišča analogne probleme in njihove rešitve za izboljšanje sklepanja, namesto da bi študentje LLM razmišljali iz nič.

- Poskusi pri različnih nalogah kažejo, da TP bistveno prekaša osnovne metode, z izboljšavami v razponu od 12 % do 15 %.

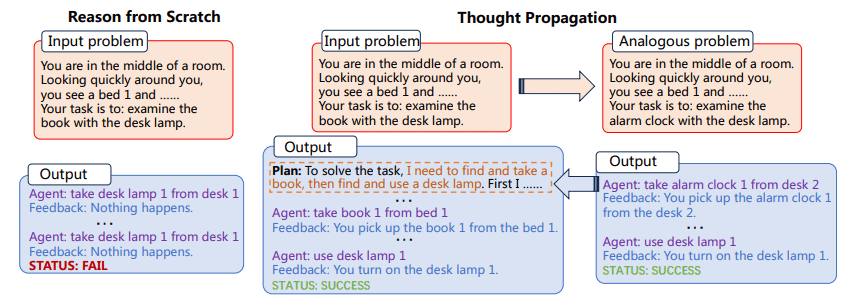

TP najprej pozove LLM-ja, da predlaga in reši niz analognih problemov, ki so povezani z vhodnim. Nato TP ponovno uporabi rezultate analognih problemov, da neposredno pridobi novo rešitev ali izpelje načrt, ki temelji na znanju, za izvedbo, da spremeni začetno rešitev, pridobljeno iz nič.

Vsestranskost in računska moč velikih jezikovnih modelov (LLM) sta nesporni, vendar nista brezmejni. Eden najpomembnejših in doslednejših izzivov za LLM je njihov splošen pristop k reševanju problemov, ki ga sestavlja sklepanje iz prvih načel za vsako novo nalogo, s katero se srečajo. To je problematično, saj omogoča visoko stopnjo prilagodljivosti, hkrati pa povečuje verjetnost napak, zlasti pri nalogah, ki zahtevajo sklepanje v več korakih.

Izziv »sklepanja iz nič« je še posebej izrazit pri kompleksnih nalogah, ki zahtevajo več korakov logike in sklepanja. Na primer, če je LLM zaprošen, da najde najkrajšo pot v omrežju medsebojno povezanih točk, običajno ne bo uporabil predznanja ali podobnih problemov, da bi našel rešitev. Namesto tega bi poskušal problem rešiti izolirano, kar lahko privede do neoptimalnih rezultatov ali celo popolnih napak. Vnesite Razširjanje misli (TP), metoda, ki je zasnovana za povečanje zmožnosti sklepanja LLM. Cilj TP je preseči inherentne omejitve LLM-jev tako, da jim omogoči črpanje iz rezervoarja analognih problemov in njihovih ustreznih rešitev. Ta inovativni pristop ne le izboljšuje natančnost rešitev, ustvarjenih z LLM, ampak tudi bistveno izboljša njihovo sposobnost reševanja večstopenjskih, zapletenih nalog razmišljanja. Z izkoriščanjem moči analogije TP zagotavlja ogrodje, ki krepi prirojene zmožnosti razmišljanja LLM-jev in nas pripelje korak bližje realizaciji resnično inteligentnih umetnih sistemov.

Razširjanje misli vključuje dva glavna koraka:

- Najprej je LLM pozvan, da predlaga in reši vrsto podobnih problemov, povezanih z vhodnim problemom

- Nato se rešitve teh podobnih problemov uporabijo za neposredno pridobitev nove rešitve ali za spremembo začetne rešitve.

Postopek prepoznavanja analognih problemov omogoča LLM, da ponovno uporabi strategije in rešitve za reševanje problemov, s čimer izboljša svoje sposobnosti sklepanja. TP je združljiv z obstoječimi metodami pozivanja in zagotavlja posplošljivo rešitev, ki jo je mogoče vključiti v različne naloge brez pomembnega inženiringa, specifičnega za nalogo.

Slika 1: Proces širjenja misli (slika s papirja)

Poleg tega ne smemo podcenjevati prilagodljivosti TP. Zaradi združljivosti z obstoječimi metodami pozivanja je zelo vsestransko orodje. To pomeni, da TP ni omejen na nobeno specifično vrsto domene reševanja problemov. To odpira vznemirljive poti za natančno prilagajanje in optimizacijo, specifično za naloge, s čimer se poveča uporabnost in učinkovitost LLM-jev v širokem spektru aplikacij.

Implementacijo Thought Propagation je mogoče vključiti v potek dela obstoječih LLM. Na primer, v nalogi Shortest-path Reasoning bi lahko TP najprej rešil niz enostavnejših, analognih problemov, da bi razumel različne možne poti. Te vpoglede bi nato uporabil za rešitev kompleksnega problema in s tem povečal verjetnost, da najde optimalno rešitev.

Primer 1

- Naloga: Sklepanje po najkrajši poti

- Analogni problemi: Najkrajša pot med točko A in B, Najkrajša pot med točko B in C

- Končna rešitev: Optimalna pot od točke A do C ob upoštevanju rešitev analognih problemov

Primer 2

- Naloga: Kreativno pisanje

- Analogni problemi: Napiši kratko zgodbo o prijateljstvu, Napiši kratko zgodbo o zaupanju

- Končna rešitev: Napišite zapleteno kratko zgodbo, ki vključuje teme prijateljstva in zaupanja

Postopek vključuje najprej reševanje teh podobnih problemov, nato pa uporabo pridobljenih spoznanj za reševanje zapletene naloge, ki jo imamo. Ta metoda je dokazala svojo učinkovitost pri več nalogah in prikazala znatne izboljšave v meritvah uspešnosti.

Posledice širjenja misli presegajo zgolj izboljšanje obstoječih meritev. Ta tehnika spodbujanja lahko spremeni naše razumevanje in uvajanje LLM-jev. Metodologija poudarja premik od izoliranega, atomskega reševanja problemov k bolj celostnemu, med seboj povezanemu pristopu. Spodbudi nas k razmisleku o tem, kako se lahko LLM učijo ne le iz podatkov, ampak iz samega procesa reševanja problemov. Z nenehnim posodabljanjem svojega razumevanja z rešitvami podobnih problemov so LLM-ji, opremljeni s TP, bolje pripravljeni na spopadanje z nepredvidenimi izzivi, zaradi česar so bolj odporni in prilagodljivi v hitro razvijajočih se okoljih.

Razširjanje misli je obetaven dodatek k orodju metod spodbujanja, namenjenih izboljšanju zmogljivosti LLM. Z omogočanjem LLM-jem, da izkoristijo podobne probleme in njihove rešitve, TP zagotavlja bolj niansirano in učinkovito metodo sklepanja. Poskusi potrjujejo njegovo učinkovitost, zaradi česar je kandidat za strategijo za izboljšanje učinkovitosti LLM pri različnih nalogah. TP lahko na koncu predstavlja pomemben korak naprej pri iskanju zmogljivejših sistemov AI.

Matthew Mayo (@mattmayo13) ima magisterij iz računalništva in diplomo iz podatkovnega rudarjenja. Matthew si kot glavni urednik KDnuggets prizadeva narediti dostopne zapletene koncepte podatkovne znanosti. Njegovi poklicni interesi vključujejo obdelavo naravnega jezika, algoritme strojnega učenja in raziskovanje nastajajoče umetne inteligence. Vodi ga misija demokratizacije znanja v skupnosti podatkovne znanosti. Matthew kodira od svojega 6. leta.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- PlatoData.Network Vertical Generative Ai. Opolnomočite se. Dostopite tukaj.

- PlatoAiStream. Web3 Intelligence. Razširjeno znanje. Dostopite tukaj.

- PlatoESG. Ogljik, CleanTech, Energija, Okolje, sončna energija, Ravnanje z odpadki. Dostopite tukaj.

- PlatoHealth. Obveščanje o biotehnologiji in kliničnih preskušanjih. Dostopite tukaj.

- vir: https://www.kdnuggets.com/thought-propagation-an-analogical-approach-to-complex-reasoning-with-large-language-models?utm_source=rss&utm_medium=rss&utm_campaign=thought-propagation-an-analogical-approach-to-complex-reasoning-with-large-language-models

- :ima

- : je

- :ne

- $GOR

- 15%

- 8

- a

- sposobnosti

- sposobnost

- O meni

- dostopen

- natančnost

- čez

- Poleg tega

- AI

- AI sistemi

- Namerjen

- Cilje

- algoritmi

- Dovoli

- omogoča

- Prav tako

- širi

- an

- in

- kaj

- aplikacije

- pristop

- SE

- umetni

- AS

- At

- poskus

- povečanje

- poti

- b

- Izhodišče

- BE

- bilo

- Boljše

- med

- Poleg

- Predložitev

- široka

- vendar

- by

- CAN

- Kandidat

- Zmogljivosti

- lahko

- izziv

- izzivi

- bližje

- Kodiranje

- skupnost

- združljivost

- združljiv

- kompleksna

- računalniški

- računska moč

- računalnik

- Računalništvo

- koncepti

- Potrdi

- Razmislite

- upoštevamo

- dosledno

- Sestavljeno

- stalno

- Ustrezno

- bi

- Creative

- datum

- rudarjenje podatkov

- znanost o podatkih

- Stopnja

- Povpraševanje

- demokratizirati

- Dokazano

- razporedi

- zasnovan

- neposredno

- domena

- pripravi

- vozi

- urednik

- Učinkovito

- učinkovitost

- učinkovitost

- bodisi

- dvigovanje

- smirkovim

- Inženiring

- Izboljša

- izboljšanje

- Vnesite

- okolja

- opremljena

- napake

- zlasti

- Tudi

- Tudi vsak

- razvija

- Primer

- zanimivo

- izvedba

- obstoječih

- Poskusi

- Raziskovati

- Najdi

- iskanje

- prva

- za

- Naprej

- Okvirni

- prijateljstvo

- iz

- pridobljeno

- splošno

- Go

- diplomiral

- strani

- he

- visoka

- zelo

- njegov

- drži

- celosten

- Kako

- HTTPS

- identifikacijo

- if

- slika

- Izvajanje

- posledice

- izboljšanje

- Izboljšave

- izboljšuje

- izboljšanju

- in

- vključujejo

- Vključena

- Poveča

- narašča

- inherentno

- začetna

- prirojeno

- inovativne

- vhod

- vpogledi

- Namesto

- integrirana

- Integrira

- Inteligentna

- medsebojno povezani

- interesi

- v

- vključuje

- izolirani

- izolacija

- IT

- ITS

- sam

- jpg

- samo

- KDnuggets

- Otrok

- znanje

- jezik

- velika

- vodi

- UČITE

- učenje

- Vzvod

- Leverages

- vzvod

- verjetnost

- LIMIT

- omejitve

- Limited

- Logika

- stroj

- strojno učenje

- Glavne

- Znamka

- IZDELA

- Izdelava

- mojster

- Matthew

- Maj ..

- pomeni

- zgolj

- Metoda

- Metodologija

- Metode

- Meritve

- Rudarstvo

- Mission

- modeli

- več

- Najbolj

- več

- naravna

- Naravni jezik

- Obdelava Natural Language

- mreža

- Novo

- nova rešitev

- roman

- pridobljeni

- of

- Staro

- on

- ONE

- samo

- Odpre

- optimalna

- optimizacija

- or

- Presega

- naravnost

- Premagajte

- Papir

- zlasti

- pot

- performance

- Načrt

- platon

- Platonova podatkovna inteligenca

- PlatoData

- Točka

- točke

- mogoče

- potencial

- moč

- pripravljeni

- Načela

- Predhodna

- problem

- reševanje problema

- Težave

- Postopek

- obravnavati

- strokovni

- obetaven

- izrazit

- razmnoževanje

- predlaga

- zagotavlja

- zagotavljanje

- obsegu

- hitro

- precej

- realizacija

- Razlog

- povezane

- upodabljanje

- predstavljajo

- zahteva

- odporno

- Rezultati

- ponovna

- s

- Znanost

- praska

- Iskalnik

- nastavite

- premik

- Kratke Hlače

- shouldnt

- Prikaži

- razstavni

- pomemben

- bistveno

- saj

- Rešitev

- rešitve

- SOLVE

- Reševanje

- specifična

- Spectrum

- Korak

- Koraki

- Zgodba

- strategije

- Strategija

- precejšen

- v bistvu

- sistemi

- reševanje

- Naloga

- Naloge

- tehnika

- kot

- da

- O

- njihove

- Njih

- teme

- POTEM

- s tem

- te

- jih

- ta

- mislil

- skozi

- do

- orodje

- Toolbox

- proti

- tp

- resnično

- Zaupajte

- dva

- tipično

- Konec koncev

- zanikati

- poudarja

- razumeli

- razumevanje

- nepredviden

- posodabljanje

- us

- uporaba

- Rabljeni

- uporabo

- pripomoček

- raznolikost

- različnih

- vsestranski

- vsestranskost

- je

- we

- ki

- z

- brez

- potek dela

- bi

- pisati

- pisanje

- let

- še

- donos

- zefirnet