Методы конечных элементов для анализа возникают во многих областях проектирования электронных систем: анализ механических напряжений в системах с несколькими кристаллами, термический анализ как аналог анализа охлаждения и напряжений (например, деформации), а также анализ электромагнитной совместимости. (Вычислительная гидродинамика – CFD – это отдельная тема, о которой я мог бы рассказать в отдельном блоге.) Я обсуждал темы в этой области с другим клиентом и продолжаю находить эту область привлекательной, потому что она перекликается с моим опытом в физике и моим внутренним фанатом математики. (решение дифференциальных уравнений). Здесь я исследую Недавняя статья от Siemens AG совместно с техническими университетами Мюнхена и Брауншвейга.

Постановка проблемы

Методы конечных элементов — это методы численного решения систем двумерных и трехмерных уравнений в частных производных (ЧДУ), возникающих во многих физических анализах. Они могут простираться от того, как тепло распространяется в сложной системе-на-кристалле, до электромагнитного анализа автомобильного радара, того, как механическая конструкция изгибается под нагрузкой, и того, как передняя часть автомобиля сминается при аварии.

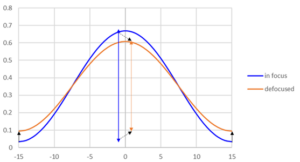

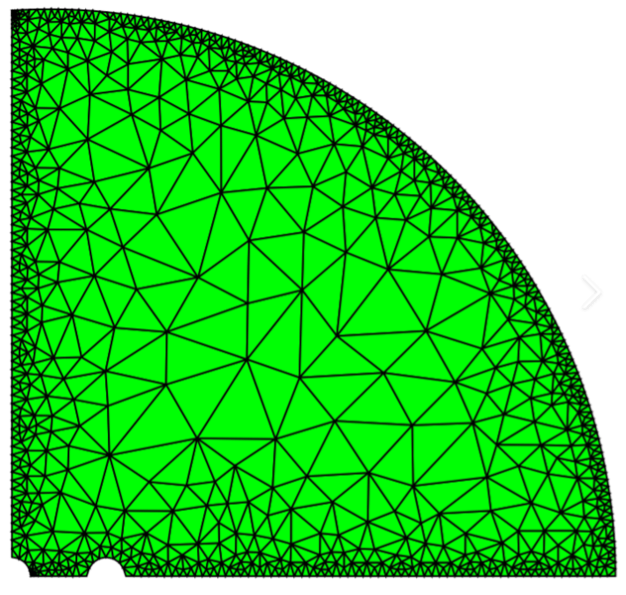

Для FEM сетка строится в физическом пространстве как дискретная структура для анализа, более мелкозернистая вокруг границ и особенно быстро меняющихся граничных условий и более крупнозернистая в других местах. Опуская кровавые детали, метод оптимизирует линейные суперпозиции простых функций по сетке путем изменения коэффициентов в суперпозиции. Целью оптимизации является поиск наилучшего соответствия в пределах некоторого приемлемого допуска, совместимого с дискретными прокси для УЧП вместе с начальными и граничными условиями с помощью линейной алгебры и других методов.

Для достижения приемлемой точности обычно требуются очень большие сетки, что приводит к очень длительному времени выполнения решений МКЭ для реалистичных задач, что становится еще более обременительным при выполнении нескольких анализов для изучения возможностей оптимизации. Каждый прогон по сути начинается с нуля, без необходимости обучения между прогонами, что предполагает возможность использовать методы ML для ускорения анализа.

Способы использования ML с FEM

Широко используемый подход к ускорению анализа FEM (FEA) заключается в построении суррогатных моделей. Это похоже на абстрактные модели в других областях — упрощенные версии полной сложности исходной модели. Эксперты FEA говорят о моделях уменьшенного порядка (ROM), которые продолжают демонстрировать хорошее приближение (дискретизированного) физического поведения исходной модели, но не требуют запуска FEA, по крайней мере, на этапе оптимизации проекта, хотя и работают намного быстрее, чем FEA. .

Один из способов создания суррогата — начать с набора FEA, используя эту информацию в качестве обучающей базы данных для создания суррогата. Однако это по-прежнему требует длительного анализа для создания обучающих наборов входных и выходных данных. Авторы также указывают на еще один недостаток такого подхода. ML не имеет естественного понимания физических ограничений, важных во всех подобных приложениях, и поэтому склонен к галлюцинациям, если ему представлен сценарий за пределами его обучающего набора.

И наоборот, замена FEM на физически информированная нейронная сеть (PINN) включает физические PDE в расчеты функции потерь, по сути вводя физические ограничения в оптимизацию на основе градиента. Это умная идея, хотя последующие исследования показали, что, хотя метод работает с простыми задачами, он не работает при наличии высокочастотных и многомасштабных функций. Также разочаровывает то, что время обучения таким методам может превышать время выполнения FEA.

В этой статье предлагается интригующая альтернатива более тесному объединению обучения FEA и ML, чтобы функции потерь ML обучались на расчетах ошибок FEA при подгонке пробных решений по сетке. Существует некоторое сходство с подходом PINN, но с важным отличием: эта нейронная сеть работает вместе с FEA для ускорения сходимости к решению при обучении. Что, очевидно, приводит к более быстрому обучению. Таким образом, модель нейронной сети работает без необходимости использования FEA. По своей конструкции модель, обученная таким образом, должна точно соответствовать физическим ограничениям реальной задачи, поскольку она очень точно обучалась на физически осведомленном решателе.

Я думаю, что моя интерпретация здесь довольно точна. Приветствую поправки от знатоков!

Поделитесь этим постом через:

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://semiwiki.com/artificial-intelligence/341034-blending-finite-element-methods-and-ml/

- :имеет

- :является

- $UP

- a

- О нас

- АБСТРАКТ НАЯ

- ускорять

- приемлемый

- точность

- точный

- через

- AG

- против

- Цель

- Все

- причислены

- альтернатива

- an

- анализирует

- анализ

- и

- Другой

- Приложения

- подхода

- МЫ

- ПЛОЩАДЬ

- возникающий

- около

- AS

- At

- привлекательный

- Авторы

- автомобильный

- знать

- фон

- BE

- , так как:

- становление

- было

- поведение

- ЛУЧШЕЕ

- между

- смешивание

- Блог

- изоферменты печени

- Границы

- брейки

- строить

- Группа

- но

- by

- байпас

- CAN

- автомобиль

- CFD

- клиент

- тесно

- объединять

- обычно

- комплекс

- сложность

- Соответствие закону

- вычислительный

- Условия

- последовательный

- ограничения

- построенный

- строительство

- продолжать

- Сближение

- исправления

- контрагент

- чехол для варгана

- покрытый

- Crash

- урожай

- База данных

- Проект

- подробнее

- разница

- различный

- разочаровывающим,

- домен

- доменов

- вниз

- динамика

- каждый

- Электронный

- элемент

- в другом месте

- уравнения

- ошибка

- особенно

- сущность

- по существу

- Даже

- проявлять

- эксперты

- Больше

- продлить

- достаточно

- быстрее

- Особенности

- Найдите

- соответствовать

- примерка

- жидкость

- Динамика жидкостей

- Что касается

- Рамки

- частота

- от

- передний

- полный

- функция

- Функции

- Компьютерщик

- порождать

- хорошо

- Есть

- здесь

- High

- Как

- Однако

- HTTPS

- i

- идея

- if

- важную

- in

- В других

- включает в себя

- информация

- сообщил

- начальный

- внутренний

- затраты

- интерпретация

- в

- интригующий

- введение

- IT

- ЕГО

- большой

- ведущий

- изучение

- наименее

- Кредитное плечо

- такое как

- Длинное

- дольше

- от

- многих

- математике

- макс-ширина

- механический

- Встречайте

- сетке

- метод

- методы

- может быть

- мин

- ML

- модель

- Модели

- БОЛЕЕ

- много

- с разными

- Мюнхен

- my

- родной

- Необходимость

- необходимый

- сеть

- нервный

- нет

- of

- on

- Возможность

- оптимизация

- оптимизирует

- заказ

- оригинал

- Другое

- внешний

- выходы

- внешнюю

- бумага & картон

- фаза

- физический

- Физически

- Физика

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- Точка

- возможности,

- После

- присутствие

- представлены

- Проблема

- проблемам

- прокси

- радар

- быстро

- реальные

- реалистичный

- Цена снижена

- требуется

- исследованиям

- резонирует

- Итоги

- Run

- Бег

- работает

- сценарий

- поцарапать

- отдельный

- набор

- Наборы

- должен

- показанный

- Сименс

- просто

- упрощенный

- с

- So

- Решение

- Решения

- РЕШАТЬ

- Решение

- некоторые

- Источник

- Space

- Начало

- начинается

- По-прежнему

- стресс

- Структура

- последующее

- такие

- Предлагает

- суперпозиция

- система

- системы

- Говорить

- Технический

- снижения вреда

- чем

- который

- Ассоциация

- Источник

- Там.

- следовательно

- тепловой

- Эти

- think

- этой

- хоть?

- Через

- время

- раз

- в

- вместе

- терпимость

- Темы

- Train

- специалистов

- Обучение

- суд

- под

- понимание

- Университеты

- использование

- используемый

- через

- Различная

- версии

- очень

- с помощью

- Путь..

- слабость

- добро пожаловать

- когда

- , которые

- в то время как

- широко

- в

- без

- работает

- бы

- зефирнет