Мы считаем, что генеративный искусственный интеллект со временем может изменить практически любой опыт клиентов, который мы знаем. Число компаний, запускающих генеративные приложения искусственного интеллекта на AWS, велико и быстро растет, включая adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy и LexisNexis Legal & Professional, и это лишь некоторые из них. Инновационные стартапы, такие как Perplexity AI, полностью используют AWS для создания генеративного искусственного интеллекта. Ведущие компании в области искусственного интеллекта, такие как Anthropic, выбрали AWS в качестве основного поставщика облачных услуг для критически важных рабочих нагрузок и места для обучения своих будущих моделей. А глобальные поставщики услуг и решений, такие как Accenture, пожинают плоды индивидуальных генеративных приложений искусственного интеллекта, предоставляя своим разработчикам возможности Amazon Code Whisperer.

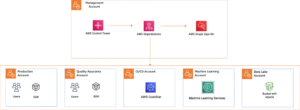

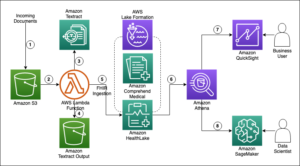

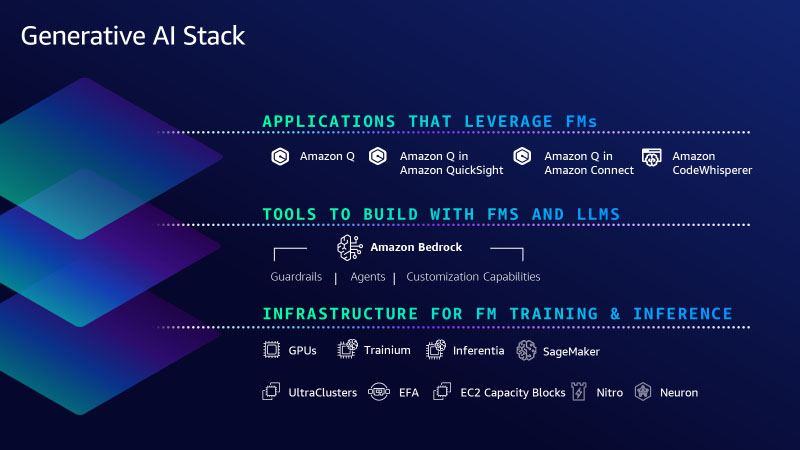

Эти клиенты выбирают AWS, потому что мы стремимся делать то, что делали всегда: использовать сложные и дорогие технологии, которые могут изменить качество обслуживания клиентов и бизнес, и демократизировать их для клиентов любого размера и технических возможностей. Для этого мы инвестируем и быстро внедряем инновации, чтобы предоставить наиболее полный набор возможностей на трех уровнях генеративного стека ИИ. Нижний уровень — это инфраструктура для обучения моделей большого языка (LLM) и других базовых моделей (FM) и создания выводов или прогнозов. Средний уровень — это легкий доступ ко всем моделям и инструментам, необходимым клиентам для создания и масштабирования генеративных приложений искусственного интеллекта с той же безопасностью, контролем доступа и другими функциями, которые клиенты ожидают от сервиса AWS. А на верхнем уровне мы инвестируем в революционные приложения в таких ключевых областях, как генеративное кодирование на основе искусственного интеллекта. Помимо предложения им выбора и, как они ожидают от нас, широты и глубины возможностей на всех уровнях, клиенты также говорят нам, что ценят наш подход, ориентированный на данные, и верят, что мы создали все с нуля с помощью корпоративного подхода. уровень безопасности и конфиденциальности.

На этой неделе мы сделали большой шаг вперед, анонсировав множество важных новых возможностей на всех трех уровнях стека, чтобы нашим клиентам было легко и практично широко использовать генеративный искусственный интеллект в своем бизнесе.

Нижний уровень стека: AWS Trainium2 — новейшее дополнение, обеспечивающее самую передовую облачную инфраструктуру для генеративного искусственного интеллекта.

Нижний уровень стека — это инфраструктура — вычисления, сети, платформы, сервисы — необходимая для обучения и работы LLM и других FM. AWS внедряет инновации, предлагая самую передовую инфраструктуру для машинного обучения. Благодаря нашему давнему сотрудничеству с NVIDIA, AWS была первой, кто перенес графические процессоры в облако более 12 лет назад, а совсем недавно мы стали первым крупным поставщиком облачных услуг, сделавшим графические процессоры NVIDIA H100 доступными для наших инстансов P5. Мы продолжаем инвестировать в уникальные инновации, которые делают AWS лучшим облаком для работы с графическими процессорами, в том числе преимущества соотношения цены и производительности самой передовой системы виртуализации (AWS Nitro), мощные сети петабитного масштаба с адаптером Elastic Fabric (EFA) и гипертехнологии. масштабируйте кластеризацию с помощью Amazon EC2 UltraClusters (тысячи ускоренных экземпляров, расположенных в зоне доступности и соединенных между собой в неблокируемой сети, которая может обеспечивать скорость до 3,200 Гбит/с для крупномасштабного обучения машинному обучению). Мы также упрощаем для любого клиента доступ к востребованным вычислительным мощностям графических процессоров для генеративного искусственного интеллекта с помощью блоков емкости Amazon EC2 для машинного обучения — первой и единственной модели потребления в отрасли, которая позволяет клиентам резервировать графические процессоры для будущего использования (до 500 развернуты в EC2 UltraClusters) для кратковременных рабочих нагрузок машинного обучения.

Несколько лет назад мы поняли, что для того, чтобы продолжать расширять границы ценовых характеристик, нам необходимо внедрять инновации вплоть до кремния, и мы начали инвестировать в наши собственные чипы. В частности, что касается машинного обучения, мы начали с AWS Inferentia, нашего специального чипа вывода. Сегодня мы используем второе поколение AWS Inferentia с экземплярами Amazon EC2 Inf2, которые оптимизированы специально для крупномасштабных генеративных приложений искусственного интеллекта с моделями, содержащими сотни миллиардов параметров. Инстансы Inf2 предлагают самые низкие затраты на логический вывод в облаке, а также обеспечивают до четырех раз более высокую пропускную способность и до десяти раз меньшую задержку по сравнению с инстансами Inf1. Inf12, оснащенный до 2 чипами Inferentia2, является единственным экземпляром EC2, оптимизированным для вывода, который имеет высокоскоростное соединение между ускорителями, поэтому клиенты могут выполнять вывод быстрее и эффективнее (с меньшими затратами), не жертвуя производительностью или задержкой за счет распространения сверхбольших моделей. через несколько ускорителей. Такие клиенты, как Adobe, Deutsche Telekom и Leonardo.ai, увидели отличные первые результаты и с нетерпением ждут масштабного развертывания своих моделей на Inf2.

Что касается обучения, то экземпляры Trn1, работающие на базе специального обучающего чипа машинного обучения AWS, AWS Trainium, оптимизированы для распределения обучения между несколькими серверами, подключенными к сети EFA. Такие клиенты, как Ricoh, всего за несколько дней обучили японского LLM миллиардам параметров. Databricks обеспечивает до 40 % лучшее соотношение цены и качества благодаря экземплярам на базе Trainium для обучения крупномасштабных моделей глубокого обучения. Но поскольку новые, более функциональные модели выходят практически каждую неделю, мы продолжаем расширять границы производительности и масштаба, и мы рады объявить об этом. AWS Трениум2, разработанный для обеспечения еще более выгодных ценовых показателей для обучающих моделей с сотнями миллиардов и триллионами параметров.. Trainium2 должен обеспечивать производительность обучения в четыре раза выше, чем Trainium первого поколения, а при использовании в EC2 UltraClusters совокупная вычислительная мощность должна достигать 65 экзафлопс. Это означает, что клиенты смогут обучить LLM с 300 миллиардами параметров за недели, а не за месяцы. Производительность, масштаб и энергоэффективность Trainium2 — вот некоторые из причин, по которым Anthropic решила обучать свои модели на AWS и будет использовать Trainium2 для своих будущих моделей. И мы сотрудничаем с Anthropic в постоянных инновациях с Trainium и Inferentia. Мы ожидаем, что наши первые экземпляры Trainium2 будут доступны клиентам в 2024 году.

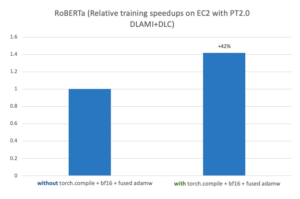

Мы также увеличили набор программных инструментов для нашей микросхемы машинного обучения, в частности, для продвижения AWS Neuron, комплекта разработки программного обеспечения (SDK), который помогает клиентам получить максимальную производительность от Trainium и Inferentia. С момента представления Neuron в 2019 году мы вложили значительные средства в технологии компиляторов и фреймворков, и сегодня Neuron поддерживает многие из наиболее популярных общедоступных моделей, включая Llama 2 от Meta, MPT от Databricks и Stable Diffusion от Stability AI, а также 93 из 100 лучших моделей в популярном репозитории моделей Hugging Face. Neuron подключается к популярным платформам машинного обучения, таким как PyTorch и TensorFlow, а поддержка JAX появится в начале следующего года. Клиенты говорят нам, что Neuron позволил им легко переключить существующие конвейеры обучения моделей и вывода на Trainium и Inferentia с помощью всего лишь нескольких строк кода.

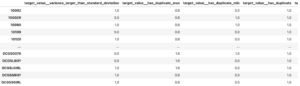

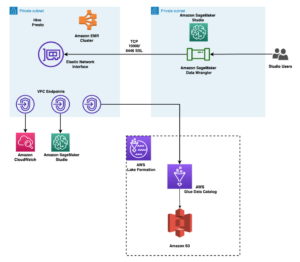

Никто другой не предлагает такое сочетание лучших чипов машинного обучения, сверхбыстрых сетей, виртуализации и гипермасштабируемых кластеров. Поэтому неудивительно, что некоторые из самых известных стартапов в области генеративного ИИ, такие как AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway и Stability AI, работают на AWS. Но вам по-прежнему нужны правильные инструменты для эффективного использования этих вычислений для эффективного и экономичного создания, обучения и запуска LLM и других FM. И для многих из этих стартапов Создатель мудреца Амазонки это ответ. Будь то создание и обучение новой собственной модели с нуля или начало работы с одной из многих популярных общедоступных моделей, обучение — сложное и дорогостоящее мероприятие. Также непросто эксплуатировать эти модели с минимальными затратами. Клиентам необходимо получить большие объемы данных и подготовить их. Обычно это требует большого количества ручной работы по очистке данных, удалению дубликатов, их дополнению и преобразованию. Затем им приходится создавать и поддерживать большие кластеры графических процессоров/ускорителей, писать код для эффективного распределения обучения модели по кластерам, часто проверять точки, приостанавливать, проверять и оптимизировать модель, а также вручную вмешиваться и устранять аппаратные проблемы в кластере. Многие из этих проблем не новы, они являются одними из причин, по которым мы запустили SageMaker шесть лет назад — чтобы разрушить множество барьеров, связанных с обучением и развертыванием моделей, и предоставить разработчикам гораздо более простой путь. Десятки тысяч клиентов используют Amazon SageMaker, и все большее число из них, таких как LG AI Research, Perplexity AI, AI21, Hugging Face и Stability AI, обучают LLM и других FM-специалистов с помощью SageMaker. Совсем недавно Институт технологических инноваций (создатели популярных программ Falcon LLM) обучил самую большую общедоступную модель — Falcon 180B — на SageMaker. По мере роста размеров и сложности моделей росли и возможности SageMaker.

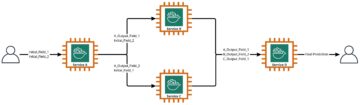

За прошедшие годы мы добавили в Amazon SageMaker более 380 революционных функций и возможностей, таких как автоматическая настройка моделей, распределенное обучение, гибкие варианты развертывания моделей, инструменты для операций машинного обучения, инструменты для подготовки данных, хранилища функций, блокноты, бесшовная интеграция. с человеческими оценками на протяжении всего жизненного цикла машинного обучения и встроенными функциями для ответственного ИИ. Мы продолжаем быстро внедрять инновации, чтобы клиенты SageMaker могли продолжать создавать, обучать и выполнять логические выводы для всех моделей, включая LLM и другие FM. И мы делаем обучение и развертывание больших моделей еще проще и экономичнее для клиентов благодаря двум новым возможностям. Во-первых, чтобы упростить обучение, мы введение Amazon SageMaker HyperPod который автоматизирует больше процессов, необходимых для крупномасштабного отказоустойчивого распределенного обучения. (например, настройка распределенных библиотек обучения, масштабирование учебных нагрузок на тысячи ускорителей, обнаружение и исправление неисправных экземпляров), что ускоряет обучение на целых 40%. В результате такие клиенты, как Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid и другие, используют SageMaker HyperPod для создания, обучения или развития моделей. Второй, мы представляем новые возможности, которые сделают вывод более экономичным и при этом уменьшат задержку. SageMaker теперь помогает клиентам развертывать несколько моделей в одном экземпляре, чтобы они могли совместно использовать вычислительные ресурсы, что снижает затраты на логические выводы на 50 % (в среднем). SageMaker также активно отслеживает экземпляры, обрабатывающие запросы на вывод, и интеллектуально маршрутизирует запросы в зависимости от того, какие экземпляры доступны, что позволяет снизить задержку вывода на 20 % (в среднем). Conjecture, Salesforce и Slack уже используют SageMaker для размещения моделей благодаря оптимизации вывода.

Средний уровень стека: Amazon Bedrock добавляет новые модели и ряд новых возможностей, которые еще больше упрощают для клиентов безопасное создание и масштабирование генеративных приложений искусственного интеллекта.

Хотя ряд клиентов будут создавать свои собственные LLM и другие FM или развивать любое количество общедоступных вариантов, многие не захотят тратить на это ресурсы и время. Для них средний уровень стека предлагает эти модели как услугу. Наше решение здесь, Коренная порода Амазонки, позволяет клиентам выбирать из ведущих в отрасли моделей Anthropic, Stability AI, Meta, Cohere, AI21 и Amazon, настраивать их с использованием собственных данных и использовать все те же ведущие функции безопасности, контроля доступа и функции, к которым они привыкли. в AWS — и все это через управляемый сервис. В конце сентября мы сделали Amazon Bedrock общедоступным, и отзывы клиентов были исключительно положительными. Клиенты со всего мира и практически из каждой отрасли с удовольствием используют Amazon Bedrock. Adidas позволяет разработчикам получать быстрые ответы на любые вопросы: от информации для начала работы до более глубоких технических вопросов. Booking.com намерен использовать генеративный искусственный интеллект для составления индивидуальных рекомендаций по поездке для каждого клиента. Bridgewater Associates разрабатывает помощника инвестиционного аналитика на базе LLM, который поможет создавать диаграммы, рассчитывать финансовые показатели и обобщать результаты. Carrier делает более точную энергетическую аналитику и аналитические данные доступными для клиентов, чтобы они могли снизить потребление энергии и сократить выбросы углекислого газа. Clariant предоставляет членам своей команды внутреннего чат-бота с генеративным искусственным интеллектом для ускорения процессов исследований и разработок, поддержки отделов продаж в подготовке к встречам и автоматизации электронной почты клиентов. GoDaddy помогает клиентам легко организовать свой бизнес в Интернете, используя генеративный искусственный интеллект для создания веб-сайтов, поиска поставщиков, связи с клиентами и многого другого. Lexis Nexis Legal & Professional меняет юридическую работу юристов и повышает их продуктивность благодаря возможностям диалогового поиска Lexis+ AI, обобщения, составления и анализа документов. Nasdaq помогает автоматизировать рабочие процессы расследований подозрительных транзакций и усилить возможности борьбы с финансовыми преступлениями и наблюдения. Все эти и многие другие разнообразные приложения генеративного ИИ работают на AWS.

Мы воодушевлены развитием Amazon Bedrock, но это еще только начало. Работая с клиентами, мы увидели, что все движутся быстро, но эволюция генеративного искусственного интеллекта продолжается быстрыми темпами, а новые возможности и инновации появляются практически ежедневно. Клиенты обнаруживают, что существуют разные модели, которые лучше работают для разных случаев использования или с разными наборами данных. Некоторые модели отлично подходят для обобщения, другие — для рассуждений и интеграции, а третьи имеют действительно потрясающую языковую поддержку. А еще есть генерация изображений, варианты использования для поиска и многое другое — все это происходит как на основе проприетарных моделей, так и на основе моделей, которые общедоступны для всех. А во времена, когда так много непознаваемого, способность адаптироваться, возможно, является самым ценным инструментом из всех. Не будет одной модели, которая бы управляла всеми. И уж точно не одна технологическая компания, предлагающая модели, которыми пользуются все. Клиентам необходимо пробовать разные модели. У них должна быть возможность переключаться между ними или комбинировать их в рамках одного варианта использования. Это означает, что им нужен реальный выбор поставщиков моделей (что еще более ясно продемонстрировали события последних 10 дней). Вот почему мы изобрели Amazon Bedrock, почему он так глубоко находит отклик у клиентов и почему мы продолжаем внедрять инновации и быстро внедрять итерации, чтобы сделать создание (и перемещение между) рядом моделей таким же простым, как вызов API, используя новейшие технологии. для настройки модели в руках всех разработчиков и обеспечения безопасности клиентов и конфиденциальности их данных. Мы рады представить несколько новых возможностей, которые еще больше упростят клиентам создание и масштабирование генеративных приложений ИИ:

- Расширение выбора моделей за счет Anthropic Claude 2.1, Meta Llama 2 70B и дополнений к семейству Amazon Titan. На заре клиенты все еще изучают и экспериментируют с различными моделями, чтобы определить, какие из них они хотят использовать для различных целей. Они хотят иметь возможность легко опробовать новейшие модели, а также проверить, какие возможности и функции дадут им наилучшие результаты и финансовые характеристики для их сценариев использования. Благодаря Amazon Bedrock клиенты могут получить новую модель всего в одном вызове API. Некоторые из наиболее впечатляющих результатов, которые клиенты получили за последние несколько месяцев, были получены от таких программ LLM, как Модель Клода от Anthropic, который превосходно справляется с широким спектром задач: от сложных диалогов и создания контента до сложных рассуждений, сохраняя при этом высокую степень надежности и предсказуемости. Клиенты сообщают, что Claude с гораздо меньшей вероятностью выдает вредные результаты, с ним легче общаться и он более управляем по сравнению с другими FM, поэтому разработчики могут получить желаемый результат с меньшими усилиями. Современная модель Anthropic, Claude 2, набирает баллы выше 90-го процентиля на экзаменах GRE по чтению и письму, а также по количественному мышлению. И теперь недавно выпущенная модель Claude 2.1 доступна на Amazon Bedrock. Claude 2.1 предоставляет предприятиям ключевые возможности, такие как лучшее в отрасли контекстное окно на 200 тыс. токенов (в два раза больше контекста, чем Claude 2), снижение частоты галлюцинаций и значительное повышение точности даже при очень большой длине контекста. Claude 2.0 также включает улучшенные системные подсказки, которые представляют собой типовые инструкции, которые обеспечивают удобство работы для конечных пользователей, а также снижают стоимость подсказок и дополнений на 2.1%.

Для растущего числа клиентов, желающих использовать управляемую версию общедоступной модели Meta 2 Llama 2, Amazon Bedrock предлагает Llama 13 XNUMXB и добавляем Ламу 2 70Б. Llama 2 70B подходит для масштабных задач, таких как языковое моделирование, генерация текста и диалоговые системы. Общедоступные модели Llama были загружены более 30 миллионов раз, и клиентам нравится, что Amazon Bedrock предлагает их как часть управляемого сервиса, где им не нужно беспокоиться об инфраструктуре или иметь глубокие знания в области машинного обучения в своих командах. Кроме того, для создания изображений Stability AI предлагает набор популярных моделей преобразования текста в изображение. Stable Diffusion XL 1.0 (SDXL 1.0) — самый продвинутый из них, и теперь он общедоступен на Amazon Bedrock.. Последняя версия этой популярной модели изображения имеет повышенную точность, лучший фотореализм и более высокое разрешение.

Клиенты также используют Амазонка Титан модели, которые создаются и предварительно обучаются в AWS, чтобы предложить мощные возможности с отличной экономичностью для различных вариантов использования. Amazon имеет 25-летний опыт работы в области машинного обучения и искусственного интеллекта — технологий, которые мы используем в нашем бизнесе, — и мы многому научились в создании и развертывании моделей. Мы тщательно выбрали способ обучения наших моделей и данные, которые мы для этого используем. Мы защищаем клиентов от претензий о том, что наши модели или их результаты нарушают чьи-либо авторские права. Мы представили наши первые модели Titan в апреле этого года. Титан Текст Лайт— теперь общедоступен— это лаконичная и экономичная модель для таких случаев использования, как чат-боты, обобщение текста или копирайтинг, и ее также легко настраивать. Titan Text Express — теперь также общедоступен.— более обширен и может использоваться для более широкого круга текстовых задач, таких как генерация открытого текста и диалоговый чат. Мы предлагаем эти варианты текстовой модели, чтобы дать клиентам возможность оптимизировать точность, производительность и стоимость в зависимости от их варианта использования и бизнес-требований. Такие клиенты, как Nexxiot, PGA Tour и Ryanair, используют две наши модели Titan Text. У нас также есть модель внедрения Titan Text Embeddings для вариантов использования в поиске и персонализации. Такие клиенты, как Nasdaq, видят отличные результаты, используя Titan Text Embeddings для расширения возможностей Nasdaq IR Insight по получению аналитической информации из документов более 9,000 глобальных компаний для групп по устойчивому развитию, юридических и бухгалтерских отделов. И со временем мы продолжим добавлять новые модели в семейство Titan. Мы представляем новую модель встраивания Titan Multimodal Embeddings., чтобы обеспечить мультимодальный поиск и рекомендации для пользователей, использующих изображения и текст (или их комбинацию) в качестве входных данных. И мы Представляем новую модель преобразования текста в изображение — Amazon Titan Image Generator. С помощью Titan Image Generator клиенты из таких отраслей, как реклама, электронная коммерция, средства массовой информации и развлечения, могут использовать ввод текста для создания реалистичных изображений студийного качества в больших объемах и по низкой цене. Мы воодушевлены тем, как клиенты реагируют на модели Titan, и вы можете ожидать, что мы продолжим внедрять инновации.

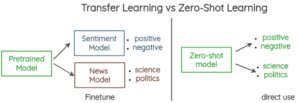

- Новые возможности для безопасной настройки вашего генеративного приложения искусственного интеллекта с использованием ваших собственных данных.: Одна из наиболее важных возможностей Amazon Bedrock — это простота настройки модели. Это становится по-настоящему интересным для клиентов, потому что именно здесь генеративный искусственный интеллект встречается с их основным отличием — их данными. Однако очень важно, чтобы их данные оставались в безопасности, чтобы они могли контролировать их на протяжении всего процесса и чтобы улучшения моделей были конфиденциальными для них. Есть несколько способов сделать это, и Amazon Bedrock предлагает широчайший выбор вариантов настройки для нескольких моделей). Первое — это тонкая настройка. Точную настройку модели в Amazon Bedrock выполнить легко. Вы просто выбираете модель, и Amazon Bedrock создает ее копию. Затем вы указываете на несколько помеченных примеров (например, серию хороших пар вопрос-ответ), которые вы храните в Amazon Simple Storage Service (Amazon S3), и Amazon Bedrock «инкрементально обучает» (дополняет скопированную модель новой информацией). на этих примерах, и результатом является частная, более точная и точно настроенная модель, которая обеспечивает более релевантные и индивидуальные ответы. Мы рады сообщить, что точная настройка доступна для Cohere Command, Meta Llama 2, Amazon Titan Text (Lite и Express), Amazon Titan Multimodal Embeddings, а также в предварительной версии для Amazon Titan Image Generator. И благодаря нашему сотрудничеству с Anthropic мы вскоре предоставим клиентам AWS ранний доступ к уникальным функциям для настройки модели и точной настройки современной модели Claude.

Второй метод настройки LLM и других FM для вашего бизнеса — это дополненная генерация извлечения (RAG), которая позволяет вам настраивать ответы модели, дополняя ваши подсказки данными из нескольких источников, включая репозитории документов, базы данных и API. В сентябре мы представили возможность RAG — базы знаний для Amazon Bedrock, которая безопасно соединяет модели с вашими собственными источниками данных, дополняя ваши запросы дополнительной информацией, чтобы ваши приложения предоставляли более релевантные, контекстуальные и точные ответы. Основы знаний теперь общедоступен с API, который выполняет весь рабочий процесс RAG. от получения текста, необходимого для дополнения подсказки, до отправки подсказки в модель и возврата ответа. Базы знаний поддерживают базы данных с векторными возможностями, в которых хранятся числовые представления ваших данных (внедрения), которые модели используют для доступа к этим данным для RAG, включая Amazon OpenSearch Service, и другие популярные базы данных, такие как Pinecone и Redis Enterprise Cloud (в будущем появится поддержка векторов Amazon Aurora и MongoDB). скоро).

Третий способ настройки моделей в Amazon Bedrock — это постоянное предварительное обучение. С помощью этого метода модель основывается на исходной предварительной подготовке к общему пониманию языка для изучения языка и терминологии, специфичной для предметной области. Этот подход предназначен для клиентов, которые имеют большие объемы неразмеченной, специфичной для предметной области информации и хотят, чтобы их LLM понимали язык, фразы, сокращения, концепции, определения и жаргонизмы, уникальные для их мира (и бизнеса). В отличие от тонкой настройки, которая требует довольно небольшого объема данных, постоянное предварительное обучение выполняется на больших наборах данных (например, тысячах текстовых документов). Теперь в Amazon Bedrock доступны возможности предварительного обучения для Titan Text Lite и Titan Text Express.

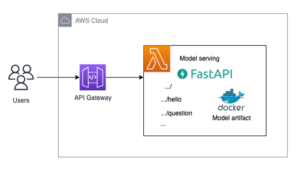

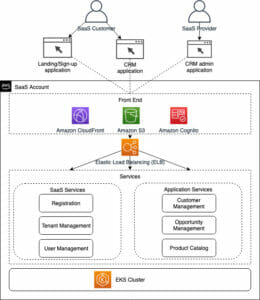

- Общая доступность Агенты Amazon Bedrock помочь выполнить многоэтапные задачи с использованием систем, источников данных и знаний компании. LLM отлично умеют вести переговоры и генерировать контент, но клиенты хотят, чтобы их приложения могли do даже больше — например, предпринимайте действия, решайте проблемы и взаимодействуйте с различными системами для выполнения многоэтапных задач, таких как бронирование поездок, подача страховых претензий или заказ запасных частей. И Amazon Bedrock может помочь решить эту задачу. С помощью агентов разработчики выбирают модель, пишут несколько основных инструкций типа «вы веселый агент по обслуживанию клиентов» и «проверьте наличие товара в системе инвентаризации», указывают выбранной модели на правильные источники данных и системы предприятия (например, CRM). или приложения ERP) и напишите несколько функций AWS Lambda для выполнения API (например, проверки доступности элемента в инвентаре ERP). Amazon Bedrock автоматически анализирует запрос и разбивает его на логическую последовательность, используя возможности рассуждения выбранной модели, чтобы определить, какая информация необходима, какие API следует вызывать и когда вызывать их для выполнения шага или решения задачи. Теперь, когда они общедоступны, агенты могут планировать и выполнять большинство бизнес-задач — от ответов на вопросы клиентов о доступности вашего продукта до принятия их заказов — и разработчикам не нужно быть знакомым с машинным обучением, инженерными подсказками, обучать модели или подключать системы вручную. И Bedrock делает все это безопасно и конфиденциально, и такие клиенты, как Druva и Athene, уже используют их для повышения точности и скорости разработки своих генеративных приложений ИИ.

- Вводя Ограждения для коренных пород Амазонки чтобы вы могли применять меры безопасности на основе требований вашего варианта использования и политик ответственного ИИ. Клиенты хотят быть уверены, что взаимодействие с их приложениями искусственного интеллекта безопасно, избегает токсичных или оскорбительных выражений, сохраняет актуальность для своего бизнеса и соответствует своим политикам ответственного использования искусственного интеллекта. Благодаря ограничениям клиенты могут указывать темы, которых следует избегать, а Amazon Bedrock будет предоставлять пользователям только утвержденные ответы на вопросы, которые попадают в эти ограниченные категории. Например, приложение онлайн-банкинга можно настроить так, чтобы он не давал советов по инвестициям и удалял неприемлемый контент (например, разжигание ненависти и насилие). В начале 2024 года клиенты также смогут удалять личную информацию (PII) в ответах моделей. Например, после того, как клиент взаимодействует с агентом колл-центра, разговор со службой поддержки часто суммируется для ведения учета, и защитные меры могут удалить личную информацию из этих сводок. Guardrails можно использовать в моделях Amazon Bedrock (включая точно настроенные модели), а также в агентах для Amazon Bedrock, чтобы клиенты могли обеспечить согласованный уровень защиты для всех своих генеративных приложений ИИ.

Верхний уровень стека: постоянные инновации делают генеративный искусственный интеллект доступным для большего числа пользователей.

На верхнем уровне стека находятся приложения, которые используют LLM и другие FM, чтобы вы могли использовать преимущества генеративного ИИ на работе. Одна из областей, в которой генеративный ИИ уже меняет правила игры, — это программирование. В прошлом году мы представили Amazon CodeWhisperer, который помогает создавать приложения быстрее и безопаснее, генерируя предложения и рекомендации по коду практически в реальном времени. Такие клиенты, как Accenture, Boeing, Bundesliga, The Cigna Group, Kone и Warner Music Group, используют CodeWhisperer для повышения производительности разработчиков, а Accenture предоставляет возможность использовать Amazon CodeWhisperer до 50,000 XNUMX своих разработчиков программного обеспечения и ИТ-специалистов. Мы хотим, чтобы как можно больше разработчиков смогли получить преимущества производительности от генеративного искусственного интеллекта, поэтому CodeWhisperer предлагает бесплатные рекомендации для всех людей.

Однако, хотя инструменты ИИ-кодирования во многом облегчают жизнь разработчиков, их преимущества в производительности ограничены отсутствием знаний о внутренних базах кода, внутренних API, библиотеках, пакетах и классах. Один из способов подумать об этом: если вы наймете нового разработчика, даже если он мирового класса, он не будет настолько продуктивен в вашей компании, пока не поймет ваши лучшие практики и код. Сегодняшние инструменты кодирования на базе искусственного интеллекта похожи на новоиспеченного разработчика. Чтобы помочь в этом, мы недавно анонсировали новый возможность настройки в Amazon CodeWhisperer, который безопасно использует внутреннюю кодовую базу клиента для предоставления более актуальных и полезных рекомендаций по коду. Благодаря этой возможности CodeWhisperer является экспертом по надежная код и предоставляет более актуальные рекомендации, позволяющие сэкономить еще больше времени. В исследовании, которое мы провели совместно с Persistent, глобальной компанией по цифровому проектированию и модернизации предприятий, мы обнаружили, что настройки помогают разработчикам выполнять задачи на 28 % быстрее, чем при использовании общих возможностей CodeWhisperer. Теперь разработчик компании, занимающейся технологиями в области здравоохранения, может попросить CodeWhisperer «импортировать изображения МРТ, связанные с идентификатором клиента, и пропустить их через классификатор изображений», чтобы обнаружить аномалии. Поскольку CodeWhisperer имеет доступ к базе кода, он может предоставлять гораздо более релевантные предложения, включая места импорта изображений МРТ и идентификаторы клиентов. CodeWhisperer сохраняет настройки полностью конфиденциальными, а базовый FM не использует их для обучения, защищая ценную интеллектуальную собственность клиентов. AWS — единственный крупный поставщик облачных услуг, предлагающий подобные возможности каждому.

Вводя Амазон Кью, генеративный помощник на базе искусственного интеллекта, созданный для работы

Разработчики, конечно, не единственные, кто знакомится с генеративным ИИ: миллионы людей используют чат-приложения с генеративным ИИ. То, что первые поставщики сделали в этой области, интересно и очень полезно для потребителей, но во многих отношениях они не совсем «работают» на работе. Их общие знания и способности велики, но они не знают вашу компанию, ваши данные, ваших клиентов, ваши операции или ваш бизнес. Это ограничивает то, насколько они могут вам помочь. Они также мало что знают о вашей роли: какую работу вы выполняете, с кем работаете, какую информацию используете и к чему у вас есть доступ. Эти ограничения понятны, поскольку эти помощники не имеют доступа к личной информации вашей компании и не предназначены для удовлетворения требований конфиденциальности и безопасности данных, которые компании должны предоставить им такой доступ. Трудно сосредоточиться на безопасности постфактум и ожидать, что она будет работать хорошо. Мы думаем, что у нас есть лучший способ, который позволит каждому человеку в любой организации безопасно использовать генеративный ИИ в своей повседневной работе.

WМы рады представить Amazon Q — новый тип генеративного помощника на базе искусственного интеллекта, который создан специально для работы и может быть адаптирован к вашему бизнесу. Q может помочь вам получить быстрые и актуальные ответы на насущные вопросы, решить проблемы, создать контент и предпринять действия, используя данные и опыт, найденные в информационных хранилищах, коде и корпоративных системах вашей компании. Когда вы общаетесь с Amazon Q, он мгновенно предоставляет актуальную информацию и советы, которые помогут оптимизировать задачи, ускорить принятие решений, а также стимулировать творческий подход и инновации в работе. Мы создали Amazon Q безопасным и конфиденциальным, он может понимать и уважать ваши существующие идентификационные данные, роли и разрешения, а также использовать эту информацию для персонализации своего взаимодействия. Если у пользователя нет разрешения на доступ к определенным данным без Q, он также не сможет получить к ним доступ с помощью Q. Мы разработали Amazon Q так, чтобы с первого дня удовлетворить строгие требования корпоративных клиентов — ни один из их контента не используется для улучшения базовых моделей.

Amazon Q — ваш опытный помощник для разработки на AWS: Мы обучили Amazon Q, используя 17-летний опыт и знания AWS, чтобы он мог изменить способы создания, развертывания и эксплуатации приложений и рабочих нагрузок на AWS. Amazon Q имеет интерфейс чата в консоли управления AWS и документации, в вашей IDE (через CodeWhisperer), а также в чатах вашей команды в Slack или других приложениях для чата. Amazon Q может помочь вам изучить новые возможности AWS, быстрее приступить к работе, изучить незнакомые технологии, спроектировать решения, устранить неполадки, обновить и многое другое — он является экспертом в хорошо спроектированных шаблонах AWS, передовых практиках, документации и внедрении решений. Вот несколько примеров того, что вы можете делать с помощью нового экспертного помощника AWS:

- Получите четкие ответы и рекомендации по возможностям, сервисам и решениям AWS: Попросите Amazon Q «Расскажите мне об агентах для Amazon Bedrock», и Q предоставит вам описание функции, а также ссылки на соответствующие материалы. Вы также можете задать Amazon Q практически любой вопрос о том, как работает сервис AWS (например, «Каковы ограничения масштабирования таблицы DynamoDB?», «Что такое управляемое хранилище Redshift?») или о том, как лучше спроектировать любое количество решений ( «Каковы лучшие практики построения событийно-ориентированной архитектуры?»). Amazon Q соберет краткие ответы и всегда ссылается на свои источники.

- Выберите лучший сервис AWS для своего варианта использования и быстро приступайте к работе: Задайте вопрос Amazon: «Каковы способы создания веб-приложения на AWS?» », и он предоставит список потенциальных услуг, таких как АМС Усиление, AWS Lambdaи Amazon EC2 с преимуществами каждого. Отсюда вы можете сузить варианты, помогая Q понять ваши требования, предпочтения и ограничения (например, «Что из этого будет лучше, если я хочу использовать контейнеры?» или «Должен ли я использовать реляционную или нереляционную базу данных? »). Закончите вопросом «Как мне начать?». и Amazon Q обрисует некоторые основные шаги и укажет вам на дополнительные ресурсы.

- Оптимизируйте свои вычислительные ресурсы: Amazon Q может помочь вам выбрать инстансы Amazon EC2. Если вы попросите его: «Помогите мне найти правильный экземпляр EC2 для развертывания рабочей нагрузки по кодированию видео для моего игрового приложения с максимальной производительностью», Q предоставит вам список семейств экземпляров с обоснованием каждого предложения. Кроме того, вы можете задать любое количество дополнительных вопросов, чтобы помочь найти лучший вариант для вашей рабочей нагрузки.

- Получите помощь в отладке, тестировании и оптимизации вашего кода: Если при написании кода в IDE вы столкнулись с ошибкой, вы можете попросить Amazon Q помочь, сказав: «В моем коде ошибка ввода-вывода, можете ли вы предоставить исправление?» и Q сгенерирует для вас код. Если вам нравится это предложение, вы можете попросить Amazon Q добавить исправление в ваше приложение. Поскольку Amazon Q находится в вашей IDE, он понимает код, над которым вы работаете, и знает, куда вставить исправление. Amazon Q также может создавать модульные тесты («Написание модульных тестов для выбранной функции»), которые можно вставлять в ваш код и запускать. Наконец, Amazon Q может подсказать вам способы оптимизации вашего кода для повышения производительности. Попросите Q «Оптимизировать выбранный мной запрос DynamoDB», и он будет использовать свое понимание вашего кода, чтобы на естественном языке предложить, что исправить, а также сопроводительный код, который вы можете реализовать одним щелчком мыши.

- Диагностика и устранение неполадок: Если вы столкнулись с проблемами в консоли управления AWS, такими как ошибки разрешений EC2 или ошибки конфигурации Amazon S3, вы можете просто нажать кнопку «Устранение неполадок с помощью Amazon Q», и она будет использовать свое понимание типа ошибки и сервиса, в котором находится ошибка. чтобы дать вам предложения по исправлению. Вы даже можете попросить Amazon Q устранить неполадки в вашей сети (например, «Почему я не могу подключиться к моему экземпляру EC2 с помощью SSH?»), и Q проанализирует вашу сквозную конфигурацию и предоставит диагноз (например, «Этот экземпляр похоже, находится в частной подсети, поэтому, возможно, потребуется обеспечить публичный доступ»).

- Быстро начните работу над новой кодовой базой: Когда вы общаетесь с Amazon Q в своей IDE, он сочетает свой опыт в создании программного обеспечения с пониманием вашего кода — мощное сочетание! Раньше, если вы переняли проект от кого-то другого или были новичком в команде, вам, возможно, приходилось часами вручную просматривать код и документацию, чтобы понять, как он работает и что он делает. Теперь, поскольку Amazon Q понимает код в вашей IDE, вы можете просто попросить Amazon Q объяснить код («Предоставьте мне описание того, что делает это приложение и как оно работает»), и Q предоставит вам подробную информацию, например, какие службы использует код и что делают различные функции (например, Q может ответить что-то вроде: «Это приложение создает базовую систему заявок в службу поддержки с использованием Python Flask и AWS Lambda» и продолжить описание каждой из его основных возможностей, того, как они реализованы, и многое другое).

- Очищайте накопившиеся функции быстрее: Вы даже можете попросить Amazon Q помочь вам и автоматизировать большую часть сквозного процесса добавления функции в ваше приложение. Amazon CodeCatalyst, наша унифицированная служба разработки программного обеспечения для команд. Для этого вы просто назначаете Q невыполненную задачу из своего списка задач — так же, как если бы вы это делали товарищем по команде — и Q генерирует пошаговый план того, как он будет создавать и реализовывать эту функцию. Как только вы одобрите план, Q напишет код и представит вам предлагаемые изменения в виде проверки кода. Вы можете запросить доработку (при необходимости), утвердить и/или развернуть!

- Обновите свой код за короткое время: Большинство разработчиков на самом деле тратят лишь часть своего времени на написание нового кода и создание новых приложений. Они тратят гораздо больше времени на болезненные и утомительные области, такие как обслуживание и обновления. Обновите языковую версию. Большое количество клиентов продолжают использовать старые версии Java, поскольку для обновления потребуются месяцы — даже годы — и тысячи часов времени разработчиков. Откладывание этого процесса сопряжено с реальными издержками и рисками: вы упускаете возможность повышения производительности и уязвимы для проблем с безопасностью. Мы думаем, что Amazon Q может изменить правила игры, и очень рады Преобразование Amazon Q-кода, функция, которая может облегчить большую часть этой тяжелой работы и сократить время, необходимое для обновления приложений, с дней до минут. Вы просто открываете код, который хотите обновить, в своей IDE, и просите Amazon Q «/преобразовать» ваш код. Amazon Q проанализирует весь исходный код приложения, сгенерирует код на целевом языке и версии и выполнит тесты, помогая вам реализовать улучшения безопасности и производительности последних языковых версий. Недавно очень небольшая группа разработчиков Amazon использовала Amazon Q Code Transformation для обновления 1,000 производственных приложений с Java 8 до Java 17 всего за два дня. Среднее время рассмотрения заявки составило менее 10 минут. Сегодня Amazon Q Code Transformation выполняет обновление языка Java с Java 8 или Java 11 до Java 17. Следующим шагом (и скоро) станет возможность преобразования .NET Framework в кроссплатформенный .NET (в будущем ожидается еще больше преобразований). .

Amazon Q — ваш бизнес-эксперт: вы можете подключить Amazon Q к своим бизнес-данным, информации и системам, чтобы он мог синтезировать все и предоставлять индивидуальную помощь, помогая людям решать проблемы, генерировать контент и предпринимать действия, имеющие отношение к вашему бизнесу. Внедрить Amazon Q в свой бизнес очень просто. Он имеет более 40 встроенных коннекторов для популярных корпоративных систем, таких как Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive и Zendesk. Он также может подключаться к вашей внутренней интрасети, вики-сайтам и рабочим книгам, а с помощью Amazon Q SDK вы можете создать соединение с любым внутренним приложением, которое вам нужно. Направьте Amazon Q на эти репозитории, и он «ускорит» ваш бизнес, собирая и понимая семантическую информацию, которая делает вашу компанию уникальной. Затем вы получаете собственное удобное и простое веб-приложение Amazon Q, чтобы сотрудники вашей компании могли взаимодействовать с диалоговым интерфейсом. Amazon Q также подключается к вашему поставщику удостоверений, чтобы понять пользователя, его роль и к каким системам им разрешен доступ, чтобы пользователи могли задавать подробные, детализированные вопросы и получать индивидуальные результаты, включающие только ту информацию, которую им разрешено видеть. Amazon Q генерирует ответы и аналитическую информацию, которые точны и соответствуют материалам и знаниям, которые вы ему предоставляете. Вы можете ограничить деликатные темы, заблокировать ключевые слова или отфильтровать неуместные вопросы и ответы. Вот несколько примеров того, что вы можете сделать с новым помощником-экспертом вашего бизнеса:

- Получите четкие и сверхрелевантные ответы на основе данных и информации о вашем бизнесе: Сотрудники могут спрашивать Amazon Q обо всем, что им раньше приходилось искать в самых разных источниках. Спросите «Каковы последние рекомендации по использованию логотипа?» или «Как мне подать заявку на получение корпоративной кредитной карты?», и Amazon Q синтезирует весь найденный соответствующий контент и вернется с быстрыми ответами и ссылками на соответствующий контент. источники (например, порталы брендов и хранилища логотипов, политика компании в области T&E и приложения для карт).

- Оптимизация повседневного общения: Просто спросите, и Amazon Q сможет генерировать контент («Создайте публикацию в блоге и три заголовка в социальных сетях, анонсирующие продукт, описанный в этой документации»), создавать резюме («Напишите краткое изложение стенограммы нашей встречи с маркированным списком действий» ), предоставлять обновления по электронной почте («Составьте электронное письмо с описанием наших программ обучения для клиентов в Индии в третьем квартале») и помогайте структурировать встречи («Составьте повестку дня встреч, чтобы обсудить последний отчет об удовлетворенности клиентов»).

- Выполните задания: Amazon Q может помочь выполнить определенные задачи, сократив количество времени, которое сотрудники тратят на повторяющуюся работу, например на подачу заявок. Попросите Amazon Q «обобщить отзывы клиентов о новом ценовом предложении в Slack», а затем попросите Q взять эту информацию и открыть заявку в Jira, чтобы сообщить об этом маркетинговой команде. Вы можете попросить Q «Обобщить стенограмму разговора», а затем «Открыть новое обращение для клиента А в Salesforce». Amazon Q поддерживает другие популярные инструменты автоматизации работы, такие как Zendesk и Service Now.

Amazon Q находится в Amazon QuickSight: Доступно Amazon Q в QuickSight, службы бизнес-аналитики AWS, пользователи могут задавать на информационных панелях вопросы, например: «Почему количество заказов увеличилось в прошлом месяце?» и получите визуализации и объяснения факторов, повлиявших на увеличение. Кроме того, аналитики могут использовать Amazon Q, чтобы сократить время, необходимое им для создания информационных панелей, с дней до минут с помощью простой подсказки, например «Покажите мне продажи по регионам и месяцам в виде гистограммы с накоплением». Q сразу же возвращается с этой диаграммой, и вы можете легко добавить ее на панель мониторинга или продолжить общение с Q, чтобы уточнить визуализацию (например, «Изменить гистограмму на диаграмму Санки» или «Показать страны вместо регионов»). Amazon Q в QuickSight также упрощает использование существующих информационных панелей для информирования заинтересованных сторон, извлечения ключевой информации и упрощения принятия решений с использованием историй данных. Например, пользователи могут предложить Amazon Q «Составить историю о том, как бизнес изменился за последний месяц, для бизнес-обзора с высшим руководством», и за считанные секунды Amazon Q предоставит основанную на данных историю, визуально привлекательную и понятную. полностью настраиваемый. Этими историями можно безопасно делиться во всей организации, чтобы помочь скоординировать действия заинтересованных сторон и принимать более эффективные решения.

Amazon Q находится в Amazon Connect: В Amazon Connect, нашем сервисе контакт-центра, Amazon Q помогает вашим агентам по обслуживанию клиентов обеспечить лучшее обслуживание клиентов. Amazon Q использует репозитории знаний, которые ваши агенты обычно используют для получения информации для клиентов, после чего агенты могут общаться с Amazon Q непосредственно в Connect, чтобы получать ответы, которые помогут им быстрее реагировать на запросы клиентов без необходимости самостоятельно искать в документации. И хотя общаться в чате с Amazon Q для получения сверхбыстрых ответов — это здорово, в службе поддержки клиентов нет такого понятия, как «слишком быстро». Вот почему Amazon Q In Connect превращает живую беседу клиента с агентом в подсказку и автоматически предоставляет агенту возможные ответы, предлагаемые действия и ссылки на ресурсы. Например, Amazon Q может обнаружить, что клиент обращается в компанию по аренде автомобилей, чтобы изменить свое бронирование, сгенерировать ответ для агента, чтобы быстро сообщить, как применяются политики компании в отношении платы за изменение, и помочь агенту выполнить шаги, необходимые для обновления бронирования. бронирование.

Amazon Q входит в цепочку поставок AWS (скоро): В AWS Supply Chain, нашем сервисе анализа цепочки поставок, Amazon Q помогает планировщикам спроса и предложения, менеджерам по запасам и торговым партнерам оптимизировать свою цепочку поставок, обобщая и выделяя потенциальные риски дефицита или избытка запасов, а также визуализируя сценарии решения проблемы. Пользователи могут задавать Amazon Q вопросы «что», «почему» и «что, если» о данных своей цепочки поставок и обсуждать в чате сложные сценарии и компромиссы между различными решениями в цепочке поставок. Например, клиент может спросить: «Что вызывает задержку моих поставок и как я могу ускорить процесс?» на что Amazon Q может ответить: «90% ваших заказов находятся на восточном побережье, а сильный шторм на юго-востоке вызывает 24-часовую задержку. Если вы отправите товар в порт Нью-Йорка, а не в Майами, вы ускорите доставку и снизите затраты на 50 %».

Наши клиенты быстро внедряют генеративный ИИ: они обучают новаторские модели на AWS, разрабатывают приложения генеративного ИИ с рекордной скоростью с помощью Amazon Bedrock и развертывают в своих организациях революционные приложения, такие как Amazon Q. Благодаря нашим последним объявлениям AWS обеспечивает клиентам еще большую производительность, выбор и инновации на каждом уровне стека. Совокупное воздействие всех возможностей, которые мы предоставляем в re:Invent, знаменует собой важную веху на пути к достижению захватывающей и значимой цели: мы делаем генеративный ИИ доступным для клиентов любого размера и технических возможностей, чтобы они могли заново изобретать и трансформировать то, что возможно.

Полезные ресурсы

Об авторе

Свами Шивасубраманян является вице-президентом по данным и машинному обучению в AWS. В этой роли Свами курирует все службы базы данных AWS, аналитики, искусственного интеллекта и машинного обучения. Задача его команды — помочь организациям заставить свои данные работать с помощью комплексного решения для хранения, доступа, анализа, визуализации и прогнозирования.

Свами Шивасубраманян является вице-президентом по данным и машинному обучению в AWS. В этой роли Свами курирует все службы базы данных AWS, аналитики, искусственного интеллекта и машинного обучения. Задача его команды — помочь организациям заставить свои данные работать с помощью комплексного решения для хранения, доступа, анализа, визуализации и прогнозирования.

- SEO-контент и PR-распределение. Получите усиление сегодня.

- PlatoData.Network Вертикальный генеративный ИИ. Расширьте возможности себя. Доступ здесь.

- ПлатонАйСтрим. Интеллект Web3. Расширение знаний. Доступ здесь.

- ПлатонЭСГ. Углерод, чистые технологии, Энергия, Окружающая среда, Солнечная, Управление отходами. Доступ здесь.

- ПлатонЗдоровье. Биотехнологии и клинические исследования. Доступ здесь.

- Источник: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- :имеет

- :является

- :нет

- :куда

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 300

- 35%

- 40

- 50

- 500

- 65

- 8

- 9

- a

- способности

- способность

- в состоянии

- О нас

- выше

- ускорять

- ускоренный

- ускорители

- Accenture

- доступ

- доступность

- доступной

- Бухгалтерский учет

- точность

- точный

- приобретать

- через

- Действие

- действия

- активно

- на самом деле

- приспосабливать

- Добавить

- добавленный

- добавить

- дополнение

- дополнительный

- Дополнительно

- дополнениями

- Добавляет

- Adidas

- саман

- Принятие

- продвинутый

- опережения

- плюс

- Преимущества

- Реклама

- совет

- После

- против

- повестка дня

- Агент

- агенты

- совокупный

- тому назад

- AI

- ИИ и машинное обучение

- AI chatbot

- ай исследование

- Поддержка

- выравнивать

- Все

- позволять

- позволяет

- вдоль

- уже

- причислены

- всегда

- Amazon

- Amazon Code Whisperer

- Amazon EC2

- Amazon QuickSight

- Создатель мудреца Амазонки

- Amazon Web Services

- количество

- суммы

- an

- анализ

- аналитик

- Аналитики

- аналитика

- анализировать

- анализы

- и

- анонсировать

- Объявления

- объявляющий

- ответ

- ответы

- Антропный

- любой

- кто угодно

- все

- API

- API

- приложение

- появляется

- Применение

- Приложения

- Применить

- ценить

- подхода

- утвердить

- утвержденный

- Программы

- апрель

- МЫ

- ПЛОЩАДЬ

- области

- спорно

- около

- AS

- спросить

- Помощь

- помощник

- помощники

- связанный

- ассоциированных

- At

- Atlassian

- увеличивать

- дополненная

- увеличивает

- Aurora

- уполномоченный

- автоматизировать

- автоматы

- Автоматический

- автоматически

- автоматизация

- автомобильный

- свободных мест

- доступен

- в среднем

- избежать

- прочь

- AWS

- Вывод AWS

- AWS Lambda

- Консоль управления AWS

- назад

- Банковское дело

- бар

- барьеры

- Использование темпера с изогнутым основанием

- основанный

- основной

- BE

- , так как:

- становится

- было

- начал

- верить

- Преимущества

- ЛУЧШЕЕ

- лучшие практики

- Лучшая

- между

- большой

- миллиард

- миллиарды

- Заблокировать

- Блоки

- Блог

- Boeing

- болт

- бронирование

- Booking.com

- Книги

- изоферменты печени

- Дно

- Границы

- марка

- Ломать

- брейки

- приносить

- Приведение

- строить

- Строительство

- строит

- построенный

- встроенный

- бизнес

- бизнес-аналитика

- бизнес

- но

- кнопка

- by

- призывают

- колл-центр

- CAN

- Может получить

- возможности

- возможности

- способный

- Пропускная способность

- Захват

- автомобиль

- углерод

- выбросы углекислого газа

- карта

- осторожно

- случаев

- случаев

- категории

- Причинение

- Центр

- определенный

- конечно

- цепь

- вызов

- проблемы

- изменение

- менялась

- Переключатель

- изменения

- изменения

- характеристика

- График

- Графики

- чаты

- Chatbot

- chatbots

- в чате

- проверка

- чип

- чипсы

- выбор

- Выберите

- Выбирая

- выбранный

- требования

- классов

- Уборка

- Очистить

- нажмите на

- облако

- облачная инфраструктура

- Кластер

- кластеризации

- Побережье

- код

- кодовая база

- Обзор кода

- Кодирование

- сотрудничество

- сотрудничество

- COM

- сочетание

- объединять

- сочетании

- комбинаты

- как

- выходит

- приход

- Скоро

- общаться

- Связь

- Компании

- Компания

- Компании

- сравненный

- неотразимый

- полный

- полностью

- комплекс

- сложность

- комплексный

- Вычисление

- понятия

- Конфигурация

- настройка

- догадка

- Свяжитесь

- подключенный

- связи

- связь

- подключает

- последовательный

- Консоли

- ограничения

- Потребители

- потребление

- обращайтесь

- контакт-центр

- Контейнеры

- содержание

- контекст

- контекстной

- продолжать

- продолжающийся

- продолжается

- продолжающийся

- контроль

- контрольная

- Разговор

- диалоговый

- Беседы

- авторское право

- Копирайтинг

- Основные

- Цена

- рентабельным

- Расходы

- страны

- Рулевой

- Создайте

- создали

- креативность

- Создатели

- кредит

- кредитная карта

- Преступление

- CRISP

- CRM

- кросс-платформенной

- клиент

- опыт работы с клиентами

- Удовлетворенность клиентов

- Служба поддержки игроков

- Клиенты

- настраиваемый

- настройка

- настроить

- подгонянный

- Порез

- циклы

- ежедневно

- приборная панель

- щитки

- данным

- Подготовка данных

- конфиденциальность данных

- Конфиденциальность и безопасность данных

- наборы данных

- управляемых данными

- База данных

- базы данных

- Databricks

- день

- дня в день

- Дней

- Принятие решений

- решения

- глубоко

- глубокое обучение

- более глубокий

- Определения

- Степень

- задерживать

- доставить

- Поставки

- доставки

- обеспечивает

- Спрос

- Демократизация

- в зависимости

- развертывание

- развернуть

- развертывание

- развертывание

- глубина

- описывать

- описано

- описание

- предназначенный

- желанный

- подробный

- подробнее

- обнаруживать

- Определять

- ДОЙЧЕ ТЕЛЕКОМ

- Застройщик

- застройщиков

- развивающийся

- Развитие

- диагностика

- Диалог

- Диалог

- DID

- различный

- Вещание

- Интернет

- непосредственно

- распространять

- распределенный

- распределенное обучение

- распределительный

- do

- документ

- документации

- Документация

- приносит

- не

- дело

- сделанный

- Dont

- удвоившись

- вниз

- управлять

- два

- дубликаты

- продолжительность

- e

- электронная коммерция

- каждый

- Рано

- легче

- легко

- восток

- Восточное побережье

- легко

- Экономика

- edition

- фактически

- затрат

- эффективно

- усилие

- или

- еще

- Писем

- Выбросы

- сотрудников

- расширение прав и возможностей

- расширение прав и возможностей

- включить

- позволяет

- кодирование

- столкновение

- конец

- впритык

- энергетика

- Энергопотребление

- энергоэффективности

- инженер

- Проект и

- повышать

- улучшения

- обогащение

- Предприятие

- корпоративного класса

- предприятий

- Развлечения

- Весь

- конверт

- Эпоха

- ERP

- ошибка

- ошибки

- Эфир (ETH)

- оценки

- Даже

- События

- НИКОГДА

- Каждая

- все члены

- многое

- эволюция

- развивается

- пример

- Примеры

- возбужденный

- захватывающий

- выполнять

- исполнительный

- существующий

- экспансивный

- ожидать

- ускорять

- дорогим

- опыт

- опытные

- Впечатления

- эксперту

- опыта

- Объяснять

- Больше

- экспресс

- ткань

- Face

- факт

- факторы

- достаточно

- верный

- сокол

- Осень

- знакомый

- семей

- семья

- БЫСТРО

- быстрее

- неисправный

- Особенность

- Особенности

- Комисии

- Обратная связь

- несколько

- Подача

- фильтр

- в заключение

- финансовый

- Найдите

- обнаружение

- находит

- конец

- окончание

- Во-первых,

- фиксированный

- гибкого

- внимание

- следовать

- Что касается

- Для потребителей

- вперед

- найденный

- Год основания

- 4

- доля

- Рамки

- каркасы

- Бесплатно

- часто

- дружественный

- от

- Функции

- далее

- будущее

- игра

- игра-чейнджер

- игровой

- Общие

- в общем

- порождать

- генерирует

- порождающий

- поколение

- генеративный

- Генеративный ИИ

- генератор

- получить

- получающий

- Дайте

- Глобальный

- глобальный цифровой

- Gmail

- Go

- цель

- будет

- хорошо

- GPU / ГРАФИЧЕСКИЙ ПРОЦЕССОР

- Графические процессоры

- большой

- земля

- новаторским

- группы

- Рост

- взрослый

- руководство

- инструкция

- методические рекомендации

- было

- Руки

- Случай

- Жесткий

- Аппаратные средства

- вредный

- ненавидеть

- ненависти

- Есть

- имеющий

- Последние новости

- здравоохранение

- тяжелый

- тяжелая атлетика

- помощь

- помощь

- помогает

- здесь

- High

- высший

- наивысший

- выделив

- очень

- Наем

- его

- хостинг

- ЧАСЫ

- Как

- How To

- Однако

- HTTPS

- Сотни

- i

- ID

- тождества

- Личность

- идентификаторы

- if

- изображение

- генерация изображения

- изображений

- немедленная

- Влияние

- осуществлять

- реализации

- в XNUMX году

- Импортировать

- важную

- впечатляющий

- улучшать

- улучшенный

- улучшение

- in

- включают

- включает в себя

- В том числе

- Увеличение

- расширились

- повышение

- индикаторы

- лиц

- промышленности

- промышленность

- отрасли

- влияние

- info

- наделяют информацией

- информация

- Инфраструктура

- обновлять

- инновации

- Инновации

- инновации

- инновационный

- вход

- затраты

- понимание

- размышления

- пример

- случаев

- вместо

- Институт

- инструкции

- страхование

- интеграции.

- интеллектуальный

- интеллектуальная собственность

- Интеллекта

- намерен

- взаимодействовать

- взаимодействие

- взаимодействует

- взаимосвязано

- Интерфейс

- в нашей внутренней среде,

- вмешиваться

- в

- вводить

- выпустили

- введение

- Изобретенный

- инвентаризация

- Грин- карта инвестору

- следственный

- инвестирование

- инвестиций

- Вложения

- вовлеченный

- включает в себя

- вопросы

- IT

- ИТ-специалисты

- ЕГО

- Японский

- жаргон

- Java

- JPG

- всего

- только один

- Сохранить

- хранение

- Основные

- Ключевые области

- ключевые слова

- комплект

- Комплект (SDK)

- Знать

- знания

- знает

- Labs

- Отсутствие

- язык

- большой

- крупномасштабный

- крупнейших

- Фамилия

- В прошлом году

- Поздно

- Задержка

- последний

- запустили

- запуск

- Адвокаты

- слой

- слоев

- Наша команда

- ведущий

- УЧИТЬСЯ

- узнали

- изучение

- Юр. Информация

- Меньше

- Lets

- уровень

- Кредитное плечо

- рычаги

- LexisNexis

- LG

- библиотеки

- Жизненный цикл

- Подтяжка лица

- такое как

- Вероятно

- недостатки

- Ограниченный

- рамки

- линий

- LINK

- связи

- Список

- жить

- Живет

- Лама

- расположенный

- места

- логический

- логотип

- Длинное

- давнишний

- серия

- любят

- Низкий

- ниже

- низший

- машина

- обучение с помощью машины

- сделанный

- поддерживать

- сохранение

- техническое обслуживание

- основной

- сделать

- ДЕЛАЕТ

- Создание

- управляемого

- управление

- Менеджеры

- руководство

- ручная работа

- вручную

- многих

- Маркетинг

- материала

- материалы

- максимальный

- Май..

- me

- значимым

- означает

- Медиа

- Встречайте

- заседания

- заседаниях

- Соответствует

- Участники

- меров

- Мета

- метод

- Miami

- Microsoft

- Microsoft 365

- средняя

- может быть

- веха

- минут

- скучать

- Наша миссия

- ML

- модель

- моделирование

- Модели

- модернизация

- Импульс

- MongoDB

- Мониторы

- Месяц

- месяцев

- БОЛЕЕ

- самых

- Самые популярные

- перемещение

- МРТ

- много

- с разными

- Музыка

- должен

- my

- имя

- Nasdaq

- натуральный

- Естественный язык

- Возле

- необходимо

- Необходимость

- необходимый

- нуждающихся

- сеть

- сеть

- сетей

- Новые

- New York

- вновь

- следующий

- Нитро

- нет

- ноутбуки

- сейчас

- номер

- Nvidia

- of

- от

- наступление

- предлагают

- предлагающий

- Предложения

- .

- старший

- on

- консолидировать

- ONE

- те,

- онлайн

- онлайн-банкинг

- только

- открытый

- работать

- Операционный отдел

- Оптимизировать

- оптимизированный

- оптимизирующий

- Опции

- or

- заказы

- организация

- организации

- оригинал

- Другое

- Другое

- наши

- внешний

- контур

- выходной

- выходы

- за

- Затоваривание

- в подавляющем большинстве случаев

- собственный

- Темп

- пакеты

- болезненный

- пар

- параметр

- параметры

- часть

- партнеры

- части

- мимо

- паттеранами

- Пауза

- Люди

- для

- выполнять

- производительность

- выполнены

- выполняет

- разрешение

- Разрешения

- человек

- воплощение

- Олицетворять

- Лично

- PGA Тур

- фразы

- PII

- Часть

- план

- Платон

- Платон Интеллектуальные данные

- ПлатонДанные

- плюс

- Точка

- сборах

- Популярное

- положительный

- возможное

- После

- потенциал

- мощностью

- Питание

- мощный

- практическое

- практически

- практиками

- необходимость

- предсказывать

- Predictions

- предпочтения

- подготовка

- Подготовить

- представить

- президент

- нажмите

- прессование

- предварительный просмотр

- предварительно

- цена

- цены

- первичный

- политикой конфиденциальности.

- Конфиденциальность и безопасность

- частная

- личная информация

- Проблема

- проблемам

- процесс

- Процессы

- обработка

- производит

- Продукт

- Производство

- производительный

- производительность

- профессиональный

- профессионалы

- Программы

- Проект

- наводящие

- собственность

- ( изучите наши патенты),

- защищающий

- защиту

- обеспечивать

- Недвижимости

- поставщики

- приводит

- обеспечение

- что такое варган?

- публично

- целей

- Push

- Нажимать

- положил

- Полагая

- Питон

- pytorch

- Q3

- количественный

- вопрос

- Вопросы

- САЙТ

- быстро

- вполне

- R & D

- ассортимент

- быстро

- быстро

- Стоимость

- RE

- Reading

- реальные

- реального времени

- реалистичный

- реализовать

- реализованный

- на самом деле

- жатва

- причины

- недавно

- Рекомендация

- рекомендаций

- запись

- уменьшить

- Цена снижена

- снижение

- совершенствовать

- область

- выпустил

- соответствующие

- надежность

- остатки

- удаление

- удаление

- ремонт

- повторяющийся

- замена

- Ответить

- отчету

- хранилище

- запросить

- Запросы

- обязательный

- Требования

- исследованиям

- бронирование

- Резерв

- Постановления

- резонирует

- Полезные ресурсы

- уважение

- Реагируйте

- ответ

- ответ

- ответы

- ответственный

- ограничивать

- ограниченный

- результат

- Итоги

- возвращение

- обзоре

- обзор

- правую

- рисках,

- Роли

- роли

- Комнаты

- маршруты

- Правило

- Run

- Бег

- взлетно-посадочная полоса

- пожертвовав

- безопасный

- защитные меры

- безопасно

- sagemaker

- главная

- Salesforce

- то же

- удовлетворение

- Сохранить

- поговорка

- Шкала

- масштабирование

- Сценарии

- сфера

- множество

- поцарапать

- SDK

- бесшовные

- Поиск

- Во-вторых

- Второе поколение

- секунды

- безопасный

- безопасно

- безопасность

- посмотреть

- видя

- видел

- выберите

- выбранный

- выбор

- отправка

- старший

- высшее руководство

- чувствительный

- сентябрь

- Последовательность

- Серии

- серверы

- обслуживание

- ServiceNow

- Услуги

- набор

- Наборы

- несколько

- Поделиться

- общие

- судно

- Короткое

- должен

- сторона

- значительный

- кремний

- Аналогичным образом

- просто

- упростить

- просто

- с

- ШЕСТЬ

- Размеры

- слабина

- небольшой

- So

- Соцсети

- социальные сети

- Software

- Разработчики программного обеспечения

- разработка программного обеспечения

- комплект для разработки программного обеспечения

- Решение

- Решения

- РЕШАТЬ

- некоторые

- Кто-то

- удалось

- Скоро

- сложный

- Источник

- исходный код

- Источники

- юго-восток

- Space

- Искриться

- конкретно

- речь

- скорость

- тратить

- Стабильность

- стабильный

- стек

- сложены

- заинтересованных сторон

- и политические лидеры

- Начало

- Стартапы

- современное состояние

- оставаться

- Шаг

- Шаги

- По-прежнему

- диск

- магазин

- магазины

- Истории

- буря

- История

- упорядочить

- УКРЕПЛЯТЬ

- строгий

- Структура

- Кабинет

- подсети

- существенный

- такие

- подходящее

- suite

- суммировать

- РЕЗЮМЕ

- супер

- дополнять

- поставщики

- поставка

- Спрос и предложение

- цепочками поставок

- поддержка

- Поддержка

- Убедитесь

- удивительный

- наблюдение

- подозрительный

- Стабильность

- Коммутатор

- синтезировать

- система

- системы

- ТАБЛИЦЫ

- с учетом

- взять

- принимает

- с

- Говорить

- цель

- Сложность задачи

- задачи

- команда

- Члены команды

- команды

- Технический

- техника

- снижения вреда

- технологии

- Технологии

- технологические инновации

- сказать

- говорят

- 10

- десятки

- tensorflow

- терминология

- тестXNUMX

- Тестирование

- тестов

- текст

- генерация текста

- чем

- который

- Ассоциация

- Будущее

- мир

- их

- Их

- сами

- тогда

- Там.

- Эти

- они

- задача

- вещи

- think

- В третьих

- этой

- В этом году

- те

- тысячи

- три

- Через

- по всему

- пропускная способность

- билет

- билеты

- время

- раз

- исполин

- в

- сегодня

- Сегодняшних

- вместе

- знак

- слишком

- приняли

- инструментом

- инструменты

- топ

- Темы

- Тур

- к

- к

- трек

- Торговля

- Train

- специалистов

- Обучение

- Сделки

- Запись

- Transform

- трансформация

- преобразований

- превращение

- путешествовать

- триллионы

- путешествие

- по-настоящему

- Доверие

- стараться

- пытается

- Получается

- два

- напишите

- типично

- лежащий в основе

- понимать

- понятный

- понимание

- понимает

- незнакомый

- унифицированный

- созданного

- Уникальные особенности

- Ед. изм

- В отличие от

- до

- Обновление ПО

- Updates

- модернизация

- обновления

- us

- Применение

- использование

- прецедент

- используемый

- Информация о пользователе

- пользователей

- использования

- через

- ценный

- разнообразие

- различный

- версия

- Против

- очень

- с помощью

- вице

- вице-президент

- Видео

- фактически

- визуализация

- визуализации

- визуально

- тома

- Уязвимый

- хотеть

- Сигнализатор

- музыкальная группа Warner

- законопроект

- Wave

- Путь..

- способы

- we

- Web

- веб приложение

- веб-сервисы

- веб-сайты

- неделя

- Недели

- добро пожаловать

- ЧТО Ж

- известный

- были

- Что

- Что такое

- когда

- будь то

- который

- в то время как

- КТО

- зачем

- широкий

- Широкий диапазон

- Шире

- будете

- окно

- в

- без

- Работа

- работавший

- Рабочие процессы

- работает

- работает

- Мир

- мировой класс

- беспокоиться

- стоимость

- бы

- записывать

- написать код

- письмо

- год

- лет

- йорк

- являетесь

- ВАШЕ

- Zendesk

- зефирнет