Credem că inteligența artificială generativă are potențialul de a transforma în timp aproape fiecare experiență client pe care o cunoaștem. Numărul de companii care lansează aplicații AI generative pe AWS este substanțial și se dezvoltă rapid, inclusiv adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy și LexisNexis Legal & Professional, pentru a numi doar câteva. Startup-urile inovatoare, cum ar fi Perplexity AI, fac all-in pe AWS pentru AI generativă. Companii de IA de top, cum ar fi Anthropic, au ales AWS ca furnizor principal de cloud pentru sarcinile de lucru critice și locul în care să-și antreneze viitoarele modele. Iar furnizorii globali de servicii și soluții, cum ar fi Accenture, beneficiază de beneficiile aplicațiilor personalizate AI generative, pe măsură ce își împuternicesc dezvoltatorii interni cu Amazon Code Whisperer.

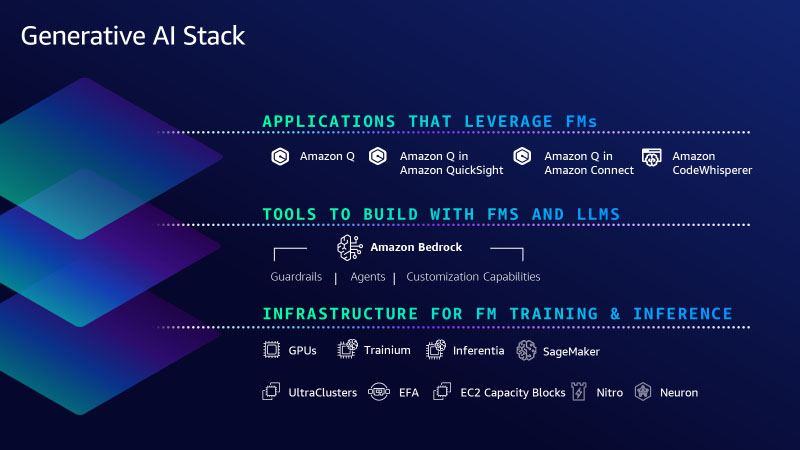

Acești clienți aleg AWS pentru că suntem concentrați să facem ceea ce am făcut întotdeauna - luând tehnologie complexă și costisitoare care poate transforma experiențele clienților și afacerile și democratizarea acesteia pentru clienții de toate dimensiunile și abilitățile tehnice. Pentru a face acest lucru, investim și inovăm rapid pentru a oferi cel mai cuprinzător set de capabilități pe cele trei straturi ale stivei AI generative. Stratul inferior este infrastructura pentru a antrena modele de limbaj mari (LLM) și alte modele de bază (FM) și pentru a produce inferențe sau predicții. Stratul de mijloc oferă acces ușor la toate modelele și instrumentele de care clienții au nevoie pentru a construi și scala aplicații AI generative cu aceeași securitate, control al accesului și alte caracteristici pe care clienții le așteaptă de la un serviciu AWS. Și la nivelul superior, am investit în aplicații care schimbă jocul în domenii cheie, cum ar fi codificarea generativă bazată pe inteligență artificială. Pe lângă faptul că le oferă posibilitatea de a alege și, așa cum se așteaptă ei de la noi, lărgimea și profunzimea capabilităților pe toate straturile, clienții ne spun, de asemenea, că apreciază abordarea noastră bazată pe date și au încredere că am construit totul de la zero cu ajutorul întreprinderii. gradul de securitate și confidențialitate.

Săptămâna aceasta am făcut un mare pas înainte, anunțând multe capacități noi semnificative în toate cele trei straturi ale stivei, pentru a le face clienților noștri ușor și practic să utilizeze AI generativ în mod generalizat în afacerile lor.

Stratul inferior al stivei: AWS Trainium2 este cea mai recentă adăugare care oferă cea mai avansată infrastructură cloud pentru AI generativă

Stratul de jos al stivei este infrastructura - calcul, rețea, cadre, servicii - necesare pentru instruirea și rularea LLM-urilor și a altor FM. AWS inovează pentru a oferi cea mai avansată infrastructură pentru ML. Prin colaborarea noastră de lungă durată cu NVIDIA, AWS a fost primul care a adus GPU-uri în cloud în urmă cu mai bine de 12 ani și, cel mai recent, am fost primul furnizor important de cloud care a făcut GPU-urile NVIDIA H100 disponibile cu instanțele noastre P5. Continuăm să investim în inovații unice care fac din AWS cel mai bun cloud pentru rularea GPU-urilor, inclusiv beneficiile preț-performanță ale celui mai avansat sistem de virtualizare (AWS Nitro), rețele puternice la scară petabiți cu Elastic Fabric Adapter (EFA) și hiper- clustering la scară cu Amazon EC2 UltraClusters (mii de instanțe accelerate amplasate într-o zonă de disponibilitate și interconectate într-o rețea fără blocare care poate oferi până la 3,200 Gbps pentru instruire ML la scară masivă). De asemenea, facem mai ușor pentru orice client să acceseze o capacitate de calcul GPU foarte căutată pentru IA generativă cu Amazon EC2 Capacity Blocks pentru ML - primul și singurul model de consum din industrie care le permite clienților să rezerve GPU-uri pentru utilizare viitoare (până la 500 de implementat în EC2 UltraClusters) pentru sarcini de lucru ML de scurtă durată.

Cu câțiva ani în urmă, ne-am dat seama că, pentru a continua să împingem limitele în ceea ce privește performanța prețului, ar trebui să inovăm până la siliciu și am început să investim în propriile noastre cipuri. În special pentru ML, am început cu AWS Inferentia, cipul nostru de inferență creat special. Astăzi, ne aflăm la a doua generație de AWS Inferentia cu instanțe Amazon EC2 Inf2 care sunt optimizate special pentru aplicații AI generative la scară largă, cu modele care conțin sute de miliarde de parametri. Instanțele Inf2 oferă cel mai mic cost pentru inferență în cloud, oferind, de asemenea, un randament de până la patru ori mai mare și o latență de până la zece ori mai mică, comparativ cu instanțele Inf1. Alimentat cu până la 12 cipuri Inferentia2, Inf2 sunt singurele instanțe EC2 optimizate pentru inferență care au conectivitate de mare viteză între acceleratoare, astfel încât clienții să poată rula inferența mai rapid și mai eficient (la costuri mai mici) fără a sacrifica performanța sau latența prin distribuirea modelelor ultra-mari. pe mai multe acceleratoare. Clienți precum Adobe, Deutsche Telekom și Leonardo.ai au văzut rezultate excelente și sunt încântați să își implementeze modelele la scară pe Inf2.

În ceea ce privește instruirea, instanțele Trn1 — alimentate de cipul de antrenament ML creat special de AWS, AWS Trainium — sunt optimizate pentru a distribui instruirea pe mai multe servere conectate la rețeaua EFA. Clienți precum Ricoh au pregătit un LLM japonez cu miliarde de parametri în doar zile. Databricks obține o performanță preț-performanță cu până la 40% mai bună cu instanțe bazate pe Trainium pentru a antrena modele de deep learning la scară largă. Dar, cu modele noi și mai capabile care apar practic în fiecare săptămână, continuăm să depășim limitele în ceea ce privește performanța și scara și suntem încântați să anunțăm AWS Trainium2, conceput pentru a oferi performanțe și mai bune la prețuri pentru modelele de antrenament cu sute de miliarde până la trilioane de parametri. Trainium2 ar trebui să ofere performanțe de antrenament de până la patru ori mai rapide decât Trainium de prima generație, iar atunci când este utilizat în EC2 UltraClusters ar trebui să ofere până la 65 de exaflopi de calcul agregat. Aceasta înseamnă că clienții vor putea antrena un LLM cu parametri de 300 de miliarde în săptămâni față de luni. Performanța, scara și eficiența energetică a Trainium2 sunt câteva dintre motivele pentru care Anthropic a ales să-și antreneze modelele pe AWS și va folosi Trainium2 pentru viitoarele sale modele. Și colaborăm cu Anthropic pentru inovarea continuă atât cu Trainium, cât și cu Inferentia. Ne așteptăm ca primele noastre instanțe Trainium2 să fie disponibile clienților în 2024.

De asemenea, ne-am dublat lanțul de instrumente software pentru siliciul nostru ML, în special în dezvoltarea AWS Neuron, kitul de dezvoltare software (SDK) care ajută clienții să obțină performanța maximă de la Trainium și Inferentia. De la introducerea Neuron în 2019, am făcut investiții substanțiale în tehnologii de compilare și cadru, iar astăzi Neuron acceptă multe dintre cele mai populare modele disponibile public, inclusiv Llama 2 de la Meta, MPT de la Databricks și Stable Diffusion de la Stability AI, precum și 93 dintre primele 100 de modele din popularul depozit de modele Hugging Face. Neuron se conectează la cadre populare ML precum PyTorch și TensorFlow, iar suportul pentru JAX va veni la începutul anului viitor. Clienții ne spun că Neuron le-a făcut ușor să-și schimbe conductele existente de antrenament și inferență a modelului la Trainium și Inferentia cu doar câteva linii de cod.

Nimeni altcineva nu oferă aceeași combinație de alegere a celor mai bune cipuri ML, rețele super-rapide, virtualizare și clustere la scară ridicată. Și, așadar, nu este surprinzător faptul că unele dintre cele mai cunoscute startup-uri de IA generativă precum AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway și Stability AI rulează pe AWS. Dar, aveți încă nevoie de instrumentele potrivite pentru a utiliza eficient acest calcul pentru a construi, antrena și rula LLM-uri și alte FM în mod eficient și rentabil. Și pentru multe dintre aceste startup-uri, Amazon SageMaker este raspunsul. Fie că se construiește și se antrenează un model nou, proprietar de la zero, fie că se începe cu unul dintre numeroasele modele populare disponibile public, instruirea este o întreprindere complexă și costisitoare. De asemenea, nu este ușor să rulezi aceste modele în mod rentabil. Clienții trebuie să achiziționeze cantități mari de date și să le pregătească. Acest lucru implică de obicei o mulțime de date de curățare manuală, eliminarea duplicatelor, îmbogățirea și transformarea acestora. Apoi trebuie să creeze și să mențină grupuri mari de GPU/acceleratoare, să scrie cod pentru a distribui eficient antrenamentul modelului între clustere, să pună frecvent în control, să întrerupă, să inspecteze și să optimizeze modelul și să intervină manual și să remedieze problemele hardware din cluster. Multe dintre aceste provocări nu sunt noi, ele sunt câteva dintre motivele pentru care am lansat SageMaker acum șase ani — pentru a înlătura numeroasele bariere implicate în instruirea și implementarea modelelor și pentru a oferi dezvoltatorilor o modalitate mult mai ușoară. Zeci de mii de clienți folosesc Amazon SageMaker, iar un număr tot mai mare dintre ei, cum ar fi LG AI Research, Perplexity AI, AI21, Hugging Face și Stability AI, formează LLM și alți FM pe SageMaker. Recent, Technology Innovation Institute (creatorii popularului Falcon LLM) a antrenat cel mai mare model disponibil public – Falcon 180B – pe SageMaker. Pe măsură ce dimensiunile și complexitatea modelului au crescut, la fel și domeniul de aplicare al SageMaker.

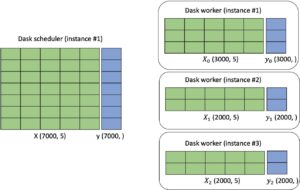

De-a lungul anilor, am adăugat la Amazon SageMaker peste 380 de caracteristici și capabilități care schimbă jocul, cum ar fi reglarea automată a modelelor, instruirea distribuită, opțiunile flexibile de implementare a modelului, instrumente pentru operațiuni ML, instrumente pentru pregătirea datelor, magazine de caracteristici, notebook-uri, integrare perfectă. cu evaluări umane în buclă de-a lungul ciclului de viață ML și funcții încorporate pentru IA responsabilă. Continuăm să inovăm rapid pentru a ne asigura că clienții SageMaker sunt capabili să continue să construiască, să antreneze și să ruleze inferențe pentru toate modelele, inclusiv LLM și alte FM. Și facem și mai ușor și mai rentabil pentru clienți să antreneze și să implementeze modele mari cu două capacități noi. În primul rând, pentru a simplifica antrenamentul suntem introducerea Amazon SageMaker HyperPod care automatizează mai multe procese necesare pentru instruirea distribuită la scară mare cu toleranță la erori (de exemplu, configurarea bibliotecilor de instruire distribuite, scalarea sarcinilor de lucru de antrenament pe mii de acceleratoare, detectarea și repararea instanțelor defecte), accelerarea antrenamentului cu până la 40%. Drept urmare, clienți precum Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid și alții folosesc SageMaker HyperPod pentru a construi, antrena sau evolua modele. Al doilea, introducem noi capabilități pentru a face inferența mai rentabilă, reducând în același timp latența. SageMaker îi ajută acum pe clienți să implementeze mai multe modele în aceeași instanță, astfel încât să poată partaja resursele de calcul, reducând costurile de inferență cu 50% (în medie). De asemenea, SageMaker monitorizează în mod activ instanțele care procesează cereri de inferență și direcționează în mod inteligent cererile în funcție de instanțele disponibile, obținând o latență de inferență cu 20% mai mică (în medie). Conjecture, Salesforce și Slack folosesc deja SageMaker pentru modele de găzduire datorită acestor optimizări de inferență.

Stratul mijlociu al stivei: Amazon Bedrock adaugă noi modele și un val de noi capabilități facilitează construirea și scalarea în siguranță a aplicațiilor AI generative pentru clienți.

În timp ce un număr de clienți își vor construi propriile LLM-uri și alte FM-uri sau vor dezvolta orice număr de opțiuni disponibile public, mulți nu vor dori să-și petreacă resursele și timpul pentru a face acest lucru. Pentru ei, stratul mijlociu al stivei oferă aceste modele ca serviciu. Soluția noastră aici, Amazon Bedrock, le permite clienților să aleagă dintre modelele de vârf din industrie de la Anthropic, Stability AI, Meta, Cohere, AI21 și Amazon, să le personalizeze cu propriile date și să folosească aceleași elemente de securitate, controale de acces și caracteristici cu care sunt obișnuiți. în AWS — totul printr-un serviciu gestionat. Am făcut Amazon Bedrock disponibil în general la sfârșitul lunii septembrie, iar răspunsul clienților a fost copleșitor de pozitiv. Clienții din întreaga lume și din aproape fiecare industrie sunt încântați să folosească Amazon Bedrock. adidas le permite dezvoltatorilor să obțină răspunsuri rapide la orice, de la informații despre „începerea” până la întrebări tehnice mai profunde. Booking.com intenționează să folosească inteligența artificială generativă pentru a redacta recomandări de călătorie personalizate pentru fiecare client. Bridgewater Associates dezvoltă un asistent de analist de investiții bazat pe LLM pentru a ajuta la generarea de diagrame, calcularea indicatorilor financiari și rezumarea rezultatelor. Carrier pune la dispoziția clienților analize energetice și informații mai precise, astfel încât aceștia să reducă consumul de energie și să reducă emisiile de carbon. Clariant le oferă membrilor echipei sale un chatbot intern generativ AI pentru a accelera procesele de cercetare și dezvoltare, pentru a sprijini echipele de vânzări cu pregătirea întâlnirilor și pentru a automatiza e-mailurile clienților. GoDaddy îi ajută pe clienți să-și configureze cu ușurință afacerile online, folosind AI generativă pentru a-și construi site-urile web, a găsi furnizori, a intra în legătură cu clienții și multe altele. Lexis Nexis Legal & Professional transformă activitatea juridică pentru avocați și crește productivitatea acestora cu capabilitățile de căutare conversațională, rezumare și redactare și analiză a documentelor Lexis+ AI. Nasdaq ajută la automatizarea fluxurilor de investigații privind tranzacțiile suspecte și la consolidarea capacităților lor de supraveghere și criminalitate anti-financiară. Toate acestea – și multe altele – diverse aplicații AI generative rulează pe AWS.

Suntem încântați de impulsul pentru Amazon Bedrock, dar este încă devreme. Ceea ce am văzut în timp ce am lucrat cu clienții este că toată lumea se mișcă rapid, dar evoluția AI generativă continuă într-un ritm rapid, cu noi opțiuni și inovații care au loc practic zilnic. Clienții descoperă că există modele diferite care funcționează mai bine pentru diferite cazuri de utilizare sau pe diferite seturi de date. Unele modele sunt grozave pentru rezumat, altele sunt grozave pentru raționament și integrare, iar altele au un suport lingvistic cu adevărat minunat. Și apoi există generarea de imagini, cazurile de utilizare a căutării și multe altele - toate provin atât de la modele proprietare, cât și de la modele care sunt disponibile public pentru oricine. Și în vremuri în care există atât de multe lucruri de necunoscut, capacitatea de adaptare este, fără îndoială, cel mai valoros instrument dintre toate. Nu va exista un model care să le conducă pe toate. Și cu siguranță nu doar o companie de tehnologie care oferă modelele pe care le folosește toată lumea. Clienții trebuie să încerce diferite modele. Trebuie să poată comuta între ele sau să le combine în cadrul aceluiași caz de utilizare. Aceasta înseamnă că au nevoie de o alegere reală a furnizorilor de modele (pe care evenimentele din ultimele 10 zile le-au făcut și mai clare). Acesta este motivul pentru care am inventat Amazon Bedrock, de ce rezonează atât de profund în rândul clienților și de ce continuăm să inovăm și să repetăm rapid pentru a face construirea cu (și mutarea între) o gamă de modele la fel de ușoară ca un apel API, punem cele mai recente tehnici. pentru personalizarea modelului în mâinile tuturor dezvoltatorilor și păstrați clienții în siguranță și datele lor private. Suntem încântați să introducem câteva capacități noi care vor face și mai ușor pentru clienți să construiască și să scaleze aplicații AI generative:

- Extinderea opțiunii de model cu Anthropic Claude 2.1, Meta Llama 2 70B și completări la familia Amazon Titan. În aceste zile de început, clienții încă învață și experimentează diferite modele pentru a determina pe care doresc să le folosească în diverse scopuri. Ei doresc să poată încerca cu ușurință cele mai recente modele și, de asemenea, să testeze pentru a vedea care capabilități și caracteristici le vor oferi cele mai bune rezultate și caracteristici de cost pentru cazurile lor de utilizare. Cu Amazon Bedrock, clienții se află la doar un apel API de un nou model. Unele dintre cele mai impresionante rezultate pe care clienții le-au experimentat în ultimele luni sunt de la LLM-uri precum Modelul lui Anthropic Claude, care excelează într-o gamă largă de sarcini, de la dialog sofisticat și generare de conținut până la raționament complex, menținând în același timp un grad ridicat de fiabilitate și predictibilitate. Clienții raportează că Claude este mult mai puțin probabil să producă rezultate dăunătoare, mai ușor de conversat și mai ușor de direcționat în comparație cu alte FM, astfel încât dezvoltatorii pot obține rezultatul dorit cu mai puțin efort. Modelul de ultimă generație al lui Anthropic, Claude 2, obține scoruri peste percentila 90 la examenele GRE de citire și scriere și, în mod similar, la raționamentul cantitativ. Și acum, modelul Claude 2.1 recent lansat este disponibil pe Amazon Bedrock. Claude 2.1 oferă capabilități cheie pentru întreprinderi, cum ar fi o fereastră de context de 200 token lider în industrie (de două ori contextul lui Claude 2), rate reduse de halucinații și îmbunătățiri semnificative ale preciziei, chiar și la lungimi de context foarte mari. Claude 2.0 include, de asemenea, solicitări de sistem îmbunătățite – care sunt instrucțiuni model care oferă o experiență mai bună pentru utilizatorii finali – reducând în același timp costul solicitărilor și completărilor cu 2.1%.

Pentru un număr tot mai mare de clienți care doresc să utilizeze o versiune gestionată a modelului Llama 2 de la Meta, disponibil public, Amazon Bedrock oferă Llama 2 13B și adăugăm Llama 2 70B. Llama 2 70B este potrivit pentru sarcini la scară largă, cum ar fi modelarea limbii, generarea de text și sistemele de dialog. Modelele Llama disponibile public au fost descărcate de peste 30 de milioane de ori, iar clienților le place că Amazon Bedrock le oferă ca parte a unui serviciu gestionat în care nu trebuie să-și facă griji cu privire la infrastructură sau să aibă o experiență profundă ML în echipele lor. În plus, pentru generarea de imagini, Stability AI oferă o suită de modele populare text-to-image. Stable Diffusion XL 1.0 (SDXL 1.0) este cel mai avansat dintre acestea și este acum disponibil în general în Amazon Bedrock. Cea mai recentă ediție a acestui model de imagine popular are o acuratețe sporită, un fotorealism mai bun și o rezoluție mai mare.

Clienții folosesc și ei Amazon Titan modele, care sunt create și pregătite în prealabil de AWS pentru a oferi capabilități puternice cu o economie excelentă pentru o varietate de cazuri de utilizare. Amazon are o experiență de 25 de ani în ML și AI — tehnologia pe care o folosim în afacerile noastre — și am învățat multe despre construirea și implementarea modelelor. Am ales cu atenție modul în care ne antrenăm modelele și datele pe care le folosim pentru a face acest lucru. Despăgubim clienții împotriva pretențiilor conform cărora modelele noastre sau rezultatele acestora încalcă drepturile de autor ale oricui. Am prezentat primele noastre modele Titan în aprilie a acestui an. Titan Text Lite- acum disponibil în general— este un model succint, eficient din punct de vedere al costurilor pentru cazuri de utilizare, cum ar fi chatbot, rezumatul textului sau scrierea de text, și este, de asemenea, convingător de ajustat. Titan Text Express — de asemenea, acum disponibil în general— este mai extins și poate fi folosit pentru o gamă mai largă de sarcini bazate pe text, cum ar fi generarea de text deschisă și chatul conversațional. Oferim aceste opțiuni de model text pentru a oferi clienților posibilitatea de a optimiza acuratețea, performanța și costul, în funcție de cazul lor de utilizare și de cerințele de afaceri. Clienți precum Nexxiot, PGA Tour și Ryanair folosesc cele două modele Titan Text. Avem, de asemenea, un model de încorporare, Titan Text Embeddings, pentru cazuri de utilizare a căutării și personalizare. Clienți precum Nasdaq văd rezultate excelente folosind Titan Text Embeddings pentru a îmbunătăți capacitățile Nasdaq IR Insight de a genera informații din peste 9,000 de documente ale companiilor globale pentru echipele de durabilitate, juridice și contabile. Și vom continua să adăugăm mai multe modele familiei Titan de-a lungul timpului. Introducem un nou model de încorporare, Titan Multimodal Embeddings, pentru a alimenta experiențe de căutare și recomandare multimodală pentru utilizatori care folosesc imagini și text (sau o combinație a ambelor) ca intrări. Si noi suntem introducerea unui nou model text-to-image, Amazon Titan Image Generator. Cu Titan Image Generator, clienții din industrii precum publicitatea, comerțul electronic și mass-media și divertismentul pot utiliza o intrare de text pentru a genera imagini realiste, de calitate studio, în volume mari și la costuri reduse. Suntem încântați de modul în care clienții răspund la modelele Titan și vă puteți aștepta că vom continua să inovăm aici.

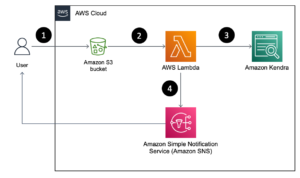

- Noi capabilități pentru a vă personaliza în siguranță aplicația generativă AI cu datele dvs. proprietare: Una dintre cele mai importante capabilități ale Amazon Bedrock este cât de ușor este să personalizați un model. Acest lucru devine cu adevărat interesant pentru clienți, deoarece este locul în care AI generativă se întâlnește cu diferențiatorul lor principal - datele lor. Cu toate acestea, este foarte important ca datele lor să rămână în siguranță, să aibă control asupra lor pe parcurs și ca îmbunătățirile modelului să fie private pentru ei. Există câteva moduri prin care puteți face acest lucru, iar Amazon Bedrock oferă cea mai largă selecție de opțiuni de personalizare pentru mai multe modele). Prima este reglarea fină. Reglarea fină a unui model în Amazon Bedrock este ușoară. Pur și simplu selectați modelul și Amazon Bedrock face o copie a acestuia. Apoi indicați câteva exemple etichetate (de exemplu, o serie de perechi întrebări-răspuns bune) pe care le stocați în Amazon Simple Storage Service (Amazon S3) și Amazon Bedrock „antrenează progresiv” (mărește modelul copiat cu noile informații) pe aceste exemple, iar rezultatul este un model privat, mai precis, ajustat, care oferă răspunsuri mai relevante și personalizate. Suntem încântați să anunțăm că reglarea fină este disponibilă în general pentru Cohere Command, Meta Llama 2, Amazon Titan Text (Lite și Express), Amazon Titan Multimodal Embeddings și în previzualizare pentru Amazon Titan Image Generator. Și, prin colaborarea noastră cu Anthropic, vom oferi în curând clienților AWS acces timpuriu la caracteristici unice pentru personalizarea modelului și reglarea fină a modelului său de ultimă generație Claude.

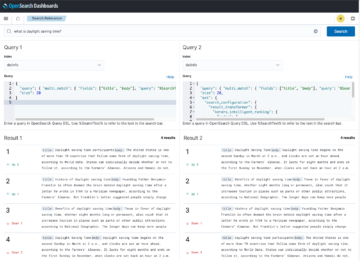

O a doua tehnică de personalizare a LLM-urilor și a altor FM-uri pentru afacerea dvs. este generarea augmentată de recuperare (RAG), care vă permite să personalizați răspunsurile unui model prin creșterea solicitărilor cu date din mai multe surse, inclusiv depozite de documente, baze de date și API-uri. În septembrie, am introdus o capacitate RAG, Knowledge Bases pentru Amazon Bedrock, care conectează în siguranță modelele la sursele dvs. de date proprietare pentru a completa solicitările dvs. cu mai multe informații, astfel încât aplicațiile dvs. să ofere răspunsuri mai relevante, contextuale și mai precise. Baze de cunoștințe este acum disponibil în general cu un API care realizează întregul flux de lucru RAG de la preluarea textului necesar pentru a mări un prompt, la trimiterea promptului către model, până la returnarea răspunsului. Bazele de cunoștințe acceptă baze de date cu capabilități vectoriale care stochează reprezentări numerice ale datelor dvs. (înglobări) pe care modelele le folosesc pentru a accesa aceste date pentru RAG, inclusiv Amazon OpenSearch Service și alte baze de date populare, cum ar fi Pinecone și Redis Enterprise Cloud (suport pentru vectori Amazon Aurora și MongoDB). curând).

Al treilea mod în care puteți personaliza modelele în Amazon Bedrock este prin pre-formare continuă. Cu această metodă, modelul se bazează pe pre-instruirea inițială pentru înțelegerea generală a limbajului pentru a învăța limbajul și terminologia specifice domeniului. Această abordare este destinată clienților care dețin o mulțime de informații neetichetate, specifice domeniului și care doresc să permită LLM-urilor lor să înțeleagă limbajul, expresiile, abrevierile, conceptele, definițiile și jargonul unic pentru lumea lor (și afaceri). Spre deosebire de reglajul fin, care necesită o cantitate destul de mică de date, pre-instruirea continuă este efectuată pe seturi mari de date (de exemplu, mii de documente text). Acum, capabilitățile de pre-instruire sunt disponibile în Amazon Bedrock pentru Titan Text Lite și Titan Text Express.

- Disponibilitatea generală a Agenți pentru Amazon Bedrock pentru a ajuta la executarea sarcinilor în mai mulți pași folosind sisteme, surse de date și cunoștințele companiei. LLM-urile sunt excelente pentru a purta conversații și a genera conținut, dar clienții doresc ca aplicațiile lor să poată face acest lucru do chiar mai mult, cum ar fi luarea de măsuri, rezolvarea problemelor și interacțiunea cu o gamă largă de sisteme pentru a finaliza sarcini în mai mulți pași, cum ar fi rezervarea călătoriilor, depunerea cererilor de asigurare sau comandarea de piese de schimb. Și Amazon Bedrock poate ajuta cu această provocare. Cu agenți, dezvoltatorii selectează un model, scriu câteva instrucțiuni de bază, cum ar fi „sunteți un agent vesel de servicii pentru clienți” și „verificați disponibilitatea produsului în sistemul de inventar”, indică modelul selectat către sursele de date și sistemele de întreprindere potrivite (de exemplu, CRM). sau aplicații ERP) și scrieți câteva funcții AWS Lambda pentru a executa API-urile (de exemplu, verificați disponibilitatea unui articol în inventarul ERP). Amazon Bedrock analizează automat cererea și o descompune într-o secvență logică folosind capacitățile de raționament ale modelului selectat pentru a determina ce informații sunt necesare, ce API-uri să apeleze și când să le apeleze pentru a finaliza un pas sau a rezolva o sarcină. Acum, disponibili în general, agenții pot planifica și îndeplini majoritatea sarcinilor de afaceri — de la răspunsul la întrebările clienților despre disponibilitatea produselor dvs. până la preluarea comenzilor acestora — iar dezvoltatorii nu trebuie să fie familiarizați cu învățarea automată, instrucțiunile inginerilor, modelele de tren sau conectarea manuală a sistemelor. Iar Bedrock face toate acestea în mod sigur și privat, iar clienți precum Druva și Athene le folosesc deja pentru a îmbunătăți acuratețea și viteza de dezvoltare a aplicațiilor lor generative AI.

- Introducand Balustrade pentru Amazon Bedrock astfel încât să puteți aplica măsuri de protecție bazate pe cerințele de caz de utilizare și politicile responsabile de AI. Clienții doresc să se asigure că interacțiunile cu aplicațiile lor AI sunt sigure, evită limbajul toxic sau ofensator, rămân relevanți pentru afacerea lor și se aliniază cu politicile lor responsabile de AI. Cu balustradele, clienții pot specifica subiecte de evitat, iar Amazon Bedrock va oferi utilizatorilor doar răspunsuri aprobate la întrebările care se încadrează în acele categorii restricționate. De exemplu, o aplicație bancară online poate fi configurată pentru a evita oferirea de sfaturi de investiții și pentru a elimina conținutul neadecvat (cum ar fi discursul instigator la ură și violența). La începutul lui 2024, clienții vor putea, de asemenea, să redacteze informații de identificare personală (PII) în răspunsurile model. De exemplu, după ce un client interacționează cu un agent de call center, conversația cu serviciul clienți este adesea rezumată pentru păstrarea înregistrărilor, iar balustradele pot elimina informațiile personale din acele rezumate. Paravanele pot fi utilizate pe toate modelele din Amazon Bedrock (inclusiv modele ajustate) și cu agenții pentru Amazon Bedrock, astfel încât clienții să poată oferi un nivel consistent de protecție tuturor aplicațiilor lor generative AI.

Stratul superior al stivei: inovația continuă face ca AI generativă să fie accesibilă mai multor utilizatori

În stratul superior al stivei sunt aplicații care folosesc LLM-uri și alte FM-uri, astfel încât să puteți profita de AI generativă la locul de muncă. Un domeniu în care AI generativă schimbă deja jocul este codificarea. Anul trecut, am introdus Amazon CodeWhisperer, care vă ajută să creați aplicații mai rapid și mai sigur, generând sugestii și recomandări de cod aproape în timp real. Clienți precum Accenture, Boeing, Bundesliga, The Cigna Group, Kone și Warner Music Group folosesc CodeWhisperer pentru a crește productivitatea dezvoltatorilor – iar Accenture permite până la 50,000 dintre dezvoltatorii lor de software și profesioniști IT cu Amazon CodeWhisperer. Ne dorim ca cât mai mulți dezvoltatori să poată obține beneficiile de productivitate ale inteligenței artificiale generative, motiv pentru care CodeWhisperer oferă recomandări gratuit tuturor persoanelor.

Cu toate acestea, în timp ce instrumentele de codare AI fac mult pentru a ușura viața dezvoltatorilor, beneficiile lor de productivitate sunt limitate de lipsa lor de cunoaștere a bazelor interne de cod, API-uri interne, biblioteci, pachete și clase. O modalitate de a vă gândi la acest lucru este că, dacă angajați un nou dezvoltator, chiar dacă este de clasă mondială, acesta nu va fi atât de productiv la compania dvs. până când nu va înțelege cele mai bune practici și codul dvs. Instrumentele de codificare de astăzi bazate pe inteligență artificială sunt ca acel dezvoltator nou angajat. Pentru a ajuta acest lucru, recent am previzualizat un nou capacitate de personalizare în Amazon CodeWhisperer, care folosește în siguranță baza de cod intern a unui client pentru a oferi recomandări de cod mai relevante și mai utile. Cu această capacitate, CodeWhisperer este un expert în ta cod și oferă recomandări care sunt mai relevante pentru a economisi și mai mult timp. Într-un studiu pe care l-am făcut cu Persistent, o companie globală de inginerie digitală și modernizare a întreprinderilor, am constatat că personalizările îi ajută pe dezvoltatori să îndeplinească sarcini cu până la 28% mai rapid decât cu capacitățile generale ale CodeWhisperer. Acum, un dezvoltator de la o companie de tehnologie de asistență medicală poate cere CodeWhisperer să „importe imagini RMN asociate cu ID-ul clientului și să le ruleze prin clasificatorul de imagini“ pentru a detecta anomalii. Deoarece CodeWhisperer are acces la baza de coduri, poate oferi sugestii mult mai relevante, care includ locațiile de import ale imaginilor RMN și ID-urile clienților. CodeWhisperer păstrează personalizările complet private, iar FM-ul de bază nu le folosește pentru instruire, protejând proprietatea intelectuală valoroasă a clienților. AWS este singurul furnizor important de cloud care oferă o astfel de capacitate tuturor.

Introducand Amazon Q, asistentul generativ alimentat de AI, adaptat pentru muncă

Cu siguranță, dezvoltatorii nu sunt singurii care se apucă de AI generativă – milioane de oameni folosesc aplicații de chat AI generative. Ceea ce au făcut primii furnizori în acest spațiu este interesant și foarte util pentru consumatori, dar în multe feluri ei nu prea „lucrează” la locul de muncă. Cunoștințele și capacitățile lor generale sunt excelente, dar nu vă cunosc compania, datele, clienții, operațiunile sau afacerea dvs. Asta limitează cât de mult te pot ajuta. De asemenea, ei nu știu prea multe despre rolul tău - ce muncă faci, cu cine lucrezi, ce informații folosești și la ce ai acces. Aceste limitări sunt de înțeles deoarece acești asistenți nu au acces la informațiile private ale companiei dvs. și nu au fost proiectați pentru a îndeplini cerințele de confidențialitate și securitate a datelor de care companiile au nevoie pentru a le acorda acest acces. Este greu să te asiguri de securitate după fapt și să te aștepți să funcționeze bine. Credem că avem o modalitate mai bună, care va permite fiecărei persoane din fiecare organizație să folosească AI generativă în siguranță în munca lor de zi cu zi.

WSunt încântați să vă prezint Amazon Q, un nou tip de asistent generativ bazat pe inteligență artificială, care este special pentru muncă și poate fi adaptat afacerii dvs. Q vă poate ajuta să obțineți răspunsuri rapide și relevante la întrebări urgente, să rezolvați probleme, să generați conținut și să luați acțiuni folosind datele și expertiza găsite în depozitele de informații, codul și sistemele companiei dumneavoastră. Când discutați cu Amazon Q, acesta oferă informații și sfaturi imediate și relevante pentru a vă ajuta să eficientizați sarcinile, să accelerați luarea deciziilor și să stimuleze creativitatea și inovația la locul de muncă. Am construit Amazon Q pentru a fi sigur și privat și poate înțelege și respecta identitățile, rolurile și permisiunile dvs. existente și poate utiliza aceste informații pentru a-și personaliza interacțiunile. Dacă un utilizator nu are permisiunea de a accesa anumite date fără Q, nu le poate accesa nici folosind Q. Am proiectat Amazon Q pentru a satisface cerințele stricte ale clienților întreprinderilor încă din prima zi — niciunul dintre conținutul acestora nu este folosit pentru a îmbunătăți modelele de bază.

Amazon Q este asistentul tău expert pentru construirea pe AWS: Am instruit Amazon Q pe 17 ani de cunoștințe și experiență AWS, astfel încât să poată transforma modul în care construiți, implementați și operați aplicațiile și sarcinile de lucru pe AWS. Amazon Q are o interfață de chat în Consola de management AWS și documentație, IDE-ul tău (prin CodeWhisperer) și camerele de chat ale echipei în Slack sau alte aplicații de chat. Amazon Q vă poate ajuta să explorați noi capabilități AWS, să începeți mai rapid, să învățați tehnologii nefamiliare, soluții de arhitect, depanare, actualizare și multe altele - este un expert în modele bine arhitecturate AWS, cele mai bune practici, documentație și implementări de soluții. Iată câteva exemple de ceea ce puteți face cu noul dvs. asistent expert AWS:

- Obțineți răspunsuri clare și îndrumări despre capabilitățile, serviciile și soluțiile AWS: Cereți-i lui Amazon Q „Spuneți-mi despre agenții pentru Amazon Bedrock”, iar Q vă va oferi o descriere a funcției, plus link-uri către materiale relevante. De asemenea, puteți adresa Amazon Q practic orice întrebare despre modul în care funcționează un serviciu AWS (de exemplu, „Care sunt limitele de scalare pe un tabel DynamoDB?” „Ce este Redshift Managed Storage?”) sau cum să proiectați cel mai bine orice număr de soluții ( „Care sunt cele mai bune practici pentru construirea de arhitecturi bazate pe evenimente?”). Și Amazon Q va aduna răspunsuri succinte și va cita întotdeauna (și trimite la) sursele sale.

- Alegeți cel mai bun serviciu AWS pentru cazul dvs. de utilizare și începeți rapid: Întrebați Amazon Q „Care sunt modalitățile de a construi o aplicație web pe AWS? ” și va oferi o listă de servicii potențiale precum Amplificare AWS, AWS Lambdas, și Amazon EC2 cu avantajele fiecaruia. De acolo puteți restrânge opțiunile, ajutându-l pe Q să vă înțeleagă cerințele, preferințele și constrângerile (de exemplu, „Care dintre acestea ar fi cel mai bine dacă vreau să folosesc containere?” sau „Ar trebui să folosesc o bază de date relațională sau non-relațională? ”). Încheiați cu „Cum încep?” și Amazon Q va sublinia câțiva pași de bază și vă va indica resurse suplimentare.

- Optimizați-vă resursele de calcul: Amazon Q vă poate ajuta să selectați instanțe Amazon EC2. Dacă îi cereți „Ajutați-mă să găsesc instanța EC2 potrivită pentru a implementa o sarcină de lucru de codificare video pentru aplicația mea de jocuri cu cea mai înaltă performanță”, Q vă va oferi o listă de familii de instanțe cu motivele fiecărei sugestii. Și, puteți adresa orice număr de întrebări ulterioare pentru a vă ajuta să găsiți cea mai bună alegere pentru volumul dvs. de lucru.

- Obțineți asistență pentru depanarea, testarea și optimizarea codului dvs.: Dacă întâmpinați o eroare în timpul codificării în IDE-ul dvs., puteți cere ajutor Amazon Q spunând: „Codul meu are o eroare IO, puteți oferi o remediere?” iar Q va genera codul pentru tine. Dacă vă place sugestia, puteți cere Amazon Q să adauge remedierea la aplicația dvs. Deoarece Amazon Q se află în IDE-ul dvs., înțelege codul la care lucrați și știe unde să insereze remedierea. Amazon Q poate crea, de asemenea, teste unitare („Scrieți teste unitare pentru funcția selectată”) pe care le poate introduce în codul dvs. și le puteți rula. În cele din urmă, Amazon Q vă poate spune modalități de optimizare a codului pentru performanțe mai mari. Cereți lui Q să „Optimizeze interogarea DynamoDB selectată” și va folosi înțelegerea codului dvs. pentru a oferi o sugestie în limbaj natural despre ce să remediați, împreună cu codul însoțitor pe care îl puteți implementa cu un singur clic.

- Diagnosticați și remediați problemele: Dacă întâmpinați probleme în Consola de administrare AWS, cum ar fi erori de permisiuni EC2 sau erori de configurare Amazon S3, puteți apăsa pur și simplu butonul „Depanați cu Amazon Q” și va folosi înțelegerea tipului de eroare și serviciul în care se află eroarea. pentru a vă oferi sugestii pentru o remediere. Puteți chiar să cereți Amazon Q să vă depaneze rețeaua (de exemplu, „De ce nu mă pot conecta la instanța mea EC2 folosind SSH?”), iar Q va analiza configurația dvs. de la capăt la capăt și va oferi un diagnostic (de exemplu, „Această instanță pare să fie într-o subrețea privată, așa că ar putea fi necesară stabilirea accesibilității publice”).

- Creșteți o nouă bază de cod în cel mai scurt timp: Când discutați cu Amazon Q în IDE-ul dvs., acesta combină experiența sa în construirea de software cu înțelegerea codului dvs. - o pereche puternică! Anterior, dacă ați preluat un proiect de la altcineva sau ați fost nou în echipă, ar putea fi necesar să petreceți ore întregi examinând manual codul și documentația pentru a înțelege cum funcționează și ce face. Acum, deoarece Amazon Q înțelege codul din IDE-ul dvs., puteți să-i cereți pur și simplu lui Amazon Q să explice codul („Oferiți-mi o descriere a ceea ce face această aplicație și cum funcționează”), iar Q vă va oferi detalii precum ce servicii utilizările codului și ceea ce fac diferitele funcții (de exemplu, Q ar putea răspunde cu ceva de genul „Această aplicație creează un sistem de bază de bilete de asistență folosind Python Flask și AWS Lambda” și continuă să descrie fiecare dintre capacitățile sale de bază, cum sunt implementate, și mult mai mult).

- Ștergeți mai repede acumularea de funcții: Puteți chiar să cereți Amazon Q să vă ghideze și să automatizeze o mare parte a procesului de la capăt la capăt de adăugare a unei funcții la aplicația dvs. în Amazon CodeCatalyst, serviciul nostru unificat de dezvoltare software pentru echipe. Pentru a face acest lucru, trebuie doar să atribuiți Q o sarcină de backlog din lista dvs. de probleme - la fel ca și un coechipier - și Q generează un plan pas cu pas pentru modul în care va construi și implementa caracteristica. Odată ce ați aprobat planul, Q va scrie codul și vă va prezenta modificările sugerate ca o revizuire a codului. Puteți solicita reluare (dacă este necesar), aproba și/sau implementa!

- Actualizați codul într-o fracțiune de timp: Majoritatea dezvoltatorilor petrec de fapt doar o fracțiune din timp scriind coduri noi și creând aplicații noi. Ei își petrec mult mai mult din ciclurile lor în zone dureroase, lentoase, cum ar fi întreținerea și upgrade-urile. Luați upgrade la versiunea lingvistică. Un număr mare de clienți continuă să folosească versiuni mai vechi de Java, deoarece va dura luni – chiar ani – și mii de ore de timp de dezvoltator pentru a actualiza. Amânarea acestui lucru are costuri și riscuri reale - ratați îmbunătățirile de performanță și sunteți vulnerabil la probleme de securitate. Credem că Amazon Q poate schimba jocul aici și suntem încântați Transformarea codului Amazon Q, o caracteristică care poate elimina o mare parte din aceste sarcini grele și poate reduce timpul necesar pentru actualizarea aplicațiilor de la zile la minute. Doar deschideți codul pe care doriți să îl actualizați în IDE-ul dvs. și cereți Amazon Q să „/transforme” codul. Amazon Q va analiza întregul cod sursă al aplicației, va genera codul în limba și versiunea țintă și va executa teste, ajutându-vă să realizați îmbunătățirile de securitate și performanță ale celor mai recente versiuni de limbă. Recent, o echipă foarte mică de dezvoltatori Amazon a folosit Amazon Q Code Transformation pentru a actualiza 1,000 de aplicații de producție de la Java 8 la Java 17 în doar două zile. Timpul mediu per aplicare a fost mai mic de 10 minute. Astăzi, Amazon Q Code Transformation realizează actualizări de limbaj Java de la Java 8 sau Java 11 la Java 17. Urmează (și în curând) capacitatea de a transforma .NET Framework în .NET multiplatformă (cu și mai multe transformări de urmat în viitor) .

Amazon Q este expertul dvs. în afaceri: Puteți conecta Amazon Q la datele, informațiile și sistemele dvs. de afaceri, astfel încât să poată sintetiza totul și să ofere asistență personalizată pentru a ajuta oamenii să rezolve probleme, să genereze conținut și să întreprindă acțiuni relevante pentru afacerea dvs. Este ușor să aduci Amazon Q în afacerea ta. Are peste 40 de conectori încorporați pentru sistemele de întreprindere populare, cum ar fi Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive și Zendesk. De asemenea, se poate conecta la intranetul intern, la wiki-uri și la rularea cărților, iar cu Amazon Q SDK, puteți construi o conexiune la orice aplicație internă doriți. Îndreptați Amazon Q către aceste depozite și va „intensifica” afacerea dvs., captând și înțelegând informațiile semantice care fac compania dvs. unică. Apoi, obțineți propria dvs. aplicație web Amazon Q prietenoasă și simplă, astfel încât angajații din compania dvs. să poată interacționa cu interfața conversațională. Amazon Q se conectează, de asemenea, la furnizorul dvs. de identitate pentru a înțelege un utilizator, rolul său și ce sisteme le este permis să acceseze, astfel încât utilizatorii să poată pune întrebări detaliate și nuanțate și să obțină rezultate personalizate care includ doar informațiile pe care sunt autorizați să le vadă. Amazon Q generează răspunsuri și informații care sunt exacte și fidele materialului și cunoștințelor pe care le furnizați și puteți restricționa subiecte sensibile, blocați cuvintele cheie sau filtrați întrebările și răspunsurile neadecvate. Iată câteva exemple de ceea ce poți face cu noul asistent expert al companiei tale:

- Obțineți răspunsuri clare, super-relevante, bazate pe datele și informațiile dvs. comerciale: Angajații pot întreba Amazon Q despre orice ar fi trebuit să caute anterior în tot felul de surse. Întrebați „Care sunt cele mai recente linii directoare pentru utilizarea logo-ului?” sau „Cum pot solicita un card de credit al companiei?”, iar Amazon Q va sintetiza tot conținutul relevant pe care îl găsește și va reveni cu răspunsuri rapide plus link-uri către cele relevante. surse (de exemplu, portaluri de marcă și depozite de sigle, politicile companiei T&E și aplicațiile pentru carduri).

- Eficientizarea comunicațiilor de zi cu zi: Întrebați, iar Amazon Q poate genera conținut („Creați o postare pe blog și trei titluri pe rețelele sociale care anunță produsul descris în această documentație”), să creeze rezumate executive („Scrieți un rezumat al transcripției întâlnirii noastre cu o listă cu marcatori de acțiuni” ), să furnizeze actualizări prin e-mail („Elaborați un e-mail care să evidențieze programele noastre de instruire în Q3 pentru clienții din India”) și să ajute la structurarea întâlnirilor („Creați o agendă de întâlnire pentru a vorbi despre cel mai recent raport de satisfacție a clienților”).

- Finalizați sarcini: Amazon Q poate ajuta la îndeplinirea anumitor sarcini, reducând timpul petrecut de angajați în muncă repetitivă, cum ar fi depunerea biletelor. Cereți-i lui Amazon Q să „Rezumă feedbackul clienților cu privire la noua ofertă de preț în Slack”, apoi cereți lui Q să ia acele informații și să deschidă un bilet în Jira pentru a actualiza echipa de marketing. Puteți cere lui Q să „Rezumă această transcriere a apelului”, apoi „Deschide un nou caz pentru Clientul A în Salesforce”. Amazon Q acceptă alte instrumente populare de automatizare a muncii, cum ar fi Zendesk și Service Now.

Amazon Q este în Amazon QuickSight: cu Amazon Q în QuickSight, serviciul de business intelligence al AWS, utilizatorii își pot adresa tablouri de bord întrebări precum „De ce a crescut numărul de comenzi luna trecută?” și obțineți vizualizări și explicații ale factorilor care au influențat creșterea. Și, analiștii pot folosi Amazon Q pentru a reduce timpul necesar pentru a construi tablouri de bord de la zile la minute, cu o solicitare simplă, cum ar fi „Afișați-mi vânzările în funcție de regiune, sub formă de diagramă cu bare stivuite”. Q revine imediat cu acea diagramă și o puteți adăuga cu ușurință la un tablou de bord sau puteți discuta mai departe cu Q pentru a rafina vizualizarea (de exemplu, „Schimbați diagrama cu bare într-o diagramă Sankey” sau „Afișați țările în loc de regiuni”). Amazon Q în QuickSight facilitează, de asemenea, utilizarea tablourilor de bord existente pentru a informa părțile interesate de afaceri, pentru a extrage informații cheie și pentru a simplifica luarea deciziilor folosind poveștile de date. De exemplu, utilizatorii pot solicita Amazon Q să „Construiți o poveste despre modul în care afacerea s-a schimbat în ultima lună pentru o revizuire a afacerii cu conducerea superioară”, iar în câteva secunde, Amazon Q oferă o poveste bazată pe date, care este vizual convingătoare și este complet personalizabil. Aceste povești pot fi împărtășite în siguranță în întreaga organizație pentru a ajuta la alinierea părților interesate și pentru a lua decizii mai bune.

Amazon Q este în Amazon Connect: În Amazon Connect, serviciul nostru de contact center, Amazon Q ajută agenții dvs. de servicii pentru clienți să ofere un serviciu mai bun pentru clienți. Amazon Q folosește depozitele de cunoștințe pe care agenții dvs. le folosesc în mod obișnuit pentru a obține informații pentru clienți, iar apoi agenții pot discuta cu Amazon Q direct în Connect pentru a obține răspunsuri care îi ajută să răspundă mai rapid la solicitările clienților, fără a fi nevoie să caute ei înșiși prin documentație. Și, în timp ce conversația cu Amazon Q pentru răspunsuri super-rapide este grozavă, în serviciul pentru clienți nu există prea rapid. De aceea Amazon Q In Connect transformă o conversație live cu un client cu un agent într-un prompt și oferă automat agentului posibile răspunsuri, acțiuni sugerate și link-uri către resurse. De exemplu, Amazon Q poate detecta că un client contactează o companie de închiriere de mașini pentru a-și schimba rezervarea, poate genera un răspuns pentru ca agentul să comunice rapid modul în care se aplică politicile de modificare a taxelor ale companiei și poate ghida agentul prin pașii de care au nevoie pentru a actualiza rezervare.

Amazon Q se află în lanțul de aprovizionare AWS (în curând): În AWS Supply Chain, serviciul nostru de informații despre lanțul de aprovizionare, Amazon Q ajută planificatorii cererii și ofertei, managerii de stocuri și partenerii comerciali să își optimizeze lanțul de aprovizionare prin rezumarea și evidențierea riscurilor potențiale de stocare sau suprastoc și vizualizarea scenariilor pentru a rezolva problema. Utilizatorii pot pune Amazon Q întrebări „ce”, „de ce” și „ce ar fi dacă” despre datele lanțului lor de aprovizionare și pot discuta prin scenarii complexe și compromisuri între diferite decizii privind lanțul de aprovizionare. De exemplu, un client poate întreba: „Ce cauzează întârzierea livrărilor mele și cum pot accelera lucrurile?” la care Amazon Q poate răspunde: „90% din comenzile tale sunt pe coasta de est, iar o furtună mare în sud-est provoacă o întârziere de 24 de ore. Dacă expediați în portul New York în loc de Miami, veți accelera livrările și veți reduce costurile cu 50%.

Clienții noștri adoptă rapid AI generativă – pregătesc modele inovatoare pe AWS, dezvoltă aplicații AI generative cu o viteză record folosind Amazon Bedrock și implementează aplicații care schimbă jocul în organizațiile lor, cum ar fi Amazon Q. Cu cele mai recente anunțuri, AWS aduce clienților și mai multă performanță, alegere și inovație în fiecare strat al stivei. Impactul combinat al tuturor capabilităților pe care le oferim la re:Invent marchează o etapă majoră în atingerea unui obiectiv interesant și semnificativ: facem AI generativă accesibilă clienților de toate dimensiunile și abilitățile tehnice, astfel încât aceștia să poată reinventa și transforma ceea ce este posibil.

Resurse

Despre autor

Swami Sivasubramanian este vicepreședinte pentru Data și Machine Learning la AWS. În acest rol, Swami supraveghează toate serviciile AWS Database, Analytics și AI & Machine Learning. Misiunea echipei sale este de a ajuta organizațiile să-și pună datele în funcțiune cu o soluție de date completă, de la capăt la capăt, pentru a stoca, accesa, analiza și vizualiza și prezice.

Swami Sivasubramanian este vicepreședinte pentru Data și Machine Learning la AWS. În acest rol, Swami supraveghează toate serviciile AWS Database, Analytics și AI & Machine Learning. Misiunea echipei sale este de a ajuta organizațiile să-și pună datele în funcțiune cu o soluție de date completă, de la capăt la capăt, pentru a stoca, accesa, analiza și vizualiza și prezice.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- :are

- :este

- :nu

- :Unde

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 300

- 35%

- 40

- 50

- 500

- 65

- 8

- 9

- a

- abilități

- capacitate

- Capabil

- Despre Noi

- mai sus

- accelera

- accelerat

- acceleratoare

- Accenture

- acces

- accesibilitate

- accesibil

- Contabilitate

- precizie

- precis

- dobândi

- peste

- Acțiune

- acțiuni

- activ

- de fapt

- adapta

- adăuga

- adăugat

- adăugare

- plus

- Suplimentar

- În plus,

- adăugări

- Adaugă

- Adidas

- chirpici

- Adoptarea

- avansat

- înaintând

- Avantaj

- Avantajele

- Promovare

- sfat

- După

- împotriva

- agendă

- Agent

- agenţi

- agregat

- în urmă

- AI

- AI și învățarea automată

- Chatbot AI

- cercetare ai

- AI-alimentat

- alinia

- TOATE

- permite

- permite

- de-a lungul

- deja

- de asemenea

- mereu

- Amazon

- Amazon Code Whisperer

- Amazon EC2

- Amazon QuickSight

- Amazon SageMaker

- Amazon Web Services

- sumă

- Sume

- an

- analiză

- analist

- analiști

- Google Analytics

- analiza

- analize

- și

- anunța

- anunturi

- anunțare

- răspunde

- răspunsuri

- Antropică

- Orice

- oricine

- nimic

- api

- API-uri

- aplicaţia

- apare

- aplicație

- aplicatii

- Aplică

- aprecia

- abordare

- aproba

- aprobat

- Apps

- Aprilie

- SUNT

- ZONĂ

- domenii

- discutabil

- în jurul

- AS

- cere

- Asistență

- Asistent

- asistenți

- asociate

- asociați

- At

- Atlassian

- spori

- augmented

- măriri

- Auroră

- autorizat

- automatizarea

- automate

- Automat

- în mod automat

- Automatizare

- auto

- disponibilitate

- disponibil

- in medie

- evita

- departe

- AWS

- Inferentia AWS

- AWS Lambdas

- Consola de administrare AWS

- înapoi

- Bancar

- bar

- bariere

- de bază

- bazat

- de bază

- BE

- deoarece

- devine

- fost

- început

- Crede

- Beneficiile

- CEL MAI BUN

- Cele mai bune practici

- Mai bine

- între

- Mare

- Miliard

- miliarde

- Bloca

- Blocuri

- Blog

- Boeing

- Bolt

- rezervare

- Booking.com

- Manuale

- atât

- De jos

- limitele

- marca

- Pauză

- pauze

- aduce

- Aducere

- construi

- Clădire

- construiește

- construit

- construit-in

- afaceri

- business intelligence

- întreprinderi

- dar

- buton

- by

- apel

- call center

- CAN

- Poate obține

- capacități

- capacitate

- capabil

- Capacitate

- capturarea

- mașină

- carbon

- emisiilor de carbon

- card

- cu grijă

- caz

- cazuri

- categorii

- provocând

- Centru

- sigur

- cu siguranță

- lanţ

- contesta

- provocări

- Schimbare

- si-a schimbat hainele;

- Changer

- Modificări

- schimbarea

- Caracteristici

- Diagramă

- Grafice

- camere de chat

- chatbot

- chatbots

- chat

- verifica

- cip

- Chips

- alegere

- Alege

- alegere

- ales

- creanțe

- clase

- Curățenie

- clar

- clic

- Cloud

- infrastructura cloud

- Grup

- clustering

- Coastă

- cod

- baza codului

- Revizuire a Codului

- Codificare

- colaborarea

- colaborare

- COM

- combinaţie

- combina

- combinate

- combină

- cum

- vine

- venire

- În curând

- comunica

- Comunicații

- Companii

- companie

- Compania

- comparație

- convingătoare

- Completă

- complet

- complex

- complexitate

- cuprinzător

- Calcula

- Concepte

- Configuraţie

- configurarea

- presupunere

- Conectați

- legat

- conexiune

- Suport conectare

- Connects

- consistent

- Consoleze

- constrângeri

- Consumatorii

- consum

- contactați-ne

- centru de contact

- Containere

- conţinut

- context

- contextual

- continua

- a continuat

- continuă

- continuarea

- Control

- controale

- Conversație

- de conversaţie

- conversații

- drepturi de autor

- copywriting

- Nucleu

- A costat

- cost-eficiente

- Cheltuieli

- țări

- cox

- crea

- a creat

- creativitate

- Creatorii

- credit

- card de credit

- Crimă

- CRISP

- CRM

- cross-platform

- client

- experienta clientului

- Satisfactia clientului

- Serviciu clienți

- clienţii care

- personalizabil

- personalizare

- personaliza

- personalizate

- Tăiat

- cicluri

- zilnic

- tablou de bord

- tablouri de bord

- de date

- Pregătirea datelor

- confidențialitatea datelor

- Confidențialitatea și securitatea datelor

- seturi de date

- Pe bază de date

- Baza de date

- baze de date

- cărămizi de date

- zi

- zilnic

- Zi

- Luarea deciziilor

- Deciziile

- adânc

- învățare profundă

- Mai adânc

- Definitii

- Grad

- întârziere

- livra

- Livrări

- livrarea

- Oferă

- Cerere

- democratizarea

- În funcție

- implementa

- dislocate

- Implementarea

- desfășurarea

- adâncime

- descrie

- descris

- descriere

- proiectat

- dorit

- detaliat

- detalii

- detecta

- Determina

- DEUTSCHE TELECOM

- Dezvoltator

- Dezvoltatorii

- în curs de dezvoltare

- Dezvoltare

- diagnostic

- Dialog

- Dialog

- FĂCUT

- diferit

- difuziune

- digital

- direct

- distribui

- distribuite

- instruire distribuită

- distribuire

- do

- document

- documentaţie

- documente

- face

- Nu

- face

- făcut

- Dont

- dublare

- jos

- conduce

- două

- duplicate

- durată

- e

- e-commerce

- fiecare

- Devreme

- mai ușor

- cu ușurință

- Est

- coasta de est

- uşor

- Economie

- ediţie

- în mod eficient

- eficiență

- eficient

- efort

- oricare

- altfel

- e-mailuri

- Emisiile

- de angajați

- împuternici

- împuternicirea

- permite

- permițând

- codare

- întâlni

- capăt

- un capăt la altul

- energie

- Consumul de energie

- eficiența energetică

- inginer

- Inginerie

- spori

- îmbunătățiri

- îmbogățitor

- Afacere

- íntreprindere

- Companii

- Divertisment

- Întreg

- plic

- Eră

- ERP

- eroare

- Erori

- Eter (ETH)

- evaluări

- Chiar

- evenimente

- EVER

- Fiecare

- toată lumea

- tot

- evoluţie

- evolua

- exemplu

- exemple

- excitat

- captivant

- a executa

- executiv

- existent

- expansiv

- aștepta

- accelera

- scump

- experienţă

- cu experienţă

- Experiențe

- expert

- expertiză

- Explica

- explora

- expres

- țesătură

- Față

- fapt

- factori

- destul de

- credincios

- şoim

- Cădea

- familiar

- familii

- familie

- FAST

- mai repede

- defect

- Caracteristică

- DESCRIERE

- taxă

- feedback-ul

- puțini

- Depunerea

- filtru

- În cele din urmă

- financiar

- Găsi

- descoperire

- descoperiri

- capăt

- termina

- First

- Repara

- flexibil

- concentrat

- urma

- Pentru

- Pentru consumatori

- Înainte

- găsit

- Fundație

- patru

- fracțiune

- Cadru

- cadre

- Gratuit

- frecvent

- prietenos

- din

- funcții

- mai mult

- viitor

- joc

- joc schimbător

- jocuri

- General

- în general

- genera

- generează

- generator

- generaţie

- generativ

- AI generativă

- generator

- obține

- obtinerea

- Da

- Caritate

- digital global

- Gmail

- Go

- scop

- merge

- bine

- GPU

- unități de procesare grafică

- mare

- Teren

- inovatoare

- grup

- În creştere

- crescut

- îndrumare

- ghida

- orientări

- HAD

- mâini

- lucru

- Greu

- Piese metalice

- nociv

- ură

- ură de vorbire

- Avea

- având în

- Prima pagină

- de asistență medicală

- greu

- ridicare de greutati

- ajutor

- ajutor

- ajută

- aici

- Înalt

- superior

- cea mai mare

- subliniind

- extrem de

- închiriere

- lui

- găzduire

- ORE

- Cum

- Cum Pentru a

- Totuși

- HTTPS

- sute

- i

- ID

- identitățile

- Identitate

- ID-uri

- if

- imagine

- generarea imaginii

- imagini

- imediat

- Impactul

- punerea în aplicare a

- implementările

- implementat

- import

- important

- impresionant

- îmbunătăţi

- îmbunătățit

- îmbunătățiri

- in

- include

- include

- Inclusiv

- Crește

- a crescut

- crescând

- Indicatorii

- persoane fizice

- industrii

- industrie

- lider în industrie

- influențat

- info

- Informa

- informații

- Infrastructură

- inova

- inovatoare

- Inovaţie

- inovații

- inovatoare

- intrare

- intrări

- înţelegere

- perspective

- instanță

- cazuri

- in schimb

- Institut

- instrucțiuni

- asigurare

- integrare

- intelectual

- de proprietate intelectuală

- Inteligență

- intenționează

- interacţiona

- interacţiuni

- interactiv

- interconectate

- interfaţă

- intern

- interveni

- în

- introduce

- introdus

- introducerea

- Inventat

- inventar

- Investi

- de investigare

- investind

- investiţie

- Investiții

- implicat

- implică

- probleme de

- IT

- Specialiști IT

- ESTE

- Japonez

- jargon

- Java

- jpg

- doar

- doar unul

- A pastra

- păstrare

- Cheie

- Domenii-cheie

- Cuvinte cheie

- trusă

- Kit (SDK)

- Cunoaște

- cunoştinţe

- știe

- Labs

- lipsă

- limbă

- mare

- pe scară largă

- cea mai mare

- Nume

- Anul trecut

- Târziu

- Latență

- Ultimele

- a lansat

- lansare

- avocaţi

- strat

- straturi

- Conducere

- conducere

- AFLAȚI

- învățat

- învăţare

- Legal

- mai puțin

- Permite

- Nivel

- Pârghie

- pîrghii

- LexisNexis

- LG

- biblioteci

- ciclu de viață

- ridicare

- ca

- Probabil

- limitări

- Limitat

- Limitele

- linii

- LINK

- Link-uri

- Listă

- trăi

- Locuiește

- Lamă

- situat

- Locații

- logic

- siglă

- Lung

- de lungă durată

- Lot

- dragoste

- Jos

- LOWER

- cel mai mic

- maşină

- masina de învățare

- făcut

- menține

- mentine

- întreținere

- major

- face

- FACE

- Efectuarea

- gestionate

- administrare

- Manageri

- manual

- munca manuala

- manual

- multe

- Marketing

- material

- Materiale

- maxim

- Mai..

- me

- semnificativ

- mijloace

- Mass-media

- Întâlni

- Reuniunea

- reuniuni

- se intalneste

- Membri actuali

- Mers

- meta

- metodă

- Miami

- Microsoft

- Microsoft 365

- De mijloc

- ar putea

- bornă

- minute

- rata

- Misiune

- ML

- model

- modelare

- Modele

- modernizare

- Impuls

- MongoDB

- monitoare

- Lună

- luni

- mai mult

- cele mai multe

- Cel mai popular

- în mişcare

- RMN

- mult

- multiplu

- Muzică

- trebuie sa

- my

- nume

- Nasdaq

- Natural

- Limbajul natural

- În apropiere

- necesar

- Nevoie

- necesar

- au nevoie

- net

- reţea

- rețele

- Nou

- New York

- recent

- următor

- Nitro

- Nu.

- notebook-uri

- acum

- număr

- Nvidia

- of

- de pe

- ofensator

- oferi

- oferind

- promoții

- de multe ori

- mai în vârstă

- on

- dată

- ONE

- cele

- on-line

- online banking

- afară

- deschide

- funcionar

- Operațiuni

- Optimizați

- optimizate

- optimizarea

- Opţiuni

- or

- comenzilor

- organizație

- organizații

- original

- Altele

- Altele

- al nostru

- afară

- schiță

- producție

- iesiri

- peste

- Stoc excedentar

- apăsător

- propriu

- Pace

- ofertele

- dureros

- perechi

- parametru

- parametrii

- parte

- parteneri

- piese

- trecut

- modele

- pauză

- oameni

- pentru

- efectua

- performanță

- efectuată

- efectuează

- permisiune

- permisiuni

- persoană

- personalizare

- personaliza

- Personal

- Tur PGA

- Expresii

- PII

- Loc

- plan

- Plato

- Informații despre date Platon

- PlatoData

- la care se adauga

- Punct

- Politicile

- Popular

- pozitiv

- posibil

- Post

- potenţial

- putere

- alimentat

- puternic

- Practic

- practic

- practicile

- precis

- prezice

- Predictii

- preferinţele

- pregătire

- Pregăti

- prezenta

- preşedinte

- presa

- presare

- Anunţ

- în prealabil

- preţ

- de stabilire a prețurilor

- primar

- intimitate

- Confidențialitate și securitate

- privat

- informații private

- Problemă

- probleme

- proces

- procese

- prelucrare

- produce

- Produs

- producere

- productiv

- productivitate

- profesional

- profesioniști

- Programe

- proiect

- solicitări

- proprietate

- proprietate

- protectoare

- protecţie

- furniza

- furnizorul

- furnizori

- furnizează

- furnizarea

- public

- public

- scopuri

- Împinge

- împingerea

- pune

- Punând

- Piton

- pirtorh

- Q3

- cantitativ

- întrebare

- Întrebări

- Rapid

- repede

- cu totul

- C&D

- gamă

- rapid

- repede

- tarife

- RE

- Citind

- real

- în timp real

- realist

- realiza

- realizat

- într-adevăr

- cucerind

- motive

- recent

- Recomandare

- Recomandări

- record

- reduce

- Redus

- reducerea

- rafina

- regiune

- eliberat

- încredere

- rămășițe

- scoate

- eliminarea

- repararea

- repetitiv

- înlocuire

- răspuns

- raportează

- depozit

- solicita

- cereri de

- necesar

- Cerinţe

- cercetare

- Rezervare

- Rezervă

- Rezoluţie

- rezonanța

- Resurse

- respect

- Răspunde

- răspunde

- răspuns

- răspunsuri

- responsabil

- restrânge

- limitat

- rezultat

- REZULTATE

- revenind

- revizuiască

- revizuirea

- dreapta

- Riscurile

- Rol

- rolurile

- Camere

- rute

- Regula

- Alerga

- funcţionare

- pistei

- sacrificare

- sigur

- garanții

- în siguranță

- sagemaker

- de vânzări

- Salesforce

- acelaşi

- satisfacție

- Economisiți

- spunând

- Scară

- scalare

- scenarii

- domeniu

- scorurile

- zgâria

- sdk

- fără sudură

- Caută

- Al doilea

- A doua generație

- secunde

- sigur

- în siguranță,

- securitate

- vedea

- vedere

- văzut

- selecta

- selectate

- selecţie

- trimitere

- senior

- conducere superioară

- sensibil

- Septembrie

- Secvenţă

- serie

- servere

- serviciu

- ServiceNow

- Servicii

- set

- Seturi

- câteva

- Distribuie

- comun

- navă

- Pantaloni scurți

- să

- parte

- semnificativ

- Siliciu

- asemănător

- simplu

- simplifica

- pur şi simplu

- întrucât

- SIX

- dimensiuni

- moale

- mic

- So

- Social

- social media

- Software

- Dezvoltatori de software

- de dezvoltare de software

- kit de dezvoltare software

- soluţie

- soluţii

- REZOLVAREA

- unele

- Cineva

- ceva

- Curând

- sofisticat

- Sursă

- cod sursă

- Surse

- Sud Est

- Spaţiu

- Scânteie

- specific

- discurs

- viteză

- petrece

- Stabilitate

- stabil

- stivui

- stivuite

- părțile interesate

- început

- Pornire

- Startup-urile

- de ultimă oră

- şedere

- Pas

- paşi

- Încă

- depozitare

- stoca

- magazine

- Istorii

- Furtună

- Poveste

- simplifica

- A intari

- stringent

- structura

- Studiu

- subrețea

- substanțial

- astfel de

- potrivit

- suită

- rezuma

- REZUMAT

- Super

- completa

- furnizori

- livra

- Cerere și ofertă

- lanțului de aprovizionare

- a sustine

- Sprijină

- sigur

- surprinzător

- supraveghere

- suspicios

- Durabilitate

- Intrerupator

- sintetiza

- sistem

- sisteme

- tabel

- adaptate

- Lua

- ia

- luare

- Vorbi

- Ţintă

- Sarcină

- sarcini

- echipă

- Membrii echipei

- echipe

- Tehnic

- tehnică

- tehnici de

- Tehnologii

- Tehnologia

- inovația tehnologică

- spune

- spune

- zece

- zeci

- tensorflow

- terminologie

- test

- Testarea

- teste

- a) Sport and Nutrition Awareness Day in Manasia Around XNUMX people from the rural commune Manasia have participated in a sports and healthy nutrition oriented activity in one of the community’s sports ready yards. This activity was meant to gather, mainly, middle-aged people from a Romanian rural community and teach them about the benefits that sports have on both their mental and physical health and on how sporting activities can be used to bring people from a community closer together. Three trainers were made available for this event, so that the participants would get the best possible experience physically and so that they could have the best access possible to correct information and good sports/nutrition practices. b) Sports Awareness Day in Poiana Țapului A group of young participants have taken part in sporting activities meant to teach them about sporting conduct, fairplay, and safe physical activities. The day culminated with a football match.

- generarea textului

- decât

- acea

- Viitorul

- lumea

- lor

- Lor

- se

- apoi

- Acolo.

- Acestea

- ei

- lucru

- lucruri

- crede

- Al treilea

- acest

- în acest an

- aceste

- mii

- trei

- Prin

- de-a lungul

- debit

- bilet

- bilete

- timp

- ori

- gigant

- la

- astăzi

- azi

- împreună

- semn

- de asemenea

- a luat

- instrument

- Unelte

- top

- subiecte

- Tur

- spre

- față de

- urmări

- Trading

- Tren

- dresat

- Pregătire

- Tranzacții

- Copie

- Transforma

- Transformare

- transformări

- transformare

- călătorie

- trilioane

- excursie

- cu adevărat

- Încredere

- încerca

- încercat

- se transformă

- Două

- tip

- tipic

- care stau la baza

- înţelege

- inteligibil

- înţelegere

- înțelege

- necunoscut

- unificat

- unic

- caracteristici unice

- unitate

- spre deosebire de

- până la

- Actualizează

- actualizări

- upgrade-ul

- upgrade-uri

- us

- Folosire

- utilizare

- carcasa de utilizare

- utilizat

- Utilizator

- utilizatorii

- utilizări

- folosind

- Valoros

- varietate

- diverse

- versiune

- Impotriva

- foarte

- de

- viciu

- Vicepreședinte

- Video

- practic

- vizualizare

- imagina

- vizual

- volume

- vulnerabil

- vrea

- Warner

- grup muzical warner

- a fost

- Val

- Cale..

- modalități de

- we

- web

- aplicatie web

- servicii web

- site-uri web

- săptămână

- săptămâni

- bun venit

- BINE

- bine cunoscut

- au fost

- Ce

- Ce este

- cand

- dacă

- care

- în timp ce

- OMS

- de ce

- larg

- Gamă largă

- mai larg

- voi

- fereastră

- cu

- în

- fără

- Apartamente

- a lucrat

- fluxuri de lucru

- de lucru

- fabrică

- lume

- de clasă mondială

- face griji

- valoare

- ar

- scrie

- scrie cod

- scris

- an

- ani

- York

- tu

- Ta

- Zendesk

- zephyrnet