Creșterea rapidă a IA generativă aduce noi inovații promițătoare și, în același timp, ridică noi provocări. Aceste provocări includ unele care erau comune înainte de AI generativă, cum ar fi părtinirea și explicabilitatea și altele noi unice pentru modelele de fundație (FM), inclusiv halucinații și toxicitate. La AWS, ne angajăm dezvoltarea IA generativă în mod responsabil, adoptând o abordare centrată pe oameni, care acordă prioritate educației, științei și clienților noștri, pentru a integra AI responsabilă pe parcursul ciclului de viață AI de la capăt la capăt.

În ultimul an, am introdus noi capabilități în aplicațiile și modelele noastre AI generative, cum ar fi scanarea de securitate încorporată în Amazon Code Whisperer, antrenament pentru detectarea și blocarea conținutului dăunător în Amazon Titan, și protecția confidențialității datelor în Amazon Bedrock. Investiția noastră în IA generativă sigură, transparentă și responsabilă include colaborarea cu comunitatea globală și factorii de decizie politică, deoarece am încurajat și sprijinit atât Angajamentele voluntare ale IA la Casa Albă și AI Safety Summit în Regatul Unit. Și continuăm să lucrăm mână în mână cu clienții pentru a opera IA responsabilă cu instrumente special create, cum ar fi Amazon SageMaker Clarify, Guvernare ML cu Amazon SageMaker, Și mai mult.

Introducerea unei noi inovații responsabile în domeniul inteligenței artificiale

Pe măsură ce IA generativă se extinde la noi industrii, organizații și cazuri de utilizare, această creștere trebuie să fie însoțită de o investiție susținută în dezvoltarea responsabilă a FM. Clienții doresc ca FM-urile lor să fie construite având în vedere siguranța, corectitudinea și securitatea, astfel încât să poată, la rândul lor, să implementeze AI în mod responsabil. Anul acesta, la AWS re:Invent, suntem încântați să anunțăm noi capabilități pentru a promova inovația responsabilă generativă AI printr-un set larg de capabilități cu noi instrumente încorporate, protecția clienților, resurse pentru a spori transparența și instrumente pentru combaterea dezinformarii. Ne propunem să oferim clienților informațiile de care au nevoie pentru a evalua FM-urile în funcție de considerente cheie responsabile de AI, cum ar fi toxicitatea și robustețea, și introducem balustrade pentru a aplica măsuri de protecție bazate pe cazurile de utilizare ale clienților și politicile responsabile de AI. În același timp, clienții noștri doresc să fie mai bine informați cu privire la siguranța, corectitudinea, securitatea și alte proprietăți ale serviciilor AI și ale FM, pe măsură ce le folosesc în cadrul propriei organizații. Suntem încântați să anunțăm mai multe resurse pentru a ajuta clienții să înțeleagă mai bine serviciile noastre AWS AI și să oferim transparența pe care o cer.

Implementarea măsurilor de protecție: balustrade pentru Amazon Bedrock

Siguranța este o prioritate atunci când vine vorba de introducerea AI generativă la scară. Organizațiile doresc să promoveze interacțiuni sigure între clienții lor și aplicațiile AI generative care evită limbajul dăunător sau ofensator și se aliniază la politicile companiei. Cel mai simplu mod de a face acest lucru este să puneți măsuri de protecție consecvente în întreaga organizație, astfel încât toată lumea să poată inova în siguranță. Ieri am anunțat avanpremiera Balustrade pentru Amazon Bedrock— o nouă capacitate care facilitează implementarea măsurilor de protecție specifice aplicației pe baza cazurilor de utilizare ale clienților și a politicilor responsabile de AI.

Garanțiile asigură coerența modului în care FM-urile de pe Amazon Bedrock răspund la conținutul nedorit și dăunător din aplicații. Clienții pot aplica balustrade pentru modele de limbă mari de pe Amazon Bedrock, precum și pentru modele ajustate și în combinație cu Agenți pentru Amazon Bedrock. Guardrails vă permite să specificați subiecte care trebuie evitate, iar serviciul detectează și previne automat interogările și răspunsurile care se încadrează în categorii restricționate. Clienții pot configura, de asemenea, praguri de filtrare a conținutului în diferite categorii, inclusiv discursul instigator la ură, insulte, limbaj sexualizat și violență, pentru a filtra conținutul dăunător la nivelul dorit. De exemplu, o aplicație bancară online poate fi configurată pentru a evita oferirea de sfaturi de investiții și pentru a limita conținutul neadecvat (cum ar fi discursul instigator la ură, insulte și violență). În viitorul apropiat, clienții vor putea, de asemenea, să redacteze informații de identificare personală (PII) în intrările utilizatorilor și răspunsurile FM, să stabilească filtre de blasfemie și să ofere o listă de cuvinte personalizate pe care să le blocheze în interacțiunile dintre utilizatori și FM, îmbunătățind conformitatea și în continuare. protejarea utilizatorilor. Cu Guardrails, puteți inove mai rapid cu IA generativă, menținând în același timp protecțiile și garanțiile în concordanță cu politicile companiei.

Identificarea celui mai bun FM pentru un anumit caz de utilizare: Model Evaluation in Amazon Bedrock

Astăzi, organizațiile au o gamă largă de opțiuni FM pentru a-și alimenta aplicațiile AI generative. Pentru a atinge echilibrul corect de precizie și performanță pentru cazul lor de utilizare, organizațiile trebuie să compare eficient modelele și să găsească cea mai bună opțiune pe baza IA responsabilă cheie și a valorilor de calitate care sunt importante pentru ele. Pentru a evalua modelele, organizațiile trebuie să petreacă mai întâi zilele identificând punctele de referință, instalând instrumente de evaluare și executând evaluări, toate acestea necesită o experiență profundă în știința datelor. În plus, aceste teste nu sunt utile pentru evaluarea criteriilor subiective (de exemplu, vocea mărcii, relevanța și stilul) care necesită judecată prin fluxuri de lucru plictisitoare, care necesită mult timp, de analiză umană. Timpul, expertiza și resursele necesare pentru aceste evaluări – pentru fiecare nou caz de utilizare – îngreunează organizațiile să evalueze modelele în raport cu dimensiunile AI responsabile și să facă o alegere informată în ceea ce privește modelul care va oferi cea mai precisă și sigură experiență pentru clienții lor.

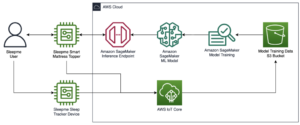

Acum disponibil în previzualizare, Evaluare model pe Amazon Bedrock ajută clienții să evalueze, să compare și să selecteze cele mai bune FM pentru cazul lor specific de utilizare, pe baza unor valori personalizate, cum ar fi acuratețea și siguranța, folosind fie evaluări automate, fie evaluări umane. În consola Amazon Bedrock, clienții aleg FM-urile pe care doresc să le compare pentru o anumită sarcină, cum ar fi răspunsul la întrebări sau rezumarea conținutului. Pentru evaluările automate, clienții selectează criterii de evaluare predefinite (de exemplu, acuratețe, robustețe și toxicitate) și își încarcă propriul set de date de testare sau selectează din seturi de date încorporate, disponibile public. Pentru criterii subiective sau conținut nuanțat care necesită judecată, clienții pot configura cu ușurință fluxuri de lucru de evaluare bazate pe oameni, cu doar câteva clicuri. Aceste fluxuri de lucru folosesc echipa de lucru internă a unui client sau folosesc o forță de muncă gestionată furnizată de AWS pentru a evalua răspunsurile modelului. În timpul evaluărilor bazate pe oameni, clienții definesc valorile specifice de utilizare (de exemplu, relevanța, stilul și vocea mărcii). Odată ce clienții termină procesul de configurare, Amazon Bedrock rulează evaluări și generează un raport, astfel încât clienții să poată înțelege cu ușurință modul în care modelul a funcționat în funcție de criteriile cheie de siguranță și acuratețe și să selecteze cel mai bun model pentru cazul lor de utilizare.

Această capacitate de a evalua modele nu se limitează la Amazon Bedrock, clienții pot utiliza, de asemenea, evaluarea modelului în Amazon SageMaker Clarify pentru a evalua, compara și selecta cu ușurință cea mai bună opțiune FM în funcție de parametri cheie de calitate și responsabilitate, cum ar fi acuratețea, robustețea și toxicitatea toate FM-urile.

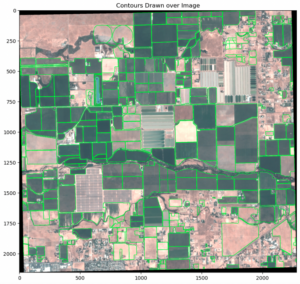

Combaterea dezinformării: Watermarking în Amazon Titan

Astăzi, am anunțat Amazon Titan Generator de imagini în previzualizare, care dă posibilitatea clienților să producă și să îmbunătățească rapid imagini de înaltă calitate la scară. Am considerat AI responsabilă în fiecare etapă a procesului de dezvoltare a modelului, inclusiv selecția datelor de antrenament, construirea de capabilități de filtrare pentru a detecta și elimina intrările neadecvate ale utilizatorilor și ieșirile modelului și îmbunătățirea diversității demografice a rezultatelor modelului nostru. Toate imaginile generate de Amazon Titan conțin implicit un filigran invizibil, care este conceput pentru a ajuta la reducerea răspândirii dezinformației, oferind un mecanism discret de identificare a imaginilor generate de AI. AWS este printre primii furnizori de modele care lansează pe scară largă filigrane invizibile încorporate care sunt integrate în ieșirile de imagine și sunt proiectate pentru a fi rezistente la modificări.

Construirea încrederii: ne sprijinim modelele și aplicațiile noastre cu despăgubiri

Construirea încrederii clienților este esențial pentru AWS. Am fost într-o călătorie cu clienții noștri încă de la începuturile noastre și, odată cu creșterea IA generativă, rămânem angajați să construim împreună tehnologie inovatoare. Pentru a le permite clienților să valorifice puterea IA generativă, aceștia trebuie să știe că sunt protejați. AWS oferă acoperire de despăgubire pentru drepturile de autor pentru rezultatele următoarelor servicii AI generative Amazon: Amazon Titan Text Express, Amazon Titan Text Lite, Amazon Titan Embeddings, Amazon Titan Multimodal Embeddings, Amazon CodeWhisperer Professional, AWS HealthScribe, Amazon Lex, și Personalizați Amazon. Aceasta înseamnă că clienții care utilizează serviciile în mod responsabil sunt protejați de reclamațiile terților care pretind încălcarea drepturilor de autor prin rezultatele generate de acele servicii (a se vedea Secțiunea 50.10 din Termeni de serviciu). În plus, indemnizația noastră standard de IP pentru utilizarea serviciilor îi protejează pe clienți de reclamațiile terților care pretind încălcarea IP de către servicii și datele utilizate pentru instruirea acestora. Cu alte cuvinte, dacă utilizați un serviciu AI generativ Amazon enumerat mai sus și cineva vă dă în judecată pentru încălcarea IP, AWS va apăra acel proces, care include acoperirea oricărei hotărâri judecătorești împotriva dvs. sau a costurilor de decontare.

Suntem în spatele serviciilor noastre AI generative și lucrăm pentru a le îmbunătăți continuu. Pe măsură ce AWS lansează noi servicii și AI generativă continuă să evolueze, AWS va continua să se concentreze neîncetat pe câștigarea și menținerea încrederii clienților.

Îmbunătățirea transparenței: AWS AI Service Card pentru Amazon Titan Text

We a introdus AWS AI Service Cards la re:Invent 2022 ca resursă de transparență pentru a ajuta clienții să înțeleagă mai bine serviciile noastre AWS AI. Cardurile de servicii AI sunt o formă de documentație AI responsabilă care oferă clienților un singur loc pentru a găsi informații despre cazurile de utilizare și limitările preconizate, alegerile responsabile de proiectare AI și cele mai bune practici de implementare și optimizare a performanței pentru serviciile noastre AI. Ele fac parte dintr-un proces cuprinzător de dezvoltare pe care ne angajăm pentru a ne construi serviciile într-un mod responsabil, care abordează corectitudinea, explicabilitatea, veridicitatea și robustețea, guvernanța, transparența, confidențialitatea și securitatea, siguranța și controlabilitatea.

La re:Invent anul acesta anunțăm a nou card de servicii AI pentru Amazon Titan Text pentru a crește transparența modelelor de fundație. De asemenea, lansăm patru noi carduri de servicii AI, inclusiv: Amazon Comprehend Detect PII, Detectarea toxicității Amazon Transcribe, Amazon Rekognition Face Liveness, și AWS HealthScribe. Puteți explora fiecare dintre aceste cărți pe Site-ul web AWS. Pe măsură ce IA generativă continuă să crească și să evolueze, transparența cu privire la modul în care tehnologia este dezvoltată, testată și utilizată va fi o componentă vitală pentru a câștiga încrederea organizațiilor și a clienților lor deopotrivă. La AWS, ne angajăm să continuăm să aducem resurse de transparență, cum ar fi cardurile de servicii AI pentru comunitatea mai largă – și să repetăm și să adunăm feedback cu privire la cele mai bune căi de urmat.

Investiția în IA responsabilă pe întreg ciclul de viață generativ al AI

Suntem încântați de noile inovații anunțate la re:Invent săptămâna aceasta, care oferă clienților noștri mai multe instrumente, resurse și protecții încorporate pentru a construi și utiliza AI generativă în siguranță. De la evaluarea modelului la balustrade la watermarking, clienții pot acum să aducă AI generativă în organizația lor mai rapid, atenuând în același timp riscurile. Noile protecții pentru clienți, cum ar fi acoperirea indemnizației IP și noi resurse pentru a spori transparența, cum ar fi cardurile suplimentare de servicii AI, sunt, de asemenea, exemple cheie ale angajamentului nostru de a construi încredere în companiile de tehnologie, factorii de decizie, grupurile comunitare, oamenii de știință și multe altele. Continuăm să facem investiții semnificative în inteligența artificială responsabilă pe parcursul ciclului de viață al unui model de bază, pentru a ajuta clienții noștri să extindă IA într-un mod sigur, securizat și responsabil.

Despre Autori

Peter Hallinan conduce inițiative în știința și practica IA responsabilă la AWS AI, alături de o echipă de experți responsabili în IA. Are o expertiză profundă în AI (doctorat, Harvard) și antreprenoriat (Blindsight, vândut către Amazon). Activitățile sale de voluntariat au inclus serviciul ca profesor consultant la Școala de Medicină a Universității Stanford și ca președinte al Camerei de Comerț Americane din Madagascar. Când este posibil, pleacă la munte cu copiii săi: schi, alpinism, drumeții și rafting

Peter Hallinan conduce inițiative în știința și practica IA responsabilă la AWS AI, alături de o echipă de experți responsabili în IA. Are o expertiză profundă în AI (doctorat, Harvard) și antreprenoriat (Blindsight, vândut către Amazon). Activitățile sale de voluntariat au inclus serviciul ca profesor consultant la Școala de Medicină a Universității Stanford și ca președinte al Camerei de Comerț Americane din Madagascar. Când este posibil, pleacă la munte cu copiii săi: schi, alpinism, drumeții și rafting

Vasi Philomin este în prezent VP generativ AI la AWS. El conduce eforturile generative de inteligență artificială, inclusiv Amazon Bedrock, Amazon Titan și Amazon CodeWhisperer.

Vasi Philomin este în prezent VP generativ AI la AWS. El conduce eforturile generative de inteligență artificială, inclusiv Amazon Bedrock, Amazon Titan și Amazon CodeWhisperer.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/announcing-new-tools-and-capabilities-to-enable-responsible-ai-innovation/

- :are

- :este

- :nu

- $UP

- 10

- 100

- 125

- 2022

- 50

- a

- capacitate

- Capabil

- Despre Noi

- mai sus

- însoțit

- precizie

- precis

- peste

- activităţi de

- plus

- Suplimentar

- adrese

- sfat

- împotriva

- AI

- Servicii AI

- urmări

- alinia

- deopotrivă

- TOATE

- pe langa

- de asemenea

- Amazon

- Amazon Code Whisperer

- Amazon SageMaker

- Amazon Web Services

- american

- printre

- an

- și

- anunța

- a anunțat

- anunțare

- O alta

- Orice

- aplicație

- aplicatii

- Aplică

- abordare

- SUNT

- în jurul

- AS

- solicitând

- evaluări

- At

- Automat

- în mod automat

- disponibil

- evita

- evitat

- AWS

- AWS re: Inventează

- Sold

- Bancar

- bazat

- BE

- fost

- înainte

- în spatele

- valori de referință

- CEL MAI BUN

- Cele mai bune practici

- Mai bine

- între

- părtinire

- Bloca

- atât

- marca

- aduce

- Aduce

- larg

- mai larg

- construi

- a cladi increderea

- Clădire

- construit

- construit-in

- by

- CAN

- capacități

- capacitate

- card

- Carduri

- caz

- cazuri

- categorii

- provocări

- Cameră

- Copii

- alegere

- alegeri

- Alege

- creanțe

- Alpinism

- colaborare

- combaterea

- combinaţie

- vine

- Comerț

- angajament

- comise

- Comun

- comunitate

- Companii

- companie

- comparaţie

- conformitate

- component

- înţelege

- cuprinzător

- Considerații

- luate în considerare

- consistent

- Consoleze

- consultant

- conţine

- conţinut

- continuu

- continua

- continuă

- continuarea

- drepturi de autor

- încălcarea drepturilor de autor

- Nucleu

- Cheltuieli

- acoperire

- acoperire

- Criteriile de

- În prezent

- personalizat

- client

- clienţii care

- de date

- confidențialitatea datelor

- știința datelor

- seturi de date

- Zi

- adânc

- expertiza profundă

- Mod implicit

- defini

- livra

- demografic

- implementa

- desfășurarea

- Amenajări

- proiectat

- dorit

- detecta

- dezvoltat

- Dezvoltare

- dificil

- Dimensiuni

- dezinformare

- Diversitate

- do

- documentaţie

- conduce

- în timpul

- e

- fiecare

- câștiga

- Câștigul salarial

- Cel mai simplu

- cu ușurință

- uşor

- Educaţie

- eficient

- Eforturile

- oricare

- imputerniceste

- permite

- incurajata

- un capăt la altul

- spori

- Întreg

- antreprenoriatului

- Eter (ETH)

- evalua

- evaluarea

- evaluare

- evaluări

- Fiecare

- toată lumea

- evolua

- exemplu

- exemple

- excitat

- experienţă

- expertiză

- experți

- Explicabilitate

- explora

- expres

- Față

- cinste

- Cădea

- mai repede

- feedback-ul

- puțini

- filtru

- filtrare

- Filtre

- Găsi

- termina

- First

- Concentra

- următor

- Pentru

- formă

- Înainte

- Foster

- Fundație

- patru

- din

- mai mult

- În plus

- viitor

- aduna

- generată

- generează

- generativ

- AI generativă

- dat

- oferă

- Caritate

- guvernare

- Grupului

- Crește

- Creștere

- nociv

- valorifica

- harvard

- ură

- ură de vorbire

- Avea

- he

- ajutor

- ajută

- de înaltă calitate

- drumeții

- lui

- casă

- Cum

- HTTPS

- uman

- identifica

- identificarea

- if

- imagine

- imagini

- punerea în aplicare a

- important

- îmbunătăţi

- îmbunătățirea

- in

- începuturile

- include

- inclus

- include

- Inclusiv

- Crește

- industrii

- informații

- informat

- încălcare

- inițiative

- inova

- Inovaţie

- inovații

- inovatoare

- tehnologie inovatoare

- intrări

- integra

- integrate

- destinate

- interacţiuni

- în

- introduce

- introdus

- introducerea

- investiţie

- Investiții

- invizibil

- IP

- IT

- călătorie

- jpg

- doar

- Cheie

- Cunoaște

- limbă

- mare

- lansează

- lansare

- proces

- Conduce

- Permite

- Nivel

- Pârghie

- ciclu de viață

- ca

- LIMITĂ

- limitări

- Limitat

- Listă

- listat

- mentine

- face

- FACE

- gestionate

- semnificativ

- mijloace

- mecanism

- medicină

- Metrici

- minte

- atenuant

- model

- Modele

- mai mult

- cele mai multe

- trebuie sa

- În apropiere

- Nevoie

- Nou

- acum

- of

- de pe

- ofensator

- promoții

- on

- dată

- cele

- on-line

- online banking

- optimizare

- Opțiune

- Opţiuni

- or

- organizație

- organizații

- Altele

- al nostru

- afară

- iesiri

- propriu

- parte

- trecut

- performanță

- efectuată

- Personal

- PhD

- PII

- Loc

- Plato

- Informații despre date Platon

- PlatoData

- Politicile

- factorii de decizie politică

- posibil

- putere

- practică

- practicile

- preşedinte

- previne

- Anunţ

- prioritizează

- prioritate

- intimitate

- Confidențialitate și securitate

- proces

- produce

- PROFANITATE

- profesional

- Profesor

- promițător

- promova

- proprietăţi

- protejat

- protectoare

- protejează

- furniza

- prevăzut

- furnizori

- furnizarea

- public

- pune

- calitate

- interogări

- ridică

- gamă

- rapid

- repede

- RE

- reduce

- eliberaţi

- relevanţa

- rămâne

- scoate

- raportează

- necesar

- Necesită

- rezistent

- resursă

- Resurse

- Răspunde

- răspunsuri

- responsabilitate

- responsabil

- responsabil

- limitat

- dreapta

- Risc

- robusteţe

- funcţionare

- ruleaza

- sigur

- garanții

- în siguranță

- Siguranţă

- sagemaker

- acelaşi

- Scară

- scara ai

- cântare

- scanare

- Şcoală

- Ştiinţă

- oamenii de stiinta

- Secțiune

- sigur

- securitate

- vedea

- selecta

- selecţie

- serviciu

- Servicii

- servire

- set

- instalare

- așezare

- configurarea

- întrucât

- singur

- So

- vândut

- unele

- Cineva

- specific

- discurs

- petrece

- răspândire

- Etapă

- stand

- standard

- în picioare

- stanford

- Universitatea Stanford

- grevă

- stil

- astfel de

- Sues

- Suportat

- susținut

- luare

- Sarcină

- echipă

- Tehnologia

- companii de tehnologie

- testat

- Testarea

- teste

- a) Sport and Nutrition Awareness Day in Manasia Around XNUMX people from the rural commune Manasia have participated in a sports and healthy nutrition oriented activity in one of the community’s sports ready yards. This activity was meant to gather, mainly, middle-aged people from a Romanian rural community and teach them about the benefits that sports have on both their mental and physical health and on how sporting activities can be used to bring people from a community closer together. Three trainers were made available for this event, so that the participants would get the best possible experience physically and so that they could have the best access possible to correct information and good sports/nutrition practices. b) Sports Awareness Day in Poiana Țapului A group of young participants have taken part in sporting activities meant to teach them about sporting conduct, fairplay, and safe physical activities. The day culminated with a football match.

- acea

- informațiile

- Marea Britanie

- lor

- Lor

- Acestea

- ei

- terț

- acest

- în această săptămână

- în acest an

- aceste

- Prin

- timp

- gigant

- la

- împreună

- Unelte

- subiecte

- Tren

- Pregătire

- Transparență

- transparent

- Încredere

- ÎNTORCĂ

- Uk

- înţelege

- întreprinde

- unic

- universitate

- utilizare

- carcasa de utilizare

- utilizat

- Utilizator

- utilizatorii

- folosind

- vital

- Voce

- voluntar

- voluntar

- vp

- vrea

- filigran

- filigranare

- filigrane

- Cale..

- modalități de

- we

- web

- servicii web

- website

- săptămână

- BINE

- au fost

- Ce

- cand

- care

- în timp ce

- OMS

- întreg

- larg

- Gamă largă

- pe larg

- voi

- cu

- în

- cuvinte

- Apartamente

- fluxuri de lucru

- Forta de munca

- an

- ieri

- tu

- zephyrnet