Video Falsificarea Seinfeld Nothing, Forever – un sitcom dezvoltat folosind inteligența artificială generativă – a fost interzis temporar pe Twitch, după ce unul dintre personaje a aruncat accidental profanități transfobe.

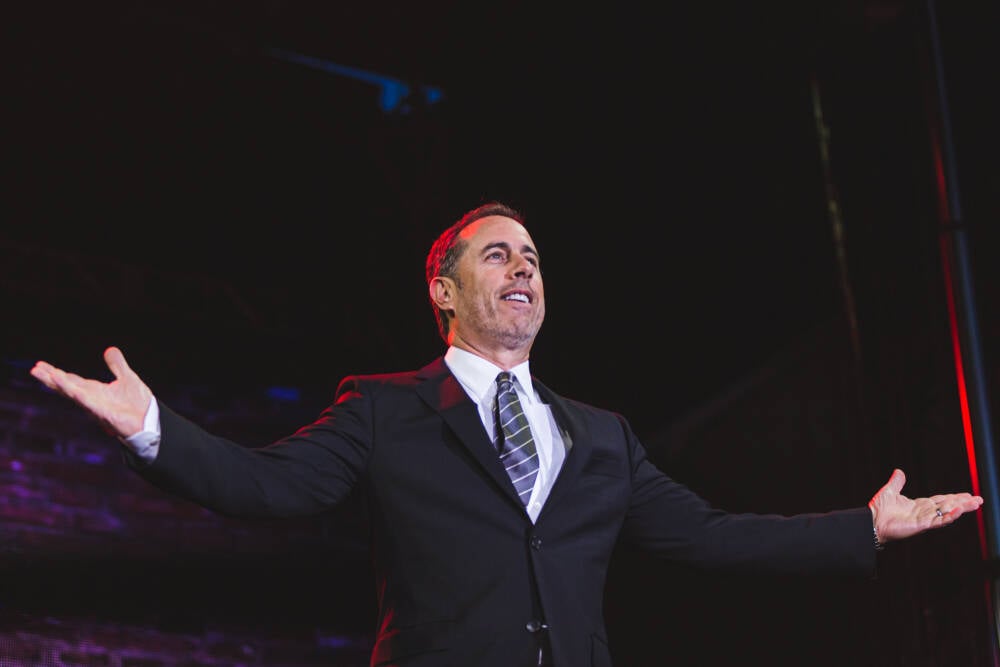

Spectacolul bizar face titluri Săptămâna trecută pentru că am folosit inteligența artificială pentru a improviza imaginile și scenariul unui episod fără sfârșit din Seinfeld. În comedie care imit arta, sitcom 30 Rock a prezis ceva de genul asta acum peste 15 ani.

Personajele, modelate după personajele emblematice ale seriei de comedie Jerry, George, Elaine și Kramer, rostesc un dialog complet alcătuit folosind modelele de limbaj GPT-3 OpenAI. Textul este tradus în audio folosind algoritmi de conversie a textului în vorbire, iar fundalurile și scenele sunt, de asemenea, generate de AI. Nimic, Forever a transmis pe Twitch 24/7 și a atras mulți adepți de când a început difuzarea anul trecut, în decembrie.

Dar canal găzduirea emisiunii a fost desființată luni pentru încălcarea Politicile de conținut ale Twitch. Skyler Hartle, cofondatorul Mismatch Media și unul dintre creatorii din spatele Nothing, Forever, a declarat Registrul interdicția a fost emisă din cauza personajului principal, Larry Feinberg, care a făcut comentarii jignitoare spunând că persoanele transgender „distrug structura societății”, faptul că transgender este o boală mintală și că „toți liberalii sunt în secret gay”.

Puteți urmări scena proastă de stand-up mai jos.

Hartle a spus că scenariul emisiunii s-a deviat atunci când creatorii săi au trecut de la utilizarea modelului OpenAI GPT-3 modelul Davinci la o versiune mai puțin puternică și mai ieftină numită Curie și nu au implementat caracteristici software pentru a-și modera conținutul.

„Am întâmpinat o problemă cu conexiunea noastră cu Davinci aseară și a trebuit să trecem la modelul Curie în timp ce problema s-a rezolvat de la sine. Acesta a fost momentul în care a fost generat textul neadecvat și l-am închis imediat. Am investigat în continuare problema și am descoperit că nu folosim corect instrumentele de moderare a conținutului OpenAI”, ne-a spus el.

Hartle a confirmat că interdicția este temporară și ar trebui să dureze 14 zile. Mismatch Media lucrează acum la implementarea instrumentelor de moderare a conținutului OpenAI și are în vedere și un sistem secundar pentru a urmări rezultatele modelului.

„Textul pe care l-am generat a fost o greșeală, suntem super stânjeniți și că conținutul generativ creat nu reflectă în niciun caz valorile sau opiniile personalului nostru. Regretăm foarte mult că s-a întâmplat acest lucru și sperăm să revenim curând la emisiune, cu toate măsurile de protecție adecvate”, a spus el.

Modelele de limbaj mari, cum ar fi GPT-3, sunt antrenate din textul răzuit de pe internet și pot genera un limbaj nepotrivit și ofensator. Filtrele de conținut pot minimiza cel mai prost text, dar fragmentele se vor strecura în continuare chiar și cu măsurile de siguranță existente.

Un purtător de cuvânt de la Twitch a trimis Registrul liniile directoare ale comunității companiei care se ocupă de comportamentul instigator la ură și a spus:

„Nu comentăm anumite încălcări din motive de confidențialitate, dar luăm măsurile corespunzătoare atunci când avem dovezi că un canal a acționat cu încălcarea Regulilor comunității sau a Termenilor și condițiilor.” ®

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- Platoblockchain. Web3 Metaverse Intelligence. Cunoștințe amplificate. Accesați Aici.

- Sursa: https://go.theregister.com/feed/www.theregister.com/2023/02/07/twitch_ai_seinfeld/

- ani 15

- a

- Acțiune

- După

- AI

- AIR

- algoritmi

- TOATE

- și

- adecvat

- Artă

- atrase

- audio

- înapoi

- fundaluri

- Rău

- Interzice

- interzis

- banurile

- în spatele

- fiind

- de mai jos

- Canal

- caracter

- caractere

- mai ieftin

- Co-fondator

- Comedie

- comentariu

- comentarii

- comunitate

- companie

- complet

- Conduce

- CONFIRMAT

- conexiune

- luand in considerare

- conţinut

- moderarea conținutului

- a creat

- Creatorii

- Zi

- abuzive

- decembrie

- implementa

- dezvoltat

- Dialog

- FĂCUT

- a descoperit

- jos

- Eter (ETH)

- Chiar

- dovadă

- cu experienţă

- țesătură

- DESCRIERE

- Feinberg

- Filtre

- pentru totdeauna

- din

- mai mult

- genera

- generată

- generativ

- AI generativă

- George

- orientări

- sa întâmplat

- speranţă

- găzduire

- HTTPS

- iconic

- boală

- imediat

- punerea în aplicare a

- in

- Internet

- problema

- Emis

- IT

- în sine

- Etichetă

- limbă

- Nume

- Anul trecut

- efectului de pârghie

- făcut

- Principal

- Efectuarea

- multe

- Mass-media

- mental

- Boală mintală

- greşeală

- model

- Modele

- moderare

- luni

- Numit

- noapte

- ofensator

- ONE

- OpenAI

- Avize

- oameni

- Loc

- Plato

- Informații despre date Platon

- PlatoData

- Politicile

- puternic

- intimitate

- motive

- reflectă

- regreta

- hotărât

- stâncă

- Said

- scenă

- scene

- secundar

- serie

- serviciu

- să

- Arăta

- întrucât

- furişa

- Societate

- Software

- ceva

- Curând

- specific

- Purtatorul de cuvant al

- Personal

- început

- Încă

- transmise în flux

- Super

- Intrerupator

- comutate

- sistem

- Lua

- temporar

- termeni

- punct de vedere al serviciului

- Text-to-Speech

- Prin

- la

- de asemenea

- Unelte

- urmări

- dresat

- transsexuali

- TIC nervos

- us

- Valori

- versiune

- ÎNCĂLCARE

- încălcări

- Ceas

- săptămână

- în timp ce

- Wikipedia

- voi

- de lucru

- Mini rulouri de absorbție

- an

- ani

- zephyrnet