În această eră a datelor mari, organizațiile din întreaga lume caută în mod constant modalități inovatoare de a extrage valoare și informații din seturile lor vaste de date. Apache Spark oferă scalabilitatea și viteza necesare procesării eficiente a unor cantități mari de date.

Amazon EMR este soluția de big data în cloud lider în industrie pentru procesarea datelor la scară petabyte, analiză interactivă și învățare automată (ML) folosind framework-uri open source, cum ar fi Apache Spark, Apache Hive, și Presto. Amazon EMR este cel mai bun loc pentru a rula Apache Spark. Puteți crea rapid și fără efort clustere Spark gestionate din Consola de administrare AWS, Interfața liniei de comandă AWS (AWS CLI) sau Amazon EMR API. De asemenea, puteți utiliza funcții Amazon EMR suplimentare, inclusiv cele rapide Serviciul Amazon de stocare simplă (Amazon S3) conectivitate folosind Amazon EMR File System (EMRFS), integrare cu Amazon EC2 Spot piata si cel AWS Adeziv Data Catalog și EMR Managed Scaling pentru a adăuga sau elimina instanțe din cluster. Amazon EMR Studio este un mediu de dezvoltare integrat (IDE) care permite oamenilor de știință și inginerilor de date să dezvolte, să vizualizeze și să depaneze aplicații de inginerie și știință a datelor scrise în R, Python, Scala și PySpark. EMR Studio oferă notebook-uri Jupyter complet gestionate și instrumente precum Spark UI și YARN Timeline Service pentru a simplifica depanarea.

Pentru a debloca potențialul ascuns în depozitele de date, este esențial să depășim analiza tradițională. Introduceți AI generativă, o tehnologie de ultimă oră care combină ML cu creativitatea pentru a genera text, artă și chiar cod de tip uman. Amazon Bedrock este cel mai simplu mod de a construi și scala aplicații AI generative cu modele de fundație (FM). Amazon Bedrock este un serviciu complet gestionat care face ca FM-urile de la Amazon și de la companiile de IA de top să fie disponibile printr-un API, astfel încât să puteți experimenta rapid cu o varietate de FM în terenul de joacă și să utilizați un singur API pentru inferență, indiferent de modelele pe care le alegeți, oferind aveți flexibilitatea de a utiliza FM de la diferiți furnizori și de a fi la curent cu cele mai recente versiuni de model, cu modificări minime de cod.

În această postare, explorăm modul în care vă puteți supraalimenta analiza datelor cu IA generativă folosind Amazon EMR, Amazon Bedrock și pyspark-ai bibliotecă. Biblioteca pyspark-ai este un SDK în limba engleză pentru Apache Spark. Preia instrucțiuni în limba engleză și le compilează în obiecte PySpark precum DataFrames. Acest lucru facilitează lucrul cu Spark, permițându-vă să vă concentrați pe extragerea valorii din datele dvs.

Prezentare generală a soluțiilor

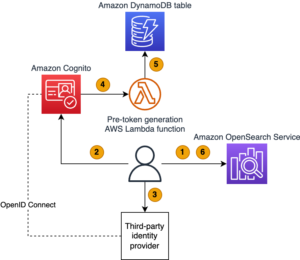

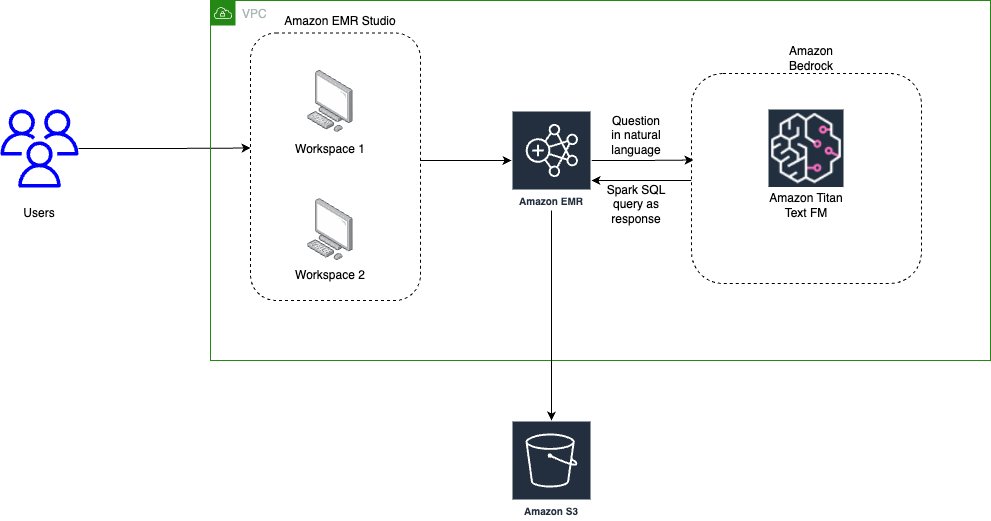

Următoarea diagramă ilustrează arhitectura pentru utilizarea AI generativă cu Amazon EMR și Amazon Bedrock.

EMR Studio este un IDE bazat pe web pentru notebook-uri Jupyter complet gestionate care rulează pe clustere EMR. Interacționăm cu EMR Studio Workspaces conectat la un cluster EMR care rulează și rulăm notebook-ul furnizat ca parte a acestei postări. Noi folosim Taxi din New York date pentru a aduna informații despre diferite curse cu taxiul efectuate de utilizatori. Adresăm întrebările în limbaj natural pe lângă datele încărcate în Spark DataFrame. Biblioteca pyspark-ai utilizează apoi Amazon Titan Text FM de la Amazon Bedrock pentru a crea o interogare SQL bazată pe întrebarea în limbaj natural. Biblioteca pyspark-ai preia interogarea SQL, o rulează folosind Spark SQL și oferă rezultate înapoi utilizatorului.

În această soluție, puteți crea și configura resursele necesare în contul dvs. AWS cu un Formarea AWS Cloud șablon. Șablonul creează AWS Adeziv bază de date și tabele, compartiment S3, VPC și altele Gestionarea identității și accesului AWS (IAM) resurse care sunt utilizate în soluție.

Șablonul este conceput pentru a demonstra cum să utilizați EMR Studio cu pachetul pyspark-ai și Amazon Bedrock și nu este destinat utilizării în producție fără modificări. În plus, șablonul folosește us-east-1 Regiune și este posibil să nu funcționeze în alte regiuni fără modificări. Șablonul creează resurse care implică costuri în timp ce sunt în uz. Urmați pașii de curățare de la sfârșitul acestei postări pentru a șterge resursele și pentru a evita taxele inutile.

Cerințe preliminare

Înainte de a lansa stiva CloudFormation, asigurați-vă că aveți următoarele:

- Un cont AWS care oferă acces la serviciile AWS

- Un utilizator IAM cu o cheie de acces și o cheie secretă pentru a configura AWS CLI și permisiuni pentru a crea un rol IAM, politici IAM și stive în AWS CloudFormation

- Modelul Titan Text G1 – Express este în prezent în previzualizare, așa că trebuie să aveți acces la previzualizare pentru a-l folosi ca parte a acestei postări

Creați resurse cu AWS CloudFormation

CloudFormation creează următoarele resurse AWS:

- O stivă VPC cu subrețele private și publice de utilizat cu EMR Studio, tabele de rute și gateway-ul NAT.

- Un cluster EMR cu Python 3.9 instalat. Folosim o acțiune de bootstrap pentru a instala Python 3.9 și alte pachete relevante, cum ar fi dependențele pyspark-ai și Amazon Bedrock. (Pentru mai multe informații, consultați script bootstrap.)

- O găleată S3 pentru spațiul de lucru EMR Studio și stocarea notebook-urilor.

- Rolurile și politicile IAM pentru configurarea EMR Studio, accesul Amazon Bedrock și rularea notebook-urilor

Pentru a începe, parcurgeți următorii pași:

Stiva CloudFormation durează aproximativ 20-30 de minute. Puteți monitoriza progresul acestuia pe consola AWS CloudFormation. Când starea lui se citește CREATE_COMPLETE, contul dvs. AWS va avea resursele necesare pentru a implementa această soluție.

Creați EMR Studio

Acum puteți crea un EMR Studio și un spațiu de lucru pentru a lucra cu codul notebook-ului. Parcurgeți următorii pași:

- Pe consola EMR Studio, alegeți Creați Studio.

- Introduceţi Numele studioului as

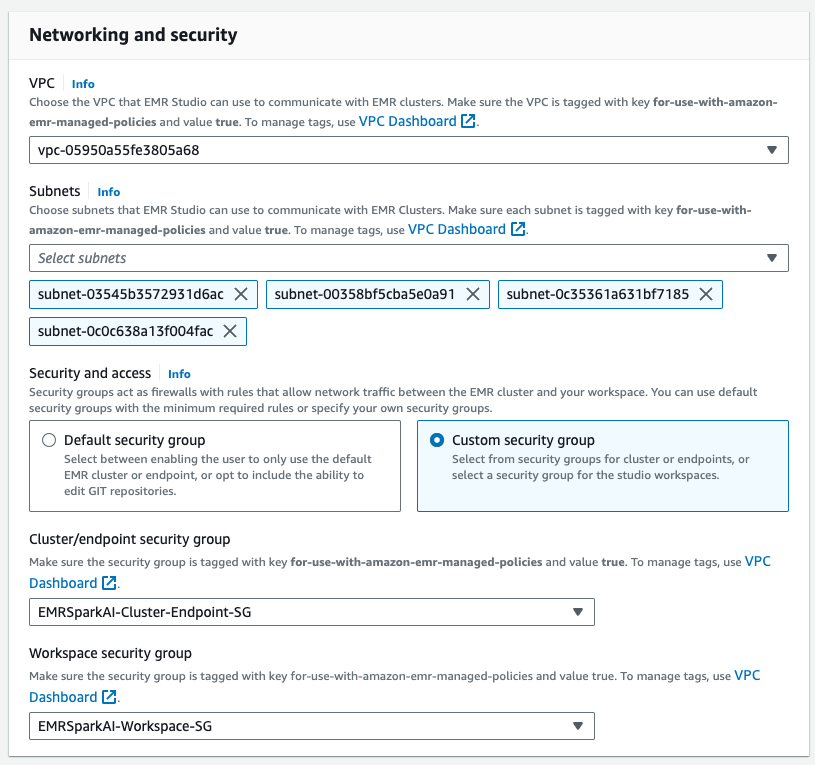

GenAI-EMR-Studioși furnizați o descriere. - În Rețea și securitate secțiunea, specificați următoarele:

- Pentru VPC, alegeți VPC-ul pe care l-ați creat ca parte a stivei CloudFormation pe care l-ați implementat. Obțineți ID-ul VPC folosind ieșirile CloudFormation pentru cheia VPCID.

- Pentru Subrețele, alegeți toate cele patru subrețele.

- Pentru Securitate și acces, Selectați Grup de securitate personalizat.

- Pentru Grup de securitate cluster/endpoint, alege

EMRSparkAI-Cluster-Endpoint-SG. - Pentru Grup de securitate pentru spațiul de lucru, alege

EMRSparkAI-Workspace-SG.

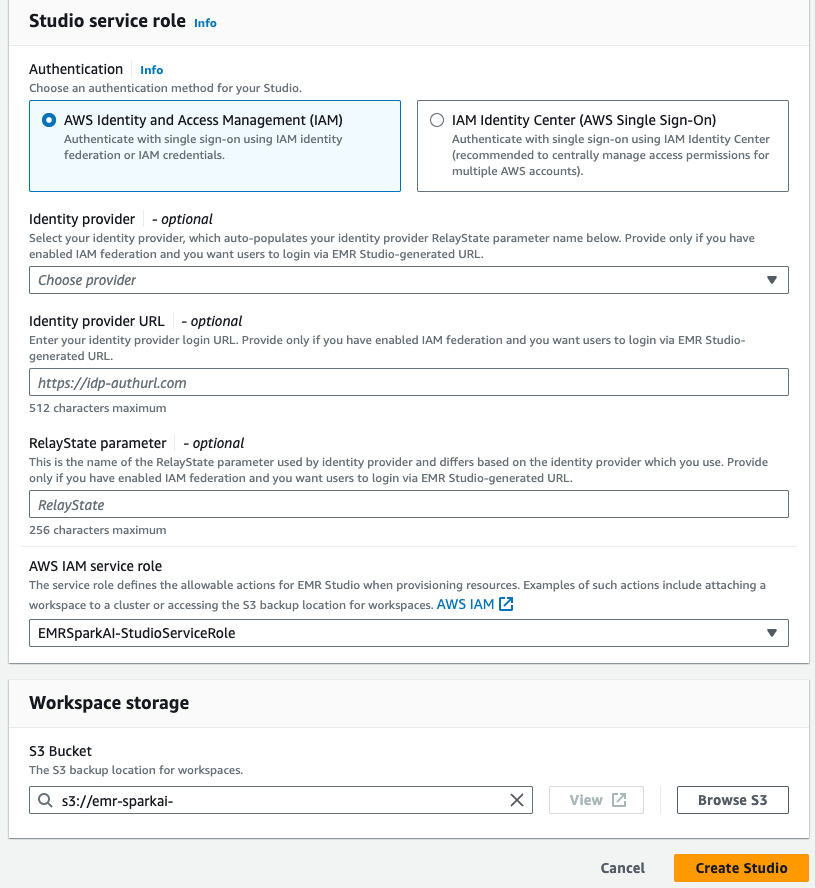

- În Rol de serviciu în studio secțiunea, specificați următoarele:

- Pentru Autentificare, Selectați AWS Identity and Access Management (IAM).

- Pentru Rol de serviciu AWS IAM, alege

EMRSparkAI-StudioServiceRole.

- În Depozitarea spațiului de lucru secțiunea, răsfoiți și alegeți găleata S3 pentru stocare începând cu

emr-sparkai-<account-id>. - Alege Creați Studio.

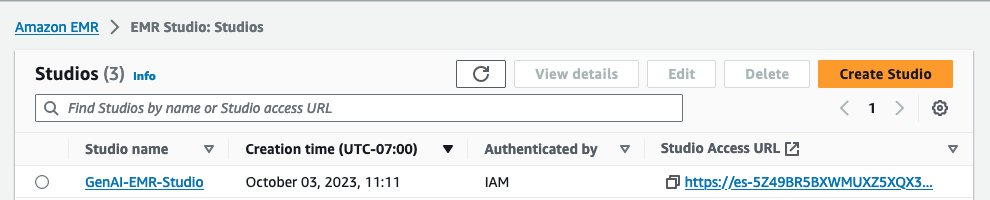

- Când este creat EMR Studio, alegeți linkul de sub Adresa URL de acces la Studio pentru a accesa Studioul.

- Când sunteți în Studio, alegeți Creați spațiu de lucru.

- Adăuga

emr-genaica nume pentru spațiul de lucru și alegeți Creați spațiu de lucru. - Când spațiul de lucru este creat, alegeți-i numele pentru a lansa spațiul de lucru (asigurați-vă că ați dezactivat blocarea ferestrelor pop-up).

Analiza datelor mari folosind Apache Spark cu Amazon EMR și AI generativă

Acum că am finalizat configurarea necesară, putem începe să efectuăm analize de date mari folosind Apache Spark cu Amazon EMR și AI generativă.

Ca prim pas, încărcăm un notebook care are codul necesar și exemple pentru a lucra cu cazul de utilizare. Folosim setul de date NY Taxi, care conține detalii despre călătoriile cu taxiul.

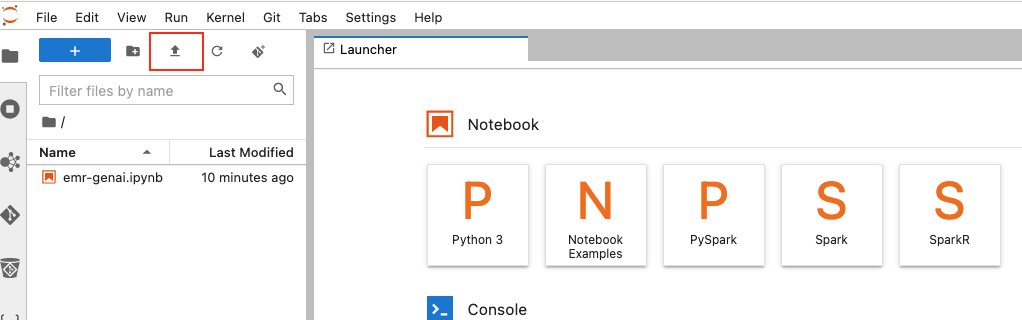

- Descărcați fișierul caiet NYTaxi.ipynb și încărcați-l în spațiul dvs. de lucru alegând pictograma de încărcare.

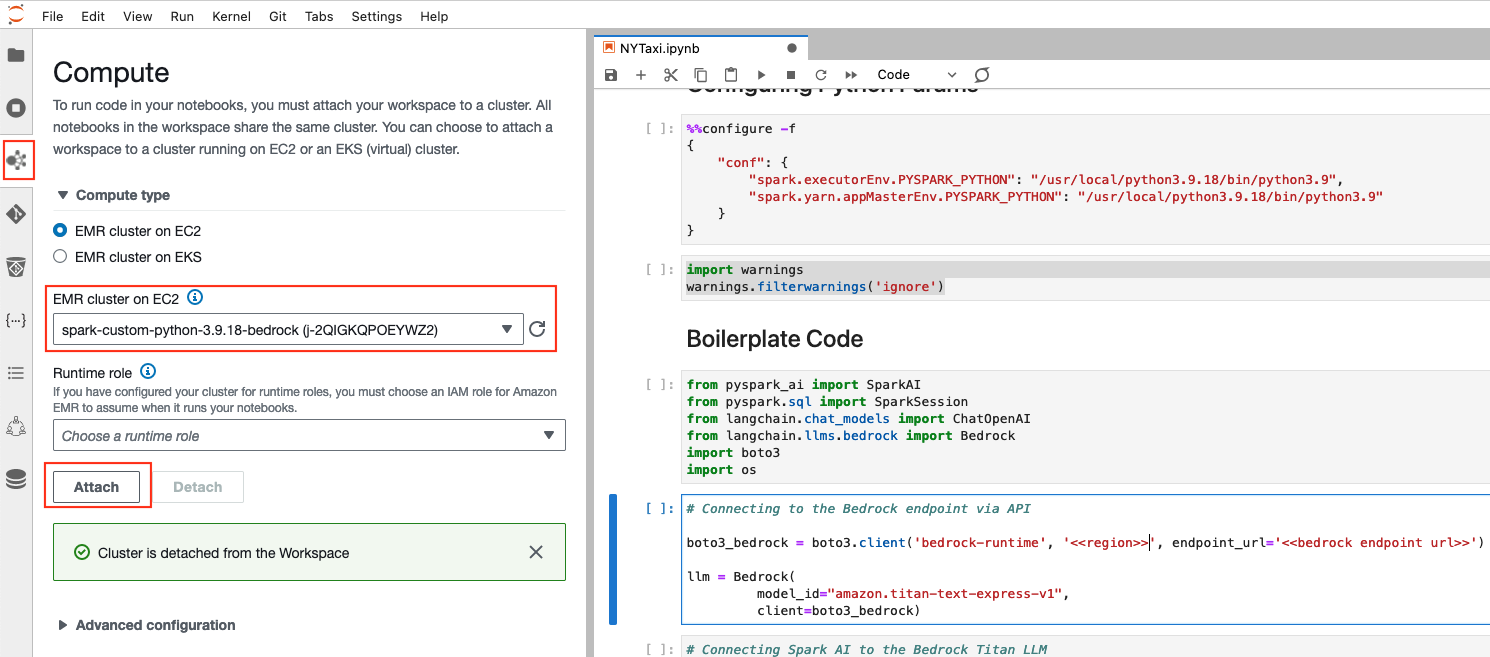

- După ce caietul este importat, deschideți blocnotesul și alegeți

PySparkca nucleu.

PySpark AI folosește în mod implicit ChatGPT4.0 de la OpenAI ca model LLM, dar puteți conecta și modele de la Amazon Bedrock, Amazon SageMaker JumpStart, și alte modele terțe. Pentru această postare, arătăm cum să integrăm modelul Amazon Bedrock Titan pentru generarea de interogări SQL și să îl rulăm cu Apache Spark în Amazon EMR.

- Pentru a începe cu blocnotesul, trebuie să asociați spațiul de lucru unui strat de calcul. Pentru a face acest lucru, alegeți Calcula pictograma din panoul de navigare și alegeți clusterul EMR creat de stiva CloudFormation.

- Configurați parametrii Python pentru a utiliza pachetul actualizat Python 3.9 cu Amazon EMR:

- Importă bibliotecile necesare:

- După ce bibliotecile sunt importate, puteți defini modelul LLM de la Amazon Bedrock. În acest caz, folosim amazon.titan-text-express-v1. Trebuie să introduceți adresa URL pentru regiunea și punctul final Amazon Bedrock pe baza accesului dvs. de previzualizare pentru modelul Titan Text G1 – Express.

- Conectați Spark AI la modelul Amazon Bedrock LLM pentru generarea de interogări SQL bazate pe întrebări în limbaj natural:

Aici, am inițializat Spark AI cu verbose=False; De asemenea, puteți seta verbose=True pentru a vedea mai multe detalii.

Acum puteți citi datele NYC Taxi într-un cadru de date Spark și puteți utiliza puterea AI generativă în Spark.

- De exemplu, puteți cere numărul de înregistrări din setul de date:

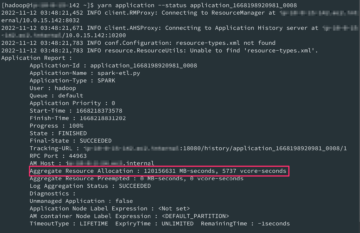

Primim următorul răspuns:

Spark AI folosește intern LangChain și lanțul SQL, care ascund complexitatea utilizatorilor finali care lucrează cu interogări în Spark.

Notebook-ul mai are câteva exemple de scenarii pentru a explora puterea AI generativă cu Apache Spark și Amazon EMR.

A curăța

Goliți conținutul găleții S3 emr-sparkai-<account-id>, ștergeți spațiul de lucru EMR Studio creat ca parte a acestei postări, apoi ștergeți stiva CloudFormation pe care ați implementat-o.

Concluzie

Această postare a arătat cum vă puteți supraalimenta analiza de date mari cu ajutorul Apache Spark cu Amazon EMR și Amazon Bedrock. Pachetul PySpark AI vă permite să obțineți informații semnificative din datele dvs. Ajută la reducerea timpului de dezvoltare și analiză, reducând timpul necesar pentru scrierea interogărilor manuale și permițându-vă să vă concentrați pe cazul dvs. de utilizare în afaceri.

Despre Autori

Saurabh Bhutyani este arhitect principal de soluții specialist în analiză la AWS. Este pasionat de noile tehnologii. S-a alăturat AWS în 2019 și lucrează cu clienții pentru a oferi îndrumări arhitecturale pentru rularea cazurilor de utilizare AI generative, soluții de analiză scalabile și arhitecturi de rețea de date folosind servicii AWS precum Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, și Amazon DataZone.

Saurabh Bhutyani este arhitect principal de soluții specialist în analiză la AWS. Este pasionat de noile tehnologii. S-a alăturat AWS în 2019 și lucrează cu clienții pentru a oferi îndrumări arhitecturale pentru rularea cazurilor de utilizare AI generative, soluții de analiză scalabile și arhitecturi de rețea de date folosind servicii AWS precum Amazon Bedrock, Amazon SageMaker, Amazon EMR, Amazon Athena, AWS Glue, AWS Lake Formation, și Amazon DataZone.

Vardhan aspru este un AWS Senior Solutions Architect, specializat în analiză. Are peste 8 ani de experiență în domeniul big data și al științei datelor. Este pasionat de a ajuta clienții să adopte cele mai bune practici și să descopere perspective din datele lor.

Vardhan aspru este un AWS Senior Solutions Architect, specializat în analiză. Are peste 8 ani de experiență în domeniul big data și al științei datelor. Este pasionat de a ajuta clienții să adopte cele mai bune practici și să descopere perspective din datele lor.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/big-data/use-generative-ai-with-amazon-emr-amazon-bedrock-and-english-sdk-for-apache-spark-to-unlock-insights/

- :are

- :este

- :nu

- $UP

- 1

- 10

- 100

- 107

- 11

- 20

- 200

- 2019

- 320

- 500

- 521

- 7

- 8

- 9

- 990

- a

- Despre Noi

- acces

- managementul accesului

- Cont

- recunoaște

- Acțiune

- adăuga

- Suplimentar

- În plus,

- adopta

- AI

- ai cazuri de utilizare

- TOATE

- Permiterea

- permite

- de asemenea

- Amazon

- Amazon Atena

- Amazon EMR

- Amazon SageMaker

- Amazon Web Services

- Sume

- an

- analiză

- Google Analytics

- și

- răspunde

- Orice

- Apache

- Apache Spark

- api

- aplicatii

- aproximativ

- arhitectural

- arhitectură

- SUNT

- Artă

- AS

- cere

- Avocat Colaborator

- At

- disponibil

- evita

- AWS

- Formarea AWS Cloud

- AWS Adeziv

- Formația lacului AWS

- înapoi

- bazat

- CEL MAI BUN

- Cele mai bune practici

- Dincolo de

- Mare

- Datele mari

- Bootstrap

- construi

- afaceri

- dar

- buton

- by

- CAN

- caz

- cazuri

- catalog

- lanţ

- Modificări

- taxe

- Alege

- alegere

- Oraș

- Cloud

- cloud big data

- Grup

- cod

- combină

- Companii

- Completă

- Terminat

- complexitate

- Calcula

- legat

- Suport conectare

- Consoleze

- mereu

- conține

- conținut

- Cheltuieli

- crea

- a creat

- creează

- creativitate

- În prezent

- clienţii care

- ultima generație

- de date

- Analiza datelor

- de prelucrare a datelor

- știința datelor

- Baza de date

- seturi de date

- Data

- Mod implicit

- defini

- demonstra

- dependențe

- dislocate

- deriva

- descriere

- proiectat

- detalii

- dezvolta

- Dezvoltare

- diferit

- invalid

- descoperi

- do

- eficient

- efort

- capăt

- Punct final

- Inginerie

- inginerii

- Engleză

- asigura

- Intrați

- intrarea

- Mediu inconjurator

- Eră

- esenţial

- Eter (ETH)

- Chiar

- exemplu

- exemple

- experienţă

- experiment

- explora

- expres

- extrage

- FAST

- DESCRIERE

- puțini

- camp

- Fișier

- final

- First

- Flexibilitate

- Concentra

- urma

- următor

- Pentru

- formare

- Fundație

- patru

- cadre

- din

- complet

- g1

- acumula

- poartă

- genera

- generaţie

- generativ

- AI generativă

- obține

- Oferirea

- Go

- îndrumare

- Avea

- he

- ajutor

- ajutor

- ajută

- Ascuns

- Ascunde

- Cum

- Cum Pentru a

- http

- HTTPS

- i

- IAM

- ICON

- ID

- Identitate

- gestionarea identității și accesului

- ilustrează

- punerea în aplicare a

- import

- in

- În altele

- Inclusiv

- lider în industrie

- informații

- inovatoare

- intrare

- perspective

- instala

- cazuri

- instrucțiuni

- integra

- integrate

- integrare

- destinate

- interacţiona

- interactiv

- intern

- în

- IT

- ESTE

- alăturat

- jpg

- A pastra

- Cheie

- Cunoaște

- lac

- limbă

- mare

- Ultimele

- lansa

- strat

- conducere

- învăţare

- biblioteci

- Bibliotecă

- ca

- Linie

- LINK

- încărca

- maşină

- masina de învățare

- face

- FACE

- gestionate

- administrare

- manual

- Piață

- Mai..

- semnificativ

- ochiurilor de plasă

- minim

- minute

- ML

- model

- Modele

- monitor

- mai mult

- cele mai multe

- nume

- Natural

- Limbajul natural

- Navigare

- necesar

- Nevoie

- necesar

- rețele

- Nou

- Noi tehnologii

- caiet

- notebook-uri

- acum

- număr

- NY

- NYC

- obiecte

- observaţie

- of

- promoții

- on

- deschide

- open-source

- or

- organizații

- Altele

- iesiri

- peste

- Prezentare generală

- pachet

- ofertele

- pâine

- parametrii

- parte

- pasionat

- efectuarea

- permisiuni

- Loc

- Plato

- Informații despre date Platon

- PlatoData

- loc de joaca

- ștecher

- Politicile

- pop-up

- Post

- potenţial

- putere

- practicile

- Anunţ

- Principal

- privat

- proces

- prelucrare

- producere

- Progres

- furniza

- prevăzut

- furnizori

- furnizează

- public

- Piton

- interogări

- întrebare

- Întrebări

- repede

- R

- Citeste

- înregistrări

- reduce

- reducerea

- trimite

- Fără deosebire

- regiune

- regiuni

- scoate

- necesar

- Resurse

- răspuns

- REZULTATE

- plimbari

- Rol

- rolurile

- Traseul

- Alerga

- funcţionare

- ruleaza

- sagemaker

- Scala

- scalabilitate

- scalabil

- Scară

- scalare

- scenarii

- Ştiinţă

- oamenii de stiinta

- sdk

- căutare

- Secret

- securitate

- vedea

- selecta

- senior

- serviciu

- Servicii

- set

- configurarea

- Arăta

- a arătat

- simplu

- simplifica

- singur

- So

- soluţie

- soluţii

- Sursă

- Scânteie

- specialist

- specializata

- viteză

- SQL

- stivui

- Stive

- Începe

- început

- Pornire

- Stare

- Pas

- paşi

- depozitare

- simplu

- studio

- subrețele

- astfel de

- Supraîncărcare

- sigur

- sistem

- tabel

- luate

- ia

- Tehnologii

- Tehnologia

- șablon

- a) Sport and Nutrition Awareness Day in Manasia Around XNUMX people from the rural commune Manasia have participated in a sports and healthy nutrition oriented activity in one of the community’s sports ready yards. This activity was meant to gather, mainly, middle-aged people from a Romanian rural community and teach them about the benefits that sports have on both their mental and physical health and on how sporting activities can be used to bring people from a community closer together. Three trainers were made available for this event, so that the participants would get the best possible experience physically and so that they could have the best access possible to correct information and good sports/nutrition practices. b) Sports Awareness Day in Poiana Țapului A group of young participants have taken part in sporting activities meant to teach them about sporting conduct, fairplay, and safe physical activities. The day culminated with a football match.

- acea

- lor

- Lor

- apoi

- ei

- terț

- acest

- gândit

- Prin

- timp

- cronologie

- gigant

- la

- Unelte

- top

- tradiţional

- ui

- în

- deschide

- actualizat

- URL-ul

- utilizare

- carcasa de utilizare

- utilizat

- Utilizator

- utilizatorii

- utilizări

- folosind

- valoare

- varietate

- diverse

- Fixă

- imagina

- Cale..

- modalități de

- we

- web

- servicii web

- bazat pe web

- cand

- care

- în timp ce

- voi

- cu

- în

- fără

- Apartamente

- de lucru

- fabrică

- la nivel internațional.

- scrie

- scris

- ani

- York

- tu

- Ta

- zephyrnet