În lumea actuală bazată pe date, abilitatea de a muta și analiza fără efort datele pe diverse platforme este esențială. Amazon App Flow, un serviciu de integrare a datelor complet gestionat, a fost în fruntea eficientizării transferului de date între serviciile AWS, aplicațiile software ca serviciu (SaaS) și acum Google BigQuery. În această postare pe blog, explorezi noul Conector Google BigQuery în Amazon AppFlow și descoperă cum simplifică procesul de transfer de date din depozitul de date Google către Serviciul Amazon de stocare simplă (Amazon S3), oferind beneficii semnificative pentru profesioniștii și organizațiile de date, inclusiv democratizarea accesului la date multi-cloud.

Prezentare generală a Amazon AppFlow

Amazon App Flow este un serviciu de integrare complet gestionat pe care îl puteți utiliza pentru a transfera în siguranță date între aplicații SaaS, cum ar fi Google BigQuery, Salesforce, SAP, Hubspot și ServiceNow, și servicii AWS precum Amazon S3 și Amazon RedShift, în doar câteva clicuri. Cu Amazon AppFlow, puteți rula fluxuri de date la aproape orice scară, la frecvența pe care o alegeți, conform unui program, ca răspuns la un eveniment de afaceri sau la cerere. Puteți configura capabilitățile de transformare a datelor, cum ar fi filtrarea și validarea, pentru a genera date bogate, gata de utilizare, ca parte a fluxului în sine, fără pași suplimentari. Amazon AppFlow criptează automat datele în mișcare și vă permite să restricționați fluxul de date prin internetul public pentru aplicațiile SaaS care sunt integrate cu AWS PrivateLink, reducând expunerea la amenințările de securitate.

Vă prezentăm conectorul Google BigQuery

Noul Conector Google BigQuery în Amazon AppFlow dezvăluie posibilități pentru organizațiile care doresc să utilizeze capacitatea analitică a depozitului de date Google și să integreze, să analizeze, să stocheze sau să proceseze în continuare datele din BigQuery fără efort, transformându-le în informații utile.

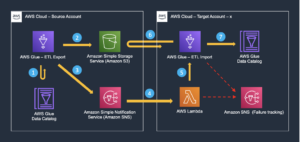

Arhitectură

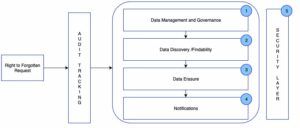

Să revizuim arhitectura pentru a transfera date de la Google BigQuery la Amazon S3 utilizând Amazon AppFlow.

- Selectați o sursă de date: În Amazon App Flow, selectați Google BigQuery ca sursă de date. Specificați tabelele sau seturile de date din care doriți să extrageți date.

- Maparea câmpului și transformarea: configurați transferul de date utilizând interfața vizuală intuitivă a Amazon AppFlow. Puteți mapa câmpuri de date și puteți aplica transformări după cum este necesar pentru a alinia datele cu cerințele dvs.

- Frecvența transferului: decideți cât de des doriți să transferați date, cum ar fi zilnic, săptămânal sau lunar, susținând flexibilitate și automatizare.

- Destinație: specificați un compartiment S3 ca destinație pentru datele dvs. Amazon AppFlow va muta eficient datele, făcându-le accesibile în stocarea dvs. Amazon S3.

- Consum: Utilizare Amazon Atena pentru a analiza datele din Amazon S3.

Cerințe preliminare

Setul de date utilizat în această soluție este generat de Synthea, un simulator sintetic al populației de pacienți și un proiect opensource sub Licență Apache 2.0. Încărcați aceste date în Google BigQuery sau utilizați setul de date existent.

Conectați Amazon AppFlow la contul dvs. Google BigQuery

Pentru această postare, utilizați un cont Google, un client OAuth cu permisiunile corespunzătoare și date Google BigQuery. Pentru a activa accesul Google BigQuery din Amazon AppFlow, trebuie să configurați un nou client OAuth în avans. Pentru instrucțiuni, vezi Conector Google BigQuery pentru Amazon AppFlow.

Configurați Amazon S3

Fiecare obiect din Amazon S3 este stocat într-o găleată. Înainte de a putea stoca date în Amazon S3, trebuie creați o cupă S3 pentru a stoca rezultatele.

Creați un nou compartiment S3 pentru rezultatele Amazon AppFlow

Pentru a crea o găleată S3, parcurgeți următorii pași:

- Pe consola de management AWS pentru Amazon S3, alege Creați găleată.

- Introduceți un unic la nivel global numele găleții tale; de exemplu,

appflow-bq-sample. - Alege Creați o găleată.

Creați un nou bucket S3 pentru rezultatele Amazon Athena

Pentru a crea o găleată S3, parcurgeți următorii pași:

- Pe consola de management AWS pentru Amazon S3, alege Creați găleată.

- Introduceți un unic la nivel global numele găleții tale; de exemplu,

athena-results. - Alege Creați o găleată.

Rol de utilizator (rol IAM) pentru AWS Glue Data Catalog

Pentru a cataloga datele pe care le transferați cu fluxul dvs., trebuie să aveți rolul de utilizator corespunzător AWS Identity and Access Management (IAM). Furnizi acest rol Amazon AppFlow pentru a acorda permisiunile de care are nevoie pentru a crea un Catalogul de date AWS Glue, tabele, baze de date și partiții.

Pentru un exemplu de politică IAM care are permisiunile necesare, consultați Exemple de politici bazate pe identitate pentru Amazon AppFlow.

Descrierea proiectului

Acum, să parcurgem un caz de utilizare practic pentru a vedea cum funcționează conectorul Amazon AppFlow Google BigQuery la Amazon S3. Pentru cazul de utilizare, veți folosi Amazon AppFlow pentru a arhiva datele istorice de la Google BigQuery în Amazon S3 pentru stocarea pe termen lung și analiză.

Configurați Amazon AppFlow

Creați un nou flux Amazon AppFlow pentru a transfera date de la Google Analytics la Amazon S3.

- Pe Consola Amazon AppFlow, alege Creați flux.

- Introduceți un nume pentru fluxul dvs.; de exemplu,

my-bq-flow. - Adăugați necesar Tag-uri; de exemplu, pentru Cheie introduce

envsi pentru Valoare introducedev.

- Alege Pagina Următoare →.

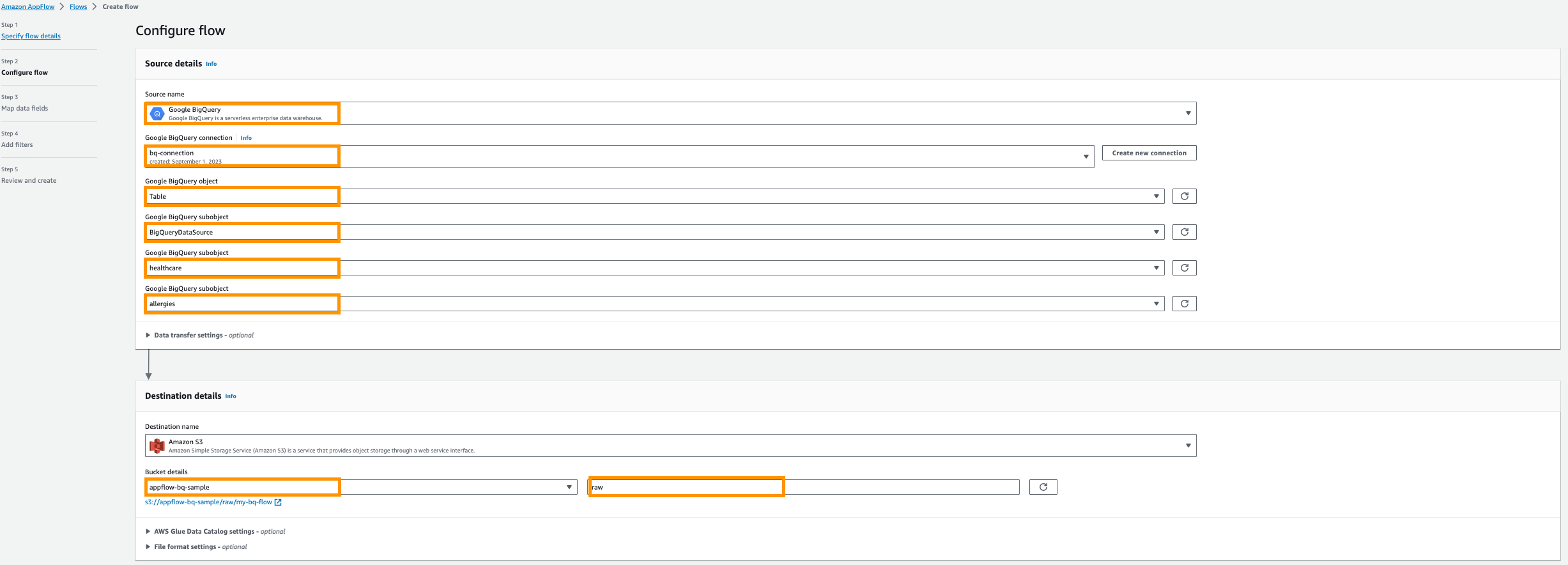

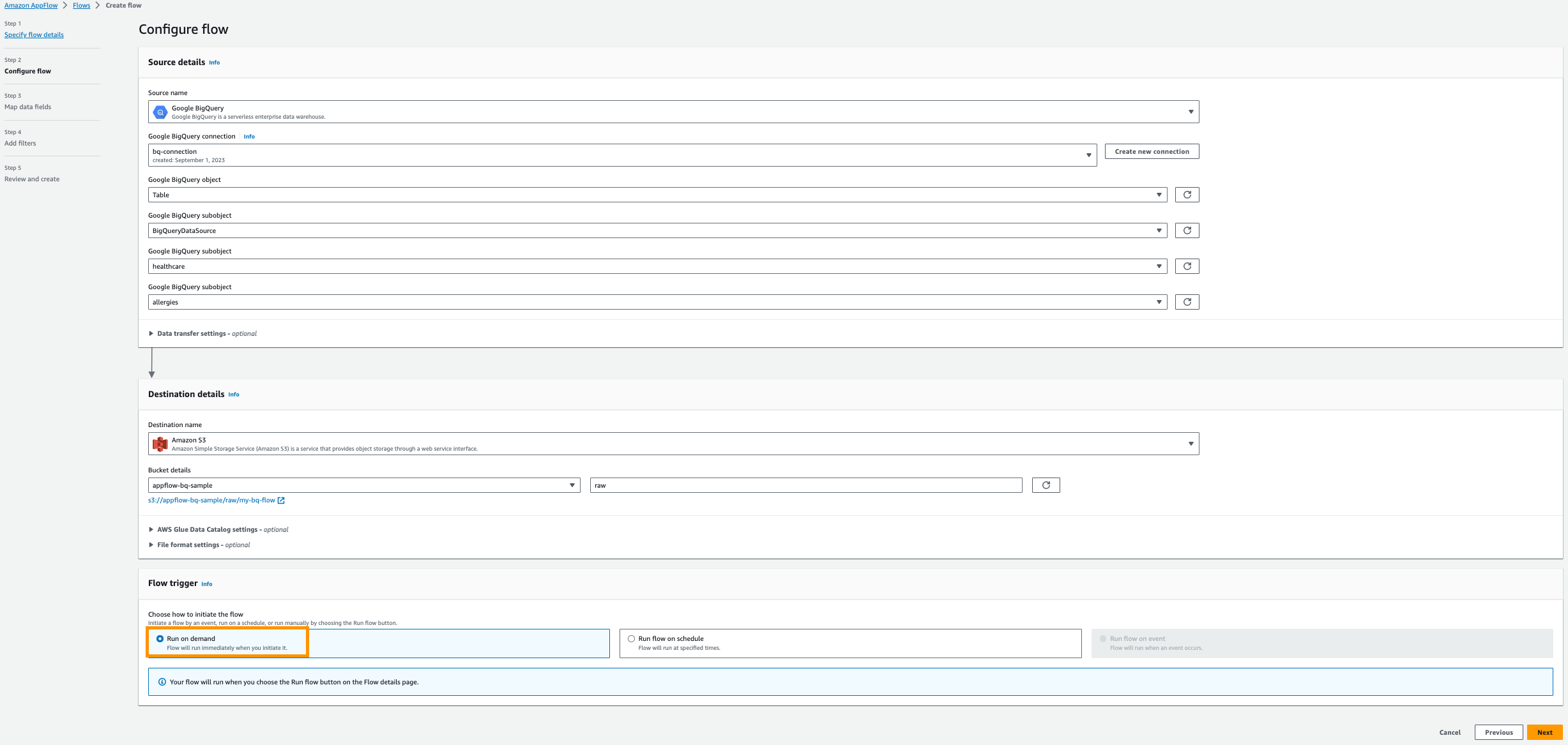

- Pentru Numele sursei, alege Google BigQuery.

- Alege Creați o nouă conexiune.

- Introduceți OAuth-ul dvs ID-ul clientului și Secretul clientului, apoi denumește-ți conexiunea; de exemplu,

bq-connection.

- În fereastra pop-up, alegeți să permiteți accesul amazon.com la API-ul Google BigQuery.

- Pentru Alegeți obiectul Google BigQuery, alege Tabel.

- Pentru Alegeți subobiect Google BigQuery, alege BigQueryProjectName.

- Pentru Alegeți subobiect Google BigQuery, alege Numele bazei de date.

- Pentru Alegeți subobiect Google BigQuery, alege TableName.

- Pentru Numele destinației, alege Amazon S3.

- Pentru Detalii găleată, alegeți compartimentul Amazon S3 pe care l-ați creat pentru stocarea rezultatelor Amazon AppFlow în condițiile preliminare.

- Intrați

rawca o prefix.

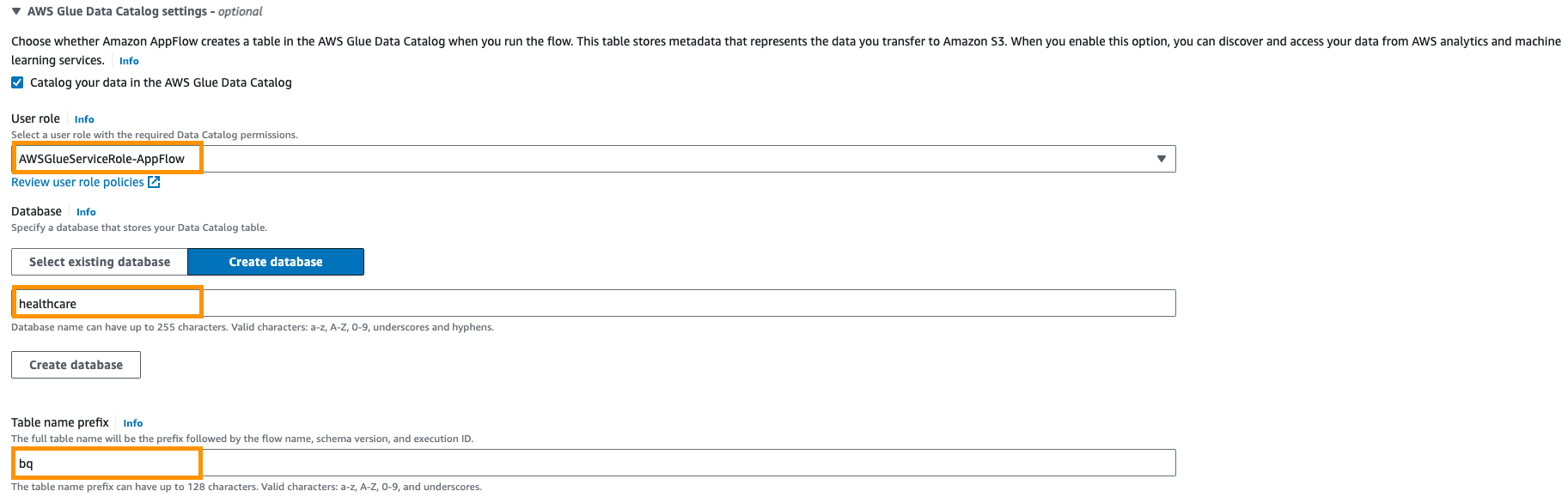

- Apoi, furnizați Catalogul de date AWS Glue setări pentru a crea un tabel pentru analize ulterioare.

- selectaţi Rolul utilizatorului (rol IAM) creat în condițiile prealabile.

- Creaza nou Baza de date de exemplu,

healthcare. - Furnizeaza un prefix de tabel setarea de exemplu,

bq.

- Selectați Fugi la cerere.

- Alege Următorul.

- Selectați Hartați manual câmpurile.

- Selectați următoarele șase câmpuri pentru Numele câmpului sursă din tabelul Alergiile:

- acasă

- Pacient

- Cod

- Descriere

- Tip

- Categorii

- Alege Hartă câmpurile direct.

- Alege Pagina Următoare →.

- In Adăugați filtre secțiune, pentru a alege Pagina Următoare →.

- Alege Creați flux.

Rulați fluxul

După crearea noului flux, îl puteți rula la cerere.

- Pe Consola Amazon AppFlow, alege

my-bq-flow. - Alege Rulați fluxul.

Pentru această prezentare, alegeți executarea sarcinii la cerere pentru ușurință de înțelegere. În practică, puteți alege o lucrare programată și puteți extrage periodic doar date nou adăugate.

Interogați prin Amazon Athena

Când selectați setările opționale AWS Glue Data Catalog, Data Catalog creează catalogul pentru date, permițând Amazon Athena să efectueze interogări.

Dacă vi se solicită să configurați o locație pentru rezultatele interogării, navigați la Setări cont filă și alegeți Administrare. Sub Gestionează setările, alegeți grupul de rezultate Athena creat în condiții preliminare și alegeți Economisiți.

- Pe Consola Amazon Athena, selectați Sursa de date ca

AWSDataCatalog. - Apoi, selectați Baza de date as

healthcare. - Acum puteți selecta tabelul creat de crawler-ul AWS Glue și îl puteți previzualiza.

- De asemenea, puteți rula o interogare personalizată pentru a găsi primele 10 alergii, așa cum se arată în următoarea interogare.

notițe: În interogarea de mai jos, înlocuiți numele tabelului, în acest caz bq_appflow_mybqflow_1693588670_latest, cu numele tabelului generat în contul dvs. AWS.

- Alege Rulați interogarea.

Acest rezultat arată primele 10 alergii după numărul de cazuri.

A curăța

Pentru a evita costurile, curățați resursele din contul dvs. AWS parcurgând următorii pași:

- Pe consola Amazon AppFlow, alegeți fluxurilor în panoul de navigare.

- Din lista de fluxuri, selectați fluxul

my-bq-flow, și ștergeți-l. - Introduceți ștergere pentru a șterge fluxul.

- Alege Conexiuni în panoul de navigare.

- Alege Google BigQuery din lista de conectori, selectați

bq-connector, și ștergeți-l. - Introduceți ștergere pentru a șterge conectorul.

- Pe consola IAM, alegeți Roluri în pagina de navigare, apoi selectați rolul pe care l-ați creat pentru crawlerul AWS Glue și ștergeți-l.

- Pe consola Amazon Athena:

- Ștergeți tabelele create în baza de date

healthcarefolosind crawlerul AWS Glue. - Aruncă baza de date

healthcare

- Ștergeți tabelele create în baza de date

- Pe consola Amazon S3, căutați grupul de rezultate Amazon AppFlow pe care l-ați creat, alegeți Gol pentru a șterge obiectele, apoi ștergeți găleata.

- Pe consola Amazon S3, căutați grupul de rezultate Amazon Athena pe care l-ați creat, alegeți Gol pentru a șterge obiectele, apoi ștergeți găleata.

- Curățați resursele din contul dvs. Google ștergând proiectul care conține resursele Google BigQuery. Urmați documentația pentru curățați resursele Google.

Concluzie

Conectorul Google BigQuery din Amazon AppFlow simplifică procesul de transfer de date din depozitul de date Google către Amazon S3. Această integrare simplifică analiza și învățarea automată, arhivarea și stocarea pe termen lung, oferind beneficii semnificative profesioniștilor de date și organizațiilor care doresc să valorifice capacitățile analitice ale ambelor platforme.

Cu Amazon AppFlow, complexitățile integrării datelor sunt eliminate, permițându-vă să vă concentrați pe obținerea de informații utile din datele dvs. Indiferent dacă arhivați date istorice, efectuați analize complexe sau pregătiți date pentru învățarea automată, acest conector simplifică procesul, făcându-l accesibil unei game mai largi de profesioniști în domeniul datelor.

Dacă sunteți interesat să vedeți cum se transferă date de la Google BigQuery la Amazon S3 utilizând Amazon AppFlow, aruncați o privire pas cu pas tutorial video. În acest tutorial, parcurgem întregul proces, de la configurarea conexiunii până la rularea fluxului de transfer de date. Pentru mai multe informații despre Amazon AppFlow, vizitați Amazon App Flow.

Despre autori

Kartikay Khator este arhitect de soluții în știința globală a vieții la Amazon Web Services. Este pasionat de a ajuta clienții în călătoria lor în cloud, cu accent pe serviciile de analiză AWS. Este un alergător pasionat și îi place drumețiile.

Kartikay Khator este arhitect de soluții în știința globală a vieții la Amazon Web Services. Este pasionat de a ajuta clienții în călătoria lor în cloud, cu accent pe serviciile de analiză AWS. Este un alergător pasionat și îi place drumețiile.

Kamen Sharlandjiev este arhitect senior în soluții Big Data și ETL și expert Amazon AppFlow. El are misiunea de a ușura viața clienților care se confruntă cu provocări complexe de integrare a datelor. Arma lui secretă? Servicii AWS complet gestionate, cu cod redus, care pot face treaba cu efort minim și fără codare.

Kamen Sharlandjiev este arhitect senior în soluții Big Data și ETL și expert Amazon AppFlow. El are misiunea de a ușura viața clienților care se confruntă cu provocări complexe de integrare a datelor. Arma lui secretă? Servicii AWS complet gestionate, cu cod redus, care pot face treaba cu efort minim și fără codare.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/big-data/simplify-data-transfer-google-bigquery-to-amazon-s3-using-amazon-appflow/

- :are

- :este

- $UP

- 10

- 100

- 14

- 16

- 17

- 22

- 321

- 8

- 9

- a

- capacitate

- Despre Noi

- acces

- managementul accesului

- accesibil

- Cont

- peste

- adăuga

- adăugat

- Suplimentar

- avansa

- alinia

- Alergiile

- permite

- Permiterea

- permite

- de asemenea

- Amazon

- Amazon Atena

- Amazon Web Services

- Amazon.com

- an

- analiză

- Analitic

- Google Analytics

- analiza

- și

- Orice

- api

- aplicatii

- Aplică

- adecvat

- arhitectură

- arhivă

- SUNT

- AS

- At

- în mod automat

- Automatizare

- evita

- AWS

- AWS Adeziv

- Consola de administrare AWS

- fost

- înainte

- de mai jos

- Beneficiile

- între

- Mare

- Datele mari

- BigQuery

- Blog

- atât

- mai larg

- afaceri

- by

- CAN

- Poate obține

- capacități

- capacitate

- caz

- cazuri

- catalog

- Categorii

- provocări

- taxe

- Alege

- client

- Cloud

- Codificare

- COM

- Completă

- completarea

- complex

- complexități

- conexiune

- Consoleze

- conține

- tractor pe şenile

- crea

- a creat

- creează

- Crearea

- personalizat

- clienţii care

- zilnic

- de date

- accesul la date

- integrarea datelor

- depozit de date

- Pe bază de date

- Baza de date

- baze de date

- seturi de date

- decide

- Cerere

- democratizare

- descriere

- destinație

- descoperi

- diferit

- documentaţie

- făcut

- uşura

- mai ușor

- eficient

- efort

- efort

- eliminat

- permite

- permițând

- Întreg

- esenţial

- Eter (ETH)

- eveniment

- exemplu

- exemple

- existent

- expert

- explora

- Expunere

- extrage

- cu care se confruntă

- puțini

- camp

- Domenii

- filtrare

- Găsi

- Flexibilitate

- debit

- Curgere

- fluxurilor

- Concentra

- urma

- următor

- Pentru

- frunte

- Frecvență

- frecvent

- din

- complet

- mai mult

- genera

- generată

- obține

- Caritate

- La nivel global

- Google Analytics

- acordarea

- grup

- valorifica

- Avea

- he

- de asistență medicală

- ajutor

- drumeții

- lui

- istoric

- Cum

- HTML

- http

- HTTPS

- HubSpot

- IAM

- Identitate

- gestionarea identității și accesului

- in

- Inclusiv

- informații

- perspective

- instrucțiuni

- integra

- integrate

- integrare

- interesat

- interfaţă

- Internet

- în

- intuitiv

- IT

- în sine

- Loc de munca

- călătorie

- doar

- învăţare

- Licență

- Viaţă

- Știința vieții

- LIMITĂ

- Listă

- încărca

- locaţie

- pe termen lung

- Uite

- maşină

- masina de învățare

- face

- Efectuarea

- gestionate

- administrare

- Hartă

- cartografiere

- minim

- Misiune

- mai mult

- mişcare

- muta

- trebuie sa

- nume

- Navigaţi

- Navigare

- aproape

- necesar

- necesar

- nevoilor

- Nou

- recent

- Nu.

- acum

- număr

- oauth

- obiect

- obiecte

- of

- on

- La cerere

- afară

- sursa deschisa

- or

- comandă

- organizații

- peste

- pagină

- pâine

- parte

- pasionat

- pacient

- efectua

- efectuarea

- permisiuni

- Platforme

- Plato

- Informații despre date Platon

- PlatoData

- Politica

- pop-up

- populație

- posibilităţile de

- Post

- Practic

- practică

- pregătirea

- premise

- Anunţ

- proces

- profesioniști

- proiect

- furniza

- furnizarea

- public

- interogări

- gamă

- reducerea

- înlocui

- necesar

- Cerinţe

- Resurse

- răspuns

- restrânge

- rezultat

- REZULTATE

- revizuiască

- Bogat

- Rol

- Alerga

- alergător

- funcţionare

- SaaS

- Salesforce

- sevă

- Scară

- programa

- programată

- Ştiinţă

- Caută

- Secret

- Secțiune

- în siguranță,

- securitate

- Amenințări la adresa securității

- vedea

- caută

- serviciu

- ServiceNow

- Servicii

- set

- instalare

- setări

- indicat

- Emisiuni

- semnificativ

- simplu

- simplifica

- Simulator

- SIX

- Software

- sistem de operare ca serviciu

- soluţie

- soluţii

- Sursă

- paşi

- depozitare

- stoca

- stocate

- raționalizarea

- astfel de

- sintetic

- tabel

- Lua

- acea

- lor

- apoi

- acest

- amenințări

- Prin

- la

- azi

- top

- Top 10

- transfer

- transferare

- Transformare

- transformări

- transformare

- tutorial

- tip

- în

- înţelegere

- unic

- dezvăluie

- utilizare

- carcasa de utilizare

- utilizat

- Utilizator

- folosind

- validare

- valoare

- Vizita

- umbla

- walkthrough

- vrea

- Depozit

- we

- web

- servicii web

- săptămânal

- dacă

- OMS

- voi

- fereastră

- cu

- fără

- fabrică

- lume

- tu

- Ta

- youtube

- zephyrnet