Intrebari cu cheie

- Propagarea gândirii (TP) este o metodă nouă care îmbunătățește abilitățile complexe de raționament ale modelelor de limbaj mari (LLM).

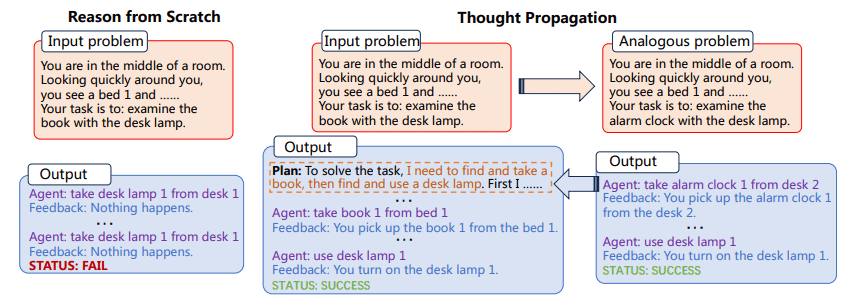

- TP folosește probleme similare și soluțiile acestora pentru a îmbunătăți raționamentul, mai degrabă decât să facă LLM-urile să raționeze de la zero.

- Experimentele din diverse sarcini arată că TP depășește substanțial metodele de bază, cu îmbunătățiri variind de la 12% la 15%.

TP solicită mai întâi LLM-urilor să propună și să rezolve un set de probleme analoge care sunt legate de cea de intrare. Apoi, TP reutiliza rezultatele unor probleme analoge pentru a obține direct o nouă soluție sau pentru a deriva un plan de execuție cu cunoștințe intensive pentru a modifica soluția inițială obținută de la zero.

Versatilitatea și puterea de calcul a modelelor de limbaj mari (LLM) sunt incontestabile, dar nu sunt fără limită. Una dintre cele mai semnificative și mai consistente provocări pentru LLM este abordarea lor generală în rezolvarea problemelor, constând în raționamentul de la primele principii pentru fiecare sarcină nouă întâlnită. Acest lucru este problematic, deoarece permite un grad ridicat de adaptabilitate, dar crește și probabilitatea de erori, în special în sarcinile care necesită un raționament în mai mulți pași.

Provocarea „raționării de la zero” este mai ales pronunțată în sarcinile complexe care necesită mai mulți pași de logică și inferență. De exemplu, dacă unui LLM i se cere să găsească calea cea mai scurtă într-o rețea de puncte interconectate, de obicei nu ar folosi cunoștințele anterioare sau probleme similare pentru a găsi o soluție. În schimb, ar încerca să rezolve problema în mod izolat, ceea ce poate duce la rezultate suboptime sau chiar la erori. introduce Propagarea Gândului (TP), o metodă concepută pentru a spori capacitățile de raționament ale LLM-urilor. TP își propune să depășească limitele inerente ale LLM-urilor, permițându-le să tragă dintr-un rezervor de probleme analoge și soluțiile lor corespunzătoare. Această abordare inovatoare nu numai că îmbunătățește acuratețea soluțiilor generate de LLM, dar le îmbunătățește semnificativ și capacitatea de a aborda sarcini complexe de raționament în mai mulți pași. Prin valorificarea puterii analogiei, TP oferă un cadru care amplifică capacitățile de raționament înnăscute ale LLM-urilor, aducându-ne cu un pas mai aproape de realizarea unor sisteme artificiale cu adevărat inteligente.

Propagarea gândirii implică doi pași principali:

- În primul rând, LLM este îndemnat să propună și să rezolve un set de probleme analoge legate de problema de intrare

- În continuare, soluțiile la aceste probleme analoge sunt folosite fie pentru a obține direct o nouă soluție, fie pentru a modifica soluția inițială

Procesul de identificare a problemelor analoge permite LLM să refolosească strategiile și soluțiile de rezolvare a problemelor, îmbunătățindu-și astfel abilitățile de raționament. TP este compatibil cu metodele de solicitare existente, oferind o soluție generalizabilă care poate fi încorporată în diferite sarcini fără o inginerie semnificativă specifică sarcinii.

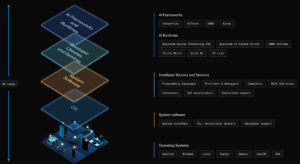

Figura 1: Procesul de propagare a gândirii (Imagine de pe hârtie)

Mai mult, adaptabilitatea TP nu trebuie subestimată. Compatibilitatea sa cu metodele de solicitare existente îl face un instrument extrem de versatil. Aceasta înseamnă că TP nu se limitează la niciun fel specific de domeniu de rezolvare a problemelor. Acest lucru deschide căi interesante pentru reglarea fină și optimizarea specifice sarcinii, crescând astfel utilitatea și eficacitatea LLM-urilor într-un spectru larg de aplicații.

Implementarea Thought Propagation poate fi integrată în fluxul de lucru al LLM-urilor existente. De exemplu, într-o sarcină de raționament pe calea cea mai scurtă, TP ar putea mai întâi să rezolve un set de probleme mai simple, analoge, pentru a înțelege diferite căi posibile. Apoi, ar folosi aceste informații pentru a rezolva problema complexă, crescând astfel probabilitatea de a găsi soluția optimă.

Exemplu 1

- Sarcină: Raționamentul pe calea cea mai scurtă

- Probleme analoge: Cea mai scurtă cale între punctele A și B, cea mai scurtă cale între punctele B și C

- Soluție finală: Calea optimă de la punctul A la C având în vedere soluțiile problemelor analoge

Exemplu 2

- Sarcină: Scriere creativa

- Probleme analoge: Scrie o poveste scurtă despre prietenie, Scrie o poveste scurtă despre încredere

- Soluție finală: Scrieți o nuvelă complexă care integrează teme de prietenie și încredere

Procesul implică mai întâi rezolvarea acestor probleme similare și apoi utilizarea informațiilor obținute pentru a aborda sarcina complexă la îndemână. Această metodă și-a demonstrat eficacitatea în mai multe sarcini, prezentând îmbunătățiri substanțiale ale valorilor de performanță.

Implicațiile de propagare a gândirii merg dincolo de simpla îmbunătățire a valorilor existente. Această tehnică de promptare are potențialul de a modifica modul în care înțelegem și implementăm LLM-urile. Metodologia subliniază o trecere de la rezolvarea izolată, atomică a problemelor, către o abordare mai holistică, interconectată. Ne îndeamnă să luăm în considerare modul în care LLM-urile pot învăța nu doar din date, ci și din procesul în sine de rezolvare a problemelor. Prin actualizarea continuă a înțelegerii prin soluțiile la probleme similare, LLM-urile echipate cu TP sunt mai bine pregătite pentru a face față provocărilor neprevăzute, făcându-le mai rezistente și adaptabile în medii cu evoluție rapidă.

Thought Propagation este un plus promițător la setul de instrumente al metodelor de promptare care vizează îmbunătățirea capacităților LLM-urilor. Permițând LLM-urilor să folosească probleme similare și soluțiile acestora, TP oferă o metodă de raționament mai nuanțată și mai eficientă. Experimentele confirmă eficacitatea acestuia, făcându-l o strategie candidată pentru îmbunătățirea performanței LLM într-o varietate de sarcini. TP poate reprezenta în cele din urmă un pas semnificativ înainte în căutarea unor sisteme AI mai capabile.

Matthew Mayo (@mattmayo13) deține o diplomă de master în informatică și o diplomă de licență în data mining. În calitate de redactor-șef al KDnuggets, Matthew își propune să facă accesibile concepte complexe de știință a datelor. Interesele sale profesionale includ procesarea limbajului natural, algoritmii de învățare automată și explorarea AI emergente. El este condus de misiunea de a democratiza cunoștințele în comunitatea științei datelor. Matthew face coduri de la vârsta de 6 ani.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://www.kdnuggets.com/thought-propagation-an-analogical-approach-to-complex-reasoning-with-large-language-models?utm_source=rss&utm_medium=rss&utm_campaign=thought-propagation-an-analogical-approach-to-complex-reasoning-with-large-language-models

- :are

- :este

- :nu

- $UP

- 15%

- 8

- a

- abilități

- capacitate

- Despre Noi

- accesibil

- precizie

- peste

- plus

- AI

- Sisteme AI

- vizează

- isi propune

- algoritmi

- Permiterea

- permite

- de asemenea

- amplifică

- an

- și

- Orice

- aplicatii

- abordare

- SUNT

- artificial

- AS

- At

- încercare

- spori

- căi

- b

- De bază

- BE

- fost

- Mai bine

- între

- Dincolo de

- Aducere

- larg

- dar

- by

- CAN

- candidat

- capacități

- capabil

- contesta

- provocări

- mai aproape

- Codificare

- comunitate

- compatibilitate

- compatibil

- complex

- de calcul

- puterea de calcul

- calculator

- Informatică

- Concepte

- Confirma

- Lua în considerare

- luand in considerare

- consistent

- Constând

- continuu

- Corespunzător

- ar putea

- Creator

- de date

- data mining

- știința datelor

- Grad

- Cerere

- democratiza

- demonstrat

- implementa

- proiectat

- direct

- domeniu

- a desena

- condus

- redactor șef

- Eficace

- eficacitate

- eficacitate

- oricare

- înălțător

- șmirghel

- Inginerie

- Îmbunătăţeşte

- consolidarea

- Intrați

- medii

- echipat

- Erori

- mai ales

- Chiar

- Fiecare

- evoluție

- exemplu

- captivant

- execuție

- existent

- experimente

- Explorarea

- Găsi

- descoperire

- First

- Pentru

- Înainte

- Cadru

- Prietenie

- din

- dobândită

- General

- Go

- absolvent

- mână

- he

- Înalt

- extrem de

- lui

- deține

- holistică

- Cum

- HTTPS

- identificarea

- if

- imagine

- implementarea

- implicații

- îmbunătăţi

- îmbunătățiri

- îmbunătăţeşte

- îmbunătățirea

- in

- include

- Incorporated

- Creșteri

- crescând

- inerent

- inițială

- înnăscut

- inovatoare

- intrare

- perspective

- in schimb

- integrate

- integreaza

- Inteligent

- interconectate

- interese

- în

- implică

- izolat

- izolare

- IT

- ESTE

- în sine

- jpg

- doar

- KDnuggets

- Copil

- cunoştinţe

- limbă

- mare

- conduce

- AFLAȚI

- învăţare

- Pârghie

- pîrghii

- efectului de pârghie

- probabilitate

- LIMITĂ

- limitări

- Limitat

- logică

- maşină

- masina de învățare

- Principal

- face

- FACE

- Efectuarea

- maestru

- Matthew

- Mai..

- mijloace

- pur și simplu

- metodă

- Metodologie

- Metode

- Metrici

- Minerit

- Misiune

- Modele

- mai mult

- cele mai multe

- multiplu

- Natural

- Limbajul natural

- Procesarea limbajului natural

- reţea

- Nou

- soluție nouă

- roman

- obținut

- of

- Vechi

- on

- ONE

- afară

- deschide

- optimă

- optimizare

- or

- surclasează

- direct

- Învinge

- Hârtie

- în special

- cale

- performanță

- plan

- Plato

- Informații despre date Platon

- PlatoData

- Punct

- puncte

- posibil

- potenţial

- putere

- pregătit

- Principiile

- anterior

- Problemă

- de rezolvare a problemelor

- probleme

- proces

- prelucrare

- profesional

- promițător

- pronunţat

- propagare

- propune

- furnizează

- furnizarea

- variind

- repede

- mai degraba

- realizare

- motiv

- legate de

- tencuială

- reprezenta

- necesita

- elastic

- REZULTATE

- reutilizarea

- s

- Ştiinţă

- zgâria

- Caută

- set

- schimbare

- Pantaloni scurți

- să

- Arăta

- simbolizeazã

- semnificativ

- semnificativ

- întrucât

- soluţie

- soluţii

- REZOLVAREA

- Rezolvarea

- specific

- Spectru

- Pas

- paşi

- Poveste

- strategii

- Strategie

- substanțial

- substanţial

- sisteme

- aborda

- Sarcină

- sarcini

- tehnică

- decât

- acea

- lor

- Lor

- tematică

- apoi

- astfel

- Acestea

- ei

- acest

- gândit

- Prin

- la

- instrument

- Toolbox

- față de

- tp

- cu adevărat

- Încredere

- Două

- tipic

- în cele din urmă

- netăgăduit

- subliniere

- înţelege

- înţelegere

- neprevăzut

- actualizarea

- us

- utilizare

- utilizat

- folosind

- utilitate

- varietate

- diverse

- multilateral

- versatilitate

- a fost

- we

- care

- cu

- fără

- flux de lucru

- ar

- scrie

- scris

- ani

- încă

- Randament

- zephyrnet