Aplicațiile de inteligență artificială generativă (AI) construite în jurul modelelor de limbaj mari (LLM) au demonstrat potențialul de a crea și de a accelera valoare economică pentru afaceri. Exemple de aplicații includ căutare conversațională, asistență agent de asistență clienți, analize de asistență pentru clienți, asistenți virtuali cu autoservire, chatbots, generație rich media, moderarea conținutului, însoțitori de codare pentru a accelera dezvoltarea software sigură și de înaltă performanță, perspective mai profunde din surse de conținut multimodal, accelerarea investigațiilor și atenuărilor de securitate ale organizației dvs., și mult mai mult. Mulți clienți caută îndrumări despre cum să gestioneze securitatea, confidențialitatea și conformitatea pe măsură ce dezvoltă aplicații AI generative. Înțelegerea și abordarea vulnerabilităților, amenințărilor și riscurilor LLM în timpul fazelor de proiectare și arhitectură ajută echipele să se concentreze pe maximizarea beneficiilor economice și de productivitate pe care IA generativă le poate aduce. Conștientizarea riscurilor încurajează transparența și încrederea în aplicațiile AI generative, încurajează o observabilitate sporită, ajută la îndeplinirea cerințelor de conformitate și facilitează luarea deciziilor informate de către lideri.

Scopul acestei postări este de a împuternici inginerii AI și învățare automată (ML), oamenii de știință în date, arhitecții de soluții, echipele de securitate și alte părți interesate să aibă un model mental și un cadru comun pentru a aplica cele mai bune practici de securitate, permițând echipelor AI/ML să se miște rapid, fără a schimba securitatea cu viteza. În mod specific, această postare încearcă să ajute oamenii de știință în domeniul AI/ML și al datelor care nu au avut o expunere anterioară la principiile de securitate să înțeleagă cele mai bune practici de bază de securitate și confidențialitate în contextul dezvoltării de aplicații AI generative folosind LLM-uri. De asemenea, discutăm despre preocupările comune de securitate care pot submina încrederea în AI, așa cum sunt identificate de Deschideți Proiectul mondial de securitate a aplicațiilor (OWASP) Top 10 pentru aplicații LLMși arătați modalități prin care puteți utiliza AWS pentru a vă crește gradul de securitate și încrederea în timp ce inovăm cu IA generativă.

Această postare oferă trei pași ghidați pentru a crea strategii de gestionare a riscurilor în timp ce se dezvoltă aplicații AI generative folosind LLM-uri. În primul rând, analizăm vulnerabilitățile, amenințările și riscurile care apar din implementarea, implementarea și utilizarea soluțiilor LLM și oferim îndrumări despre cum să începem să inovăm având în vedere securitatea. Apoi discutăm despre modul în care construirea pe o fundație sigură este esențială pentru IA generativă. În cele din urmă, le conectăm împreună cu un exemplu de sarcină de lucru LLM pentru a descrie o abordare a arhitecturii cu securitate de apărare în profunzime peste granițele de încredere.

Până la sfârșitul acestei postări, Inginerii AI/ML, oamenii de știință de date și tehnologii care se ocupă de securitate vor fi capabili să identifice strategii de arhitectură a apărării stratificate pentru aplicațiile lor generative AI, să înțeleagă cum să mapați OWASP Top 10 pentru preocupările de securitate LLM cu unele controale corespunzătoare și să construiască cunoștințe fundamentale pentru răspunzând la următoarele teme de top întrebări ale clienților AWS pentru aplicațiile lor:

- Care sunt unele dintre riscurile comune de securitate și confidențialitate legate de utilizarea AI generativă bazată pe LLM în aplicațiile mele pe care le pot afecta cel mai mult cu acest ghid?

- Care sunt câteva modalități de implementare a controalelor de securitate și confidențialitate în ciclul de viață al dezvoltării pentru aplicațiile generative AI LLM pe AWS?

- Ce bune practici operaționale și tehnice pot să integrez în modul în care organizația mea creează aplicații generative AI LLM pentru a gestiona riscurile și pentru a crește încrederea în aplicațiile generative AI folosind LLM-uri?

Îmbunătățiți rezultatele securității în timp ce dezvoltați IA generativă

Inovarea cu IA generativă care utilizează LLM-uri necesită să începem cu securitatea în minte pentru a dezvolta rezistența organizațională, a construi pe o bază sigură și a integra securitatea cu o abordare de securitate în profunzime. Securitatea este o responsabilitate comună între AWS și clienții AWS. Toate principiile modelului de responsabilitate partajată AWS sunt aplicabile soluțiilor AI generative. Reîmprospătați-vă înțelegerea despre Modelul de responsabilitate partajată AWS, așa cum se aplică infrastructurii, serviciilor și datelor atunci când construiți soluții LLM.

Începeți cu securitatea în minte pentru a dezvolta rezistența organizațională

Începeți cu securitatea în minte pentru a dezvolta rezistența organizațională pentru dezvoltarea de aplicații AI generative care să vă îndeplinească obiectivele de securitate și conformitate. Reziliența organizațională se bazează pe și extinde definiția rezilienței în cadrul AWS Well-Architected Framework să includă și să se pregătească pentru capacitatea unei organizații de a se recupera după întreruperi. Luați în considerare postura dvs. de securitate, guvernanța și excelența operațională atunci când evaluați pregătirea generală de a dezvolta IA generativă cu LLM și reziliența organizațională la orice impact potențial. Pe măsură ce organizația dvs. avansează în utilizarea tehnologiilor emergente, cum ar fi IA generativă și LLM, reziliența organizațională generală ar trebui să fie considerată o piatră de temelie a unei strategii defensive pentru a proteja activele și liniile de afaceri de consecințe nedorite.

Reziliența organizațională contează în mod substanțial pentru aplicațiile LLM

Deși toate programele de management al riscului pot beneficia de rezistență, rezistența organizațională contează substanțial pentru IA generativă. Cinci dintre primele 10 riscuri identificate de OWASP pentru aplicațiile LLM se bazează pe definirea controalelor arhitecturale și operaționale și aplicarea acestora la scară organizațională pentru a gestiona riscul. Aceste cinci riscuri sunt gestionarea nesigură a producției, vulnerabilitățile lanțului de aprovizionare, dezvăluirea de informații sensibile, agenție excesivă și încrederea excesivă. Începeți să creșteți rezistența organizațională prin socializarea echipelor pentru a considera AI, ML și securitatea AI generativă o cerință de bază de afaceri și o prioritate de top pe tot parcursul ciclului de viață al produsului, de la începutul ideii, până la cercetare, până la dezvoltarea, implementarea și implementarea aplicației. utilizare. Pe lângă conștientizare, echipele dvs. ar trebui să ia măsuri pentru a lua în considerare IA generativă în practicile de guvernare, asigurare și validare a conformității.

Construiți rezistența organizațională în jurul inteligenței artificiale generative

Organizațiile pot începe să adopte modalități de a-și dezvolta capacitatea și capacitățile pentru AI/ML și securitatea AI generativă în cadrul organizațiilor lor. Ar trebui să începeți prin a vă extinde programele existente de securitate, asigurare, conformitate și dezvoltare pentru a ține cont de IA generativă.

Următoarele sunt cele cinci domenii cheie de interes pentru securitatea AI organizațională, ML și AI generativă:

- Înțelegeți peisajul de securitate AI/ML

- Includeți diverse perspective în strategiile de securitate

- Luați măsuri proactiv pentru asigurarea activităților de cercetare și dezvoltare

- Aliniați stimulentele cu rezultatele organizaționale

- Pregătiți-vă pentru scenarii de securitate realiste în AI/ML și AI generativă

Dezvoltați un model de amenințare pe tot parcursul ciclului dvs. de viață generativ AI

Organizațiile care construiesc cu IA generativă ar trebui să se concentreze pe managementul riscurilor, nu pe eliminarea riscurilor și să includă modelarea amenințărilor in si planificarea continuitatii afacerii planificarea, dezvoltarea și operațiunile sarcinilor de lucru AI generative. Lucrați înapoi de la utilizarea în producție a IA generativă prin dezvoltarea unui model de amenințare pentru fiecare aplicație, utilizând riscurile tradiționale de securitate, precum și riscurile specifice AI generative. Unele riscuri pot fi acceptabile pentru afacerea dvs., iar un exercițiu de modelare a amenințărilor vă poate ajuta compania să identifice care este apetitul dvs. acceptabil pentru risc. De exemplu, este posibil ca afacerea dvs. să nu necesite un timp de funcționare de 99.999% pentru o aplicație AI generativă, astfel încât timpul suplimentar de recuperare asociat recuperării utilizând AWS Backup cu Ghețarul Amazon S3 poate fi un risc acceptabil. În schimb, datele din modelul dvs. pot fi extrem de sensibile și foarte reglementate, deci abaterea de la AWS Service Management Service (AWS KMS) cheie gestionată de client (CMK) rotație și utilizare a Firewall de rețea AWS pentru a ajuta la aplicarea Transport Layer Security (TLS) pentru traficul de intrare și ieșire pentru a proteja împotriva exfiltrării datelor poate fi un risc inacceptabil.

Evaluați riscurile (inerente vs. reziduale) ale utilizării aplicației AI generative într-un cadru de producție pentru a identifica controalele fundamentale și la nivel de aplicație potrivite. Planificați derularea și recuperarea de la evenimentele de securitate de producție și întreruperile serviciului, cum ar fi injectarea promptă, otrăvirea datelor de antrenament, refuzul serviciului de model și furtul modelului de la început și definiți atenuările pe care le veți utiliza pe măsură ce definiți cerințele aplicației. Aflarea despre riscurile și controalele care trebuie puse în aplicare va ajuta la definirea celei mai bune abordări de implementare pentru construirea unei aplicații AI generative și va oferi părților interesate și factorilor de decizie informații pentru a lua decizii de afaceri informate cu privire la risc. Dacă nu sunteți familiarizat cu fluxul general de lucru AI și ML, începeți prin a revizui 7 moduri de a îmbunătăți securitatea sarcinilor de lucru de învățare automată pentru a crește familiaritatea cu controalele de securitate necesare pentru sistemele tradiționale AI/ML.

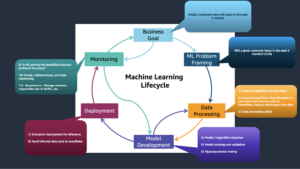

La fel ca construirea oricărei aplicații ML, construirea unei aplicații AI generative implică parcurgerea unui set de etape ale ciclului de viață de cercetare și dezvoltare. Poate doriți să revizuiți AWS Generative AI Security Scoping Matrix pentru a ajuta la construirea unui model mental pentru a înțelege disciplinele cheie de securitate pe care ar trebui să le luați în considerare în funcție de soluția generativă AI pe care o alegeți.

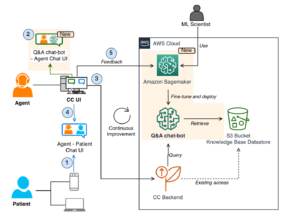

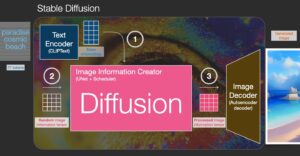

Aplicațiile generative de inteligență artificială care utilizează LLM sunt de obicei dezvoltate și operate urmând pași ordonați:

- Cerințe de aplicare – Identificați obiectivele, cerințele și criteriile de succes ale cazurilor de utilizare

- Selectarea modelului – Selectați un model de fundație care se aliniază cu cerințele cazului de utilizare

- Adaptarea modelului și reglajul fin – Pregătiți datele, solicitările inginerului și ajustați modelul

- Evaluarea modelului – Evaluați modelele de fundație cu valori specifice cazului de utilizare și selectați modelul cu cele mai bune performanțe

- Implementare și integrare – Implementați modelul de bază selectat pe infrastructura dvs. optimizată și integrați-l cu aplicația dvs. generativă AI

- Monitorizarea aplicației – Monitorizați performanța aplicației și a modelului pentru a permite analiza cauzei principale

Asigurați-vă că echipele înțeleg natura critică a securității ca parte a fazelor de proiectare și arhitectură ale ciclului de viață de dezvoltare a software-ului în Ziua 1. Aceasta înseamnă să discutați despre securitate la fiecare nivel al stivei și ciclului de viață și să poziționați securitatea și confidențialitatea ca factori care permit atingerea obiectivelor de afaceri. Arhitectul controlează amenințările înainte de a lansa aplicația LLM și luați în considerare dacă datele și informațiile pe care le veți utiliza pentru adaptarea modelului și reglarea fină garantează controlul implementării în mediile de cercetare, dezvoltare și formare. Ca parte a testelor de asigurare a calității, introduceți amenințări sintetice de securitate (cum ar fi încercarea de a otrăvi datele de antrenament sau încercarea de a extrage date sensibile prin inginerie promptă rău intenționată) pentru a vă testa în mod regulat apărarea și postura de securitate.

În plus, părțile interesate ar trebui să stabilească o cadență de revizuire consecventă pentru sarcinile de lucru AI de producție, ML și AI generativă și să stabilească prioritatea organizațională pentru înțelegerea compromisurilor dintre controlul uman și mașină și eroare înainte de lansare. Validarea și asigurarea că aceste compromisuri sunt respectate în aplicațiile LLM implementate va crește probabilitatea de succes a reducerii riscurilor.

Creați aplicații AI generative pe fundații cloud securizate

La AWS, securitatea este prioritatea noastră principală. AWS este proiectat pentru a fi cea mai sigură infrastructură cloud globală pe care să construiți, să migrați și să gestionați aplicațiile și sarcinile de lucru. Acest lucru este susținut de setul nostru profund de peste 300 de instrumente de securitate în cloud și de încrederea milioanelor noștri de clienți, inclusiv organizațiile cele mai sensibile la securitate, cum ar fi serviciile guvernamentale, de asistență medicală și financiare. Când construiți aplicații AI generative folosind LLM-uri pe AWS, obțineți beneficii de securitate din mediu de calcul în cloud AWS sigur, fiabil și flexibil.

Utilizați o infrastructură globală AWS pentru securitate, confidențialitate și conformitate

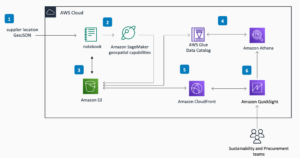

Atunci când dezvoltați aplicații cu consum mare de date pe AWS, puteți beneficia de o infrastructură regională globală AWS, proiectată pentru a oferi capabilități care să vă satisfacă cerințele principale de securitate și conformitate. Acest lucru este întărit de noastre Angajamentul de suveranitate digitală AWS, angajamentul nostru de a vă oferi cel mai avansat set de controale și funcții de suveranitate disponibile în cloud. Ne angajăm să ne extindem capacitățile pentru a vă permite să vă îndepliniți suveranitatea digitală nevoilor, fără a compromite performanța, inovația, securitatea sau amploarea AWS Cloud. Pentru a simplifica implementarea celor mai bune practici de securitate și confidențialitate, luați în considerare utilizarea proiectelor de referință și a infrastructurii ca resurse de cod, cum ar fi Arhitectura de referință de securitate AWS (AWS SRA) si Arhitectura de referință pentru confidențialitate AWS (AWS PRA). Citiți mai multe despre proiectarea soluțiilor de confidențialitate, suveranitatea prin proiect, și conformitatea pe AWS și folosiți servicii precum Configurare AWS, Artefact AWS, și Manager de audit AWS pentru a vă sprijini nevoile de confidențialitate, conformitate, audit și observabilitate.

Înțelegeți-vă postura de securitate utilizând cadrele AWS Well-Architected și Cloud Adoption Frameworks

AWS oferă îndrumări despre cele mai bune practici dezvoltate din anii de experiență în sprijinirea clienților în arhitectura mediilor lor cloud cu Cadru bine arhitecturat AWS și în evoluția pentru a realiza valoarea afacerii din tehnologiile cloud cu AWS Cloud Adoption Framework (AWS CAF). Înțelegeți postura de securitate a sarcinilor dvs. de lucru AI, ML și AI generativă, efectuând o revizuire a cadrului bine arhitecturat. Evaluările pot fi efectuate folosind instrumente precum Instrument AWS bine arhitecturat, sau cu ajutorul echipei dvs. AWS prin intermediul Asistență AWS Enterprise. Instrumentul AWS bine arhitecturat integrează automat informații din Consilier de încredere AWS pentru a evalua ce bune practici există și ce oportunități există pentru a îmbunătăți funcționalitatea și optimizarea costurilor. Instrumentul AWS Well-Architected oferă, de asemenea, lentile personalizate cu bune practici specifice, cum ar fi Lentila de învățare automată pentru a vă măsura în mod regulat arhitecturile în raport cu cele mai bune practici și pentru a identifica zonele de îmbunătățire. Verificați-vă călătoria pe calea spre realizarea valorii și maturitatea în cloud, prin înțelegerea modului în care clienții AWS adoptă strategii pentru a dezvolta capabilități organizaționale în AWS Cloud Adoption Framework pentru inteligență artificială, învățare automată și IA generativă. De asemenea, s-ar putea să găsiți beneficii în înțelegerea gradului de pregătire global pentru cloud participând la un AWS Cloud Readiness Assessment. AWS oferă oportunități suplimentare de implicare — cereți echipei dvs. de cont AWS mai multe informații despre cum să începeți cu Centrul de inovare generativ AI.

Accelerați-vă securitatea și învățarea AI/ML cu îndrumări, instruire și certificare privind cele mai bune practici

AWS organizează, de asemenea, recomandări de la Cele mai bune practici pentru securitate, identitate și conformitate și Documentație de securitate AWS pentru a vă ajuta să identificați modalități de a vă asigura mediile de formare, dezvoltare, testare și operaționale. Dacă abia ați început, aprofundați instruirea și certificarea în domeniul securității, luați în considerare să începeți cu Noțiuni fundamentale de securitate AWS si Planul de învățare privind securitatea AWS. Puteți utiliza, de asemenea, Modelul de maturitate de securitate AWS pentru a vă ajuta să găsiți și să prioritizați cele mai bune activități în diferite faze de maturitate pe AWS, începând cu câștiguri rapide, prin etape fundamentale, eficiente și optimizate. După ce dvs. și echipele dvs. aveți o înțelegere de bază a securității pe AWS, vă recomandăm insistent să o revizuiți Cum să abordați modelarea amenințărilor și apoi conduceți un exercițiu de modelare a amenințărilor cu echipele dvs., începând cu Atelierul de modelare a amenințărilor pentru constructori program de antrenament. Sunt multe altele Resurse de instruire și certificare AWS Security disponibile.

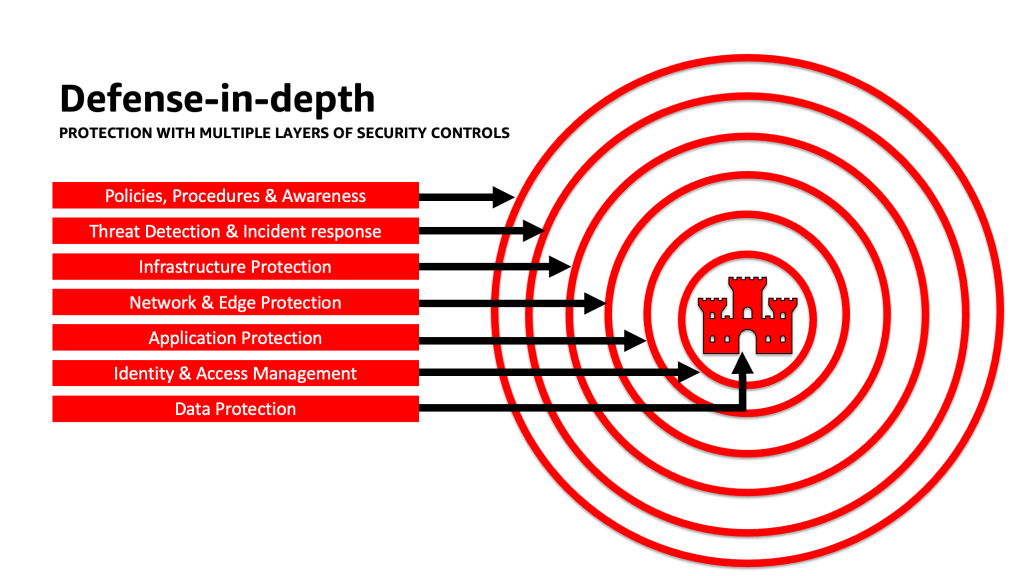

Aplicați o abordare de apărare în profunzime pentru a securiza aplicațiile LLM

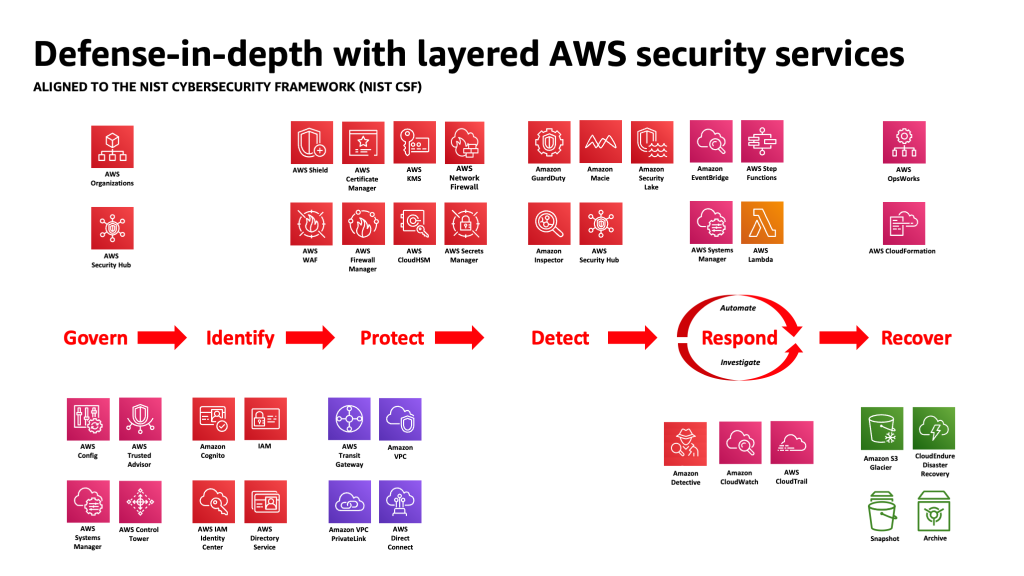

Aplicarea unei abordări de securitate de apărare în profunzime la sarcinile de lucru, datele și informațiile dvs. generative de AI poate ajuta la crearea celor mai bune condiții pentru a vă atinge obiectivele de afaceri. Cele mai bune practici de securitate de apărare în profunzime atenuează multe dintre riscurile comune cu care se confruntă orice sarcină de lucru, ajutându-vă și echipele să vă accelerați inovația generativă AI. O strategie de securitate de apărare în profunzime utilizează mai multe apărări redundante pentru a vă proteja conturile, încărcăturile de lucru, datele și activele dvs. AWS. Vă ajută să vă asigurați că, în cazul în care un control de securitate este compromis sau eșuează, există straturi suplimentare pentru a ajuta la izolarea amenințărilor și pentru a preveni, detecta, răspunde și recupera din evenimentele de securitate. Puteți utiliza o combinație de strategii, inclusiv servicii și soluții AWS, la fiecare nivel pentru a îmbunătăți securitatea și reziliența sarcinilor dvs. de lucru AI generative.

Mulți clienți AWS se aliniază la cadrele standard din industrie, cum ar fi Cadrul NIS pentru securitate cibernetică. Acest cadru vă ajută să vă asigurați că apărările dvs. de securitate au protecție pe pilonii Identificare, Protejare, Detectare, Răspuns, Recuperare și, cel mai recent adăugat, Guvernare. Acest cadru se poate mapa apoi cu ușurință la serviciile de securitate AWS și la cele de la terțe părți integrate, pentru a vă ajuta să validați acoperirea și politicile adecvate pentru orice eveniment de securitate pe care organizația dvs. îl întâlnește.

Apărare în profunzime: securizați-vă mediul, apoi adăugați capacități îmbunătățite de securitate și confidențialitate specifice AI/ML

O strategie de apărare în profunzime ar trebui să înceapă prin a vă proteja mai întâi conturile și organizația, iar apoi să se adauge la caracteristicile suplimentare de securitate și confidențialitate îmbunătățite ale serviciilor, cum ar fi Amazon Bedrock și Amazon SageMaker. Amazon are peste 30 de servicii în portofoliul de securitate, identitate și conformitate care sunt integrate cu serviciile AWS AI/ML și pot fi utilizate împreună pentru a vă ajuta să vă securizați sarcinile de lucru, conturile și organizația. Pentru a vă apăra în mod corespunzător împotriva OWASP Top 10 pentru LLM, acestea ar trebui utilizate împreună cu serviciile AWS AI/ML.

Începeți prin a implementa o politică de cel mai mic privilegiu, folosind servicii precum Analizor de acces IAM la căutați conturi, roluri și resurse prea permisive pentru a restricționa accesul folosind acreditările pe termen scurt. Apoi, asigurați-vă că toate datele în repaus sunt criptate cu AWS KMS, inclusiv luând în considerare utilizarea CMK-urilor, și că toate datele și modelele sunt versionate și copiate de rezervă folosind Serviciul Amazon de stocare simplă (Amazon S3) versiunea și aplicarea imuabilității la nivel de obiect cu Blocare obiect Amazon S3. Protejați toate datele în tranzit între servicii folosind Manager certificat AWS şi / sau AWS Private CAși păstrați-l în VPC-uri care folosesc AWS PrivateLink. Definiți reguli stricte de intrare și ieșire a datelor pentru a vă proteja împotriva manipulării și exfiltrării folosind VPC-uri cu Firewall de rețea AWS politici. Luați în considerare introducerea AWS Web Application Firewall (AWS WAF) în fața protejați aplicațiile web și API-urile din roboți rău intenționați, Atacurile de injectare SQL, cross-site scripting (XSS), si preluari de cont cu Controlul fraudelor. Conectare cu AWS CloudTrail, Cloud virtual virtual Amazon jurnalele de flux (Amazon VPC) și Serviciul Amazon Elastic Kubernetes Jurnalele de audit (Amazon EKS) vor ajuta la furnizarea unei analize criminalistice a fiecărei tranzacții disponibile pentru servicii precum Amazon Detectiv. Puteți folosi Inspector Amazon pentru a automatiza descoperirea și gestionarea vulnerabilităților pentru Cloud Elastic de calcul Amazon (Amazon EC2) instanțe, containere, AWS Lambdas funcții și identificați accesibilitatea în rețea a sarcinilor dvs. de lucru. Protejați-vă datele și modelele împotriva activităților suspecte de utilizare Serviciul de gardă AmazonModelele de amenințări bazate pe ML și fluxurile de informații și activarea caracteristicilor sale suplimentare pentru EKS Protection, ECS Protection, S3 Protection, RDS Protection, Malware Protection, Lambda Protection și multe altele. Puteți utiliza servicii precum AWS Security Hub pentru a centraliza și automatiza verificările de securitate pentru a detecta abaterile de la cele mai bune practici de securitate și pentru a accelera investigarea și automatiza remedierea constatărilor de securitate cu manuale. De asemenea, puteți lua în considerare implementarea unui încredere zero arhitectură pe AWS pentru a crește în continuare autentificarea fină și controalele de autorizare pentru ceea ce utilizatorii umani sau procesele de la mașină la mașină le pot accesa pe bază de cerere. Luați în considerare și utilizarea Amazon Security Lake pentru a centraliza automat datele de securitate din mediile AWS, furnizorii SaaS, sursele locale și cloud într-un lac de date creat special, stocat în contul dvs. Cu Security Lake, puteți obține o înțelegere mai completă a datelor dvs. de securitate în întreaga organizație.

După ce mediul dvs. de lucru generativ AI a fost securizat, puteți să stratificați funcții specifice AI/ML, cum ar fi Amazon SageMaker Data Wrangler pentru a identifica eventualele părtiniri în timpul pregătirii datelor și Amazon SageMaker Clarify pentru a detecta părtinirea datelor și modelelor ML. De asemenea, puteți utiliza Monitor de model Amazon SageMaker pentru a evalua calitatea modelelor SageMaker ML în producție și pentru a vă anunța când există o schimbare în ceea ce privește calitatea datelor, calitatea modelului și atribuirea caracteristicilor. Aceste servicii AWS AI/ML care lucrează împreună (inclusiv SageMaker care lucrează cu Amazon Bedrock) cu serviciile de securitate AWS vă pot ajuta să identificați sursele potențiale de părtinire naturală și să vă protejați împotriva modificărilor rău intenționate a datelor. Repetați acest proces pentru fiecare dintre vulnerabilitățile OWASP Top 10 pentru LLM, pentru a vă asigura că maximizați valoarea serviciilor AWS pentru a implementa apărarea în profunzime pentru a vă proteja datele și sarcinile de lucru.

După cum a scris Clarke Rodgers, strategul AWS Enterprise, în postarea sa de blog „CISO Insight: Fiecare serviciu AWS este un serviciu de securitate”, „Aș susține că practic fiecare serviciu din cloudul AWS fie permite un rezultat de securitate în sine, fie poate fi utilizat (singur sau împreună cu unul sau mai multe servicii) de către clienți pentru a atinge un obiectiv de securitate, risc sau conformitate.” Și „Ofițerii șefi de securitate a informațiilor pentru clienți (CISO) (sau echipele lor respective) ar putea dori să-și facă timp pentru a se asigura că sunt bine familiarizați cu toate serviciile AWS, deoarece poate exista un obiectiv de securitate, risc sau conformitate care poate fi atins, chiar dacă un serviciu nu se încadrează în categoria „Securitate, identitate și conformitate”.

Strat de apărare la granițele de încredere în aplicațiile LLM

Când dezvoltați sisteme și aplicații bazate pe inteligență artificială generativă, ar trebui să luați în considerare aceleași preocupări ca și în cazul oricărei alte aplicații ML, așa cum este menționat în MITRE ATLAS Machine Learning Threat Matrix, cum ar fi luarea în considerare a originilor software-ului și componentelor de date (cum ar fi efectuarea unui audit de software cu sursă deschisă, revizuirea listei de materiale software (SBOM) și analiza fluxurilor de lucru de date și integrărilor API) și implementarea protecțiilor necesare împotriva amenințărilor lanțului de aprovizionare LLM. Includeți informații din cadrele din industrie și fiți conștienți de modalități de a utiliza mai multe surse de informații despre amenințări și informații despre risc pentru a vă ajusta și extinde apărarea de securitate pentru a lua în considerare riscurile de securitate AI, ML și AI generative care sunt emergente și nu sunt incluse în cadrele tradiționale. Căutați informații complementare despre riscurile specifice IA din surse industriale, de apărare, guvernamentale, internaționale și academice, deoarece noi amenințări apar și evoluează în mod regulat în acest spațiu, iar cadrele și ghidurile însoțitoare sunt actualizate frecvent. De exemplu, atunci când utilizați un model Retrieval Augmented Generation (RAG), dacă modelul nu include datele de care are nevoie, acesta poate solicita acestuia de la o sursă de date externă pentru utilizare în timpul deducerii și reglajului fin. Sursa pe care o interoghează poate fi în afara controlului dvs. și poate fi o potențială sursă de compromis în lanțul dvs. de aprovizionare. O abordare de apărare în profunzime ar trebui extinsă către surse externe pentru a stabili încrederea, autentificarea, autorizarea, accesul, securitatea, confidențialitatea și acuratețea datelor pe care le accesează. Pentru a vă scufunda mai adânc, citiți „Creați o aplicație de întreprindere securizată cu Generative AI și RAG utilizând Amazon SageMaker JumpStartMatei 22:21

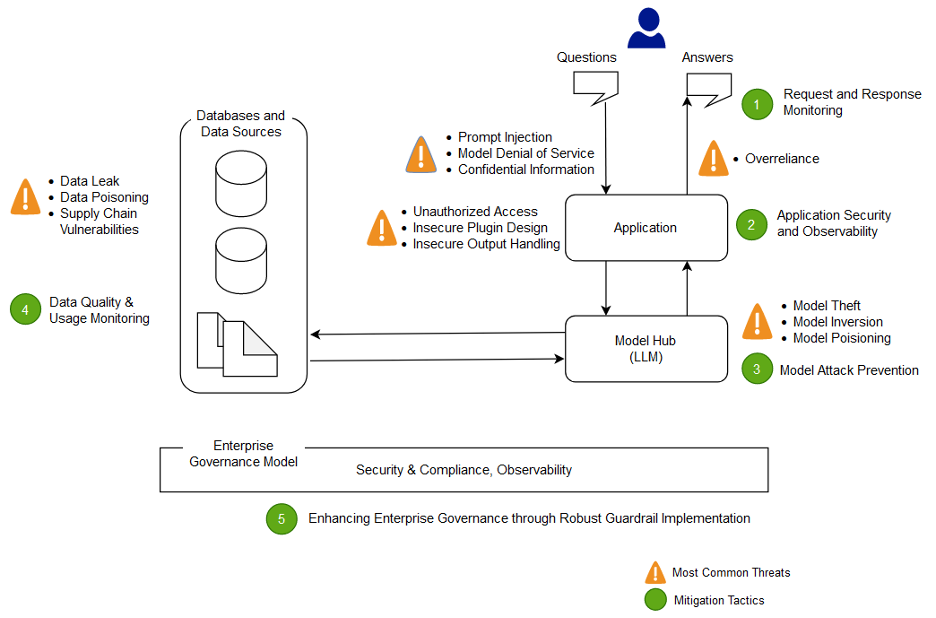

Analizați și reduceți riscul în aplicațiile dvs. LLM

În această secțiune, analizăm și discutăm câteva tehnici de atenuare a riscurilor bazate pe granițele și interacțiunile încrederii sau pe zone distincte ale volumului de lucru cu un domeniu de aplicare și un profil de risc similar similar. În acest exemplu de arhitectură a unei aplicații chatbot, există cinci limite de încredere în care sunt demonstrate controalele, pe baza modului în care clienții AWS își construiesc în mod obișnuit aplicațiile LLM. Aplicația dvs. LLM poate avea mai multe sau mai puține limite de încredere definibile. În următorul exemplu de arhitectură, aceste limite de încredere sunt definite astfel:

- Interacțiunile interfeței cu utilizatorul (cerere și răspuns)

- Interacțiunile aplicației

- Interacțiuni model

- Interacțiunile de date

- Interacțiuni organizaționale și utilizare

Interacțiuni cu interfața utilizatorului: Dezvoltați monitorizarea cererilor și răspunsurilor

Detectați și răspundeți la incidentele cibernetice legate de IA generativă în timp util, evaluând o strategie de abordare a riscului din intrările și ieșirile aplicației AI generative. De exemplu, este posibil ca monitorizarea suplimentară a comportamentelor și a fluxului de date să fie instrumentată pentru a detecta dezvăluirea de informații sensibile în afara domeniului sau organizației dvs., în cazul în care acestea sunt utilizate în aplicația LLM.

Aplicațiile AI generative ar trebui să respecte în continuare cele mai bune practici standard de securitate atunci când vine vorba de protejarea datelor. Stabilește o perimetrul de date securizat și depozite de date sensibile securizate. Criptați datele și informațiile utilizate pentru aplicațiile LLM în repaus și în tranzit. Protejați datele utilizate pentru a vă antrena modelul de otrăvirea datelor de antrenament prin înțelegerea și controlul utilizatorilor, proceselor și rolurilor care au permisiunea de a contribui la depozitele de date, precum și a modului în care fluxul de date în aplicație, monitorizarea abaterilor de părtinire și utilizarea versiunilor și stocare imuabilă în servicii de stocare precum Amazon S3. Stabiliți controale stricte de intrare și ieșire a datelor folosind servicii precum AWS Network Firewall și AWS VPC-uri pentru a vă proteja împotriva intrărilor suspecte și a potențialului de exfiltrare a datelor.

În timpul procesului de instruire, recalificare sau reglare fină, ar trebui să fiți conștient de orice date sensibile care sunt utilizate. După ce datele sunt utilizate în timpul unuia dintre aceste procese, ar trebui să planificați un scenariu în care orice utilizator al modelului dvs. devine brusc capabil să extragă datele sau informațiile înapoi utilizând tehnici de injectare promptă. Înțelegeți riscurile și beneficiile utilizării datelor sensibile în modelele dvs. și inferențe. Implementați mecanisme robuste de autentificare și autorizare pentru stabilirea și gestionarea permisiunilor de acces detaliate, care nu se bazează pe logica aplicației LLM pentru a preveni dezvăluirea. Intrarea controlată de utilizator într-o aplicație AI generativă a fost demonstrată în anumite condiții pentru a putea oferi un vector pentru a extrage informații din model sau din orice parte necontrolată de utilizator a intrării. Acest lucru poate avea loc prin injectare promptă, în care utilizatorul furnizează o intrare care face ca rezultatul modelului să se abate de la paravanele așteptate ale aplicației LLM, inclusiv furnizarea de indicii pentru seturile de date pe care modelul a fost antrenat inițial.

Implementați cote de acces la nivel de utilizator pentru utilizatorii care furnizează intrări și primesc rezultate de la un model. Ar trebui să luați în considerare abordări care nu permit accesul anonim în condițiile în care datele și informațiile de antrenament ale modelului sunt sensibile sau în care există riscuri de la un adversar care antrenează un fax al modelului dvs. pe baza intrării lor și a rezultatelor modelului dvs. aliniat. În general, dacă o parte a intrării într-un model constă dintr-un text arbitrar furnizat de utilizator, considerați rezultatul ca fiind susceptibil de injectare promptă și, în consecință, asigurați-vă că utilizarea rezultatelor include contramăsuri tehnice și organizaționale implementate pentru a atenua gestionarea nesigură a rezultatelor, agenție excesivă. , și încrederea excesivă. În exemplul de mai devreme referitor la filtrarea intrărilor rău intenționate folosind AWS WAF, luați în considerare construirea unui filtru în fața aplicației dvs. pentru o astfel de potențială utilizare greșită a solicitărilor și dezvoltați o politică pentru gestionarea și evoluția acestora pe măsură ce modelul și datele dvs. cresc. Luați în considerare, de asemenea, o revizuire filtrată a rezultatelor înainte de a fi returnată utilizatorului pentru a vă asigura că respectă standardele de calitate, acuratețe sau moderare a conținutului. Poate doriți să personalizați în continuare acest lucru pentru nevoile organizației dvs., cu un nivel suplimentar de control asupra intrărilor și ieșirilor în fața modelelor dvs. pentru a atenua modelele de trafic suspecte.

Interacțiuni cu aplicația: securitatea aplicației și observabilitatea

Examinați aplicația dvs. LLM cu atenție la modul în care un utilizator ar putea utiliza modelul dvs. pentru a ocoli autorizarea standard către un instrument din aval sau un lanț de instrumente pe care nu are autorizație de acces sau de utilizare. O altă preocupare la acest nivel implică accesarea depozitelor de date externe prin utilizarea unui model ca mecanism de atac folosind riscuri LLM tehnice sau organizaționale neatenuate. De exemplu, dacă modelul dvs. este instruit să acceseze anumite depozite de date care ar putea conține date sensibile, ar trebui să vă asigurați că aveți verificări adecvate de autorizare între modelul dvs. și depozitele de date. Utilizați atribute imuabile despre utilizatori care nu provin din model atunci când efectuați verificări de autorizare. Gestionarea nesigură a ieșirilor, proiectarea nesigură a pluginurilor și agenția excesivă pot crea condiții în care un actor de amenințare poate folosi un model pentru a păcăli sistemul de autorizare pentru a escalada privilegii eficiente, ceea ce duce la o componentă din aval care crede că utilizatorul este autorizat să recupereze date sau să ia o anumită acțiune.

Când implementați orice plugin sau instrument AI generativ, este imperativ să examinați și să înțelegeți nivelul de acces acordat, precum și să analizați controalele de acces care au fost configurate. Utilizarea pluginurilor AI generative nesigure neatenuate poate face sistemul dumneavoastră susceptibil la vulnerabilități și amenințări ale lanțului de aprovizionare, ceea ce poate duce la acțiuni rău intenționate, inclusiv rularea de cod la distanță.

Interacțiuni model: Prevenirea atacurilor model

Ar trebui să fiți conștienți de originea oricăror modele, pluginuri, instrumente sau date pe care le utilizați, pentru a evalua și a atenua vulnerabilitățile lanțului de aprovizionare. De exemplu, unele formate de model obișnuite permit încorporarea codului rulabil arbitrar în modelele în sine. Utilizați oglinzile pachetelor, scanarea și inspecțiile suplimentare, în funcție de obiectivele de securitate ale organizației dvs.

Seturile de date pe care le antrenați și la care vă reglați modelele trebuie, de asemenea, revizuite. Dacă ajustați automat un model pe baza feedback-ului utilizatorului (sau a altor informații controlabile de utilizatorul final), trebuie să luați în considerare dacă un actor rău intenționat ar putea schimba modelul în mod arbitrar pe baza manipulării răspunsurilor lor și a obține otrăvirea datelor de antrenament.

Interacțiuni cu datele: monitorizează calitatea și utilizarea datelor

Modelele AI generative, cum ar fi LLM-urile, funcționează în general bine, deoarece au fost instruite pe o cantitate mare de date. Deși aceste date ajută LLM-urile să finalizeze sarcini complexe, de asemenea, vă pot expune sistemul la riscul de otrăvire a datelor de antrenament, care apare atunci când sunt incluse sau omise date neadecvate într-un set de date de antrenament care poate modifica comportamentul unui model. Pentru a reduce acest risc, ar trebui să vă uitați la lanțul dvs. de aprovizionare și să înțelegeți procesul de revizuire a datelor pentru sistemul dvs. înainte de a fi utilizat în interiorul modelului dvs. Deși canalul de antrenament este o sursă principală pentru otrăvirea datelor, ar trebui să vă uitați și la modul în care modelul dvs. primește date, cum ar fi într-un model RAG sau într-un lac de date, și dacă sursa acelor date este de încredere și protejată. Utilizați serviciile de securitate AWS, cum ar fi AWS Security Hub, Amazon GuardDuty și Amazon Inspector pentru a ajuta la monitorizarea continuă a activităților suspecte în Amazon EC2, Amazon EKS, Amazon S3, Serviciul de baze de date relaționale Amazon (Amazon RDS) și accesul la rețea care pot fi indicatori ai amenințărilor emergente și utilizați Detective pentru a vizualiza investigațiile de securitate. Luați în considerare, de asemenea, utilizarea unor servicii precum Amazon Security Lake pentru a accelera investigațiile de securitate prin crearea unui lac de date creat special pentru a centraliza automat datele de securitate din mediile AWS, furnizorii SaaS, la sediul și sursele cloud care contribuie la sarcinile dvs. de lucru AI/ML.

Interacțiuni organizaționale: implementați balustrade de guvernare a întreprinderii pentru IA generativă

Identificați riscurile asociate cu utilizarea IA generativă pentru afacerile dvs. Ar trebui să construiți taxonomia de risc a organizației dvs. și să efectuați evaluări ale riscurilor pentru a lua decizii informate atunci când implementați soluții AI generative. Dezvoltă un plan de continuitate a afacerii (BCP) care include încărcături de lucru AI, ML și AI generativă și care pot fi implementate rapid pentru a înlocui funcționalitatea pierdută a unei aplicații LLM afectate sau offline pentru a vă îndeplini SLA-urile.

Identificați lipsurile de procese și resurse, ineficiența și inconsecvențele și îmbunătățiți gradul de conștientizare și asumarea proprietății în afacerea dvs. Model de amenințare toate sarcinile de lucru AI generative pentru a identifica și a atenua potențialele amenințări de securitate care pot duce la rezultate cu impact asupra afacerii, inclusiv accesul neautorizat la date, refuzul serviciului și utilizarea necorespunzătoare a resurselor. Profita de nou Instrumentul de modelare AWS Threat Composer pentru a ajuta la reducerea time-to-value atunci când se realizează modelarea amenințărilor. Mai târziu în ciclurile dvs. de dezvoltare, luați în considerare includerea introducerii ingineria haosului de securitate experimente de injectare a erorilor pentru a crea condiții reale pentru a înțelege cum va reacționa sistemul dumneavoastră la necunoscute și pentru a construi încrederea în reziliența și securitatea sistemului.

Includeți diverse perspective în dezvoltarea strategiilor de securitate și a mecanismelor de gestionare a riscurilor pentru a asigura aderarea și acoperirea pentru AI/ML și securitatea generativă în toate rolurile și funcțiile postului. Aduceți o mentalitate în materie de securitate de la începutul și cercetarea oricărei aplicații AI generative pentru a se alinia cerințelor. Dacă aveți nevoie de asistență suplimentară de la AWS, solicitați managerului de cont AWS să vă asigurați că există asistență egală, solicitând AWS Solutions Architects de la AWS Security și AI/ML să vă ajute în tandem.

Asigurați-vă că organizația dvs. de securitate ia în mod obișnuit acțiuni pentru a promova comunicarea atât în ceea ce privește conștientizarea riscurilor, cât și înțelegerea gestionării riscurilor în rândul părților interesate generative de IA, cum ar fi managerii de produse, dezvoltatorii de software, oamenii de știință de date și conducerea executivă, permițând informațiilor despre amenințări și îndrumărilor de control să ajungă la echipele care pot fi afectat. Organizațiile de securitate pot susține o cultură a dezvăluirii responsabile și a îmbunătățirii iterative prin participarea la discuții și aducând idei și informații noi părților interesate generative de inteligență artificială care se referă la obiectivele lor de afaceri. Află mai multe despre angajamentul nostru față de IA responsabilă și suplimentare resurse responsabile de IA pentru a ne ajuta clientii.

Obține avantaje în a permite o poziție organizațională mai bună pentru AI generativă prin deblocarea timpului de valorificare în procesele de securitate existente ale organizației tale. Evaluați în mod proactiv unde organizația dvs. poate necesita procese care sunt excesiv de împovărătoare, având în vedere contextul generativ de securitate AI și perfecționați-le pentru a oferi dezvoltatorilor și oamenilor de știință o cale clară de lansare cu controalele corecte.

Evaluați unde pot exista oportunități de a alinia stimulentele, de a reduce riscul și de a oferi o linie de vedere clară asupra rezultatelor dorite. Actualizați îndrumările și apărarea controalelor pentru a răspunde nevoilor în evoluție ale dezvoltării de aplicații AI/ML și AI generative pentru a reduce confuzia și incertitudinea care poate costa timpul de dezvoltare, crește riscul și crește impactul.

Asigurați-vă că părțile interesate care nu sunt experți în securitate sunt capabile să înțeleagă atât modul în care guvernanța organizațională, politicile și pașii de gestionare a riscurilor se aplică sarcinilor lor de lucru, cât și să aplice mecanisme de gestionare a riscurilor. Pregătiți-vă organizația să răspundă la evenimentele și scenariile realiste care pot apărea cu aplicațiile AI generative și asigurați-vă că rolurile generatoare de AI și echipele de răspuns sunt la curent cu căile și acțiunile de escaladare în caz de îngrijorare pentru orice activitate suspectă.

Concluzie

Pentru a comercializa cu succes inovația cu orice tehnologie nouă și emergentă, este nevoie să începem cu o mentalitate care să priorizeze securitatea, să te bazezi pe o bază de infrastructură sigură și să te gândești la cum să integrezi în continuare securitatea la fiecare nivel al stivei tehnologice devreme cu o securitate apărată în profunzime. abordare. Aceasta include interacțiuni la mai multe straturi ale stivei dvs. de tehnologie și puncte de integrare în lanțul dvs. de aprovizionare digital, pentru a asigura rezistența organizațională. Deși IA generativă introduce unele noi provocări de securitate și confidențialitate, dacă urmați cele mai bune practici fundamentale de securitate, cum ar fi utilizarea apărării în profunzime cu servicii de securitate stratificate, vă puteți proteja organizația de multe probleme comune și amenințări în evoluție. Ar trebui să implementați servicii de securitate AWS stratificate în sarcinile dvs. de lucru AI generative și organizația mai mare și să vă concentrați pe punctele de integrare din lanțurile dvs. de aprovizionare digitale pentru a vă securiza mediile cloud. Apoi, puteți utiliza capacitățile îmbunătățite de securitate și confidențialitate din serviciile AWS AI/ML, cum ar fi Amazon SageMaker și Amazon Bedrock, pentru a adăuga mai multe straturi de control îmbunătățit de securitate și confidențialitate la aplicațiile dvs. generative AI. Încorporarea securității de la început va face mai rapidă, mai ușoară și mai rentabilă inovarea cu AI generativă, simplificând în același timp conformitatea. Acest lucru vă va ajuta să creșteți controalele, încrederea și observabilitatea aplicațiilor dvs. AI generative pentru angajați, clienți, parteneri, autorități de reglementare și alte părți interesate.

Referințe suplimentare

- Cadre standard din industrie pentru managementul și securitatea riscurilor specifice AI/ML:

Despre autori

Christopher Rae este un specialist principal GTM în securitate la nivel mondial, concentrat pe dezvoltarea și executarea inițiativelor strategice care accelerează și scala adoptarea serviciilor de securitate AWS. Este pasionat de intersecția dintre securitatea cibernetică și tehnologiile emergente, cu peste 20 de ani de experiență în roluri de conducere strategică globală, oferind soluții de securitate clienților media, divertisment și telecom. El se reîncarcă prin lectură, călătorii, mâncare și vin, descoperind muzică nouă și sfătuind startup-urile aflate în stadiu incipient.

Christopher Rae este un specialist principal GTM în securitate la nivel mondial, concentrat pe dezvoltarea și executarea inițiativelor strategice care accelerează și scala adoptarea serviciilor de securitate AWS. Este pasionat de intersecția dintre securitatea cibernetică și tehnologiile emergente, cu peste 20 de ani de experiență în roluri de conducere strategică globală, oferind soluții de securitate clienților media, divertisment și telecom. El se reîncarcă prin lectură, călătorii, mâncare și vin, descoperind muzică nouă și sfătuind startup-urile aflate în stadiu incipient.

Ilie Winter este inginer senior de securitate în Amazon Security, deținând o licență în inginerie cibernetică și infuzat cu dragoste pentru Harry Potter. Elijah excelează în identificarea și abordarea vulnerabilităților din sistemele AI, combinând expertiza tehnică cu un strop de vrăjitorie. Elijah proiectează protocoale de securitate personalizate pentru ecosistemele AI, aducând un fler magic apărării digitale. Orientat spre integritate, Elijah are experiență în domeniul securității atât în organizații din sectorul public, cât și din sectorul comercial, concentrate pe protejarea încrederii.

Ilie Winter este inginer senior de securitate în Amazon Security, deținând o licență în inginerie cibernetică și infuzat cu dragoste pentru Harry Potter. Elijah excelează în identificarea și abordarea vulnerabilităților din sistemele AI, combinând expertiza tehnică cu un strop de vrăjitorie. Elijah proiectează protocoale de securitate personalizate pentru ecosistemele AI, aducând un fler magic apărării digitale. Orientat spre integritate, Elijah are experiență în domeniul securității atât în organizații din sectorul public, cât și din sectorul comercial, concentrate pe protejarea încrederii.

Ram Vittal este arhitect principal de soluții ML la AWS. Are peste 3 decenii de experiență în arhitectura și construirea de aplicații distribuite, hibride și cloud. El este pasionat de construirea de soluții sigure și scalabile de AI/ML și de date mari pentru a ajuta clienții întreprinderilor în călătoria lor de adoptare și optimizare a cloud-ului pentru a-și îmbunătăți rezultatele în afaceri. În timpul liber, se plimbă cu motocicleta și se plimbă cu Sheepadoodle-ul său de 3 ani!

Ram Vittal este arhitect principal de soluții ML la AWS. Are peste 3 decenii de experiență în arhitectura și construirea de aplicații distribuite, hibride și cloud. El este pasionat de construirea de soluții sigure și scalabile de AI/ML și de date mari pentru a ajuta clienții întreprinderilor în călătoria lor de adoptare și optimizare a cloud-ului pentru a-și îmbunătăți rezultatele în afaceri. În timpul liber, se plimbă cu motocicleta și se plimbă cu Sheepadoodle-ul său de 3 ani!

Navneet Tuteja este specialist în date la Amazon Web Services. Înainte de a se alătura AWS, Navneet a lucrat ca facilitator pentru organizațiile care doresc să își modernizeze arhitecturile de date și să implementeze soluții complete AI/ML. Ea deține o diplomă de inginerie de la Universitatea Thapar, precum și un master în statistică de la Universitatea Texas A&M.

Navneet Tuteja este specialist în date la Amazon Web Services. Înainte de a se alătura AWS, Navneet a lucrat ca facilitator pentru organizațiile care doresc să își modernizeze arhitecturile de date și să implementeze soluții complete AI/ML. Ea deține o diplomă de inginerie de la Universitatea Thapar, precum și un master în statistică de la Universitatea Texas A&M.

Emily Soward este un Data Scientist cu AWS Professional Services. Ea deține un master în știință cu distincție în inteligență artificială de la Universitatea din Edinburgh din Scoția, Regatul Unit, cu accent pe procesarea limbajului natural (NLP). Emily a ocupat roluri științifice și de inginerie aplicate axate pe cercetarea și dezvoltarea de produse cu AI, excelența operațională și guvernanța pentru sarcinile de lucru AI care rulează în organizații din sectorul public și privat. Ea contribuie la îndrumarea clienților în calitate de vorbitor principal AWS și recent, ca autor pentru AWS Well-Architected in the Machine Learning Lens.

Emily Soward este un Data Scientist cu AWS Professional Services. Ea deține un master în știință cu distincție în inteligență artificială de la Universitatea din Edinburgh din Scoția, Regatul Unit, cu accent pe procesarea limbajului natural (NLP). Emily a ocupat roluri științifice și de inginerie aplicate axate pe cercetarea și dezvoltarea de produse cu AI, excelența operațională și guvernanța pentru sarcinile de lucru AI care rulează în organizații din sectorul public și privat. Ea contribuie la îndrumarea clienților în calitate de vorbitor principal AWS și recent, ca autor pentru AWS Well-Architected in the Machine Learning Lens.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- PlatoData.Network Vertical Generative Ai. Împuterniciți-vă. Accesați Aici.

- PlatoAiStream. Web3 Intelligence. Cunoștințe amplificate. Accesați Aici.

- PlatoESG. carbon, CleanTech, Energie, Mediu inconjurator, Solar, Managementul deșeurilor. Accesați Aici.

- PlatoHealth. Biotehnologie și Inteligență pentru studii clinice. Accesați Aici.

- Sursa: https://aws.amazon.com/blogs/machine-learning/architect-defense-in-depth-security-for-generative-ai-applications-using-the-owasp-top-10-for-llms/

- :are

- :este

- :nu

- :Unde

- $UP

- 1

- 10

- 100

- 125

- 150

- 30

- 300

- a

- capacitate

- Capabil

- Despre Noi

- academic

- accelera

- acceptabil

- acces

- Acces la date

- accesarea

- în consecință

- Cont

- Conturi

- precizie

- Obține

- realizarea

- peste

- Acțiune

- acțiuni

- activităţi de

- activitate

- adaptare

- adăuga

- adăugat

- plus

- Suplimentar

- adresa

- adresare

- aderare

- regla

- adopta

- Adoptarea

- Adoptare

- avansat

- avans

- Avantaj

- consiliere

- După

- împotriva

- agenție

- Agent

- AI

- Modele AI

- Sisteme AI

- AI / ML

- alinia

- aliniat

- Se aliniază

- TOATE

- permite

- permis

- Permiterea

- singur

- de asemenea

- Cu toate ca

- Amazon

- Amazon EC2

- Amazon RDS

- Amazon SageMaker

- Amazon Web Services

- printre

- sumă

- an

- analiza

- analiza

- și

- și infrastructură

- Anonim

- O alta

- telefonic

- Orice

- api

- apetit

- aplicabil

- aplicație

- Dezvoltare de Aplicații

- securitatea aplicațiilor

- aplicatii

- aplicat

- se aplică

- Aplică

- Aplicarea

- abordare

- abordari

- adecvat

- arhitecți

- arhitectural

- arhitectură

- SUNT

- domenii

- argumenta

- apărea

- în jurul

- artificial

- inteligență artificială

- Inteligența artificială (AI)

- AS

- cere

- evaluarea

- evaluări

- Bunuri

- Asistență

- asistenți

- asociate

- asigurare

- At

- atlas

- ataca

- Atacuri

- încercarea

- atenţie

- atribute

- de audit

- augmented

- Autentificare

- autor

- autorizare

- autorizat

- automatizarea

- în mod automat

- disponibil

- conştient

- gradului de conştientizare

- AWS

- Client AWS

- Servicii profesionale AWS

- înapoi

- sprijinit

- fundal

- bazat

- de bază

- bază

- BE

- deoarece

- devine

- fost

- înainte

- începe

- comportament

- fiind

- credincios

- beneficia

- Beneficiile

- CEL MAI BUN

- Cele mai bune practici

- Mai bine

- între

- părtinire

- Mare

- Datele mari

- Proiect de lege

- amestecare

- Blog

- atât

- limitele

- aduce

- Aducere

- construi

- constructor

- constructori

- Clădire

- construiește

- construit

- construit-in

- afaceri

- întreprinderi

- by

- by-pass

- Cadenţă

- CAN

- Poate obține

- capacități

- Capacitate

- caz

- Categorii

- Provoca

- cauze

- centraliza

- sigur

- certificat

- Certificare

- lanţ

- lanţuri

- provocări

- Schimbare

- Haos

- chatbot

- Verificări

- şef

- clar

- Cloud

- adoptarea norului

- Aplicații cloud

- cloud computing

- infrastructura cloud

- Securitatea cloud

- cod

- combinaţie

- cum

- vine

- comercial

- comercializa

- angajament

- comise

- Comun

- în mod obișnuit

- Comunicare

- tovarăş

- însoțitoare

- companie

- Completă

- complex

- conformitate

- component

- Compozitor

- înţelege

- cuprinzător

- compromis

- compromis

- compromisor

- Calcula

- tehnica de calcul

- Îngrijorare

- îngrijorat

- preocupările

- Condiții

- Conduce

- încredere

- configurat

- confuzie

- conjuncție

- Conectați

- Consecințele

- Lua în considerare

- luate în considerare

- luand in considerare

- consistent

- constă

- conţine

- Containere

- conţinut

- moderarea conținutului

- context

- continuitate

- continuu

- a contribui

- contribuie

- Control

- controlul

- controale

- invers

- Nucleu

- piatră de temelie

- corecta

- Corespunzător

- A costat

- cost-eficiente

- ar putea

- acoperire

- crea

- Crearea

- critic

- Cultură

- curate

- client

- clienţii care

- personaliza

- personalizate

- Cyber

- securitate cibernetică

- Securitate cibernetică

- cicluri

- de date

- Lacul de date

- Pregătirea datelor

- calitatea datelor

- om de știință de date

- falsificarea datelor

- Baza de date

- seturi de date

- zi

- zeci de ani

- Luarea deciziilor

- factorii de decizie

- Deciziile

- adânc

- Mai adânc

- Apărare

- defensivă

- defini

- definit

- definire

- Grad

- livrarea

- se îngropa

- demonstrat

- Denial of Service

- În funcție

- implementa

- dislocate

- Implementarea

- desfășurarea

- adâncime

- descrie

- Amenajări

- modele

- dorit

- detecta

- dezvolta

- dezvoltat

- Dezvoltatorii

- în curs de dezvoltare

- Dezvoltare

- se abate

- deviere

- diferit

- digital

- discipline

- dezvăluire

- descoperirea

- descoperire

- discuta

- discutarea

- discuții

- perturbări

- distinct

- distincție

- distribuite

- scufunda

- diferit

- perspective diverse

- Nu

- domeniu

- Dont

- atrage

- condus

- în timpul

- fiecare

- Mai devreme

- Devreme

- stadiu timpuriu

- mai ușor

- cu ușurință

- Economic

- valoare economica

- ecosistemele

- Edinburgh

- Eficace

- eficient

- oricare

- Încorporarea

- apărea

- șmirghel

- tehnologii emergente

- Tehnologie emergentă

- accent

- de angajați

- împuternici

- permite

- permite

- permițând

- încurajează

- criptate

- capăt

- aplica

- aplicarea

- inginer

- Inginerie

- inginerii

- sporită

- asigura

- Afacere

- clienții întreprinderii

- Divertisment

- Întreg

- Mediu inconjurator

- medii

- egal

- eroare

- Escaladarea

- esenţial

- stabili

- stabilirea

- Eter (ETH)

- evalua

- evaluarea

- evaluare

- Chiar

- eveniment

- evenimente

- Fiecare

- evolua

- evoluție

- examina

- exemplu

- exemple

- Excelență

- excesiv

- executând

- executiv

- Exercita

- exfiltrațiile

- exista

- existent

- extinderea

- de aşteptat

- experienţă

- experimente

- expertiză

- experți

- Expunere

- extinde

- extins

- extindere

- extinde

- extern

- suplimentar

- extrage

- extrageți datele

- extrem

- fete

- facilitează

- facilitator

- eșuează

- Cădea

- Familiaritate

- FAST

- mai repede

- Caracteristică

- DESCRIERE

- feedback-ul

- mai puține

- filtru

- filtrare

- financiar

- Servicii financiare

- Găsi

- descoperire

- constatările

- firewall

- First

- cinci

- fler

- flexibil

- debit

- fluxurilor

- Concentra

- concentrat

- urma

- următor

- alimente

- Pentru

- juridic

- Foster

- plasează

- Fundație

- foundational

- Cadru

- cadre

- frecvent

- din

- faţă

- funcționalitate

- funcții

- fundamental

- mai mult

- Câştig

- lacune

- General

- în general

- generaţie

- generativ

- AI generativă

- obține

- obtinerea

- dat

- Caritate

- scop

- Goluri

- merge

- guverna

- guvernare

- Guvern

- guvernamental

- acordate

- creste

- îndrumare

- ghida

- ghidate

- Ghiduri

- HAD

- manipula

- Manipularea

- Avea

- he

- de asistență medicală

- ajutor

- ajutor

- ajută

- performanta ridicata

- extrem de

- lui

- deținere

- deține

- Cum

- Cum Pentru a

- HTML

- http

- HTTPS

- Butuc

- uman

- Hibrid

- i

- idee

- idei

- identificat

- identifica

- identificarea

- Identitate

- if

- inflexibilitate

- imuabil

- Impactul

- afectate

- Impacturi

- imperativ

- punerea în aplicare a

- implementarea

- implementat

- Punere în aplicare a

- îmbunătăţi

- îmbunătățire

- in

- stimulente

- începuturile

- incidente

- include

- inclus

- include

- Inclusiv

- incoerențe

- Crește

- a crescut

- crescând

- Indicatorii

- industrie

- ineficiențe

- informații

- securitatea informațiilor

- informat

- Infrastructură

- perfuzată

- inerent

- inițiative

- inova

- inovatoare

- Inovaţie

- intrare

- intrări

- nesigur

- în interiorul

- înţelegere

- perspective

- cazuri

- integra

- integrate

- integreaza

- integrare

- integrările

- integritate

- Inteligență

- interacţiuni

- interes

- interfaţă

- Internațional

- intersecție

- în

- introduce

- Prezintă

- introducerea

- investigaţie

- Investigații

- implică

- probleme de

- IT

- ESTE

- în sine

- Loc de munca

- aderarea

- călătorie

- jpg

- doar

- A pastra

- Cheie

- Domenii-cheie

- regat

- cunoştinţe

- Kubernetes

- lac

- limbă

- mare

- mai mare

- în cele din urmă

- mai tarziu

- lansa

- strat

- stratificat

- straturi

- conduce

- Liderii

- Conducere

- conducere

- AFLAȚI

- învăţare

- cel mai puțin

- Obiectiv

- Lentilele

- Nivel

- ciclu de viață

- ca

- probabilitate

- Linie

- linii

- logare

- logică

- Uite

- cautati

- pierdut

- dragoste

- maşină

- masina de învățare

- face

- rău

- malware

- administra

- gestionate

- administrare

- manager

- Manageri

- de conducere

- manipulant

- Manipulare

- manieră

- multe

- Hartă

- maestru

- studii de masterat

- Materiale

- materie

- scadență

- maximizarea

- Mai..

- mijloace

- măsura

- mecanism

- mecanisme

- Mass-media

- Întâlni

- se intalneste

- mental

- menționat

- cu

- Metrici

- ar putea

- migra

- milioane

- minte

- Mod de gândire

- folosire greșită

- diminua

- atenuare

- ML

- model

- modelare

- Modele

- moderare

- moderniza

- monitor

- Monitorizarea

- mai mult

- cele mai multe

- motocicletă

- muta

- mult

- multiplu

- Muzică

- trebuie sa

- my

- Natural

- Limbajul natural

- Procesarea limbajului natural

- Natură

- necesar

- Nevoie

- necesar

- nevoilor

- reţea

- Acces la retea

- Nou

- următor

- nist

- nlp

- obiect

- obiectiv

- Obiectivele

- avea loc

- of

- de pe

- oferind

- promoții

- ofițerii

- Offline

- on

- ONE

- deschide

- open-source

- operat

- operațional

- Operațiuni

- Oportunităţi

- optimizare

- optimizate

- or

- comandă

- organizație

- de organizare

- organizații

- Origine

- iniţial

- origini

- Altele

- al nostru

- afară

- Rezultat

- rezultate

- producție

- iesiri

- exterior

- peste

- global

- excesiv

- proprietate

- pachet

- parte

- participante

- petreceri

- parteneri

- piese

- pasionat

- cale

- căi

- modele

- performanță

- efectuată

- efectuarea

- permisiuni

- perspective

- faze

- piloni

- conducte

- Loc

- plan

- planificare

- Plato

- Informații despre date Platon

- PlatoData

- conecteaza

- Plugin-uri

- puncte

- otravă

- Politicile

- Politica

- poziţionare

- Post

- potenţial

- potenţial

- practică

- practicile

- pregătire

- Pregăti

- împiedica

- precedent

- Prim

- Principal

- Principiile

- anterior

- Stabilirea priorităților

- prioritate

- intimitate

- privat

- sectorul privat

- privilegiu

- privilegii

- proces

- procese

- prelucrare

- Produs

- producere

- productivitate

- profesional

- Profil

- Program

- Programe

- proiect

- solicitări

- adecvat

- cum se cuvine

- proteja

- protejat

- protectoare

- protecţie

- protocoale

- furniza

- furnizori

- furnizează

- furnizarea

- public

- pune

- calitate

- interogări

- întrebare

- Rapid

- repede

- cârpă

- ajunge

- Reacţiona

- Citeste

- promptitudine

- Citind

- lumea reală

- realist

- realizare

- realiza

- primire

- recent

- recomanda

- Recomandări

- Recupera

- recuperare

- reduce

- referință

- rafina

- regiune

- regulat

- regulat

- reglementate

- Autoritățile de reglementare

- legate de

- de încredere

- se bazează

- remedierea

- la distanta

- repeta

- înlocui

- solicita

- solicitând

- necesita

- cerință

- Cerinţe

- Necesită

- cercetare

- cercetare și dezvoltare

- elasticitate

- resursă

- Resurse

- apreciat

- respectiv

- Răspunde

- răspuns

- răspunsuri

- responsabilitate

- responsabil

- REST

- restrânge

- reconversie profesională

- regăsire

- revizuiască

- revizuite

- revizuirea

- Recenzii

- plimbari

- dreapta

- Risc

- apetit pentru risc

- de gestionare a riscurilor

- Atenuarea riscului

- Riscurile

- robust

- rodgers

- rolurile

- rădăcină

- în mod obișnuit

- norme

- funcţionare

- s

- SaaS

- sagemaker

- acelaşi

- scalabil

- Scară

- scanare

- scenariu

- scenarii

- Ştiinţă

- ştiinţific

- Om de stiinta

- oamenii de stiinta

- domeniu

- Scoping

- Scoţia

- Caută

- Secțiune

- sector

- sigur

- securizat

- asigurarea

- securitate

- beneficii de securitate

- Evenimente de securitate

- riscuri de securitate

- Amenințări la adresa securității

- instrumente de securitate

- Căuta

- caută

- urmăreşte

- selecta

- selectate

- senior

- sensibil

- servit

- serviciu

- Servicii

- set

- instalare

- comun

- ea

- să

- Arăta

- Vedere

- asemănător

- simplu

- simplifica

- simplificarea

- So

- socializare

- Software

- factura de software

- Dezvoltatori de software

- de dezvoltare de software

- soluţie

- soluţii

- unele

- Sursă

- Surse

- suveranitate

- Spaţiu

- Vorbitor

- specialist

- specific

- specific

- viteză

- stivui

- Stadiile

- părțile interesate

- standard

- standarde

- Începe

- început

- Pornire

- Startup-urile

- statistică

- paşi

- Încă

- depozitare

- stocate

- magazine

- Strategic

- strategii

- Strateg

- Strategie

- strict

- tare

- substanţial

- succes

- Reușit

- astfel de

- livra

- lanțului de aprovizionare

- Lanțurile de aprovizionare

- a sustine

- De sprijin

- sigur

- susceptibil

- suspicios

- sintetic

- sistem

- sisteme

- tabel

- adaptate

- Lua

- ia

- Tandem

- sarcini

- taxonomie

- echipă

- echipe

- Tehnic

- tehnici de

- Tehnologii

- tehnologi

- Tehnologia

- telecom

- test

- Testarea

- teste

- Texas

- a) Sport and Nutrition Awareness Day in Manasia Around XNUMX people from the rural commune Manasia have participated in a sports and healthy nutrition oriented activity in one of the community’s sports ready yards. This activity was meant to gather, mainly, middle-aged people from a Romanian rural community and teach them about the benefits that sports have on both their mental and physical health and on how sporting activities can be used to bring people from a community closer together. Three trainers were made available for this event, so that the participants would get the best possible experience physically and so that they could have the best access possible to correct information and good sports/nutrition practices. b) Sports Awareness Day in Poiana Țapului A group of young participants have taken part in sporting activities meant to teach them about sporting conduct, fairplay, and safe physical activities. The day culminated with a football match.

- acea

- Sursa

- furt

- lor

- Lor

- tematică

- se

- apoi

- Acolo.

- Acestea

- ei

- Gândire

- Al treilea

- terțe părți

- acest

- aceste

- amenințare

- inteligența amenințărilor

- amenințări

- trei

- Prin

- de-a lungul

- timp

- oportun

- TLS

- la

- împreună

- instrument

- Unelte

- top

- Top 10

- atingeţi

- față de

- Trading

- tradiţional

- trafic

- Tren

- dresat

- Pregătire

- tranzacție

- tranzit

- Transparență

- de transport

- Traveling

- Încredere

- de încredere

- tipic

- neautorizat

- Incertitudine

- în

- Submina

- înţelege

- înţelegere

- necunoscut

- Unit

- Regatul Unit

- universitate

- neatenuat

- Actualizează

- actualizat

- susține

- uptime

- utilizare

- carcasa de utilizare

- utilizat

- Utilizator

- utilizatorii

- utilizări

- folosind

- folosi

- utilizate

- Utilizand

- VALIDA

- validare

- validare

- valoare

- versat

- de

- Virtual

- practic

- imagina

- vs

- Vulnerabilitățile

- vulnerabilitate

- plimbări

- vrea

- Warrant

- a fost

- modalități de

- we

- web

- aplicatie web

- aplicații web

- servicii web

- BINE

- Ce

- cand

- dacă

- care

- în timp ce

- OMS

- întreg

- voi

- VIN

- Victorii

- cu

- în

- fără

- Apartamente

- a lucrat

- flux de lucru

- fluxuri de lucru

- de lucru

- la nivel internațional.

- ar

- scris

- XSS

- ani

- tu

- Ta

- zephyrnet