Esta postagem foi escrita em colaboração com Greg Benson, Cientista Chefe; Aaron Kesler, gerente sênior de produto; e Rich Dill, arquiteto de soluções empresariais da SnapLogic.

Muitos clientes estão criando aplicativos generativos de IA em Rocha Amazônica e Sussurrador de Código da Amazon para criar artefatos de código baseados em linguagem natural. Este caso de uso destaca como os grandes modelos de linguagem (LLMs) são capazes de se tornar tradutores entre linguagens humanas (inglês, espanhol, árabe e mais) e linguagens interpretáveis por máquina (Python, Java, Scala, SQL e assim por diante), juntamente com linguagens sofisticadas. raciocínio interno. Essa capacidade emergente em LLMs obrigou os desenvolvedores de software a usar LLMs como uma ferramenta de automação e aprimoramento de UX que transforma a linguagem natural em uma linguagem específica de domínio (DSL): instruções do sistema, solicitações de API, artefatos de código e muito mais. Neste post, mostramos como SnapLogic, um cliente da AWS, usou o Amazon Bedrock para potencializar seu SnapGPT produto através da criação automatizada desses artefatos DSL complexos a partir da linguagem humana.

Quando os clientes criam objetos DSL a partir de LLMs, o DSL resultante é uma réplica exata ou um derivado de dados e esquemas de interface existentes que formam o contrato entre a UI e a lógica de negócios no serviço de apoio. Esse padrão é particularmente tendência entre fornecedores independentes de software (ISVs) e ISVs de software como serviço (SaaS) devido à sua maneira única de representar configurações por meio de código e ao desejo de simplificar a experiência do usuário para seus clientes. Exemplos de casos de uso incluem:

A maneira mais direta de criar e dimensionar aplicativos text-to-pipeline com LLMs na AWS é usar o Amazon Bedrock. O Amazon Bedrock é a maneira mais fácil de criar e dimensionar aplicações generativas de IA com modelos básicos (FMs). É um serviço totalmente gerenciado que oferece acesso a uma variedade de FMs básicos de alto desempenho da IA líder por meio de uma única API, juntamente com um amplo conjunto de recursos necessários para criar aplicativos generativos de IA com privacidade e segurança. A Anthropic, um laboratório de pesquisa e segurança de IA que cria sistemas de IA confiáveis, interpretáveis e orientáveis, é uma das empresas líderes em IA que oferece acesso ao seu LLM de última geração, Claude, no Amazon Bedrock. Claude é um LLM que se destaca em uma ampla gama de tarefas, desde diálogo cuidadoso, criação de conteúdo, raciocínio complexo, criatividade e codificação. A Anthropic oferece modelos Claude e Claude Instant, todos disponíveis no Amazon Bedrock. Claude rapidamente ganhou popularidade nesses aplicativos de texto para pipeline devido à sua capacidade de raciocínio aprimorada, o que lhe permite se destacar na resolução de problemas técnicos ambíguos. Claude 2 no Amazon Bedrock oferece suporte a uma janela de contexto de 100,000 tokens, o que equivale a cerca de 200 páginas de texto em inglês. Esse é um recurso particularmente importante no qual você pode confiar ao criar aplicativos de texto para pipeline que exigem raciocínio complexo, instruções detalhadas e exemplos abrangentes.

Plano de fundo do SnapLogic

SnapLogic é um cliente da AWS com a missão de levar a automação empresarial ao mundo. A Plataforma de Integração Inteligente SnapLogic (IIP) permite que as organizações realizem automação em toda a empresa, conectando todo o seu ecossistema de aplicativos, bancos de dados, big data, máquinas e dispositivos, APIs e muito mais com conectores inteligentes pré-construídos chamados Snaps. SnapLogic lançou recentemente um recurso chamado SnapGPT, que fornece uma interface de texto onde você pode digitar o pipeline de integração desejado que deseja criar em linguagem humana simples. SnapGPT usa o modelo Claude da Anthropic por meio do Amazon Bedrock para automatizar a criação desses pipelines de integração como código, que são então usados por meio da principal solução de integração da SnapLogic. No entanto, a jornada do SnapLogic para o SnapGPT foi o culminar de muitos anos de operação no espaço de IA.

A jornada de IA do SnapLogic

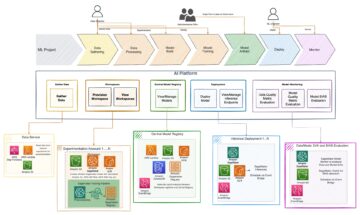

No domínio das plataformas de integração, o SnapLogic tem estado consistentemente na vanguarda, aproveitando o poder transformador da inteligência artificial. Ao longo dos anos, o compromisso da empresa em inovar com IA ficou evidente, principalmente quando traçamos a jornada desde íris para AutoLink.

O começo humilde com Iris

Em 2017, a SnapLogic revelou o Iris, o primeiro assistente de integração com tecnologia de IA do setor. O Iris foi projetado para usar algoritmos de aprendizado de máquina (ML) para prever as próximas etapas na construção de um pipeline de dados. Ao analisar milhões de elementos de metadados e fluxos de dados, a Iris poderia fazer sugestões inteligentes aos usuários, democratizando a integração de dados e permitindo que mesmo aqueles sem um profundo conhecimento técnico criassem fluxos de trabalho complexos.

AutoLink: Construindo impulso

Com base no sucesso e nos aprendizados da Iris, a SnapLogic introduziu o AutoLink, um recurso que visa simplificar ainda mais o processo de mapeamento de dados. A tediosa tarefa de mapear manualmente os campos entre os sistemas de origem e de destino tornou-se muito fácil com o AutoLink. Usando IA, o AutoLink identificou e sugeriu automaticamente possíveis correspondências. Integrações que antes levavam horas podiam ser executadas em poucos minutos.

O salto generativo com SnapGPT

A última incursão do SnapLogic em IA nos traz o SnapGPT, que visa revolucionar ainda mais a integração. Com o SnapGPT, o SnapLogic apresenta a primeira solução de integração generativa do mundo. Não se trata apenas de simplificar os processos existentes, mas de reimaginar totalmente como as integrações são projetadas. O poder da IA generativa pode criar pipelines de integração inteiros do zero, otimizando o fluxo de trabalho com base no resultado desejado e nas características dos dados.

O SnapGPT é extremamente impactante para os clientes do SnapLogic porque eles são capazes de diminuir drasticamente o tempo necessário para gerar seu primeiro pipeline do SnapLogic. Tradicionalmente, os clientes do SnapLogic precisariam passar dias ou semanas configurando pipelines de integração do zero. Agora, esses clientes podem simplesmente pedir ao SnapGPT para, por exemplo, “criar um pipeline que moverá todos os meus clientes SFDC ativos para o WorkDay”. Um primeiro rascunho funcional de um pipeline é criado automaticamente para esse cliente, reduzindo drasticamente o tempo de desenvolvimento necessário para a criação da base de seu pipeline de integração. Isso permite que o cliente final gaste mais tempo concentrando-se no que tem verdadeiro impacto nos negócios, em vez de trabalhar nas configurações de um pipeline de integração. O exemplo a seguir mostra como um cliente SnapLogic pode inserir uma descrição no recurso SnapGPT para gerar rapidamente um pipeline, usando linguagem natural.

AWS e SnapLogic colaboraram estreitamente durante a construção deste produto e aprenderam muito ao longo do caminho. O restante desta postagem se concentrará nos aprendizados técnicos que a AWS e o SnapLogic tiveram sobre o uso de LLMs para aplicativos de texto para pipeline.

Visão geral da solução

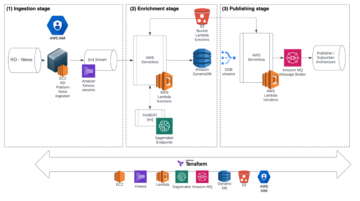

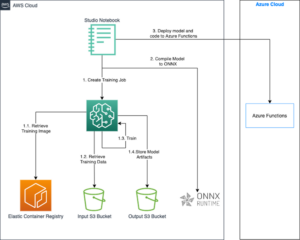

Para resolver esse problema de texto para pipeline, a AWS e a SnapLogic projetaram uma solução abrangente mostrada na arquitetura a seguir.

Uma solicitação ao SnapGPT passa pelo seguinte fluxo de trabalho:

- Um usuário envia uma descrição para o aplicativo.

- SnapLogic usa uma abordagem de geração aumentada de recuperação (RAG) para recuperar exemplos relevantes de pipelines SnapLogic que são semelhantes à solicitação do usuário.

- Esses exemplos relevantes extraídos são combinados com a entrada do usuário e passam por algum pré-processamento de texto antes de serem enviados para Claude no Amazon Bedrock.

- Claude produz um artefato JSON que representa um pipeline SnapLogic.

- O artefato JSON é diretamente integrado à plataforma central de integração SnapLogic.

- O pipeline SnapLogic é renderizado ao usuário de maneira visualmente amigável.

Por meio de vários experimentos entre AWS e SnapLogic, descobrimos que a etapa imediata de engenharia do diagrama de solução é extremamente importante para gerar resultados de alta qualidade para essas saídas de texto para pipeline. A próxima seção aborda algumas técnicas específicas usadas com Claude neste espaço.

Experimentação imediata

Durante a fase de desenvolvimento do SnapGPT, a AWS e o SnapLogic descobriram que a iteração rápida nos prompts enviados a Claude era uma tarefa de desenvolvimento crítica para melhorar a precisão e a relevância das saídas de texto para pipeline nas saídas do SnapLogic. Usando Estúdio Amazon SageMaker notebooks interativos, a equipe da AWS e do SnapLogic conseguiu trabalhar rapidamente em diferentes versões de prompts usando o Conexão Boto3 SDK com Amazon Bedrock. O desenvolvimento baseado em notebook permitiu que as equipes criassem rapidamente conexões do lado do cliente com o Amazon Bedrock, incluíssem descrições baseadas em texto junto com o código Python para enviar prompts ao Amazon Bedrock e realizassem sessões conjuntas de engenharia de prompts onde as iterações eram feitas rapidamente entre várias personas.

Métodos de engenharia imediatos do Antrópico Claude

Nesta seção, descrevemos algumas das técnicas iterativas que usamos para criar um prompt de alto desempenho com base em uma solicitação ilustrativa do usuário: “Faça um pipeline que use o banco de dados ExemploCompany que recupera todos os clientes ativos”. Observe que este exemplo não é o esquema pelo qual o SnapGPT é desenvolvido e é usado apenas para ilustrar um aplicativo de texto para pipeline.

Para basear nossa engenharia de prompt, usamos o seguinte prompt original:

Faça um pipeline que use o banco de dados ExemploCompany que recupera todos os clientes ativos

A saída esperada é a seguinte:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Melhoria nº 1: usando as anotações humanas e assistentes

O procedimento de treinamento de Claude ensina o FM a compreender o diálogo entre um humano e um assistente em sua estrutura imediata. Os usuários do Claude podem aproveitar essa estrutura encerrando seu prompt no Assistant:, o que fará com que Claude comece a gerar a resposta a uma consulta com base no que o humano disse. Observe que, como Claude continuará gerando texto até que seja solicitado que pare, certifique-se de usar uma sequência de parada de nnHuman: na solicitação de API para o Amazon Bedrock ao usar Claude. Isso garantirá que você receba apenas a resposta do assistente e não a próxima resposta prevista do humano na cadeia de diálogo. Estes indicadores nnHuman e nnAssistant não só ajudam a limitar a resposta de Claude a informações relevantes, mas também ajudam a fornecer uma demarcação clara entre as contribuições humanas primárias e as respostas dos assistentes de outras interações. Isso ajuda especialmente em uma configuração de prompt de poucos disparos, onde você pode ter várias consultas e respostas com consultas marcadas com nnHuman e respostas anteriores marcadas com nnAssistant. Vejamos o prompt aprimorado e a chamada de API ilustrativa associada para Amazon Bedrock por meio do Boto3 SDK.

Usamos o seguinte prompt:

Humano: crie um pipeline que use o banco de dados ExemploCompany que recupera todos os clientes ativos

Assistente:

O resultado é o seguinte:

Aqui está um pipeline do MongoDB para recuperar todos os clientes ativos do banco de dados ExampleCompany:

pipeline = [ { '$match': { 'database': 'ExampleCompany', 'status': 'active' } } ] db.customers.aggregate(pipeline)As principais etapas são:

– `$match` para filtrar os documentos apenas para aqueles do banco de dados ExemploCompany e com status igual a “ativo”.

– `db.customers.agregate()` executa o pipeline na coleção de clientes e retorna os resultados filtrados.

Portanto, isso retornará todos os documentos do cliente do banco de dados ExemploCompany onde o campo de status está definido como “ativo”.

Observe como na saída, Claude responde à nossa pergunta sem qualquer contexto. A resposta é potencialmente útil, mas não é específica do problema que estamos tentando resolver porque não é fornecida com contexto suficiente. Também é importante notar que o Anthropic requer esse formato humano e assistente ao usar os modelos de Claude; se você não incluir esta etapa, o Amazon Bedrock retornará um erro.

Melhoria nº 2: inclua um contexto hiperespecífico para Claude antes que ele diga o que fazer

Claude tem melhor desempenho quando recebe um bom contexto sobre o que precisa realizar e como deve realizar essa tarefa. Aqui estão alguns exemplos de coisas a serem incluídas como contexto para Claude antes de você contar a tarefa:

- Descreva a função que você deseja que Claude cumpra. Ao fazer isso, você está fazendo Claude pensar no papel de alguém que trabalha naquele cargo, ou mais como alguém que acabou de ser contratado para aquele cargo específico. Isso ajudará Claude a formular a resposta a partir da perspectiva daquela função específica, reduzindo a alucinação e a aleatoriedade na resposta.

- Inclua detalhes técnicos sobre o formato de saída. Os modelos básicos geralmente são bons para seguir ações, portanto, pedir ao Claude para gerar a saída em um formato ou esquema específico com um ou alguns exemplos ajudará Claude a fornecer a resposta no formato correto, reduzindo a necessidade de filtragem e pós-processamento da saída. O exemplo no prompt a seguir mostra um esquema fictício que corresponde à saída esperada.

Vamos combinar essas sugestões para melhorar nosso prompt original:

Humano: Seu trabalho é atuar como especialista em pipelines ETL. Especificamente, seu trabalho é criar uma representação JSON de um pipeline ETL que resolverá a solicitação do usuário fornecida a você.

A saída JSON deve seguir o seguinte formato:

Aqui está sua tarefa: crie um pipeline que use o banco de dados ExemploCompany que recupera todos os clientes ativos

Assistente:

O resultado é o seguinte:

Aqui está uma representação JSON de um pipeline ETL para recuperar todos os clientes ativos do banco de dados ExampleCompany:

Este pipeline usa o banco de dados ExemploCompany e uma consulta SQL para selecionar todos os registros da tabela de clientes onde o status é 'ativo'.

Com a adição de contexto, o modelo agora é capaz de percorrer a maior parte do caminho até a nossa resposta. Agora ele sabe como estruturar a saída e entende que precisa escrever uma instrução SQL para resolver a tarefa. No entanto, você notará que o modelo não usa corretamente a nomenclatura ec_prod.customers que esperamos. Espaço para melhorias! Observe também que, na prática, você precisará incluir significativamente mais contexto do que o fornecido neste exemplo para obter resultados de alta qualidade em casos de uso de texto para pipeline.

Melhoria nº 3: incluir exemplos em tags XML

O aprendizado rápido é uma forma popular de aumentar a precisão dos FMs, onde você tem exemplos relevantes para orientar o FM em sua tarefa. Isso é particularmente importante ao trabalhar em aplicativos de texto para pipeline porque essas saídas de pipeline hiperespecíficas geralmente não são incluídas em nenhum conjunto de dados público porque são específicas para a representação de dados de um cliente individual. Ao usar o Claude, você pode aproveitar seu conhecimento inato de tags XML arbitrárias para fornecer esses exemplos em formato resumido. No prompt aprimorado a seguir, observe a adição de exemplos entre Etiquetas XML. Além disso, você pode usar abreviações para humano e assistente com H e A para contextualizar Claude sem fazê-lo pensar que essas eram partes específicas do diálogo que já ocorreram.

Usamos o seguinte prompt:

Humano: Seu trabalho é atuar como especialista em pipelines ETL. Especificamente, seu trabalho é criar uma representação JSON de um pipeline ETL que resolverá a solicitação do usuário fornecida a você.

A saída JSON deve seguir o seguinte formato:

Aqui estão alguns exemplos de solicitações de usuários e artefatos JSON de saída associados que resolvem corretamente a tarefa fornecida. Certifique-se de usar a mesma nomenclatura fornecida nos exemplos se estiver usando os mesmos bancos de dados.

H: consulte o banco de dados ExemploCompany para quaisquer pedidos ativos para o cliente #1234

A:

O raciocínio para esta consulta é que o cliente #1234 está filtrado e estamos pesquisando na tabela “pedidos” por quaisquer registros existentes após o filtro “ativo”.

H: remova todos os clientes do banco de dados ExemploCompany que não estiveram ativos no último mês

A:

O raciocínio para esta consulta é que a tabela “ec_prod.customers” é a única tabela no banco de dados ExemploCompany que contém registros de clientes.

Aqui está sua tarefa: criar um pipeline que use o banco de dados ExampleCompany que recupera todos os clientes ativos.

Assistente:

O resultado é o seguinte:

Aqui está a representação JSON de um pipeline ETL para recuperar todos os clientes ativos do banco de dados ExampleCompany:

O raciocínio é:

O banco de dados ExampleCompany é especificado como o banco de dados a ser usado

A tabela ec_prod.customers contém os dados do cliente

O campo de status indica se um cliente está ativo para que a consulta seja filtrada apenas por clientes ativos

Isso deve recuperar todos os registros de clientes ativos do banco de dados ExampleCompany. Deixe-me saber se precisar de algum esclarecimento ou tiver requisitos adicionais para o pipeline de ETL!

A saída JSON agora tem a nomenclatura correta do banco de dados, que Claude conseguiu usar devido aos exemplos que fornecemos. O acoplamento de indicadores humanos e assistentes com tags XML torna mais fácil para Claude entender qual é a tarefa e qual foi a resposta em exemplos semelhantes, com uma separação muito clara entre vários exemplos de poucas tentativas. Quanto mais fácil for para Claude entender, melhor e mais relevante será a resposta, reduzindo ainda mais a chance de o modelo ter alucinações e fornecer respostas aleatórias e irrelevantes.

Melhoria nº 4: acionando Claude para iniciar a geração JSON com tags XML

Um pequeno desafio com aplicações de texto para pipeline usando FMs é a necessidade de analisar exatamente uma saída do texto resultante para que possa ser interpretada como código em uma aplicação downstream. Uma maneira de resolver isso com Claude é aproveitar a compreensão da tag XML e combiná-la com uma sequência de parada personalizada. No prompt a seguir, instruímos Claude a colocar a saída em Etiquetas XML. Então, adicionamos o tag no final do prompt. Isso garante que o primeiro texto que sai de Claude será o início da saída JSON. Se você não fizer isso, Claude geralmente responde com algum texto de conversação e, em seguida, com a verdadeira resposta em código. Ao instruir Claude para começar imediatamente a gerar a saída, você pode facilmente interromper a geração quando vir o fechamento marcação. Isso é mostrado na chamada atualizada da API Boto3. Os benefícios desta técnica são duplos. Primeiro, você é capaz de analisar exatamente a resposta do código de Claude. Segundo, você pode reduzir custos porque Claude gera apenas saídas de código e nenhum texto extra. Isso reduz o custo no Amazon Bedrock porque você é cobrado por cada token produzido como saída de todos os FMs.

Usamos o seguinte prompt:

Humano: Seu trabalho é atuar como especialista em pipelines ETL. Especificamente, seu trabalho é criar uma representação JSON de um pipeline ETL que resolverá a solicitação do usuário fornecida a você.

A saída JSON deve seguir o seguinte formato:

Aqui estão alguns exemplos de solicitações de usuários e artefatos JSON de saída associados que resolvem corretamente a tarefa fornecida. Certifique-se de usar a mesma nomenclatura fornecida nos exemplos se estiver usando os mesmos bancos de dados.

H: consulte o banco de dados ExemploCompany para quaisquer pedidos ativos para o cliente #1234

A:

O raciocínio para esta consulta é que o cliente #1234 está filtrado e estamos pesquisando na tabela “pedidos” por quaisquer registros existentes após o filtro “ativo”.

H: remova todos os clientes do banco de dados ExemploCompany que não estiveram ativos no último mês

A:

O raciocínio para esta consulta é que a tabela “ec_prod.customers” é a única tabela no banco de dados ExemploCompany que contém registros de clientes.

Lembre-se sempre de incluir suas saídas JSON em Tag.

Aqui está sua tarefa: criar um pipeline que use o banco de dados ExampleCompany que recupera todos os clientes ativos.

Assistente:

Usamos o seguinte código:

body = json.dumps({"prompt": prompt, "stop_sequences": ['nnHuman:', '</json>']})

response = bedrock.invoke_model(

body=body,

modelId='anthropic.claude-v2'

)O resultado é o seguinte:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Agora chegamos à saída esperada com apenas o objeto JSON retornado! Ao usar este método, somos capazes de gerar um artefato técnico imediatamente utilizável, bem como reduzir o custo de geração, reduzindo os tokens de saída.

Conclusão

Para começar hoje mesmo com o SnapGPT, solicite um teste gratuito do SnapLogic or solicite uma demonstração do produto. Se você quiser usar esses conceitos para criar aplicativos hoje, recomendamos experimentando na prática com a seção de engenharia imediata nesta postagem, usando o mesmo fluxo em um caso de uso de geração DSL diferente que se adapte ao seu negócio e se aprofundando no Recursos RAG disponíveis no Amazon Bedrock.

SnapLogic e AWS conseguiram formar uma parceria eficaz para construir um tradutor avançado entre a linguagem humana e o esquema complexo de pipelines de integração SnapLogic desenvolvidos pelo Amazon Bedrock. Ao longo desta jornada, vimos como a saída gerada com Claude pode ser melhorada em aplicações text-to-pipeline usando técnicas específicas de engenharia imediata. A AWS e a SnapLogic estão entusiasmadas em continuar esta parceria em IA generativa e esperam colaboração e inovação futuras neste espaço em rápida evolução.

Sobre os autores

Greg Benson é professor de Ciência da Computação na Universidade de São Francisco e cientista-chefe da SnapLogic. Ele ingressou no Departamento de Ciência da Computação da USF em 1998 e ministrou cursos de graduação e pós-graduação, incluindo sistemas operacionais, arquitetura de computadores, linguagens de programação, sistemas distribuídos e programação introdutória. Greg publicou pesquisas nas áreas de sistemas operacionais, computação paralela e sistemas distribuídos. Desde que ingressou na SnapLogic em 2010, Greg ajudou a projetar e implementar vários recursos importantes da plataforma, incluindo processamento de cluster, processamento de big data, arquitetura de nuvem e aprendizado de máquina. Atualmente ele está trabalhando em IA generativa para integração de dados.

Greg Benson é professor de Ciência da Computação na Universidade de São Francisco e cientista-chefe da SnapLogic. Ele ingressou no Departamento de Ciência da Computação da USF em 1998 e ministrou cursos de graduação e pós-graduação, incluindo sistemas operacionais, arquitetura de computadores, linguagens de programação, sistemas distribuídos e programação introdutória. Greg publicou pesquisas nas áreas de sistemas operacionais, computação paralela e sistemas distribuídos. Desde que ingressou na SnapLogic em 2010, Greg ajudou a projetar e implementar vários recursos importantes da plataforma, incluindo processamento de cluster, processamento de big data, arquitetura de nuvem e aprendizado de máquina. Atualmente ele está trabalhando em IA generativa para integração de dados.

Aaron Kesler é gerente de produto sênior para produtos e serviços de IA na SnapLogic, Aaron aplica mais de dez anos de experiência em gerenciamento de produtos para ser pioneiro no desenvolvimento de produtos de IA/ML e evangelizar serviços em toda a organização. Ele é o autor do próximo livro “Qual é o seu problema?” com o objetivo de orientar novos gerentes de produto através da carreira de gerenciamento de produto. Sua jornada empreendedora começou com sua startup universitária, STAK, que mais tarde foi adquirida pela Carvertise, com Aaron contribuindo significativamente para seu reconhecimento como Tech Startup of the Year 2015 em Delaware. Além de suas atividades profissionais, Aaron encontra alegria em jogar golfe com seu pai, explorar novas culturas e comidas em suas viagens e praticar ukulele.

Aaron Kesler é gerente de produto sênior para produtos e serviços de IA na SnapLogic, Aaron aplica mais de dez anos de experiência em gerenciamento de produtos para ser pioneiro no desenvolvimento de produtos de IA/ML e evangelizar serviços em toda a organização. Ele é o autor do próximo livro “Qual é o seu problema?” com o objetivo de orientar novos gerentes de produto através da carreira de gerenciamento de produto. Sua jornada empreendedora começou com sua startup universitária, STAK, que mais tarde foi adquirida pela Carvertise, com Aaron contribuindo significativamente para seu reconhecimento como Tech Startup of the Year 2015 em Delaware. Além de suas atividades profissionais, Aaron encontra alegria em jogar golfe com seu pai, explorar novas culturas e comidas em suas viagens e praticar ukulele.

endro rico é um arquiteto de soluções principal com experiência em diversas áreas de especialização. Um histórico de sucesso abrangendo software empresarial multiplataforma e SaaS. Bem conhecido por transformar a defesa do cliente (servindo como a voz do cliente) em novos recursos e produtos geradores de receita. Capacidade comprovada de levar produtos de ponta ao mercado e concluir projetos dentro do prazo e do orçamento em ambientes onshore e offshore de ritmo acelerado. Uma maneira simples de me descrever: a mente de um cientista, o coração de um explorador e a alma de um artista.

endro rico é um arquiteto de soluções principal com experiência em diversas áreas de especialização. Um histórico de sucesso abrangendo software empresarial multiplataforma e SaaS. Bem conhecido por transformar a defesa do cliente (servindo como a voz do cliente) em novos recursos e produtos geradores de receita. Capacidade comprovada de levar produtos de ponta ao mercado e concluir projetos dentro do prazo e do orçamento em ambientes onshore e offshore de ritmo acelerado. Uma maneira simples de me descrever: a mente de um cientista, o coração de um explorador e a alma de um artista.

Clay Elmore é arquiteto de soluções especialista em IA/ML na AWS. Depois de passar muitas horas em um laboratório de pesquisa de materiais, sua formação em engenharia química foi rapidamente deixada para trás para prosseguir seu interesse em aprendizado de máquina. Ele trabalhou em aplicações de ML em diversos setores, desde comércio de energia até marketing hoteleiro. O trabalho atual de Clay na AWS se concentra em ajudar os clientes a trazer práticas de desenvolvimento de software para cargas de trabalho de ML e IA generativas, permitindo que os clientes criem soluções repetíveis e escaláveis nesses ambientes complexos. Nas horas vagas, Clay gosta de esquiar, resolver cubos de Rubik, ler e cozinhar.

Clay Elmore é arquiteto de soluções especialista em IA/ML na AWS. Depois de passar muitas horas em um laboratório de pesquisa de materiais, sua formação em engenharia química foi rapidamente deixada para trás para prosseguir seu interesse em aprendizado de máquina. Ele trabalhou em aplicações de ML em diversos setores, desde comércio de energia até marketing hoteleiro. O trabalho atual de Clay na AWS se concentra em ajudar os clientes a trazer práticas de desenvolvimento de software para cargas de trabalho de ML e IA generativas, permitindo que os clientes criem soluções repetíveis e escaláveis nesses ambientes complexos. Nas horas vagas, Clay gosta de esquiar, resolver cubos de Rubik, ler e cozinhar.

Sina Sojoodi é executivo de tecnologia, engenheiro de sistemas, líder de produto, ex-fundador e consultor de startups. Ele ingressou na AWS em março de 2021 como arquiteto de soluções principal. Sina é atualmente o arquiteto de soluções líder da área ISV dos EUA. Ele trabalha com empresas de software SaaS e B2B para construir e expandir seus negócios na AWS. Antes de sua função na Amazon, Sina foi executivo de tecnologia na VMware e na Pivotal Software (IPO em 2018, VMware M&A em 2020) e ocupou vários cargos de liderança, incluindo engenheiro fundador na Xtreme Labs (aquisição da Pivotal em 2013). Sina dedicou os últimos 15 anos de sua experiência profissional à construção de plataformas e práticas de software para empresas, empresas de software e setor público. Ele é um líder do setor com paixão pela inovação. Sina é bacharel pela Universidade de Waterloo, onde estudou Engenharia Elétrica e Psicologia.

Sina Sojoodi é executivo de tecnologia, engenheiro de sistemas, líder de produto, ex-fundador e consultor de startups. Ele ingressou na AWS em março de 2021 como arquiteto de soluções principal. Sina é atualmente o arquiteto de soluções líder da área ISV dos EUA. Ele trabalha com empresas de software SaaS e B2B para construir e expandir seus negócios na AWS. Antes de sua função na Amazon, Sina foi executivo de tecnologia na VMware e na Pivotal Software (IPO em 2018, VMware M&A em 2020) e ocupou vários cargos de liderança, incluindo engenheiro fundador na Xtreme Labs (aquisição da Pivotal em 2013). Sina dedicou os últimos 15 anos de sua experiência profissional à construção de plataformas e práticas de software para empresas, empresas de software e setor público. Ele é um líder do setor com paixão pela inovação. Sina é bacharel pela Universidade de Waterloo, onde estudou Engenharia Elétrica e Psicologia.

Sandeep Rohilla é arquiteto de soluções sênior na AWS, oferecendo suporte a clientes ISV na região oeste dos EUA. Ele se concentra em ajudar os clientes a arquitetar soluções que aproveitam contêineres e IA generativa na nuvem AWS. Sandeep é apaixonado por compreender os problemas de negócios dos clientes e ajudá-los a atingir seus objetivos por meio da tecnologia. Ele ingressou na AWS depois de trabalhar mais de uma década como arquiteto de soluções, aproveitando seus 17 anos de experiência. Sandeep possui um mestrado. em Engenharia de Software pela University of the West of England em Bristol, Reino Unido.

Sandeep Rohilla é arquiteto de soluções sênior na AWS, oferecendo suporte a clientes ISV na região oeste dos EUA. Ele se concentra em ajudar os clientes a arquitetar soluções que aproveitam contêineres e IA generativa na nuvem AWS. Sandeep é apaixonado por compreender os problemas de negócios dos clientes e ajudá-los a atingir seus objetivos por meio da tecnologia. Ele ingressou na AWS depois de trabalhar mais de uma década como arquiteto de soluções, aproveitando seus 17 anos de experiência. Sandeep possui um mestrado. em Engenharia de Software pela University of the West of England em Bristol, Reino Unido.

Dr. Farooq Sabir é arquiteto sênior de soluções de inteligência artificial e aprendizado de máquina da AWS. Ele possui doutorado e mestrado em Engenharia Elétrica pela Universidade do Texas em Austin e mestrado em Ciência da Computação pelo Georgia Institute of Technology. Ele tem mais de 15 anos de experiência profissional e também gosta de ensinar e orientar estudantes universitários. Na AWS, ele ajuda os clientes a formular e resolver seus problemas de negócios em ciência de dados, aprendizado de máquina, visão computacional, inteligência artificial, otimização numérica e domínios relacionados. Com sede em Dallas, Texas, ele e sua família adoram viajar e fazer longas viagens.

Dr. Farooq Sabir é arquiteto sênior de soluções de inteligência artificial e aprendizado de máquina da AWS. Ele possui doutorado e mestrado em Engenharia Elétrica pela Universidade do Texas em Austin e mestrado em Ciência da Computação pelo Georgia Institute of Technology. Ele tem mais de 15 anos de experiência profissional e também gosta de ensinar e orientar estudantes universitários. Na AWS, ele ajuda os clientes a formular e resolver seus problemas de negócios em ciência de dados, aprendizado de máquina, visão computacional, inteligência artificial, otimização numérica e domínios relacionados. Com sede em Dallas, Texas, ele e sua família adoram viajar e fazer longas viagens.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/how-snaplogic-built-a-text-to-pipeline-application-with-amazon-bedrock-to-translate-business-intent-into-action/

- :tem

- :é

- :não

- :onde

- $UP

- 10

- 100

- 121

- 14

- 15 anos

- 15%

- 150

- 17

- 1998

- 200

- 2010

- 2013

- 2015

- 2017

- 2018

- 2020

- 2021

- 31

- 33

- 7

- 8

- 9

- a

- Aaron

- habilidade

- Capaz

- Sobre

- Acesso

- realizar

- precisão

- Alcançar

- adquirido

- aquisição

- em

- Aja

- Açao Social

- ações

- ativo

- adicionado

- Adição

- Adicional

- avançado

- Vantagem

- assessor

- advocacia

- Depois de

- AI

- Sistemas de IA

- Alimentado por AI

- AI / ML

- Destinado

- visa

- algoritmos

- Todos os Produtos

- permitidas

- Permitindo

- permite

- juntamente

- ao lado de

- já

- tb

- Amazon

- Amazon Web Services

- quantidade

- an

- análise

- e

- responder

- respostas

- Antrópico

- qualquer

- api

- APIs

- Aplicação

- aplicações

- aplica

- abordagem

- Aplicativos

- árabe

- arquitetura

- SOMOS

- ÁREA

- áreas

- por aí

- chegou

- Arte

- artificial

- inteligência artificial

- Inteligência Artificial e Aprendizado de Máquinas

- artista

- AS

- perguntar

- pergunta

- Assistente

- associado

- At

- aumentado

- austin

- autor

- automatizar

- Automatizado

- automaticamente

- Automação

- disponível

- AWS

- Cliente AWS

- B2B

- fundo

- apoio

- base

- baseado

- Linha de Base

- BE

- Tenha

- passou a ser

- Porque

- tornam-se

- sido

- antes

- começou

- começar

- atrás

- ser

- Benefícios

- MELHOR

- Melhor

- entre

- Pós

- Grande

- Big Data

- livro

- ambos

- trazer

- Trazendo

- Traz

- Bristol

- amplo

- amplamente

- orçamento

- construir

- Prédio

- Constrói

- construído

- negócio

- impacto nos negócios

- negócios

- mas a

- by

- chamada

- chamado

- CAN

- capacidades

- Oportunidades

- casas

- casos

- Centros

- cadeia

- desafiar

- chance

- características

- carregada

- químico

- chefe

- escolha

- remover filtragem

- de perto

- encerramento

- Na nuvem

- Agrupar

- código

- Codificação

- colaborou

- colaboração

- coleção

- Faculdade

- combinar

- combinado

- vem

- compromisso

- Empresas

- Empresa

- obrigado

- realização

- integrações

- compreensivo

- computador

- Ciência da Computação

- Visão de Computador

- computação

- conceitos

- configurando

- Conexão de

- da conexão

- Coneções

- consistentemente

- Containers

- contém

- conteúdo

- Criação de conteúdo

- contexto

- continuar

- contract

- contribuindo

- conversação

- cozinha

- núcleo

- correta

- corretamente

- Custo

- poderia

- cursos

- crio

- criado

- criação

- criatividade

- crítico

- Atual

- Atualmente

- personalizadas

- cliente

- Clientes

- corte

- ponta

- Dallas

- dados,

- integração de dados

- informática

- ciência de dados

- banco de dados

- bases de dados

- dias

- década

- diminuir

- dedicado

- profundo

- mais profunda

- Delaware

- Demo

- Democratizando

- Departamento

- derivado

- descreve

- descrição

- Design

- projetado

- desejo

- desejado

- detalhado

- detalhes

- desenvolvedores

- Desenvolvimento

- Dispositivos/Instrumentos

- Diálogo

- diferente

- diretamente

- distribuído

- Sistemas distribuídos

- mergulho

- do

- INSTITUCIONAIS

- Não faz

- fazer

- domínios

- não

- down

- rascunho

- drasticamente

- distância

- dois

- cada

- mais fácil

- maneira mais fácil é

- facilmente

- ecossistema

- efetivamente

- ou

- Engenharia elétrica

- elementos

- permite

- final

- fim

- energia

- engenheiro

- Engenharia

- Inglaterra

- Inglês

- aprimoramento

- suficiente

- garantir

- garante

- Entrar

- Empreendimento

- software corporativo

- Soluções Empresariais

- empresas

- Todo

- inteiramente

- empreendedor

- ambientes

- igual

- Equivalente

- erro

- especialmente

- Éter (ETH)

- Mesmo

- evidente

- exatamente

- exemplo

- exemplos

- Excel

- animado

- executivo

- existente

- esperado

- esperando

- vasta experiência

- especialista

- experiência

- explorador

- Explorando

- extra

- extremamente

- família

- movendo rápido

- ritmo acelerado

- Característica

- Funcionalidades

- poucos

- campo

- Campos

- filtro

- filtragem

- filtros

- encontra

- Primeiro nome

- navio almirante

- fluxo

- Fluxos

- Foco

- concentra-se

- focando

- seguir

- seguinte

- segue

- alimentos

- Escolha

- Incursão

- Frente

- formato

- formas

- para a frente

- encontrado

- Foundation

- fundando

- Francisco

- amigável

- da

- Cumprir

- totalmente

- função

- mais distante

- futuro

- ganhou

- geralmente

- gerar

- gerado

- gera

- gerando

- geração

- generativo

- IA generativa

- Georgia Institute of Technology

- ter

- gif

- dado

- Go

- Objetivos

- vai

- Bom estado, com sinais de uso

- pós-graduação

- Cresça:

- guia

- tinha

- mão

- Aproveitamento

- Ter

- he

- Coração

- ajudar

- ajudou

- útil

- ajuda

- ajuda

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- Alta performance

- alta qualidade

- destaques

- sua

- segurar

- detém

- hospitalidade

- HORÁRIO

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTML

- HTTPS

- humano

- humilde

- identificado

- if

- ilustrar

- imediatamente

- Impacto

- impactante

- executar

- importante

- melhorar

- melhorado

- melhorar

- in

- incluir

- incluído

- Incluindo

- Crescimento

- de treinadores em Entrevista Motivacional

- indicam

- indicadores

- Individual

- indústrias

- indústria

- Líder da indústria

- INFORMAÇÕES

- inato

- inovando

- Inovação

- entrada

- inputs

- instantâneos

- em vez disso

- Instituto

- instruções

- integrado

- integração

- integrações

- Inteligência

- Inteligente

- intenção

- interações

- interativo

- interesse

- Interface

- interno

- para dentro

- introduzido

- Introduz

- introdutório

- IPO

- Isv

- IT

- iteração

- iterações

- ESTÁ

- Java

- Trabalho

- ingressou

- juntando

- articulação

- viagem

- alegria

- jpg

- json

- apenas por

- Chave

- Saber

- Conhecimento

- conhecido

- sabe

- laboratório

- Laboratório

- língua

- Idiomas

- grande

- Sobrenome

- mais tarde

- mais recente

- conduzir

- líder

- Liderança

- principal

- Saltar

- aprendido

- aprendizagem

- esquerda

- deixar

- aproveitando

- como

- gostos

- lógica

- longo

- olhar

- lote

- gosta,

- FANTASMA

- máquina

- aprendizado de máquina

- máquinas

- moldadas

- fazer

- FAZ

- Fazendo

- gerenciados

- de grupos

- Gerente

- Gerentes

- maneira

- manualmente

- muitos

- mapeamento

- Março

- mercado

- Marketing

- fósforos

- materiais

- me

- mentor

- mers

- metadados

- método

- milhões

- mente

- minutos

- Missão

- ML

- modelo

- modelos

- MongoDB

- mais

- a maioria

- mover

- MS

- Multi-Plataforma

- múltiplo

- my

- nome

- natural

- Linguagem Natural

- você merece...

- Cria

- Novo

- Novos Recursos

- produto novo

- Próximo

- não

- nota

- laptops

- Perceber..

- agora

- objeto

- objetos

- ocorreu

- of

- Oferece

- frequentemente

- on

- uma vez

- ONE

- só

- operando

- sistemas operacionais

- otimização

- otimizando

- or

- ordem

- ordens

- organização

- organizações

- original

- Outros

- A Nossa

- Fora

- Resultado

- saída

- outputs

- Acima de

- páginas

- Paralelo

- particularmente

- parceiro

- Google Cloud

- paixão

- apaixonado

- passado

- padrão

- executa

- perspectiva

- fase

- phd

- peças

- pioneiro

- oleoduto

- essencial

- Lugar

- plataforma

- Plataformas

- platão

- Inteligência de Dados Platão

- PlatãoData

- Popular

- popularidade

- Publique

- potencial

- potencialmente

- poder

- alimentado

- prática

- práticas

- predizer

- previsto

- anterior

- primário

- Diretor

- política de privacidade

- Privacidade e segurança

- Problema

- problemas

- procedimentos

- processo

- processos

- em processamento

- Produzido

- produz

- Produto

- desenvolvimento de produtos

- gestão de produtos

- gerente de produto

- Produtos

- Produtos e Serviços

- profissional

- Professor

- Programação

- linguagens de programação

- projetos

- solicita

- comprovado

- fornecer

- fornecido

- fornece

- fornecendo

- Psicologia

- público

- publicado

- Pesquisa publicada

- prosseguir

- Python

- consultas

- questão

- rapidamente

- acaso

- aleatoriedade

- alcance

- variando

- rápido

- Leitura

- perceber

- reino

- receber

- recentemente

- reconhecimento

- recomendar

- registro

- registros

- reduzir

- reduz

- redução

- em relação a

- região

- reimaginar

- relacionado

- liberado

- relevante

- confiável

- depender

- lembrar

- remover

- renderizado

- Repetivel

- responder

- representação

- representando

- representa

- solicitar

- pedidos

- requerer

- requeridos

- Requisitos

- exige

- pesquisa

- resposta

- respostas

- DESCANSO

- resultando

- Resultados

- retorno

- Retorna

- revolucionar

- Rico

- certo

- estrada

- Tipo

- papéis

- Quarto

- Execute

- é executado

- SaaS

- Segurança

- sábio

- Dito

- mesmo

- San

- San Francisco

- Scala

- escalável

- Escala

- cronograma

- Ciência

- Cientista

- arranhar

- Sdk

- pesquisar

- Segundo

- Seção

- setor

- segurança

- Vejo

- visto

- selecionar

- envio

- senior

- enviei

- Seqüência

- servido

- serviço

- Serviços

- de servir

- sessões

- conjunto

- contexto

- vários

- rede de apoio social

- mostrar

- mostrando

- Shows

- de forma considerável

- semelhante

- simples

- simplificar

- simplificando

- simplesmente

- desde

- solteiro

- pequeno

- So

- Software

- software como serviço

- Desenvolvedores de software

- desenvolvimento de software

- Engenharia de software

- solução

- Soluções

- RESOLVER

- Resolvendo

- alguns

- Alguém

- sofisticado

- alma

- fonte

- Espaço

- Espanhol

- abrangendo

- especialista

- específico

- especificamente

- especificada

- gastar

- Passar

- SQL

- começo

- começado

- inicialização

- Declaração

- Status

- Passo

- Passos

- Dê um basta

- franco

- estrutura

- Estudantes

- estudado

- sucesso

- Apoiar

- suportes

- suposto

- certo

- .

- sistemas

- mesa

- TAG

- Tire

- Target

- Tarefa

- tarefas

- ensinado

- Profissionais

- equipes

- tecnologia

- startup de tecnologia

- Dados Técnicos:

- técnica

- técnicas

- Tecnologia

- dizer

- dez

- texas

- texto

- do que

- que

- A

- O Ocidente

- o mundo

- deles

- Eles

- então

- Este

- deles

- coisas

- think

- isto

- aqueles

- Através da

- todo

- tempo

- para

- hoje

- token

- Tokens

- disse

- levou

- ferramenta

- traçar

- pista

- Trading

- tradicionalmente

- Training

- transformadora

- transformações

- traduzir

- viagens

- viaja

- trending

- julgamento

- desencadear

- desencadeando

- verdadeiro

- Código Verdadeiro

- tentando

- Passando

- tipo

- ui

- Uk

- para

- compreender

- compreensão

- entende

- único

- universidade

- até

- revelou

- os próximos

- Atualizada

- sobre

- us

- utilizável

- usar

- caso de uso

- usava

- Utilizador

- Experiência do Usuário

- usuários

- usos

- utilização

- geralmente

- ux

- vário

- fornecedores

- muito

- via

- visão

- visual

- vmware

- voz

- queremos

- foi

- Caminho..

- we

- web

- serviços web

- semanas

- BEM

- foram

- Ocidente

- O Quê

- O que é a

- quando

- qual

- Largo

- Ampla variedade

- precisarão

- janela

- de

- sem

- Atividades:

- trabalhou

- de gestão de documentos

- fluxos de trabalho

- trabalhar

- trabalho

- mundo

- do mundo

- seria

- escrever

- XML

- ano

- anos

- Você

- investimentos

- Youtube

- zefirnet