Esta postagem foi escrita em co-autoria com Jayadeep Pabbisetty, especialista sênior em engenharia de dados da Merck, e Prabakaran Mathaiyan, engenheiro sênior de ML da Tiger Analytics.

O grande ciclo de vida de desenvolvimento de modelo de aprendizado de máquina (ML) requer um processo escalonável de lançamento de modelo semelhante ao do desenvolvimento de software. Os desenvolvedores de modelos geralmente trabalham juntos no desenvolvimento de modelos de ML e exigem uma plataforma MLOps robusta para trabalhar. Uma plataforma MLOps escalável precisa incluir um processo para lidar com o fluxo de trabalho de registro, aprovação e promoção do modelo de ML para o próximo nível de ambiente (desenvolvimento, teste , UAT ou produção).

Um desenvolvedor de modelo normalmente começa a trabalhar em um ambiente de desenvolvimento de ML individual dentro Amazon Sage Maker. Quando um modelo está treinado e pronto para ser utilizado, ele precisa ser aprovado após ser cadastrado no Registro de modelos do Amazon SageMaker. Nesta postagem, discutimos como a equipe de IA/ML da AWS colaborou com a equipe de MLOps de TI da Merck Human Health para construir uma solução que usa um fluxo de trabalho automatizado para aprovação e promoção de modelos de ML com intervenção humana no meio.

Visão geral da solução

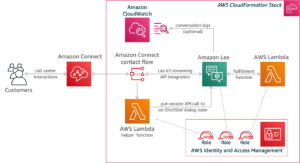

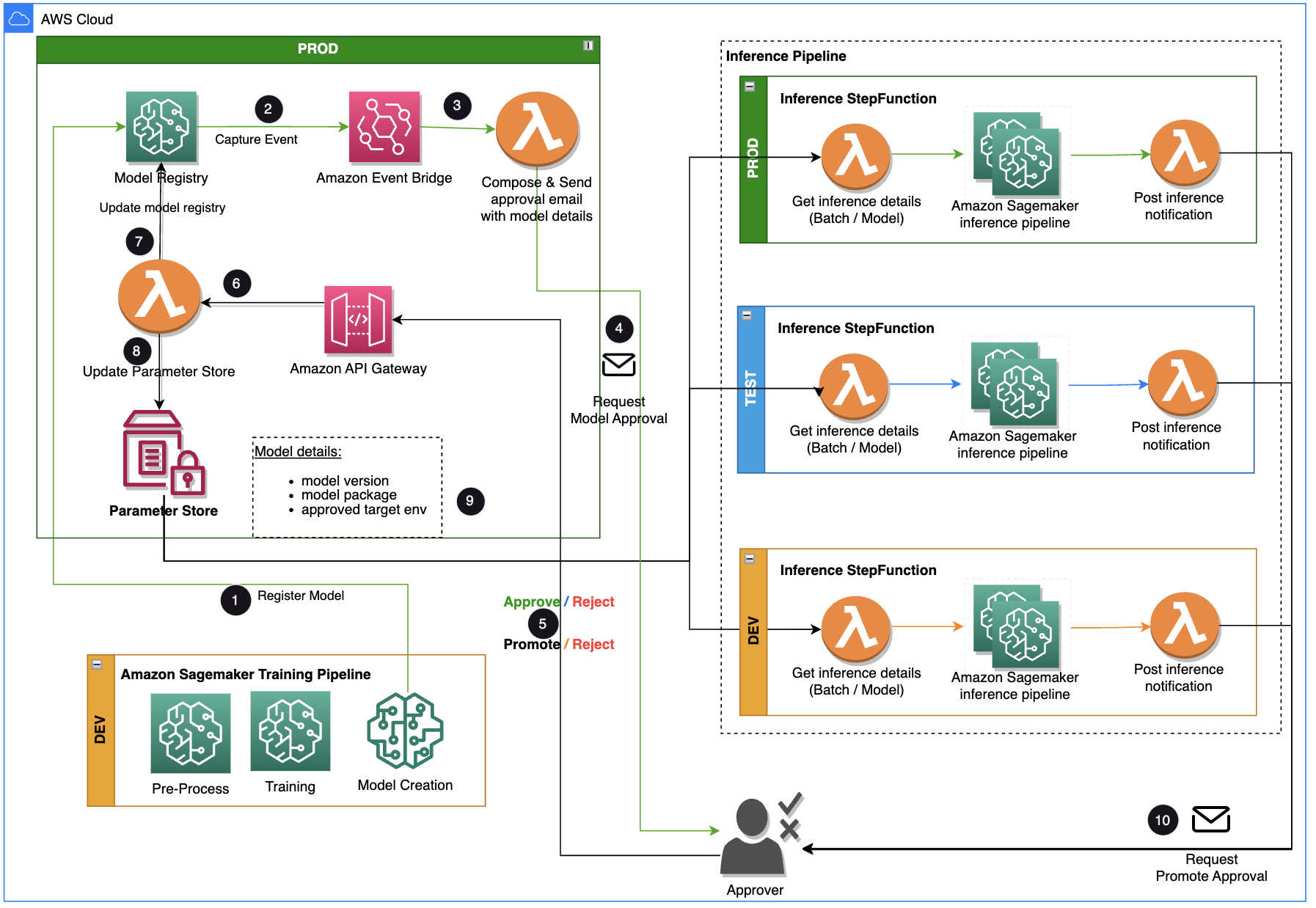

Esta postagem se concentra em uma solução de fluxo de trabalho que o ciclo de vida de desenvolvimento do modelo de ML pode usar entre o pipeline de treinamento e o pipeline de inferência. A solução fornece um fluxo de trabalho escalonável para MLOps no suporte ao processo de aprovação e promoção do modelo de ML com intervenção humana. Um modelo de ML registrado por um cientista de dados precisa de um aprovador para revisá-lo e aprová-lo antes de ser usado em um pipeline de inferência e no próximo nível de ambiente (teste, UAT ou produção). A solução usa AWS Lambda, Gateway de API da Amazon, Amazon Event Bridgee SageMaker para automatizar o fluxo de trabalho com intervenção de aprovação humana no meio. O diagrama de arquitetura a seguir mostra o design geral do sistema, os serviços da AWS usados e o fluxo de trabalho para aprovação e promoção de modelos de ML com intervenção humana, desde o desenvolvimento até a produção.

O fluxo de trabalho inclui as seguintes etapas:

- O pipeline de treinamento desenvolve e registra um modelo no registro de modelos do SageMaker. Neste ponto, o status do modelo é

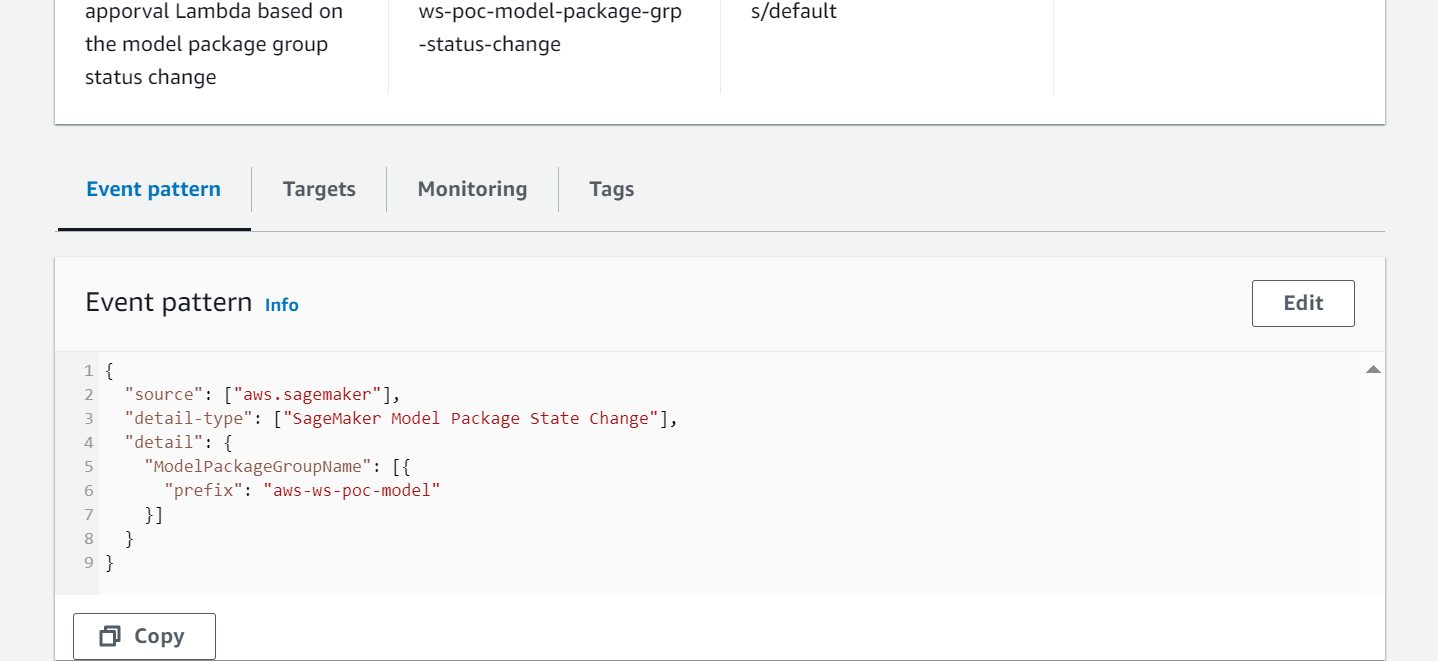

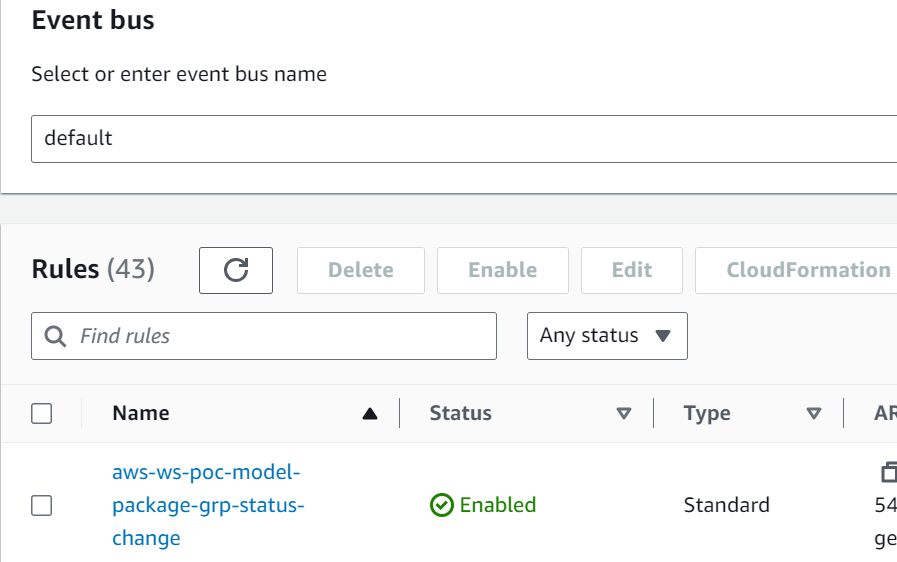

PendingManualApproval. - O EventBridge monitora eventos de mudança de status para executar ações automaticamente com regras simples.

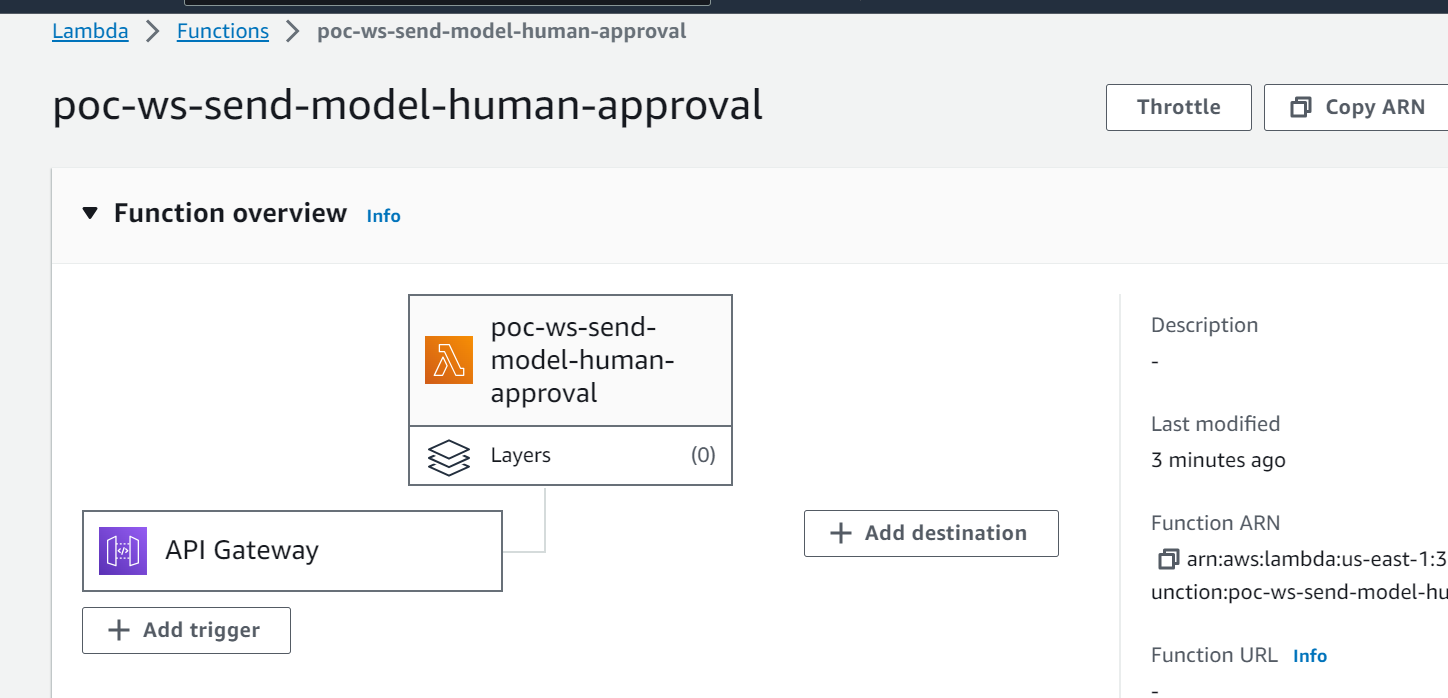

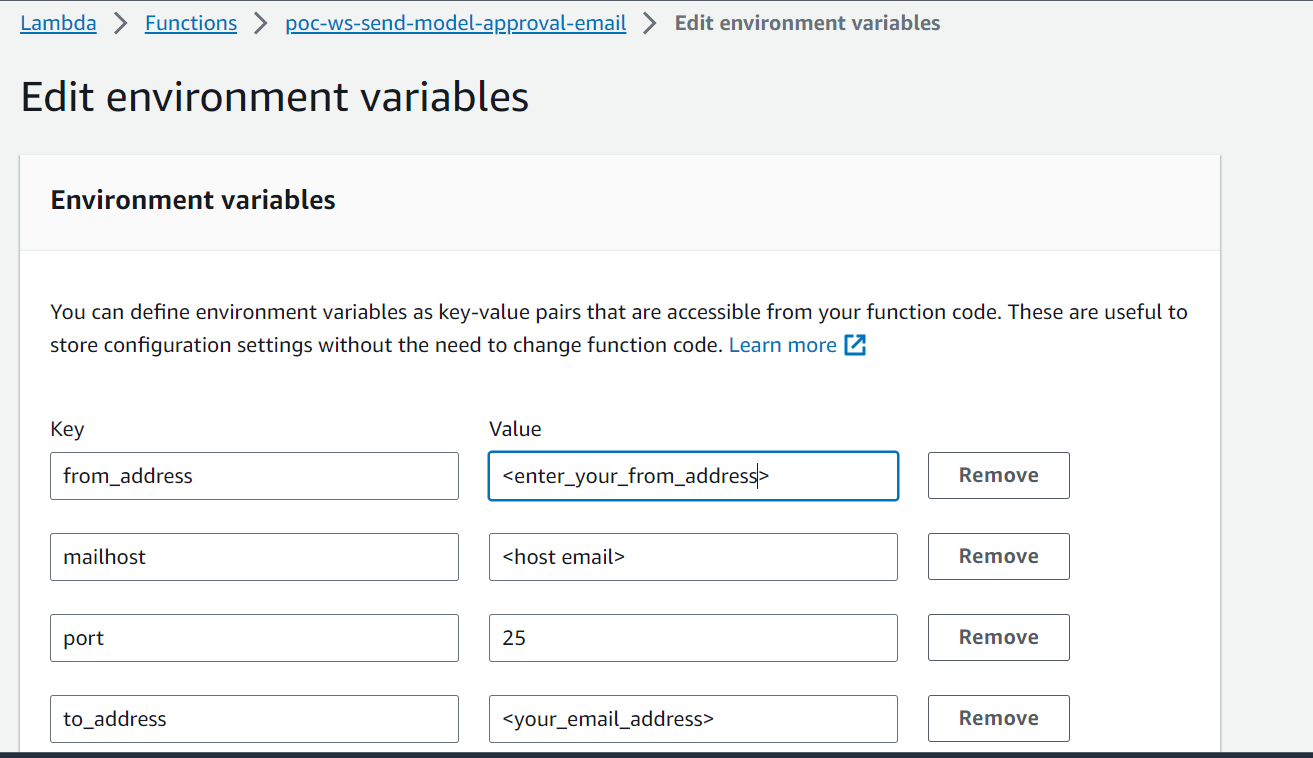

- A regra de evento de registro de modelo do EventBridge invoca uma função Lambda que cria um e-mail com um link para aprovar ou rejeitar o modelo registrado.

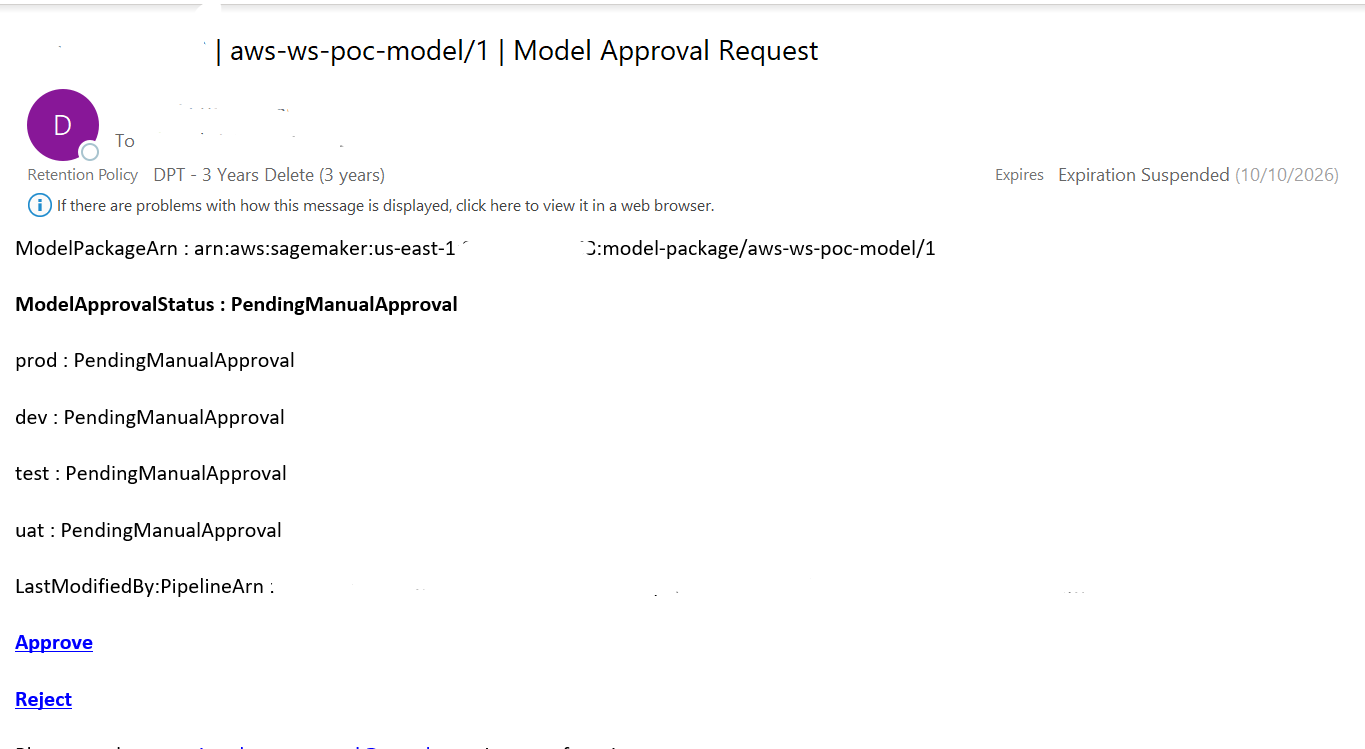

- O aprovador recebe um email com o link para revisar e aprovar ou rejeitar o modelo.

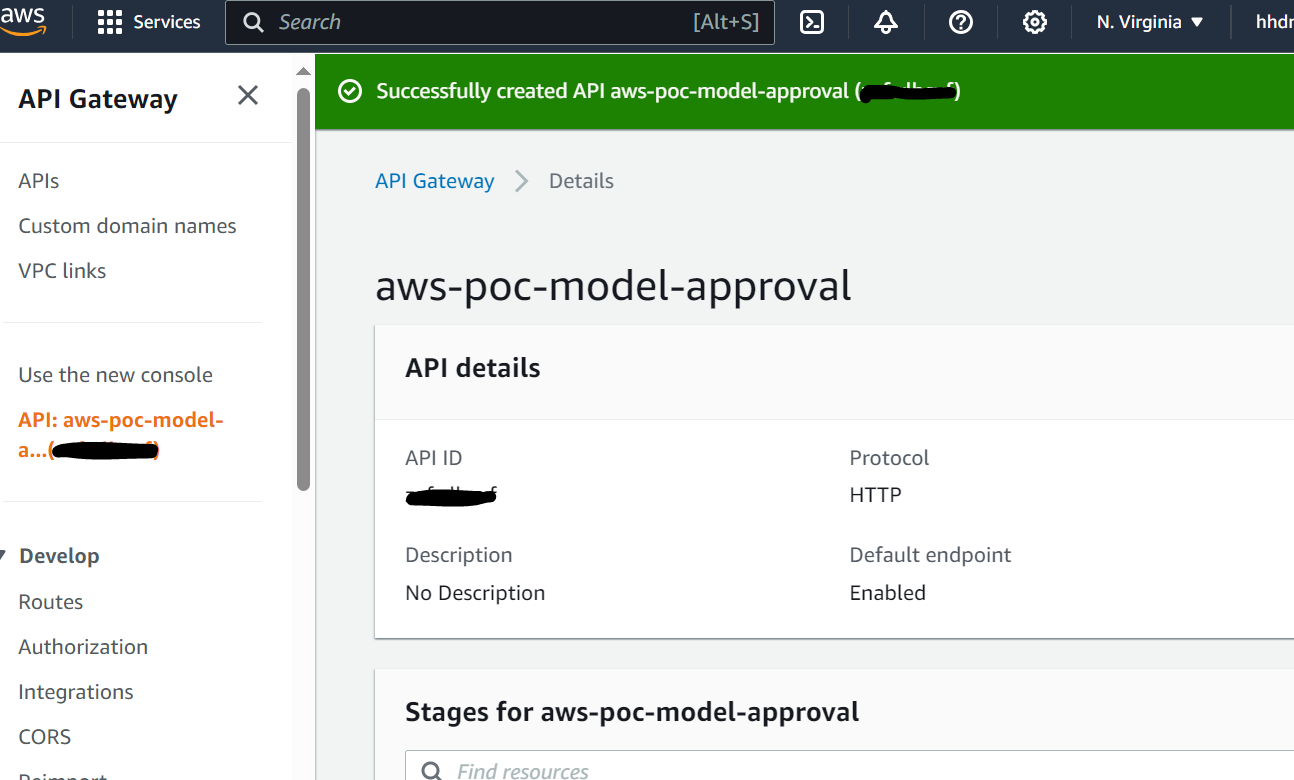

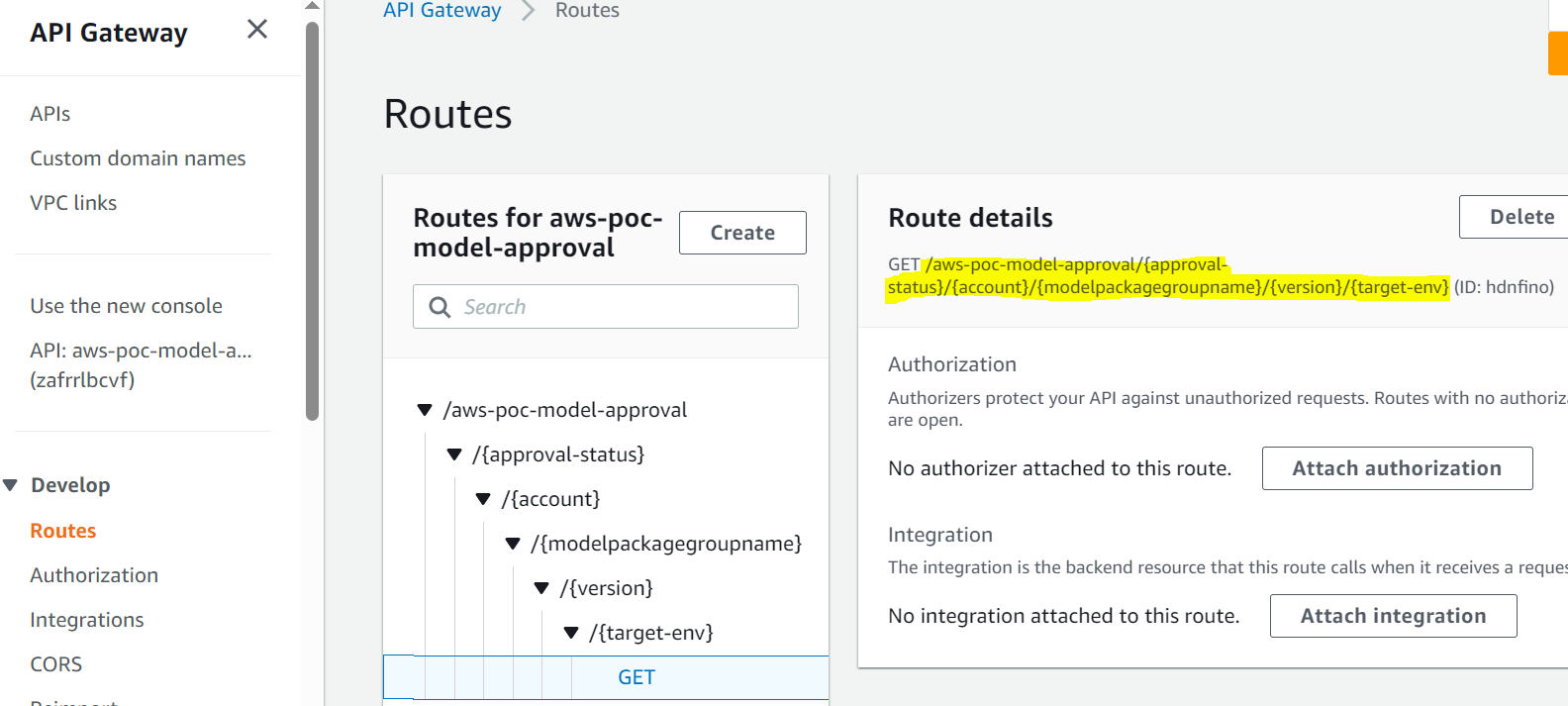

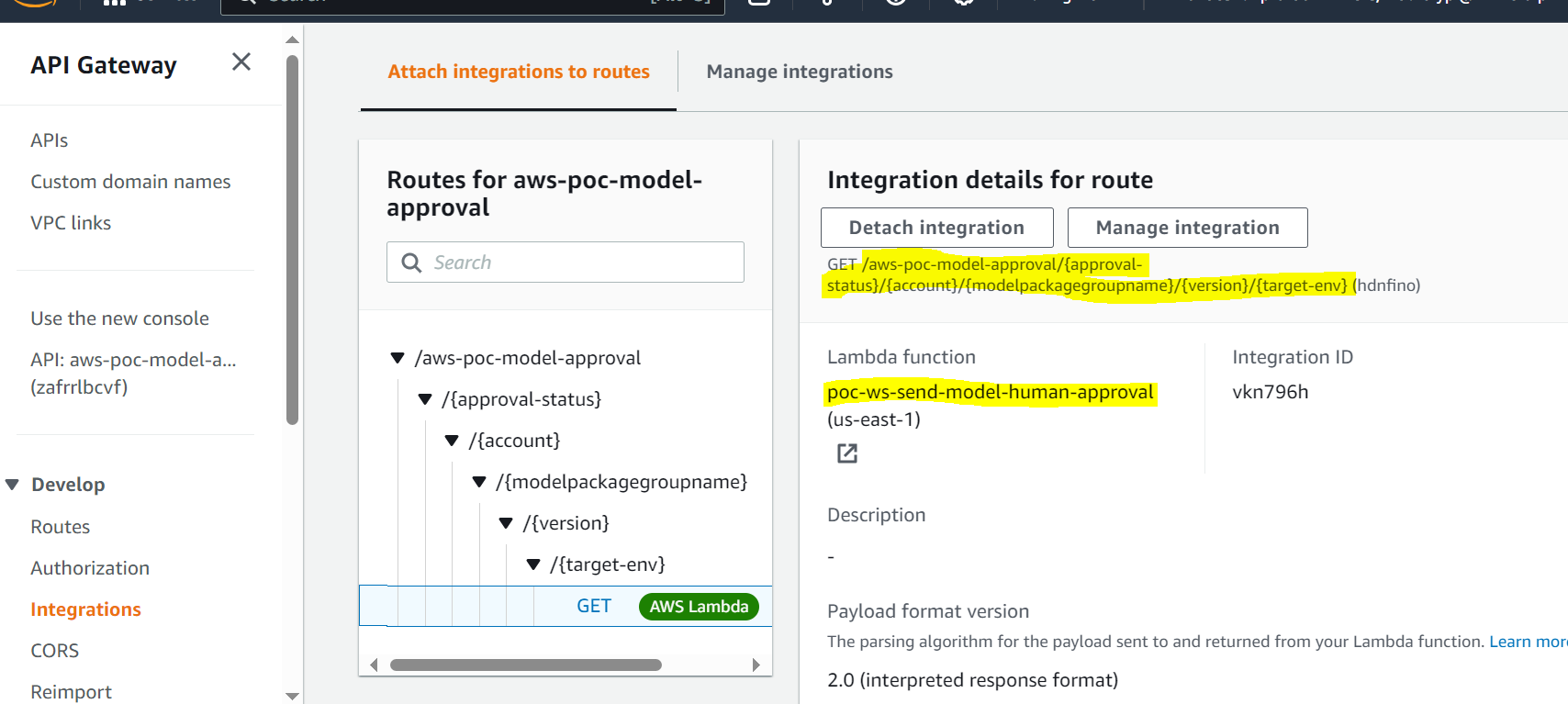

- O aprovador aprova o modelo seguindo o link no e-mail para um endpoint do API Gateway.

- O API Gateway invoca uma função Lambda para iniciar atualizações de modelo.

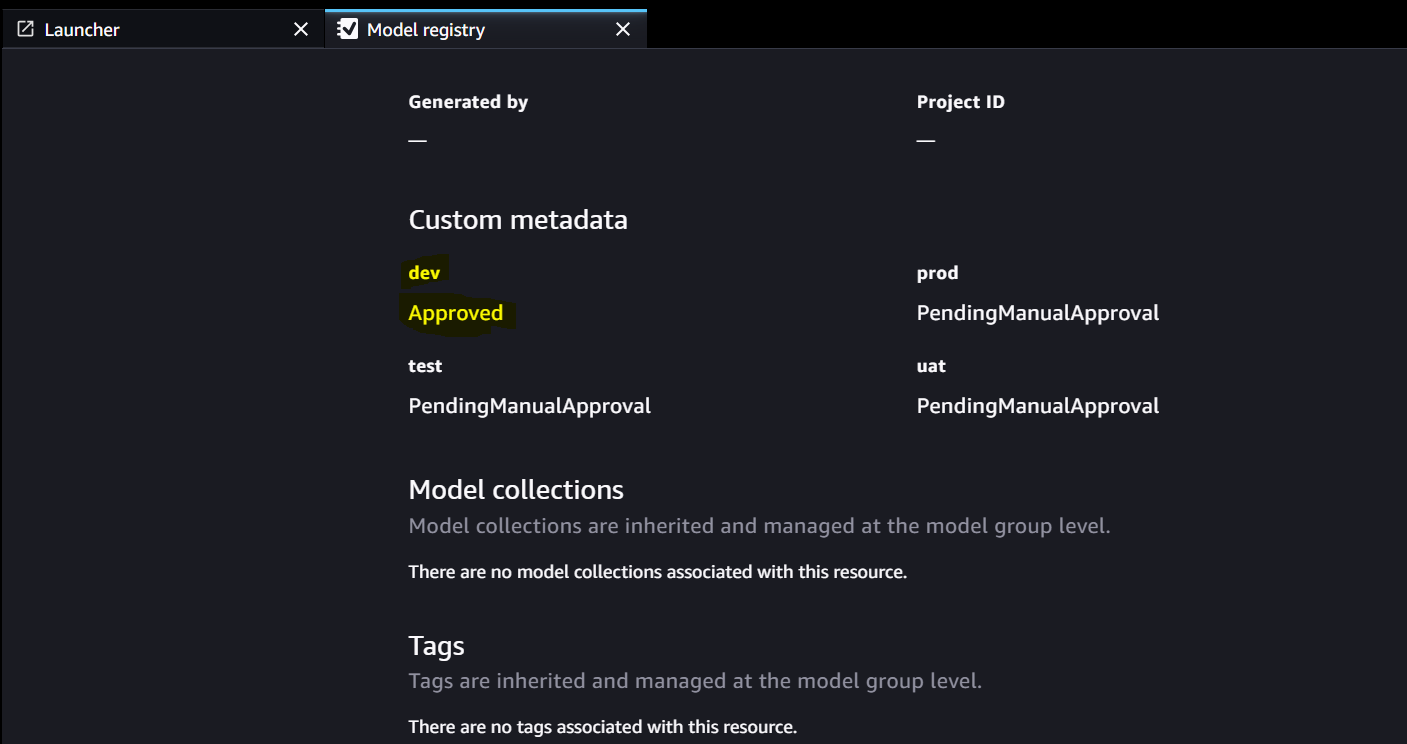

- O registro do modelo é atualizado para o status do modelo (

Approvedpara o ambiente de desenvolvimento, masPendingManualApprovalpara teste, UAT e produção). - Os detalhes do modelo são armazenados em Armazenamento de parâmetros AWS, uma capacidade de Gerente de Sistemas AWS, incluindo a versão do modelo, ambiente de destino aprovado, pacote de modelo.

- O pipeline de inferência busca o modelo aprovado para o ambiente de destino no Parameter Store.

- A função Lambda de notificação pós-inferência coleta métricas de inferência em lote e envia um e-mail ao aprovador para promover o modelo para o próximo ambiente.

Pré-requisitos

O fluxo de trabalho nesta postagem pressupõe que o ambiente para o pipeline de treinamento esteja configurado no SageMaker, junto com outros recursos. A entrada para o pipeline de treinamento é o conjunto de dados de recursos. Os detalhes de geração de recursos não estão incluídos nesta postagem, mas se concentra no registro, aprovação e promoção de modelos de ML após serem treinados. O modelo é registrado no registro de modelos e é regido por uma estrutura de monitoramento em Monitor de modelo do Amazon SageMaker para detectar qualquer desvio e proceder ao retreinamento em caso de desvio do modelo.

Detalhes do fluxo de trabalho

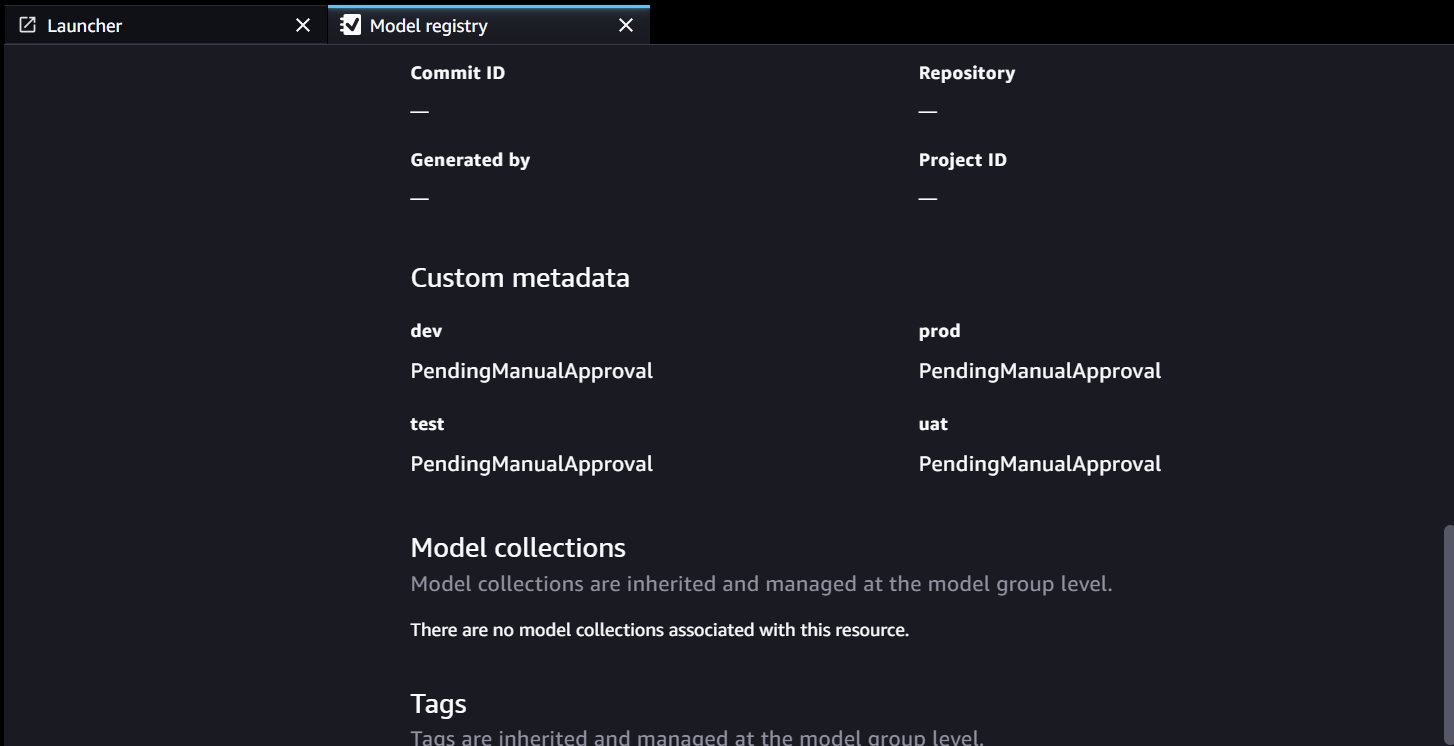

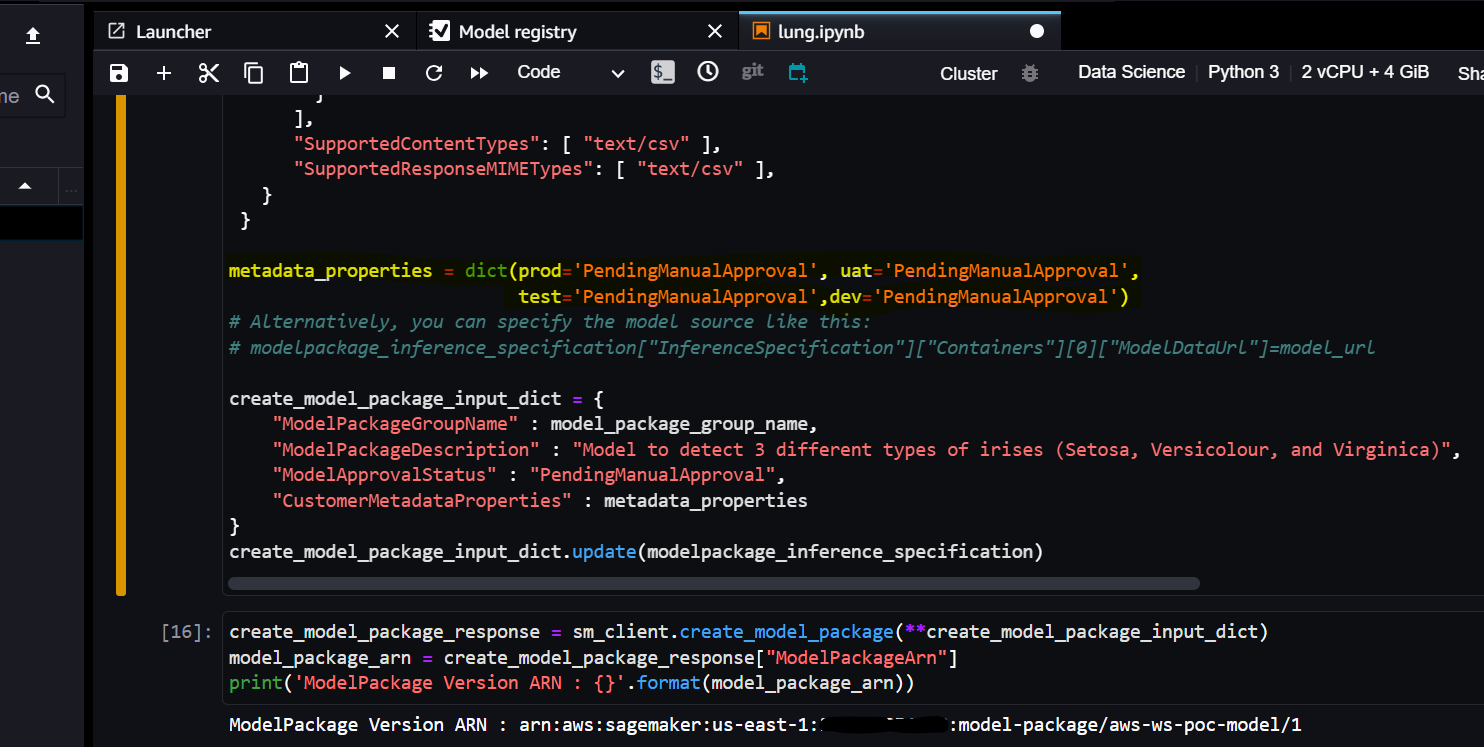

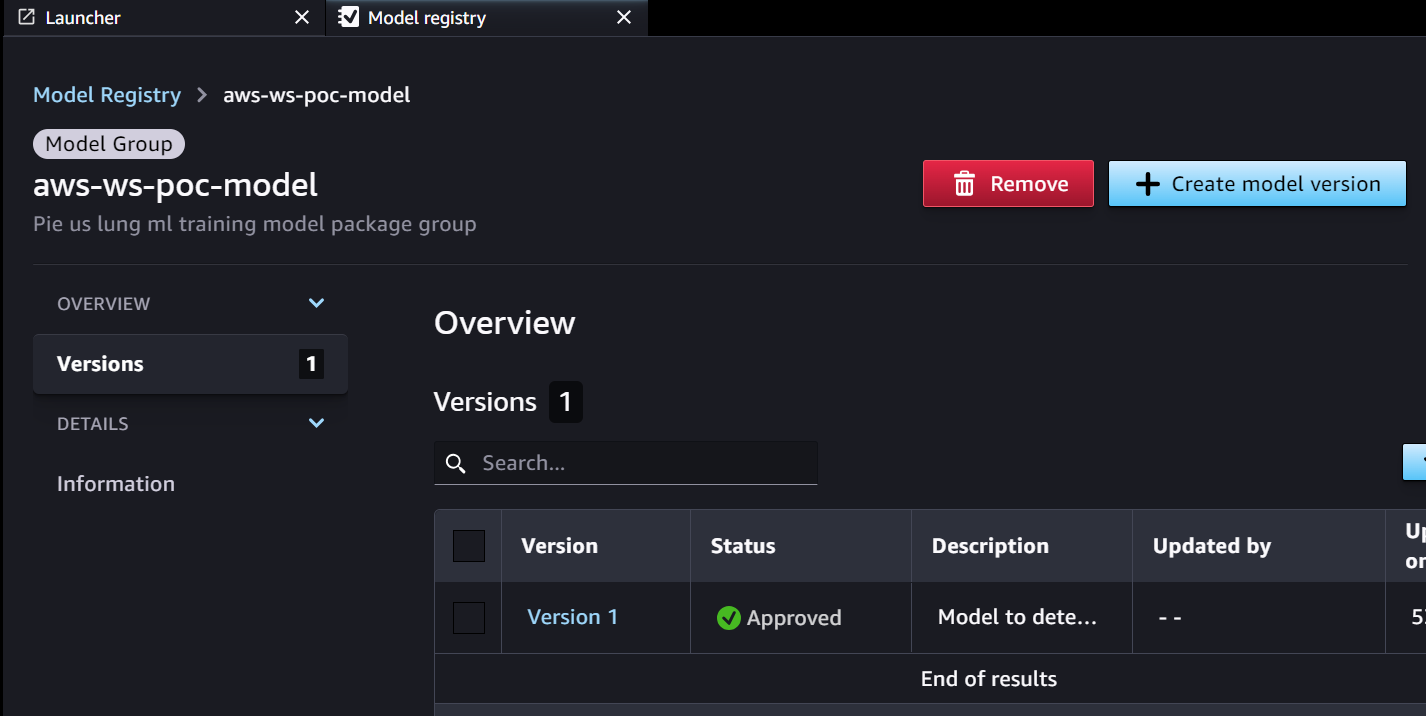

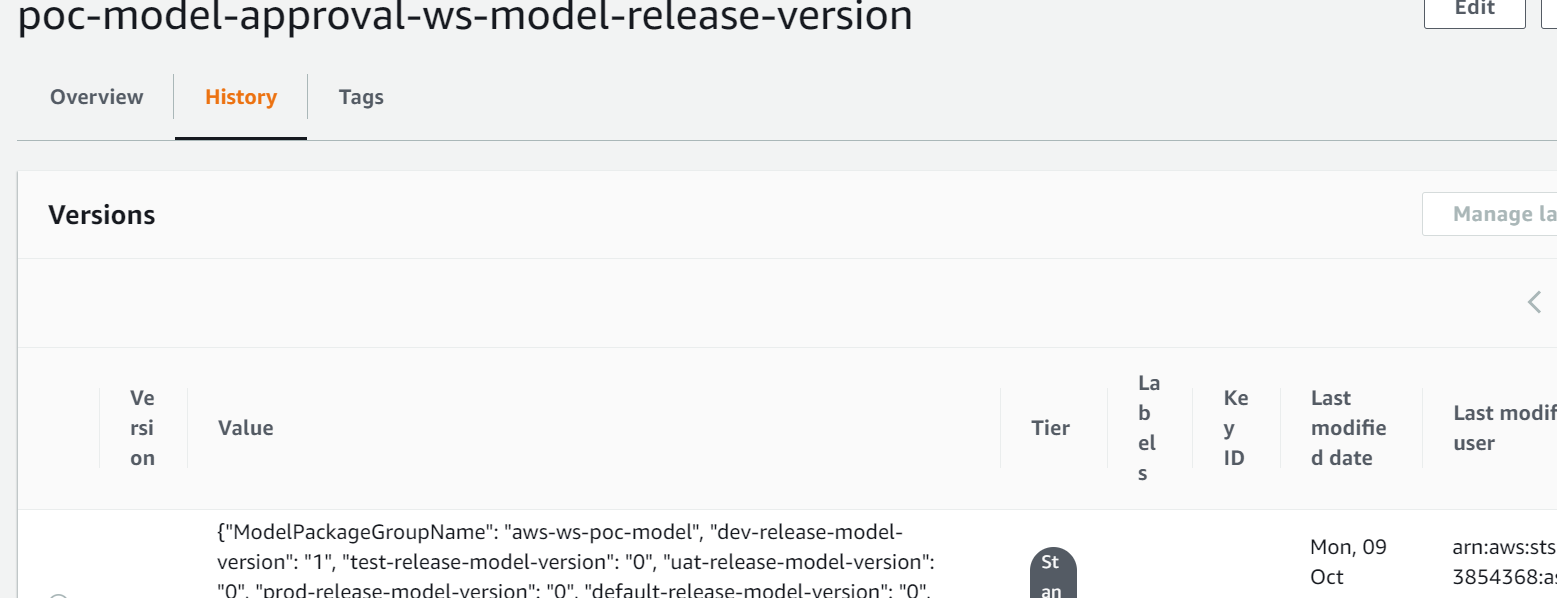

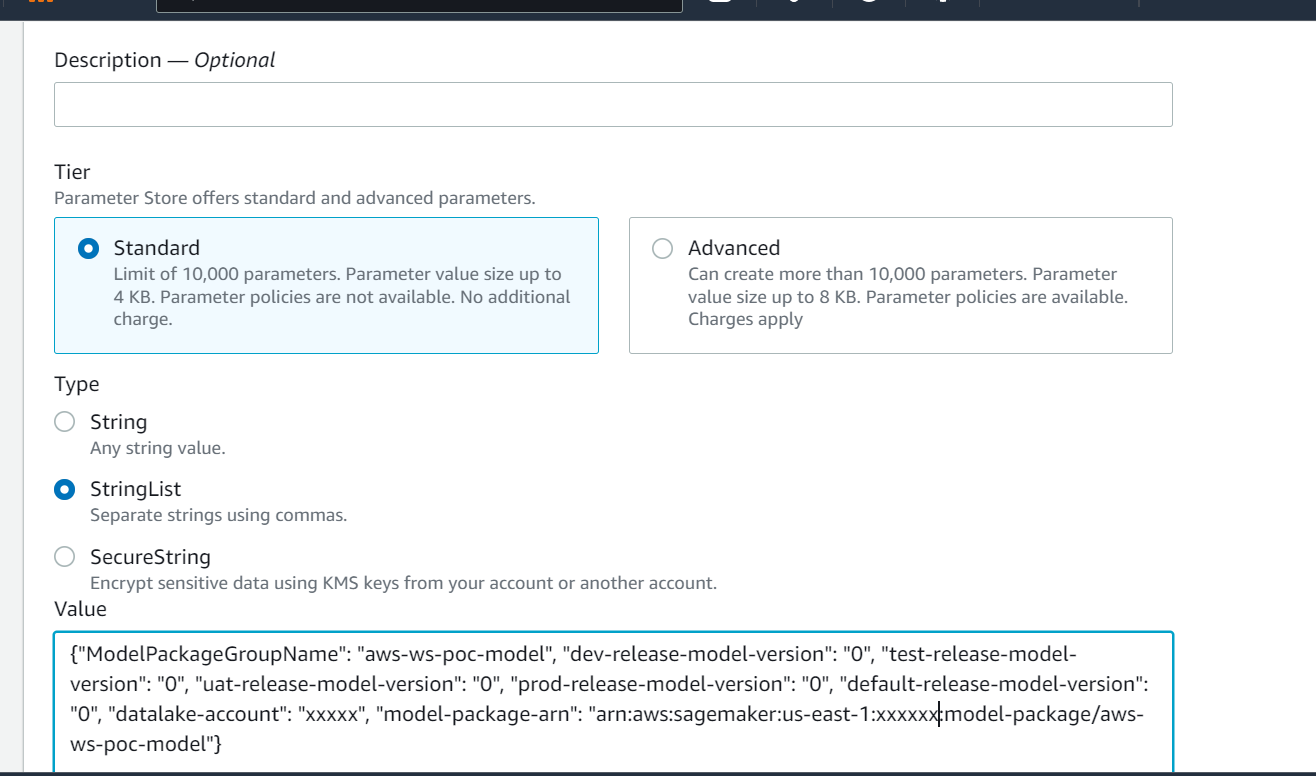

O fluxo de trabalho de aprovação começa com um modelo desenvolvido a partir de um pipeline de treinamento. Quando os cientistas de dados desenvolvem um modelo, eles o registram no SageMaker Model Registry com o status de modelo de PendingManualApproval. O EventBridge monitora o SageMaker em busca do evento de registro do modelo e aciona uma regra de evento que invoca uma função Lambda. A função Lambda constrói dinamicamente um e-mail para aprovação do modelo com um link para um endpoint do API Gateway para outra função Lambda. Quando o aprovador segue o link para aprovar o modelo, o API Gateway encaminha a ação de aprovação para a função Lambda, que atualiza o SageMaker Model Registry e os atributos do modelo no Parameter Store. O aprovador deve ser autenticado e fazer parte do grupo de aprovadores gerenciado pelo Active Directory. A aprovação inicial marca o modelo como Approved para dev, mas PendingManualApproval para teste, UAT e produção. Os atributos do modelo salvos no Parameter Store incluem a versão do modelo, o pacote do modelo e o ambiente de destino aprovado.

Quando um pipeline de inferência precisa buscar um modelo, ele verifica no Parameter Store a versão mais recente do modelo aprovada para o ambiente de destino e obtém os detalhes da inferência. Quando o pipeline de inferência estiver concluído, um e-mail de notificação pós-inferência será enviado a uma parte interessada solicitando aprovação para promover o modelo para o próximo nível de ambiente. O e-mail contém detalhes sobre o modelo e as métricas, bem como um link de aprovação para um endpoint do API Gateway para uma função Lambda que atualiza os atributos do modelo.

A seguir está a sequência de eventos e etapas de implementação para o fluxo de trabalho de aprovação/promoção do modelo de ML, desde a criação do modelo até a produção. O modelo é promovido desde o desenvolvimento até os ambientes de teste, UAT e produção com aprovação humana explícita em cada etapa.

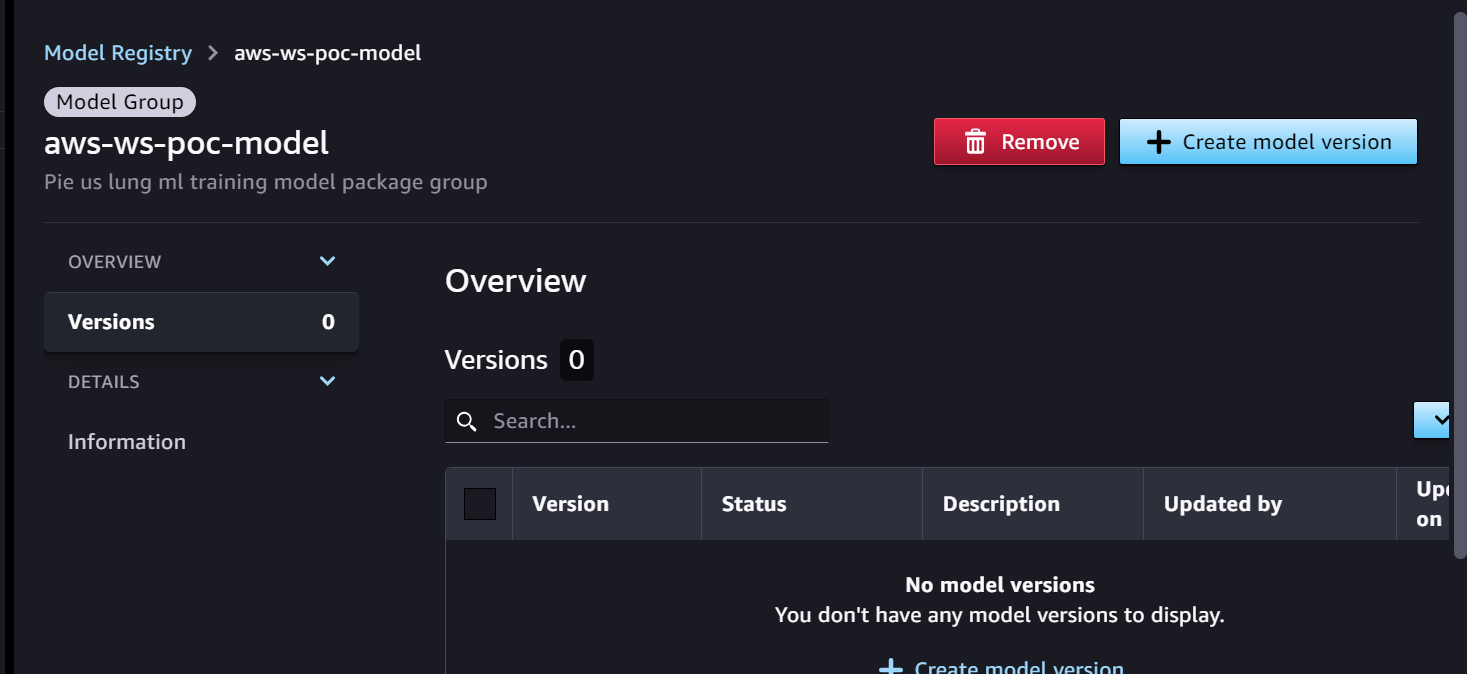

Começamos com o pipeline de treinamento, que está pronto para o desenvolvimento do modelo. A versão do modelo começa como 0 no SageMaker Model Registry.

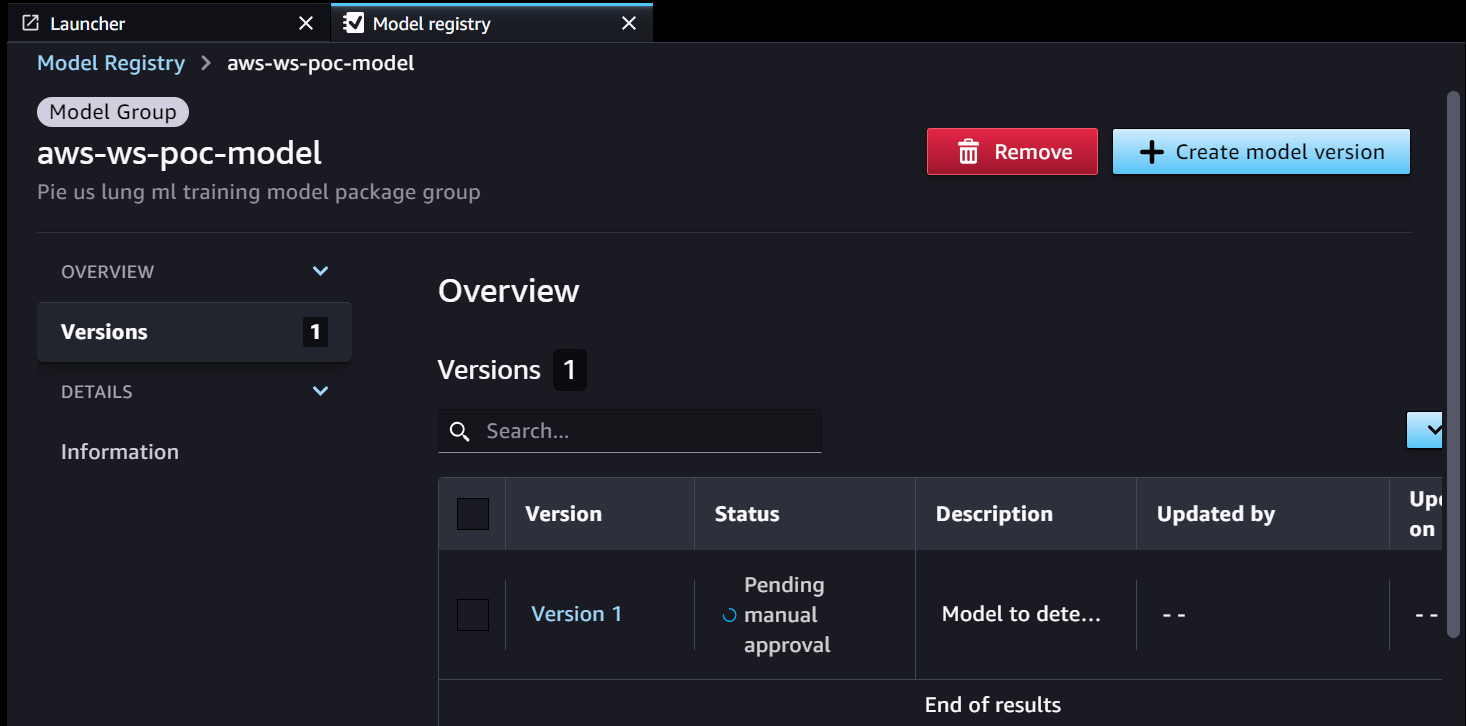

- O pipeline de treinamento do SageMaker desenvolve e registra um modelo no SageMaker Model Registry. A versão 1 do modelo está registrada e começa com Aprovação manual pendente estado.

Os metadados do Model Registry possuem quatro campos customizados para os ambientes:

Os metadados do Model Registry possuem quatro campos customizados para os ambientes: dev, test, uateprod.

- O EventBridge monitora o SageMaker Model Registry em busca de alterações de status para agir automaticamente com regras simples.

- A regra de evento de registro de modelo invoca uma função Lambda que cria um email com o link para aprovar ou rejeitar o modelo registrado.

- O aprovador recebe um email com o link para revisar e aprovar (ou rejeitar) o modelo.

- O aprovador aprova o modelo seguindo o link para o endpoint do API Gateway no email.

- O API Gateway invoca a função Lambda para iniciar atualizações de modelo.

- O registro do modelo SageMaker é atualizado com o status do modelo.

- As informações detalhadas do modelo são armazenadas no Parameter Store, incluindo a versão do modelo, o ambiente de destino aprovado e o pacote do modelo.

- O pipeline de inferência busca o modelo aprovado para o ambiente de destino no Parameter Store.

- A função Lambda de notificação pós-inferência coleta métricas de inferência em lote e envia um e-mail ao aprovador para promover o modelo para o próximo ambiente.

- O aprovador aprova a promoção do modelo para o próximo nível seguindo o link para o endpoint do API Gateway, que aciona a função Lambda para atualizar o SageMaker Model Registry e o Parameter Store.

O histórico completo do versionamento e aprovação do modelo é salvo para revisão no Parameter Store.

Conclusão

O grande ciclo de vida de desenvolvimento do modelo de ML requer um processo escalonável de aprovação do modelo de ML. Nesta postagem, compartilhamos uma implementação de um fluxo de trabalho de registro, aprovação e promoção de modelo de ML com intervenção humana usando SageMaker Model Registry, EventBridge, API Gateway e Lambda. Se você está considerando um processo de desenvolvimento de modelo de ML escalonável para sua plataforma MLOps, você pode seguir as etapas desta postagem para implementar um fluxo de trabalho semelhante.

Sobre os autores

Tom Kim é arquiteto de soluções sênior na AWS, onde ajuda seus clientes a atingir seus objetivos de negócios desenvolvendo soluções na AWS. Ele tem ampla experiência em arquitetura e operações de sistemas empresariais em diversos setores – especialmente em saúde e ciências biológicas. Tom está sempre aprendendo novas tecnologias que levam aos resultados de negócios desejados pelos clientes – por exemplo, IA/ML, GenAI e análise de dados. Ele também gosta de viajar para novos lugares e jogar em novos campos de golfe sempre que encontra tempo.

Tom Kim é arquiteto de soluções sênior na AWS, onde ajuda seus clientes a atingir seus objetivos de negócios desenvolvendo soluções na AWS. Ele tem ampla experiência em arquitetura e operações de sistemas empresariais em diversos setores – especialmente em saúde e ciências biológicas. Tom está sempre aprendendo novas tecnologias que levam aos resultados de negócios desejados pelos clientes – por exemplo, IA/ML, GenAI e análise de dados. Ele também gosta de viajar para novos lugares e jogar em novos campos de golfe sempre que encontra tempo.

Shamika Ariyawansa, atuando como arquiteto sênior de soluções de IA/ML na divisão de saúde e ciências biológicas da Amazon Web Services (AWS), é especialista em IA generativa, com foco em treinamento em Large Language Model (LLM), otimizações de inferência e MLOps (Machine Learning). Operações). Ele orienta os clientes na incorporação de IA generativa avançada em seus projetos, garantindo processos de treinamento robustos, mecanismos de inferência eficientes e práticas de MLOps simplificadas para soluções de IA eficazes e escalonáveis. Além de seus compromissos profissionais, Shamika busca apaixonadamente aventuras de esqui e off-road.

Shamika Ariyawansa, atuando como arquiteto sênior de soluções de IA/ML na divisão de saúde e ciências biológicas da Amazon Web Services (AWS), é especialista em IA generativa, com foco em treinamento em Large Language Model (LLM), otimizações de inferência e MLOps (Machine Learning). Operações). Ele orienta os clientes na incorporação de IA generativa avançada em seus projetos, garantindo processos de treinamento robustos, mecanismos de inferência eficientes e práticas de MLOps simplificadas para soluções de IA eficazes e escalonáveis. Além de seus compromissos profissionais, Shamika busca apaixonadamente aventuras de esqui e off-road.

Jayadeep Pabbisetty é engenheiro sênior de ML/dados na Merck, onde projeta e desenvolve soluções ETL e MLOps para desbloquear ciência e análise de dados para os negócios. Ele está sempre entusiasmado em aprender novas tecnologias, explorar novos caminhos e adquirir as habilidades necessárias para evoluir junto com o setor de TI em constante mudança. Nas horas vagas segue sua paixão por esportes e gosta de viajar e explorar novos lugares.

Jayadeep Pabbisetty é engenheiro sênior de ML/dados na Merck, onde projeta e desenvolve soluções ETL e MLOps para desbloquear ciência e análise de dados para os negócios. Ele está sempre entusiasmado em aprender novas tecnologias, explorar novos caminhos e adquirir as habilidades necessárias para evoluir junto com o setor de TI em constante mudança. Nas horas vagas segue sua paixão por esportes e gosta de viajar e explorar novos lugares.

Prabakaran Mathaiyan é engenheiro sênior de aprendizado de máquina na Tiger Analytics LLC, onde ajuda seus clientes a atingir seus objetivos de negócios, fornecendo soluções para construção de modelos, treinamento, validação, monitoramento, CICD e melhoria de soluções de aprendizado de máquina na AWS. Prabakaran está sempre aprendendo novas tecnologias que levam aos resultados de negócios desejados pelos clientes – por exemplo, AI/ML, GenAI, GPT e LLM. Ele também gosta de jogar críquete sempre que encontra tempo.

Prabakaran Mathaiyan é engenheiro sênior de aprendizado de máquina na Tiger Analytics LLC, onde ajuda seus clientes a atingir seus objetivos de negócios, fornecendo soluções para construção de modelos, treinamento, validação, monitoramento, CICD e melhoria de soluções de aprendizado de máquina na AWS. Prabakaran está sempre aprendendo novas tecnologias que levam aos resultados de negócios desejados pelos clientes – por exemplo, AI/ML, GenAI, GPT e LLM. Ele também gosta de jogar críquete sempre que encontra tempo.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://aws.amazon.com/blogs/machine-learning/build-an-amazon-sagemaker-model-registry-approval-and-promotion-workflow-with-human-intervention/

- :tem

- :é

- :não

- :onde

- $UP

- 1

- 100

- 110

- 116

- a

- Sobre

- Alcançar

- aquisição de

- em

- Açao Social

- ações

- ativo

- Active Directory

- avançado

- aventuras

- Depois de

- AI

- AI / ML

- juntamente

- tb

- sempre

- Amazon

- Amazon Sage Maker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- analítica

- e

- Outro

- qualquer

- api

- aprovação

- aprovar

- aprovou

- arquitetura

- SOMOS

- AS

- assume

- At

- atributos

- autenticado

- automatizar

- Automatizado

- automaticamente

- avenidas

- AWS

- BE

- antes

- ser

- entre

- Pós

- Inferior

- construir

- Prédio

- ônibus

- negócio

- mas a

- by

- CAN

- capacidade

- Cuidado

- casas

- alterar

- Cheques

- código

- colaborou

- coleta

- compromissos

- completar

- considerando

- cursos

- criação

- Grilo

- personalizadas

- Clientes

- dados,

- Análise de Dados

- ciência de dados

- cientista de dados

- Design

- projetos

- desejado

- detalhe

- detalhes

- descobrir

- Dev

- desenvolver

- desenvolvido

- Developer

- desenvolvedores

- em desenvolvimento

- Desenvolvimento

- desenvolve

- discutir

- Divisão

- dinamicamente

- e

- cada

- Eficaz

- eficiente

- embutindo

- Ponto final

- engenheiro

- Engenharia

- assegurando

- Empreendimento

- entusiasta

- Meio Ambiente

- ambientes

- Éter (ETH)

- Evento

- eventos

- em constante mudança

- evolui

- vasta experiência

- explorar

- Explorando

- extenso

- Experiência Extensiva

- Característica

- Funcionalidades

- Campos

- Encontre

- Foco

- concentra-se

- seguir

- seguinte

- segue

- Escolha

- quatro

- Quadro

- da

- função

- porta de entrada

- geração

- generativo

- IA generativa

- golfe

- governado

- Grupo

- Guias

- Manipulação

- he

- Saúde

- Assistência médica

- saúde

- ajuda

- sua

- história

- Como funciona o dobrador de carta de canal

- HTML

- HTTPS

- humano

- if

- executar

- implementação

- melhoria

- in

- incluir

- incluído

- inclui

- Incluindo

- Individual

- indústrias

- indústria

- INFORMAÇÕES

- do estado inicial,

- iniciar

- entrada

- integração

- da intervenção

- para dentro

- invoca

- IT

- Setor de TI

- jpg

- língua

- grande

- mais recente

- conduzir

- aprendizagem

- Nível

- vida

- Ciência da vida

- Ciências da Vida

- wifecycwe

- gostos

- LINK

- LLC

- máquina

- aprendizado de máquina

- gerenciados

- manual

- mecanismos

- Merck

- metadados

- Métrica

- Coração

- ML

- MLOps

- modelo

- modelos

- monitoração

- monitores

- devo

- necessário

- Cria

- Novo

- Novas tecnologias

- Próximo

- notificação

- objetivos

- of

- frequentemente

- on

- Operações

- or

- Outros

- Resultado

- global

- pacote

- parâmetro

- parte

- particularmente

- paixão

- padrão

- oleoduto

- Locais

- plataforma

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- ponto

- retrato

- Publique

- práticas

- prosseguir

- processo

- processos

- Produção

- profissional

- projetos

- a promover

- Promovido

- Promoção

- promoção

- fornece

- fornecendo

- Perseguições

- pronto

- cadastre-se

- registrado

- registradores

- Registo

- registro

- liberar

- solicitando

- requerer

- exige

- Recursos

- reciclagem

- rever

- uma conta de despesas robusta

- Rota

- Regra

- regras

- s

- sábio

- salvo

- escalável

- Ciência

- CIÊNCIAS

- Cientista

- cientistas

- envia

- senior

- enviei

- Seqüência

- Serviços

- de servir

- conjunto

- vários

- compartilhado

- Shows

- semelhante

- simples

- Habilidades

- Software

- desenvolvimento de software

- solução

- Soluções

- especialista

- especializada

- Esportes

- partes interessadas

- começo

- começa

- Status

- Passo

- Passos

- loja

- armazenadas

- simplificada

- Apoiar

- .

- sistemas

- Tire

- Target

- Profissionais

- Tecnologias

- teste

- que

- A

- deles

- deles

- isto

- tigre

- tempo

- para

- juntos

- tomo

- treinado

- Training

- viagens

- Viagens

- tipicamente

- destravar

- Atualizar

- Atualizada

- Atualizações

- usar

- usava

- usos

- utilização

- validação

- versão

- we

- web

- serviços web

- BEM

- quando

- sempre que

- qual

- de

- dentro

- Atividades:

- trabalhar juntos

- de gestão de documentos

- Você

- investimentos

- zefirnet