Imagem do autor

Gemini é um novo modelo desenvolvido pelo Google e Bard está se tornando utilizável novamente. Com o Gemini, agora é possível obter respostas quase perfeitas às suas dúvidas, fornecendo-lhes imagens, áudio e texto.

Neste tutorial aprenderemos sobre a API Gemini e como configurá-la em sua máquina. Também exploraremos várias funções da API Python, incluindo geração de texto e compreensão de imagens.

Gemini é um novo modelo de IA desenvolvido através da colaboração entre equipes do Google, incluindo Google Research e Google DeepMind. Foi construído especificamente para ser multimodal, o que significa que pode compreender e trabalhar com diferentes tipos de dados como texto, código, áudio, imagens e vídeo.

Gemini é o maior e mais avançado modelo de IA desenvolvido pelo Google até hoje. Ele foi projetado para ser altamente flexível, de modo que possa operar com eficiência em uma ampla variedade de sistemas, desde data centers até dispositivos móveis. Isto significa que tem o potencial de revolucionar a forma como as empresas e os programadores podem construir e dimensionar aplicações de IA.

Aqui estão três versões do modelo Gemini projetadas para diferentes casos de uso:

- Gêmeos Ultra: A maior e mais avançada IA capaz de realizar tarefas complexas.

- Gêmeos Profissional: Um modelo balanceado que possui bom desempenho e escalabilidade.

- Gêmeos Nano: Mais eficiente para dispositivos móveis.

Imagem da Apresentando Gêmeos

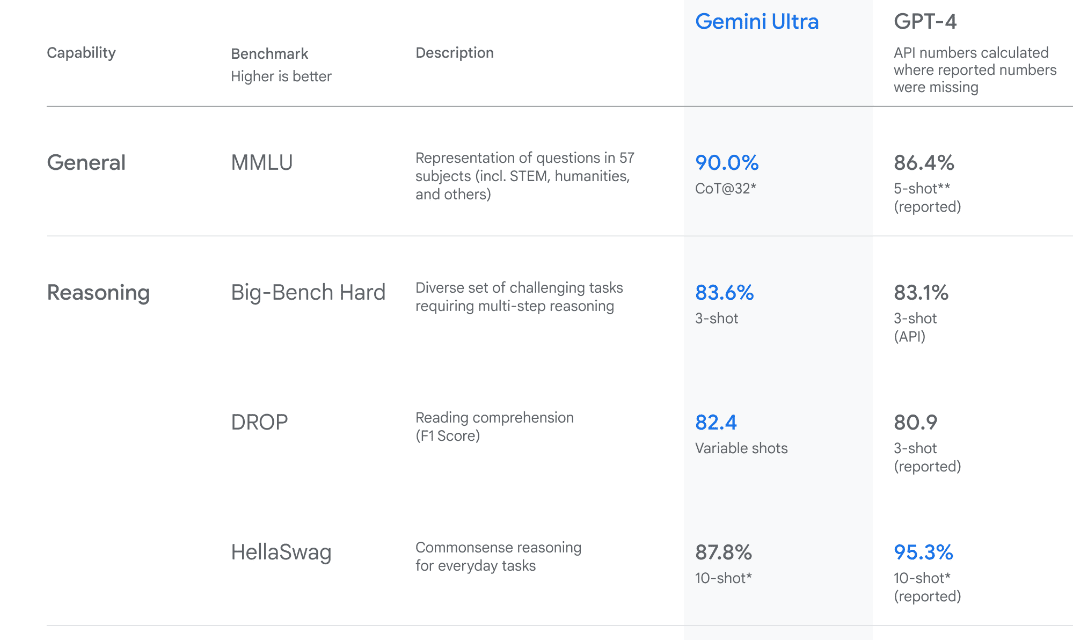

O Gemini Ultra possui desempenho de última geração, superando o desempenho do GPT-4 em diversas métricas. É o primeiro modelo a superar os especialistas humanos no benchmark Massive Multitask Language Understanding, que testa o conhecimento mundial e a resolução de problemas em 57 assuntos diversos. Isso mostra sua compreensão avançada e capacidades de resolução de problemas.

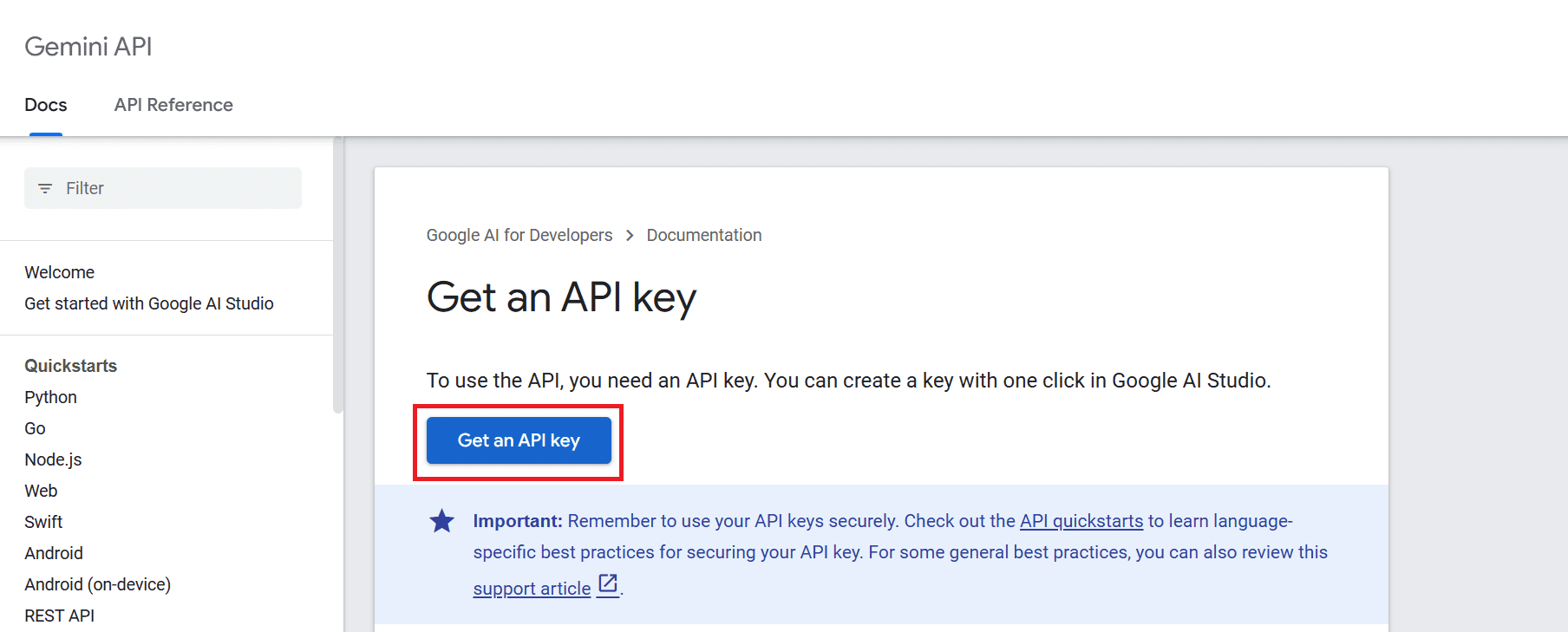

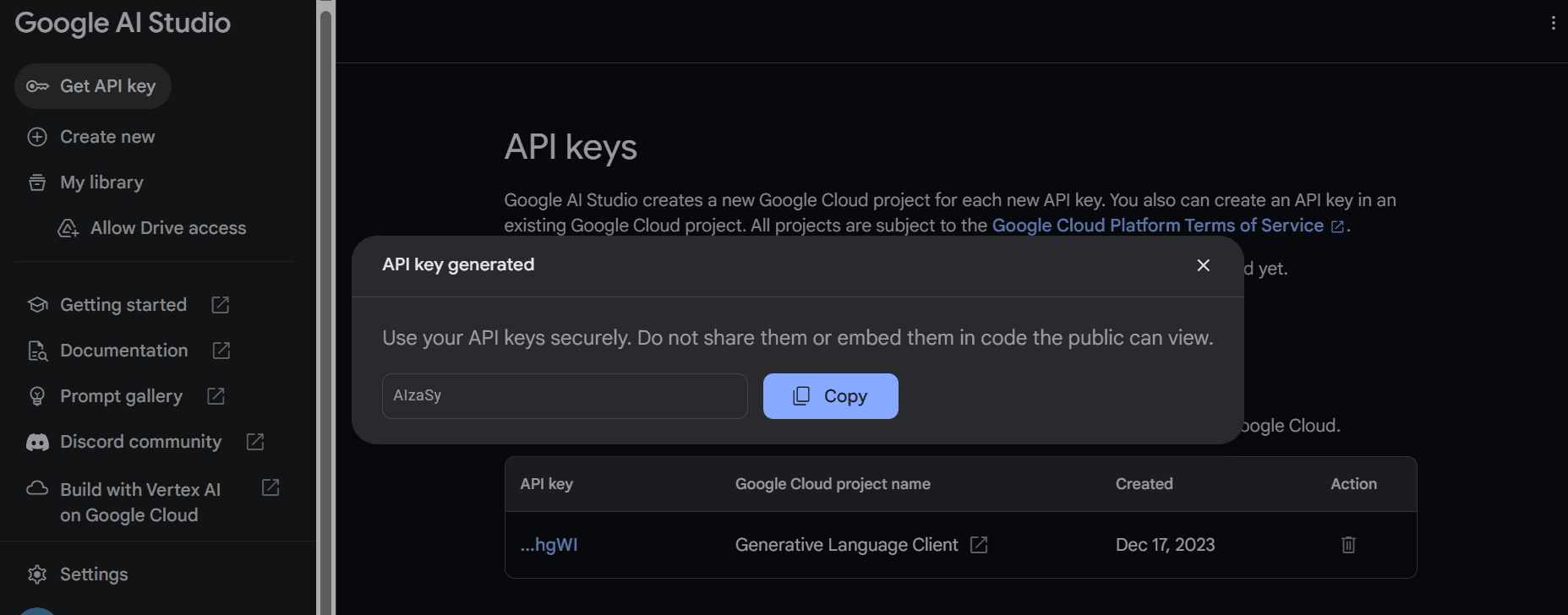

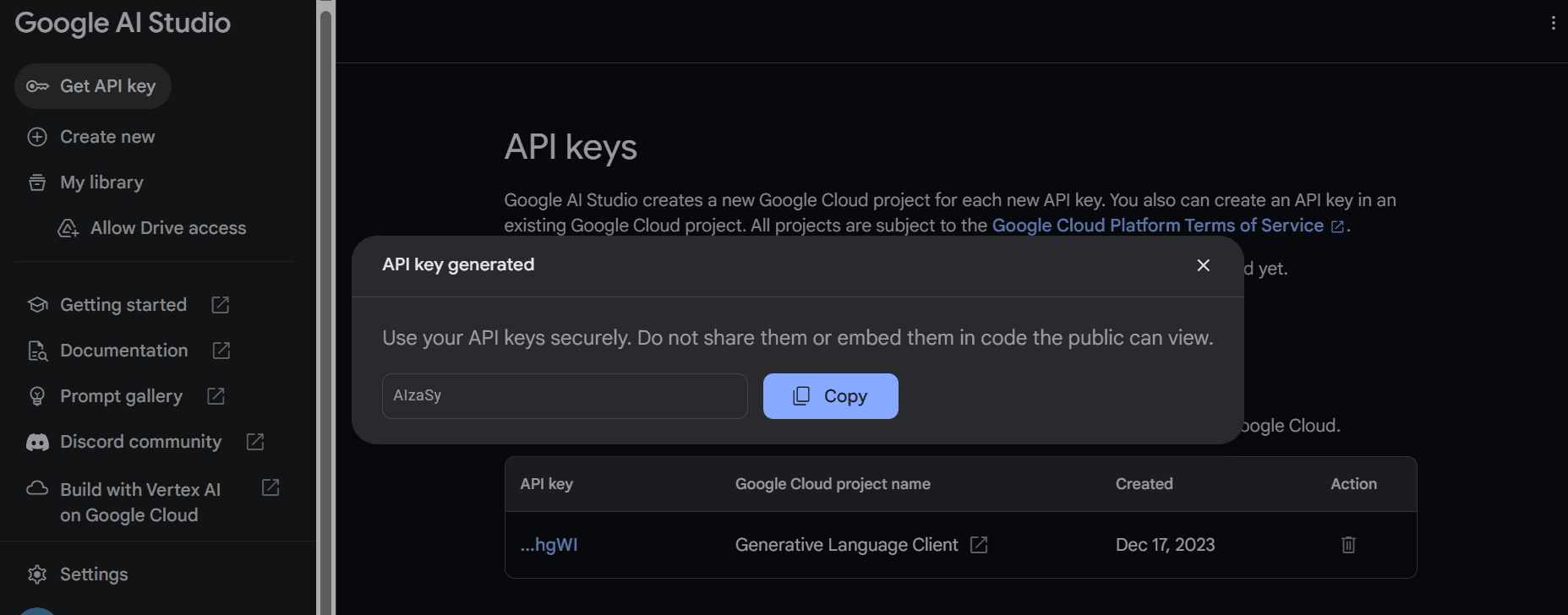

Para usar a API, precisamos primeiro obter uma chave de API que você pode encontrar aqui: https://ai.google.dev/tutorials/setup

Depois disso clique no botão “Obter uma chave de API” e a seguir clique em “Criar chave de API em novo projeto”.

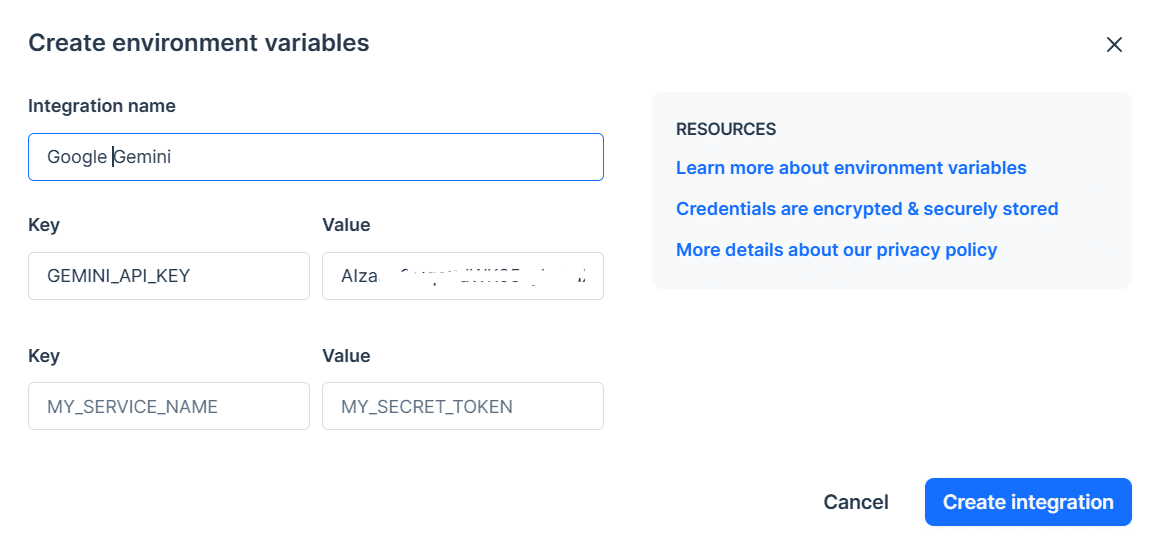

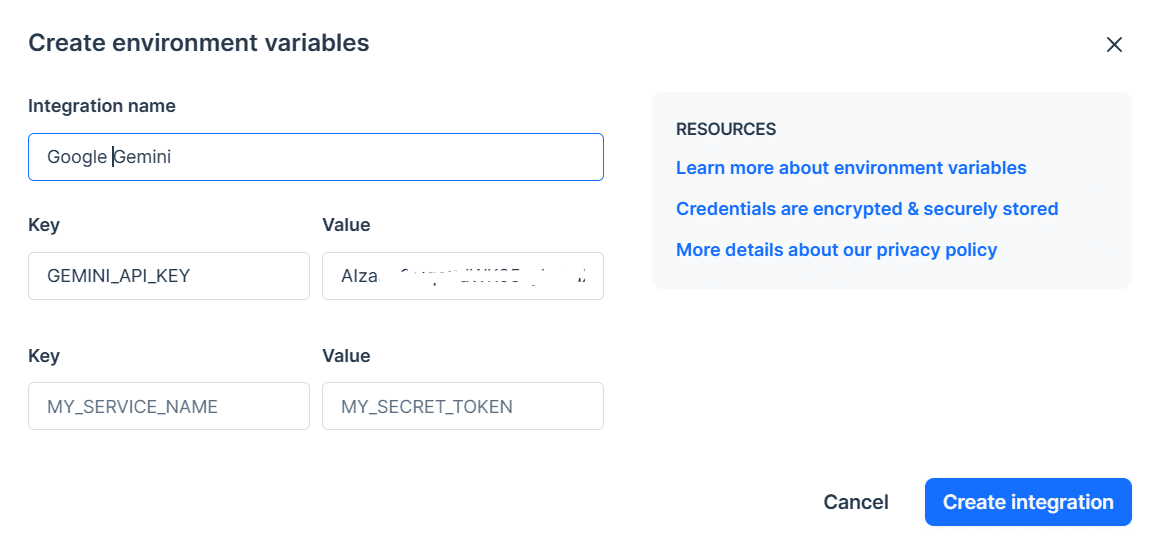

Copie a chave de API e defina-a como uma variável de ambiente. Estamos usando o Deepnote e é muito fácil definir a chave com o nome “GEMINI_API_KEY”. Basta ir até a integração, rolar para baixo e selecionar variáveis de ambiente.

Na próxima etapa, instalaremos a API Python usando PIP:

pip install -q -U google-generativeaiDepois disso, definiremos a chave API para GenAI do Google e iniciaremos a instância.

import google.generativeai as genai

import os

gemini_api_key = os.environ["GEMINI_API_KEY"]

genai.configure(api_key = gemini_api_key)Depois de configurar a chave API, usar o modelo Gemini Pro para gerar conteúdo é simples. Forneça um prompt para a função `generate_content` e exiba a saída como Markdown.

from IPython.display import Markdown

model = genai.GenerativeModel('gemini-pro')

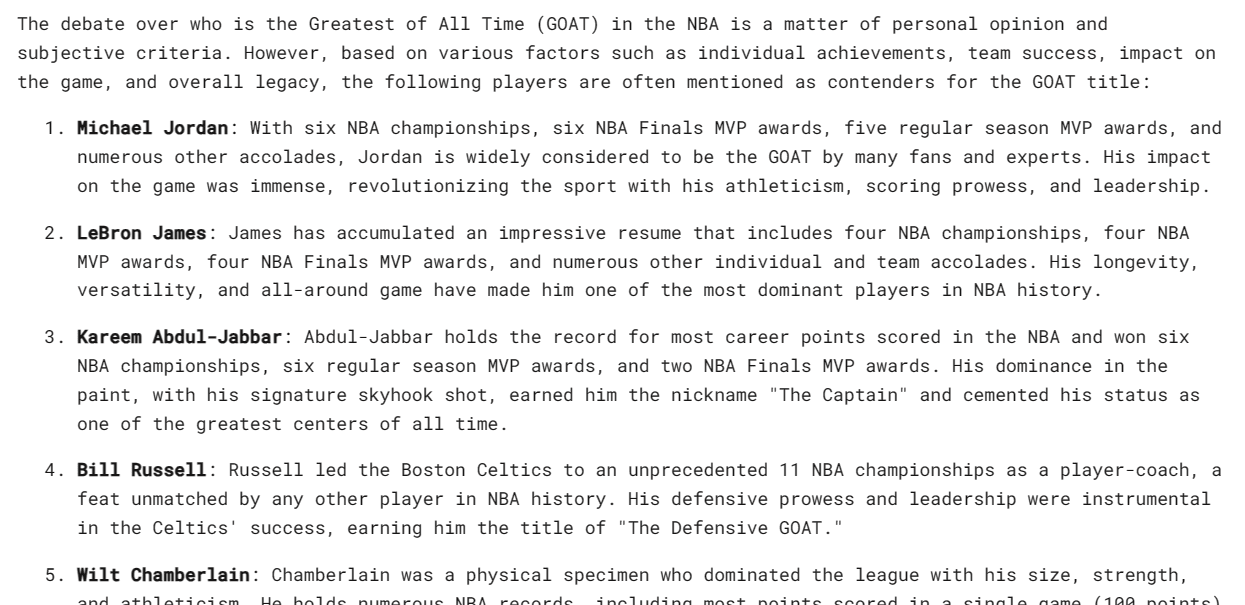

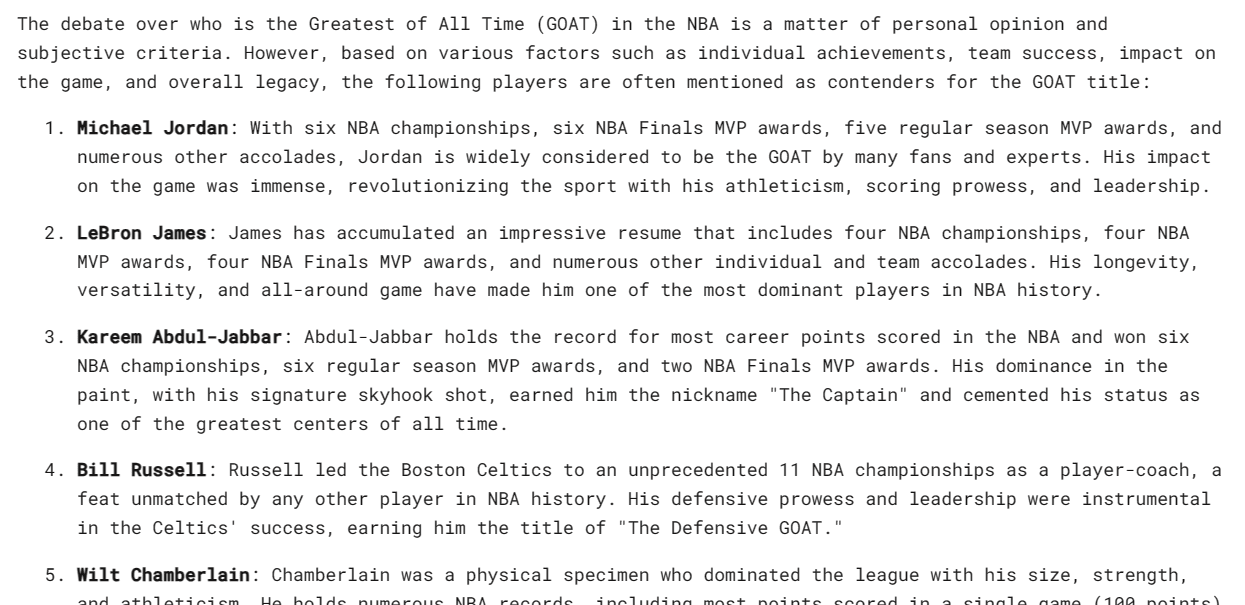

response = model.generate_content("Who is the GOAT in the NBA?")

Markdown(response.text)Isso é incrível, mas não concordo com a lista. No entanto, entendo que é tudo uma questão de preferência pessoal.

O Gemini pode gerar múltiplas respostas, chamadas de candidatas, para um único prompt. Você pode selecionar o mais adequado. No nosso caso, tivemos apenas uma resposta.

response.candidates

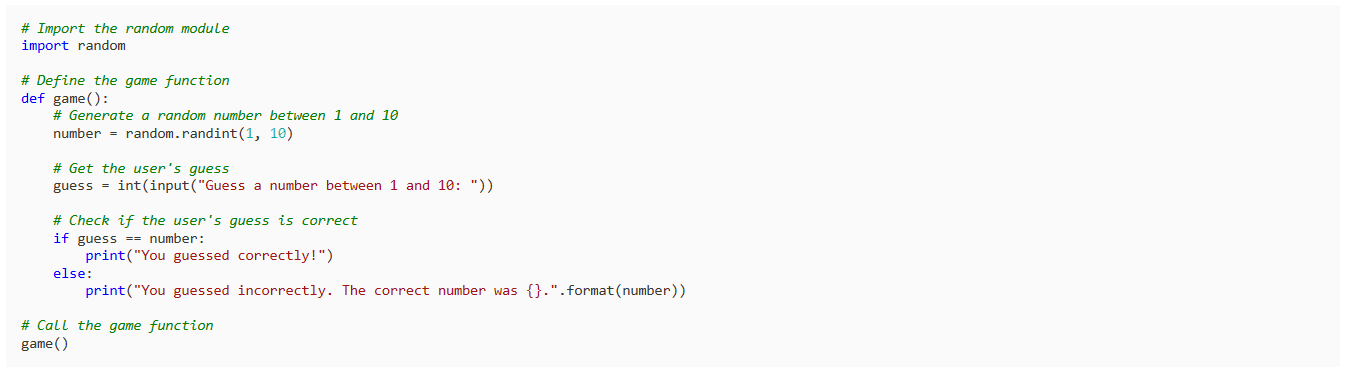

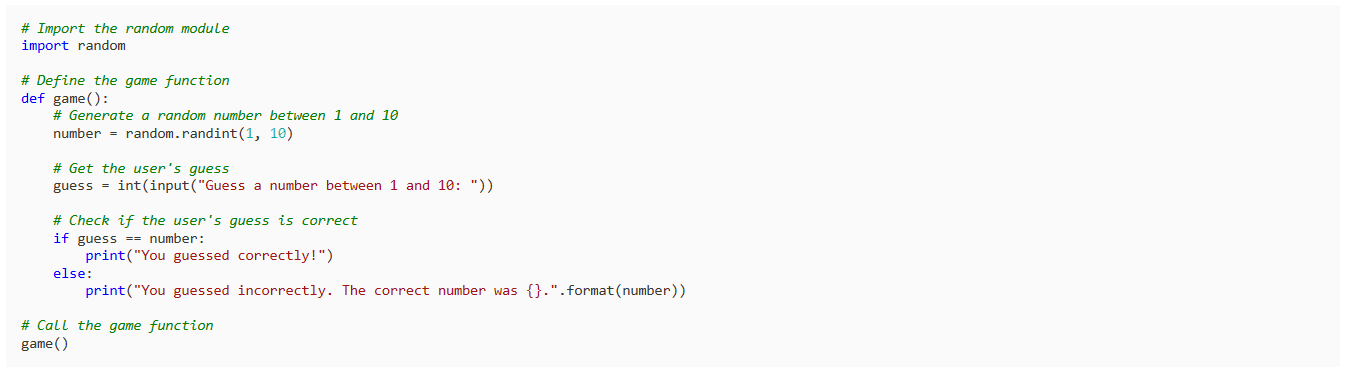

Vamos pedir para escrever um jogo simples em Python.

response = model.generate_content("Build a simple game in Python")

Markdown(response.text)O resultado é simples e direto ao ponto. A maioria dos LLMs começa a explicar o código Python em vez de escrevê-lo.

Você pode personalizar sua resposta usando o argumento `generation_config`. Estamos limitando a contagem de candidatos a 1, adicionando a palavra de parada “espaço” e definindo o máximo de tokens e temperatura.

response = model.generate_content(

'Write a short story about aliens.',

generation_config=genai.types.GenerationConfig(

candidate_count=1,

stop_sequences=['space'],

max_output_tokens=200,

temperature=0.7)

)

Markdown(response.text)Como você pode ver, a resposta parou antes da palavra “espaço”. Incrível.

Você também pode usar o argumento `stream` para transmitir a resposta. É semelhante às APIs Anthropic e OpenAI, mas mais rápida.

model = genai.GenerativeModel('gemini-pro')

response = model.generate_content("Write a Julia function for cleaning the data.", stream=True)

for chunk in response:

print(chunk.text)

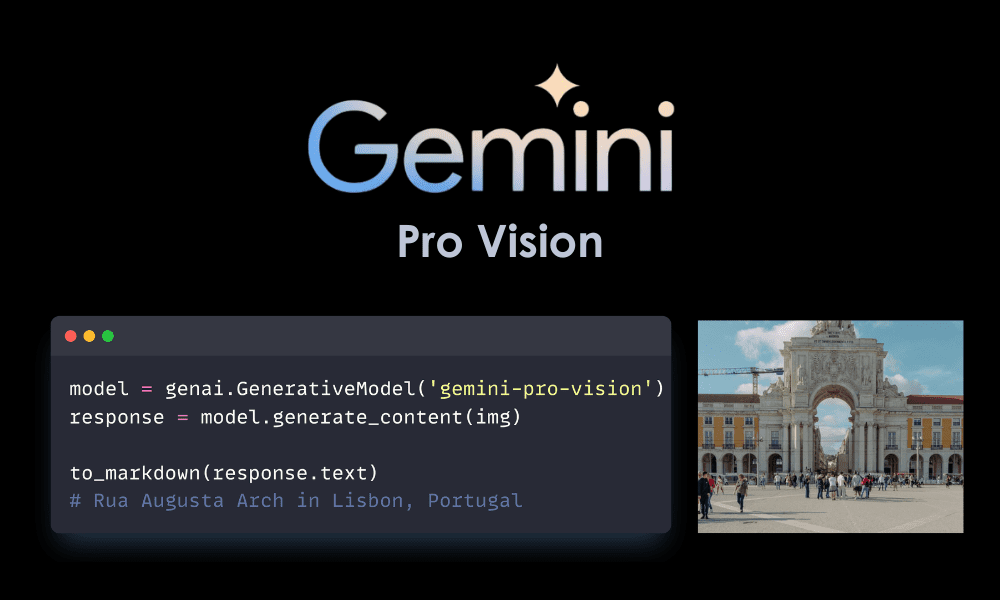

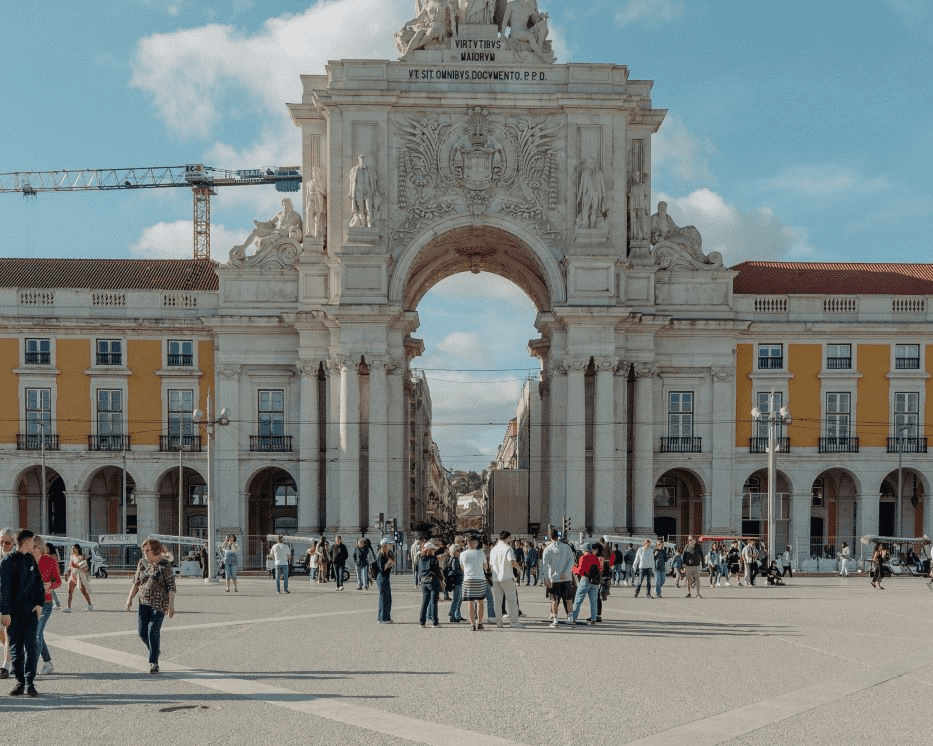

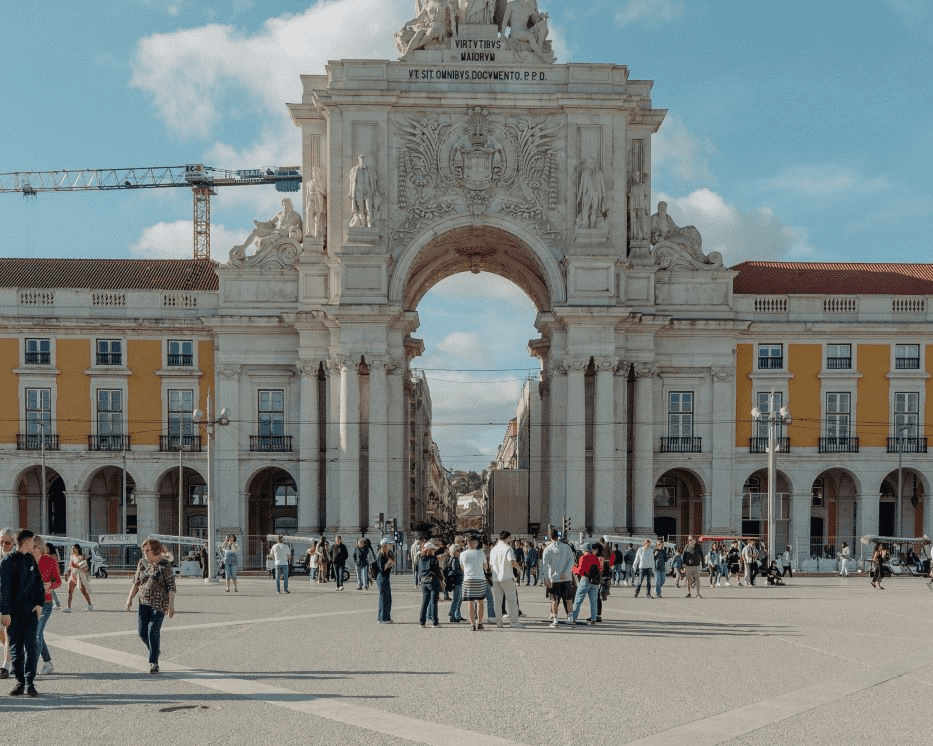

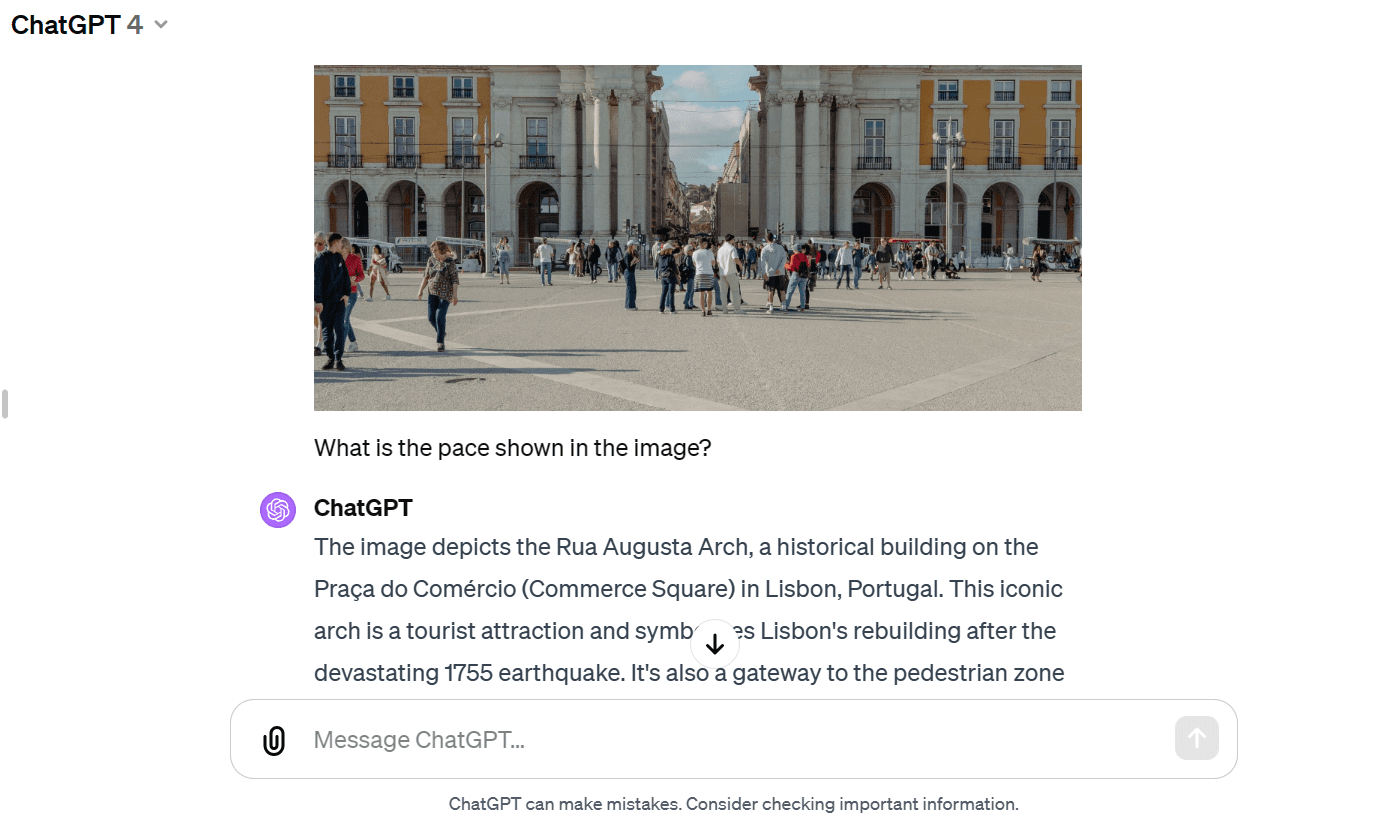

Nesta seção, carregaremos Masood Aslami foto e use-a para testar a multimodalidade do Gemini Pro Vision.

Carregue as imagens no `PIL` e exiba-as.

import PIL.Image

img = PIL.Image.open('images/photo-1.jpg')

imgTemos uma foto em alta qualidade do Arco da Rua Augusta.

Vamos carregar o modelo Gemini Pro Vision e fornecer a imagem.

model = genai.GenerativeModel('gemini-pro-vision')

response = model.generate_content(img)

Markdown(response.text)A maquete identificou com precisão o palácio e forneceu informações adicionais sobre sua história e arquitetura.

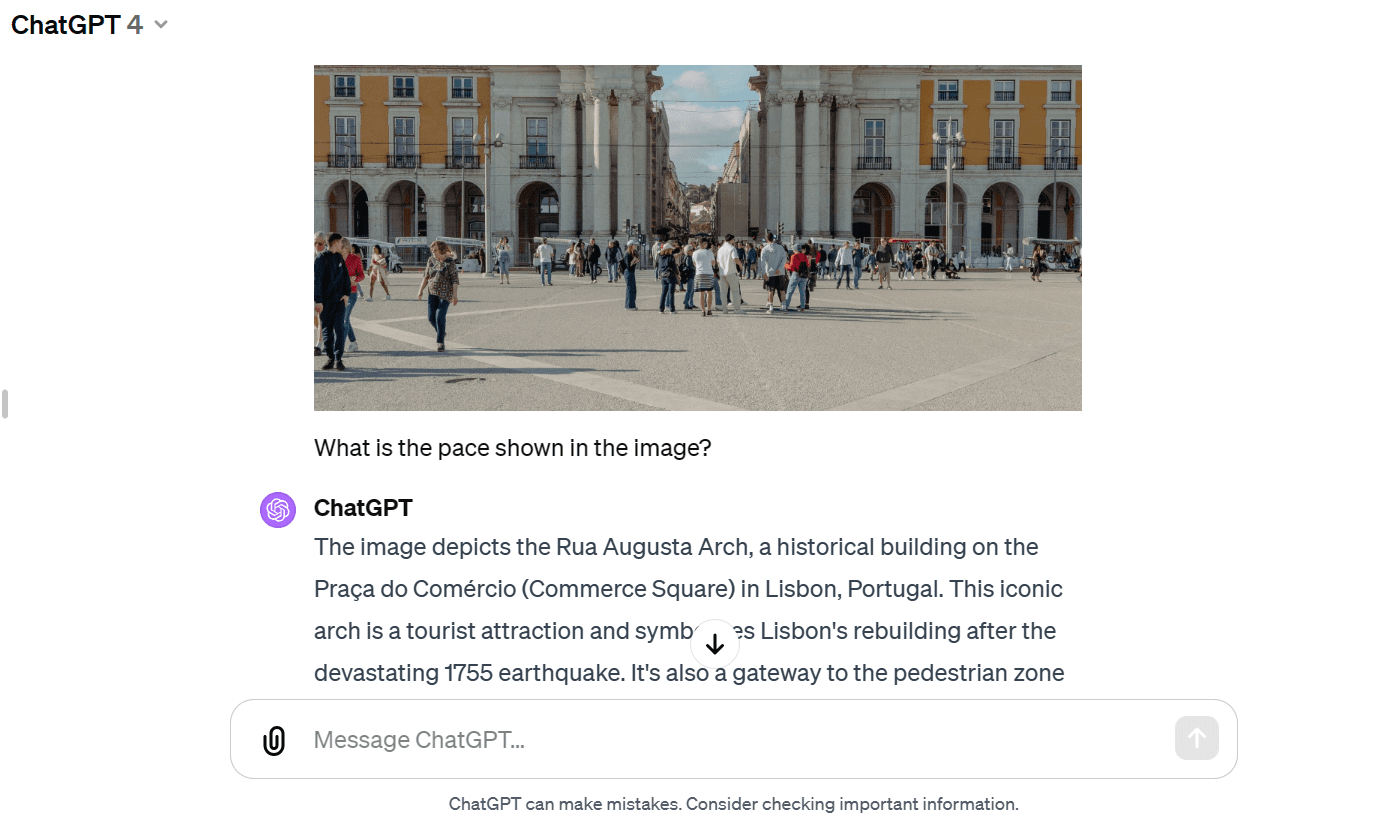

Vamos fornecer a mesma imagem ao GPT-4 e perguntar sobre a imagem. Ambos os modelos forneceram respostas quase semelhantes. Mas gosto mais da resposta do GPT-4.

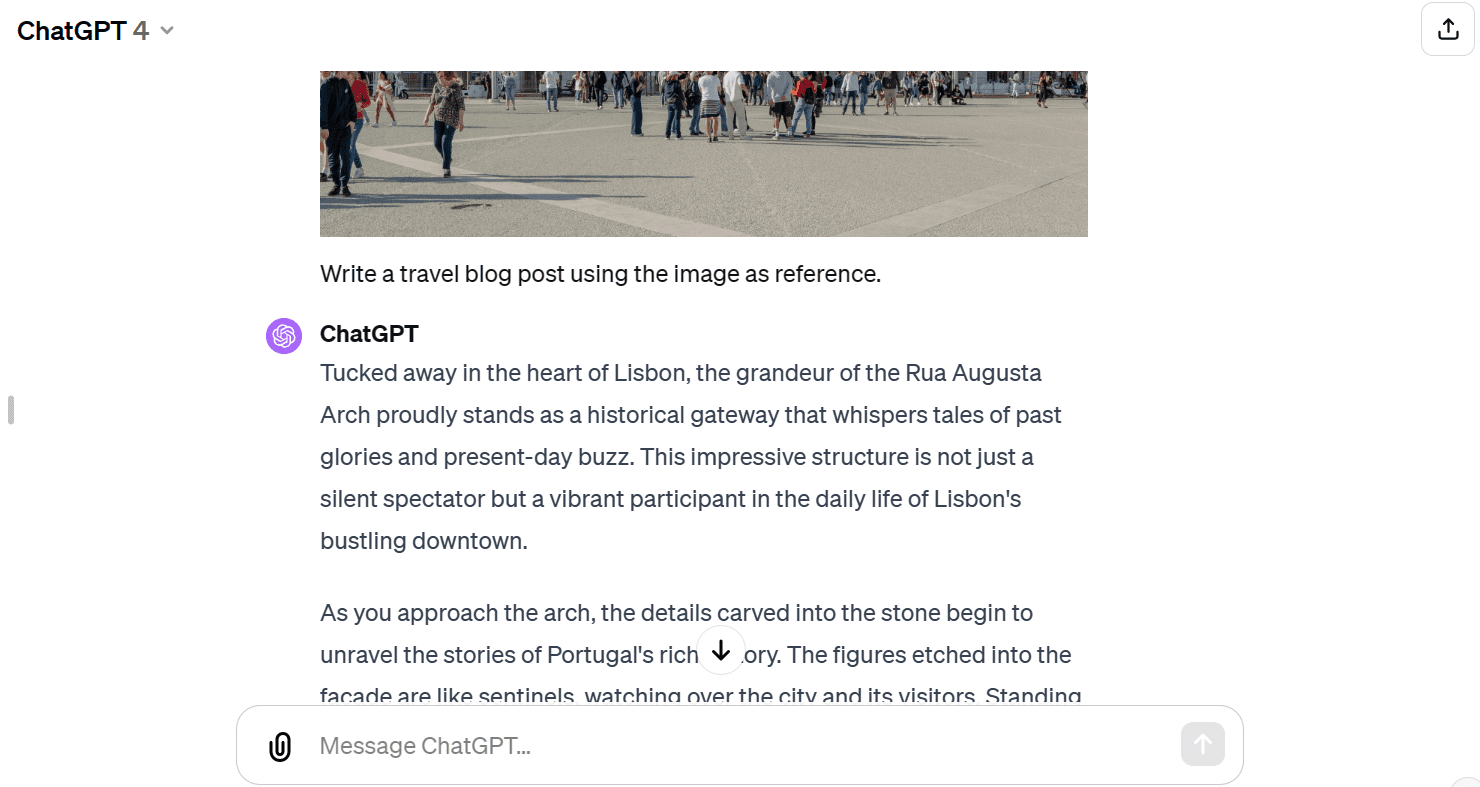

Agora forneceremos o texto e a imagem para a API. Pedimos ao modelo de visão que escrevesse um blog de viagens usando a imagem como referência.

response = model.generate_content(["Write a travel blog post using the image as reference.", img])

Markdown(response.text)Ele me forneceu um pequeno blog. Eu esperava um formato mais longo.

Comparado ao GPT-4, o modelo Gemini Pro Vision tem lutado para gerar um blog de formato longo.

Podemos configurar o modelo para ter uma sessão de bate-papo de ida e volta. Dessa forma, o modelo lembra o contexto e a resposta das conversas anteriores.

No nosso caso, iniciamos a sessão de chat e pedimos à modelo que me ajudasse a começar a jogar Dota 2.

model = genai.GenerativeModel('gemini-pro')

chat = model.start_chat(history=[])

chat.send_message("Can you please guide me on how to start playing Dota 2?")

chat.historyComo você pode ver, o objeto `chat` está salvando o histórico do usuário e do modo chat.

Também podemos exibi-los em estilo Markdown.

for message in chat.history:

display(Markdown(f'**{message.role}**: {message.parts[0].text}'))

Vamos fazer a pergunta de acompanhamento.

chat.send_message("Which Dota 2 heroes should I start with?")

for message in chat.history:

display(Markdown(f'**{message.role}**: {message.parts[0].text}'))Podemos rolar para baixo e ver toda a sessão com o modelo.

Os modelos de incorporação estão se tornando cada vez mais populares para aplicações sensíveis ao contexto. O modelo Gemini embedding-001 permite que palavras, frases ou documentos inteiros sejam representados como vetores densos que codificam o significado semântico. Esta representação vetorial torna possível comparar facilmente a semelhança entre diferentes trechos de texto, comparando seus vetores de incorporação correspondentes.

Podemos fornecer o conteúdo para `embed_content` e converter o texto em embeddings. É tão simples.

output = genai.embed_content(

model="models/embedding-001",

content="Can you please guide me on how to start playing Dota 2?",

task_type="retrieval_document",

title="Embedding of Dota 2 question")

print(output['embedding'][0:10])[0.060604308, -0.023885584, -0.007826327, -0.070592545, 0.021225851, 0.043229062, 0.06876691, 0.049298503, 0.039964676, 0.08291664]Podemos converter vários pedaços de texto em embeddings passando uma lista de strings para o argumento ‘content’.

output = genai.embed_content(

model="models/embedding-001",

content=[

"Can you please guide me on how to start playing Dota 2?",

"Which Dota 2 heroes should I start with?",

],

task_type="retrieval_document",

title="Embedding of Dota 2 question")

for emb in output['embedding']:

print(emb[:10])[0.060604308, -0.023885584, -0.007826327, -0.070592545, 0.021225851, 0.043229062, 0.06876691, 0.049298503, 0.039964676, 0.08291664]

[0.04775657, -0.044990525, -0.014886052, -0.08473655, 0.04060122, 0.035374347, 0.031866882, 0.071754575, 0.042207796, 0.04577447]Se você estiver tendo problemas para reproduzir o mesmo resultado, confira meu Espaço de trabalho Deepnote.

Existem tantas funções avançadas que não abordamos neste tutorial introdutório. Você pode aprender mais sobre a API Gemini acessando o API Gemini: início rápido com Python.

Neste tutorial, aprendemos sobre o Gemini e como acessar a API Python para gerar respostas. Em particular, aprendemos sobre geração de texto, compreensão visual, streaming, histórico de conversas, saída personalizada e incorporações. No entanto, isso apenas arranha a superfície do que Gêmeos pode fazer.

Sinta-se à vontade para compartilhar comigo o que você construiu usando a API gratuita do Gemini. As possibilidades são ilimitadas.

Abid Ali Awan (@ 1abidaliawan) é um profissional de cientista de dados certificado que adora criar modelos de aprendizado de máquina. Atualmente, ele está se concentrando na criação de conteúdo e escrevendo blogs técnicos sobre tecnologias de aprendizado de máquina e ciência de dados. Abid é mestre em Gestão de Tecnologia e bacharel em Engenharia de Telecomunicações. Sua visão é construir um produto de IA usando uma rede neural gráfica para estudantes que lutam contra doenças mentais.

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- Fonte: https://www.kdnuggets.com/how-to-access-and-use-gemini-api-for-free?utm_source=rss&utm_medium=rss&utm_campaign=how-to-access-and-use-gemini-api-for-free

- :tem

- :é

- $UP

- 1

- 10

- 12

- 13

- 14

- 17

- 27

- 7

- 8

- 9

- a

- Sobre

- Acesso

- exatamente

- em

- acrescentando

- Adicional

- Informação adicional

- avançado

- novamente

- AI

- estrangeiros

- Todos os Produtos

- permite

- quase

- tb

- surpreendente

- an

- e

- respostas

- Antrópico

- api

- APIs

- aplicações

- arquitetura

- SOMOS

- argumento

- AS

- perguntar

- At

- auditivo

- Equilibrado

- BE

- tornando-se

- sido

- antes

- referência

- entre

- Blog

- Blogs

- ambos

- construir

- Prédio

- construído

- negócios

- mas a

- botão

- by

- chamado

- CAN

- candidato

- candidatos

- capacidades

- capaz

- casas

- casos

- Centros

- Non-GMO

- bate-papo

- verificar

- Limpeza

- clique

- código

- colaboração

- comparar

- comparando

- integrações

- conteúdo

- Criação de conteúdo

- contexto

- Conversa

- conversas

- converter

- Correspondente

- cobrir

- criação

- Atualmente

- personalizadas

- personalizar

- dados,

- centros de dados

- ciência de dados

- cientista de dados

- Data

- DeepMind

- Grau

- denso

- projetado

- desenvolvido

- desenvolvedores

- Dispositivos/Instrumentos

- didn

- diferente

- Ecrã

- diferente

- do

- INSTITUCIONAIS

- don

- Dota

- Dota 2

- down

- facilmente

- fácil

- eficiente

- eficientemente

- embutindo

- Engenharia

- Todo

- Meio Ambiente

- Éter (ETH)

- esperando

- especialistas

- Explicação

- explorar

- mais rápido

- Primeiro nome

- flexível

- focando

- seguir

- Escolha

- formato

- Gratuito

- da

- função

- funções

- jogo

- Gemini

- gerar

- geração

- ter

- gif

- Go

- vai

- Bom estado, com sinais de uso

- gráfico

- Rede Neural do Gráfico

- guia

- tinha

- Ter

- ter

- he

- ajudar

- SUA PARTICIPAÇÃO FAZ A DIFERENÇA

- Heróis

- Alta

- altamente

- sua

- história

- detém

- Como funciona o dobrador de carta de canal

- Como Negociar

- Contudo

- HTTPS

- humano

- i

- identificado

- doença

- imagem

- imagens

- importar

- in

- Incluindo

- cada vez mais

- INFORMAÇÕES

- iniciar

- instalar

- instância

- em vez disso

- integração

- para dentro

- introdutório

- IT

- ESTÁ

- jpg

- julia

- apenas por

- KDnuggetsGenericName

- Chave

- Conhecimento

- língua

- maior

- APRENDER

- aprendido

- aprendizagem

- como

- ilimitado

- Lista

- carregar

- mais

- ama

- máquina

- aprendizado de máquina

- FAZ

- de grupos

- muitos

- maciço

- dominar

- max

- me

- significado

- significa

- mental

- Doença mental

- Métrica

- Móvel Esteira

- dispositivos móveis

- Moda

- modelo

- modelos

- mais

- a maioria

- múltiplo

- nome

- nano

- NBA

- rede

- Neural

- rede neural

- Novo

- Próximo

- agora

- objeto

- of

- on

- ONE

- só

- OpenAI

- operar

- or

- OS

- A Nossa

- Fora

- Outperform

- saída

- Palácio

- particular

- Passagem

- perfeita

- atuação

- realização

- pessoal

- foto

- peças

- platão

- Inteligência de Dados Platão

- PlatãoData

- jogar

- por favor

- ponto

- Popular

- possibilidades

- possível

- Publique

- potencial

- anterior

- Pro

- Problema

- Solução de problemas

- Produto

- profissional

- fornecer

- fornecido

- fornecendo

- Python

- qualidade

- consultas

- questão

- bastante

- alcance

- RE

- referência

- representação

- representado

- pesquisa

- resposta

- respostas

- resultar

- revolucionar

- s

- mesmo

- poupança

- AMPLIAR

- Escala

- escala ai

- Ciência

- Cientista

- scroll

- Seção

- Vejo

- selecionar

- Sessão

- conjunto

- contexto

- vários

- Partilhar

- Baixo

- rede de apoio social

- semelhante

- simples

- solteiro

- So

- Resolvendo

- Espaço

- especificamente

- começo

- começado

- estado-da-arte

- Passo

- Dê um basta

- parou

- História

- transmitir canais

- de streaming

- Lutando

- Estudantes

- estilo

- adequado

- superfície

- sistemas

- T

- tarefas

- equipes

- Dados Técnicos:

- Tecnologias

- Tecnologia

- telecomunicação

- teste

- testes

- texto

- geração de texto

- que

- A

- deles

- Eles

- então

- isto

- três

- Através da

- para

- Tokens

- viagens

- problema

- tutorial

- tipos

- Ultra

- compreender

- compreensão

- us

- utilizável

- usar

- Utilizador

- utilização

- variável

- vário

- Vídeo

- visão

- visual

- foi

- Caminho..

- we

- O Quê

- qual

- QUEM

- Largo

- Ampla variedade

- precisarão

- de

- Word

- palavras

- Atividades:

- mundo

- escrever

- escrita

- Você

- investimentos

- zefirnet