Autor: Vitalik Buterin através do Blog de Vitalik Buterin

Agradecimentos especiais às equipes Worldcoin e Modulus Labs, Xinyuan Sun, Martin Koeppelmann e Illia Polosukhin pelo feedback e discussão.

Muitas pessoas ao longo dos anos me fizeram uma pergunta semelhante: quais são os interseções entre criptografia e IA que considero o mais frutífero? É uma pergunta razoável: criptografia e IA são as duas principais tendências tecnológicas profundas (de software) da última década, e parece que existem devo haver algum tipo de conexão entre os dois. É fácil criar sinergias em um nível de vibração superficial: a descentralização da criptografia pode equilibrar a centralização da IA, a IA é opaca e a criptografia traz transparência, a IA precisa de dados e os blockchains são bons para armazenar e rastrear dados. Mas ao longo dos anos, quando as pessoas me pediam para ir mais fundo e falar sobre aplicações específicas, a minha resposta foi decepcionante: “sim, há algumas coisas, mas não tanto assim”.

Nos últimos três anos, com o surgimento de uma IA muito mais poderosa na forma de tecnologias modernas LLMs, e o surgimento de criptografia muito mais poderosa, não apenas na forma de soluções de escalonamento de blockchain, mas também ZKPs, FHE, (bipartidária e N-partidária) MPC, estou começando a ver essa mudança. De fato, existem algumas aplicações promissoras de IA dentro dos ecossistemas blockchain, ou IA junto com criptografia, embora seja importante ter cuidado com a forma como a IA é aplicada. Um desafio específico é: na criptografia, o código aberto é a única maneira de tornar algo verdadeiramente seguro, mas na IA, um modelo (ou mesmo seus dados de treinamento) sendo aberto aumenta muito sua vulnerabilidade a aprendizado de máquina adversário ataques. Este post abordará uma classificação das diferentes maneiras pelas quais criptografia e IA podem se cruzar, e as perspectivas e desafios de cada categoria.

Um resumo de alto nível das interseções de criptografia + IA de um Postagem no blog da uETH. Mas o que é necessário para realmente concretizar qualquer uma dessas sinergias em uma aplicação concreta?

As quatro categorias principais

IA é um conceito muito amplo: você pode pensar em “IA” como sendo o conjunto de algoritmos que você cria não especificando-os explicitamente, mas sim mexendo uma grande sopa computacional e colocando algum tipo de pressão de otimização que empurra a sopa para produzindo algoritmos com as propriedades que você deseja. Esta descrição não deve definitivamente ser tomada com desdém: ela inclui que o processo que criado nós, humanos, em primeiro lugar! Mas significa que os algoritmos de IA têm algumas propriedades comuns: a sua capacidade de fazer coisas que são extremamente poderosas, juntamente com limites na nossa capacidade de saber ou compreender o que se passa nos bastidores.

Existem muitas maneiras de categorizar a IA; para os fins deste post, que fala sobre interações entre IA e blockchains (que foram descritos como uma plataforma para criando “jogos”), vou categorizá-lo da seguinte forma:

- IA como jogador em um jogo [maior viabilidade]: IAs participando de mecanismos onde a fonte final dos incentivos vem de um protocolo com contribuições humanas.

- IA como interface para o jogo [alto potencial, mas com riscos]: A IA está ajudando os usuários a compreender o mundo criptográfico ao seu redor e a garantir que seu comportamento (ou seja, mensagens e transações assinadas) corresponda às suas intenções e que eles não sejam enganados ou enganados.

- IA como regras do jogo [tenha muito cuidado]: blockchains, DAOs e mecanismos semelhantes que chamam diretamente IAs. Pense, por exemplo. “Juízes de IA”

- IA como objetivo do jogo [longo prazo, mas intrigante]: projetar blockchains, DAOs e mecanismos semelhantes com o objetivo de construir e manter uma IA que possa ser usada para outros fins, usando os bits criptográficos para melhor incentivar o treinamento ou para evitar que a IA vaze dados privados ou seja mal utilizada.

Vamos examinar isso um por um.

IA como jogador em um jogo

Na verdade, esta é uma categoria que existe há quase uma década, pelo menos desde exchanges descentralizadas on-chain (DEXes) começou a ver um uso significativo. Sempre que há uma troca, há uma oportunidade de ganhar dinheiro através da arbitragem, e os bots podem fazer arbitragem muito melhor do que os humanos. Este caso de uso já existe há muito tempo, mesmo com IAs muito mais simples do que as que temos hoje, mas no final das contas é uma interseção muito real de IA + criptografia. Mais recentemente, vimos bots de arbitragem MEV muitas vezes explorando uns aos outros. Sempre que você tiver um aplicativo blockchain que envolva leilões ou negociações, você terá bots de arbitragem.

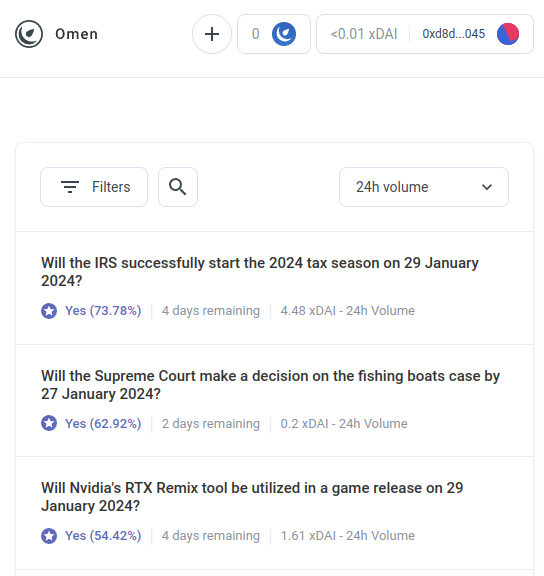

Mas os bots de arbitragem de IA são apenas o primeiro exemplo de uma categoria muito maior, que espero que em breve comece a incluir muitas outras aplicações. Conheça AIOmen, um demonstração de um mercado de previsão onde as IAs são participantes:

Uma resposta a isso é apontar para melhorias contínuas de UX em Polimercado ou outros novos mercados de previsão, e espero que tenham sucesso onde as iterações anteriores falharam. Afinal, diz a história, as pessoas estão dispostas a apostar dezenas de bilhões em esportes, então por que as pessoas não investiriam dinheiro suficiente apostando nas eleições dos EUA ou LK99 que começa a fazer sentido que os jogadores sérios comecem a entrar? Mas este argumento deve enfrentar o fato de que, bem, as iterações anteriores não conseguiram chegar a este nível de escala (pelo menos em comparação com os sonhos dos seus proponentes), e por isso parece que você precisa algo novo para fazer com que os mercados de previsão tenham sucesso. E, portanto, uma resposta diferente é apontar para uma característica específica dos ecossistemas de mercado de previsão que podemos esperar ver na década de 2020 e que não vimos na década de 2010: a possibilidade de participação onipresente das IAs.

As IAs estão dispostas a trabalhar por menos de US$ 1 por hora e possuem o conhecimento de uma enciclopédia – e se isso não for suficiente, elas podem até ser integradas com capacidade de pesquisa na web em tempo real. Se você criar um mercado e oferecer um subsídio de liquidez de US$ 50, os humanos não se importarão o suficiente para fazer lances, mas milhares de IAs facilmente atacarão a questão e darão o melhor palpite que puderem. O incentivo para fazer um bom trabalho em qualquer questão pode ser pequeno, mas o incentivo para criar uma IA que faça boas previsões em geral pode estar na casa dos milhões. Observe que potencialmente, você nem precisa dos humanos para julgar a maioria das questões: você pode usar um sistema de disputa de múltiplas rodadas semelhante ao Augur ou Kleros, onde as IAs também seriam as participantes das rodadas anteriores. Os seres humanos só precisariam de responder nos poucos casos em que ocorresse uma série de escaladas e em que grandes quantias de dinheiro tivessem sido comprometidas por ambos os lados.

Esta é uma primitiva poderosa, porque uma vez que um “mercado de previsão” possa funcionar em uma escala tão microscópica, você poderá reutilizar a primitiva de “mercado de previsão” para muitos outros tipos de questões:

- Esta postagem em mídia social é aceitável sob [termos de uso]?

- O que acontecerá com o preço da ação X (por exemplo, ver Numerai)

- Esta conta que está me enviando mensagens é na verdade Elon Musk?

- Este envio de trabalho em um mercado de tarefas online é aceitável?

- O dapp em https://examplefinance.network é uma farsa?

- Is

0x1b54....98c3na verdade, o endereço do token ERC20 “Casinu Inu”?

Você pode notar que muitas dessas ideias vão na direção do que chamei de “defesa de informações" em . Definida em termos gerais, a questão é: como podemos ajudar os utilizadores a distinguir informações verdadeiras e falsas e a detetar fraudes, sem capacitar uma autoridade centralizada para decidir o que é certo e o que é errado, quem poderá então abusar dessa posição? Em um nível micro, a resposta pode ser “IA”. Mas a um nível macro, a questão é: quem constrói a IA? A IA é um reflexo do processo que a criou e, portanto, não pode evitar preconceitos. Portanto, há necessidade de um jogo de nível superior que avalie o desempenho das diferentes IAs, onde as IAs possam participar como jogadores no jogo..

Este uso da IA, onde as IAs participam de um mecanismo onde são finalmente recompensadas ou penalizadas (probabilisticamente) por um mecanismo em cadeia que reúne informações de humanos (chame-o descentralizado baseado no mercado RLHF?), é algo que acho que realmente vale a pena investigar. Agora é o momento certo para analisar mais casos de uso como este, porque o dimensionamento do blockchain está finalmente tendo sucesso, tornando “micro” qualquer coisa finalmente viável na cadeia, quando muitas vezes não era antes.

Uma categoria relacionada de aplicações vai na direção de agentes altamente autônomos usando blockchains para cooperar melhor, seja através de pagamentos ou da utilização de contratos inteligentes para assumir compromissos credíveis.

IA como interface para o jogo

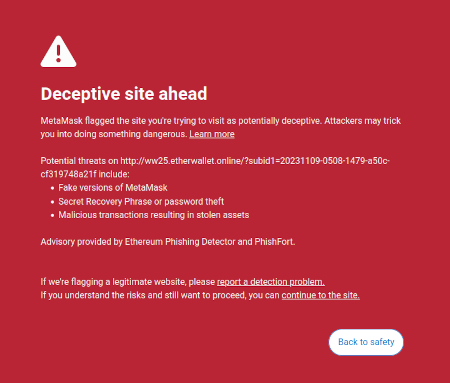

Uma ideia que trouxe na minha escritos sobre é a ideia de que existe uma oportunidade de mercado para escrever software voltado para o usuário que proteja os interesses dos usuários, interpretando e identificando perigos no mundo on-line em que o usuário está navegando. Um exemplo já existente disso é o recurso de detecção de golpes do Metamask:

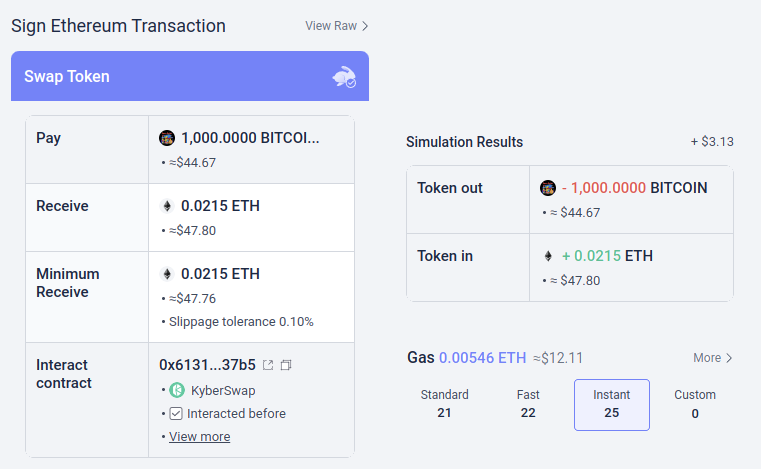

Potencialmente, esses tipos de ferramentas poderiam ser sobrecarregados com IA. A IA poderia fornecer uma explicação muito mais rica e amigável sobre o tipo de dapp do qual você está participando, as consequências de operações mais complicadas que você está assinando, se um token específico é genuíno ou não (por exemplo, BITCOIN não é apenas uma sequência de caracteres, é o nome de uma criptomoeda real, que não é um token ERC20 e que tem um preço muito superior a US$ 0.045, e um LLM moderno saberia disso) e assim por diante. Há projectos que começam a avançar nesta direcção (por exemplo, o Carteira LangChain, que usa IA como primário interface). Minha opinião é que as interfaces de IA pura são provavelmente muito arriscadas no momento, pois aumentam o risco de de outros tipos de erros, mas a IA complementando uma interface mais convencional está se tornando muito viável.

Há um risco específico que vale a pena mencionar. Abordarei mais isso na seção “IA como regras do jogo” abaixo, mas a questão geral é o aprendizado de máquina adversário: se um usuário tiver acesso a um assistente de IA dentro de uma carteira de código aberto, os bandidos também terão acesso a esse assistente de IA e, portanto, terão oportunidades ilimitadas de otimizar seus golpes para não desencadear as defesas daquela carteira. Todas as IAs modernas têm bugs em algum lugar, e não é muito difícil para um processo de treinamento, mesmo que tenha apenas acesso limitado ao modelo, para encontrá-los.

É aqui que “IAs que participam em micromercados em cadeia” funcionam melhor: cada IA individual é vulnerável aos mesmos riscos, mas você está criando intencionalmente um ecossistema aberto de dezenas de pessoas constantemente iterando e melhorando-os continuamente. Além disso, cada IA individual é fechada: a segurança do sistema vem da abertura das regras do jogo, não o funcionamento interno de cada um jogador.

Resumo: A IA pode ajudar os usuários a entender o que está acontecendo em linguagem simples, pode servir como um tutor em tempo real, pode proteger os usuários de erros, mas esteja avisado ao tentar usá-la diretamente contra desinformadores e golpistas maliciosos.

IA como regras do jogo

Agora chegamos ao aplicativo que deixa muita gente entusiasmada, mas que considero o mais arriscado e onde precisamos agir com mais cuidado: o que chamo de IAs como parte das regras do jogo. Isto está ligado ao entusiasmo entre as principais elites políticas sobre os “juízes de IA” (por exemplo, ver Este artigo no site da “Cúpula Governamental Mundial”), e há análogos desses desejos em aplicações blockchain. Se um contrato inteligente baseado em blockchain ou um DAO precisar tomar uma decisão subjetiva (por exemplo, um produto de trabalho específico é aceitável em um contrato de trabalho contratado? Qual é a interpretação correta de uma constituição de linguagem natural como o Otimismo Lei das Correntes?), você poderia fazer com que uma IA simplesmente fizesse parte do contrato ou DAO para ajudar a fazer cumprir essas regras?

Aqui é onde aprendizado de máquina adversário será um desafio extremamente difícil. O argumento básico de duas frases é o seguinte:

Se um modelo de IA que desempenha um papel fundamental em um mecanismo for fechado, não será possível verificar seu funcionamento interno e, portanto, não será melhor do que um aplicativo centralizado. Se o modelo de IA estiver aberto, um invasor poderá baixá-lo e simulá-lo localmente e projetar ataques altamente otimizados para enganar o modelo, que poderá então reproduzir na rede ativa.

Agora, os leitores frequentes deste blog (ou habitantes do criptoverso) podem já estar me adiantando e pensando: mas espere! Temos provas sofisticadas de conhecimento zero e outras formas muito legais de criptografia. Certamente podemos fazer alguma criptografia mágica e ocultar o funcionamento interno do modelo para que os invasores não possam otimizar os ataques, mas ao mesmo tempo provar que o modelo está sendo executado corretamente e foi construído usando um processo de treinamento razoável em um conjunto razoável de dados subjacentes!

Normalmente, isso é exatamente o tipo de pensamento que defendo neste blog e em meus outros escritos. Mas no caso da computação relacionada à IA, existem duas objeções principais:

- Sobrecarga criptográfica: é muito menos eficiente fazer algo dentro de um SNARK (ou MPC ou…) do que fazê-lo “às claras”. Dado que a IA já exige muito uso computacional, será que fazer IA dentro de caixas pretas criptográficas é mesmo computacionalmente viável?

- Ataques de aprendizado de máquina adversários de caixa preta: existem maneiras de otimizar ataques contra modelos de IA mesmo sem saber muito sobre o funcionamento interno do modelo. E se você se esconder demais, você corre o risco de tornar muito fácil para quem escolhe os dados de treinamento corromper o modelo com envenenamento ataques.

Ambas são tocas de coelho complicadas, então vamos examinar cada uma delas.

Sobrecarga criptográfica

Dispositivos criptográficos, especialmente os de uso geral, como ZK-SNARKs e MPC, têm uma sobrecarga elevada. Um bloco Ethereum leva algumas centenas de milissegundos para um cliente verificar diretamente, mas gerar um ZK-SNARK para provar a exatidão de tal bloco pode levar horas. A sobrecarga típica de outros dispositivos criptográficos, como o MPC, pode ser ainda pior. A computação de IA já é cara: os LLMs mais poderosos podem produzir palavras individuais apenas um pouco mais rápido do que os seres humanos conseguem lê-las, sem mencionar os custos computacionais muitas vezes multimilionários de treinamento os modelos. A diferença de qualidade entre os modelos topo de linha e os modelos que tentam economizar muito mais em custo de treinamento or contagem de parâmetros é grande. À primeira vista, este é um bom motivo para suspeitar de todo o projeto de tentar adicionar garantias à IA envolvendo-a em criptografia.

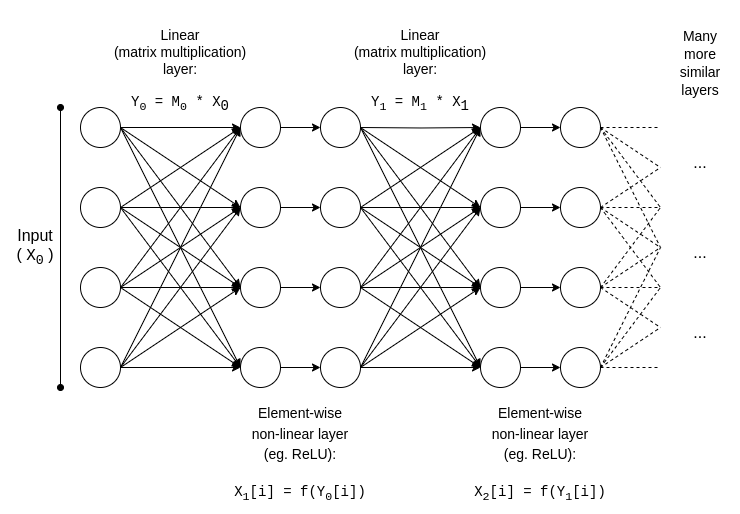

Felizmente, porém, IA é um tipo muito específico de computação, o que o torna passível de todos os tipos de otimizações dos quais tipos de computação mais “não estruturados”, como ZK-EVMs, não podem se beneficiar. Vamos examinar a estrutura básica de um modelo de IA:

y = max(x, 0)). Assintoticamente, as multiplicações de matrizes ocupam a maior parte do trabalho: multiplicar dois N*N matrizes leva �(�2.8) tempo, enquanto o número de operações não lineares é muito menor. Isso é realmente conveniente para criptografia, porque muitas formas de criptografia podem realizar operações lineares (que são multiplicações de matrizes, pelo menos se você criptografar o modelo, mas não as entradas para ele) quase “de graça”.

Se você é um criptógrafo, provavelmente já ouviu falar de um fenômeno semelhante no contexto de criptografia homomórfica: realizando Adicionais em textos cifrados criptografados é realmente fácil, mas multiplicações são incrivelmente difíceis e não descobrimos nenhuma maneira de fazê-lo com profundidade ilimitada até 2009.

Para ZK-SNARKs, o equivalente é protocolos como este de 2013, que mostram uma menos de 4x sobrecarga na prova de multiplicações de matrizes. Infelizmente, o overhead nas camadas não lineares ainda acaba sendo significativo, e as melhores implementações na prática mostram um overhead de cerca de 200x. Mas há esperança de que isto possa ser bastante reduzido através de mais pesquisas; ver esta apresentação de Ryan Cao para uma abordagem recente baseada no GKR, e no meu próprio explicação simplificada de como funciona o principal componente do GKR.

Mas para muitas aplicações, não queremos apenas provar que uma saída de IA foi calculada corretamente, também queremos ocultar o modelo. Existem abordagens ingênuas para isso: você pode dividir o modelo para que um conjunto diferente de servidores armazene redundantemente cada camada e esperar que alguns dos servidores que vazam algumas das camadas não vazem muitos dados. Mas também existem formas surpreendentemente eficazes de computação multipartidária especializada.

Em ambos os casos, a moral da história é a mesma: a maior parte de um cálculo de IA são multiplicações de matrizes, para as quais é possível fazer muito eficiente ZK-SNARKs ou MPCs (ou mesmo FHE) e, portanto, a sobrecarga total de colocar IA dentro de caixas criptográficas é surpreendentemente baixa. Geralmente, são as camadas não lineares que constituem o maior gargalo, apesar de seu tamanho menor; talvez técnicas mais recentes como argumentos de pesquisa podem ajudar.

Aprendizado de máquina adversário de caixa preta

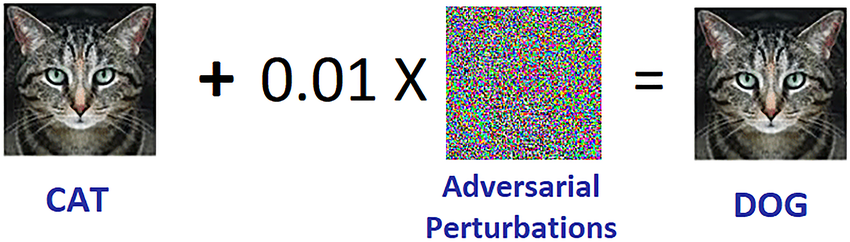

Agora, vamos ao outro grande problema: os tipos de ataques que você pode fazer mesmo se o conteúdo do modelo é mantido privado e você só tem “acesso API” ao modelo. Citando um papel de 2016:

Muitos modelos de aprendizado de máquina são vulneráveis a exemplos adversários: entradas especialmente criadas para fazer com que um modelo de aprendizado de máquina produza uma saída incorreta. Exemplos adversários que afetam um modelo geralmente afetam outro modelo, mesmo que os dois modelos tenham arquiteturas diferentes ou tenham sido treinados em conjuntos de treinamento diferentes, desde que ambos os modelos tenham sido treinados para executar a mesma tarefa.. Um invasor pode, portanto, treinar seu próprio modelo substituto, criar exemplos adversários contra o substituto e transferi-los para um modelo de vítima, com muito pouca informação sobre a vítima.

Potencialmente, você pode até criar ataques sabendo apenas os dados de treinamento, mesmo que você tenha acesso muito limitado ou nenhum acesso ao modelo que está tentando atacar. A partir de 2023, esses tipos de ataques continuam a ser um grande problema.

Para reduzir efetivamente esses tipos de ataques de caixa preta, precisamos fazer duas coisas:

- Realmente limitar quem ou o que pode consultar o modelo e quanto. As caixas pretas com acesso irrestrito à API não são seguras; caixas pretas com acesso à API muito restrito podem ser.

- Oculte os dados de treinamento, preservando a confiança que o processo usado para criar os dados de treinamento não esteja corrompido.

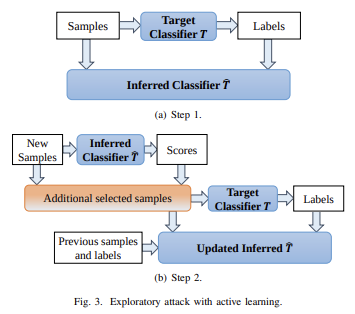

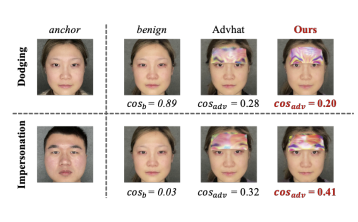

O projeto que mais teve sucesso no primeiro é talvez o Worldcoin, do qual analiso longamente uma versão anterior (entre outros protocolos). SUA PARTICIPAÇÃO FAZ A DIFERENÇA. A Worldcoin usa modelos de IA extensivamente em nível de protocolo, para (i) converter varreduras de íris em “códigos de íris” curtos que são fáceis de comparar quanto à similaridade e (ii) verificar se a coisa que está sendo escaneada é na verdade um ser humano. A principal defesa em que a Worldcoin se baseia é o fato de que não permite que ninguém simplesmente ligue para o modelo de IA: em vez disso, está usando hardware confiável para garantir que o modelo aceite apenas entradas assinadas digitalmente pela câmera do orbe.

Não é garantido que esta abordagem funcione: acontece que você pode fazer ataques adversários contra IA biométrica que vêm na forma de remendos físicos ou joias que você pode colocar no rosto:

Mas a esperança é que se você combine todas as defesas juntas, ocultando o próprio modelo de IA, limitando bastante o número de consultas e exigindo que cada consulta seja autenticada de alguma forma, você pode criar ataques adversários difíceis o suficiente para que o sistema fique seguro.

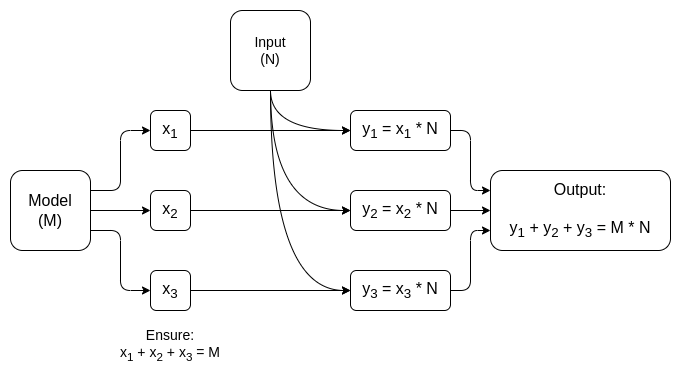

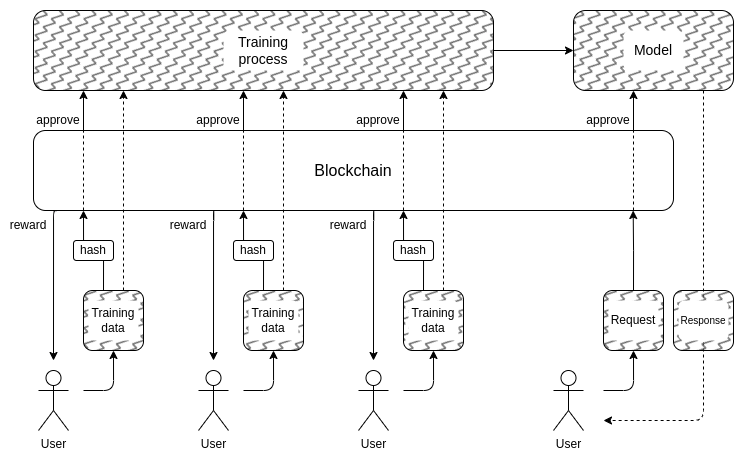

E isso nos leva à segunda parte: como podemos ocultar os dados de treinamento? É aqui que “DAOs para governar democraticamente a IA” pode realmente fazer sentido: podemos criar um DAO on-chain que rege o processo de quem tem permissão para enviar dados de treinamento (e quais atestados são necessários nos próprios dados), quem tem permissão para fazer consultas e quantas, e usar técnicas criptográficas como MPC para criptografar todo o pipeline de criação e execução da IA, desde a entrada de treinamento de cada usuário individual até a saída final de cada consulta. Este DAO poderia simultaneamente satisfazer o objetivo altamente popular de compensar as pessoas pelo envio de dados.

- A sobrecarga criptográfica ainda pode ser muito alta para que esse tipo de arquitetura totalmente caixa preta seja competitiva com as abordagens tradicionais fechadas do tipo “confie em mim”.

- Poderia acontecer que não há uma boa maneira de descentralizar o processo de envio de dados de treinamento e protegido contra ataques de envenenamento.

- Dispositivos de computação multipartidários podem quebrar suas garantias de segurança ou privacidade devido a participantes conspirando: afinal, isso aconteceu com pontes de criptomoedas entre cadeias novamente e novamente.

Uma razão pela qual não comecei esta seção com mais grandes avisos vermelhos dizendo “NÃO FAÇA JUÍZES DE IA, ISSO É DISTÓPICO”, é que nossa sociedade já é altamente dependente de juízes de IA centralizados e irresponsáveis: os algoritmos que determinam quais tipos de postagens e opiniões políticas são impulsionadas e diminuídas, ou mesmo censuradas, nas redes sociais. Eu acho que expandir essa tendência mais distante nesta fase é uma má ideia, mas não creio que haja uma grande probabilidade de que a comunidade blockchain experimentando mais IAs será o que contribuirá para piorá-lo.

Na verdade, existem algumas maneiras básicas e de baixo risco pelas quais a tecnologia de criptografia pode melhorar até mesmo esses sistemas centralizados existentes, nas quais estou bastante confiante. IA verificada com publicação atrasada: quando um site de mídia social faz uma classificação de postagens baseada em IA, ele poderia publicar um ZK-SNARK comprovando o hash do modelo que gerou essa classificação. O site poderia se comprometer a revelar seus modelos de IA após, por exemplo. um atraso de um ano. Assim que um modelo for revelado, os usuários poderão verificar o hash para verificar se o modelo correto foi lançado, e a comunidade poderá executar testes no modelo para verificar sua imparcialidade. O atraso na publicação garantiria que, no momento em que o modelo fosse revelado, ele já estivesse desatualizado.

Então, em comparação com o centralizada mundo, a questão não é if podemos fazer melhor, mas por quanto. Para o mundo descentralizado, porém, é importante ter cuidado: se alguém construir, por exemplo. um mercado de previsão ou uma moeda estável que usa um oráculo de IA, e acontece que o oráculo é atacável, é uma enorme quantidade de dinheiro que pode desaparecer em um instante.

IA como objetivo do jogo

Se as técnicas acima para criar uma IA privada descentralizada e escalável, cujo conteúdo é uma caixa preta desconhecida por ninguém, puderem realmente funcionar, então isso também poderia ser usado para criar IAs com utilidade que vai além dos blockchains. A equipe do protocolo NEAR está tornando isso um objetivo central do seu trabalho contínuo.

Há duas razões para fazer isso:

- Se você pode fazer "IAs de caixa preta confiáveis” executando o processo de treinamento e inferência usando alguma combinação de blockchains e MPC, então muitos aplicativos onde os usuários estão preocupados com o fato de o sistema ser tendencioso ou trapaceá-los poderiam se beneficiar disso. Muitas pessoas expressaram o desejo de governança democrática de IAs sistemicamente importantes do qual dependeremos; técnicas criptográficas e baseadas em blockchain podem ser um caminho para fazer isso.

- De um Segurança de IA perspectiva, esta seria uma técnica para criar uma IA descentralizada que também possui um kill switch natural e que poderia limitar as consultas que procuram usar a IA para comportamento malicioso.

Também é importante notar que “o uso de incentivos criptográficos para incentivar a criação de uma IA melhor” pode ser feito sem cair na toca do coelho de usar criptografia para criptografá-la completamente: abordagens como Bit Tensor se enquadram nesta categoria.

Conclusões

Agora que tanto as blockchains como as IA estão a tornar-se mais poderosas, há um número crescente de casos de utilização na intersecção das duas áreas. No entanto, alguns desses casos de uso fazem muito mais sentido e são muito mais robustos que outros. Em geral, os casos de uso em que o mecanismo subjacente continua a ser projetado aproximadamente como antes, mas o indivíduo players tornam-se IAs, permitindo que o mecanismo opere efetivamente em uma escala muito mais micro, são os mais imediatamente promissores e os mais fáceis de acertar.

Os mais difíceis de acertar são os aplicativos que tentam usar blockchains e técnicas criptográficas para criar um “singleton”: uma única IA confiável e descentralizada na qual alguns aplicativos confiariam para algum propósito. Estas aplicações são promissoras, tanto em termos de funcionalidade como de melhoria da segurança da IA, de forma a evitar os riscos de centralização associados a abordagens mais convencionais para esse problema. Mas há também muitas formas pelas quais os pressupostos subjacentes podem falhar; portanto, vale a pena agir com cuidado, especialmente ao implantar esses aplicativos em contextos de alto valor e alto risco.

Estou ansioso para ver mais tentativas de casos de uso construtivos de IA em todas essas áreas, para que possamos ver quais delas são realmente viáveis em escala.

Autor: Vitalik Buterin

- Conteúdo com tecnologia de SEO e distribuição de relações públicas. Seja amplificado hoje.

- PlatoData.Network Gerativa Vertical Ai. Capacite-se. Acesse aqui.

- PlatoAiStream. Inteligência Web3. Conhecimento Amplificado. Acesse aqui.

- PlatãoESG. Carbono Tecnologia Limpa, Energia, Ambiente, Solar, Gestão de resíduos. Acesse aqui.

- PlatoHealth. Inteligência em Biotecnologia e Ensaios Clínicos. Acesse aqui.

- BlockOffsets. Modernizando a Propriedade de Compensação Ambiental. Acesse aqui.

- Fonte: Platão Inteligência de Dados.