Wideo Parodia Seinfelda Nothing, Forever – sitcom opracowany przy użyciu generatywnej sztucznej inteligencji – została tymczasowo zablokowana na Twitchu po tym, jak jedna z postaci przypadkowo wypluła transfobiczne wulgaryzmy.

Dziwaczny pokaz na nagłówkach w zeszłym tygodniu za wykorzystanie sztucznej inteligencji do improwizacji oprawy wizualnej i scenariusza niekończącego się odcinka Seinfelda. W komedii naśladującej sztukę, sitcom 30 Rock Przewiduje coś takiego ponad 15 lat temu.

Postacie, wzorowane na postaciach z kultowych seriali komediowych Jerry, George, Elaine i Kramer, wypowiadają dialog całkowicie wymyślony przy użyciu modeli językowych GPT-3 OpenAI. Tekst jest tłumaczony na dźwięk za pomocą algorytmów zamiany tekstu na mowę, a tła i sceny są również generowane przez sztuczną inteligencję. Nothing, Forever transmitowało na Twitchu 24 godziny na dobę, 7 dni w tygodniu i przyciągnęło wielu obserwujących od czasu rozpoczęcia emisji w grudniu zeszłego roku.

Ale kanał gospodarz programu został zdjęty w poniedziałek z powodu naruszać Polityka treści Twitcha. Skyler Hartle, współzałożycielka Mismatch Media i jedna z twórców Nothing, Forever, powiedziała Rejestr zakaz został wydany z powodu obraźliwych komentarzy głównego bohatera, Larry'ego Feinberga, mówiących, że osoby transpłciowe „rujnują tkankę społeczną”, bycie transpłciowym jest chorobą psychiczną i że „wszyscy liberałowie są potajemnie gejami”.

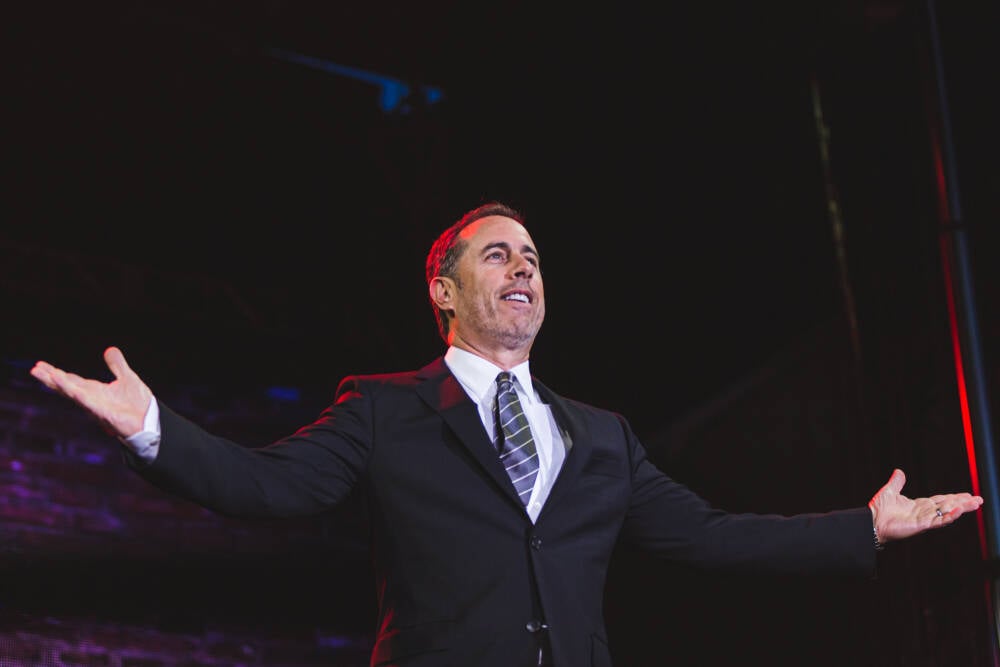

Poniżej możecie obejrzeć kiepską scenę stand-upu.

Hartle powiedział, że scenariusz serialu zboczył z toru, gdy jego twórcy przeszli z używania modelu Davinci GPT-3 OpenAI na mniej wydajną i tańszą wersję o nazwie Curie i nie zaimplementowali funkcji oprogramowania do moderowania jego treści.

„Zeszłej nocy napotkaliśmy problem z naszym połączeniem z Davinci i musieliśmy przełączyć się na model Curie, podczas gdy problem sam się rozwiązał. W tym momencie został wygenerowany nieodpowiedni tekst i natychmiast go zamknęliśmy. Zbadaliśmy ten problem dalej i odkryliśmy, że niewłaściwie wykorzystujemy narzędzia do moderowania treści OpenAI” – powiedział nam.

Hartle potwierdził, że zakaz jest tymczasowy i powinien trwać 14 dni. Mismatch Media pracuje obecnie nad wdrożeniem narzędzi do moderacji treści OpenAI, a także rozważa dodatkowy system do śledzenia wyników modelu.

„Tekst, który wygenerowaliśmy, był pomyłką, jesteśmy bardzo zawstydzeni, a stworzone treści generatywne w żaden sposób nie odzwierciedlają wartości ani opinii naszych pracowników. Bardzo żałujemy, że tak się stało i mamy nadzieję, że wkrótce wrócimy na antenę, z zachowaniem wszystkich odpowiednich zabezpieczeń” – powiedział.

Duże modele językowe, takie jak GPT-3, są trenowane na podstawie tekstu zebranego z Internetu i mogą generować nieodpowiedni, obraźliwy język. Filtry treści mogą zminimalizować najgorszy tekst, ale fragmenty nadal będą się przemykać, nawet przy zastosowanych zabezpieczeniach.

Przysłał rzecznik Twitcha Rejestr wytyczne społeczności firmy dotyczące zachowań nienawistnych i powiedział:

„Nie komentujemy konkretnych naruszeń ze względu na prywatność, ale podejmujemy odpowiednie działania, gdy mamy dowody, że kanał działał z naruszeniem naszych Wytycznych dla społeczności lub Warunków korzystania z usługi”. ®

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- Platoblockchain. Web3 Inteligencja Metaverse. Wzmocniona wiedza. Dostęp tutaj.

- Źródło: https://go.theregister.com/feed/www.theregister.com/2023/02/07/twitch_ai_seinfeld/

- 15 roku

- a

- Działania

- Po

- AI

- AIR

- Algorytmy

- Wszystkie kategorie

- i

- właściwy

- Sztuka

- przyciąga

- audio

- z powrotem

- tła

- Łazienka

- Zakaz

- zakazany

- Zakazy

- za

- jest

- poniżej

- Kanał

- charakter

- znaków

- tańsze

- Współzałożyciel

- Komedia

- komentarz

- komentarze

- społeczność

- sukcesy firma

- całkowicie

- Prowadzenie

- ZATWARDZIAŁY

- połączenie

- wobec

- zawartość

- moderacja treści

- stworzony

- twórcy

- Dni

- czynienia

- grudzień

- rozwijać

- rozwinięty

- Dialog

- ZROBIŁ

- odkryty

- na dół

- Eter (ETH)

- Parzyste

- dowód

- doświadczony

- tkanina

- Korzyści

- Feinberg

- filtry

- na zawsze

- od

- dalej

- Generować

- wygenerowane

- generatywny

- generatywna sztuczna inteligencja

- George

- wytyczne

- się

- nadzieję

- Hosting

- HTTPS

- ikoniczny

- choroba

- natychmiast

- wdrożenia

- in

- Internet

- problem

- Wydany

- IT

- samo

- Etykieta

- język

- Nazwisko

- Ostatni rok

- lewarowanie

- zrobiony

- Główny

- Dokonywanie

- wiele

- Media

- psychika

- Choroba umysłowa

- błąd

- model

- modele

- umiar

- Poniedziałek

- O imieniu

- noc

- obraźliwy

- ONE

- OpenAI

- Opinie

- Ludzie

- Miejsce

- plato

- Analiza danych Platona

- PlatoDane

- polityka

- mocny

- prywatność

- Przyczyny

- odzwierciedla

- żal

- zdecydowany

- skała

- Powiedział

- scena

- Sceny

- wtórny

- Serie

- usługa

- powinien

- pokazać

- ponieważ

- poskarżyć

- Społeczeństwo

- Tworzenie

- coś

- Wkrótce

- specyficzny

- Rzecznik

- Personel

- rozpoczęty

- Nadal

- strumieniowo

- Wspaniały

- Przełącznik

- przełączane

- system

- Brać

- tymczasowy

- REGULAMIN

- regulamin

- Text-to-Speech

- Połączenia

- Przez

- do

- także

- narzędzia

- śledzić

- przeszkolony

- transpłciowych

- Twitch

- us

- Wartości

- wersja

- NARUSZENIE

- Naruszenia

- Oglądaj

- tydzień

- Podczas

- Wikipedia

- będzie

- pracujący

- najgorszy

- rok

- lat

- zefirnet