Zdjęcie autora

Gemini to nowy model opracowany przez Google, a Bard znów staje się użyteczny. Dzięki Gemini możesz teraz uzyskać niemal doskonałe odpowiedzi na swoje pytania, dostarczając im obrazy, dźwięk i tekst.

W tym samouczku dowiemy się o interfejsie API Gemini i o tym, jak go skonfigurować na swoim komputerze. Przyjrzymy się także różnym funkcjom API języka Python, w tym generowaniu tekstu i rozumieniu obrazów.

Gemini to nowy model sztucznej inteligencji opracowany w wyniku współpracy zespołów Google, w tym Google Research i Google DeepMind. Został zbudowany specjalnie jako multimodalny, co oznacza, że może rozumieć i pracować z różnymi typami danych, takimi jak tekst, kod, dźwięk, obrazy i wideo.

Gemini to najbardziej zaawansowany i największy jak dotąd model sztucznej inteligencji opracowany przez Google. Został zaprojektowany z myślą o dużej elastyczności, dzięki czemu może efektywnie działać na szerokiej gamie systemów, od centrów danych po urządzenia mobilne. Oznacza to, że może zrewolucjonizować sposób, w jaki firmy i programiści mogą tworzyć i skalować aplikacje AI.

Oto trzy wersje modelu Gemini przeznaczone do różnych zastosowań:

- Bliźnięta Ultra: Największa i najbardziej zaawansowana sztuczna inteligencja zdolna do wykonywania złożonych zadań.

- Bliźnięta Pro: Zrównoważony model, który ma dobrą wydajność i skalowalność.

- Bliźnięta Nano: Najbardziej wydajny dla urządzeń mobilnych.

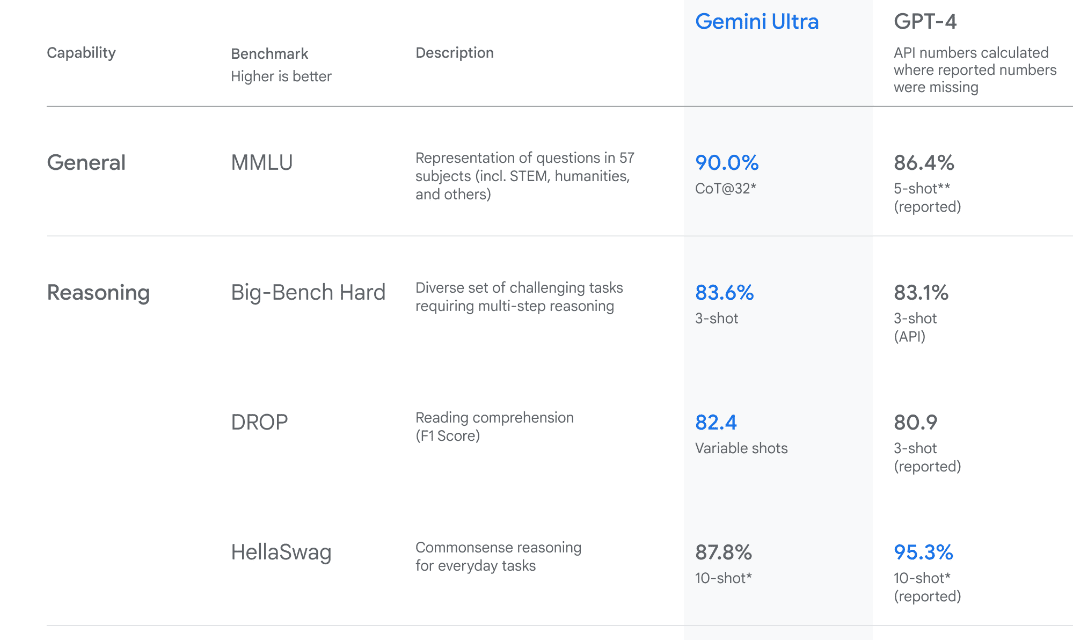

Obraz z Przedstawiamy Bliźnięta

Gemini Ultra charakteryzuje się najnowocześniejszą wydajnością, przewyższającą wydajność GPT-4 pod wieloma względami. Jest to pierwszy model, który osiąga lepsze wyniki niż eksperci w teście porównawczym Massive Multitask Language Understanding, który sprawdza wiedzę o świecie i rozwiązywanie problemów w 57 różnych tematach. To pokazuje jego zaawansowane możliwości zrozumienia i rozwiązywania problemów.

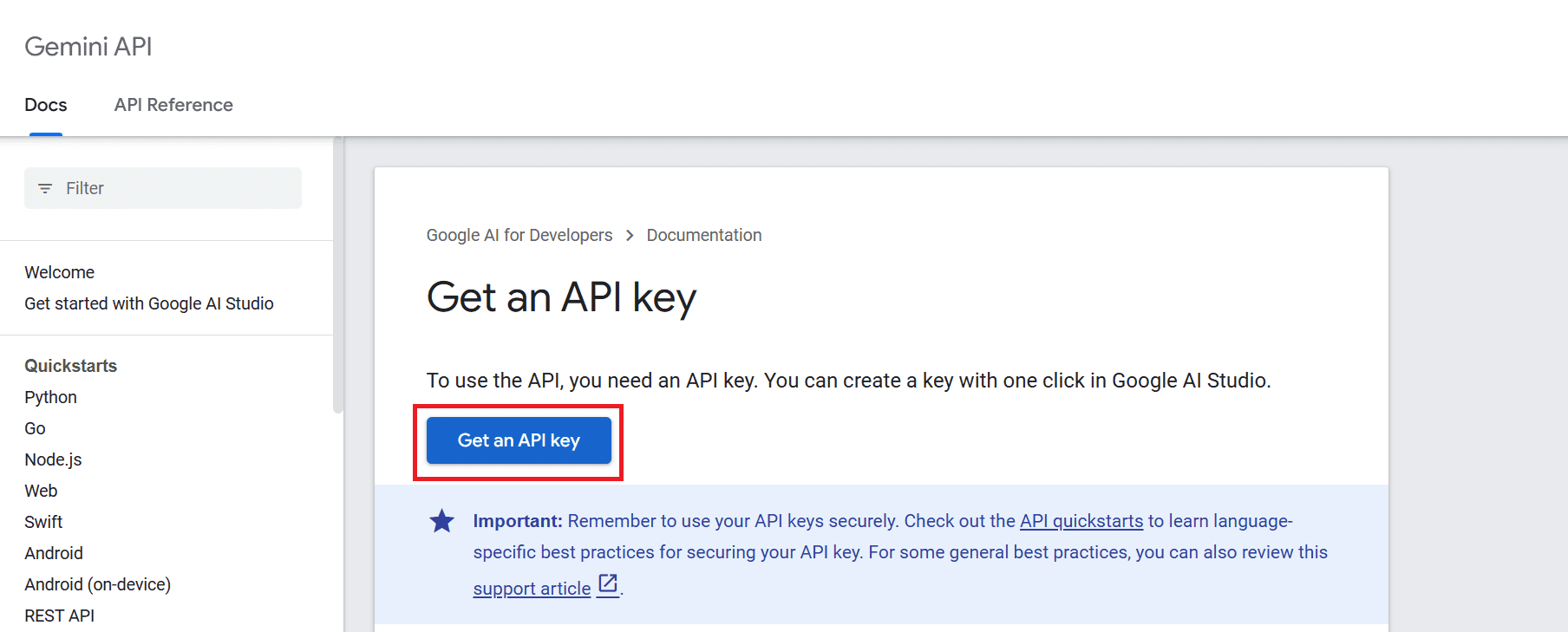

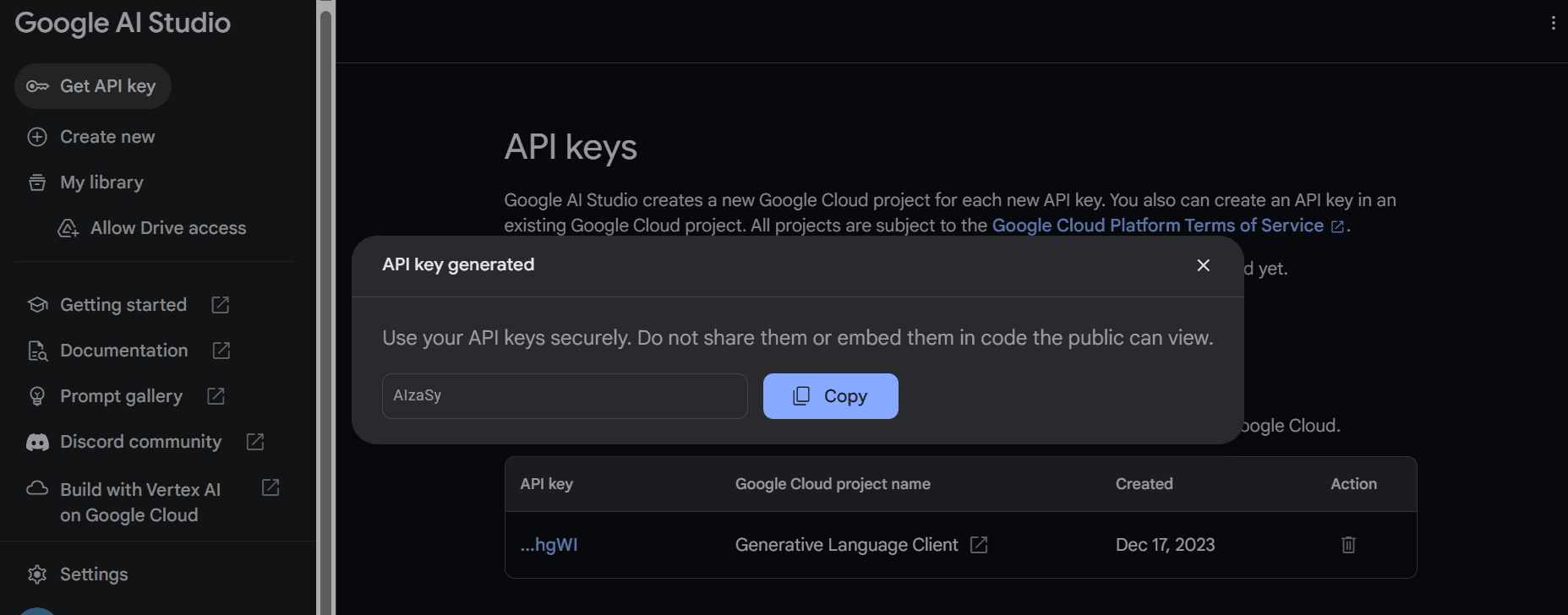

Aby móc korzystać z API, musimy najpierw zdobyć klucz API, który możesz uzyskać tutaj: https://ai.google.dev/tutorials/setup

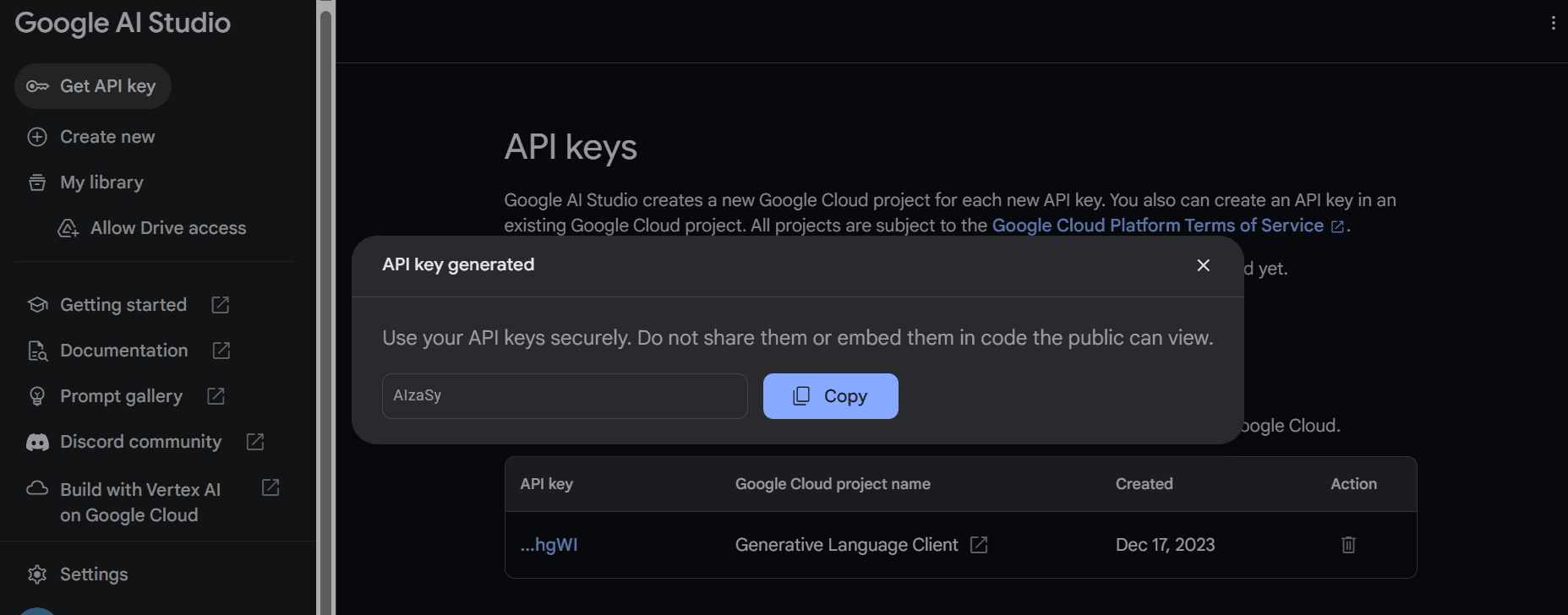

Następnie kliknij przycisk „Uzyskaj klucz API”, a następnie kliknij „Utwórz klucz API w nowym projekcie”.

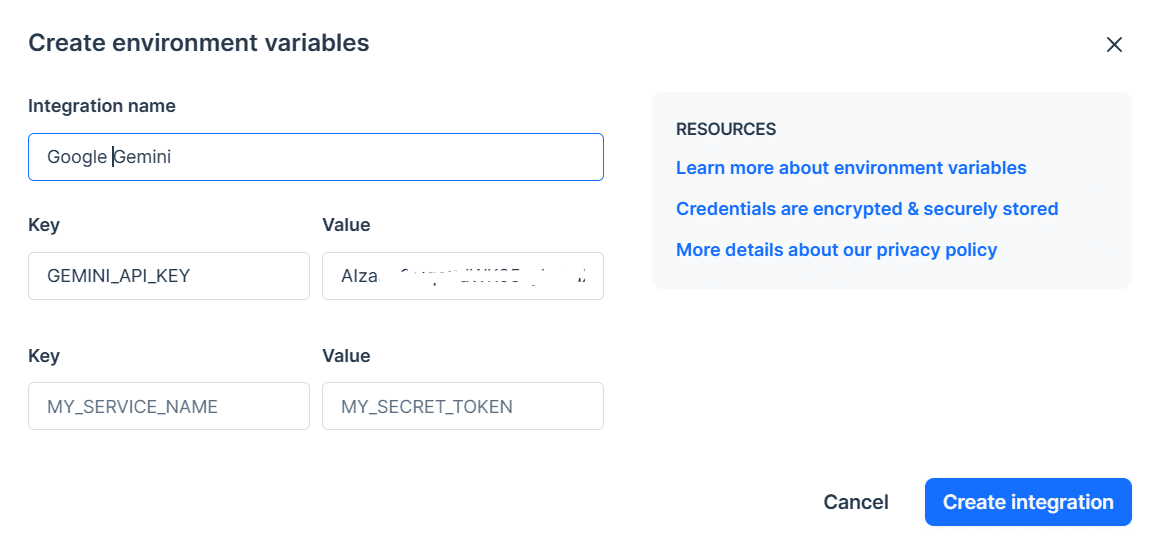

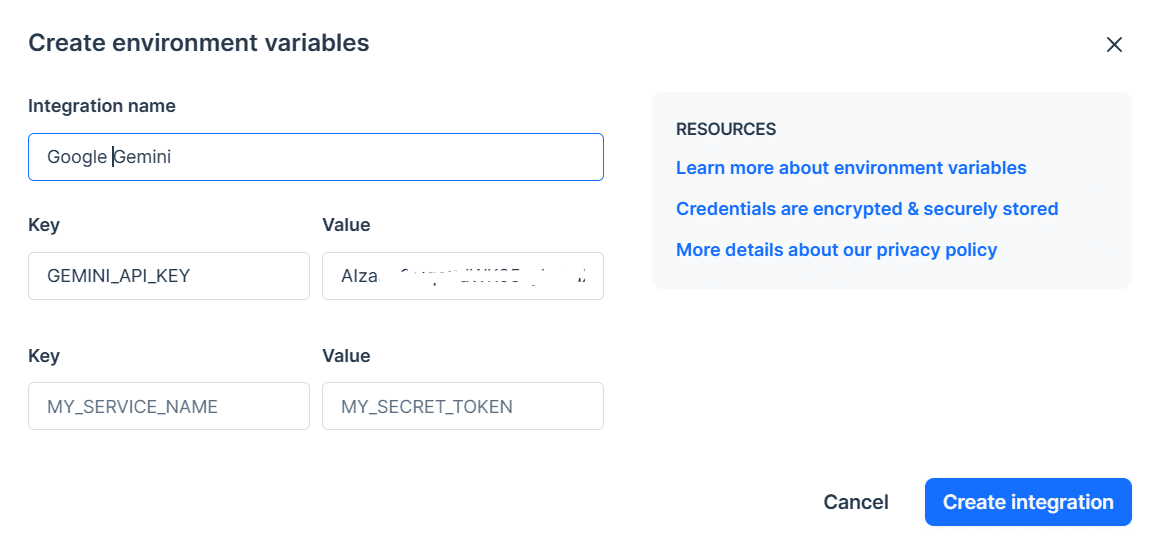

Skopiuj klucz API i ustaw go jako zmienną środowiskową. Używamy Deepnote i dość łatwo jest nam ustawić klucz o nazwie „GEMINI_API_KEY”. Wystarczy przejść do integracji, przewinąć w dół i wybrać zmienne środowiskowe.

W kolejnym kroku zainstalujemy API Pythona za pomocą PIP:

pip install -q -U google-generativeaiNastępnie ustawimy klucz API na GenAI Google i zainicjujemy instancję.

import google.generativeai as genai

import os

gemini_api_key = os.environ["GEMINI_API_KEY"]

genai.configure(api_key = gemini_api_key)Po skonfigurowaniu klucza API wykorzystanie modelu Gemini Pro do generowania treści jest proste. Podaj zachętę do funkcji `generate_content` i wyświetl wynik jako Markdown.

from IPython.display import Markdown

model = genai.GenerativeModel('gemini-pro')

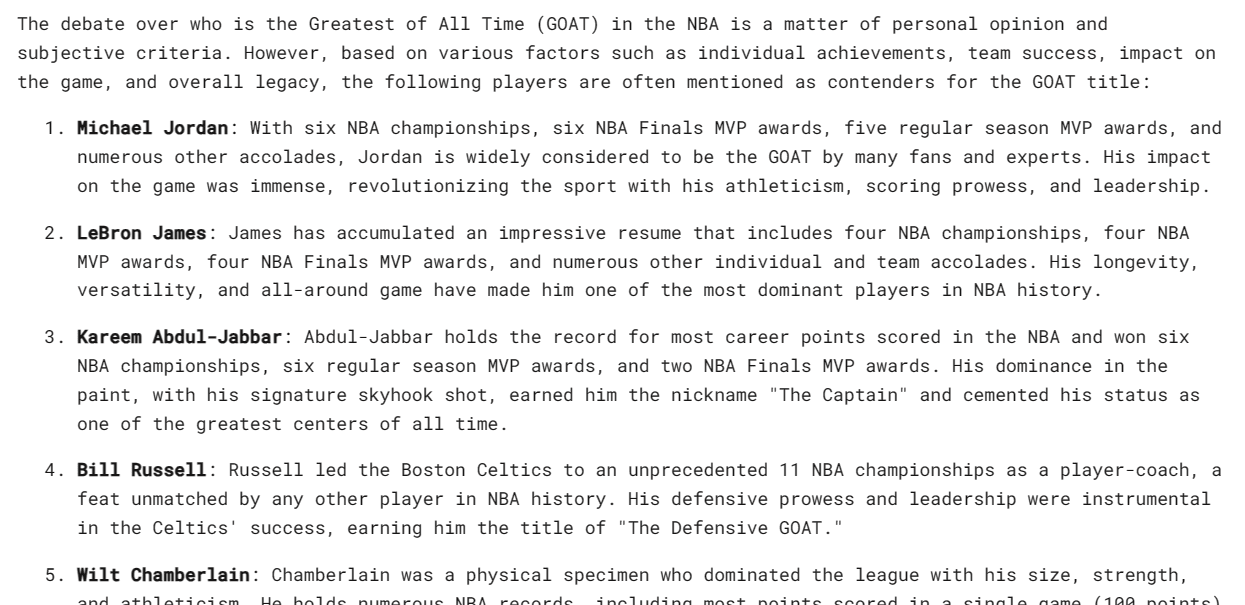

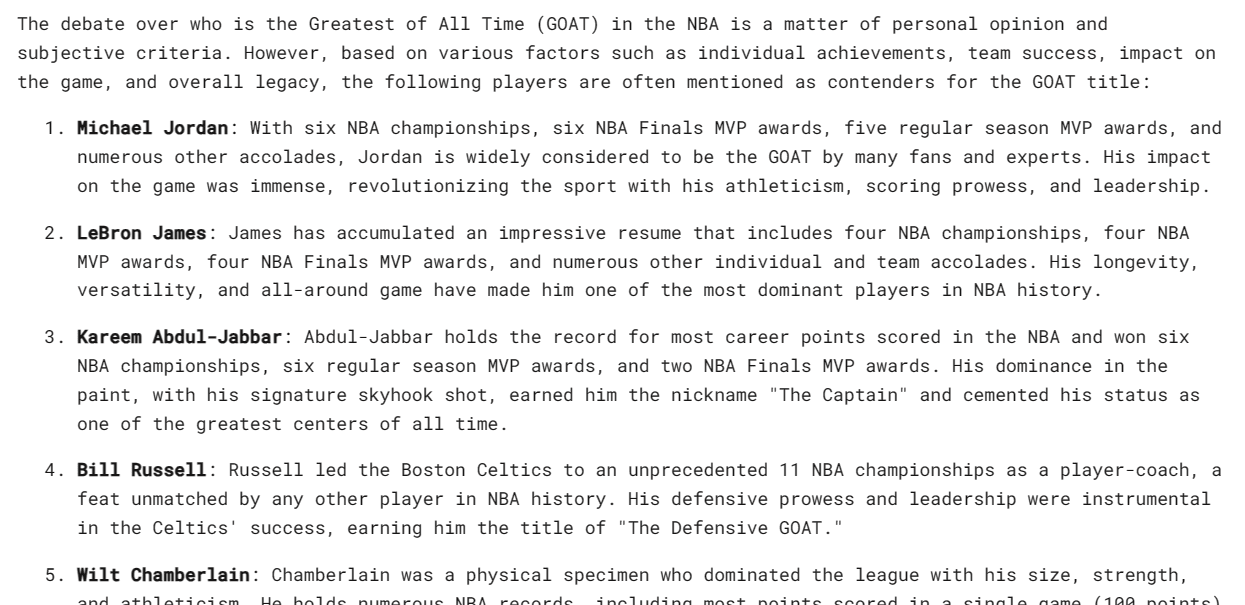

response = model.generate_content("Who is the GOAT in the NBA?")

Markdown(response.text)To niesamowite, ale nie zgadzam się z tą listą. Rozumiem jednak, że wszystko zależy od osobistych preferencji.

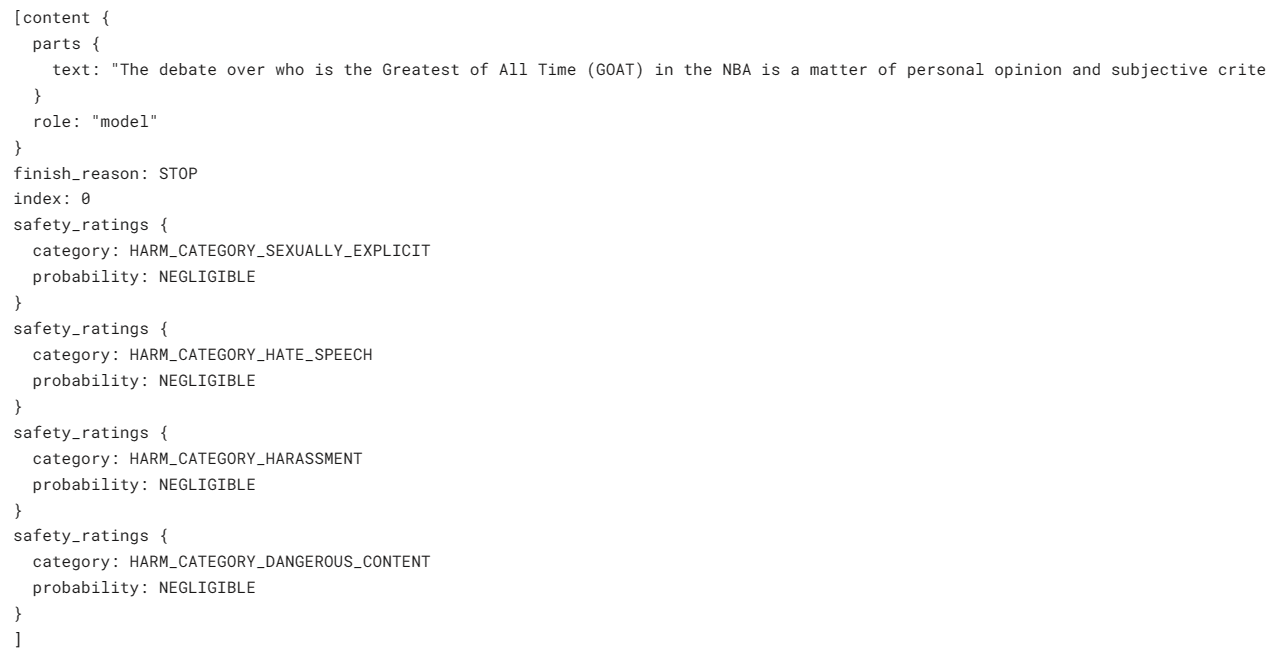

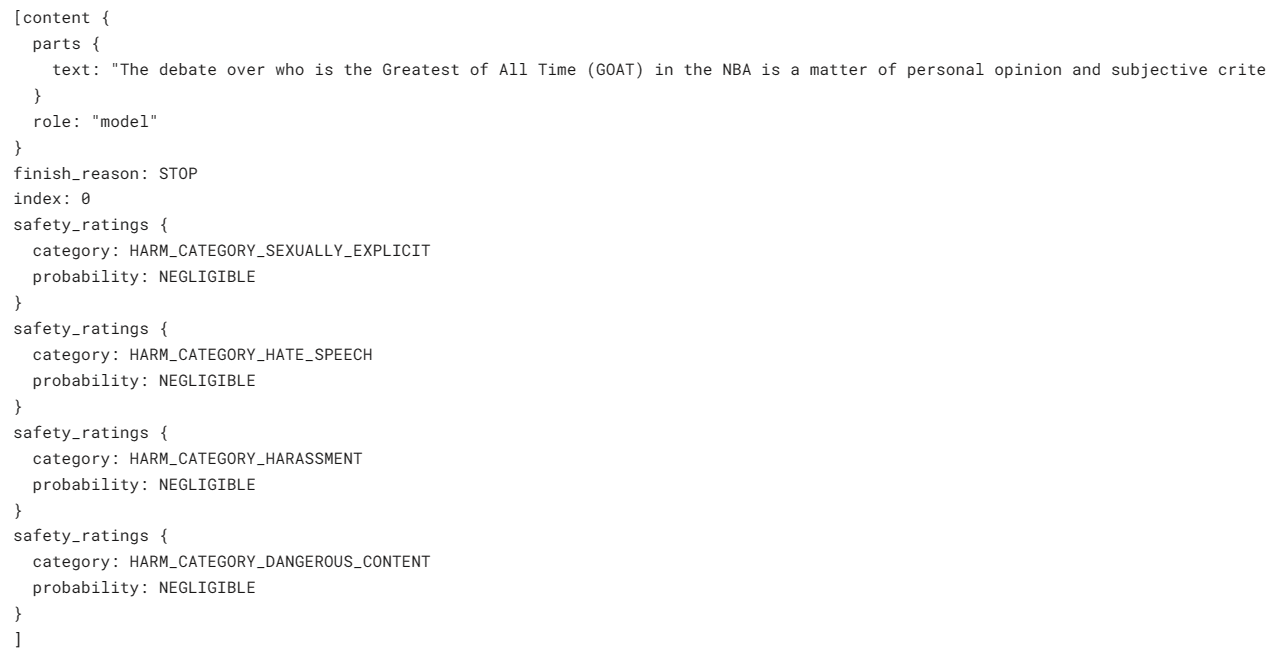

Gemini może generować wiele odpowiedzi, zwanych kandydatami, dla jednego monitu. Możesz wybrać najbardziej odpowiedni. W naszym przypadku mieliśmy tylko jedną odpowiedź.

response.candidates

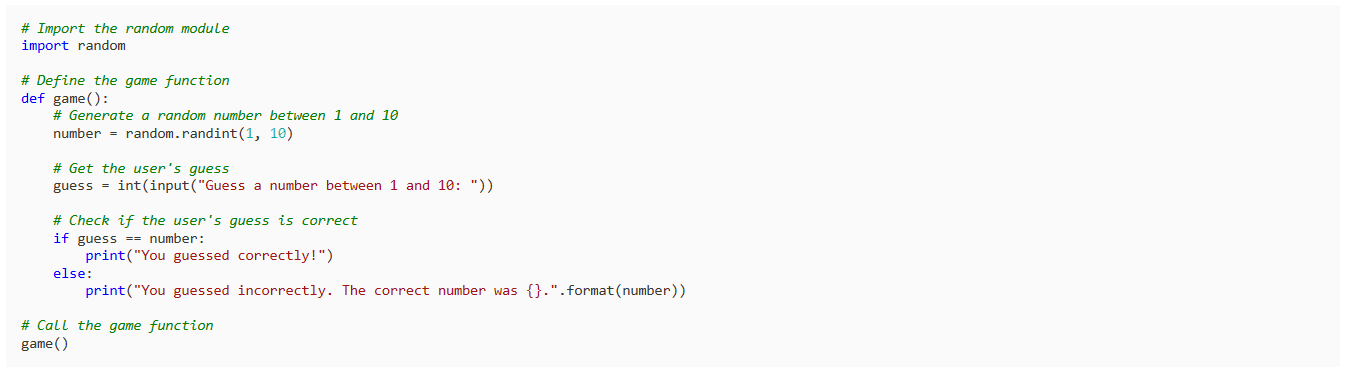

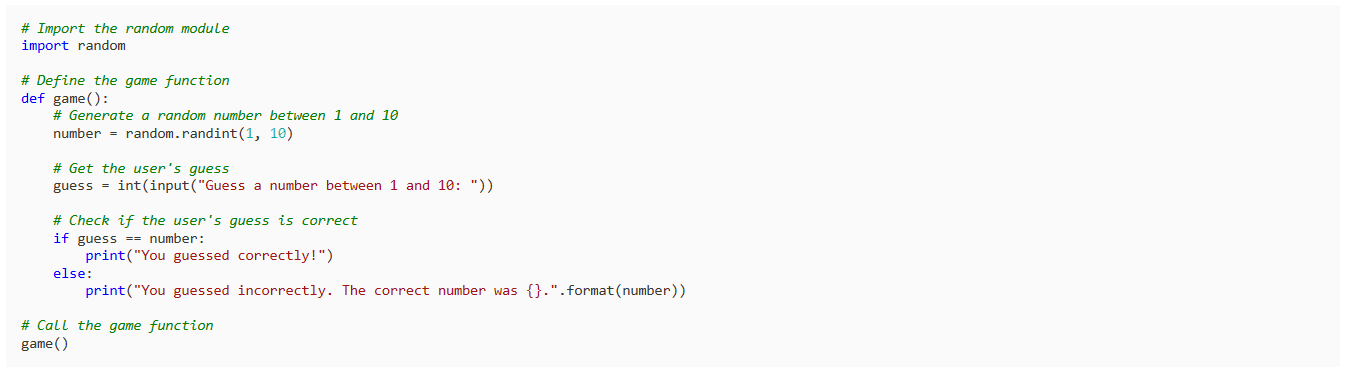

Poprośmy go o napisanie prostej gry w Pythonie.

response = model.generate_content("Build a simple game in Python")

Markdown(response.text)Wynik jest prosty i na temat. Większość LLM zaczyna wyjaśniać kod Pythona, zamiast go pisać.

Możesz dostosować swoją odpowiedź za pomocą argumentu `generacja_config`. Ograniczamy liczbę kandydatów do 1, dodajemy słowo stop „spacja” i ustawiamy maksymalne tokeny i temperaturę.

response = model.generate_content(

'Write a short story about aliens.',

generation_config=genai.types.GenerationConfig(

candidate_count=1,

stop_sequences=['space'],

max_output_tokens=200,

temperature=0.7)

)

Markdown(response.text)Jak widać, odpowiedź zatrzymała się przed słowem „spacja”. Niesamowity.

Możesz także użyć argumentu „strumień”, aby przesłać strumieniowo odpowiedź. Jest podobny do interfejsów API Anthropic i OpenAI, ale jest szybszy.

model = genai.GenerativeModel('gemini-pro')

response = model.generate_content("Write a Julia function for cleaning the data.", stream=True)

for chunk in response:

print(chunk.text)

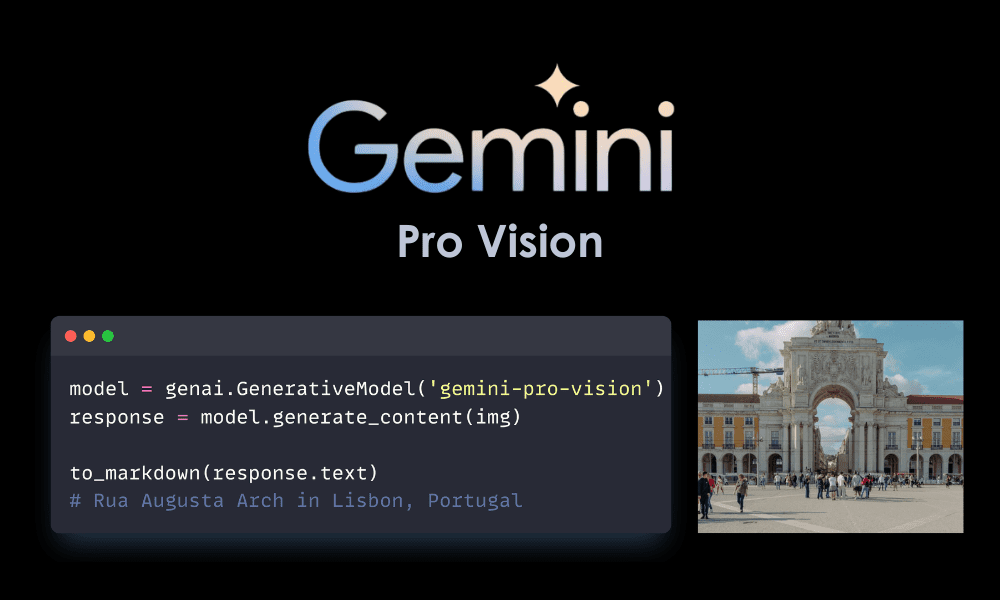

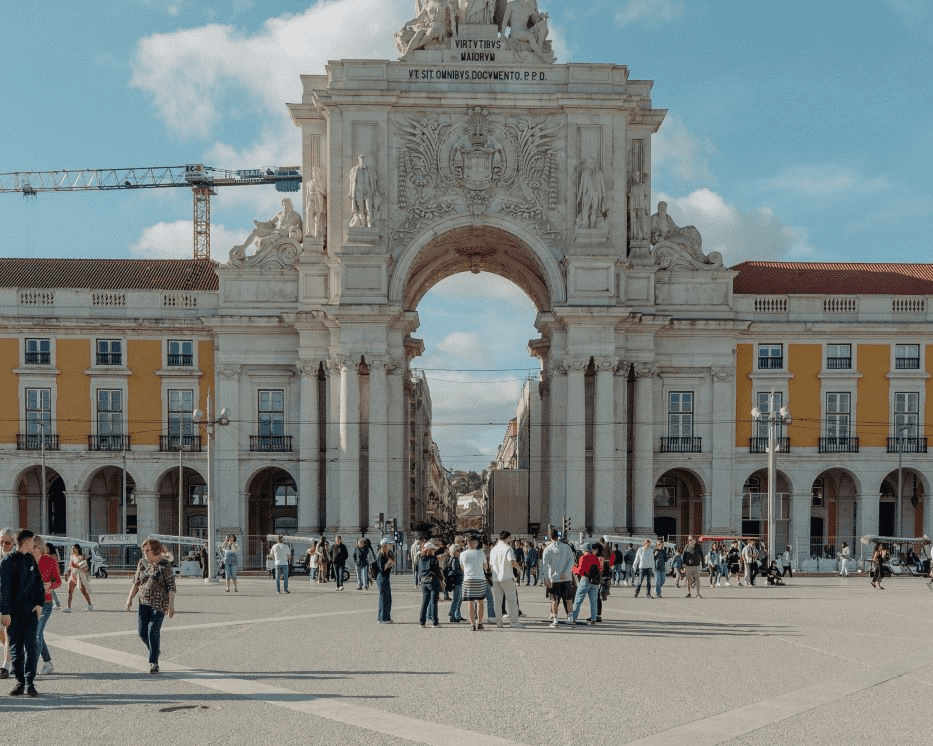

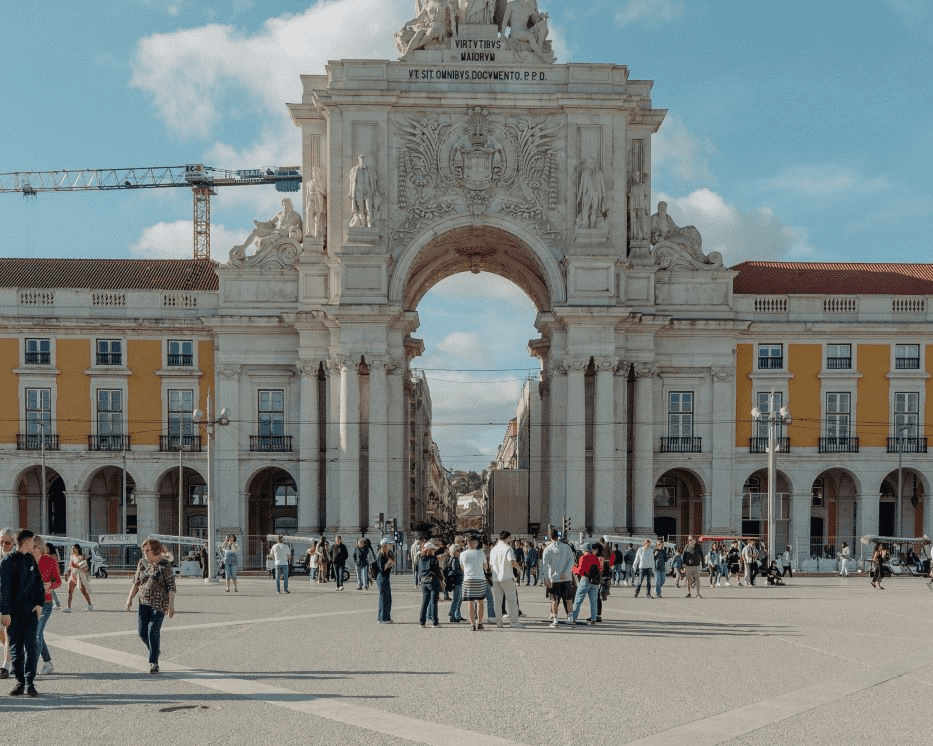

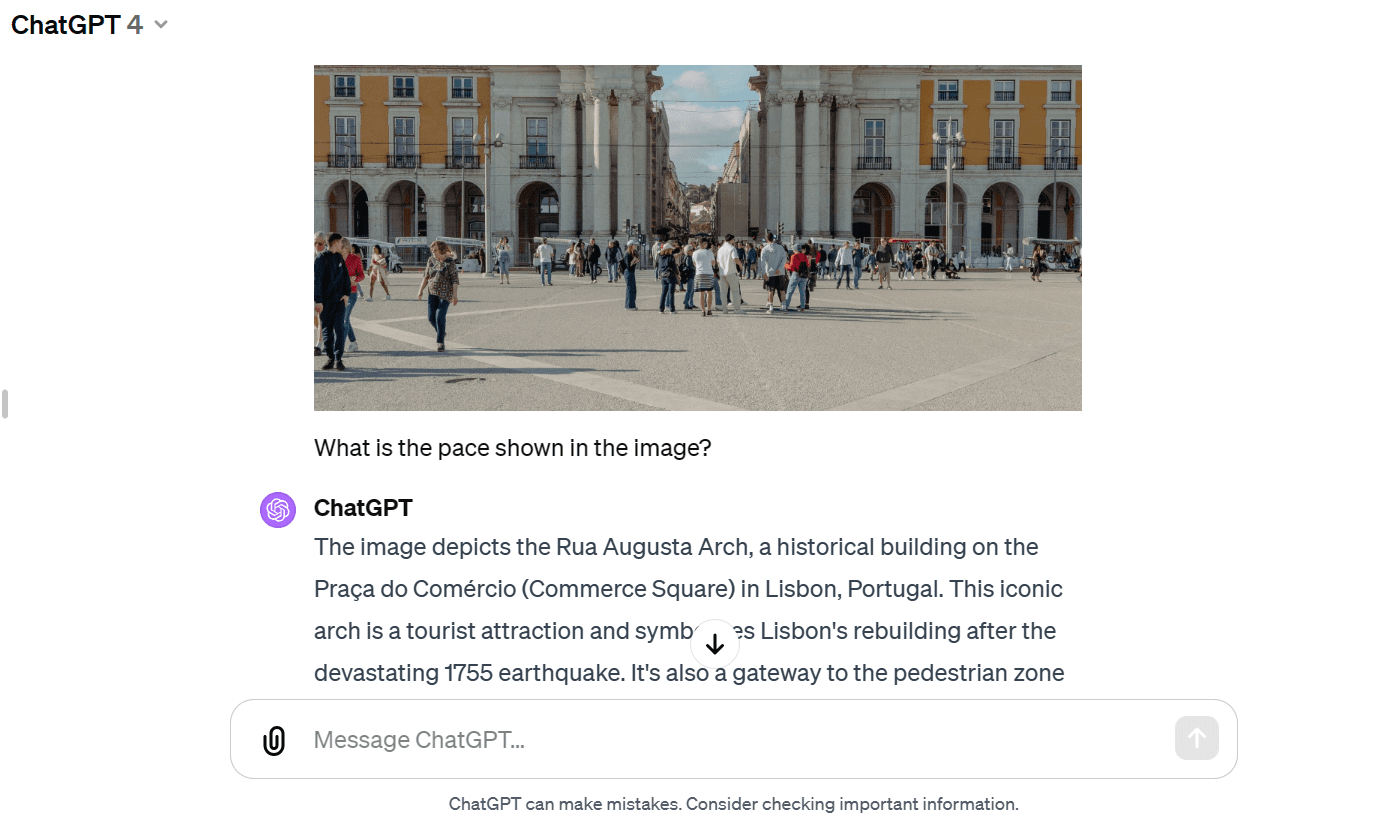

W tej sekcji będziemy ładować Masooda Aslamiego zdjęcie i użyj go, aby przetestować multimodalność Gemini Pro Vision.

Załaduj obrazy do `PIL` i wyświetl je.

import PIL.Image

img = PIL.Image.open('images/photo-1.jpg')

imgMamy wysokiej jakości zdjęcie Rua Augusta Arch.

Załadujmy model Gemini Pro Vision i zaopatrzmy go w obraz.

model = genai.GenerativeModel('gemini-pro-vision')

response = model.generate_content(img)

Markdown(response.text)Makieta dokładnie zidentyfikowała pałac i dostarczyła dodatkowych informacji na temat jego historii i architektury.

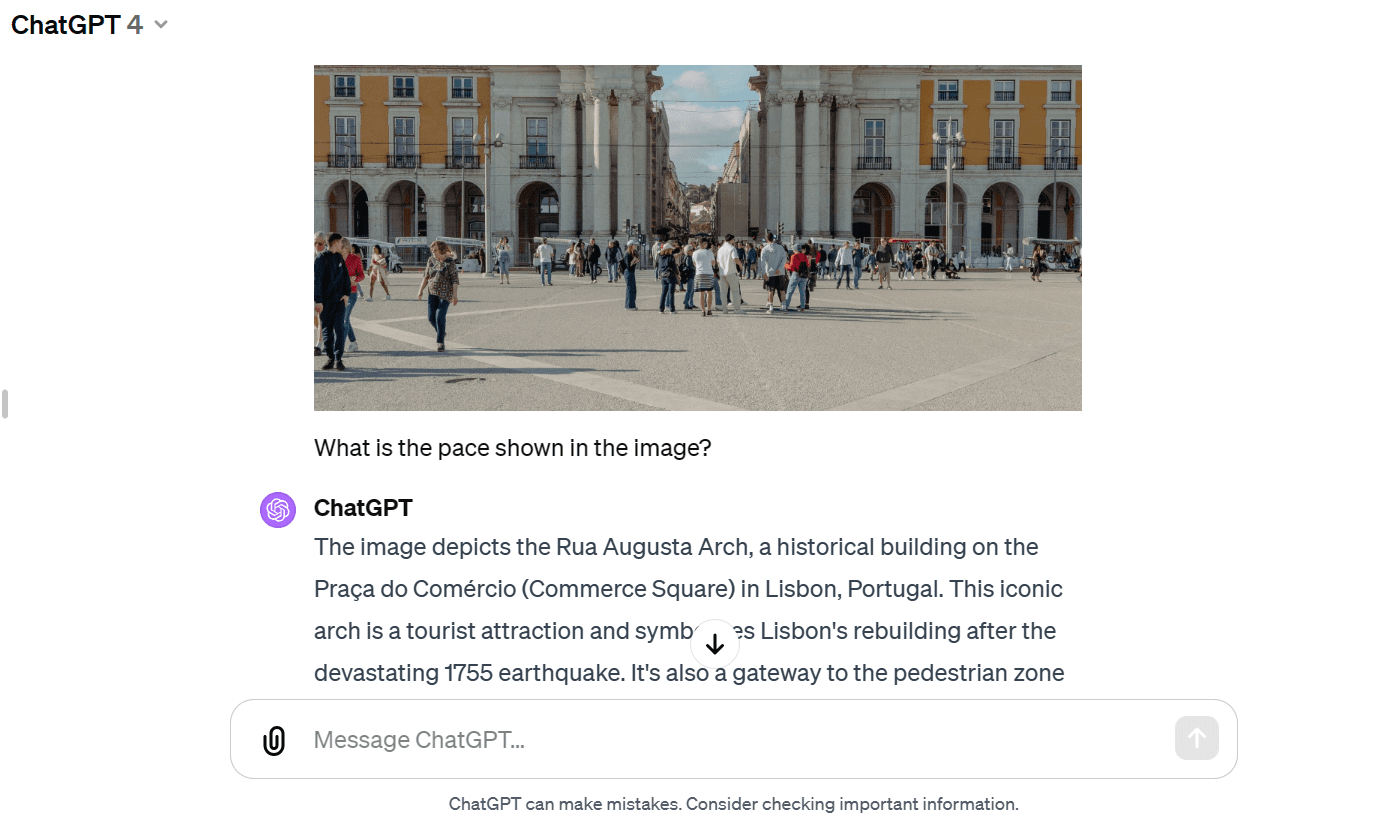

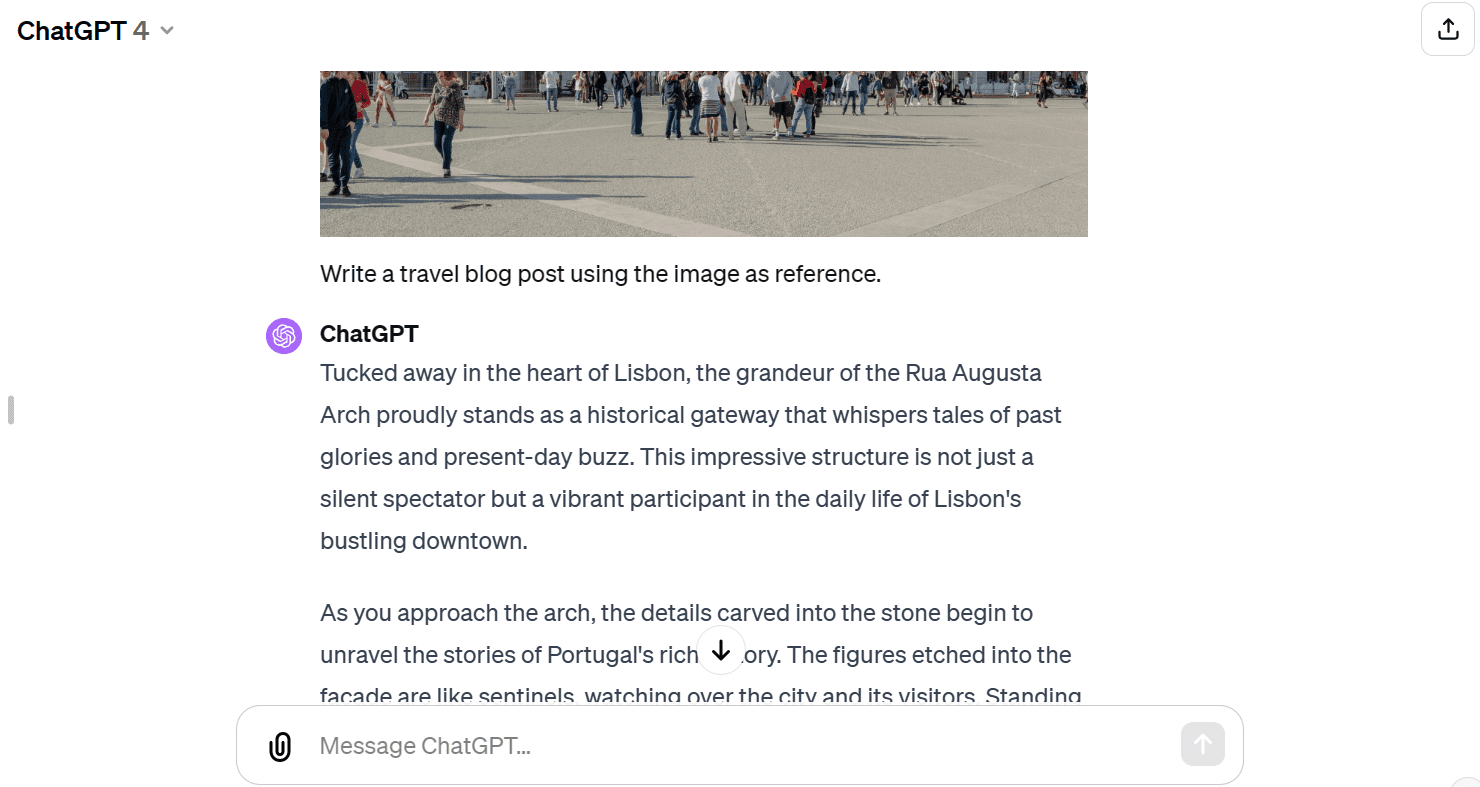

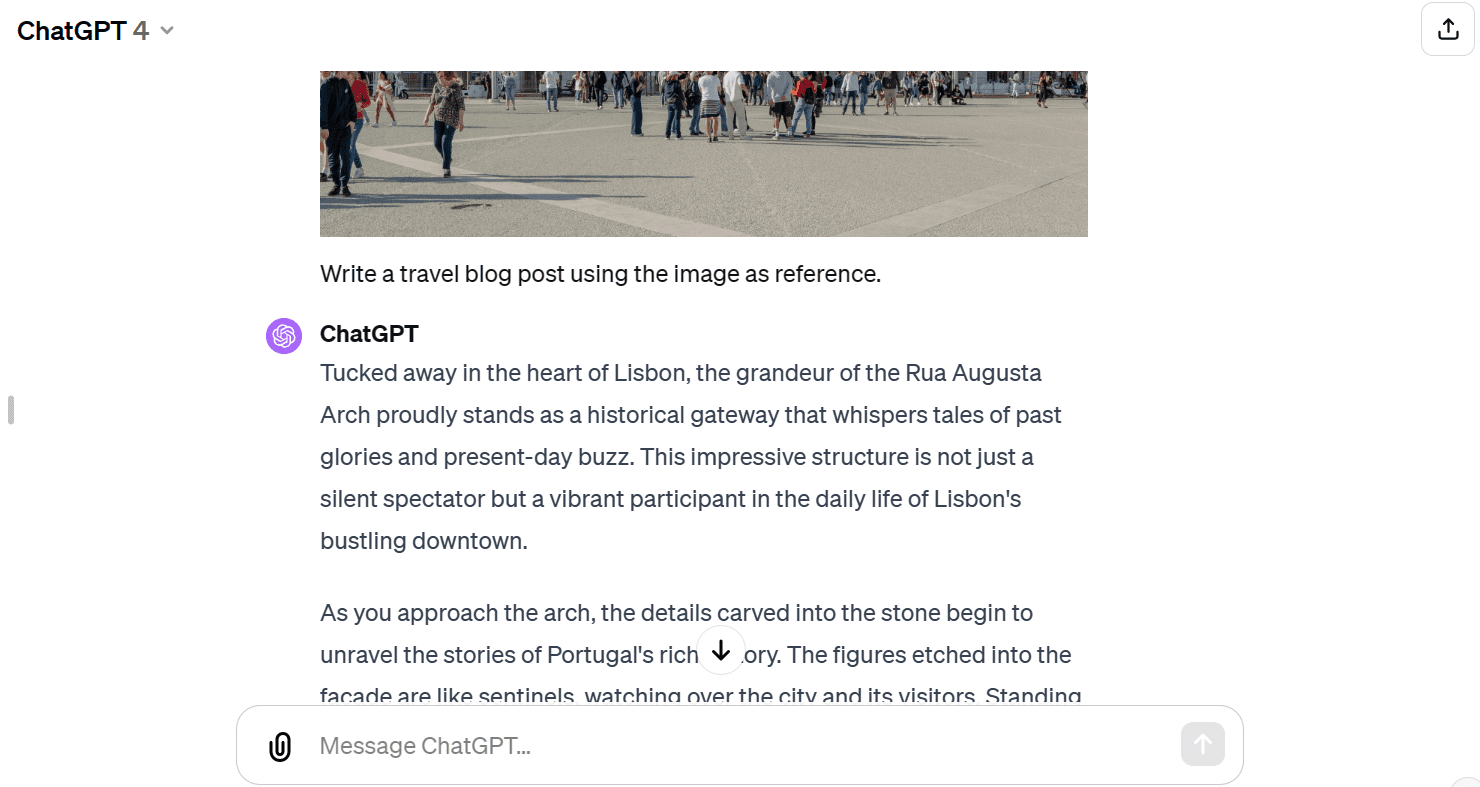

Dostarczmy ten sam obraz do GPT-4 i zapytajmy go o obraz. Obydwa modele dały niemal podobne odpowiedzi. Ale bardziej podoba mi się odpowiedź GPT-4.

Teraz udostępnimy tekst i obraz do interfejsu API. Poprosiliśmy modelkę wizji o napisanie bloga podróżniczego, wykorzystując obraz jako punkt odniesienia.

response = model.generate_content(["Write a travel blog post using the image as reference.", img])

Markdown(response.text)Dzięki niemu powstał krótki blog. Spodziewałem się dłuższego formatu.

W porównaniu do GPT-4, model Gemini Pro Vision miał trudności z wygenerowaniem bloga o długim formacie.

Możemy skonfigurować model tak, aby sesja czatu odbywała się tam i z powrotem. W ten sposób model zapamiętuje kontekst i reakcję na podstawie poprzednich rozmów.

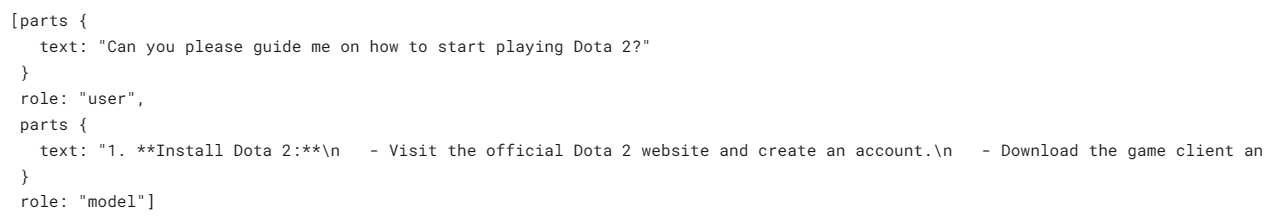

W naszym przypadku rozpoczęliśmy sesję czatu i poprosiliśmy modela o pomoc w rozpoczęciu gry Dota 2.

model = genai.GenerativeModel('gemini-pro')

chat = model.start_chat(history=[])

chat.send_message("Can you please guide me on how to start playing Dota 2?")

chat.historyJak widać obiekt `chat` zapisuje historię użytkownika i trybu czatu.

Możemy je również wyświetlić w stylu Markdown.

for message in chat.history:

display(Markdown(f'**{message.role}**: {message.parts[0].text}'))

Zadajmy pytanie uzupełniające.

chat.send_message("Which Dota 2 heroes should I start with?")

for message in chat.history:

display(Markdown(f'**{message.role}**: {message.parts[0].text}'))Możemy przewinąć w dół i zobaczyć całą sesję z modelką.

Modele osadzania stają się coraz bardziej popularne w aplikacjach kontekstowych. Model Gemini embedding-001 umożliwia reprezentowanie słów, zdań lub całych dokumentów w postaci gęstych wektorów kodujących znaczenie semantyczne. Ta reprezentacja wektorowa umożliwia łatwe porównanie podobieństwa między różnymi fragmentami tekstu poprzez porównanie odpowiadających im wektorów osadzania.

Możemy dostarczyć treść do `embed_content` i przekonwertować tekst na osadzanie. To takie proste.

output = genai.embed_content(

model="models/embedding-001",

content="Can you please guide me on how to start playing Dota 2?",

task_type="retrieval_document",

title="Embedding of Dota 2 question")

print(output['embedding'][0:10])[0.060604308, -0.023885584, -0.007826327, -0.070592545, 0.021225851, 0.043229062, 0.06876691, 0.049298503, 0.039964676, 0.08291664]Możemy przekonwertować wiele fragmentów tekstu na elementy osadzone, przekazując listę ciągów znaków do argumentu „treść”.

output = genai.embed_content(

model="models/embedding-001",

content=[

"Can you please guide me on how to start playing Dota 2?",

"Which Dota 2 heroes should I start with?",

],

task_type="retrieval_document",

title="Embedding of Dota 2 question")

for emb in output['embedding']:

print(emb[:10])[0.060604308, -0.023885584, -0.007826327, -0.070592545, 0.021225851, 0.043229062, 0.06876691, 0.049298503, 0.039964676, 0.08291664]

[0.04775657, -0.044990525, -0.014886052, -0.08473655, 0.04060122, 0.035374347, 0.031866882, 0.071754575, 0.042207796, 0.04577447]Jeśli masz problemy z odtworzeniem tego samego wyniku, sprawdź mój Obszar roboczy Deepnote.

Jest tak wiele zaawansowanych funkcji, że nie omówiliśmy w tym samouczku wprowadzającym. Możesz dowiedzieć się więcej o Gemini API wchodząc na stronę Gemini API: Szybki start z Pythonem.

W tym samouczku dowiedzieliśmy się o Gemini i o tym, jak uzyskać dostęp do API Pythona w celu wygenerowania odpowiedzi. W szczególności dowiedzieliśmy się o generowaniu tekstu, rozumieniu wizualnym, przesyłaniu strumieniowym, historii rozmów, niestandardowych wynikach i osadzaniu. Jednak to tylko zarys możliwości Gemini.

Podziel się ze mną tym, co zbudowałeś, korzystając z darmowego API Gemini. Możliwości są nieograniczone.

Abid Ali Awan (@ 1abidaliawan) jest certyfikowanym specjalistą ds. analityków danych, który uwielbia tworzyć modele uczenia maszynowego. Obecnie koncentruje się na tworzeniu treści i pisaniu blogów technicznych na temat technologii uczenia maszynowego i data science. Abid posiada tytuł magistra zarządzania technologią oraz tytuł licencjata inżynierii telekomunikacyjnej. Jego wizją jest zbudowanie produktu AI z wykorzystaniem grafowej sieci neuronowej dla studentów zmagających się z chorobami psychicznymi.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- Źródło: https://www.kdnuggets.com/how-to-access-and-use-gemini-api-for-free?utm_source=rss&utm_medium=rss&utm_campaign=how-to-access-and-use-gemini-api-for-free

- :ma

- :Jest

- $W GÓRĘ

- 1

- 10

- 12

- 13

- 14

- 17

- 27

- 7

- 8

- 9

- a

- O nas

- dostęp

- dokładnie

- w poprzek

- dodanie

- Dodatkowy

- Dodatkowe informacje

- zaawansowany

- ponownie

- AI

- obcy

- Wszystkie kategorie

- pozwala

- prawie

- również

- zdumiewający

- an

- i

- odpowiedzi

- Antropiczny

- api

- Pszczoła

- aplikacje

- architektura

- SĄ

- argument

- AS

- zapytać

- At

- audio

- zrównoważony

- BE

- staje

- być

- zanim

- Benchmark

- pomiędzy

- Blog

- blogi

- obie

- budować

- Budowanie

- wybudowany

- biznes

- ale

- przycisk

- by

- nazywa

- CAN

- kandydat

- kandydatów

- możliwości

- zdolny

- walizka

- Etui

- Centra

- Dyplomowani

- pogawędzić

- ZOBACZ

- Sprzątanie

- kliknij

- kod

- współpraca

- porównać

- porównanie

- kompleks

- zawartość

- Tworzenie treści

- kontekst

- Rozmowa

- rozmowy

- konwertować

- Odpowiedni

- pokrywa

- tworzenie

- Obecnie

- zwyczaj

- dostosować

- dane

- centra danych

- nauka danych

- naukowiec danych

- Data

- DeepMind

- Stopień

- gęsty

- zaprojektowany

- rozwinięty

- deweloperzy

- urządzenia

- nie zrobił

- różne

- Wyświetlacz

- inny

- do

- dokumenty

- darowizna

- Dota

- Dota 2

- na dół

- z łatwością

- łatwo

- wydajny

- skutecznie

- osadzanie

- Inżynieria

- Cały

- Środowisko

- Eter (ETH)

- oczekując

- eksperci

- Wyjaśniać

- odkryj

- szybciej

- i terminów, a

- elastyczne

- skupienie

- obserwuj

- W razie zamówieenia projektu

- format

- Darmowy

- od

- funkcjonować

- Funkcje

- gra

- Gemini

- Generować

- generacja

- otrzymać

- gif

- Go

- będzie

- dobry

- Google'a

- wykres

- Wykres sieci neuronowej

- poprowadzi

- miał

- Have

- mający

- he

- pomoc

- tutaj

- Heroes

- Wysoki

- wysoko

- jego

- historia

- posiada

- W jaki sposób

- How To

- Jednak

- HTTPS

- człowiek

- i

- zidentyfikowane

- choroba

- obraz

- zdjęcia

- importować

- in

- Włącznie z

- coraz bardziej

- Informacja

- zainicjować

- zainstalować

- przykład

- zamiast

- integracja

- najnowszych

- wprowadzający

- IT

- JEGO

- jpg

- julia

- właśnie

- Knuggety

- Klawisz

- wiedza

- język

- największym

- UCZYĆ SIĘ

- dowiedziałem

- nauka

- lubić

- bezgraniczny

- Lista

- załadować

- dłużej

- kocha

- maszyna

- uczenie maszynowe

- WYKONUJE

- i konserwacjami

- wiele

- masywny

- mistrz

- max

- me

- znaczenie

- znaczy

- psychika

- Choroba umysłowa

- Metryka

- Aplikacje mobilne

- urządzenia mobilne

- Moda

- model

- modele

- jeszcze

- większość

- wielokrotność

- Nazwa

- nano

- NBA

- sieć

- Nerwowy

- sieci neuronowe

- Nowości

- Następny

- już dziś

- przedmiot

- of

- on

- ONE

- tylko

- OpenAI

- działać

- or

- OS

- ludzkiej,

- na zewnątrz

- Przewyższają

- wydajność

- Pałac

- szczególny

- Przechodzący

- doskonały

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- wykonywania

- osobisty

- sztuk

- plato

- Analiza danych Platona

- PlatoDane

- gra

- Proszę

- punkt

- Popularny

- możliwości

- możliwy

- Post

- potencjał

- poprzedni

- Pro

- Problem

- rozwiązanie problemu

- Produkt

- profesjonalny

- zapewniać

- pod warunkiem,

- że

- Python

- jakość

- zapytania

- pytanie

- całkiem

- zasięg

- RE

- odniesienie

- reprezentacja

- reprezentowane

- Badania naukowe

- odpowiedź

- Odpowiedzi

- dalsze

- zrewolucjonizować

- s

- taki sam

- oszczędność

- Skalowalność

- Skala

- skala ai

- nauka

- Naukowiec

- przewijać

- Sekcja

- widzieć

- wybierać

- Sesja

- zestaw

- ustawienie

- kilka

- Share

- Short

- powinien

- podobny

- Prosty

- pojedynczy

- So

- Rozwiązywanie

- Typ przestrzeni

- swoiście

- początek

- rozpoczęty

- state-of-the-art

- Ewolucja krok po kroku

- Stop

- zatrzymany

- Historia

- strumień

- Streaming

- Walka

- Studenci

- styl

- odpowiedni

- Powierzchnia

- systemy

- T

- zadania

- Zespoły

- Techniczny

- Technologies

- Technologia

- telekomunikacja

- test

- Testy

- XNUMX

- generowanie tekstu

- że

- Połączenia

- ich

- Im

- następnie

- to

- trzy

- Przez

- do

- Żetony

- podróżować

- kłopot

- Tutorial

- typy

- Ultra

- zrozumieć

- zrozumienie

- us

- nadający się do użytku

- posługiwać się

- Użytkownik

- za pomocą

- zmienna

- różnorodny

- Wideo

- wizja

- wizualny

- była

- Droga..

- we

- Co

- który

- KIM

- szeroki

- Szeroki zasięg

- będzie

- w

- słowo

- słowa

- Praca

- świat

- napisać

- pisanie

- ty

- Twój

- zefirnet