Szybkość przepustowości pamięci i niskie opóźnienia mają kluczowe znaczenie, gdy wnioskowanie przenosi się z centrum danych na brzeg sieci.

AI/ML rozwija się w błyskawicznym tempie. Nie ma tygodnia bez nowych i ekscytujących osiągnięć w tej dziedzinie, a aplikacje takie jak ChatGPT sprawiły, że możliwości generatywnej sztucznej inteligencji znalazły się na pierwszym planie w centrum uwagi opinii publicznej.

AI/ML to tak naprawdę dwa zastosowania: szkolenie i wnioskowanie. Każdy z nich opiera się na wydajności pamięci i każdy ma unikalny zestaw wymagań, które decydują o wyborze najlepszego rozwiązania pamięci.

W przypadku szkoleń przepustowość i pojemność pamięci są wymaganiami krytycznymi. Jest to szczególnie istotne, biorąc pod uwagę rozmiar i złożoność modeli danych sieci neuronowych, które rosną w tempie 10-krotnym rocznie. Dokładność sieci neuronowej zależy od jakości i ilości przykładów w zbiorze danych uczących, co przekłada się na zapotrzebowanie na ogromne ilości danych, a co za tym idzie, przepustowość i pojemność pamięci.

Biorąc pod uwagę wartość stworzoną dzięki szkoleniu, istnieje potężna zachęta do jak najszybszego ukończenia serii treningowych. Ponieważ aplikacje szkoleniowe działają w centrach danych z coraz większymi ograniczeniami pod względem mocy i przestrzeni, preferowane są rozwiązania zapewniające efektywność energetyczną i mniejsze rozmiary. Biorąc pod uwagę wszystkie te wymagania, HBM3 jest idealnym rozwiązaniem pamięci dla sprzętu szkoleniowego AI. Zapewnia doskonałe możliwości w zakresie przepustowości i pojemności.

Wynikiem uczenia sieci neuronowej jest model wnioskowania, który można zastosować w szerokim zakresie. Dzięki temu modelowi urządzenie wnioskowujące może przetwarzać i interpretować dane wejściowe poza granicami danych szkoleniowych. Podsumowując, szybkość przepustowości pamięci i małe opóźnienia są krytyczne, szczególnie gdy potrzebne jest działanie w czasie rzeczywistym. W miarę przenoszenia coraz większej liczby wniosków AI z serca centrum danych na brzeg sieci te funkcje pamięci stają się jeszcze bardziej krytyczne.

Projektanci mają do wyboru wiele rodzajów pamięci do wnioskowania AI/ML, ale jeśli chodzi o krytyczny parametr przepustowości, pamięć GDDR6 naprawdę wyróżnia się. Przy szybkości transmisji danych 24 gigabitów na sekundę (Gb/s) i 32-bitowym interfejsie urządzenie GDDR6 może zapewnić przepustowość pamięci 96 gigabajtów na sekundę (GB/s), czyli ponad dwukrotnie więcej niż jakakolwiek alternatywna pamięć DDR lub Rozwiązania LPDDR. Pamięć GDDR6 oferuje doskonałe połączenie szybkości, przepustowości i wydajności w zakresie opóźnień w przypadku wnioskowania AI/ML, w szczególności wnioskowania na krawędzi.

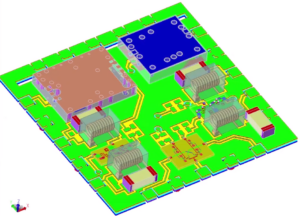

Podsystem interfejsu pamięci Rambus GDDR6 oferuje wydajność 24 Gb/s i jest zbudowany na fundamencie ponad 30-letniego doświadczenia w zakresie integralności sygnału i mocy (SI/PI) o dużej prędkości, co ma kluczowe znaczenie dla obsługi GDDR6 przy dużych prędkościach. Składa się z PHY i kontrolera cyfrowego – zapewniając kompletny podsystem interfejsu pamięci GDDR6.

Dołącz do mnie na seminarium internetowym Rambus w tym miesiącu na temat „Wysokowydajne wnioskowanie AI/ML z pamięcią 24G GDDR6”, aby odkryć, w jaki sposób pamięć GDDR6 spełnia wymagania dotyczące pamięci i wydajności obciążeń wnioskowania AI/ML oraz poznać niektóre kluczowe kwestie związane z projektowaniem i wdrażaniem podsystemów interfejsu pamięci GDDR6.

Zasoby:

Franka Ferro

(wszystkie posty)

Frank Ferro jest starszym dyrektorem ds. marketingu produktów rdzeni IP w firmie Rambus.

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoAiStream. Analiza danych Web3. Wiedza wzmocniona. Dostęp tutaj.

- Wybijanie przyszłości w Adryenn Ashley. Dostęp tutaj.

- Kupuj i sprzedawaj akcje spółek PRE-IPO z PREIPO®. Dostęp tutaj.

- Źródło: https://semiengineering.com/gddr6-delivers-the-performance-for-ai-ml-inference/

- :ma

- :Jest

- :nie

- 24

- 26

- 27

- 30

- 8

- a

- O nas

- precyzja

- Działania

- AI

- Trening AI

- AI / ML

- Wszystkie kategorie

- Wszystkie Posty

- alternatywny

- kwoty

- an

- i

- każdy

- aplikacje

- SĄ

- AS

- At

- Uwaga

- przepustowość

- BE

- staje

- być

- BEST

- szeroko

- przyniósł

- wybudowany

- ale

- by

- CAN

- możliwości

- Pojemność

- Centrum

- Centra

- ChatGPT

- wybór

- wybory

- połączenie

- kompletny

- kompleksowość

- Rozważania

- kontroler

- stworzony

- krytyczny

- dane

- Centrum danych

- centra danych

- zbiór danych

- dostarczyć

- dostarcza

- zależy

- wdrażane

- Wnętrze

- wydarzenia

- urządzenie

- cyfrowy

- Dyrektor

- odkryj

- Podwójna

- napęd

- każdy

- krawędź

- efektywność

- ogromny

- szczególnie

- Parzyste

- ewoluuje

- przykłady

- doskonała

- ekscytujący

- ekspertyza

- Korzyści

- pole

- mocno

- W razie zamówieenia projektu

- czoło

- Fundacja

- od

- generatywny

- generatywna sztuczna inteligencja

- dany

- Goes

- wspaniały

- Rozwój

- sprzęt komputerowy

- Have

- Serce

- stąd

- Wysoki

- W jaki sposób

- HTTPS

- idealny

- realizacja

- in

- Motywacja

- coraz bardziej

- Wejścia

- integralność

- Interfejs

- najnowszych

- IP

- IT

- jpg

- Klawisz

- Utajenie

- UCZYĆ SIĘ

- błyskawica

- lubić

- niski

- Marketing

- Pamięć

- model

- modele

- Miesiąc

- jeszcze

- potrzebne

- potrzeba

- sieć

- Dane sieciowe

- Nerwowy

- sieci neuronowe

- Nowości

- już dziś

- numer

- of

- oferta

- Oferty

- on

- operacyjny

- or

- wydajność

- zewnętrzne

- koniec

- Pokój

- parametr

- szczególny

- szczególnie

- jest gwarancją najlepszej jakości, które mogą dostarczyć Ci Twoje monitory,

- plato

- Analiza danych Platona

- PlatoDane

- popularność

- możliwy

- Wiadomości

- power

- mocny

- wygląda tak

- Produkt

- zapewnia

- że

- publiczny

- jakość

- ilość

- szybko

- Kurs

- w czasie rzeczywistym

- naprawdę

- wymagania

- prawo

- RZĄD

- run

- druga

- senior

- zestaw

- PRZESUNIĘCIE

- Przesunięcia

- Signal

- Rozmiar

- mniejszy

- So

- rozwiązanie

- Rozwiązania

- kilka

- Typ przestrzeni

- prędkość

- prędkości

- podpory

- niż

- że

- Połączenia

- Tam.

- Te

- to

- Przez

- wydajność

- miniatur

- do

- Trening

- drugiej

- wyjątkowy

- wartość

- Webinar

- tydzień

- jeśli chodzi o komunikację i motywację

- który

- szeroki

- w

- bez

- rok

- lat

- zefirnet