Kilka czołowych światowych organizacji zajmujących się wiadomościami i wydawnictwami, w tym Agence France-Presse (AFP), European Pressphoto Agency, Getty Images i inne, podpisana list otwarty skierowany do decydentów i liderów branży. Wzywają do ustanowienia ram regulacyjnych dla generatywnych modeli sztucznej inteligencji w celu zachowania zaufania publicznego do mediów i ochrony integralności treści.

Pismo zatytułowane „ZACHOWANIE ZAUFANIA PUBLICZNEGO DO MEDIÓW POPRZEZ UJEDNOLICONE PRZEPISY I PRAKTYKI DOTYCZĄCE SI” określa szczegółowe zasady odpowiedzialnego rozwoju modeli sztucznej inteligencji i budzi obawy dotyczące potencjalnego ryzyka, jeśli odpowiednie przepisy nie zostaną szybko wdrożone.

Proponowany Regulamin

Wśród proponowanych zasad regulacji list podkreśla:

Przejrzystość: Ujawnianie zestawów treningowych wykorzystywanych do tworzenia generatywnych modeli sztucznej inteligencji, umożliwiających kontrolę potencjalnych błędów lub dezinformacji.

Ochrona własności intelektualnej: Ochrona praw twórców treści, których praca jest często wykorzystywana bez wynagrodzenia w szkoleniu modeli AI.

Negocjacje zbiorowe: Umożliwienie firmom medialnym zbiorowych negocjacji z twórcami modeli AI w sprawie korzystania z zastrzeżonej własności intelektualnej.

Identyfikacja treści generowanych przez sztuczną inteligencję: Nakaz jasnego, konkretnego i spójnego oznaczania wyników i interakcji generowanych przez sztuczną inteligencję.

Kontrola dezinformacji: wdrażanie środków ograniczających stronniczość, dezinformację i nadużycia usług AI.

Obawy i zagrożenia

List wyszczególnia potencjalne zagrożenia, jeśli przepisy nie zostaną niezwłocznie wprowadzone. Należą do nich erozja zaufania publicznego do mediów, naruszenia praw własności intelektualnej oraz podważanie tradycyjnych modeli biznesowych mediów.

Generatywne modele sztucznej inteligencji są w stanie wytwarzać i rozpowszechniać syntetyczne treści na niespotykaną dotąd skalę, co potencjalnie prowadzi do zniekształcania faktów i propagowania uprzedzeń. Ponadto list podkreśla wpływ finansowy na firmy medialne, które mogą widzieć, że ich treści są rozpowszechniane bez uznania autorstwa lub wynagrodzenia, co zagraża trwałości branży.

Wezwanie do ustanowienia globalnych standardów

Sygnatariusze nie tylko dążą do natychmiastowych działań regulacyjnych i branżowych, ale także wyrażają poparcie dla spójnych światowych standardów mających zastosowanie do rozwoju i wdrażania sztucznej inteligencji. Uznając potencjalne korzyści technologii generatywnej sztucznej inteligencji, list podkreśla konieczność odpowiedzialnego rozwoju w celu ochrony wartości demokratycznych i różnorodności mediów.

Chociaż list pochwala pewne wysiłki podjęte w społeczności AI i różnych rządach w celu rozwiązania tych problemów, istnieje zbiorowe wezwanie do dalszego dialogu i postępów w zakresie przepisów. Sygnatariusze wyrażają chęć bycia częścią rozwiązania, zapewniając dalszy rozwój aplikacji AI przy jednoczesnym poszanowaniu praw firm medialnych i indywidualnych dziennikarzy.

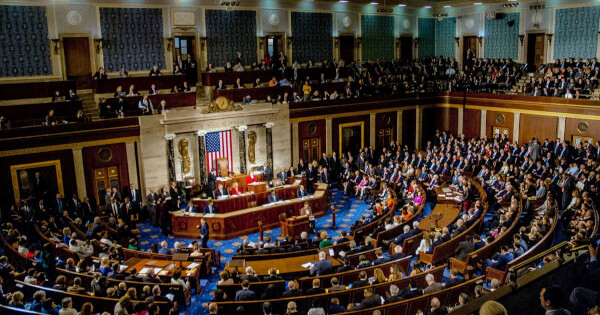

Ostatnie inicjatywy rządu USA w zakresie regulacji AI

Globalne obawy dotyczące regulacji AI, obejmujące prywatność, bezpieczeństwo, prawa autorskie i nadużycia, spotkały się z niedawnymi inicjatywami organów rządowych USA.

13 lipca 2023 r. amerykańska Federalna Komisja Handlu (FTC) rozpoczęła gruntowną analizę ZOBACZ do ChatGPT w związku z obawami dotyczącymi ochrony konsumentów. OpenAI, firma stojąca za ChatGPT, otrzymała 20-stronicowe żądanie od FTC, która w szczególności bada, czy postępowanie OpenAI z modelami AI było niesprawiedliwe lub wprowadzające w błąd, co może szkodzić reputacji ludzi.

W dniu 26 lipca 2023 r. SEC zaproponowane nowe zasady zapobiegające potencjalnym konfliktom interesów wynikającym z korzystania przez doradców inwestycyjnych i maklerów-dealerów z predykcyjnej analizy danych i sztucznej inteligencji. prezes SEC Gary Gensler ma nawet wyrażone obawia się, że sztuczna inteligencja może doprowadzić do kolejnego kryzysu finansowego.

Źródło obrazu: Shutterstock

- Dystrybucja treści i PR oparta na SEO. Uzyskaj wzmocnienie już dziś.

- PlatoData.Network Pionowe generatywne AI. Wzmocnij się. Dostęp tutaj.

- PlatoAiStream. Inteligencja Web3. Wiedza wzmocniona. Dostęp tutaj.

- PlatonESG. Motoryzacja / pojazdy elektryczne, Węgiel Czysta technologia, Energia, Środowisko, Słoneczny, Gospodarowanie odpadami. Dostęp tutaj.

- Platon Zdrowie. Inteligencja w zakresie biotechnologii i badań klinicznych. Dostęp tutaj.

- ChartPrime. Podnieś poziom swojej gry handlowej dzięki ChartPrime. Dostęp tutaj.

- Przesunięcia bloków. Modernizacja własności offsetu środowiskowego. Dostęp tutaj.

- Źródło: https://Blockchain.News/news/afp-and-other-media-giants-call-for-global-ai-regulation-to-protect-integrity

- :ma

- :Jest

- :nie

- 13

- 2023

- 26

- a

- O nas

- nadużycie

- Działania

- do tego

- adres

- adresowanie

- awansować

- AFP

- agencja

- AI

- Modele AI

- Regulacja AI

- Usługi AI

- Pozwalać

- również

- an

- analityka

- i

- odpowiedni

- aplikacje

- właściwy

- SĄ

- BE

- być

- rozpoczął

- za

- Korzyści

- stronniczość

- uprzedzenia

- ciała

- biznes

- ale

- by

- wezwanie

- zdolny

- spowodowanie

- ChatGPT

- jasny

- Collective

- zbiorowo

- prowizja

- społeczność

- Firmy

- sukcesy firma

- Odszkodowanie

- Obawy

- Konflikt interesów

- zgodny

- konsument

- Ochrona konsumenta

- zawartość

- twórcy treści

- kontynuować

- kontrola

- prawo autorskie

- tworzenie

- twórcy

- kryzys

- uszkodzić

- dane

- Analityka danych

- Kreowanie

- demokratyczny

- Wdrożenie

- detale

- deweloperzy

- oprogramowania

- Dialog

- ujawnienie

- rozdzielczy

- Różnorodność

- starania

- podkreśla

- umożliwiając

- obejmujący

- zapewnienie

- prawo

- ustanowienie

- Eter (ETH)

- europejski

- Parzyste

- ekspresowy

- fakty

- Federalny

- Federalna Komisja Handlu

- budżetowy

- kryzys finansowy

- W razie zamówieenia projektu

- Framework

- od

- FTC

- dalej

- Gary

- generatywny

- generatywna sztuczna inteligencja

- gigantów

- Globalne

- Rząd

- rządowy

- Rządy

- Wzrost

- Prowadzenie

- Have

- pasemka

- HTTPS

- if

- zdjęcia

- Natychmiastowy

- Rezultat

- realizowane

- wykonawczych

- in

- zawierać

- Włącznie z

- indywidualny

- przemysł

- inicjatywy

- integralność

- intelektualny

- własność intelektualna

- Interakcje

- odsetki

- najnowszych

- inwestycja

- Dziennikarze

- jpg

- lipiec

- etykietowanie

- prowadzić

- Przywódcy

- prowadzący

- list

- zrobiony

- Może..

- środków

- Media

- różnorodność mediów

- spełnione

- Mylna informacja

- zwodniczy

- nadużycie

- model

- modele

- konieczność

- netto

- Nowości

- aktualności

- Następny

- of

- często

- on

- tylko

- koncepcja

- OpenAI

- or

- organizacji

- Inne

- Pozostałe

- wytyczne

- koniec

- część

- szczególnie

- Ludzie

- Miejsce

- plato

- Analiza danych Platona

- PlatoDane

- politycy

- możliwie

- potencjał

- potencjalnie

- praktyki

- konserwowanie

- zapobiec

- poprzednio

- Zasady

- prywatność

- produkcji

- propagacja

- własność

- Prawa własności

- zaproponowane

- własność

- chronić

- ochrona

- publiczny

- zaufania publicznego

- Wydawniczy

- położyć

- podnosi

- Odebrane

- niedawny

- rozpoznawanie

- dokumentacja

- w sprawie

- Regulacja

- regulamin

- regulacyjne

- wynagrodzenie

- co do

- odpowiedzialny

- ograniczać

- prawa

- ryzyko

- reguły

- s

- zabezpieczenie

- Skala

- badanie

- SEK

- bezpieczeństwo

- widzieć

- poszukuje

- Usługi

- Zestawy

- Sygnatariusze

- rozwiązanie

- kilka

- Źródło

- specyficzny

- standardy

- wsparcie

- Zrównoważony rozwój

- szybko

- syntetyczny

- Technologia

- że

- Połączenia

- ich

- Tam.

- Te

- one

- Prosperować

- Przez

- do

- Top

- handel

- tradycyjny

- tradycyjne media

- Trening

- Zaufaj

- nas

- Federalna Komisja Handlu Stanów Zjednoczonych

- niesprawiedliwy

- Ujednolicony

- nakłaniając

- posługiwać się

- używany

- za pomocą

- wykorzystany

- Wartości

- różnorodny

- Naruszenia

- czy

- który

- Podczas

- którego

- w

- w ciągu

- bez

- Praca

- zefirnet