Vi tror generativ AI har potensialet over tid til å transformere praktisk talt hver kundeopplevelse vi kjenner. Antall selskaper som lanserer generative AI-applikasjoner på AWS er betydelig og bygges raskt, inkludert adidas, Booking.com, Bridgewater Associates, Clariant, Cox Automotive, GoDaddy og LexisNexis Legal & Professional, for bare å nevne noen. Innovative startups som Perplexity AI går all in på AWS for generativ AI. Ledende AI-selskaper som Anthropic har valgt AWS som sin primære skyleverandør for oppdragskritiske arbeidsbelastninger, og stedet for å trene fremtidige modeller. Og globale tjeneste- og løsningsleverandører som Accenture høster fordelene av skreddersydde generative AI-applikasjoner når de styrker sine interne utviklere med Amazon Code Whisperer.

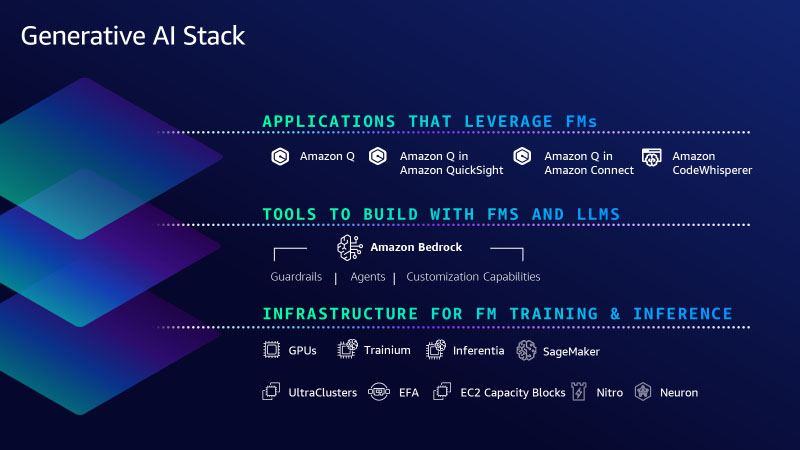

Disse kundene velger AWS fordi vi er fokusert på å gjøre det vi alltid har gjort – å ta kompleks og kostbar teknologi som kan transformere kundeopplevelser og virksomheter og demokratisere det for kunder av alle størrelser og tekniske evner. For å gjøre dette, investerer vi og innoverer raskt for å tilby det mest omfattende settet med funksjoner på tvers av de tre lagene i den generative AI-stakken. Det nederste laget er infrastrukturen for å trene store språkmodeller (LLM) og andre grunnmodeller (FM) og produsere slutninger eller spådommer. Mellomlaget er enkel tilgang til alle modellene og verktøyene kundene trenger for å bygge og skalere generative AI-applikasjoner med samme sikkerhet, tilgangskontroll og andre funksjoner som kundene forventer av en AWS-tjeneste. Og på det øverste laget har vi investert i spillendrende applikasjoner på nøkkelområder som generativ AI-basert koding. I tillegg til å tilby dem valgmuligheter og – som de forventer av oss – bredde og dybde av evner på tvers av alle lag, forteller kundene oss også at de setter pris på vår data-først-tilnærming, og stoler på at vi har bygget alt fra grunnen av med bedriften- grad sikkerhet og personvern.

Denne uken tok vi et stort skritt fremover, og kunngjorde mange viktige nye funksjoner på tvers av alle tre lagene av stabelen for å gjøre det enkelt og praktisk for kundene våre å bruke generativ AI gjennomgående i virksomheten deres.

Bunnlag av stabelen: AWS Trainium2 er det siste tillegget som leverer den mest avanserte skyinfrastrukturen for generativ AI

Det nederste laget av stabelen er infrastrukturen – databehandling, nettverk, rammeverk, tjenester – som kreves for å trene og drive LLM-er og andre FM-er. AWS innoverer for å tilby den mest avanserte infrastrukturen for ML. Gjennom vårt langvarige samarbeid med NVIDIA var AWS den første som brakte GPUer til skyen for mer enn 12 år siden, og sist var vi den første store skyleverandøren som gjorde NVIDIA H100 GPUer tilgjengelige med våre P5-instanser. Vi fortsetter å investere i unike innovasjoner som gjør AWS til den beste skyen for å kjøre GPUer, inkludert pris-ytelsesfordelene til det mest avanserte virtualiseringssystemet (AWS Nitro), kraftig petabit-skala nettverk med Elastic Fabric Adapter (EFA) og hyper- skala clustering med Amazon EC2 UltraClusters (tusenvis av akselererte forekomster samlokalisert i en tilgjengelighetssone og sammenkoblet i et ikke-blokkerende nettverk som kan levere opptil 3,200 Gbps for massiv ML-trening). Vi gjør det også enklere for enhver kunde å få tilgang til svært ettertraktet GPU-beregningskapasitet for generativ AI med Amazon EC2 Capacity Blocks for ML – den første og eneste forbruksmodellen i bransjen som lar kunder reservere GPUer for fremtidig bruk (opptil 500 distribuert i EC2 UltraClusters) for kortvarige ML-arbeidsbelastninger.

For flere år siden skjønte vi at for å fortsette å presse på prisytelsen, måtte vi innovere helt ned til silisiumet, og vi begynte å investere i våre egne chips. For ML spesifikt startet vi med AWS Inferentia, vår spesialbygde inferensbrikke. I dag er vi på vår andre generasjon av AWS Inferentia med Amazon EC2 Inf2-forekomster som er optimalisert spesifikt for storskala generative AI-applikasjoner med modeller som inneholder hundrevis av milliarder av parametere. Inf2-forekomster tilbyr den laveste kostnaden for inferens i skyen, samtidig som de leverer opptil fire ganger høyere gjennomstrømning og opptil ti ganger lavere ventetid sammenlignet med Inf1-forekomster. Drevet av opptil 12 Inferentia2-brikker, er Inf2 de eneste slutningsoptimaliserte EC2-forekomstene som har høyhastighetstilkobling mellom akseleratorer, slik at kunder kan kjøre inferens raskere og mer effektivt (til lavere kostnad) uten å ofre ytelse eller ventetid ved å distribuere ultrastore modeller over flere akseleratorer. Kunder som Adobe, Deutsche Telekom og Leonardo.ai har sett gode tidlige resultater og er glade for å distribuere modellene sine i stor skala på Inf2.

På treningssiden er Trn1-forekomster – drevet av AWSs spesialbygde ML-treningsbrikke, AWS Trainium – optimalisert for å distribuere opplæring på tvers av flere servere koblet til EFA-nettverk. Kunder som Ricoh har trent en japansk LLM med milliarder av parametere på bare dager. Databricks får opptil 40 % bedre prisytelse med Trainium-baserte forekomster for å trene opp store dyplæringsmodeller. Men med nye, mer dyktige modeller som kommer ut praktisk talt hver uke, fortsetter vi å flytte grensene for ytelse og skala, og vi er glade for å kunngjøre AWS Trainium2, designet for å levere enda bedre prisytelse for treningsmodeller med hundrevis av milliarder til billioner av parametere. Trainium2 skal levere opptil fire ganger raskere treningsytelse enn førstegenerasjons Trainium, og når den brukes i EC2 UltraClusters skal den levere opptil 65 eksaflops med aggregert beregning. Dette betyr at kunder vil kunne trene en 300 milliarder parameter LLM på uker kontra måneder. Trainium2s ytelse, skala og energieffektivitet er noen av grunnene til at Anthropic har valgt å trene sine modeller på AWS, og vil bruke Trainium2 for sine fremtidige modeller. Og vi samarbeider med Anthropic om fortsatt innovasjon med både Trainium og Inferentia. Vi forventer at våre første Trainium2-forekomster vil være tilgjengelige for kunder i 2024.

Vi har også doblet programvareverktøykjeden for vårt ML-silisium, spesielt ved å fremme AWS Neuron, programvareutviklingssettet (SDK) som hjelper kundene med å få maksimal ytelse fra Trainium og Inferentia. Siden introduksjonen av Neuron i 2019 har vi gjort betydelige investeringer i kompilator- og rammeverksteknologier, og i dag støtter Neuron mange av de mest populære offentlig tilgjengelige modellene, inkludert Llama 2 fra Meta, MPT fra Databricks og Stable Diffusion fra Stability AI, samt 93 av de 100 beste modellene på det populære modelllageret Hugging Face. Neuron kobles til populære ML-rammeverk som PyTorch og TensorFlow, og støtte for JAX kommer tidlig neste år. Kunder forteller oss at Neuron har gjort det enkelt for dem å bytte sine eksisterende modelltrenings- og slutningsrørledninger til Trainium og Inferentia med bare noen få linjer med kode.

Ingen andre tilbyr den samme kombinasjonen av valg av de beste ML-brikkene, superrask nettverk, virtualisering og hyperskaleringsklynger. Og så er det ikke overraskende at noen av de mest kjente generative AI-startupene som AI21 Labs, Anthropic, Hugging Face, Perplexity AI, Runway og Stability AI kjører på AWS. Men du trenger fortsatt de riktige verktøyene for å effektivt utnytte denne beregningen for å bygge, trene og kjøre LLM-er og andre FM-er effektivt og kostnadseffektivt. Og for mange av disse oppstartene, Amazon SageMaker er svaret. Enten du bygger og trener en ny, proprietær modell fra bunnen av eller starter med en av de mange populære, offentlig tilgjengelige modellene, er opplæring en kompleks og kostbar oppgave. Det er heller ikke lett å kjøre disse modellene kostnadseffektivt. Kunder må anskaffe store mengder data og forberede dem. Dette innebærer vanligvis mye manuelt arbeid med å rense data, fjerne duplikater, berike og transformere dem. Deretter må de opprette og vedlikeholde store klynger av GPUer/akseleratorer, skrive kode for å effektivt distribuere modellopplæring på tvers av klynger, ofte sjekke, sette på pause, inspisere og optimalisere modellen, og manuelt gripe inn og rette opp maskinvareproblemer i klyngen. Mange av disse utfordringene er ikke nye, de er noen av grunnene til at vi lanserte SageMaker for seks år siden – for å bryte ned de mange barrierene som er involvert i modellopplæring og utrulling og gi utviklere en mye enklere måte. Titusenvis av kunder bruker Amazon SageMaker, og et økende antall av dem som LG AI Research, Perplexity AI, AI21, Hugging Face og Stability AI trener LLM-er og andre FM-er på SageMaker. For nylig lærte Technology Innovation Institute (skaperne av de populære Falcon LLM-ene) den største offentlig tilgjengelige modellen – Falcon 180B – på SageMaker. Etter hvert som modellstørrelser og kompleksitet har vokst, har også SageMakers omfang blitt større.

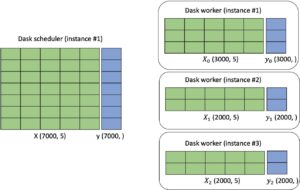

Gjennom årene har vi lagt til mer enn 380 spillendrende funksjoner og muligheter til Amazon SageMaker som automatisk modellinnstilling, distribuert opplæring, fleksible modelldistribusjonsalternativer, verktøy for ML OP-er, verktøy for dataforberedelse, funksjonsbutikker, bærbare datamaskiner, sømløs integrasjon med menneskelig-i-løkken-evalueringer over hele ML-livssyklusen, og innebygde funksjoner for ansvarlig AI. Vi fortsetter å innovere raskt for å sikre at SageMaker-kunder kan fortsette å bygge, trene og kjøre slutninger for alle modeller – inkludert LLM-er og andre FM-er. Og vi gjør det enda enklere og mer kostnadseffektivt for kunder å trene og distribuere store modeller med to nye funksjoner. For det første, for å forenkle treningen innføre Amazon SageMaker HyperPod som automatiserer flere av prosessene som kreves for høyskala feiltolerant distribuert opplæring (f.eks. konfigurere distribuerte treningsbiblioteker, skalere treningsarbeidsmengder på tvers av tusenvis av akseleratorer, oppdage og reparere feilforekomster), fremskynde treningen med så mye som 40 %. Som et resultat bruker kunder som Perplexity AI, Hugging Face, Stability, Hippocratic, Alkaid og andre SageMaker HyperPod for å bygge, trene eller utvikle modeller. Sekund, vi introduserer nye funksjoner for å gjøre slutninger mer kostnadseffektive og samtidig redusere ventetiden. SageMaker hjelper nå kunder med å distribuere flere modeller til samme instans slik at de kan dele dataressurser – noe som reduserer slutningskostnadene med 50 % (i gjennomsnitt). SageMaker overvåker også aktivt instanser som behandler slutningsforespørsler og ruter intelligent forespørsler basert på hvilke instanser som er tilgjengelige – og oppnår 20 % lavere slutningsforsinkelse (i gjennomsnitt). Conjecture, Salesforce og Slack bruker allerede SageMaker for hosting av modeller på grunn av disse slutningsoptimaliseringene.

Mellomlag av stabelen: Amazon Bedrock legger til nye modeller og en bølge av nye funksjoner gjør det enda enklere for kunder å sikkert bygge og skalere generative AI-applikasjoner

Mens en rekke kunder vil bygge sine egne LLM-er og andre FM-er, eller utvikle et hvilket som helst antall av de offentlig tilgjengelige alternativene, vil mange ikke bruke ressursene og tiden på å gjøre dette. For dem tilbyr det midterste laget av stabelen disse modellene som en tjeneste. Vår løsning her, Amazonas grunnfjell, lar kundene velge mellom bransjeledende modeller fra Anthropic, Stability AI, Meta, Cohere, AI21 og Amazon, tilpasse dem med sine egne data og utnytte alle de samme ledende sikkerhetene, tilgangskontrollene og funksjonene de er vant til i AWS – alt gjennom en administrert tjeneste. Vi gjorde Amazon Bedrock generelt tilgjengelig i slutten av september, og kunderesponsen har vært overveldende positiv. Kunder fra hele verden og i praktisk talt alle bransjer er glade for å bruke Amazon Bedrock. adidas gjør det mulig for utviklere å få raske svar på alt fra «komme i gang»-informasjon til dypere tekniske spørsmål. Booking.com har til hensikt å bruke generativ kunstig intelligens for å skrive skreddersydde reiseanbefalinger for hver kunde. Bridgewater Associates utvikler en LLM-drevet investeringsanalytikerassistent for å hjelpe med å generere diagrammer, beregne økonomiske indikatorer og oppsummere resultater. Carrier gjør mer presis energianalyse og innsikt tilgjengelig for kunder, slik at de reduserer energiforbruket og reduserer karbonutslipp. Clariant styrker teammedlemmene sine med en intern generativ AI-chatbot for å akselerere FoU-prosesser, støtte salgsteam med møteforberedelse og automatisere kunde-e-poster. GoDaddy hjelper kunder med å enkelt sette opp virksomhetene sine på nettet ved å bruke generativ AI for å bygge nettsidene deres, finne leverandører, få kontakt med kunder og mer. Lexis Nexis Legal & Professional forvandler juridisk arbeid for advokater og øker produktiviteten deres med Lexis+ AI-funksjoner for samtalesøk, oppsummering og dokumentutforming og -analyse. Nasdaq hjelper til med å automatisere etterforskningsarbeidsflyter på mistenkelige transaksjoner og styrke deres anti-finansiell kriminalitet og overvåkingsevner. Alle disse – og mange flere – ulike generative AI-applikasjoner kjører på AWS.

Vi er spente på momentumet for Amazon Bedrock, men det er fortsatt tidlig. Det vi har sett mens vi har jobbet med kunder er at alle beveger seg raskt, men utviklingen av generativ AI fortsetter i et raskt tempo med nye alternativer og innovasjoner som skjer praktisk talt daglig. Kunder finner ut at det er forskjellige modeller som fungerer bedre for forskjellige brukstilfeller, eller på forskjellige sett med data. Noen modeller er gode for oppsummering, andre er gode for resonnement og integrering, og atter andre har virkelig fantastisk språkstøtte. Og så er det bildegenerering, brukstilfeller for søk og mer – alt kommer fra både proprietære modeller og fra modeller som er offentlig tilgjengelig for alle. Og i tider når det er så mye som er ukjent, er evnen til å tilpasse seg uten tvil det mest verdifulle verktøyet av alle. Det kommer ikke til å være én modell for å styre dem alle. Og absolutt ikke bare ett teknologiselskap som leverer modellene som alle bruker. Kunder må prøve ut forskjellige modeller. De må kunne veksle mellom dem eller kombinere dem innenfor samme brukstilfelle. Dette betyr at de trenger et reelt utvalg av modellleverandører (noe hendelsene de siste 10 dagene har gjort enda tydeligere). Dette er grunnen til at vi oppfant Amazon Bedrock, hvorfor det gir så dyp gjenklang hos kundene, og hvorfor vi fortsetter å innovere og iterere raskt for å gjøre bygging med (og flytte mellom) en rekke modeller like enkelt som et API-kall, sett de nyeste teknikkene for modelltilpasning i hendene på alle utviklere, og hold kundene sikre og dataene deres private. Vi er glade for å introdusere flere nye funksjoner som vil gjøre det enda enklere for kunder å bygge og skalere generative AI-applikasjoner:

- Utvider modellutvalget med Anthropic Claude 2.1, Meta Llama 2 70B og tillegg til Amazon Titan-familien. I disse tidlige dager lærer og eksperimenterer kunder fortsatt med ulike modeller for å finne ut hvilke de vil bruke til ulike formål. De ønsker å enkelt kunne prøve de nyeste modellene, og også teste for å se hvilke muligheter og funksjoner som vil gi dem de beste resultatene og kostnadsegenskapene for deres brukstilfeller. Med Amazon Bedrock er kundene bare ett API-anrop unna en ny modell. Noen av de mest imponerende resultatene kundene har opplevd de siste månedene er fra LLM-er som Anthropics Claude-modell, som utmerker seg på et bredt spekter av oppgaver fra sofistikert dialog og innholdsgenerering til kompleks resonnement samtidig som den opprettholder en høy grad av pålitelighet og forutsigbarhet. Kunder rapporterer at Claude er mye mindre sannsynlig å produsere skadelige utganger, lettere å snakke med og mer styrbar sammenlignet med andre FM-er, slik at utviklere kan få ønsket utgang med mindre innsats. Anthropics toppmoderne modell, Claude 2, skårer over 90. persentilen på GRE lese- og skriveeksamener, og tilsvarende på kvantitativ resonnement. Og nå er den nylig utgitte Claude 2.1-modellen tilgjengelig i Amazon Bedrock. Claude 2.1 leverer nøkkelfunksjoner for bedrifter som et bransjeledende 200K token kontekstvindu (2 ganger konteksten til Claude 2.0), reduserte hallusinasjonsfrekvenser og betydelige forbedringer i nøyaktigheten, selv ved svært lange kontekstlengder. Claude 2.1 inkluderer også forbedrede systemmeldinger – som er modellinstruksjoner som gir en bedre opplevelse for sluttbrukere – samtidig som kostnadene for meldinger og fullføringer reduseres med 25 %.

For et økende antall kunder som ønsker å bruke en administrert versjon av Metas offentlig tilgjengelige Llama 2-modell, tilbyr Amazon Bedrock Llama 2 13B, og vi legger til Llama 2 70B. Llama 2 70B er egnet for store oppgaver som språkmodellering, tekstgenerering og dialogsystemer. De offentlig tilgjengelige Llama-modellene har blitt lastet ned mer enn 30 millioner ganger, og kundene elsker at Amazon Bedrock tilbyr dem som en del av en administrert tjeneste der de ikke trenger å bekymre seg for infrastruktur eller ha dyp ML-ekspertise på teamene sine. I tillegg, for bildegenerering, tilbyr Stability AI en rekke populære tekst-til-bilde-modeller. Stable Diffusion XL 1.0 (SDXL 1.0) er den mest avanserte av disse, og den er nå generelt tilgjengelig i Amazon Bedrock. Den siste utgaven av denne populære bildemodellen har økt nøyaktighet, bedre fotorealisme og høyere oppløsning.

Kunder bruker også Amazon Titan modeller, som er laget og forhåndsopplært av AWS for å tilby kraftige funksjoner med god økonomi for en rekke bruksområder. Amazon har 25 års merittliste innen ML og AI – teknologi vi bruker på tvers av virksomhetene våre – og vi har lært mye om å bygge og distribuere modeller. Vi har nøye valgt hvordan vi trener modellene våre og dataene vi bruker for å gjøre det. Vi holder kunder skadesløs mot påstander om at våre modeller eller deres utdata krenker noens opphavsrett. Vi introduserte våre første Titan-modeller i april i år. Titan Text Lite– nå generelt tilgjengelig— er en kortfattet, kostnadseffektiv modell for brukstilfeller som chatbots, tekstoppsummering eller copywriting, og den er også overbevisende å finjustere. Titan Text Express—også nå generelt tilgjengelig—er mer ekspansiv, og kan brukes til et bredere spekter av tekstbaserte oppgaver, for eksempel åpen tekstgenerering og samtaleprat. Vi tilbyr disse tekstmodellalternativene for å gi kundene muligheten til å optimalisere for nøyaktighet, ytelse og kostnader avhengig av deres brukstilfelle og forretningskrav. Kunder som Nexxiot, PGA Tour og Ryanair bruker våre to Titan Text-modeller. Vi har også en innbyggingsmodell, Titan Text Embeddings, for søk og personalisering. Kunder som Nasdaq ser gode resultater ved å bruke Titan Text Embeddings for å forbedre mulighetene for Nasdaq IR Insight for å generere innsikt fra 9,000+ globale selskapers dokumenter for bærekrafts-, juridiske og regnskapsteam. Og vi vil fortsette å legge til flere modeller til Titan-familien over tid. Vi introduserer en ny innbyggingsmodell, Titan Multimodal Embeddings, for å drive multimodale søk og anbefalingsopplevelser for brukere som bruker bilder og tekst (eller en kombinasjon av begge) som input. Og det er vi introduserer en ny tekst-til-bilde-modell, Amazon Titan Image Generator. Med Titan Image Generator kan kunder på tvers av bransjer som reklame, e-handel og media og underholdning bruke tekstinndata for å generere realistiske bilder i studiokvalitet i store volumer og til lave kostnader. Vi er spente på hvordan kundene reagerer på Titan Models, og du kan forvente at vi vil fortsette å innovere her.

- Nye muligheter for å tilpasse den generative AI-applikasjonen din sikkert med dine proprietære data: En av de viktigste egenskapene til Amazon Bedrock er hvor enkelt det er å tilpasse en modell. Dette blir virkelig spennende for kunder fordi det er der generativ AI møter deres kjernedifferensiator – dataene deres. Det er imidlertid veldig viktig at dataene deres forblir sikre, at de har kontroll over dem underveis, og at modellforbedringer er private for dem. Det er noen måter du kan gjøre dette på, og Amazon Bedrock tilbyr det bredeste utvalget av tilpasningsalternativer på tvers av flere modeller). Den første er finjustering. Det er enkelt å finjustere en modell i Amazon Bedrock. Du velger ganske enkelt modellen og Amazon Bedrock lager en kopi av den. Deretter peker du på noen få merkede eksempler (f.eks. en rekke gode spørsmål-svar-par) som du lagrer i Amazon Simple Storage Service (Amazon S3), og Amazon Bedrock "trener trinnvis" (forsterker den kopierte modellen med den nye informasjonen) på disse eksemplene, og resultatet er en privat, mer nøyaktig finjustert modell som gir mer relevante, tilpassede svar. Vi er glade for å kunngjøre at finjustering er generelt tilgjengelig for Cohere Command, Meta Llama 2, Amazon Titan Text (Lite og Express), Amazon Titan Multimodal Embeddings, og i forhåndsvisning for Amazon Titan Image Generator. Og gjennom vårt samarbeid med Anthropic vil vi snart gi AWS-kunder tidlig tilgang til unike funksjoner for modelltilpasning og finjustering av dens toppmoderne modell Claude.

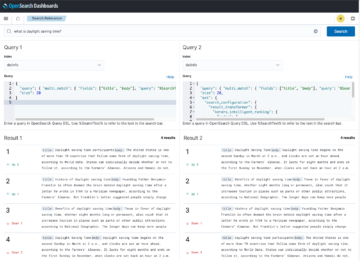

En annen teknikk for å tilpasse LLM-er og andre FM-er for virksomheten din er retrieval augmented generation (RAG), som lar deg tilpasse en modells svar ved å utvide spørsmålene dine med data fra flere kilder, inkludert dokumentlagre, databaser og API-er. I september introduserte vi en RAG-funksjon, Knowledge Bases for Amazon Bedrock, som sikkert kobler modeller til dine proprietære datakilder for å supplere forespørslene dine med mer informasjon slik at applikasjonene dine leverer mer relevante, kontekstuelle og nøyaktige svar. Kunnskapsbaser er nå generelt tilgjengelig med en API som utfører hele RAG-arbeidsflyten fra å hente tekst som er nødvendig for å utvide en forespørsel, til å sende forespørselen til modellen, til å returnere svaret. Knowledge Bases støtter databaser med vektorfunksjoner som lagrer numeriske representasjoner av dataene dine (innbygginger) som modeller bruker for å få tilgang til disse dataene for RAG, inkludert Amazon OpenSearch Service og andre populære databaser som Pinecone og Redis Enterprise Cloud (Amazon Aurora og MongoDB vektorstøtte kommer snart).

Den tredje måten du kan tilpasse modeller i Amazon Bedrock er med fortsatt forhåndstrening. Med denne metoden bygger modellen på sin opprinnelige foropplæring for generell språkforståelse for å lære domenespesifikk språk og terminologi. Denne tilnærmingen er for kunder som har store mengder umerket, domenespesifikk informasjon og som ønsker å gjøre LLM-ene deres i stand til å forstå språket, uttrykkene, forkortelsene, konseptene, definisjonene og sjargongen som er unike for deres verden (og virksomhet). I motsetning til finjustering, som krever en ganske liten mengde data, utføres fortsatt forhåndstrening på store datasett (f.eks. tusenvis av tekstdokumenter). Nå er pre-treningsfunksjoner tilgjengelig i Amazon Bedrock for Titan Text Lite og Titan Text Express.

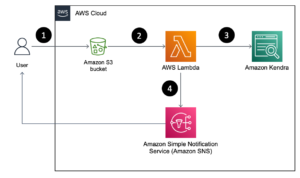

- Generell tilgjengelighet av Agenter for Amazon Bedrock for å hjelpe til med å utføre flertrinnsoppgaver ved å bruke systemer, datakilder og bedriftskunnskap. LLM-er er gode til å ha samtaler og generere innhold, men kundene vil at applikasjonene deres skal kunne do enda mer – som å iverksette tiltak, løse problemer og samhandle med en rekke systemer for å fullføre flertrinnsoppgaver som å bestille reiser, sende inn forsikringskrav eller bestille reservedeler. Og Amazon Bedrock kan hjelpe med denne utfordringen. Med agenter velger utviklere en modell, skriver noen grunnleggende instruksjoner som "du er en glad kundeserviceagent" og "sjekk produkttilgjengelighet i inventarsystemet", peker den valgte modellen til de riktige datakildene og bedriftssystemene (f.eks. CRM eller ERP-applikasjoner), og skriv noen få AWS Lambda-funksjoner for å utføre API-ene (f.eks. sjekk tilgjengeligheten til en vare i ERP-beholdningen). Amazon Bedrock analyserer automatisk forespørselen og bryter den ned i en logisk sekvens ved å bruke den valgte modellens resonneringsevner for å bestemme hvilken informasjon som trengs, hvilke APIer som skal kalles, og når de skal ringes for å fullføre et trinn eller løse en oppgave. Nå generelt tilgjengelig, kan agenter planlegge og utføre de fleste forretningsoppgaver – fra å svare på kundespørsmål om produkttilgjengelighet til å ta bestillingene deres – og utviklere trenger ikke å være kjent med maskinlæring, ingeniørforespørsler, trene modeller eller koble til systemer manuelt. Og Bedrock gjør alt dette sikkert og privat, og kunder som Druva og Athene bruker dem allerede for å forbedre nøyaktigheten og hastigheten på utviklingen av deres generative AI-applikasjoner.

- Introduserer Rekkverk for Amazon Bedrock slik at du kan bruke sikkerhetstiltak basert på krav til brukstilfeller og ansvarlig AI-policy. Kunder ønsker å være sikre på at interaksjoner med deres AI-applikasjoner er trygge, unngå giftig eller støtende språk, forbli relevant for virksomheten deres og samsvarer med deres ansvarlige AI-policyer. Med rekkverk kan kunder spesifisere emner som skal unngås, og Amazon Bedrock vil kun gi brukere godkjente svar på spørsmål som faller i de begrensede kategoriene. For eksempel kan en nettbankapplikasjon settes opp for å unngå å gi investeringsråd, og fjerne upassende innhold (som hatytringer og vold). Tidlig i 2024 vil kunder også kunne redigere personlig identifiserbar informasjon (PII) i modellsvar. For eksempel, etter at en kunde samhandler med en kundesenteragent, blir kundeservicesamtalen ofte oppsummert for journalføring, og rekkverk kan fjerne PII fra disse sammendragene. Rekkverk kan brukes på tvers av modeller i Amazon Bedrock (inkludert finjusterte modeller), og med Agents for Amazon Bedrock, slik at kunder kan gi et konsistent beskyttelsesnivå til alle sine generative AI-applikasjoner.

Topplaget av stabelen: Fortsatt innovasjon gjør generativ AI tilgjengelig for flere brukere

På det øverste laget av stabelen er applikasjoner som utnytter LLM-er og andre FM-er slik at du kan dra nytte av generativ AI på jobben. Et område hvor generativ AI allerede endrer spillet er i koding. I fjor introduserte vi Amazon CodeWhisperer, som hjelper deg å bygge applikasjoner raskere og sikrere ved å generere kodeforslag og anbefalinger i nesten sanntid. Kunder som Accenture, Boeing, Bundesliga, The Cigna Group, Kone og Warner Music Group bruker CodeWhisperer for å øke utviklerproduktiviteten – og Accenture lar opptil 50,000 XNUMX av deres programvareutviklere og IT-fagfolk bruke Amazon CodeWhisperer. Vi ønsker at så mange utviklere som mulig skal kunne få produktivitetsfordelene til generativ AI, og det er derfor CodeWhisperer tilbyr anbefalinger gratis til alle enkeltpersoner.

Men mens AI-kodingsverktøy gjør mye for å gjøre utviklernes liv enklere, begrenses produktivitetsfordelene deres av deres manglende kunnskap om interne kodebaser, interne APIer, biblioteker, pakker og klasser. En måte å tenke på dette på er at hvis du ansetter en ny utvikler, selv om de er i verdensklasse, kommer de ikke til å være så produktive i bedriften din før de forstår din beste praksis og kode. Dagens AI-drevne kodeverktøy er som den nye utvikleren. For å hjelpe med dette har vi nylig forhåndsvist en ny tilpasningsevne i Amazon CodeWhisperer som sikkert utnytter en kundes interne kodebase for å gi mer relevante og nyttige kodeanbefalinger. Med denne muligheten er CodeWhisperer ekspert på din kode og gir anbefalinger som er mer relevante for å spare enda mer tid. I en studie vi gjorde med Persistent, et globalt digitalt ingeniør- og bedriftsmoderniseringsselskap, fant vi ut at tilpasninger hjelper utviklere med å fullføre oppgaver opptil 28 % raskere enn med CodeWhisperers generelle muligheter. Nå kan en utvikler ved et helseteknologiselskap be CodeWhisperer om å "importere MR-bilder knyttet til kunde-IDen og kjøre dem gjennom bildeklassifisereren" for å oppdage uregelmessigheter. Fordi CodeWhisperer har tilgang til kodebasen, kan den gi mye mer relevante forslag som inkluderer importplasseringene til MR-bildene og kunde-IDene. CodeWhisperer holder tilpasninger helt private, og den underliggende FM bruker dem ikke til opplæring, og beskytter kundenes verdifulle intellektuelle eiendom. AWS er den eneste store skyleverandøren som tilbyr en funksjon som dette til alle.

Introduserer Amazon Q, den generative AI-drevne assistenten skreddersydd for arbeid

Utviklere er absolutt ikke de eneste som kommer i gang med generativ AI – millioner av mennesker bruker generative AI-chatteapplikasjoner. Det tidlige leverandører har gjort på dette området er spennende og supernyttig for forbrukere, men på mange måter "fungerer" de ikke helt på jobben. Deres generelle kunnskap og evner er gode, men de kjenner ikke bedriften din, dataene dine, kundene, driften eller virksomheten din. Det begrenser hvor mye de kan hjelpe deg. De vet heller ikke så mye om rollen din – hvilket arbeid du gjør, hvem du jobber med, hvilken informasjon du bruker og hva du har tilgang til. Disse begrensningene er forståelige fordi disse assistentene ikke har tilgang til bedriftens private informasjon, og de er ikke designet for å oppfylle kravene til personvern og sikkerhet bedrifter trenger for å gi dem denne tilgangen. Det er vanskelig å sikre sikkerheten i etterkant og forvente at den fungerer bra. Vi tror vi har en bedre måte, som vil tillate hver person i hver organisasjon å bruke generativ AI trygt i sitt daglige arbeid.

We er glade for å introdusere Amazon Q, en ny type generativ AI-drevet assistent som er spesifikt for jobb og kan skreddersys til din bedrift. Q kan hjelpe deg med å få raske, relevante svar på presserende spørsmål, løse problemer, generere innhold og iverksette handlinger ved å bruke data og ekspertise som finnes i bedriftens informasjonslagre, kode og bedriftssystemer. Når du chatter med Amazon Q, gir den umiddelbar, relevant informasjon og råd for å effektivisere oppgaver, fremskynde beslutningstaking og hjelpe til med å vekke kreativitet og innovasjon på jobben. Vi har bygget Amazon Q for å være sikker og privat, og den kan forstå og respektere dine eksisterende identiteter, roller og tillatelser og bruke denne informasjonen til å tilpasse interaksjonene. Hvis en bruker ikke har tillatelse til å få tilgang til visse data uten Q, kan de heller ikke få tilgang til dem ved å bruke Q. Vi har designet Amazon Q for å møte strenge bedriftskunders krav fra dag én – ingenting av innholdet deres brukes til å forbedre de underliggende modellene.

Amazon Q er din ekspertassistent for å bygge på AWS: Vi har trent Amazon Q på 17 års AWS-kunnskap og erfaring, slik at den kan transformere måten du bygger, distribuerer og driver applikasjoner og arbeidsbelastninger på AWS. Amazon Q har et chat-grensesnitt i AWS Management Console og dokumentasjon, din IDE (via CodeWhisperer) og teamchatterom på Slack eller andre chat-apper. Amazon Q kan hjelpe deg med å utforske nye AWS-funksjoner, komme raskere i gang, lære ukjente teknologier, arkitektløsninger, feilsøke, oppgradere og mye mer – det er en ekspert på AWS-velarkitektte mønstre, beste praksis, dokumentasjon og løsningsimplementeringer. Her er noen eksempler på hva du kan gjøre med din nye AWS-ekspertassistent:

- Få klare svar og veiledning om AWS-funksjoner, tjenester og løsninger: Be Amazon Q om å "Fortell meg om agenter for Amazon Bedrock", og Q vil gi deg en beskrivelse av funksjonen pluss lenker til relevant materiale. Du kan også stille Amazon Q praktisk talt ethvert spørsmål om hvordan en AWS-tjeneste fungerer (f.eks. "Hva er skaleringsgrensene på en DynamoDB-tabell?" "Hva er Redshift Managed Storage?"), eller hvordan du best kan bygge et hvilket som helst antall løsninger ( "Hva er de beste praksisene for å bygge hendelsesdrevne arkitekturer?"). Og Amazon Q vil samle kortfattede svar og alltid sitere (og lenke til) kildene.

- Velg den beste AWS-tjenesten for ditt bruk, og kom raskt i gang: Spør Amazon Q "Hva er måtene å bygge en nettapp på AWS på? ” og det vil gi en liste over potensielle tjenester som AWS forsterke, AWS Lambdaog Amazon EC2 med fordelene til hver. Derfra kan du begrense alternativene ved å hjelpe Q med å forstå dine krav, preferanser og begrensninger (f.eks. "Hvilken av disse ville være best hvis jeg vil bruke containere?" eller "Bør jeg bruke en relasjonell eller ikke-relasjonell database? ”). Avslutt med "Hvordan kommer jeg i gang?" og Amazon Q vil skissere noen grunnleggende trinn og peke deg mot ytterligere ressurser.

- Optimaliser dataressursene dine: Amazon Q kan hjelpe deg med å velge Amazon EC2-forekomster. Hvis du ber den «Hjelp meg med å finne den rette EC2-forekomsten for å distribuere en videokodingsarbeidsmengde for spillappen min med høyest ytelse», vil Q gi deg en liste over forekomstfamilier med begrunnelse for hvert forslag. Og du kan stille et hvilket som helst antall oppfølgingsspørsmål for å finne det beste valget for arbeidsmengden din.

- Få hjelp til å feilsøke, teste og optimalisere koden din: Hvis du støter på en feil under koding i IDE-en din, kan du be Amazon Q om å hjelpe ved å si: "Koden min har en IO-feil, kan du gi en løsning?" og Q vil generere koden for deg. Hvis du liker forslaget, kan du be Amazon Q om å legge til rettelsen til applikasjonen din. Siden Amazon Q er i IDE-en din, forstår den koden du jobber med og vet hvor den skal sette inn rettelsen. Amazon Q kan også lage enhetstester ("Skriv enhetstester for den valgte funksjonen") som den kan sette inn i koden din og du kan kjøre. Til slutt kan Amazon Q fortelle deg hvordan du kan optimalisere koden din for høyere ytelse. Be Q om å "Optimaliser min valgte DynamoDB-spørring", og den vil bruke sin forståelse av koden din til å gi et naturlig språkforslag om hva du skal fikse sammen med den tilhørende koden du kan implementere med ett klikk.

- Diagnostiser og feilsøk problemer: Hvis du støter på problemer i AWS Management Console, som EC2-tillatelsesfeil eller Amazon S3-konfigurasjonsfeil, kan du ganske enkelt trykke på "Feilsøk med Amazon Q"-knappen, og den vil bruke sin forståelse av feiltypen og tjenesten der feilen er lokalisert for å gi deg forslag til løsning. Du kan til og med be Amazon Q om å feilsøke nettverket ditt (f.eks. "Hvorfor kan jeg ikke koble til EC2-forekomsten min ved å bruke SSH?") og Q vil analysere ende-til-ende-konfigurasjonen og gi en diagnose (f.eks. "Denne forekomsten" ser ut til å være i et privat undernett, så offentlig tilgjengelighet må kanskje etableres").

- Rask opp på en ny kodebase på et blunk: Når du chatter med Amazon Q i IDE-en din, kombinerer den sin ekspertise i å bygge programvare med en forståelse av koden din – en kraftig sammenkobling! Tidligere, hvis du tok over et prosjekt fra noen andre, eller du var ny i teamet, må du kanskje bruke timer på å gjennomgå koden og dokumentasjonen manuelt for å forstå hvordan den fungerer og hva den gjør. Nå, siden Amazon Q forstår koden i IDE-en din, kan du ganske enkelt be Amazon Q om å forklare koden ("Gi meg en beskrivelse av hva denne applikasjonen gjør og hvordan den fungerer") og Q vil gi deg detaljer som hvilke tjenester kodebruk og hva forskjellige funksjoner gjør (f.eks. Q kan svare med noe sånt som "Denne applikasjonen bygger et grunnleggende støttebillettsystem ved å bruke Python Flask og AWS Lambda" og fortsetter med å beskrive hver av kjernefunksjonene, hvordan de implementeres, og mye mer).

- Tøm funksjonsetterslepet raskere: Du kan til og med be Amazon Q om å veilede deg gjennom og automatisere mye av ende-til-ende-prosessen med å legge til en funksjon i applikasjonen din i Amazon CodeCatalyst, vår enhetlige programvareutviklingstjeneste for team. For å gjøre dette, tildeler du bare Q en backlog-oppgave fra problemlisten din – akkurat som du ville gjort en lagkamerat – og Q genererer en trinn-for-trinn-plan for hvordan den skal bygge og implementere funksjonen. Når du har godkjent planen, vil Q skrive koden og presentere de foreslåtte endringene for deg som en kodegjennomgang. Du kan be om omarbeid (om nødvendig), godkjenne og/eller distribuere!

- Oppgrader koden din på en brøkdel av tiden: De fleste utviklere bruker faktisk bare en brøkdel av tiden sin på å skrive ny kode og bygge nye applikasjoner. De bruker mye mer av syklusene sine på smertefulle, slitsomme områder som vedlikehold og oppgraderinger. Ta språkversjonsoppgraderinger. Et stort antall kunder fortsetter å bruke eldre versjoner av Java fordi det vil ta måneder – til og med år – og tusenvis av timer med utviklertid å oppgradere. Å utsette dette har reelle kostnader og risiko – du går glipp av ytelsesforbedringer og er sårbar for sikkerhetsproblemer. Vi tror Amazon Q kan være en game changer her, og er begeistret for Amazon Q-kodetransformasjon, en funksjon som kan fjerne mye av dette tunge løftet og redusere tiden det tar å oppgradere applikasjoner fra dager til minutter. Du åpner bare koden du vil oppdatere i IDE-en din, og ber Amazon Q om å "/transformere" koden din. Amazon Q vil analysere hele kildekoden til applikasjonen, generere koden på målspråket og -versjonen, og utføre tester som hjelper deg å realisere sikkerheten og ytelsesforbedringene til de nyeste språkversjonene. Nylig brukte et veldig lite team av Amazon-utviklere Amazon Q Code Transformation til å oppgradere 1,000 produksjonsapplikasjoner fra Java 8 til Java 17 på bare to dager. Gjennomsnittlig tid per påføring var mindre enn 10 minutter. I dag utfører Amazon Q Code Transformation Java-språkoppgraderinger fra Java 8 eller Java 11 til Java 17. Neste (og snart) kommer muligheten til å transformere .NET Framework til .NET på tvers av plattformer (med enda flere transformasjoner å følge i fremtiden) .

Amazon Q er din bedriftsekspert: Du kan koble Amazon Q til bedriftsdata, informasjon og systemer slik at den kan syntetisere alt og gi skreddersydd assistanse for å hjelpe folk med å løse problemer, generere innhold og utføre handlinger som er relevante for virksomheten din. Det er enkelt å bringe Amazon Q til bedriften din. Den har 40+ innebygde koblinger til populære bedriftssystemer som Amazon S3, Microsoft 365, Salesforce, ServiceNow, Slack, Atlassian, Gmail, Google Drive og Zendesk. Den kan også koble til ditt interne intranett, wikier og kjøre bøker, og med Amazon Q SDK kan du bygge en tilkobling til den interne applikasjonen du ønsker. Pek Amazon Q på disse depotene, og det vil "rampe opp" på virksomheten din, fange opp og forstå den semantiske informasjonen som gjør bedriften din unik. Deretter får du din egen vennlige og enkle Amazon Q-nettapplikasjon slik at ansatte på tvers av bedriften din kan samhandle med samtalegrensesnittet. Amazon Q kobler seg også til identitetsleverandøren din for å forstå en bruker, deres rolle og hvilke systemer de har tillatelse til å få tilgang til, slik at brukere kan stille detaljerte, nyanserte spørsmål og få skreddersydde resultater som kun inkluderer informasjon de er autorisert til å se. Amazon Q genererer svar og innsikt som er nøyaktige og tro mot materialet og kunnskapen du gir det, og du kan begrense sensitive emner, blokkere nøkkelord eller filtrere ut upassende spørsmål og svar. Her er noen eksempler på hva du kan gjøre med bedriftens nye ekspertassistent:

- Få skarpe, superrelevante svar basert på bedriftsdata og informasjon: Ansatte kan spørre Amazon Q om alt de tidligere måtte ha måttet lete etter på tvers av alle slags kilder. Spør «Hva er de siste retningslinjene for logobruk?», eller «Hvordan søker jeg om et firmakredittkort?», og Amazon Q vil syntetisere alt relevant innhold den finner og komme tilbake med raske svar pluss lenker til det relevante kilder (f.eks. merkevareportaler og logolager, selskapets T&E-policyer og kortapplikasjoner).

- Strømlinjeform daglig kommunikasjon: Bare spør, og Amazon Q kan generere innhold ("Opprett et blogginnlegg og tre sosiale medier-overskrifter som annonserer produktet beskrevet i denne dokumentasjonen"), lage sammendrag ("Skriv et sammendrag av møteutskriften vår med en punktliste over handlingspunkter" ), gi e-postoppdateringer ("Utarbeid en e-post som fremhever våre Q3-treningsprogrammer for kunder i India") og hjelp til å strukturere møter ("Lag en møteagenda for å snakke om den siste kundetilfredshetsrapporten").

- Fullfør oppgaver: Amazon Q kan hjelpe med å fullføre visse oppgaver, og redusere tiden ansatte bruker på repeterende arbeid som å arkivere billetter. Be Amazon Q om å "oppsummere tilbakemeldinger fra kunder om det nye pristilbudet i Slack," og be deretter om at Q tar den informasjonen og åpner en billett i Jira for å oppdatere markedsføringsteamet. Du kan be Q om å "oppsummere denne samtaleutskriften" og deretter "Åpne en ny sak for kunde A i Salesforce." Amazon Q støtter andre populære arbeidsautomatiseringsverktøy som Zendesk og Service Now.

Amazon Q er i Amazon QuickSight: Med Amazon Q i QuickSight, AWS sin business intelligence-tjeneste, kan brukere stille spørsmål på dashbordene sine som "Hvorfor økte antallet bestillinger forrige måned?" og få visualiseringer og forklaringer på faktorene som påvirket økningen. Og analytikere kan bruke Amazon Q for å redusere tiden det tar dem å bygge dashboards fra dager til minutter med en enkel melding som "Vis meg salg etter region for måned som et stablet stolpediagram." Q kommer rett tilbake med det diagrammet, og du kan enkelt legge det til et dashbord eller chatte videre med Q for å avgrense visualiseringen (f.eks. «Endre stolpediagrammet til et Sankey-diagram» eller «Vis land i stedet for regioner»). Amazon Q i QuickSight gjør det også enklere å bruke eksisterende instrumentbord for å informere forretningsinteressenter, destillere nøkkelinnsikt og forenkle beslutningstaking ved hjelp av datahistorier. For eksempel kan brukere be Amazon Q om å "bygge en historie om hvordan virksomheten har endret seg den siste måneden for en virksomhetsgjennomgang med seniorlederskap," og i løpet av sekunder leverer Amazon Q en datadrevet historie som er visuelt overbevisende og er fullstendig tilpassbar. Disse historiene kan deles sikkert i hele organisasjonen for å hjelpe til med å samkjøre interessenter og få bedre beslutninger.

Amazon Q er i Amazon Connect: I Amazon Connect, vår kontaktsentertjeneste, hjelper Amazon Q dine kundeserviceagenter med å gi bedre kundeservice. Amazon Q utnytter kunnskapsrepositoriene agentene dine vanligvis bruker for å få informasjon til kunder, og deretter kan agenter chatte med Amazon Q direkte i Connect for å få svar som hjelper dem å svare raskere på kundeforespørsler uten å måtte søke gjennom dokumentasjonen selv. Og selv om det er flott å chatte med Amazon Q for superraske svar, er det ikke noe som heter for raskt i kundeservice. Derfor Amazon Q In Connect gjør en direkte kundesamtale med en agent til en melding, og gir automatisk agenten mulige svar, foreslåtte handlinger og lenker til ressurser. Amazon Q kan for eksempel oppdage at en kunde kontakter et leiebilselskap for å endre reservasjonen, generere et svar for agenten for raskt å kommunisere hvordan selskapets retningslinjer for endringsgebyrer gjelder, og veilede agenten gjennom trinnene de trenger for å oppdatere reservasjon.

Amazon Q er i AWS Supply Chain (kommer snart): I AWS Supply Chain, vår forsyningskjedeinnsiktstjeneste, hjelper Amazon Q tilbuds- og etterspørselsplanleggere, lagerforvaltere og handelspartnere med å optimalisere forsyningskjeden deres ved å oppsummere og fremheve potensielle lager- eller overlagerrisikoer, og visualisere scenarier for å løse problemet. Brukere kan stille Amazon Q "hva", "hvorfor" og "hva hvis"-spørsmål om forsyningskjededataene deres og chatte gjennom komplekse scenarier og avveininger mellom ulike forsyningskjedebeslutninger. En kunde kan for eksempel spørre: «Hva forårsaker forsinkelsen i forsendelsene mine, og hvordan kan jeg få fart på sakene?» Amazon Q kan svare, "90 % av bestillingene dine er på østkysten, og en stor storm i sørøst forårsaker en 24-timers forsinkelse. Hvis du sender til havnen i New York i stedet for Miami, vil du fremskynde leveranser og redusere kostnadene med 50 %.»

Kundene våre tar raskt i bruk generativ AI – de trener banebrytende modeller på AWS, de utvikler generative AI-applikasjoner i rekordfart ved å bruke Amazon Bedrock, og de distribuerer spillendrende applikasjoner på tvers av organisasjonene sine som Amazon Q. Med våre siste kunngjøringer, AWS gir kundene enda mer ytelse, valgmuligheter og innovasjon til hvert lag av stabelen. Den kombinerte effekten av alle egenskapene vi leverer på re:Invent markerer en viktig milepæl mot å møte et spennende og meningsfylt mål: Vi gjør generativ AI tilgjengelig for kunder av alle størrelser og tekniske evner, slik at de kan finne opp igjen og transformere det er mulig.

Ressurser

om forfatteren

Swami Sivasubramanian er visepresident for data og maskinlæring i AWS. I denne rollen fører Swami tilsyn med alle AWS-databaser, analysetjenester og AI- og maskinlæringstjenester. Teamets oppgave er å hjelpe organisasjoner med å sette dataene sine i arbeid med en komplett, ende-til-ende dataløsning for å lagre, få tilgang til, analysere og visualisere og forutsi.

Swami Sivasubramanian er visepresident for data og maskinlæring i AWS. I denne rollen fører Swami tilsyn med alle AWS-databaser, analysetjenester og AI- og maskinlæringstjenester. Teamets oppgave er å hjelpe organisasjoner med å sette dataene sine i arbeid med en komplett, ende-til-ende dataløsning for å lagre, få tilgang til, analysere og visualisere og forutsi.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/machine-learning/welcome-to-a-new-era-of-building-in-the-cloud-with-generative-ai-on-aws/

- : har

- :er

- :ikke

- :hvor

- $OPP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 300

- 35%

- 40

- 50

- 500

- 65

- 8

- 9

- a

- evner

- evne

- I stand

- Om oss

- ovenfor

- akselerere

- akselerert

- akseleratorer

- Accenture

- adgang

- tilgjengelighet

- tilgjengelig

- Regnskap og administrasjon

- nøyaktighet

- nøyaktig

- erverve

- tvers

- Handling

- handlinger

- aktivt

- faktisk

- tilpasse

- legge til

- la til

- legge

- tillegg

- Ytterligere

- I tillegg

- tilleggene

- Legger

- Adidas

- Adobe

- vedta

- avansert

- Advancing

- Fordel

- fordeler

- Annonsering

- råd

- Etter

- mot

- agenda

- Agent

- agenter

- aggregat

- siden

- AI

- AI og maskinlæring

- AI chatbot

- ai forskning

- AI-drevet

- justere

- Alle

- tillate

- tillater

- langs

- allerede

- også

- alltid

- Amazon

- Amazon Code Whisperer

- Amazon EC2

- Amazon QuickSight

- Amazon SageMaker

- Amazon Web Services

- beløp

- beløp

- an

- analyse

- analytiker

- analytikere

- analytics

- analysere

- analyser

- og

- Kunngjøre

- Kunngjøringer

- Kunngjøring

- besvare

- svar

- Antropisk

- noen

- noen

- hva som helst

- api

- APIer

- app

- vises

- Søknad

- søknader

- Påfør

- verdsette

- tilnærming

- godkjenne

- godkjent

- apps

- April

- ER

- AREA

- områder

- antageligvis

- rundt

- AS

- spør

- Assistanse

- Assistent

- assistenter

- assosiert

- tilknyttede

- At

- Atlassian

- øke

- augmented

- forstørrelser

- Aurora

- autorisert

- automatisere

- automatiserer

- Automatisk

- automatisk

- Automatisering

- automotive

- tilgjengelighet

- tilgjengelig

- gjennomsnittlig

- unngå

- borte

- AWS

- AWS slutning

- AWS Lambda

- AWS-administrasjonskonsoll

- tilbake

- Banking

- Bar

- barrierer

- basen

- basert

- grunnleggende

- BE

- fordi

- blir

- vært

- begynte

- tro

- Fordeler

- BEST

- beste praksis

- Bedre

- mellom

- Stor

- Milliarder

- milliarder

- Blokker

- Blocks

- Blogg

- Boeing

- Bolt

- bestilling

- Booking.com

- bøker

- både

- Bunn

- grenser

- merke

- Break

- pauser

- bringe

- Bringe

- bygge

- Bygning

- bygger

- bygget

- innebygd

- virksomhet

- business intelligence

- bedrifter

- men

- knapp

- by

- ring

- call center

- CAN

- Kan få

- evner

- evne

- stand

- Kapasitet

- fange

- bil

- karbon

- karbonutslipp

- kort

- nøye

- saken

- saker

- kategorier

- forårsaker

- sentrum

- viss

- Gjerne

- kjede

- utfordre

- utfordringer

- endring

- endret

- Veksler

- Endringer

- endring

- egenskaper

- Figur

- Topplisten

- chatterom

- chatbot

- chatbots

- chatting

- sjekk

- chip

- chips

- valg

- Velg

- velge

- valgt ut

- krav

- klasser

- Rengjøring

- fjerne

- klikk

- Cloud

- sky infrastruktur

- Cluster

- gruppering

- Coast

- kode

- kodebase

- Kode anmeldelse

- Koding

- samarbeider

- samarbeid

- COM

- kombinasjon

- kombinere

- kombinert

- skurtreskerne

- Kom

- kommer

- kommer

- Kommer snart

- kommunisere

- kommunikasjon

- Selskaper

- Selskapet

- Selskapets

- sammenlignet

- overbevisende

- fullføre

- helt

- komplekse

- kompleksitet

- omfattende

- Beregn

- konsepter

- Konfigurasjon

- konfigurering

- formodninger

- Koble

- tilkoblet

- tilkobling

- Tilkobling

- forbinder

- konsistent

- Konsoll

- begrensninger

- Forbrukere

- forbruk

- kontakt

- kontakt senter

- Containere

- innhold

- kontekst

- kontekstuelle

- fortsette

- fortsatte

- fortsetter

- fortsetter

- kontroll

- kontroller

- Samtale

- conversational

- samtaler

- copyright

- copywriting

- Kjerne

- Kostnad

- kostnadseffektiv

- Kostnader

- land

- Cox

- skape

- opprettet

- kreativitet

- skaperne

- kreditt

- kredittkort

- Crime

- SPRØ

- CRM

- plattform

- kunde

- kundeopplevelse

- Kundetilfredshet

- Kundeservice

- Kunder

- tilpasses

- tilpasning

- tilpasse

- tilpasset

- Kutt

- sykluser

- daglig

- dashbord

- oversikter

- dato

- Dataklargjøring

- personvern

- Datas personvern og sikkerhet

- datasett

- data-drevet

- Database

- databaser

- Databaser

- dag

- dag til dag

- Dager

- Beslutningstaking

- avgjørelser

- dyp

- dyp læring

- dypere

- definisjoner

- Grad

- forsinkelse

- leverer

- leveransene

- levere

- leverer

- Etterspørsel

- Demokratisering

- avhengig

- utplassere

- utplassert

- utplasserings

- distribusjon

- dybde

- beskrive

- beskrevet

- beskrivelse

- designet

- ønsket

- detaljert

- detaljer

- oppdage

- Bestem

- DEUTSCHE TELECOM

- Utvikler

- utviklere

- utvikle

- Utvikling

- diagnose

- Dialog

- Dialog

- gJORDE

- forskjellig

- kringkasting

- digitalt

- direkte

- distribuere

- distribueres

- distribuert opplæring

- distribusjon

- do

- dokument

- dokumentasjon

- dokumenter

- gjør

- ikke

- gjør

- gjort

- ikke

- dobling

- ned

- stasjonen

- to

- duplikater

- varighet

- e

- e-handel

- hver enkelt

- Tidlig

- enklere

- lett

- øst

- øst kyst

- lett

- Økonomi

- utgave

- effektivt

- effektivitet

- effektivt

- innsats

- enten

- ellers

- emalje

- e-post

- Utslipp

- ansatte

- bemyndige

- myndiggjøring

- muliggjøre

- muliggjør

- koding

- møte

- slutt

- ende til ende

- energi

- Energiforbruk

- energieffektivitet

- ingeniør

- Ingeniørarbeid

- forbedre

- forbedringer

- berikende

- Enterprise

- enterprise-klasse

- bedrifter

- Entertainment

- Hele

- konvolutt

- Era

- ERP

- feil

- feil

- Eter (ETH)

- evalueringer

- Selv

- hendelser

- NOEN GANG

- Hver

- alle

- alt

- evolusjon

- utvikle seg

- eksempel

- eksempler

- opphisset

- spennende

- henrette

- utøvende

- eksisterende

- ekspansiv

- forvente

- fremskynde

- dyrt

- erfaring

- erfaren

- Erfaringer

- Expert

- ekspertise

- Forklar

- utforske

- ekspress

- stoff

- Face

- Faktisk

- faktorer

- ganske

- trofast

- falk

- Fall

- kjent

- familier

- familie

- FAST

- raskere

- defekt

- Trekk

- Egenskaper

- gebyr

- tilbakemelding

- Noen få

- Filing

- filtrere

- Endelig

- finansiell

- Finn

- finne

- funn

- slutt

- ferdig

- Først

- Fix

- fleksibel

- fokuserte

- følge

- Til

- For forbrukere

- Forward

- funnet

- Fundament

- fire

- brøkdel

- Rammeverk

- rammer

- Gratis

- ofte

- vennlig

- fra

- funksjoner

- videre

- framtid

- spill

- game-changer

- gaming

- general

- generelt

- generere

- genererer

- genererer

- generasjonen

- generative

- Generativ AI

- generator

- få

- få

- Gi

- Global

- global digital

- gmail

- Go

- mål

- skal

- god

- GPU

- GPU

- flott

- Ground

- banebrytende

- Gruppe

- Økende

- voksen

- veiledning

- veilede

- retningslinjer

- HAD

- hender

- Skjer

- Hard

- maskinvare

- skadelig

- hater

- hatmeldinger

- Ha

- å ha

- Overskrifter

- helsetjenester

- tung

- tung løfting

- hjelpe

- hjelpe

- hjelper

- her.

- Høy

- høyere

- høyest

- utheving

- svært

- leie

- hans

- Hosting

- TIMER

- Hvordan

- Hvordan

- Men

- HTTPS

- Hundrevis

- i

- ID

- identiteter

- Identitet

- ids

- if

- bilde

- bildegenerering

- bilder

- umiddelbar

- Påvirkning

- iverksette

- implementeringer

- implementert

- importere

- viktig

- imponerende

- forbedre

- forbedret

- forbedringer

- in

- inkludere

- inkluderer

- Inkludert

- Øke

- økt

- økende

- indikatorer

- individer

- bransjer

- industri

- bransjeledende

- påvirket

- info

- informere

- informasjon

- Infrastruktur

- innovere

- nyskapende

- Innovasjon

- innovasjoner

- innovative

- inngang

- innganger

- innsikt

- innsikt

- f.eks

- forekomster

- i stedet

- Institute

- instruksjoner

- forsikring

- integrering

- intellektuell

- intellektuell eiendom

- Intelligens

- hensikt

- samhandle

- interaksjoner

- interaktiv

- sammenhengende

- Interface

- intern

- gripe inn

- inn

- introdusere

- introdusert

- innføre

- Oppfunnet

- inventar

- Investere

- etterforskende

- investere

- investering

- Investeringer

- involvert

- innebærer

- saker

- IT

- IT-fagfolk

- DET ER

- Japansk

- sjargong

- Java

- jpg

- bare

- bare én

- Hold

- holde

- nøkkel

- Nøkkelområder

- nøkkelord

- kit

- Sett (SDK)

- Vet

- kunnskap

- vet

- Labs

- maling

- Språk

- stor

- storskala

- største

- Siste

- I fjor

- Late

- Ventetid

- siste

- lansert

- lansere

- advokater

- lag

- lag

- Ledelse

- ledende

- LÆRE

- lært

- læring

- Lovlig

- mindre

- Lar

- Nivå

- Leverage

- utnytter

- LexisNexis

- LG

- bibliotekene

- Livssyklus

- løfte

- i likhet med

- Sannsynlig

- begrensninger

- Begrenset

- grenser

- linjer

- LINK

- lenker

- Liste

- leve

- Bor

- Llama

- ligger

- steder

- logisk

- logo

- Lang

- langvarige

- Lot

- elsker

- Lav

- lavere

- lavest

- maskin

- maskinlæring

- laget

- vedlikeholde

- opprettholde

- vedlikehold

- større

- gjøre

- GJØR AT

- Making

- fikk til

- ledelse

- Ledere

- håndbok

- manuelt arbeid

- manuelt

- mange

- Marketing

- materiale

- materialer

- maksimal

- Kan..

- me

- meningsfylt

- midler

- Media

- Møt

- møte

- møter

- møter

- medlemmer

- bare

- Meta

- metode

- Miami

- Microsoft

- Microsoft 365

- Middle

- kunne

- milepæl

- minutter

- gå glipp av

- Oppdrag

- ML

- modell

- modellering

- modeller

- modernisering

- Momentum

- MongoDB

- skjermer

- Måned

- måneder

- mer

- mest

- Mest populær

- flytting

- MR

- mye

- flere

- musikk

- må

- my

- navn

- Nasdaq

- Naturlig

- Naturlig språk

- Nær

- nødvendig

- Trenger

- nødvendig

- trenger

- nett

- nettverk

- nettverk

- Ny

- New York

- nylig

- neste

- Nitro

- Nei.

- notatbøker

- nå

- Antall

- Nvidia

- of

- off

- støtende

- tilby

- tilby

- Tilbud

- ofte

- eldre

- on

- gang

- ONE

- seg

- på nett

- nettbank

- bare

- åpen

- betjene

- Drift

- Optimalisere

- optimalisert

- optimalisere

- alternativer

- or

- ordrer

- organisasjon

- organisasjoner

- original

- Annen

- andre

- vår

- ut

- omriss

- produksjon

- utganger

- enn

- Rydde

- overveldende

- egen

- Fred

- pakker

- smertefullt

- par

- parameter

- parametere

- del

- partnere

- deler

- Past

- mønstre

- pause

- Ansatte

- for

- utføre

- ytelse

- utført

- utfører

- tillatelse

- tillatelser

- person

- Tilpassing

- tilpasse

- personlig

- PGA Tour

- setninger

- PII

- Sted

- fly

- plato

- Platon Data Intelligence

- PlatonData

- i tillegg til

- Point

- Politikk

- Populær

- positiv

- mulig

- Post

- potensiell

- makt

- powered

- kraftig

- Praktisk

- praktisk talt

- praksis

- presis

- forutsi

- Spådommer

- preferanser

- forberedelse

- Forbered

- presentere

- president

- trykk

- trykke

- Forhåndsvisning

- tidligere

- pris

- prising

- primære

- privatliv

- Personvern og sikkerhet

- privat

- privat informasjon

- Problem

- problemer

- prosess

- Prosesser

- prosessering

- produsere

- Produkt

- Produksjon

- produktiv

- produktivitet

- profesjonell

- fagfolk

- programmer

- prosjekt

- ledetekster

- eiendom

- proprietær

- beskytte

- beskyttelse

- gi

- leverandør

- tilbydere

- gir

- gi

- offentlig

- offentlig

- formål

- Skyv

- Skyver

- sette

- Sette

- Python

- pytorch

- Q3

- kvantitativ

- spørsmål

- spørsmål

- Rask

- raskt

- ganske

- FoU

- område

- rask

- raskt

- priser

- RE

- Lesning

- ekte

- sanntids

- realistisk

- realisere

- realisert

- virkelig

- høsting

- grunner

- nylig

- Anbefaling

- anbefalinger

- rekord

- redusere

- Redusert

- redusere

- avgrense

- region

- utgitt

- relevant

- pålitelighet

- forblir

- fjerne

- fjerne

- reparasjon

- repeterende

- erstatning

- svar

- rapporterer

- Repository

- anmode

- forespørsler

- påkrevd

- Krav

- forskning

- Booking

- Reserve

- oppløsning

- resonerer

- Ressurser

- respekt

- Svare

- svare

- svar

- svar

- ansvarlig

- begrense

- begrenset

- resultere

- Resultater

- retur

- anmeldelse

- gjennomgå

- ikke sant

- risikoer

- Rolle

- roller

- Rom

- ruter

- Regel

- Kjør

- rennende

- rullebane

- ofre

- trygge

- sikringstiltak

- trygt

- sagemaker

- salg

- Salesforce

- samme

- tilfredshet

- Spar

- sier

- Skala

- skalering

- scenarier

- omfang

- score

- skraper

- SDK

- sømløs

- Søk

- Sekund

- Andre generasjon

- sekunder

- sikre

- sikkert

- sikkerhet

- se

- se

- sett

- velg

- valgt

- utvalg

- sending

- senior

- senior ledelse

- sensitive

- September

- Sequence

- Serien

- servere

- tjeneste

- ServiceNow

- Tjenester

- sett

- sett

- flere

- Del

- delt

- skip

- Kort

- bør

- side

- signifikant

- Silicon

- på samme måte

- Enkelt

- forenkle

- ganske enkelt

- siden

- SIX

- størrelser

- slakk

- liten

- So

- selskap

- sosiale medier

- Software

- Programvareutviklere

- programvareutvikling

- Programvareutviklingssett

- løsning

- Solutions

- LØSE

- noen

- Noen

- noe

- Snart

- sofistikert

- kilde

- kildekoden

- Kilder

- sørøst

- Rom

- Spark

- spesielt

- tale

- fart

- bruke

- Stabilitet

- stabil

- stable

- stablet

- interessenter

- startet

- Start

- startups

- state-of-the-art

- opphold

- Trinn

- Steps

- Still

- lagring

- oppbevare

- butikker

- Stories

- Storm

- Story

- effektivisere

- Forsterke

- strengere

- struktur

- Studer

- subnett

- betydelig

- slik

- egnet

- suite

- oppsummere

- SAMMENDRAG

- Super

- supplere

- leverandører

- levere

- Tilbud og etterspørsel

- forsyningskjeden

- støtte

- Støtter

- sikker

- overrask

- overvåking

- mistenkelig

- Bærekraft

- Bytte om

- syntetisere

- system

- Systemer

- bord

- skreddersydd

- Ta

- tar

- ta

- Snakk

- Target

- Oppgave

- oppgaver

- lag

- Lag medlemmer

- lag

- Teknisk

- teknikk

- teknikker

- Technologies

- Teknologi

- teknologiinnovasjon

- fortelle

- fortelle

- ti

- titus

- tensorflow

- terminologi

- test

- Testing

- tester

- tekst

- tekstgenerering

- enn

- Det

- De

- Fremtiden

- verden

- deres

- Dem

- seg

- deretter

- Der.

- Disse

- de

- ting

- ting

- tror

- Tredje

- denne

- dette året

- De

- tusener

- tre

- Gjennom

- hele

- gjennomstrømning

- billett

- billetter

- tid

- ganger

- titan

- til

- i dag

- dagens

- sammen

- token

- også

- tok

- verktøy

- verktøy

- topp

- temaer

- tur

- mot

- mot

- spor

- trading

- Tog

- trent

- Kurs

- Transaksjoner

- Transcript

- Transform

- Transformation

- transformasjoner

- transformere

- reiser

- billioner

- tur

- virkelig

- Stol

- prøve

- prøver

- snur

- to

- typen

- typisk

- underliggende

- forstå

- forståelig

- forståelse

- forstår

- ukjent

- enhetlig

- unik

- unike egenskaper

- enhet

- I motsetning til

- til

- Oppdater

- oppdateringer

- oppgradering

- oppgraderinger

- us

- bruk

- bruke

- bruk sak

- brukt

- Bruker

- Brukere

- bruker

- ved hjelp av

- Verdifull

- variasjon

- ulike

- versjon

- Versus

- veldig

- av

- vice

- Vice President

- video

- nesten

- visualisering

- visualisere

- visuelt

- volumer

- Sårbar

- ønsker

- Warner

- warner musikkgruppe

- var

- Wave

- Vei..

- måter

- we

- web

- Webapplikasjon

- webtjenester

- nettsteder

- uke

- uker

- velkommen

- VI VIL

- velkjent

- var

- Hva

- Hva er

- når

- om

- hvilken

- mens

- HVEM

- hvorfor

- bred

- Bred rekkevidde

- bredere

- vil

- vindu

- med

- innenfor

- uten

- Arbeid

- arbeidet

- arbeidsflyt

- arbeid

- virker

- verden

- verdensklasse

- bekymring

- verdt

- ville

- skrive

- skriv kode

- skriving

- år

- år

- york

- du

- Din

- Zendesk

- zephyrnet