En ny teknisk artikkel med tittelen "Hyperscale Hardware Optimized Neural Architecture Search" ble publisert av forskere ved Google, Apple og Waymo.

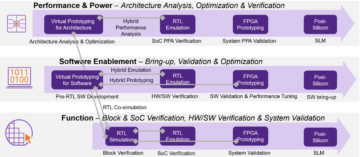

"Denne artikkelen introduserer det første Hyperscale Hardware Optimized Neural Architecture Search (H2O-NAS) for automatisk utforming av nøyaktige og effektive maskinlæringsmodeller skreddersydd til den underliggende maskinvarearkitekturen. H2O-NAS består av tre nøkkelkomponenter: en ny massivt parallell "one-shot" søkealgoritme med intelligent vektdeling, som kan skaleres til søkeområder på O(10280) og håndtere store volumer av produksjonstrafikk; maskinvareoptimaliserte søkerom for ulike ML-modeller på heterogen maskinvare; og en ny to-fase hybrid ytelsesmodell og en multi-objektiv belønningsfunksjon optimert for storskala distribusjoner,” heter det i avisen.

Finn det teknisk papir her. Publisert mars 2023.

Sheng Li, Garrett Andersen, Tao Chen, Liqun Cheng, Julian Grady, Da Huang, Quoc V. Le, Andrew Li, Xin Li, Yang Li, Chen Liang, Yifeng Lu, Yun Ni, Ruoming Pang, Mingxing Tan, Martin Wicke, Gang Wu, Shengqi Zhu, Parthasarathy Ranganathan og Norman P. Jouppi. 2023. Hyperscale Hardware Optimized Neural Architecture Search. I Proceedings of the 28th ACM International Conference on Architectural Support for Programming Languages and Operating Systems, bind 3 (ASPLOS 2023). Association for Computing Machinery, New York, NY, USA, 343–358. https://doi.org/10.1145/3582016.3582049

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. Tilgang her.

- Minting the Future med Adryenn Ashley. Tilgang her.

- kilde: https://semiengineering.com/hyperscale-hw-optimized-neural-architecture-search-google/

- ][s

- 2023

- a

- nøyaktig

- ACM

- algoritme

- og

- Andersen

- Andrew

- eple

- arkitektonisk

- arkitektur

- Association

- At

- automatisk

- by

- CAN

- chen

- Cheng

- komponenter

- databehandling

- Konferanse

- DA

- distribusjoner

- utforming

- diverse

- Først

- Til

- funksjon

- Gjeng

- håndtere

- maskinvare

- HTTPS

- Hybrid

- in

- Intelligent

- internasjonalt

- Introduserer

- nøkkel

- språk

- stor

- læring

- maskin

- maskinlæring

- maskiner

- Mars

- Martin

- massivt

- ML

- modell

- modeller

- neural

- Ny

- New York

- roman

- NY

- of

- on

- drift

- operativsystemer

- optimalisert

- Papir

- Parallel

- ytelse

- plato

- Platon Data Intelligence

- PlatonData

- proceedings

- Produksjon

- Programmering

- programmerings språk

- publisert

- forskere

- Belønn

- Skala

- Søk

- deling

- mellomrom

- Stater

- støtte

- Systemer

- skreddersydd

- Teknisk

- De

- tre

- tittelen

- til

- trafikk

- underliggende

- USA

- volum

- volumer

- var

- waymo

- vekt

- hvilken

- med

- wu

- zephyrnet