Bilde av redaktør

14. mars 2023 lanserte OpenAI GPT-4, den nyeste og kraftigste versjonen av språkmodellen deres.

I løpet av bare timer etter lanseringen overveldet GPT-4 folk ved å snu en håndtegnet skisse til en funksjonell nettside, bestått advokateksamenog generere nøyaktige sammendrag av Wikipedia-artikler.

Den overgår også forgjengeren GPT-3.5 når det gjelder å løse matematiske problemer og svare på spørsmål basert på logikk og resonnement.

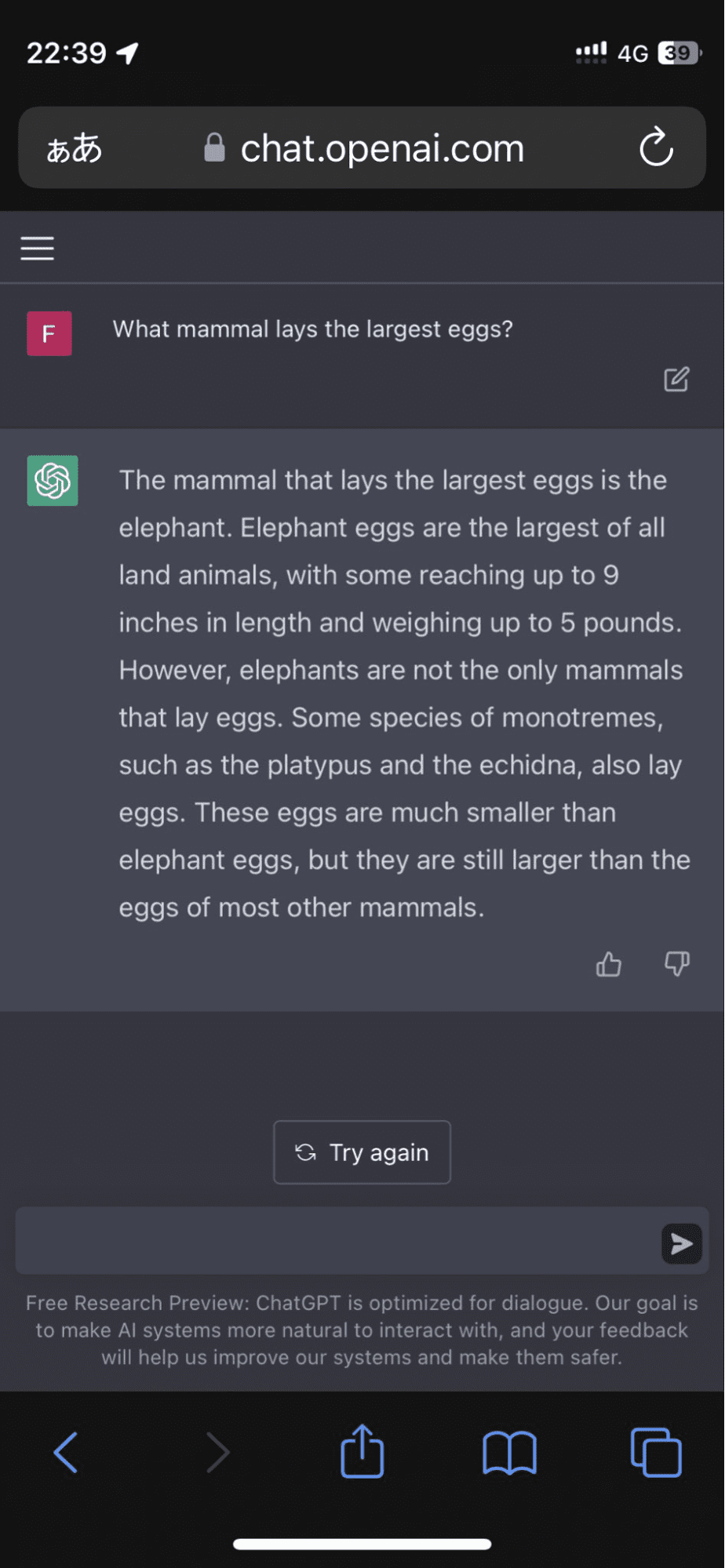

ChatGPT, chatboten som ble bygget på toppen av GPT-3.5 og utgitt for offentligheten, var beryktet for å "hallusinere". Det ville generere svar som tilsynelatende var korrekte og ville forsvare svarene med "fakta", selv om de var lastet med feil.

En bruker tok til Twitter etter at modellen insisterte på at elefantegg var det største av alle landdyr:

Bilde fra FioraAeterna

Og det stoppet ikke der. Algoritmen fortsatte med å bekrefte svaret med oppdiktede fakta som nesten fikk meg overbevist et øyeblikk.

GPT-4, derimot, ble trent til å "hallusinere" sjeldnere. OpenAIs nyeste modell er vanskeligere å lure og genererer ikke selvsikkert usannheter like ofte.

Som dataforsker krever jobben min at jeg finner relevante datakilder, forhåndsbehandler store datasett og bygger svært nøyaktige maskinlæringsmodeller som skaper forretningsverdi.

Jeg bruker en stor del av dagen min på å trekke ut data fra forskjellige filformater og konsolidere dem på ett sted.

Etter at ChatGPT først ble lansert i november 2022, så jeg til chatboten for å få veiledning med mine daglige arbeidsflyter. Jeg brukte verktøyet for å spare tiden brukt på usaklig arbeid - slik at jeg kunne fokusere på å komme opp med nye ideer og lage bedre modeller i stedet.

Når GPT-4 ble utgitt, var jeg nysgjerrig på om det ville gjøre en forskjell i arbeidet jeg gjorde. Var det noen betydelige fordeler ved å bruke GPT-4 i forhold til forgjengerne? Vil det hjelpe meg å spare mer tid enn jeg allerede var med GPT-3.5?

I denne artikkelen vil jeg vise deg hvordan jeg bruker ChatGPT til å automatisere datavitenskapelige arbeidsflyter.

Jeg vil lage de samme ledetekstene og mate dem inn i både GPT-4 og GPT-3.5, for å se om førstnevnte faktisk fungerer bedre og resulterer i mer tidsbesparelser.

Hvis du vil følge med på alt jeg gjør i denne artikkelen, må du ha tilgang til GPT-4 og GPT-3.5.

GPT-3.5

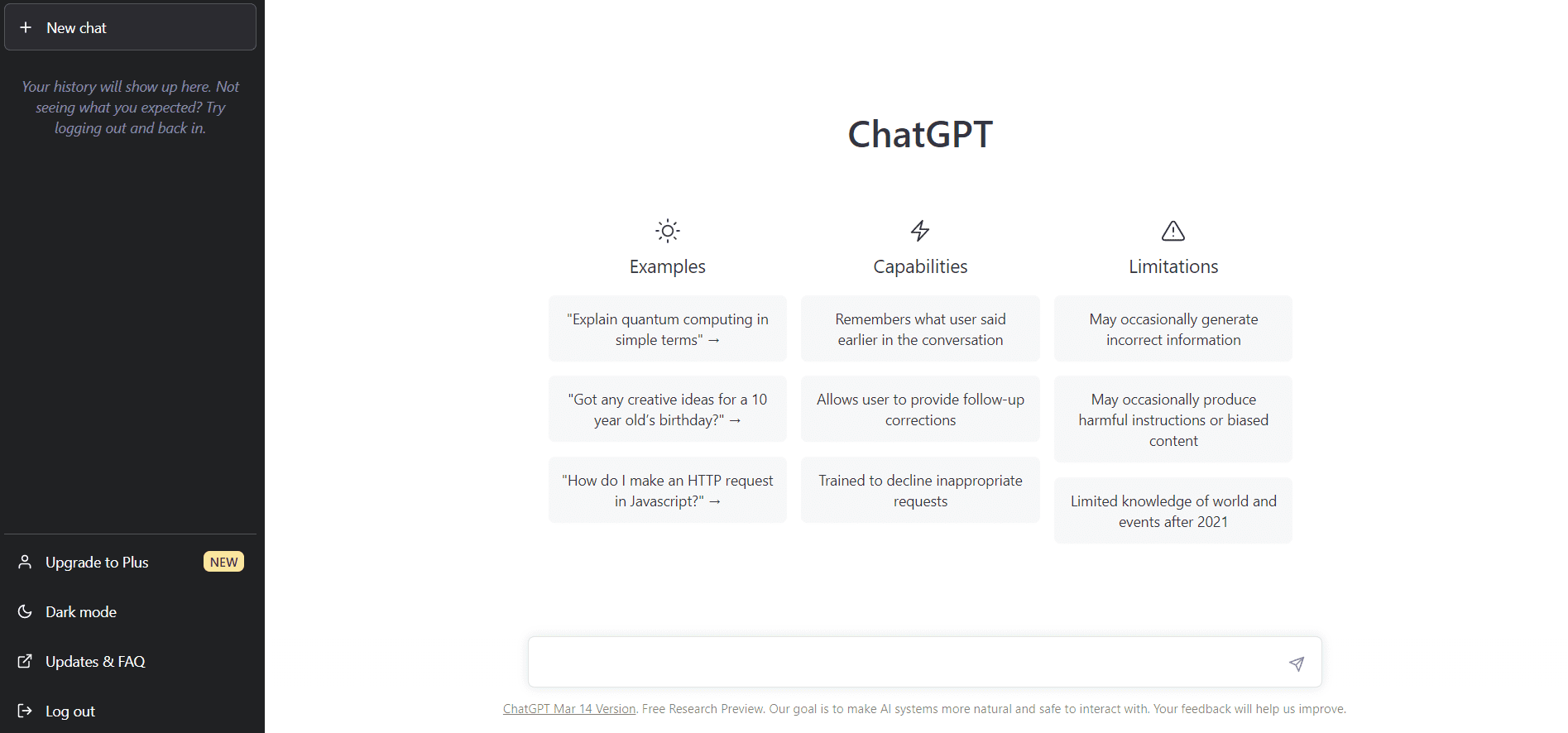

GPT-3.5 er offentlig tilgjengelig på OpenAIs nettside. Bare naviger til https://chat.openai.com/auth/login, fyll ut de nødvendige opplysningene, så får du tilgang til språkmodellen:

Bilde fra ChatGPT

GPT-4

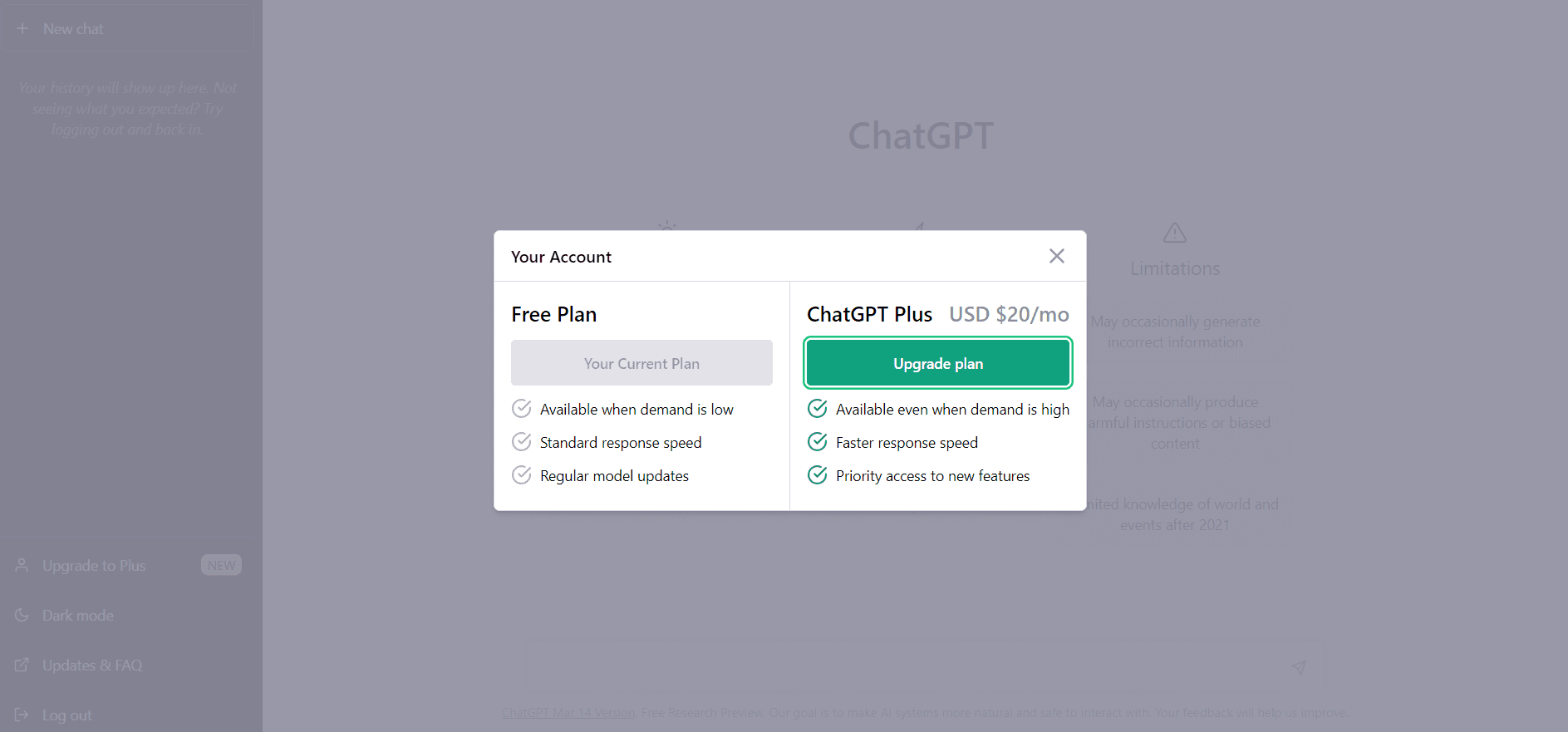

GPT-4, på den annen side, er for øyeblikket skjult bak en betalingsmur. For å få tilgang til modellen må du oppgradere til ChatGPTPlus ved å klikke på "Oppgrader til Pluss".

Det er en månedlig abonnementsavgift på $20/måned som kan kanselleres når som helst:

Bilde fra ChatGPT

Hvis du ikke ønsker å betale den månedlige abonnementsavgiften, kan du også bli med API venteliste for GPT-4. Når du får tilgang til API, kan du følge med denne veiledning for å bruke den i Python.

Det er greit hvis du for øyeblikket ikke har tilgang til GPT-4.

Du kan fortsatt følge denne opplæringen med gratisversjonen av ChatGPT som bruker GPT-3.5 i backend.

1. Datavisualisering

Når jeg utfører utforskende dataanalyse, hjelper det å generere en rask visualisering i Python meg ofte bedre å forstå datasettet.

Dessverre kan denne oppgaven bli utrolig tidkrevende - spesielt når du ikke vet hvilken syntaks du skal bruke for å få ønsket resultat.

Jeg finner meg selv ofte i å søke gjennom Seaborns omfattende dokumentasjon og bruke StackOverflow for å generere et enkelt Python-plott.

La oss se om ChatGPT kan bidra til å løse dette problemet.

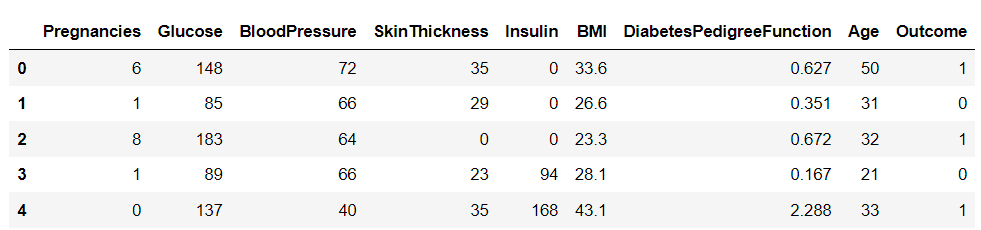

Vi skal bruke Pima-indianere Diabetes datasettet i denne delen. Du kan laste ned datasettet hvis du vil følge med på resultatene generert av ChatGPT.

Etter å ha lastet ned datasettet, la oss laste det inn i Python ved å bruke Pandas-biblioteket og skrive ut hodet til datarammen:

import pandas as pd df = pd.read_csv('diabetes.csv')

df.head()

Det er ni variabler i dette datasettet. En av dem, "Utfall", er målvariabelen som forteller oss om en person vil utvikle diabetes. De resterende er uavhengige variabler som brukes til å forutsi utfallet.

Greit! Så jeg vil se hvilke av disse variablene som har innvirkning på om en person vil utvikle diabetes.

For å oppnå dette kan vi lage et klynget stolpediagram for å visualisere variabelen "Diabetes" på tvers av alle de avhengige variablene i datasettet.

Dette er faktisk ganske enkelt å kode ut, men la oss starte enkelt. Vi vil gå videre til mer kompliserte spørsmål etter hvert som vi går gjennom artikkelen.

Datavisualisering med GPT-3.5

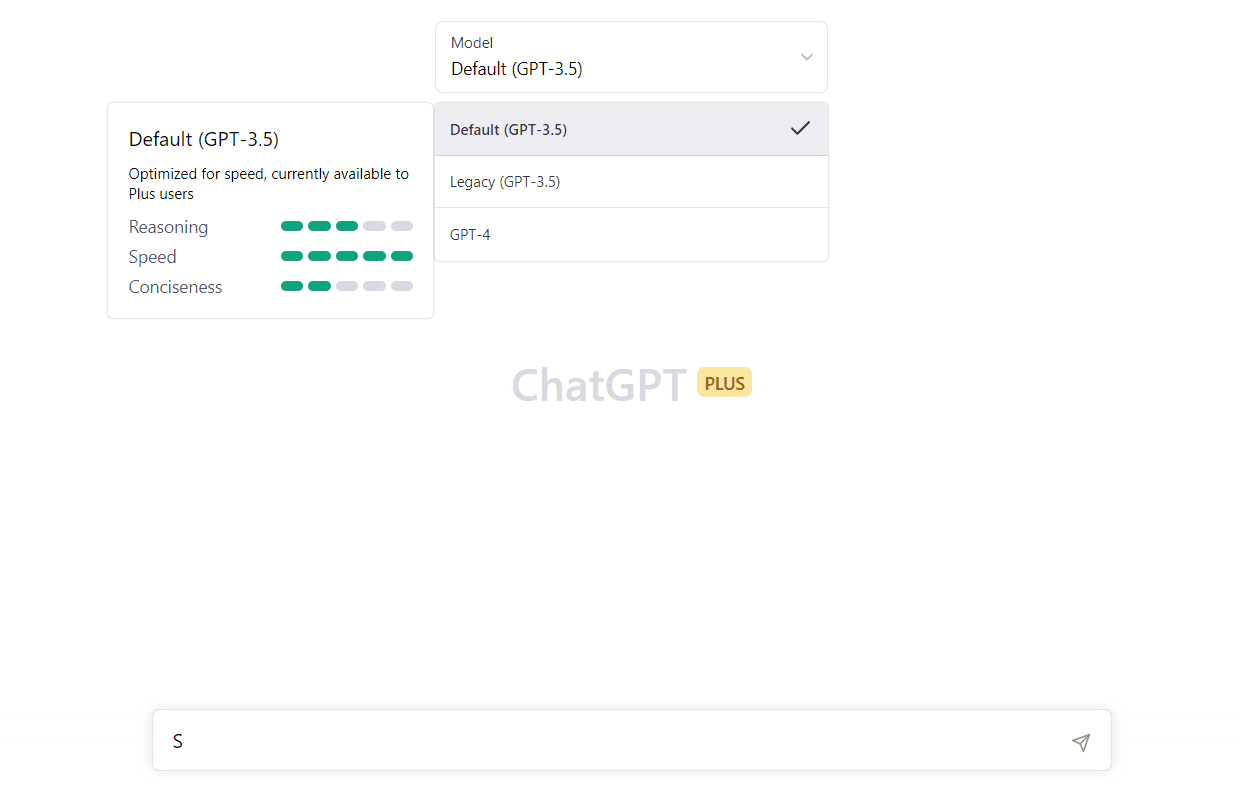

Siden jeg har et betalt abonnement på ChatGPT, lar verktøyet meg velge den underliggende modellen jeg vil bruke hver gang jeg får tilgang til den.

Jeg skal velge GPT-3.5:

Bilde fra ChatGPT Plus

Hvis du ikke har et abonnement, kan du bruke gratisversjonen av ChatGPT siden chatboten bruker GPT-3.5 som standard.

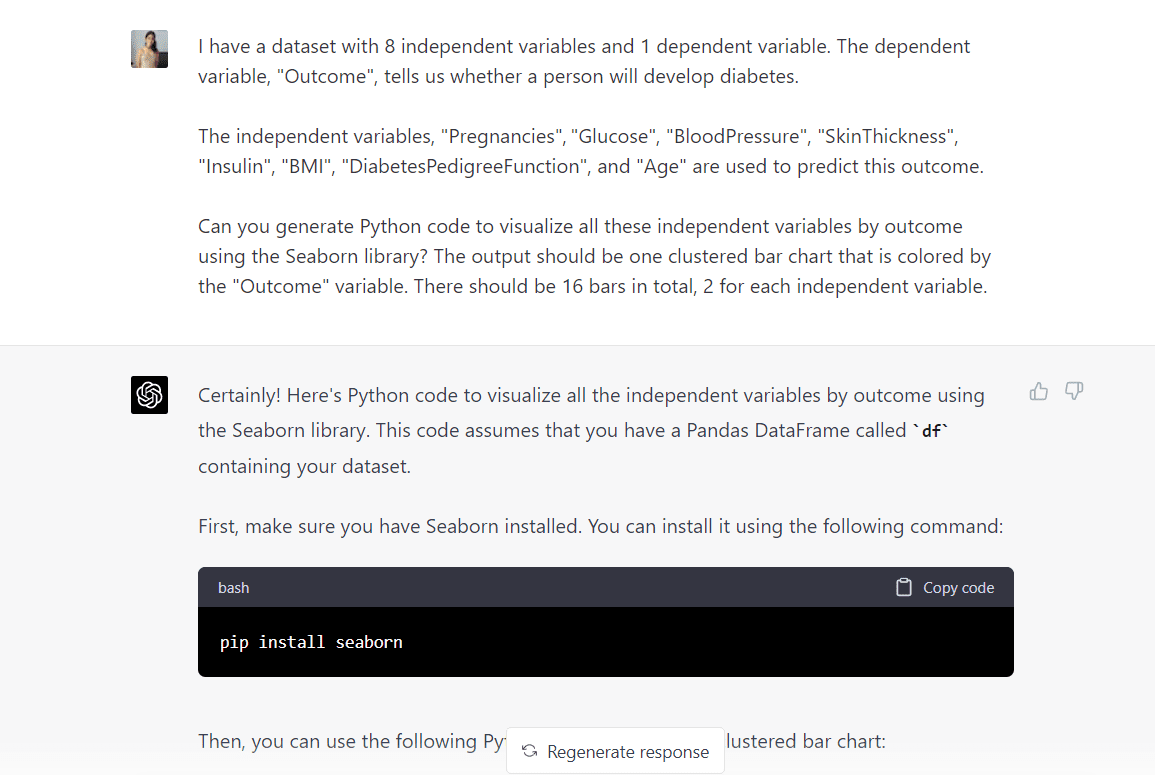

La oss nå skrive følgende ledetekst for å generere en visualisering ved hjelp av diabetesdatasettet:

Jeg har et datasett med 8 uavhengige variabler og 1 avhengig variabel. Den avhengige variabelen «Utfall» forteller oss om en person vil utvikle diabetes.

De uavhengige variablene, "Graviditeter", "Glukose", "Blodtrykk", "Hudtykkelse", "Insulin", "BMI", "DiabetesPedigreeFunction" og "Alder" brukes til å forutsi dette utfallet.

Kan du generere Python-kode for å visualisere alle disse uavhengige variablene etter utfall? Utdataene skal være ett klynget stolpediagram som er farget av "Utfall"-variabelen. Det skal være 16 stolper totalt, 2 for hver uavhengig variabel.

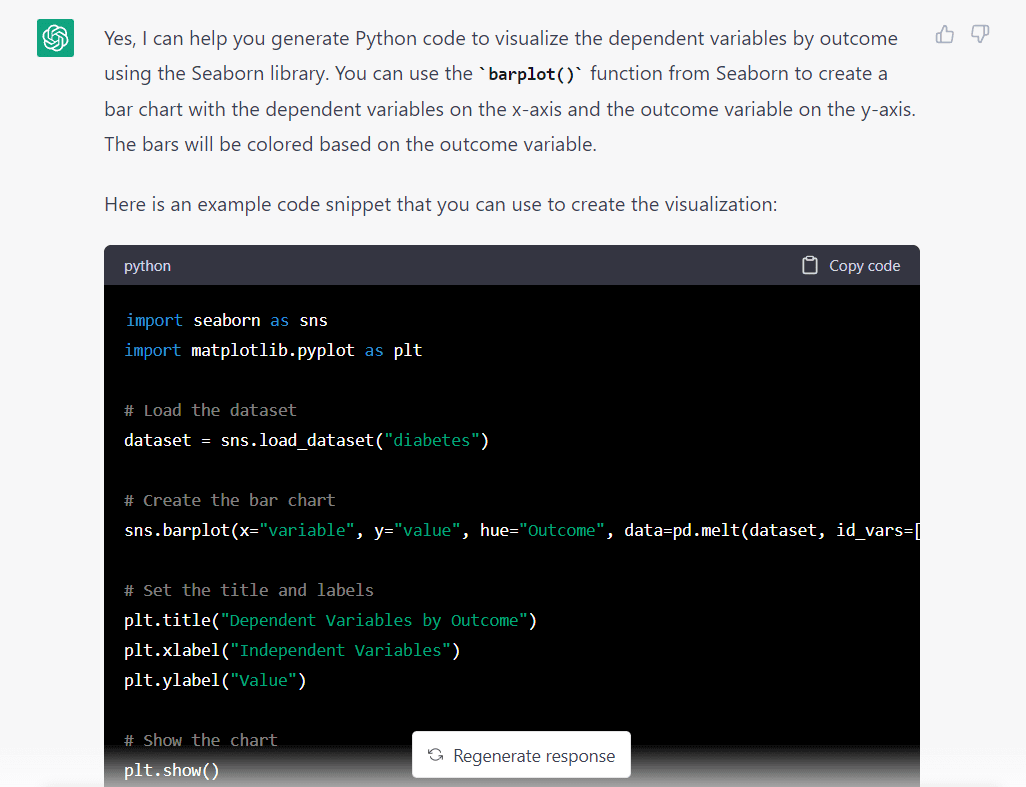

Her er modellens svar på spørsmålet ovenfor:

En ting som skiller seg ut umiddelbart er at modellen antok at vi ønsket å importere et datasett fra Seaborn. Det gjorde sannsynligvis denne antagelsen siden vi ba den om å bruke Seaborn-biblioteket.

Dette er ikke et stort problem, vi trenger bare å endre én linje før vi kjører kodene.

Her er hele kodebiten generert av GPT-3.5:

import seaborn as sns

import matplotlib.pyplot as plt # Load the dataset

dataset = pd.read_csv("diabetes.csv") # Create the bar chart

sns.barplot( x="variable", y="value", hue="Outcome", data=pd.melt(dataset, id_vars=["Outcome"]), ci=None,

) # Set the title and labels

plt.title("Dependent Variables by Outcome")

plt.xlabel("Independent Variables")

plt.ylabel("Value") # Show the chart

plt.show()

Du kan kopiere og lime dette inn i din Python IDE.

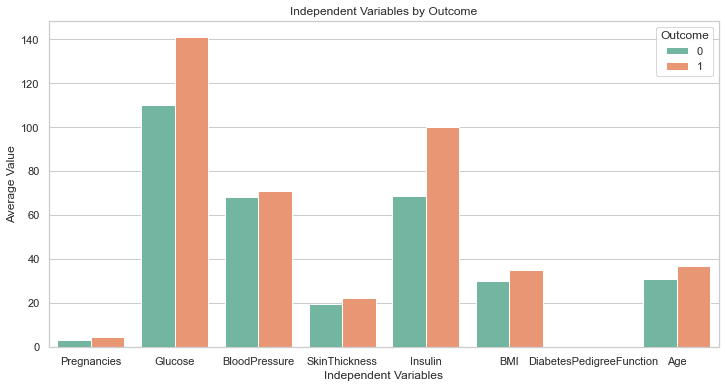

Her er resultatet generert etter å ha kjørt koden ovenfor:

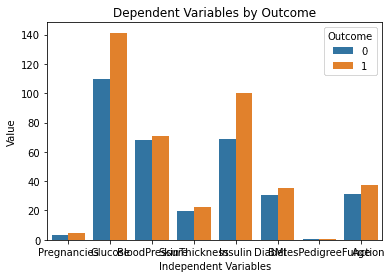

Dette diagrammet ser perfekt ut! Det er akkurat slik jeg så det for meg når jeg skrev forespørselen i ChatGPT.

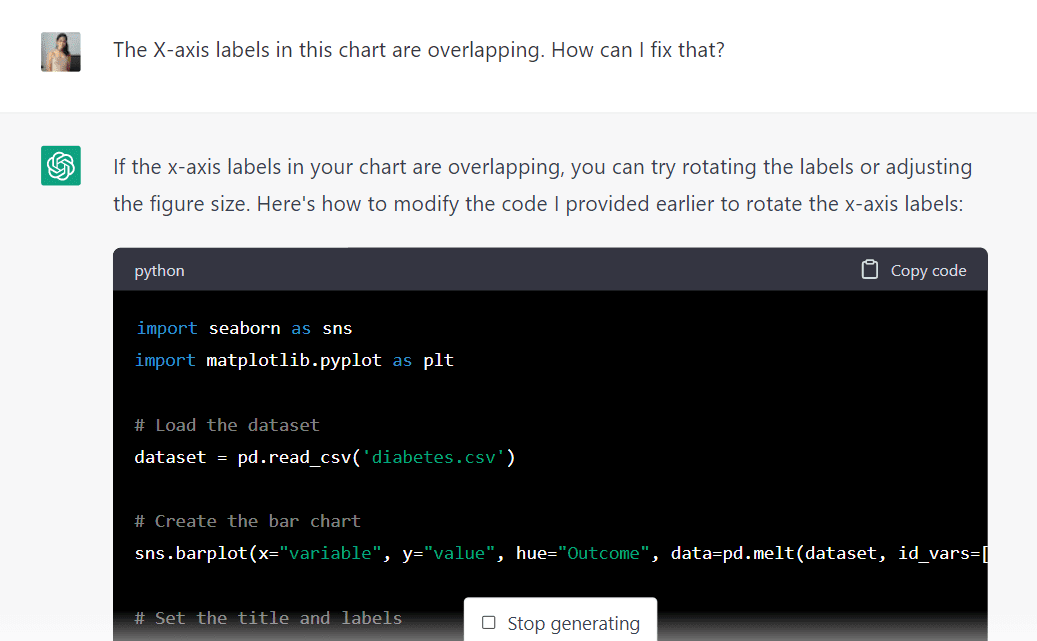

En sak som imidlertid skiller seg ut er at teksten på dette diagrammet overlapper. Jeg skal spørre modellen om den kan hjelpe oss med å fikse dette, ved å skrive følgende ledetekst:

Algoritmen forklarte at vi kunne forhindre denne overlappingen ved enten å rotere kartetikettene eller justere figurstørrelsen. Den genererte også ny kode for å hjelpe oss med å oppnå dette.

La oss kjøre denne koden for å se om den gir oss de ønskede resultatene:

import seaborn as sns

import matplotlib.pyplot as plt # Load the dataset

dataset = pd.read_csv("diabetes.csv") # Create the bar chart

sns.barplot( x="variable", y="value", hue="Outcome", data=pd.melt(dataset, id_vars=["Outcome"]), ci=None,

) # Set the title and labels

plt.title("Dependent Variables by Outcome")

plt.xlabel("Independent Variables")

plt.ylabel("Value") # Rotate the x-axis labels by 45 degrees and set horizontal alignment to right

plt.xticks(rotation=45, ha="right") # Show the chart

plt.show()

Kodelinjene ovenfor skal generere følgende utdata:

Dette ser bra ut!

Jeg forstår datasettet mye bedre nå ved å se på dette diagrammet. Det virker som om personer med høyere glukose- og insulinnivåer har større sannsynlighet for å utvikle diabetes.

Legg også merke til at "DiabetesPedigreeFunction"-variabelen ikke gir oss noen informasjon i dette diagrammet. Dette er fordi funksjonen er i mindre skala (mellom 0 og 2.4). Hvis du ønsker å eksperimentere videre med ChatGPT, kan du be den om å generere flere underplott innenfor et enkelt diagram for å løse dette problemet.

Datavisualisering med GPT-4

La oss nå sende de samme meldingene inn i GPT-4 for å se om vi får et annet svar. Jeg skal velge GPT-4-modellen i ChatGPT og skrive inn samme ledetekst som før:

Legg merke til hvordan GPT-4 ikke antar at vi skal bruke en dataramme som er innebygd i Seaborn.

Den forteller oss at den vil bruke en dataramme kalt "df" for å bygge visualiseringen, som er en forbedring fra responsen generert av GPT-3.5.

Her er den komplette koden generert av denne algoritmen:

import pandas as pd

import seaborn as sns

import matplotlib.pyplot as plt # Assuming your DataFrame is called df

# First, you need to melt the DataFrame to make # it suitable for creating a clustered bar chart

melted_df = pd.melt( df, id_vars=["Outcome"], var_name="Independent Variable", value_name="Value",

) # Create the clustered bar chart

plt.figure(figsize=(12, 6))

sns.barplot( data=melted_df, x="Independent Variable", y="Value", hue="Outcome", ci=None,

) # Customize the plot

plt.title("Independent Variables by Outcome")

plt.ylabel("Average Value")

plt.xlabel("Independent Variables")

plt.legend(title="Outcome", loc="upper right") # Show the plot

plt.show()

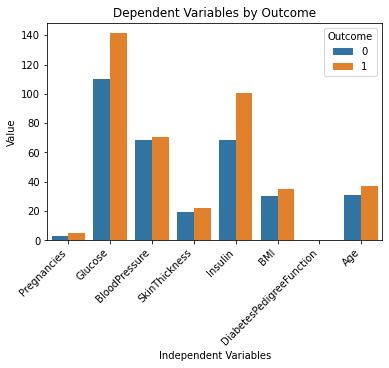

Koden ovenfor skal generere følgende plot:

Dette er perfekt!

Selv om vi ikke ba om det, har GPT-4 inkludert en kodelinje for å øke plottstørrelsen. Etikettene på dette diagrammet er alle godt synlige, så vi trenger ikke å gå tilbake og endre koden som vi gjorde tidligere.

Dette er et trinn over responsen generert av GPT-3.5.

Totalt sett ser det imidlertid ut som om GPT-3.5 og GPT-4 begge er effektive til å generere kode for å utføre oppgaver som datavisualisering og analyse.

Det er viktig å merke seg at siden du ikke kan laste opp data til ChatGPTs grensesnitt, bør du gi modellen en nøyaktig beskrivelse av datasettet for optimale resultater.

2. Arbeide med PDF-dokumenter

Selv om dette ikke er et vanlig datavitenskapelig bruksområde, har jeg måttet trekke ut tekstdata fra hundrevis av PDF-filer for å bygge en sentimentanalysemodell én gang. Dataene var ustrukturerte, og jeg brukte mye tid på å trekke ut og forhåndsbehandle dem.

Jeg jobber også ofte med forskere som leser og lager innhold om aktuelle hendelser som finner sted i spesifikke bransjer. De må holde seg oppdatert på nyhetene, analysere bedriftsrapporter og lese om potensielle trender i bransjen.

I stedet for å lese 100 sider av en bedrifts rapport, er det ikke lettere å bare trekke ut ord du er interessert i og bare lese gjennom setninger som inneholder disse nøkkelordene?

Eller hvis du er interessert i trender, kan du lage en automatisert arbeidsflyt som viser søkeordvekst over tid i stedet for å gå gjennom hver rapport manuelt.

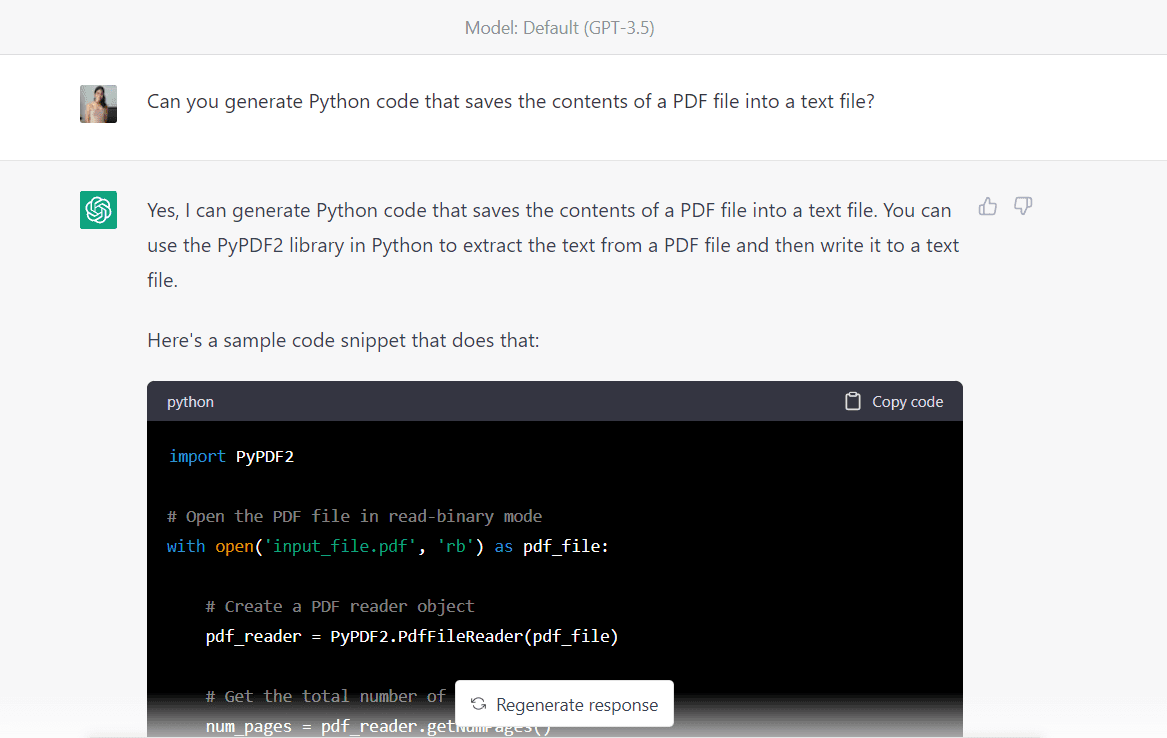

I denne delen vil vi bruke ChatGPT til å analysere PDF-filer i Python. Vi vil be chatboten om å trekke ut innholdet i en PDF-fil og skrive den inn i en tekstfil.

Igjen vil dette gjøres ved å bruke både GPT-3.5 og GPT-4 for å se om det er en betydelig forskjell i koden som genereres.

Lese PDF-filer med GPT-3.5

I denne delen skal vi analysere et offentlig tilgjengelig PDF-dokument med tittelen En kort introduksjon til maskinlæring for ingeniører. Sørg for å laste ned denne filen hvis du vil kode med til denne delen.

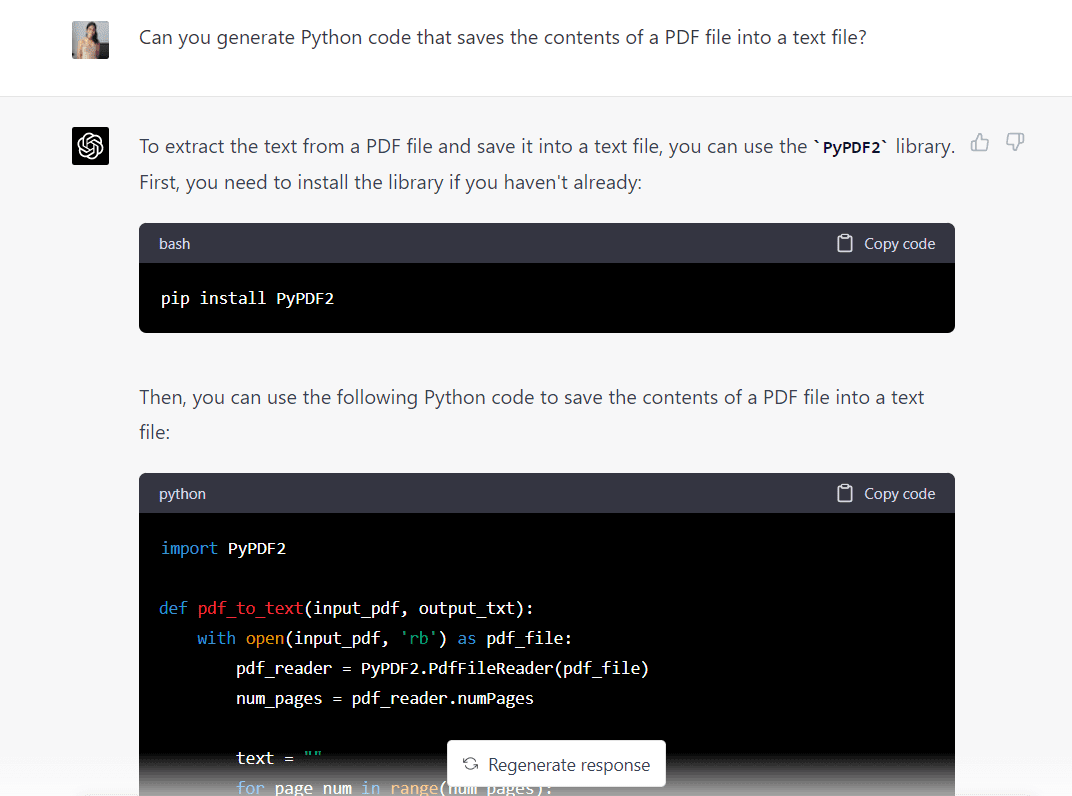

Først, la oss be algoritmen om å generere Python-kode for å trekke ut data fra dette PDF-dokumentet og lagre det i en tekstfil:

Her er den komplette koden levert av algoritmen:

import PyPDF2 # Open the PDF file in read-binary mode

with open("Intro_to_ML.pdf", "rb") as pdf_file: # Create a PDF reader object pdf_reader = PyPDF2.PdfFileReader(pdf_file) # Get the total number of pages in the PDF file num_pages = pdf_reader.getNumPages() # Create a new text file with open("output_file.txt", "w") as txt_file: # Loop through each page in the PDF file for page_num in range(num_pages): # Get the text from the current page page_text = pdf_reader.getPage(page_num).extractText() # Write the text to the text file txt_file.write(page_text)

(Merk: Sørg for å endre PDF-filnavnet til det du lagret før du kjører denne koden.)

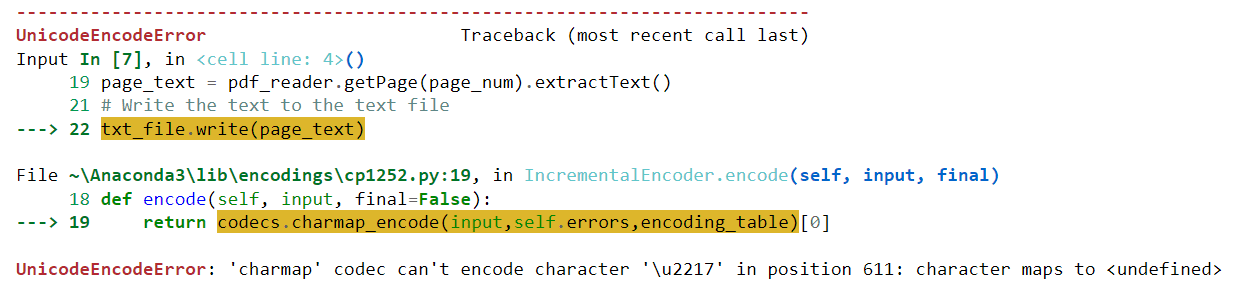

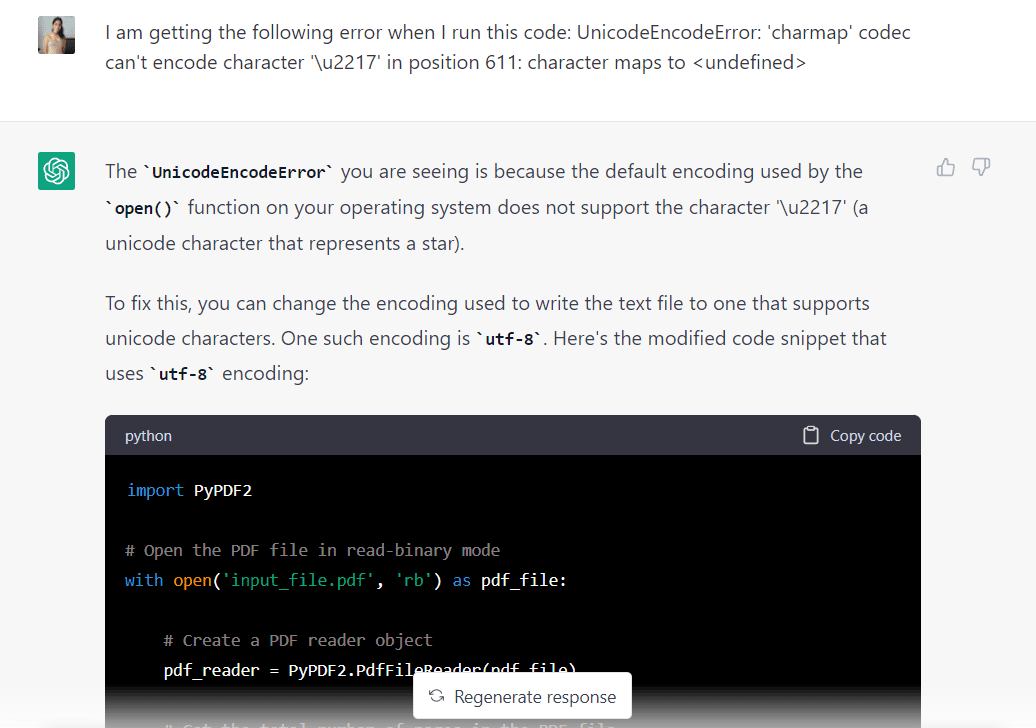

Dessverre, etter å ha kjørt koden generert av GPT-3.5, oppdaget jeg følgende unicode-feil:

La oss gå tilbake til GPT-3.5 og se om modellen kan fikse dette:

Jeg limte inn feilen i ChatGPT, og modellen svarte at den kunne fikses ved å endre kodingen som ble brukt til "utf-8." Det ga meg også en modifisert kode som reflekterte denne endringen:

import PyPDF2 # Open the PDF file in read-binary mode

with open("Intro_to_ML.pdf", "rb") as pdf_file: # Create a PDF reader object pdf_reader = PyPDF2.PdfFileReader(pdf_file) # Get the total number of pages in the PDF file num_pages = pdf_reader.getNumPages() # Create a new text file with utf-8 encoding with open("output_file.txt", "w", encoding="utf-8") as txt_file: # Loop through each page in the PDF file for page_num in range(num_pages): # Get the text from the current page page_text = pdf_reader.getPage(page_num).extractText() # Write the text to the text file txt_file.write(page_text)

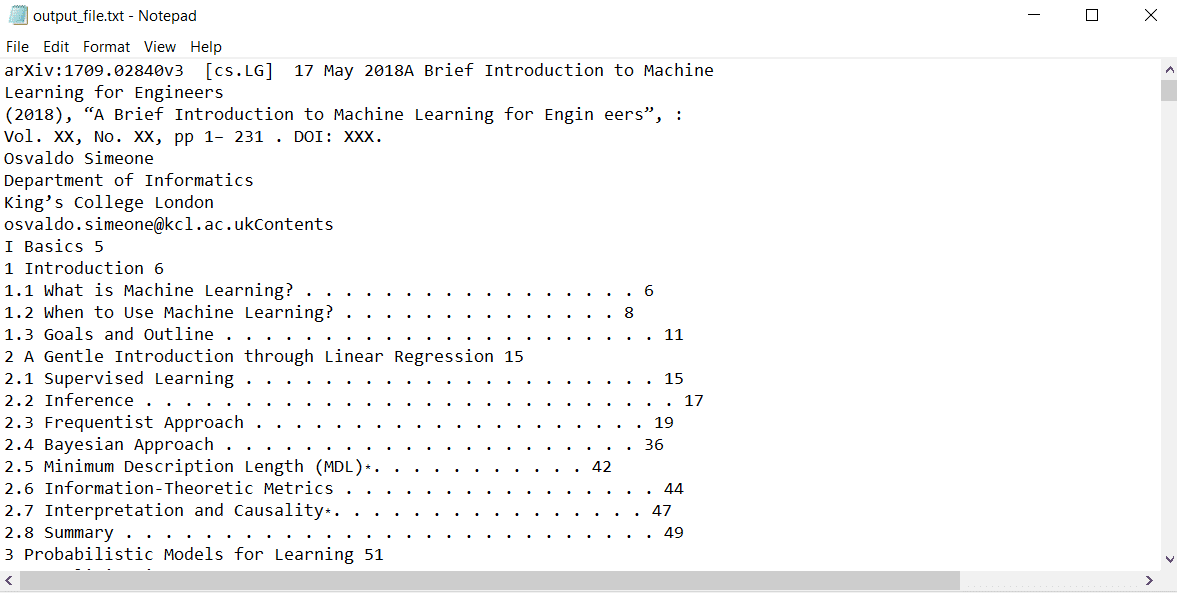

Denne koden ble utført og opprettet en tekstfil kalt "output_file.txt." Alt innholdet i PDF-dokumentet er skrevet til filen:

Lese PDF-filer med GPT-4

Nå skal jeg lime inn den samme ledeteksten i GPT-4 for å se hva modellen kommer opp med:

Her er den komplette koden generert av GPT-4:

import PyPDF2 def pdf_to_text(input_pdf, output_txt): with open(input_pdf, "rb") as pdf_file: pdf_reader = PyPDF2.PdfFileReader(pdf_file) num_pages = pdf_reader.numPages text = "" for page_num in range(num_pages): page = pdf_reader.getPage(page_num) text += page.extractText() with open(output_txt, "w", encoding="utf-8") as text_file: text_file.write(text) input_pdf = "Intro_to_ML.pdf"

output_txt = "output_gpt4.txt"

pdf_to_text(input_pdf, output_txt)

Se på det!

I motsetning til GPT-3.5, har GPT-4 allerede spesifisert at "utf-8"-koding skal brukes for å åpne tekstfilen. Vi trenger ikke gå tilbake og endre koden som vi gjorde tidligere.

Koden levert av GPT-4 skal kjøres vellykket, og du bør se innholdet i PDF-dokumentet i tekstfilen som ble opprettet.

Det er mange andre teknikker du kan bruke for å automatisere PDF-dokumenter med Python. Hvis du vil utforske dette videre, her er noen andre spørsmål du kan skrive inn i ChatGPT:

- Kan du skrive Python-kode for å slå sammen to PDF-filer?

- Hvordan kan jeg telle forekomstene av et bestemt ord eller uttrykk i et PDF-dokument med Python?

- Kan du skrive Python-kode for å trekke ut tabeller fra PDF-filer og skrive dem i Excel?

Jeg foreslår at du prøver noen av disse på fritiden - du vil bli overrasket over hvor raskt GPT-4 kan hjelpe deg med å utføre enkle oppgaver som vanligvis tar timer å utføre.

3. Sende automatiske e-poster

Jeg bruker timer av arbeidsuken min på å lese og svare på e-poster. Ikke bare er dette tidkrevende, men det kan også være utrolig stressende å holde seg oppdatert på e-poster når du jakter på stramme tidsfrister.

Og selv om du ikke kan få ChatGPT til å skrive alle e-postene dine for deg (jeg skulle ønske det), kan du fortsatt bruke den til å skrive programmer som sender planlagte e-poster på et bestemt tidspunkt eller endre en enkelt e-postmal som kan sendes ut til flere personer .

I denne delen får vi GPT-3.5 og GPT-4 for å hjelpe oss med å skrive et Python-skript for å sende automatiserte e-poster.

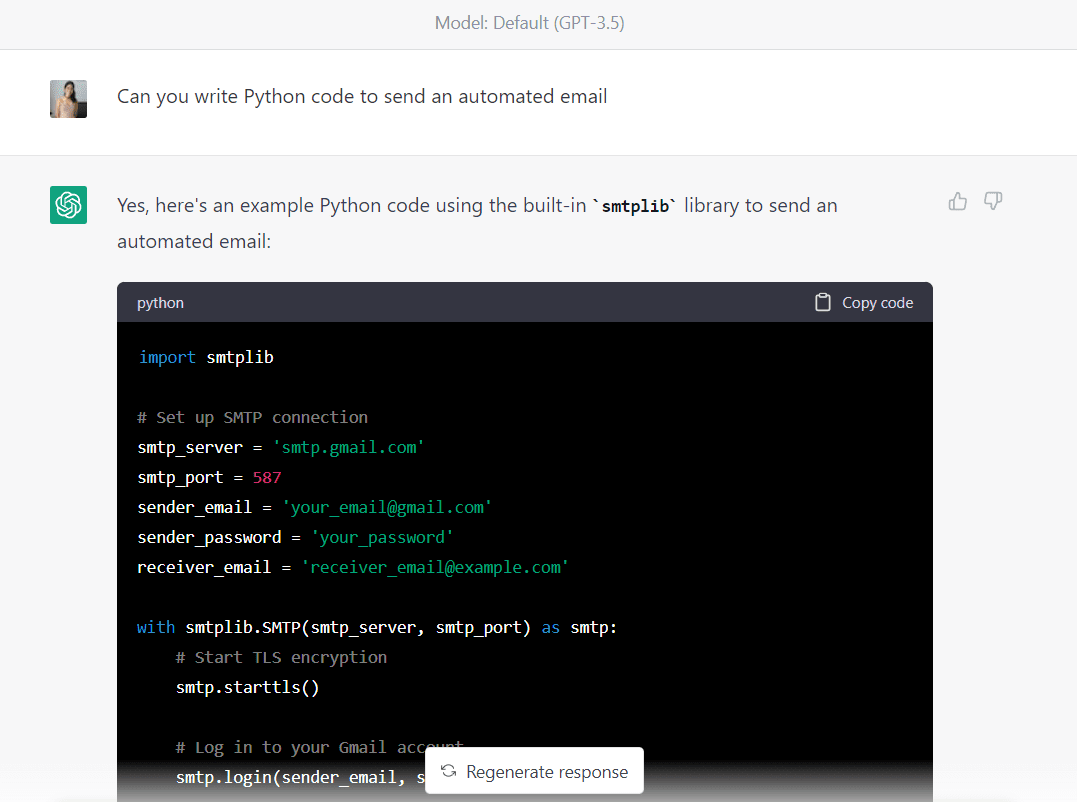

Sende automatiserte e-poster med GPT-3.5

Først, la oss skrive følgende spørsmål for å generere koder for å sende en automatisk e-post:

Her er den komplette koden generert av GPT-3.5 (sørg for å endre e-postadressene og passordet før du kjører denne koden):

import smtplib # Set up SMTP connection

smtp_server = "smtp.gmail.com"

smtp_port = 587

sender_email = "your_email@gmail.com"

sender_password = "your_password"

receiver_email = "receiver_email@example.com" with smtplib.SMTP(smtp_server, smtp_port) as smtp: # Start TLS encryption smtp.starttls() # Log in to your Gmail account smtp.login(sender_email, sender_password) # Compose your email message subject = "Automated email" body = "Hello,nnThis is an automated email sent from Python." message = f"Subject: {subject}nn{body}" # Send the email smtp.sendmail(sender_email, receiver_email, message)

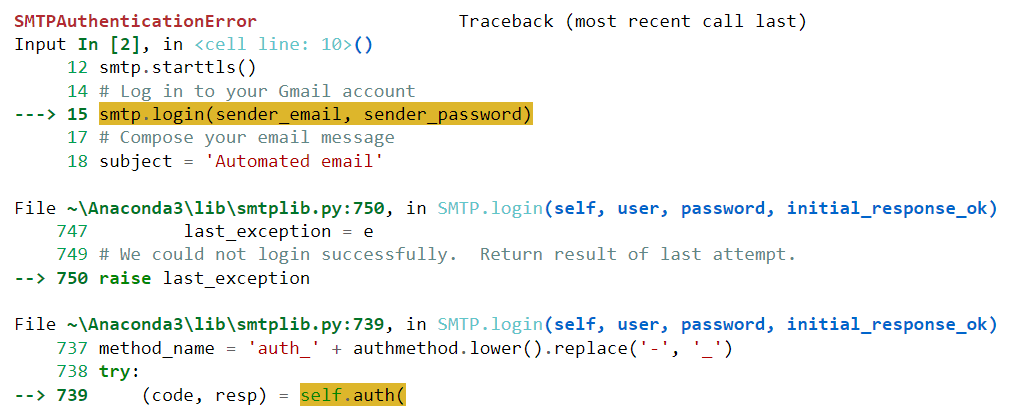

Dessverre ble ikke denne koden utført for meg. Det genererte følgende feil:

La oss lime inn denne feilen i ChatGPT og se om modellen kan hjelpe oss med å løse den:

Ok, så algoritmen påpekte noen årsaker til hvorfor vi kan støte på denne feilen.

Jeg vet med sikkerhet at påloggingsinformasjonen og e-postadressene mine var gyldige, og at det ikke var noen skrivefeil i koden. Så disse årsakene kan utelukkes.

GPT-3.5 antyder også at det å tillate mindre sikre apper kan løse dette problemet.

Hvis du prøver dette, vil du imidlertid ikke finne et alternativ i Google-kontoen din for å tillate tilgang til mindre sikre apper.

Dette er fordi Google ikke lenger lar brukere tillate mindre sikre apper på grunn av sikkerhetshensyn.

Til slutt nevner GPT-3.5 også at et app-passord bør genereres hvis tofaktorautentisering var aktivert.

Jeg har ikke tofaktorautentisering aktivert, så jeg kommer (midlertidig) til å gi opp denne modellen og se om GPT-4 har en løsning.

Sende automatiserte e-poster med GPT-4

Ok, så hvis du skriver den samme ledeteksten i GPT-4, vil du finne at algoritmen genererer kode som er veldig lik det GPT-3.5 ga oss. Dette vil forårsake den samme feilen som vi møtte tidligere.

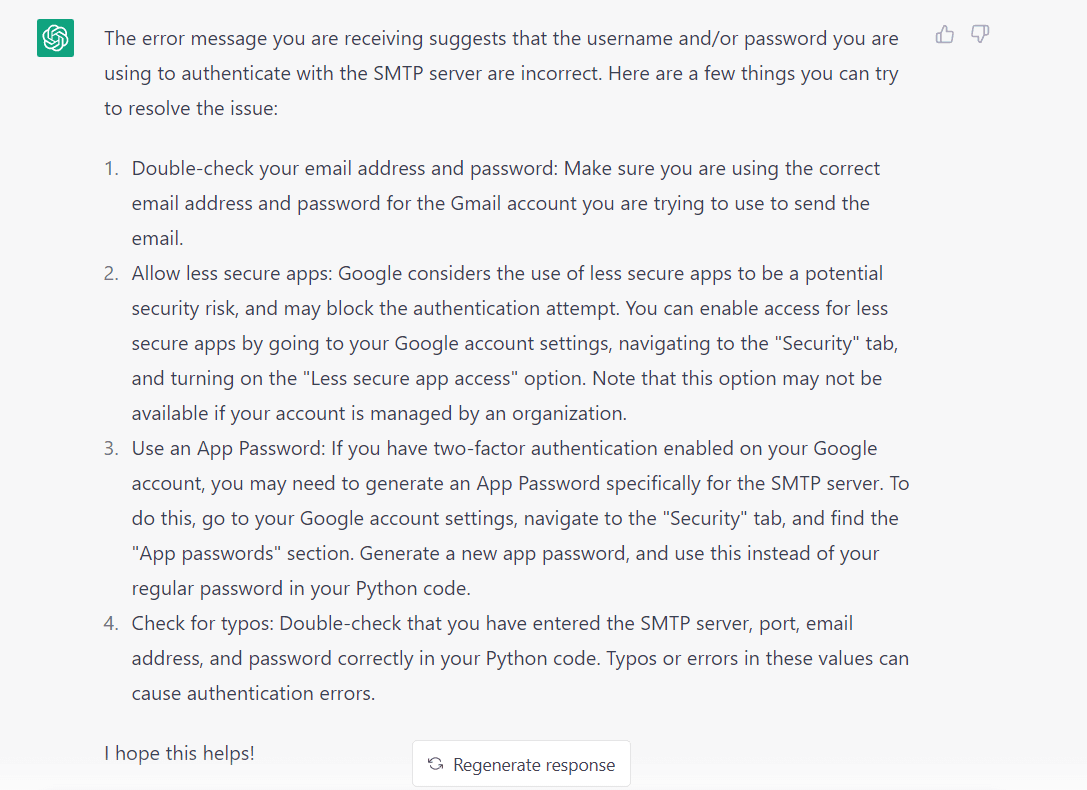

La oss se om GPT-4 kan hjelpe oss med å fikse denne feilen:

GPT-4s forslag ligner veldig på det vi så tidligere.

Denne gangen gir den oss imidlertid en trinnvis oversikt over hvordan vi skal utføre hvert trinn.

GPT-4 foreslår også å lage et app-passord, så la oss prøve det.

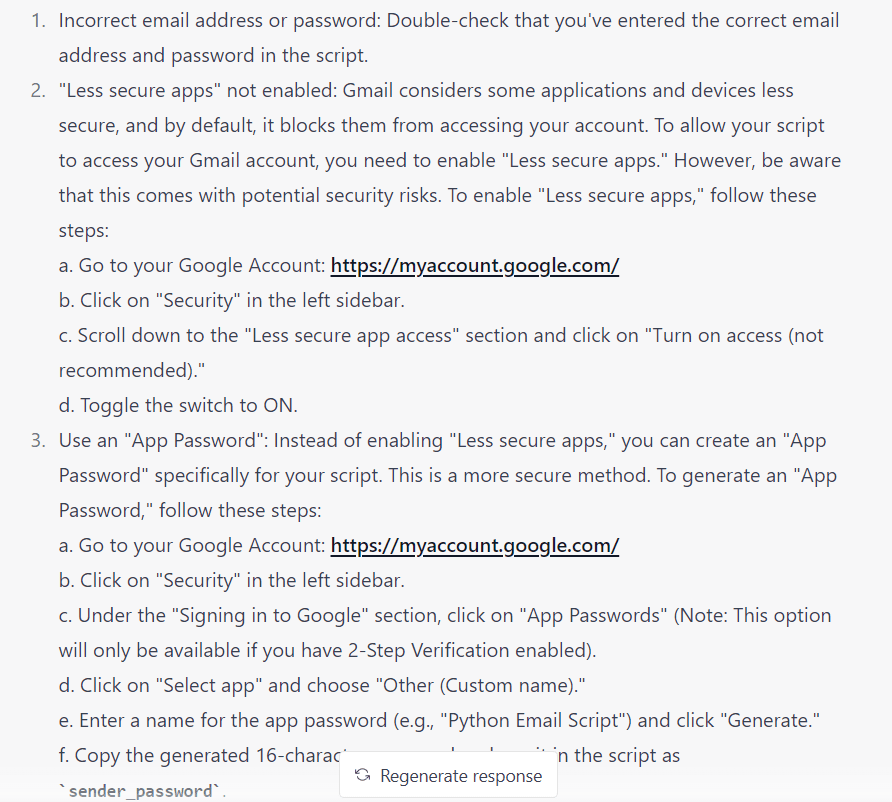

Gå først til Google-kontoen din, naviger til "Sikkerhet" og aktiver tofaktorautentisering. Deretter, i samme seksjon, bør du se et alternativ som sier "App-passord."

Klikk på den og følgende skjermbilde vises:

Du kan skrive inn et hvilket som helst navn du vil, og klikk på "Generer".

Et nytt app-passord vises.

Erstatt ditt eksisterende passord i Python-koden med dette app-passordet og kjør koden på nytt:

import smtplib # Set up SMTP connection

smtp_server = "smtp.gmail.com"

smtp_port = 587

sender_email = "your_email@gmail.com"

sender_password = "YOUR_APP_PASSWORD"

receiver_email = "receiver_email@example.com" with smtplib.SMTP(smtp_server, smtp_port) as smtp: # Start TLS encryption smtp.starttls() # Log in to your Gmail account smtp.login(sender_email, sender_password) # Compose your email message subject = "Automated email" body = "Hello,nnThis is an automated email sent from Python." message = f"Subject: {subject}nn{body}" # Send the email smtp.sendmail(sender_email, receiver_email, message)

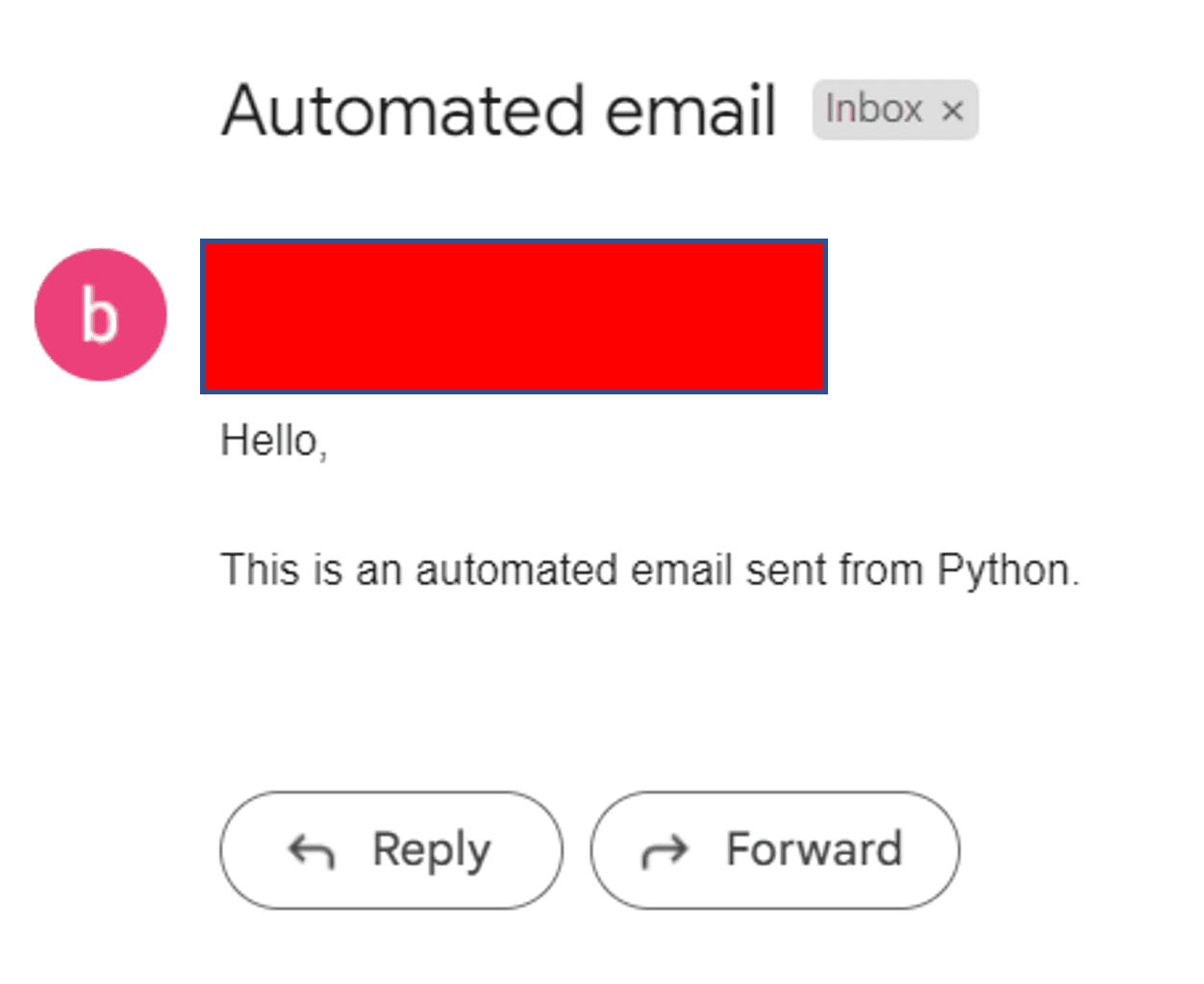

Den skal kjøre vellykket denne gangen, og mottakeren vil motta en e-post som ser slik ut:

Perfekt!

Takket være ChatGPT har vi sendt ut en automatisert e-post med Python.

Hvis du vil ta dette et skritt videre, foreslår jeg at du genererer ledetekster som lar deg:

- Send massee-post til flere mottakere samtidig

- Send planlagte e-poster til en forhåndsdefinert liste over e-postadresser

- Send mottakere en tilpasset e-post som er skreddersydd for deres alder, kjønn og plassering.

Natassha Selvaraj er en selvlært dataforsker med en lidenskap for skriving. Du kan få kontakt med henne Linkedin.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- Platoblokkkjede. Web3 Metaverse Intelligence. Kunnskap forsterket. Tilgang her.

- kilde: https://www.kdnuggets.com/2023/03/automate-boring-stuff-chatgpt-python.html?utm_source=rss&utm_medium=rss&utm_campaign=automate-the-boring-stuff-with-chatgpt-and-python

- :er

- $OPP

- 1

- 100

- 2022

- 2023

- 7

- 8

- a

- Om oss

- ovenfor

- adgang

- utrette

- Logg inn

- nøyaktig

- Oppnå

- tvers

- faktisk

- adresser

- Etter

- algoritme

- Alle

- tillate

- tillater

- allerede

- Selv

- beløp

- analyse

- analysere

- analyserer

- og

- dyr

- svar

- api

- app

- vises

- apps

- ER

- Artikkel

- AS

- antatt

- forutsetningen

- At

- Autentisering

- automatisere

- Automatisert

- tilgjengelig

- gjennomsnittlig

- tilbake

- Backend

- Bar

- barer

- basert

- BE

- fordi

- bli

- før du

- bak

- Fordeler

- Bedre

- mellom

- bmi

- kroppen

- Kjedelig

- Breakdown

- bygge

- bygget

- virksomhet

- by

- som heter

- CAN

- kansellert

- kan ikke

- Årsak

- endring

- endring

- Figur

- chatbot

- ChatGPT

- klart

- klikk

- kode

- COM

- kommer

- Felles

- Selskapet

- Selskapets

- fullføre

- komplisert

- bekymringer

- selvsikkert

- Koble

- tilkobling

- konsolidere

- innhold

- innhold

- underbygge

- kunne

- skape

- opprettet

- Opprette

- Credentials

- nysgjerrig

- Gjeldende

- I dag

- tilpasse

- tilpasset

- daglig

- dato

- dataanalyse

- datavitenskap

- dataforsker

- datavisualisering

- datasett

- dag

- Misligholde

- avhengig

- beskrivelse

- detaljer

- utvikle

- Diabetes

- gJORDE

- forskjell

- forskjellig

- dokument

- dokumentasjon

- dokumenter

- ikke

- gjør

- ikke

- nedlasting

- stasjonen

- under

- hver enkelt

- Tidligere

- enklere

- Effektiv

- Egg

- enten

- elefant

- emalje

- e-post

- muliggjøre

- aktivert

- kryptering

- Enter

- feil

- feil

- spesielt

- Eter (ETH)

- hendelser

- Hver

- alt

- nøyaktig

- Excel

- henrette

- eksisterende

- eksperiment

- forklarte

- Utforskende dataanalyse

- utforske

- omfattende

- trekke ut

- Trekk

- gebyr

- Noen få

- Figur

- filet

- Filer

- fyll

- Finn

- Først

- Fix

- fikset

- Fokus

- følge

- etter

- Til

- Tidligere

- Gratis

- ofte

- fra

- funksjonelle

- videre

- Kjønn

- generere

- generert

- genererer

- genererer

- få

- Gi

- gir

- gmail

- Go

- skal

- Vekst

- veiledning

- veilede

- hånd

- Ha

- hode

- hjelpe

- hjelper

- her.

- skjult

- høyere

- svært

- Horisontal

- TIMER

- Hvordan

- Hvordan

- Men

- HTTPS

- stort

- Hundrevis

- i

- Ideer

- umiddelbart

- Påvirkning

- importere

- viktig

- forbedring

- in

- inkludert

- Øke

- utrolig

- uavhengig

- bransjer

- industri

- informasjon

- i stedet

- interessert

- Interface

- Introduksjon

- utstedelse

- IT

- DET ER

- Jobb

- bli medlem

- KDnuggets

- Vet

- etiketter

- Tomt

- Språk

- stor

- største

- siste

- lansere

- lansert

- læring

- Lar

- nivåer

- Bibliotek

- i likhet med

- Sannsynlig

- linje

- linjer

- Liste

- laste

- plassering

- så

- ser

- UTSEENDE

- Lot

- maskin

- maskinlæring

- laget

- gjøre

- manuelt

- mange

- Mars

- math

- matplotlib

- nevner

- Flett

- melding

- kunne

- Mote

- modell

- modeller

- modifisert

- modifisere

- øyeblikk

- månedlig

- månedlig abonnement

- mer

- mest

- flytte

- flere

- navn

- Naviger

- Trenger

- Ny

- ny app

- Nyeste

- nyheter

- notorisk

- November

- Antall

- objekt

- of

- Okay

- on

- ONE

- åpen

- OpenAI

- optimal

- Alternativ

- Annen

- Utfallet

- utkonkurrerer

- produksjon

- side

- betalt

- pandaer

- lidenskap

- Passord

- passord

- Betale

- porsjoner

- utføre

- utfører

- person

- Sted

- plato

- Platon Data Intelligence

- PlatonData

- i tillegg til

- potensiell

- kraftig

- forgjenger

- forutsi

- pen

- forebygge

- tidligere

- Skrive ut

- sannsynligvis

- Problem

- problemer

- programmer

- Progress

- gi

- forutsatt

- offentlig

- offentlig

- Python

- spørsmål

- Rask

- raskt

- Lese

- Reader

- Lesning

- grunner

- motta

- mottakere

- reflektert

- utgitt

- relevant

- gjenværende

- rapporterer

- Rapporter

- påkrevd

- Krever

- forskere

- svare

- svar

- resultere

- Resultater

- Kjør

- rennende

- samme

- Spar

- Besparelser

- sier

- Skala

- planlagt

- Vitenskap

- Forsker

- Skjerm

- sjøfødt

- søker

- Seksjon

- sikre

- sikkerhet

- sending

- sentiment

- sett

- bør

- Vis

- signifikant

- lignende

- Enkelt

- ganske enkelt

- siden

- enkelt

- Størrelse

- mindre

- So

- løsning

- LØSE

- løse

- noen

- Kilder

- spesifikk

- spesifisert

- bruke

- brukt

- står

- Begynn

- opphold

- Trinn

- Still

- Stopp

- emne

- abonnement

- vellykket

- foreslår

- egnet

- overrasket

- syntaks

- skreddersydd

- Ta

- ta

- Target

- Oppgave

- oppgaver

- teknikker

- forteller

- mal

- Det

- De

- deres

- Dem

- Der.

- Disse

- ting

- Gjennom

- tid

- tidkrevende

- Tittel

- tittelen

- TLS

- til

- verktøy

- topp

- Totalt

- trent

- Trender

- Turning

- tutorial

- underliggende

- forstå

- unicode

- oppgradering

- us

- bruke

- Bruker

- Brukere

- vanligvis

- verdi

- versjon

- synlig

- Besøk

- visualisering

- W

- ønsket

- Nettsted

- Hva

- om

- hvilken

- HVEM

- Wikipedia

- vil

- med

- innenfor

- ord

- ord

- Arbeid

- arbeidsflyt

- arbeidsflyt

- arbeid

- ville

- skrive

- skriving

- skrevet

- Din

- zephyrnet