Bilde generert med Leonardo.Ai

I dette enorme landskapet av kunstig intelligens dukket det opp en revolusjonerende kraft i form av store språkmodeller (LLMS). Det er ikke bare et moteord, men vår fremtid. Deres evne til å forstå og generere menneskelignende tekst brakte dem i søkelyset, og nå har det blitt et av de hotteste forskningsområdene. Se for deg en chatbot som kan svare deg som om du snakker med vennene dine eller ser for deg et innholdsgenereringssystem som det blir vanskelig å skille mellom om det er skrevet av et menneske eller en AI. Hvis ting som dette fascinerer deg og du ønsker å dykke lenger inn i hjertet av LLM-er, er du på rett sted. Jeg har samlet en omfattende liste over ressurser som spenner fra informative artikler, kurs og GitHub-repositorier til relevante forskningsartikler som kan hjelpe deg å forstå dem bedre. Uten ytterligere forsinkelser, la oss kickstarte vår fantastiske reise i LLM-verdenen.

Bilde av Polina Tankilevich på Pexels

1. Dyplæringsspesialisering – Coursera

Link: Deep Learning Specialization

Beskrivelse: Dyp læring danner ryggraden i LLM-er. Dette omfattende kurset undervist av Andrew Ng dekker de essensielle emnene om nevrale nettverk, det grunnleggende om datasyn og naturlig språkbehandling, og hvordan du strukturerer maskinlæringsprosjektene dine.

2. Stanford CS224N: NLP med dyp læring – YouTube

Link: Stanford CS224N: NLP med dyp læring

Beskrivelse: Det er en gullgruve av kunnskap og gir en grundig innføring i banebrytende forskning innen dyp læring for NLP.

3. HuggingFace Transformers Course – HuggingFace

Link: HuggingFace Transformers-kurs

Beskrivelse: Dette kurset lærer NLP ved å bruke biblioteker fra HuggingFace-økosystemet. Den dekker den indre funksjonen og bruken av følgende biblioteker fra HuggingFace:

- transformers

- Tokenizers

- datasett

- Akselerer

4. ChatGPT Prompt Engineering for utviklere – Coursera

Link: ChatGPT prompt ingeniørkurs

Beskrivelse: ChatGPT er en populær LLM, og dette kurset deler de beste praksisene og de grunnleggende prinsippene for å skrive effektive meldinger for bedre responsgenerering.

Bilde generert med Leonardo.Ai

1. LLM University – Cohere

Link: LLM universitet

Beskrivelse: Cohere tilbyr et spesialisert kurs for å mestre LLM-er. Deres sekvensielle spor, som dekker de teoretiske aspektene ved NLP, LLM, og deres arkitektur i detalj, er rettet mot nybegynnere. Deres ikke-sekvensielle vei er for erfarne individer som er mer interessert i de praktiske anvendelsene og brukssakene til disse kraftige modellene i stedet for deres interne arbeid.

2. Stanford CS324: Store språkmodeller – Stanford-nettsted

Link: Stanford CS324: Store språkmodeller

Beskrivelse: Dette kurset dykker dypere inn i vanskelighetene ved disse modellene. Du vil utforske grunnleggende, teori, etikk og praktiske aspekter ved disse modellene, samtidig som du får litt praktisk erfaring.

3. Princeton COS597G: Forstå store språkmodeller – Princeton-nettsted

Link: Forstå store språkmodeller

Beskrivelse: Det er et kurs på høyere nivå som tilbyr en omfattende læreplan, noe som gjør det til et utmerket valg for dybdelæring. Du vil utforske det tekniske grunnlaget, egenskapene og begrensningene til modeller som BERT, GPT, T5-modeller, blanding av ekspertmodeller, gjenfinningsbaserte modeller, etc.

4. ETH Zürich: Store språkmodeller (LLMs) – RycoLab

Link: ETH Zürich: Store språkmodeller

Beskrivelse: Dette nydesignede kurset tilbyr en omfattende utforskning av LLM-er. Dykk ned i sannsynlighetsgrunnlag, nevrale nettverksmodellering, opplæringsprosesser, skaleringsteknikker og kritiske diskusjoner om sikkerhet og potensielt misbruk.

5. Full Stack LLM Bootcamp – The Full Stack

Link: Full Stack LLM Bootcamp

Beskrivelse: Full Stack LLM boot camp er et bransjerelevant kurs som dekker emner som raske ingeniørteknikker, LLM grunnleggende, distribusjonsstrategier og brukergrensesnittdesign, som sikrer at deltakerne er godt forberedt til å bygge og distribuere LLM-applikasjoner.

6. Finjustering av store språkmodeller – Coursera

Link: Finjustering av store språkmodeller

Beskrivelse: Finjustering er teknikken som lar deg tilpasse LLM-er til dine spesifikke behov. Ved å fullføre dette kurset vil du forstå når du skal bruke finjustering, dataforberedelse for finjustering, og hvordan du trener LLM på nye data og evaluerer ytelsen.

Bilde generert med Leonardo.Ai

1. Hva gjør ChatGPT ... og hvorfor fungerer det? – Steven Wolfram

Link: Hva gjør ChatGPT ... og hvorfor fungerer det?

Beskrivelse: Denne korte boken er skrevet av Steven Wolfram, en anerkjent vitenskapsmann. Han diskuterer de grunnleggende aspektene ved ChatGPT, dets opprinnelse i nevrale nett, og dets fremskritt innen transformatorer, oppmerksomhetsmekanismer og naturlig språkbehandling. Det er en utmerket lesning for noen som er interessert i å utforske mulighetene og begrensningene til LLM-er.

2. Forstå store språkmodeller: En transformativ leseliste – Sebastian Raschka

Link: Forstå store språkmodeller: En transformativ leseliste

Beskrivelse: Den inneholder en samling viktige forskningsartikler og gir en kronologisk leseliste, fra tidlige artikler om tilbakevendende nevrale nettverk (RNN) til den innflytelsesrike BERT-modellen og utover. Det er en uvurderlig ressurs for forskere og praktikere å studere utviklingen av NLP og LLM.

3. Artikkelserie: Store språkmodeller – Jay Alammar

Link: Artikkelserie: Store språkmodeller

Beskrivelse: Jay Alammars blogger er en skattekiste av kunnskap for alle som studerer store språkmodeller (LLM) og transformatorer. Bloggene hans skiller seg ut for sin unike blanding av visualiseringer, intuitive forklaringer og omfattende dekning av emnet.

4. Bygge LLM-applikasjoner for produksjon – Chip Huyen

Link: Bygge LLM-applikasjoner for produksjon

Beskrivelse: I denne artikkelen diskuteres utfordringene med å produsere LLM-er. Det gir innsikt i oppgavesammensetning og viser lovende brukstilfeller. Alle som er interessert i praktiske LLM-er vil finne det virkelig verdifullt.

Bilde av RealToughCandy.com på Pexels

1. Awesome-LLM ( 9k ⭐ )

Link: Fantastisk-LLM

Beskrivelse: Det er en kuratert samling av artikler, rammeverk, verktøy, kurs, opplæringsprogrammer og ressurser fokusert på store språkmodeller (LLM), med spesiell vekt på ChatGPT.

2. LLMsPracticalGuide ( 6.9k ⭐ )

Link: De praktiske veiledningene for store språkmodeller

Beskrivelse: Det hjelper utøverne å navigere i det vidstrakte landskapet til LLM-er. Den er basert på spørreundersøkelsen med tittelen: Utnytte kraften til LLM-er i praksis: En undersøkelse om ChatGPT og utover og denne blogg.

3. LLMSurvey ( 6.1k ⭐ )

Link: LLMSurvey

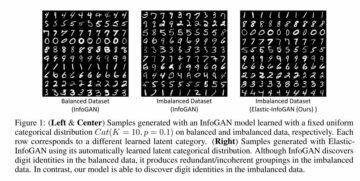

Beskrivelse: Det er en samling av undersøkelsesartikler og ressurser basert på papiret med tittelen: En undersøkelse av store språkmodeller. Den inneholder også en illustrasjon av den tekniske utviklingen av GPT-seriens modeller samt en evolusjonær graf over forskningsarbeidet utført på LLaMA.

4. Awesome Graph-LLM ( 637 ⭐ )

Link: Awesome-Graph-LLM

Beskrivelse: Det er en verdifull kilde for folk som er interessert i skjæringspunktet mellom grafbaserte teknikker og LLM-er. den gir en samling av forskningsartikler, datasett, benchmarks, undersøkelser og verktøy som fordyper seg i dette nye feltet.

5. Awesome Langchain ( 5.4k ⭐ )

Link: fantastisk langkjede

Beskrivelse: LangChain er det raske og effektive rammeverket for LLM-prosjekter, og dette depotet er navet for å spore initiativer og prosjekter relatert til LangChains økosystem.

- "En komplett undersøkelse om ChatGPT i AIGC-æra” – Det er et flott utgangspunkt for nybegynnere i LLM. Den dekker omfattende den underliggende teknologien, applikasjonene og utfordringene til ChatGPT.

- "En undersøkelse av store språkmodeller” – Den dekker de siste fremskrittene innen LLM, spesifikt i de fire hovedaspektene som pre-trening, tilpasningsjustering, utnyttelse og kapasitetsevaluering.

- "Utfordringer og anvendelser av store språkmodeller” – Diskuterer utfordringene til LLM-er og de vellykkede bruksområdene til LLM-er.

- "Oppmerksomhet er alt du trenger” – Transformers fungerer som grunnsteinen for GPT og andre LLM-er, og denne artikkelen introduserer Transformer-arkitekturen.

- "Den merkede transformatoren” – En ressurs fra Harvard University som gir en detaljert og kommentert forklaring av Transformer-arkitekturen, som er grunnleggende for mange LLM-er.

- "Den illustrerte transformatoren” – En visuell guide som hjelper deg å forstå Transformer-arkitekturen i dybden, noe som gjør komplekse konsepter mer tilgjengelige.

- "BERT: Fortrening av Deep Bidirectional Transformers for Language Understanding” – Denne artikkelen introduserer BERT, en svært innflytelsesrik LLM som setter nye standarder for en rekke Natural Language Processing (NLP) oppgaver.

I denne artikkelen har jeg samlet en omfattende liste over ressurser som er avgjørende for å mestre store språkmodeller (LLM). Læring er imidlertid en dynamisk prosess, og kunnskapsdeling står i sentrum. Hvis du har flere ressurser i tankene som du mener bør være en del av denne omfattende listen, ikke nøl med å dele dem i kommentarfeltet. Dine bidrag kan være uvurderlige for andre på deres læringsreise, og skape et interaktivt og samarbeidende rom for kunnskapsberikelse.

Kanwal Mehreen er en ambisiøs programvareutvikler med en stor interesse for datavitenskap og anvendelser av AI i medisin. Kanwal ble valgt som Google Generation Scholar 2022 for APAC-regionen. Kanwal elsker å dele teknisk kunnskap ved å skrive artikler om populære emner, og brenner for å forbedre representasjonen av kvinner i teknologiindustrien.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://www.kdnuggets.com/a-comprehensive-list-of-resources-to-master-large-language-models?utm_source=rss&utm_medium=rss&utm_campaign=a-comprehensive-list-of-resources-to-master-large-language-models

- : har

- :er

- :ikke

- 2022

- 4k

- a

- evne

- Om oss

- tilgjengelig

- tilpasse

- tilpasning

- Ytterligere

- fremskritt

- fremskritt

- AI

- AI i medisin

- aigc

- Alle

- tillater

- også

- utrolig

- an

- og

- Andrew

- andrew ng

- noen

- noen

- APAC

- Søknad

- søknader

- Påfør

- arkitektur

- ER

- områder

- Artikkel

- artikler

- AS

- aspekter

- håper

- At

- oppmerksomhet

- Backbone

- basert

- Grunnleggende

- BE

- bli

- blir

- nybegynnere

- tro

- benchmarks

- BEST

- beste praksis

- Bedre

- Beyond

- Blend

- Blogg

- blogger

- bok

- brakte

- bygge

- Bygning

- men

- buzzword

- by

- Camp

- CAN

- evner

- Kapasitet

- saker

- utfordringer

- chatbot

- ChatGPT

- chip

- valg

- samarbeids

- samling

- kommentere

- fullføre

- fullført

- komplekse

- omfattende

- datamaskin

- Datamaskin syn

- konsepter

- gjennomført

- inneholder

- innhold

- bidragene

- kunne

- kurs

- Coursera

- kurs

- dekning

- dekker

- Opprette

- kritisk

- cs

- kuratert

- Curriculum

- skjærekant

- dato

- Dataklargjøring

- datavitenskap

- datasett

- dyp

- dyp læring

- dypere

- dypelæring

- forsinkelse

- dybden

- utplassere

- distribusjon

- dybde

- utforming

- designet

- detalj

- detaljert

- Utvikler

- utviklere

- vanskelig

- diskutert

- diskusjoner

- skille

- dykk

- gjør

- gjør

- Don

- dynamisk

- Tidlig

- økosystem

- Effektiv

- effektiv

- dukket

- Emery

- vekt

- Ingeniørarbeid

- sikrer

- se for meg

- avgjørende

- etc

- ETH

- ETH Zurich

- etikk

- evaluere

- evaluering

- evolusjon

- utmerket

- ekspansiv

- erfaring

- erfaren

- forklaring

- leting

- utforske

- Utforske

- omfattende

- FAST

- felt

- Finn

- slutt

- fokuserte

- etter

- Til

- Tving

- skjema

- skjemaer

- Fundament

- Foundations

- fire

- Rammeverk

- rammer

- venner

- fra

- fullt

- Full stabel

- fundamental

- Fundamentals

- videre

- framtid

- få

- samlet

- generere

- generert

- generasjonen

- GitHub

- graf

- flott

- veilede

- Guider

- hands-on

- harvard

- Harvard University

- Ha

- he

- Hjerte

- hjelpe

- hjelper

- svært

- hans

- hotteste

- Hvordan

- Hvordan

- Men

- HTML

- http

- HTTPS

- Hub

- Klem ansikt

- menneskelig

- i

- if

- forestille

- viktig

- bedre

- in

- dyptgående

- individer

- industri

- Innflytelsesrik

- informative

- initiativer

- innsikt

- interaktiv

- interesse

- interessert

- Interface

- intern

- kryss

- inn

- forviklinger

- Introduserer

- Introduksjon

- intuitiv

- uvurderlig

- IT

- DET ER

- reise

- jpg

- bare

- KDnuggets

- Keen

- kunnskap

- landskap

- Språk

- stor

- læring

- la

- bibliotekene

- i likhet med

- begrensninger

- Liste

- Llama

- elsker

- maskin

- maskinlæring

- større

- Making

- mange

- Master

- Maste

- Saken

- mekanismer

- medisin

- tankene

- misbruk

- modell

- modellering

- modeller

- mer

- Naturlig

- Naturlig språk

- Natural Language Processing

- Naviger

- behov

- Nets

- nettverk

- nettverk

- neural

- nevrale nettverket

- nevrale nettverk

- Ny

- nylig

- nlp

- nå

- mange

- of

- Tilbud

- on

- ONE

- or

- opprinnelse

- Annen

- andre

- vår

- ut

- Papir

- papirer

- del

- deltakere

- Spesielt

- lidenskapelig

- banen

- Ansatte

- ytelse

- Sted

- plato

- Platon Data Intelligence

- PlatonData

- vær så snill

- Point

- Populær

- potensiell

- makt

- kraftig

- Praktisk

- praktiske anvendelser

- praksis

- praksis

- forberedelse

- Princeton

- prinsipper

- prosess

- Prosesser

- prosessering

- Produksjon

- prosjekter

- lovende

- ledetekster

- gir

- spenner

- heller

- Lese

- Lesning

- virkelig

- nylig

- tilbakevendende

- region

- i slekt

- relevant

- Kjent

- Repository

- representasjon

- forskning

- forskere

- ressurs

- Ressurser

- Svare

- svar

- revolusjonær

- ikke sant

- s

- skalering

- Scholar

- Vitenskap

- Forsker

- Seksjon

- sikkerhet

- valgt

- Serien

- betjene

- sett

- Del

- Aksjer

- Kort

- bør

- Software

- noen

- Noen

- kilde

- Rom

- spesialisert

- spesifikk

- spesielt

- Spotlight

- stable

- stå

- stanford

- Start

- steven

- STONE

- strategier

- struktur

- Studer

- Studerer

- emne

- vellykket

- slik

- Survey /Inspeksjonsfartøy

- system

- T

- snakker

- målrettet

- Oppgave

- oppgaver

- undervist

- tech

- tech industrien

- Teknisk

- teknikk

- teknikker

- Teknologi

- tekst

- enn

- Det

- De

- Grunnleggende

- navet

- verden

- deres

- Dem

- deretter

- teoretiske

- teori

- Disse

- ting

- denne

- tittelen

- til

- verktøy

- temaer

- mot

- spor

- Tog

- Kurs

- transformative

- transformator

- transformers

- trender

- tutorials

- underliggende

- forstå

- forståelse

- unik

- universitet

- bruk

- bruke

- Bruker

- Brukergrensesnitt

- design av brukergrensesnitt

- ved hjelp av

- Verdifull

- enorme

- Ve

- syn

- visuell

- ønsker

- var

- VI VIL

- Hva

- Hva er

- når

- om

- hvilken

- mens

- hvorfor

- vil

- med

- uten

- Dame

- kvinner i teknologi

- Arbeid

- arbeid

- hjemkomsten

- verden

- skrive

- skriving

- skrevet

- du

- Din

- zephyrnet

- Zürich