Dit bericht is geschreven in samenwerking met Greg Benson, hoofdwetenschapper; Aaron Kesler, senior productmanager; en Rich Dill, Enterprise Solutions Architect van SnapLogic.

Veel klanten bouwen generatieve AI-apps op Amazonebodem en Amazon Code Whisperer om codeartefacten te creëren op basis van natuurlijke taal. Deze use case benadrukt hoe grote taalmodellen (LLM's) een vertaler kunnen worden tussen menselijke talen (Engels, Spaans, Arabisch en meer) en door machines interpreteerbare talen (Python, Java, Scala, SQL, enzovoort), samen met geavanceerde interne redenering. Dit opkomende vermogen in LLM's heeft softwareontwikkelaars ertoe aangezet LLM's te gebruiken als een automatiserings- en UX-verbeteringstool die natuurlijke taal omzet in een domeinspecifieke taal (DSL): systeeminstructies, API-verzoeken, codeartefacten en meer. In dit bericht laten we je zien hoe Snaplogica, een AWS-klant, gebruikte Amazon Bedrock om hun SnapGPT product door het geautomatiseerd creëren van deze complexe DSL-artefacten uit menselijke taal.

Wanneer klanten DSL-objecten maken op basis van LLM's, is de resulterende DSL een exacte replica of een afgeleide van bestaande interfacegegevens en -schema's die het contract vormen tussen de gebruikersinterface en de bedrijfslogica in de back-upservice. Dit patroon is vooral populair bij onafhankelijke softwareleveranciers (ISV's) en Software as a Service (SaaS) ISV's vanwege hun unieke manier om configuraties door middel van code weer te geven en de wens om de gebruikerservaring voor hun klanten te vereenvoudigen. Voorbeelden van gebruiksscenario's zijn onder meer:

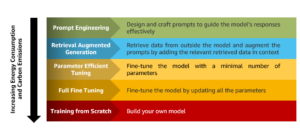

De meest eenvoudige manier om tekst-naar-pipeline-applicaties te bouwen en te schalen met LLM's op AWS is het gebruik van Amazon Bedrock. Amazon Bedrock is de gemakkelijkste manier om generatieve AI-applicaties te bouwen en te schalen met basismodellen (FM's). Het is een volledig beheerde service die via één API toegang biedt tot een keur aan goed presterende basis-FM's van toonaangevende AI, samen met een breed scala aan mogelijkheden die u nodig hebt om generatieve AI-applicaties met privacy en beveiliging te bouwen. Anthropic, een AI-veiligheids- en onderzoekslaboratorium dat betrouwbare, interpreteerbare en bestuurbare AI-systemen bouwt, is een van de toonaangevende AI-bedrijven die toegang biedt tot hun ultramoderne LLM, Claude, op Amazon Bedrock. Claude is een LLM die uitblinkt in een breed scala aan taken, van doordachte dialogen, het maken van inhoud, complex redeneren, creativiteit en coderen. Anthropic biedt zowel Claude- als Claude Instant-modellen aan, die allemaal verkrijgbaar zijn via Amazon Bedrock. Claude heeft snel aan populariteit gewonnen in deze tekst-naar-pipeline-toepassingen vanwege zijn verbeterde redeneervermogen, waardoor hij kan uitblinken in het oplossen van dubbelzinnige technische problemen. Claude 2 op Amazon Bedrock ondersteunt een contextvenster van 100,000 tokens, wat overeenkomt met ongeveer 200 pagina's Engelse tekst. Dit is een bijzonder belangrijke functie waarop u kunt vertrouwen bij het bouwen van tekst-naar-pipeline-applicaties waarvoor complexe redeneringen, gedetailleerde instructies en uitgebreide voorbeelden nodig zijn.

SnapLogic-achtergrond

SnapLogic is een AWS-klant met een missie om bedrijfsautomatisering naar de wereld te brengen. Met het SnapLogic Intelligent Integration Platform (IIP) kunnen organisaties bedrijfsbrede automatisering realiseren door hun hele ecosysteem van applicaties, databases, big data, machines en apparaten, API's en meer te verbinden met vooraf gebouwde, intelligente connectoren die Snaps worden genoemd. SnapLogic heeft onlangs een functie uitgebracht genaamd SnapGPT, dat een tekstinterface biedt waarin u in eenvoudige menselijke taal de gewenste integratiepijplijn kunt typen die u wilt maken. SnapGPT gebruikt het Claude-model van Anthropic via Amazon Bedrock om de creatie van deze integratiepijplijnen als code te automatiseren, die vervolgens worden gebruikt via de vlaggenschipintegratieoplossing van SnapLogic. De reis van SnapLogic naar SnapGPT was echter het hoogtepunt van vele jaren actief zijn in de AI-ruimte.

De AI-reis van SnapLogic

Op het gebied van integratieplatforms loopt SnapLogic consequent voorop en maakt gebruik van de transformerende kracht van kunstmatige intelligentie. Door de jaren heen is de inzet van het bedrijf om te innoveren met AI duidelijk geworden, vooral als we de reis volgen Iris naar Automatisch koppelen.

Het bescheiden begin met Iris

In 2017 onthulde SnapLogic Iris, een eerste AI-aangedreven integratieassistent in de sector. Iris is ontworpen om machine learning-algoritmen (ML) te gebruiken om de volgende stappen bij het bouwen van een datapijplijn te voorspellen. Door miljoenen metadata-elementen en datastromen te analyseren, kon Iris intelligente suggesties doen aan gebruikers, waardoor de data-integratie werd gedemocratiseerd en zelfs mensen zonder een diepgaande technische achtergrond de mogelijkheid kregen om complexe workflows te creëren.

AutoLink: momentum opbouwen

Voortbouwend op het succes en de lessen van Iris introduceerde SnapLogic AutoLink, een functie gericht op het verder vereenvoudigen van het data mapping-proces. De vervelende taak van het handmatig in kaart brengen van velden tussen bron- en doelsystemen werd een fluitje van een cent met AutoLink. Met behulp van AI identificeerde en stelde AutoLink automatisch potentiële matches voor. Integraties die ooit uren in beslag namen, konden in slechts enkele minuten worden uitgevoerd.

De generatieve sprong met SnapGPT

SnapLogic's nieuwste poging op het gebied van AI brengt ons SnapGPT, dat tot doel heeft de integratie nog verder te revolutioneren. Met SnapGPT introduceert SnapLogic 's werelds eerste generatieve integratieoplossing. Het gaat hierbij niet alleen om het vereenvoudigen van bestaande processen, maar om het volledig opnieuw vormgeven van de manier waarop integraties worden ontworpen. De kracht van generatieve AI kan hele integratiepijplijnen vanaf het begin creëren, waardoor de workflow wordt geoptimaliseerd op basis van de gewenste uitkomst en gegevenskenmerken.

SnapGPT heeft een enorme impact op de klanten van SnapLogic, omdat ze de hoeveelheid tijd die nodig is om hun eerste SnapLogic-pijplijn te genereren drastisch kunnen verkorten. Traditioneel zouden SnapLogic-klanten dagen of weken moeten besteden aan het helemaal opnieuw configureren van integratiepijplijnen. Nu kunnen deze klanten SnapGPT eenvoudigweg vragen om bijvoorbeeld “een pijplijn te creëren die al mijn actieve SFDC-klanten naar WorkDay zal verplaatsen.” Er wordt automatisch een werkend eerste ontwerp van een pijplijn voor deze klant gemaakt, waardoor de ontwikkelingstijd die nodig is voor het creëren van de basis van hun integratiepijplijn drastisch wordt verkort. Hierdoor kan de eindklant meer tijd besteden aan het focussen op wat een echte zakelijke impact voor hem heeft, in plaats van te werken aan configuraties van een integratiepijplijn. Het volgende voorbeeld laat zien hoe een SnapLogic-klant een beschrijving in de SnapGPT-functie kan invoeren om snel een pijplijn te genereren, met behulp van natuurlijke taal.

AWS en SnapLogic hebben tijdens deze productontwikkeling nauw samengewerkt en hebben onderweg veel geleerd. De rest van dit bericht zal zich richten op de technische lessen die AWS en SnapLogic hebben geleerd over het gebruik van LLM's voor tekst-naar-pipeline-applicaties.

Overzicht oplossingen

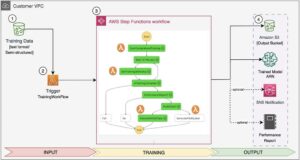

Om dit tekst-naar-pipeline-probleem op te lossen, hebben AWS en SnapLogic een alomvattende oplossing ontworpen, weergegeven in de volgende architectuur.

Een verzoek aan SnapGPT doorloopt de volgende workflow:

- Een gebruiker dient een beschrijving in bij de applicatie.

- SnapLogic gebruikt een Retrieval Augmented Generation (RAG)-benadering om relevante voorbeelden van SnapLogic-pijplijnen op te halen die vergelijkbaar zijn met het verzoek van de gebruiker.

- Deze geëxtraheerde relevante voorbeelden worden gecombineerd met de gebruikersinvoer en ondergaan een aantal tekstvoorbewerkingen voordat ze naar Claude op Amazon Bedrock worden verzonden.

- Claude produceert een JSON-artefact dat een SnapLogic-pijplijn vertegenwoordigt.

- Het JSON-artefact is rechtstreeks geïntegreerd in het kernintegratieplatform van SnapLogic.

- De SnapLogic-pijplijn wordt op een visueel vriendelijke manier aan de gebruiker weergegeven.

Door verschillende experimenten tussen AWS en SnapLogic hebben we ontdekt dat de snelle engineeringstap van het oplossingsdiagram uiterst belangrijk is voor het genereren van uitvoer van hoge kwaliteit voor deze tekst-naar-pijplijnuitvoer. In het volgende gedeelte wordt dieper ingegaan op enkele specifieke technieken die bij Claude in deze ruimte worden gebruikt.

Snel experimenteren

Gedurende de ontwikkelingsfase van SnapGPT ontdekten AWS en SnapLogic dat snelle iteratie van prompts die naar Claude werden gestuurd een cruciale ontwikkelingstaak was om de nauwkeurigheid en relevantie van tekst-naar-pipeline-uitvoer in de uitvoer van SnapLogic te verbeteren. Door het gebruiken van Amazon SageMaker Studio interactieve notebooks kon het team van AWS en SnapLogic snel door verschillende versies van prompts heen werken met behulp van de Boto3 SDK-verbinding met Amazon Bedrock. Op notebooks gebaseerde ontwikkeling stelde de teams in staat snel verbindingen aan de clientzijde met Amazon Bedrock tot stand te brengen, op tekst gebaseerde beschrijvingen op te nemen naast Python-code voor het verzenden van prompts naar Amazon Bedrock, en gezamenlijke prompt-engineeringsessies te houden waarbij snel iteraties tussen meerdere persona's werden gemaakt.

Antropische Claude snelle technische methoden

In deze sectie beschrijven we enkele van de iteratieve technieken die we hebben gebruikt om een goed presterende prompt te maken op basis van een illustratief gebruikersverzoek: "Maak een pijplijn die gebruikmaakt van de PreviewCompany-database die alle actieve klanten ophaalt." Houd er rekening mee dat dit voorbeeld niet het schema is waar SnapGPT door wordt aangedreven, en alleen wordt gebruikt om een tekst-naar-pipeline-toepassing te illustreren.

Om onze prompt-engineering te baseren, gebruiken we de volgende originele prompt:

Maak een pijplijn die gebruikmaakt van de PreviewCompany-database die alle actieve klanten ophaalt

De verwachte output is als volgt:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Verbetering #1: De menselijke en assistent-annotaties gebruiken

De trainingsprocedure van Claude leert de FM de dialoog tussen een mens en een assistent in zijn snelle structuur te begrijpen. Claude-gebruikers kunnen profiteren van deze structuur door hun prompt te beëindigen in Assistant:, waardoor Claude het antwoord op een vraag begint te genereren op basis van wat de mens heeft gezegd. Houd er rekening mee dat, omdat Claude tekst blijft genereren totdat wordt aangegeven dat hij moet stoppen, u ervoor moet zorgen dat u de stopreeks nnHuman: gebruikt in het API-verzoek aan Amazon Bedrock wanneer u Claude gebruikt. Dit zorgt ervoor dat u alleen het antwoord van de assistent ontvangt en niet het voorspelde volgende antwoord van de mens in de dialoogketen. Deze nnMenselijke en nnAssistant-indicatoren helpen niet alleen Claude's reactie op relevante informatie te beperken, maar helpen ook bij het aanbrengen van een duidelijke afbakening tussen primaire menselijke input en assistent-reacties op andere interacties. Dit helpt vooral bij een promptinstelling van een paar shots, waarbij u meerdere vragen en antwoorden kunt hebben met vragen die zijn getagd met nnHuman en eerdere antwoorden die zijn getagd met nnAssistant. Laten we eens kijken naar de verbeterde prompt en de bijbehorende illustratieve API-aanroep naar Amazon Bedrock via de Boto3 SDK.

We gebruiken de volgende prompt:

Mens: Maak een pijplijn die gebruikmaakt van de database van VoorbeeldBedrijf die alle actieve klanten ophaalt

Assistent:

De output is als volgt:

Hier is een MongoDB-pijplijn om alle actieve klanten uit de PreviewCompany-database op te halen:

pipeline = [ { '$match': { 'database': 'ExampleCompany', 'status': 'active' } } ] db.customers.aggregate(pipeline)De belangrijkste stappen zijn:

– `$match` om de documenten te filteren op alleen die in de database van VoorbeeldBedrijf en met de status gelijk aan “actief”.

– `db.customers.aggregate()` voert de pijplijn uit op de klantencollectie en retourneert de gefilterde resultaten.

Hierdoor worden dus alle klantdocumenten uit de database van VoorbeeldBedrijf geretourneerd, waarbij het statusveld is ingesteld op 'actief'.

Merk op hoe Claude in de uitvoer een antwoord op onze vraag verzint zonder enige context. Het antwoord is mogelijk nuttig, maar is niet specifiek voor het probleem dat we proberen op te lossen, omdat het niet voldoende context biedt. Het is ook belangrijk op te merken dat Anthropic dit menselijke en assistent-formaat vereist bij het gebruik van de Claude-modellen; als je deze stap niet uitvoert, retourneert Amazon Bedrock een foutmelding.

Verbetering #2: Voeg hyperspecifieke context voor Claude toe voordat hem wordt verteld wat hij moet doen

Claude presteert het beste als hij een goede context krijgt over wat hij moet bereiken en hoe hij die taak moet volbrengen. Hier zijn een paar voorbeelden van dingen die u als context voor Claude kunt opnemen voordat u hem de taak vertelt:

- Beschrijf de functie die u Claude wilt laten vervullen. Door dit te doen, laat je Claude denken in de rol van iemand die in die baan werkt, of meer als iemand die net in die specifieke functie wordt aangenomen. Dit zal Claude helpen het antwoord te formuleren vanuit het perspectief van die specifieke functie, waardoor hallucinaties en willekeur in het antwoord worden verminderd.

- Voeg technische details toe over het uitvoerformaat. Foundation-modellen zijn over het algemeen goed in het volgen van acties, dus door Claude te vragen de uitvoer in een specifiek formaat of schema met een of enkele voorbeelden te genereren, kan Claude het antwoord in het juiste formaat geven, waardoor de noodzaak voor filtering en nabewerking van de uitvoer wordt verminderd. Het voorbeeld in de volgende prompt toont een fictief schema dat overeenkomt met de verwachte uitvoer.

Laten we deze suggesties combineren om onze oorspronkelijke prompt te verbeteren:

Mens: Het is jouw taak om op te treden als expert op het gebied van ETL-pijplijnen. Concreet is het jouw taak om een JSON-representatie van een ETL-pijplijn te maken die het aan jou verstrekte gebruikersverzoek zal oplossen.

De JSON-uitvoer moet het volgende formaat volgen:

Dit is uw taak: maak een pijplijn die gebruikmaakt van de database van VoorbeeldBedrijf die alle actieve klanten ophaalt

Assistent:

De output is als volgt:

Hier is een JSON-weergave van een ETL-pijplijn om alle actieve klanten uit de PreviewCompany-database op te halen:

Deze pijplijn gebruikt de database van VoorbeeldCompany en een SQL-query om alle records uit de klantentabel te selecteren waarvan de status 'actief' is.

Met de toevoeging van context kan het model nu het grootste deel van de weg naar ons antwoord vinden. Het weet nu hoe de uitvoer moet worden gestructureerd en begrijpt dat het een SQL-instructie moet schrijven om de taak op te lossen. U zult echter merken dat het model niet correct gebruik maakt van de ec_prod.customers-nomenclatuur die we verwachten. Ruimte voor verbetering! Houd er ook rekening mee dat u in de praktijk aanzienlijk meer context moet opnemen dan wat we in dit voorbeeld hebben gegeven voor resultaten van hoge kwaliteit in tekst-naar-pipeline-gebruiksscenario's.

Verbetering #3: Voorbeelden in XML-tags insluiten

Few-shot-leren is een populaire manier om de nauwkeurigheid bij FM's te vergroten, waarbij u relevante voorbeelden heeft om de FM bij zijn taak te begeleiden. Dit is vooral belangrijk bij het werken in tekst-naar-pipeline-toepassingen, omdat deze hyperspecifieke pijplijnuitvoer doorgaans niet in een openbare dataset wordt opgenomen, omdat deze specifiek is voor de gegevensrepresentatie van een individuele klant. Wanneer u Claude gebruikt, kunt u profiteren van zijn aangeboren kennis van willekeurige XML-tags om deze voorbeelden in een paar-shot-formaat aan te bieden. Let op de toevoeging van voorbeelden in de volgende verbeterde prompt XML-tags. Je kunt ook de afkortingen voor mens en assistent met H en A gebruiken om Claude context te geven zonder dat hij denkt dat dit specifieke stukjes van de dialoog zijn die al hebben plaatsgevonden.

We gebruiken de volgende prompt:

Mens: Het is jouw taak om op te treden als expert op het gebied van ETL-pijplijnen. Concreet is het jouw taak om een JSON-representatie van een ETL-pijplijn te maken die het aan jou verstrekte gebruikersverzoek zal oplossen.

De JSON-uitvoer moet het volgende formaat volgen:

Hier volgen enkele voorbeelden van gebruikersverzoeken en bijbehorende JSON-uitvoerartefacten die de opgegeven taak correct oplossen. Zorg ervoor dat u dezelfde nomenclatuur gebruikt als in de voorbeelden als u dezelfde databases gebruikt.

H: zoek in de database van VoorbeeldBedrijf naar actieve bestellingen voor klant #1234

A:

De reden voor deze zoekopdracht is dat klant #1234 wordt gefilterd en dat we in de tabel “bestellingen” zoeken naar eventuele bestaande records na het “actieve” filter.

H: verwijder alle klanten uit de database van VoorbeeldBedrijf die de afgelopen maand niet actief zijn geweest

A:

De reden voor deze zoekopdracht is dat de tabel “ec_prod.customers” de enige tabel in de database van PreviewCompany is die klantrecords bevat.

Dit is uw taak: maak een pijplijn die gebruikmaakt van de database van VoorbeeldBedrijf die alle actieve klanten ophaalt.

Assistent:

De output is als volgt:

Hier is de JSON-weergave voor een ETL-pijplijn om alle actieve klanten uit de PreviewCompany-database op te halen:

De redenering is:

De VoorbeeldBedrijf-database is opgegeven als de database die moet worden gebruikt

De tabel ec_prod.customers bevat de klantgegevens

Het statusveld geeft aan of een klant actief is, zodat de zoekopdracht alleen op actieve klanten filtert

Hiermee moeten alle actieve klantrecords uit de database van VoorbeeldBedrijf worden opgehaald. Laat het me weten als je opheldering nodig hebt of aanvullende vereisten hebt voor de ETL-pijplijn!

De JSON-uitvoer heeft nu de juiste databasenomenclatuur, die Claude kon gebruiken dankzij de voorbeelden die we hebben gegeven. Door menselijke en assistent-indicatoren te koppelen aan XML-tags, wordt het voor Claude gemakkelijker om te begrijpen wat de taak is en wat het antwoord was in vergelijkbare voorbeelden, met een zeer duidelijke scheiding tussen meerdere, enkele voorbeelden. Hoe gemakkelijker het voor Claude is om het te begrijpen, des te beter en relevanter het antwoord zal zijn, waardoor de kans voor het model om te hallucineren en willekeurige irrelevante antwoorden te geven verder wordt verkleind.

Verbetering #4: Claude ertoe aanzetten om te beginnen met het genereren van JSON met XML-tags

Een kleine uitdaging bij tekst-naar-pipeline-applicaties die FM's gebruiken, is de noodzaak om de uitvoer van de resulterende tekst exact te parseren, zodat deze in een downstream-applicatie als code kan worden geïnterpreteerd. Eén manier om dit met Claude op te lossen, is door te profiteren van het begrip van XML-tags en dit te combineren met een aangepaste stopreeks. In de volgende prompt hebben we Claude opgedragen de uitvoer in te sluiten XML-tags. Vervolgens hebben we de tag aan het einde van de prompt. Dit zorgt ervoor dat de eerste tekst die uit Claude komt het begin zal zijn van de JSON-uitvoer. Als je dit niet doet, reageert Claude vaak met een gesprekstekst en vervolgens met het echte codeantwoord. Door Claude te instrueren om onmiddellijk te beginnen met het genereren van de uitvoer, kunt u het genereren eenvoudig stoppen wanneer u de afsluiting ziet label. Dit wordt weergegeven in de bijgewerkte Boto3 API-aanroep. De voordelen van deze techniek zijn tweeledig. Ten eerste kunt u het codeantwoord van Claude exact ontleden. Ten tweede kunt u de kosten verlagen omdat Claude alleen code-uitvoer genereert en geen extra tekst. Dit verlaagt de kosten op Amazon Bedrock omdat er kosten in rekening worden gebracht voor elk token dat wordt geproduceerd als output van alle FM's.

We gebruiken de volgende prompt:

Mens: Het is jouw taak om op te treden als expert op het gebied van ETL-pijplijnen. Concreet is het jouw taak om een JSON-representatie van een ETL-pijplijn te maken die het aan jou verstrekte gebruikersverzoek zal oplossen.

De JSON-uitvoer moet het volgende formaat volgen:

Hier volgen enkele voorbeelden van gebruikersverzoeken en bijbehorende JSON-uitvoerartefacten die de opgegeven taak correct oplossen. Zorg ervoor dat u dezelfde nomenclatuur gebruikt als in de voorbeelden als u dezelfde databases gebruikt.

H: zoek in de database van VoorbeeldBedrijf naar actieve bestellingen voor klant #1234

A:

De reden voor deze zoekopdracht is dat klant #1234 wordt gefilterd en dat we in de tabel “bestellingen” zoeken naar eventuele bestaande records na het “actieve” filter.

H: verwijder alle klanten uit de database van VoorbeeldBedrijf die de afgelopen maand niet actief zijn geweest

A:

De reden voor deze zoekopdracht is dat de tabel “ec_prod.customers” de enige tabel in de database van PreviewCompany is die klantrecords bevat.

Denk er altijd aan om uw JSON-uitvoer in te sluiten labels.

Dit is uw taak: maak een pijplijn die gebruikmaakt van de database van VoorbeeldBedrijf die alle actieve klanten ophaalt.

Assistent:

Wij gebruiken de volgende code:

body = json.dumps({"prompt": prompt, "stop_sequences": ['nnHuman:', '</json>']})

response = bedrock.invoke_model(

body=body,

modelId='anthropic.claude-v2'

)De output is als volgt:

{ "database": "ExampleCompany", "query": "SELECT * FROM ec_prod.customers WHERE status = 'active'" }

Nu zijn we bij de verwachte uitvoer aangekomen, waarbij alleen het JSON-object is geretourneerd! Door deze methode te gebruiken, kunnen we een onmiddellijk bruikbaar technisch artefact genereren en de generatiekosten verlagen door de uitvoertokens te verminderen.

Conclusie

Om vandaag nog aan de slag te gaan met SnapGPT, vraagt u een gratis proefversie van SnapLogic or Vraag een demo aan van het product. Als u deze concepten vandaag de dag voor het bouwen van toepassingen wilt gebruiken, raden wij u aan hands-on experimenteren met de prompt engineering-sectie in dit bericht, waarbij u dezelfde stroom gebruikt voor een gebruiksscenario van een andere DSL-generatie dat bij uw bedrijf past, en dieper in de materie duikt RAG-functies die beschikbaar zijn via Amazon Bedrock.

SnapLogic en AWS zijn erin geslaagd effectief samen te werken bij het bouwen van een geavanceerde vertaler tussen menselijke taal en het complexe schema van SnapLogic-integratiepijplijnen, mogelijk gemaakt door Amazon Bedrock. Tijdens dit traject hebben we gezien hoe de output die met Claude wordt gegenereerd, kan worden verbeterd in tekst-naar-pipeline-applicaties met behulp van specifieke prompt engineering-technieken. AWS en SnapLogic zijn verheugd om deze samenwerking op het gebied van generatieve AI voort te zetten en kijken uit naar toekomstige samenwerking en innovatie in deze snel veranderende ruimte.

Over de auteurs

Greg Benson is hoogleraar computerwetenschappen aan de Universiteit van San Francisco en hoofdwetenschapper bij SnapLogic. Hij trad in 1998 in dienst bij het USF Department of Computer Science en heeft bachelor- en mastercursussen gegeven, waaronder besturingssystemen, computerarchitectuur, programmeertalen, gedistribueerde systemen en inleidend programmeren. Greg heeft onderzoek gepubliceerd op het gebied van besturingssystemen, parallel computing en gedistribueerde systemen. Sinds hij in 2010 bij SnapLogic kwam, heeft Greg geholpen bij het ontwerpen en implementeren van verschillende belangrijke platformfuncties, waaronder clusterverwerking, big data-verwerking, de cloudarchitectuur en machine learning. Momenteel werkt hij aan generatieve AI voor data-integratie.

Greg Benson is hoogleraar computerwetenschappen aan de Universiteit van San Francisco en hoofdwetenschapper bij SnapLogic. Hij trad in 1998 in dienst bij het USF Department of Computer Science en heeft bachelor- en mastercursussen gegeven, waaronder besturingssystemen, computerarchitectuur, programmeertalen, gedistribueerde systemen en inleidend programmeren. Greg heeft onderzoek gepubliceerd op het gebied van besturingssystemen, parallel computing en gedistribueerde systemen. Sinds hij in 2010 bij SnapLogic kwam, heeft Greg geholpen bij het ontwerpen en implementeren van verschillende belangrijke platformfuncties, waaronder clusterverwerking, big data-verwerking, de cloudarchitectuur en machine learning. Momenteel werkt hij aan generatieve AI voor data-integratie.

Aäron Kesler is Senior Product Manager voor AI-producten en -diensten bij SnapLogic. Aaron past meer dan tien jaar ervaring op het gebied van productmanagement toe om pionierswerk te verrichten op het gebied van AI/ML-productontwikkeling en om diensten binnen de hele organisatie te promoten. Hij is de auteur van het komende boek “What’s Your Problem?” gericht op het begeleiden van nieuwe productmanagers door de productmanagementcarrière. Zijn ondernemersreis begon met zijn universiteitsstartup, STAK, die later werd overgenomen door Carvertise, waarbij Aaron aanzienlijk bijdroeg aan hun erkenning als Tech Startup of the Year 2015 in Delaware. Naast zijn professionele bezigheden vindt Aaron vreugde in golfen met zijn vader, het ontdekken van nieuwe culturen en gerechten tijdens zijn reizen, en het beoefenen van de ukelele.

Aäron Kesler is Senior Product Manager voor AI-producten en -diensten bij SnapLogic. Aaron past meer dan tien jaar ervaring op het gebied van productmanagement toe om pionierswerk te verrichten op het gebied van AI/ML-productontwikkeling en om diensten binnen de hele organisatie te promoten. Hij is de auteur van het komende boek “What’s Your Problem?” gericht op het begeleiden van nieuwe productmanagers door de productmanagementcarrière. Zijn ondernemersreis begon met zijn universiteitsstartup, STAK, die later werd overgenomen door Carvertise, waarbij Aaron aanzienlijk bijdroeg aan hun erkenning als Tech Startup of the Year 2015 in Delaware. Naast zijn professionele bezigheden vindt Aaron vreugde in golfen met zijn vader, het ontdekken van nieuwe culturen en gerechten tijdens zijn reizen, en het beoefenen van de ukelele.

Rijke dille is een Principal Solutions Architect met ervaring in meerdere specialisatiegebieden. Een trackrecord van succes op het gebied van multi-platform bedrijfssoftware en SaaS. Bekend om het omzetten van klantbelangen (die als stem van de klant fungeren) in omzetgenererende nieuwe functies en producten. Bewezen vermogen om geavanceerde producten op de markt te brengen en projecten volgens schema en binnen het budget tot voltooiing te brengen in snelle onshore- en offshore-omgevingen. Een eenvoudige manier om mij te beschrijven: de geest van een wetenschapper, het hart van een ontdekkingsreiziger en de ziel van een kunstenaar.

Rijke dille is een Principal Solutions Architect met ervaring in meerdere specialisatiegebieden. Een trackrecord van succes op het gebied van multi-platform bedrijfssoftware en SaaS. Bekend om het omzetten van klantbelangen (die als stem van de klant fungeren) in omzetgenererende nieuwe functies en producten. Bewezen vermogen om geavanceerde producten op de markt te brengen en projecten volgens schema en binnen het budget tot voltooiing te brengen in snelle onshore- en offshore-omgevingen. Een eenvoudige manier om mij te beschrijven: de geest van een wetenschapper, het hart van een ontdekkingsreiziger en de ziel van een kunstenaar.

Klei Elmore is een AI/ML Specialist Solutions Architect bij AWS. Na vele uren in een materiaalonderzoekslaboratorium te hebben doorgebracht, werd zijn achtergrond in de chemische technologie snel achter zich gelaten om zijn interesse in machinaal leren na te streven. Hij heeft gewerkt aan ML-toepassingen in veel verschillende sectoren, variërend van energiehandel tot horecamarketing. Clay's huidige werk bij AWS draait om het helpen van klanten bij het omzetten van softwareontwikkelingspraktijken naar ML en generatieve AI-workloads, waardoor klanten herhaalbare, schaalbare oplossingen kunnen bouwen in deze complexe omgevingen. In zijn vrije tijd houdt Clay van skiën, het oplossen van Rubiks kubussen, lezen en koken.

Klei Elmore is een AI/ML Specialist Solutions Architect bij AWS. Na vele uren in een materiaalonderzoekslaboratorium te hebben doorgebracht, werd zijn achtergrond in de chemische technologie snel achter zich gelaten om zijn interesse in machinaal leren na te streven. Hij heeft gewerkt aan ML-toepassingen in veel verschillende sectoren, variërend van energiehandel tot horecamarketing. Clay's huidige werk bij AWS draait om het helpen van klanten bij het omzetten van softwareontwikkelingspraktijken naar ML en generatieve AI-workloads, waardoor klanten herhaalbare, schaalbare oplossingen kunnen bouwen in deze complexe omgevingen. In zijn vrije tijd houdt Clay van skiën, het oplossen van Rubiks kubussen, lezen en koken.

Sina Sojoodi is een technologiemanager, systeemingenieur, productleider, ex-oprichter en startup-adviseur. Hij trad in maart 2021 in dienst bij AWS als Principal Solutions Architect. Sina is momenteel de US-West ISV area lead Solutions Architect. Hij werkt samen met SaaS- en B2B-softwarebedrijven om hun bedrijf op AWS op te bouwen en te laten groeien. Voorafgaand aan zijn rol bij Amazon was Sina technologiemanager bij VMware en Pivotal Software (IPO in 2018, VMware M&A in 2020) en vervulde hij meerdere leiderschapsrollen, waaronder oprichter en ingenieur bij Xtreme Labs (Pivotal-overname in 2013). Sina heeft de afgelopen 15 jaar van zijn werkervaring gewijd aan het bouwen van softwareplatforms en -praktijken voor ondernemingen, softwarebedrijven en de publieke sector. Hij is een marktleider met een passie voor innovatie. Sina heeft een BA van de Universiteit van Waterloo, waar hij elektrotechniek en psychologie studeerde.

Sina Sojoodi is een technologiemanager, systeemingenieur, productleider, ex-oprichter en startup-adviseur. Hij trad in maart 2021 in dienst bij AWS als Principal Solutions Architect. Sina is momenteel de US-West ISV area lead Solutions Architect. Hij werkt samen met SaaS- en B2B-softwarebedrijven om hun bedrijf op AWS op te bouwen en te laten groeien. Voorafgaand aan zijn rol bij Amazon was Sina technologiemanager bij VMware en Pivotal Software (IPO in 2018, VMware M&A in 2020) en vervulde hij meerdere leiderschapsrollen, waaronder oprichter en ingenieur bij Xtreme Labs (Pivotal-overname in 2013). Sina heeft de afgelopen 15 jaar van zijn werkervaring gewijd aan het bouwen van softwareplatforms en -praktijken voor ondernemingen, softwarebedrijven en de publieke sector. Hij is een marktleider met een passie voor innovatie. Sina heeft een BA van de Universiteit van Waterloo, waar hij elektrotechniek en psychologie studeerde.

Sandeep Rohilla is een Senior Solutions Architect bij AWS en ondersteunt ISV-klanten in de regio VS-West. Hij richt zich op het helpen van klanten bij het ontwerpen van oplossingen waarbij gebruik wordt gemaakt van containers en generatieve AI in de AWS-cloud. Sandeep heeft een passie voor het begrijpen van de zakelijke problemen van klanten en helpt hen hun doelen te bereiken door middel van technologie. Hij kwam bij AWS terecht nadat hij meer dan tien jaar als oplossingsarchitect had gewerkt, waarbij hij zijn 17 jaar ervaring kon inzetten. Sandeep heeft een MSc. in Software Engineering aan de Universiteit van West-Engeland in Bristol, VK.

Sandeep Rohilla is een Senior Solutions Architect bij AWS en ondersteunt ISV-klanten in de regio VS-West. Hij richt zich op het helpen van klanten bij het ontwerpen van oplossingen waarbij gebruik wordt gemaakt van containers en generatieve AI in de AWS-cloud. Sandeep heeft een passie voor het begrijpen van de zakelijke problemen van klanten en helpt hen hun doelen te bereiken door middel van technologie. Hij kwam bij AWS terecht nadat hij meer dan tien jaar als oplossingsarchitect had gewerkt, waarbij hij zijn 17 jaar ervaring kon inzetten. Sandeep heeft een MSc. in Software Engineering aan de Universiteit van West-Engeland in Bristol, VK.

Dr. Farooq Sabir is een Senior Artificial Intelligence en Machine Learning Specialist Solutions Architect bij AWS. Hij heeft een doctoraat en een MS-graad in Electrical Engineering van de Universiteit van Texas in Austin en een MS in Computer Science van het Georgia Institute of Technology. Hij heeft meer dan 15 jaar werkervaring en geeft ook graag les en begeleidt studenten. Bij AWS helpt hij klanten bij het formuleren en oplossen van hun zakelijke problemen op het gebied van datawetenschap, machine learning, computervisie, kunstmatige intelligentie, numerieke optimalisatie en aanverwante domeinen. Gevestigd in Dallas, Texas, houden hij en zijn gezin van reizen en lange roadtrips maken.

Dr. Farooq Sabir is een Senior Artificial Intelligence en Machine Learning Specialist Solutions Architect bij AWS. Hij heeft een doctoraat en een MS-graad in Electrical Engineering van de Universiteit van Texas in Austin en een MS in Computer Science van het Georgia Institute of Technology. Hij heeft meer dan 15 jaar werkervaring en geeft ook graag les en begeleidt studenten. Bij AWS helpt hij klanten bij het formuleren en oplossen van hun zakelijke problemen op het gebied van datawetenschap, machine learning, computervisie, kunstmatige intelligentie, numerieke optimalisatie en aanverwante domeinen. Gevestigd in Dallas, Texas, houden hij en zijn gezin van reizen en lange roadtrips maken.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://aws.amazon.com/blogs/machine-learning/how-snaplogic-built-a-text-to-pipeline-application-with-amazon-bedrock-to-translate-business-intent-into-action/

- : heeft

- :is

- :niet

- :waar

- $UP

- 10

- 100

- 121

- 14

- 15 jaar

- 15%

- 150

- 17

- 1998

- 200

- 2010

- 2013

- 2015

- 2017

- 2018

- 2020

- 2021

- 31

- 33

- 7

- 8

- 9

- a

- Aaron

- vermogen

- in staat

- Over

- toegang

- bereiken

- nauwkeurigheid

- Bereiken

- verworven

- acquisitie

- over

- Handelen

- Actie

- acties

- actieve

- toegevoegd

- toevoeging

- Extra

- vergevorderd

- Voordeel

- adviseur

- voorspraak

- Na

- AI

- AI-systemen

- AI-powered

- AI / ML

- Gericht

- wil

- algoritmen

- Alles

- toegestaan

- Het toestaan

- toestaat

- langs

- naast

- al

- ook

- Amazone

- Amazon Web Services

- bedragen

- an

- het analyseren van

- en

- beantwoorden

- antwoorden

- antropisch

- elke

- api

- APIs

- Aanvraag

- toepassingen

- geldt

- nadering

- apps

- Arabisch

- architectuur

- ZIJN

- GEBIED

- gebieden

- rond

- aangekomen

- Kunst

- kunstmatig

- kunstmatige intelligentie

- Kunstmatige intelligentie en machine learning

- kunstenaar

- AS

- vragen

- vragen

- Assistent

- geassocieerd

- At

- aangevuld

- austin

- auteur

- automatiseren

- geautomatiseerde

- webmaster.

- Automatisering

- Beschikbaar

- AWS

- AWS-klant

- Zakelijk

- achtergrond

- steun

- baseren

- gebaseerde

- Baseline

- BE

- Beer

- werd

- omdat

- worden

- geweest

- vaardigheden

- begon

- beginnen

- achter

- wezen

- betekent

- BEST

- Betere

- tussen

- Verder

- Groot

- Big data

- boek

- zowel

- brengen

- Bringing

- Brengt

- bristol

- breed

- breed

- begroting

- bouw

- Gebouw

- bouwt

- bebouwd

- bedrijfsdeskundigen

- zakelijke impact

- ondernemingen

- maar

- by

- Bellen

- Dit betekent dat we onszelf en onze geliefden praktisch vergiftigen.

- CAN

- mogelijkheden

- Carrière

- geval

- gevallen

- Centra

- keten

- uitdagen

- kans

- kenmerken

- opgeladen

- chemisch

- chef

- keuze

- duidelijk

- van nabij

- sluitend

- Cloud

- TROS

- code

- codering

- samengewerkt

- samenwerking

- Collectie

- College

- combineren

- gecombineerde

- komt

- verplichting

- Bedrijven

- Bedrijf

- gedwongen

- voltooiing

- complex

- uitgebreid

- computer

- Computer Science

- Computer visie

- computergebruik

- concepten

- configureren

- Wij verbinden

- versterken

- aansluitingen

- consistent

- containers

- bevat

- content

- content creatie

- verband

- voortzetten

- contract

- bij te dragen

- spraakzaam

- koken

- Kern

- te corrigeren

- correct

- Kosten

- kon

- cursussen

- en je merk te creëren

- aangemaakt

- het aanmaken

- creativiteit

- kritisch

- Actueel

- Op dit moment

- gewoonte

- klant

- Klanten

- snijdend

- op het randje

- Dallas

- gegevens

- gegevens integratie

- gegevensverwerking

- data science

- Database

- databanken

- dagen

- decennium

- verlagen

- toegewijd aan

- deep

- diepere

- Delaware

- Demo

- Democratiserend

- afdeling

- derivaat

- beschrijven

- beschrijving

- Design

- ontworpen

- verlangen

- gewenste

- gedetailleerd

- gegevens

- ontwikkelaars

- Ontwikkeling

- systemen

- Dialoog

- anders

- direct

- verdeeld

- gedistribueerde systemen

- duiken

- do

- documenten

- Nee

- doen

- domeinen

- Dont

- beneden

- draft

- drastisch

- rit

- twee

- elk

- gemakkelijker

- gemakkelijkste

- gemakkelijk

- ecosysteem

- effectief

- beide

- Elektrotechniek

- geeft je de mogelijkheid

- maakt

- einde

- einde

- energie-niveau

- ingenieur

- Engineering

- Engeland

- Engels

- enhancement

- genoeg

- verzekeren

- waarborgt

- Enter

- Enterprise

- bedrijfssoftware

- Ondernemingsoplossingen

- bedrijven

- Geheel

- geheel

- entrepreneurial

- omgevingen

- gelijk

- Gelijkwaardig

- fout

- vooral

- Ether (ETH)

- Zelfs

- duidelijk

- precies

- voorbeeld

- voorbeelden

- Excel

- opgewonden

- uitvoerend

- bestaand

- verwacht

- verwacht

- ervaring

- expert

- expertise

- ontdekkingsreiziger

- Verkennen

- extra

- uiterst

- familie

- snelbewegend

- fast-paced

- Kenmerk

- Voordelen

- weinig

- veld-

- Velden

- filter

- filtering

- filters

- vondsten

- Voornaam*

- vlaggeschip

- stroom

- Stromen

- Focus

- richt

- gericht

- volgen

- volgend

- volgt

- voedsel

- Voor

- inval

- Voorhoede

- formaat

- formulieren

- Naar voren

- gevonden

- Foundation

- oprichten

- Francisco

- vriendelijk

- oppompen van

- vervullen

- geheel

- functie

- verder

- toekomst

- opgedaan

- algemeen

- voortbrengen

- gegenereerde

- genereert

- het genereren van

- generatie

- generatief

- generatieve AI

- Georgia Institute of Technology

- krijgen

- gif

- gegeven

- Go

- Doelen

- Goes

- goed

- afstuderen

- Groeien

- gids

- HAD

- hand

- Benutten

- Hebben

- he

- Hart

- hulp

- geholpen

- nuttig

- het helpen van

- helpt

- hier

- goed presterende

- hoogwaardige

- highlights

- zijn

- houden

- houdt

- hospitality

- HOURS

- Hoe

- How To

- Echter

- HTML

- HTTPS

- menselijk

- nederig

- geïdentificeerd

- if

- illustreren

- per direct

- Impact

- impactvolle

- uitvoeren

- belangrijk

- verbeteren

- verbeterd

- het verbeteren van

- in

- omvatten

- inclusief

- Inclusief

- Laat uw omzet

- onafhankelijk

- geeft aan

- indicatoren

- individueel

- industrieën

- -industrie

- marktleider

- informatie

- aangeboren

- innoveren

- Innovatie

- invoer

- ingangen

- moment

- verkrijgen in plaats daarvan

- Instituut

- instructies

- geïntegreerde

- integratie

- integraties

- Intelligentie

- Intelligent

- aandachtig

- interacties

- interactieve

- belang

- Interface

- intern

- in

- geïntroduceerd

- Introduceert

- inleidende

- IPO

- ISV

- IT

- herhaling

- iteraties

- HAAR

- Java

- Jobomschrijving:

- toegetreden

- aansluiting

- gewricht

- vreugde

- jpg

- json

- voor slechts

- sleutel

- blijven

- kennis

- bekend

- weet

- laboratorium

- Labs

- taal

- Talen

- Groot

- Achternaam*

- later

- laatste

- leiden

- leider

- Leadership

- leidend

- Springen

- geleerd

- leren

- links

- laten

- leveraging

- als

- sympathieën

- logica

- lang

- Kijk

- lot

- liefde

- M & A

- machine

- machine learning

- Machines

- gemaakt

- maken

- MERKEN

- maken

- beheerd

- management

- manager

- Managers

- manier

- handmatig

- veel

- in kaart brengen

- Maart

- Markt

- Marketing

- lucifers

- materieel

- me

- mentor

- meer

- Metadata

- methode

- miljoenen

- denken

- minuten

- Missie

- ML

- model

- modellen

- MongoDB

- meer

- meest

- beweging

- MS

- Multi platform

- meervoudig

- my

- naam

- Naturel

- Natuurlijke taal

- Noodzaak

- behoeften

- New

- Nieuwe mogelijkheden

- nieuw product

- volgende

- geen

- nota

- laptops

- Merk op..

- nu

- object

- objecten

- opgetreden

- of

- Aanbod

- vaak

- on

- eens

- EEN

- Slechts

- werkzaam

- besturingssystemen

- optimalisatie

- optimaliseren

- or

- bestellen

- orders

- organisatie

- organisaties

- origineel

- Overige

- onze

- uit

- Resultaat

- uitgang

- uitgangen

- over

- paginas

- Parallel

- vooral

- partner

- Samenwerking

- passie

- hartstochtelijk

- verleden

- Patronen

- presteert

- perspectief

- fase

- phd

- stukken

- pionier

- pijpleiding

- centraal

- plaats

- platform

- platforms

- Plato

- Plato gegevensintelligentie

- PlatoData

- Populair

- populariteit

- Post

- potentieel

- mogelijk

- energie

- aangedreven

- praktijk

- praktijken

- voorspellen

- voorspeld

- vorig

- primair

- Principal

- privacy

- Privacy en Beveiliging

- probleem

- problemen

- procedures

- processen

- verwerking

- geproduceerd

- produceert

- Product

- productontwikkeling

- product management

- product manager

- Producten

- Producten en Diensten

- professioneel

- Hoogleraar

- Programming

- programmeertalen

- projecten

- prompts

- bewezen

- zorgen voor

- mits

- biedt

- het verstrekken van

- Psychologie

- publiek

- gepubliceerde

- Gepubliceerd onderzoek

- na te streven

- Python

- queries

- vraag

- snel

- willekeurige

- willekeurigheid

- reeks

- variërend

- snel

- lezing

- realiseren

- rijk

- ontvangen

- onlangs

- erkenning

- adviseren

- record

- archief

- verminderen

- vermindert

- vermindering

- met betrekking tot

- regio

- opnieuw bedenken

- verwant

- uitgebracht

- relevante

- betrouwbaar

- vertrouwen

- niet vergeten

- verwijderen

- gerenderd

- herhaalbare

- antwoord

- vertegenwoordiging

- vertegenwoordigen

- vertegenwoordigt

- te vragen

- verzoeken

- vereisen

- nodig

- Voorwaarden

- vereist

- onderzoek

- antwoord

- reacties

- REST

- verkregen

- Resultaten

- terugkeer

- Retourneren

- revolutioneren

- Rijk

- rechts

- weg

- Rol

- rollen

- Kamer

- lopen

- loopt

- SaaS

- Veiligheid

- sagemaker

- Zei

- dezelfde

- heilige

- San Francisco

- Scala

- schaalbare

- Scale

- rooster

- Wetenschap

- Wetenschapper

- krassen

- sdk

- zoeken

- Tweede

- sectie

- sector

- veiligheid

- zien

- gezien

- kiezen

- verzending

- senior

- verzonden

- Volgorde

- geserveerd

- service

- Diensten

- serveer-

- sessies

- reeks

- het instellen van

- verscheidene

- moet

- tonen

- getoond

- Shows

- aanzienlijk

- gelijk

- Eenvoudig

- vereenvoudigen

- vereenvoudigen

- eenvoudigweg

- sinds

- single

- Klein

- So

- Software

- software als een service

- Software ontwikkelaars

- software development

- software engineering

- oplossing

- Oplossingen

- OPLOSSEN

- Het oplossen van

- sommige

- Iemand

- geraffineerd

- Ziel

- bron

- Tussenruimte

- Spaans

- overspannen

- specialist

- specifiek

- specifiek

- gespecificeerd

- besteden

- Uitgaven

- SQL

- begin

- gestart

- startup

- Statement

- Status

- Stap voor

- Stappen

- stop

- eenvoudig

- structuur

- Leerlingen

- bestudeerd

- succes

- Ondersteuning

- steunen

- vermeend

- zeker

- system

- Systems

- tafel

- TAG

- Nemen

- doelwit

- Taak

- taken

- onderwezen

- team

- teams

- tech

- tech startup

- Technisch

- techniek

- technieken

- Technologie

- vertellen

- tien

- Texas

- tekst

- neem contact

- dat

- De

- Het Westen

- de wereld

- hun

- Ze

- harte

- Deze

- ze

- spullen

- denken

- dit

- die

- Door

- overal

- niet de tijd of

- naar

- vandaag

- teken

- tokens

- vertelde

- nam

- tools

- opsporen

- spoor

- Handel

- traditioneel

- Trainingen

- transformatieve

- transformaties

- vertalen

- reizen

- reist

- trending

- proces

- leiden

- triggering

- waar

- Ware code

- proberen

- Draai

- type dan:

- ui

- Uk

- voor

- begrijpen

- begrip

- begrijpt

- unieke

- universiteit-

- tot

- onthuld

- komende

- bijgewerkt

- op

- us

- bruikbaar

- .

- use case

- gebruikt

- Gebruiker

- Gebruikerservaring

- gebruikers

- toepassingen

- gebruik

- doorgaans

- ux

- divers

- vendors

- zeer

- via

- visie

- visuele

- vmware

- Stem

- willen

- was

- Manier..

- we

- web

- webservices

- weken

- GOED

- waren

- West

- Wat

- Wat is

- wanneer

- welke

- breed

- Grote range

- wil

- venster

- Met

- zonder

- Mijn werk

- werkte

- workflow

- workflows

- werkzaam

- Bedrijven

- wereld

- s werelds

- zou

- schrijven

- XML

- jaar

- jaar

- u

- Your

- youtube

- zephyrnet