Eindige-elementenmethoden voor analyse komen in veel domeinen van het ontwerp van elektronische systemen voor: mechanische spanningsanalyse in systemen met meerdere matrijzen, thermische analyse als tegenhanger van zowel koeling- als spanningsanalyse (bijvoorbeeld kromtrekken) en analyse van elektromagnetische compliantie. (Computationele vloeistofdynamica – CFD – is een heel ander beest, dat ik misschien in een aparte blog zal bespreken.) Ik heb onderwerpen op dit gebied besproken met een andere klant en blijf het domein aantrekkelijk vinden omdat het resoneert met mijn natuurkundeachtergrond en mijn innerlijke wiskunde-nerd (differentiaalvergelijkingen oplossen). Hier onderzoek ik a recente paper van Siemens AG samen met de Technische Universiteiten van München en Braunschweig.

De probleemstelling

Eindige-elementenmethoden zijn technieken om systemen van 2D/3D partiële differentiaalvergelijkingen (PDE's) die in veel fysieke analyses voorkomen numeriek op te lossen. Deze kunnen zich uitstrekken van hoe warmte zich verspreidt in een complexe SoC, tot EM-analyses voor autoradar, tot hoe een mechanische structuur buigt onder spanning, tot hoe de voorkant van een auto ineenkrimpt bij een botsing.

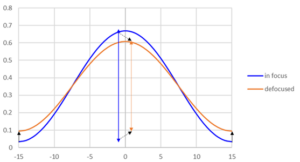

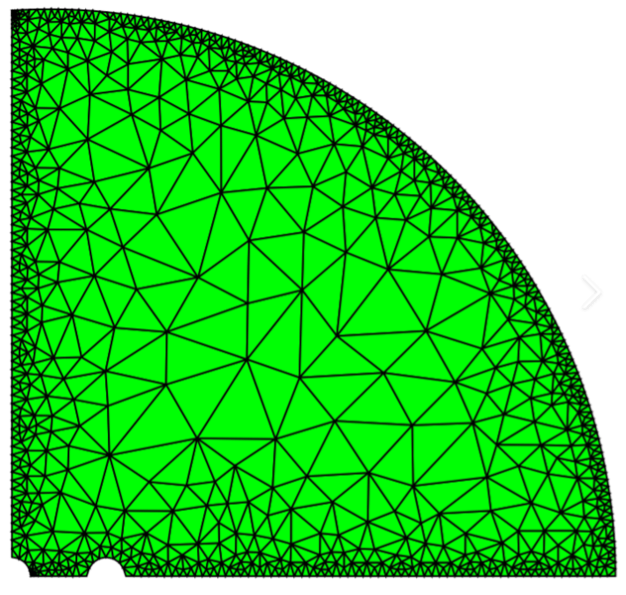

Voor FEM wordt een netwerk over de fysieke ruimte geconstrueerd als een discreet raamwerk voor analyse, fijner van structuur rond grenzen en vooral snel variërende randvoorwaarden, en elders grover van structuur. Door de bloederige details over te slaan, optimaliseert de methode lineaire superposities van eenvoudige functies over de mesh door de coëfficiënten in de superpositie te variëren. Optimalisatie heeft tot doel een beste pasvorm te vinden binnen een aanvaardbare tolerantie die consistent is met discrete proxy's voor de PDE's, samen met initiële voorwaarden en randvoorwaarden, door middel van lineaire algebra en andere methoden.

Er zijn doorgaans zeer grote meshes nodig om aan een aanvaardbare nauwkeurigheid te voldoen, wat leidt tot zeer lange doorlooptijden voor FEM-oplossingen voor realistische problemen, wat zelfs nog lastiger wordt bij het uitvoeren van meerdere analyses om optimalisatiemogelijkheden te onderzoeken. Elke run begint in wezen helemaal opnieuw, zonder dat er tussen de runs een leereffect ontstaat, wat een mogelijkheid suggereert om ML-methoden te gebruiken om de analyse te versnellen.

Manieren om ML te gebruiken met FEM

Een veelgebruikte aanpak om FEM-analyses (FEA's) te versnellen is het bouwen van surrogaatmodellen. Dit zijn net als abstracte modellen in andere domeinen: vereenvoudigde versies van de volledige complexiteit van het oorspronkelijke model. FEA-experts praten over Reduced Order Models (ROM's) die een goede benadering blijven vertonen van het (gediscretiseerde) fysieke gedrag van het bronmodel, maar de noodzaak om FEA uit te voeren omzeilen, althans in de ontwerpoptimalisatiefase, hoewel ze veel sneller werken dan FEA .

Eén manier om een surrogaat te bouwen zou zijn om te beginnen met een aantal FEA's, waarbij je die informatie gebruikt als trainingsdatabase om het surrogaat te bouwen. Dit vereist echter nog steeds langdurige analyses om trainingssets van inputs en outputs te genereren. De auteurs wijzen ook op een andere zwakte van een dergelijke aanpak. ML heeft geen aangeboren kennis van de natuurkundige beperkingen die belangrijk zijn bij al dergelijke toepassingen en is daarom vatbaar voor hallucinaties als ze een scenario voorgeschoteld krijgen dat buiten de trainingsset valt.

Omgekeerd, het vervangen van FEM door a fysiek geïnformeerd neuraal netwerk (PINN) neemt fysieke PDE's op in berekeningen van verliesfuncties, waarbij in essentie fysieke beperkingen worden geïntroduceerd in op gradiënten gebaseerde optimalisaties. Dit is een slim idee, hoewel uit verder onderzoek is gebleken dat de methode, hoewel deze werkt bij eenvoudige problemen, niet werkt als er sprake is van hoogfrequente en meerschalige kenmerken. Ook teleurstellend is dat de trainingstijd voor dergelijke methoden langer kan zijn dan de FEA-runtimes.

Dit artikel suggereert een intrigerend alternatief, om FEA- en ML-training nauwer te combineren, zodat ML-verliesfuncties trainen op de FEA-foutberekeningen bij het passen van proefoplossingen over de mesh. Er is enige gelijkenis met de PINN-aanpak, maar met een belangrijk verschil: dit neurale net werkt samen met FEA om de convergentie naar een oplossing in training te versnellen. Wat blijkbaar resulteert in een snellere training. Inferentie werkt het neurale netmodel zonder dat de FEA nodig is. Door de constructie zou een op deze manier getraind model nauw moeten aansluiten bij de fysieke beperkingen van het echte probleem, aangezien het zeer nauwkeurig is getraind tegen een fysiek bewuste oplosser.

Ik denk dat mijn interpretatie hier redelijk accuraat is. Ik verwelkom correcties van experts!

Deel dit bericht via:

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://semiwiki.com/artificial-intelligence/341034-blending-finite-element-methods-and-ml/

- : heeft

- :is

- $UP

- a

- Over

- SAMENVATTING

- versnellen

- aanvaardbaar

- nauwkeurigheid

- accuraat

- over

- AG

- tegen

- wil

- Alles

- ook

- alternatief

- an

- analyseert

- analyse

- en

- Nog een

- toepassingen

- nadering

- ZIJN

- GEBIED

- ontstaan

- rond

- AS

- At

- aantrekkelijk

- auteurs

- automotive

- bewust

- achtergrond

- BE

- omdat

- worden

- geweest

- gedrag

- BEST

- tussen

- blending

- Blog

- zowel

- grenzen

- breaks

- bouw

- Bos

- maar

- by

- bypass

- CAN

- auto

- CFD

- klant

- van nabij

- combineren

- algemeen

- complex

- ingewikkeldheid

- nakoming

- computationeel

- voorwaarden

- consequent

- beperkingen

- gebouwd

- bouw

- voortzetten

- Convergentie

- Correcties

- Tegenhanger

- deksel

- bedekt

- Neerstorten

- gewas

- Database

- Design

- gegevens

- verschil

- anders

- teleurstellend

- domein

- domeinen

- beneden

- dynamica

- elk

- elektronisch

- element

- elders

- vergelijkingen

- fout

- vooral

- essentie

- in wezen

- Zelfs

- tentoonstellen

- deskundigen

- Verken

- verlengen

- tamelijk

- sneller

- Voordelen

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- geschikt

- fitting

- vloeistof

- Vloeiende dynamiek

- Voor

- Achtergrond

- Frequentie

- oppompen van

- voor

- vol

- functie

- functies

- Geek

- voortbrengen

- goed

- Hebben

- hier

- Hoge

- Hoe

- Echter

- HTTPS

- i

- idee

- if

- belangrijk

- in

- Anders

- omvat

- informatie

- op de hoogte

- eerste

- binnenste

- ingangen

- interpretatie

- in

- intrigerend

- de invoering

- IT

- HAAR

- Groot

- leidend

- leren

- minst

- Hefboomwerking

- als

- lang

- langer

- uit

- veel

- wiskunde

- max-width

- mechanisch

- Maak kennis met

- mesh

- methode

- methoden

- macht

- Min

- ML

- model

- modellen

- meer

- veel

- meervoudig

- München

- my

- inheemse

- Noodzaak

- nodig

- netto

- Neural

- geen

- of

- on

- kansen

- optimalisatie

- Optimaliseert

- bestellen

- origineel

- Overige

- uit

- uitgangen

- buiten

- Papier

- fase

- Fysiek

- fysiek

- Fysica

- Plato

- Plato gegevensintelligentie

- PlatoData

- punt

- mogelijkheden

- Post

- aanwezigheid

- gepresenteerd

- probleem

- problemen

- proxies

- radar

- snel

- vast

- realistisch

- Gereduceerd

- vereist

- onderzoek

- resoneert

- Resultaten

- lopen

- lopend

- loopt

- scenario

- krassen

- apart

- reeks

- Sets

- moet

- getoond

- Siemens

- Eenvoudig

- vereenvoudigd

- sinds

- So

- oplossing

- Oplossingen

- OPLOSSEN

- Het oplossen van

- sommige

- bron

- Tussenruimte

- begin

- starts

- Still

- spanning

- structuur

- volgend

- dergelijk

- Stelt voor

- superpositie

- system

- Systems

- Talk

- Technisch

- technieken

- neem contact

- dat

- De

- De Bron

- Er.

- daarom

- warmte-

- Deze

- denken

- dit

- toch?

- Door

- niet de tijd of

- keer

- naar

- samen

- tolerantie

- onderwerpen

- Trainen

- getraind

- Trainingen

- proces

- voor

- begrip

- Universiteiten

- .

- gebruikt

- gebruik

- wisselende

- versies

- zeer

- via

- Manier..

- zwakte

- welkom

- wanneer

- welke

- en

- wijd

- Met

- binnen

- zonder

- Bedrijven

- zou

- zephyrnet