MELD U AAN VOOR dagelijkse nieuwsupdates van CleanTechnica op e-mail. Of volg ons op Google Nieuws!

Nog geen week geleden maakte Tesla bekend dat dit het geval was waarbij bijna 2 miljoen auto's worden teruggeroepen die in de VS zijn verkocht om zorgen over de Autopilot-software weg te nemen. Laten we duidelijk zijn. Hoewel dit technisch gezien een terugroepactie is, zal het allemaal worden uitgevoerd via een draadloze update. Elon haat het dat OTA's worden geclassificeerd als terugroepacties, maar regels zijn regels. Hoe dan ook is het goede nieuws voor Tesla-rijders dat ze niet naar een Tesla-servicecentrum hoeven te gaan en te wachten tot de update is voltooid, dus misschien heeft Elon wel een punt. De kern van het probleem is dat Tesla zegt:

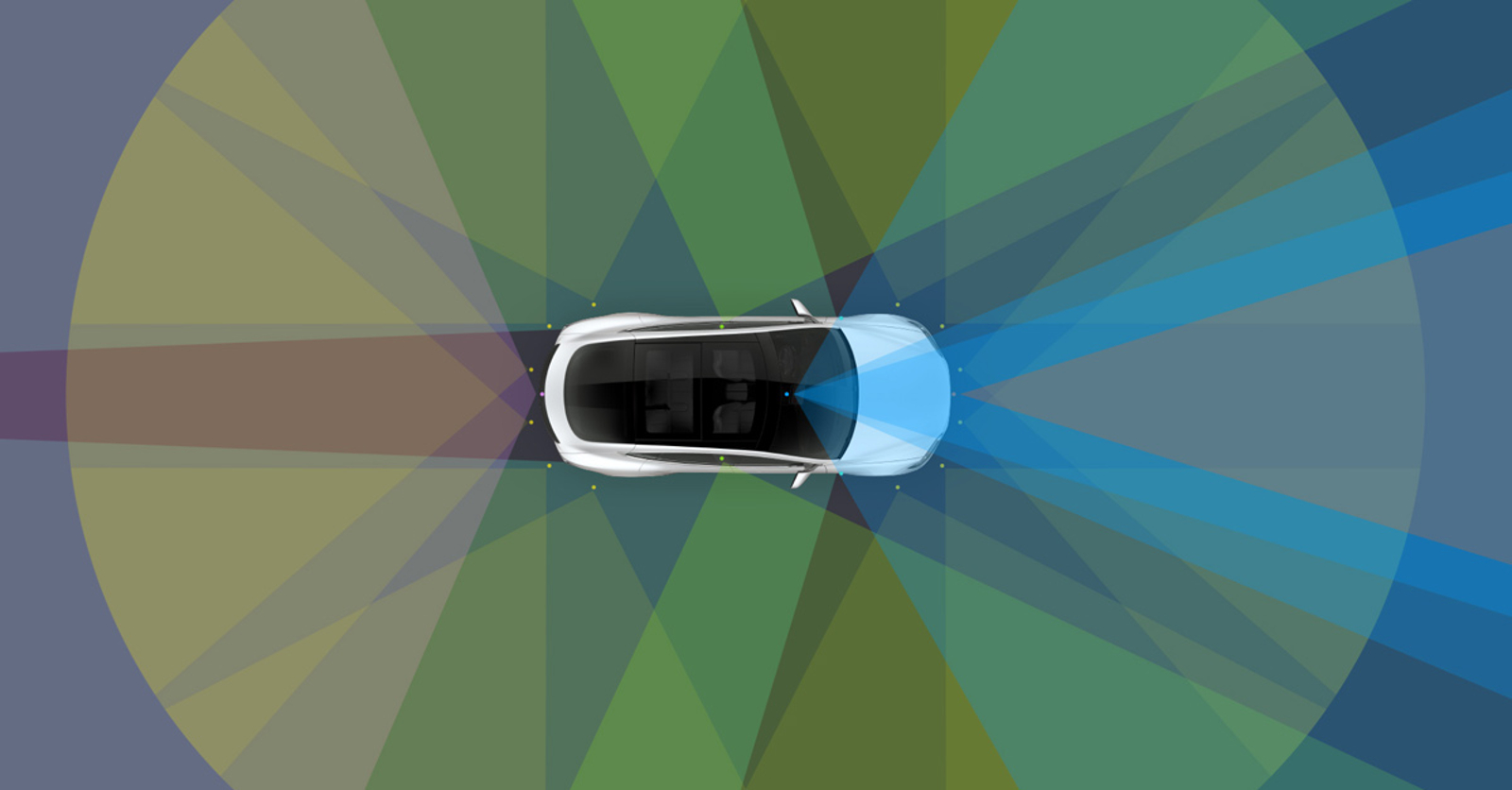

“Basic Autopilot is een pakket dat geavanceerde rijhulpfuncties van SAE Level 2 omvat, waaronder Autosteer en Traffic-Aware Cruise Control (TACC), die bestuurders kunnen kiezen om in te schakelen, afhankelijk van bepaalde gedefinieerde operationele beperkingen. Autosteer is een geavanceerde rijhulpfunctie van SAE Niveau 2 die, in coördinatie met de TACC-functie, stuur-, rem- en acceleratieondersteuning kan bieden aan de bestuurder, onder bepaalde beperkte bedrijfsomstandigheden.

“Autosteer is ontworpen en bedoeld voor gebruik op snelwegen met gecontroleerde toegang wanneer de functie niet werkt in combinatie met de functie Autosteer op stadsstraten. Wanneer Autosteer is ingeschakeld, zoals bij alle geavanceerde rijhulpsystemen en -systemen van SAE Niveau 2, is de bestuurder de bestuurder van het voertuig. Als bestuurder van het voertuig is de bestuurder te allen tijde verantwoordelijk voor de beweging van het voertuig met de handen aan het stuur, waarbij hij alert blijft op de omstandigheden op de omringende wegen en zo nodig ingrijpt (bijvoorbeeld sturen, remmen, accelereren of de hendel gebruiken) om het voertuig in stand te houden. veilige operatie.

“Wanneer Autosteer is ingeschakeld, gebruikt het verschillende bedieningselementen om te controleren of de bestuurder voortdurend en duurzaam verantwoordelijk is voor de werking van het voertuig, zoals vereist. Als de bestuurder Autosteer probeert in te schakelen wanneer niet aan de voorwaarden wordt voldaan om Autosteer in te schakelen, zal de functie de bestuurder waarschuwen dat deze niet beschikbaar is via visuele en hoorbare waarschuwingen, en Autosteer zal niet inschakelen.”

Critici zeggen dat het updaten van de automatische piloot niet genoeg is

Het probleem is: een Washington Post Uit onderzoek is gebleken dat Autopilot kan worden geactiveerd in situaties waarin Tesla zegt dat het niet gebruikt mag worden. De OTA-software zal meer toeters, fluitjes, zwaailichten en zwaaiende vlaggen toevoegen om bestuurders te waarschuwen dat ze Autopilot mogelijk op een ongepaste manier gebruiken, maar critici wijzen erop dat er niets is gedaan om misbruik van het systeem daadwerkelijk te voorkomen.

“Wat een gemiste kans”, zei Matthew Wansley, een professor aan de Cardozo School of Law in New York, gespecialiseerd in opkomende autotechnologieën, tegen de Washington Post nadat details over de update waren onthuld. “Ik moet Tesla, of iemand die Tesla verdedigt, nog met een argument zien komen waarom we mensen [Autopilot] zouden moeten laten gebruiken op wegen waar kruisend verkeer zou kunnen zijn. Dat is hoe veel van deze crashes gebeuren.”

“Het is verre van voldoende”, zegt senator Richard Blumenthal uit Connecticut, die regelmatig Tesla-criticus is. Hij zei dat toezichthouders grotere wijzigingen in de software hadden moeten eisen, gezien de geschiedenis van crashes. “Vertrouwen op zelfhandhaving is echt problematisch gezien de uitspraken van het bedrijf over hoe serieus ze het hele terugroepsysteem nemen, de opmerkingen van Elon Musk. Ze beschouwen terugroepacties meer als amusement dan als handhaving”, aldus Blumenthal. “Wanneer een auto een obstakel of een andere auto raakt, van de weg raakt of een barrière raakt, moet er meer zijn dan alleen vrijwillige naleving.”

Heeft NHTSA het rustig aan gedaan met Tesla?

Ambtenaren en wetgevers uitten hun bezorgdheid over het feit dat de NHTSA wellicht terughoudend was om harder op te treden tegen de autofabrikant, die een enorme invloed heeft op de transitie van het land naar elektrische voertuigen, wat een prioriteit is voor de regering-Biden. NHTSA zei echter dat het onderzoek naar Autopilot open blijft en sommige Tesla-critici hoopten dat de terugroepactie misschien niet de laatste actie van het bureau zou zijn.

In een verklaring zei NHTSA-woordvoerster Veronica Morales: “Het is nu volgens de wet de verantwoordelijkheid van Tesla om consumenten kosteloos een oplossing te bieden die het veiligheidsgebrek volledig aanpakt.” Vorige week zei Tesla dat het een “morele verplichting” heeft om zijn veiligheidssystemen te blijven verbeteren en zei ook dat het “moreel onverdedigbaar” is om deze functies niet beschikbaar te maken voor een bredere groep consumenten.

Als onderdeel van de terugroepactie stemde Tesla ermee in een software-update uit te brengen die nieuwe ‘controles en waarschuwingen’ bevatte, zoals ‘aanvullende controles’ wanneer bestuurders de functies buiten autosnelwegen activeren. De update zal ook de mogelijkheid van bestuurders om Autosteer te gebruiken opschorten als ze er herhaaldelijk niet in slagen betrokken te blijven tijdens het gebruik ervan, met de ogen op de weg en de handen aan het stuur.

Het Operationeel Ontwerpdomein

Nergens in de terugroeptaal zegt het bedrijf echter dat het de technologie zal beperken tot zijn zogenaamde Operational Design Domain (ODD), de industriële term voor de specifieke locaties en omstandigheden waarvoor Autopilot is ontworpen. Dat betekent dat consumenten de functie buiten de ODD nog steeds kunnen gebruiken en eenvoudigweg meer waarschuwingen en voorzorgsmaatregelen zullen ervaren als ze dat doen. Washington Post notities. In een verklaring aan De Post Vorige week zei NHTSA dat het te complex en te arbeidsintensief zou zijn om te verifiëren dat systemen zoals Tesla Autopilot binnen de ODD worden gebruikt. Het uitte ook de twijfel dat dit het probleem zou oplossen.

Tesla-criticus Dan O'Dowd, die heeft aangedrongen op het verbieden van de software van het bedrijf via zijn belangenorganisatie, het Dawn Project, zei dat de terugroepactie tekortschoot. “De juiste oplossing is om de defecte software van Tesla te verbieden, en niet om mensen te dwingen er beter op te letten”, zei hij in een verklaring. “De terugroepactie van de NHTSA mist het punt dat Tesla de onderliggende veiligheidsfouten in zijn zelfrijdende software moet aanpakken en oplossen om verdere sterfgevallen te voorkomen.”

Jennifer Homendy, de voorzitter van de National Transportation Safety Board, heeft kritiek geuit op de aanpak van de toezichthouders bij NHTSA. Ze zei dat ze blij was dat de dienst actie ondernam, ook al komt dit zeven jaar na het eerste bekende dodelijke ongeval met de Autopilot. “Ze moeten verifiëren dat de aangebrachte wijziging ook daadwerkelijk wordt doorgevoerd. En hoe kun je dat dan verifiëren met een vrijwillige terugroepactie?” Veronica Morales zei dat NHTSA verschillende Tesla’s zal testen in een autocentrum in Ohio om ‘de geschiktheid van de oplossingen te evalueren’.

Gene Munster, managing partner bij Deepwater Asset Management, zei dat hij niet verwacht dat deze terugroepactie Tesla ervan zal weerhouden agressief voort te gaan op Musk’s visie van volledig autonoom rijden. “Mensen zullen [Autopilot] nog steeds gebruiken”, zei hij. “Ik denk niet dat NHTSA de wegen meetbaar veiliger heeft gemaakt door deze meldingen te hebben, en ik denk niet dat Tesla hierdoor zijn achtervolging gaat vertragen.”

Ons advies

Dit is een enorm omstreden kwestie. Ons verhaal van vorige week kreeg bijna 200 reacties, waarvan sommige Elon Musk heilig verklaarden, terwijl anderen precies het tegenovergestelde suggereerden. Rond de CleanTechnica Kortom, de consensus is dat als de software weet dat deze zich niet op een gecontroleerde toegangsweg bevindt, deze niet mag worden geactiveerd. Periode. Punt. Wij zijn het erover eens dat Tesla een “morele verplichting” heeft om zijn veiligheidssystemen te blijven verbeteren. Tesla weet hoe het probleem moet worden opgelost. Het moet gewoon doorgaan.

Heeft u een tip voor CleanTechnica? Wilt u adverteren? Wilt u een gast voorstellen voor onze CleanTech Talk-podcast? Neem hier contact met ons op.

Onze nieuwste EVObsession-video

[Ingesloten inhoud]

Ik hou niet van betaalmuren. Je houdt niet van betaalmuren. Wie houdt er van betaalmuren? Hier bij CleanTechnica hebben we een tijdje een beperkte betaalmuur geïmplementeerd, maar het voelde altijd verkeerd – en het was altijd moeilijk om te beslissen wat we daarachter moesten zetten. In theorie bevindt uw meest exclusieve en beste inhoud zich achter een betaalmuur. Maar dan lezen minder mensen het!! Daarom hebben we besloten om de betaalmuren hier bij CleanTechnica volledig te schrappen. Maar…

Bedankt!

advertentie

CleanTechnica maakt gebruik van affiliatielinks. Zie ons beleid hier.

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- PlatoData.Network Verticale generatieve AI. Versterk jezelf. Toegang hier.

- PlatoAiStream. Web3-intelligentie. Kennis versterkt. Toegang hier.

- PlatoESG. carbon, CleanTech, Energie, Milieu, Zonne, Afvalbeheer. Toegang hier.

- Plato Gezondheid. Intelligentie op het gebied van biotech en klinische proeven. Toegang hier.

- Bron: https://cleantechnica.com/2023/12/17/tesla-recall-wont-fix-autopilot-problems-critics-say/

- : heeft

- :is

- :niet

- :waar

- $UP

- 15%

- 200

- 36

- a

- vermogen

- in staat

- Over

- versnellen

- versnelling

- toegang

- Actie

- geactiveerd

- activerende

- werkelijk

- toevoegen

- adres

- adressen

- toereikendheid

- administratie

- vergevorderd

- Adverteer

- voorspraak

- Affiliate

- Na

- agentschap

- agressief

- geleden

- afgesproken

- vooruit

- AIR

- Alarm

- meldingen

- Alles

- bijna

- ook

- altijd

- an

- en

- aangekondigd

- Nog een

- elke

- iedereen

- Solliciteer

- nadering

- ZIJN

- argument

- rond

- AS

- aanwinst

- vermogensbeheer

- Hulp

- At

- pogingen

- Hoorbaar

- automotive

- autonoom

- automatische piloot

- Beschikbaar

- ban

- verboden

- barrière

- BE

- omdat

- geweest

- achter

- wezen

- klokken

- BEST

- biden

- Biden-administratie

- Beetje

- boord

- maar

- by

- CAN

- auto

- auto's

- Centreren

- zeker

- Voorzitter

- verandering

- Wijzigingen

- lading

- opladen

- spaander

- Kies

- situatie

- Plaats

- geklasseerd

- cleantech

- Cleantech-talk

- duidelijk

- van nabij

- hoe

- komt

- opmerkingen

- Bedrijven

- afstand

- Bedrijf

- Voltooid

- compleet

- complex

- nakoming

- Bezorgdheid

- Zorgen

- voorwaarden

- samenwerking

- Connecticut

- Overeenstemming

- Consumenten

- bevatte

- content

- voortzetten

- doorlopend

- onder controle te houden

- gecontroleerd

- controles

- coördinatie

- te corrigeren

- kon

- land

- kritisch

- Critici

- Cross

- cruise

- doden

- beslissen

- beslist

- Verdedigen

- gedefinieerd

- Design

- ontworpen

- gegevens

- do

- doet

- Nee

- doen

- domein

- don

- gedaan

- Dont

- twijfelen

- beneden

- bestuurder

- chauffeurs

- aandrijving

- e

- En het is heel gemakkelijk

- Elektrisch

- elektrische voertuigen

- Elon

- Elon Musk

- ingebed

- opkomende

- handhaving

- toegewijd

- bezig

- engagement

- enorm

- Onstpanning

- Event

- Nieuwste vermeldingen

- verwachten

- ervaring

- uitgedrukt

- Ogen

- FAIL

- ver

- Kenmerk

- Voordelen

- vilt

- minder

- finale

- Voornaam*

- Bepalen

- vlaggen

- knipperende

- Voor

- Dwingen

- Gratis

- veelvuldig

- oppompen van

- vol

- geheel

- verder

- krijgen

- gegeven

- Go

- Goes

- gaan

- goed

- Kopen Google Reviews

- kreeg

- Groep

- Gast

- handen

- Happening

- harder

- haat

- Hebben

- met

- he

- Held

- hulp

- hier

- Snelweg

- snelwegen

- zijn

- geschiedenis

- Hit

- hoop

- Hoe

- How To

- Echter

- HTTPS

- Enorm

- i

- if

- geïmplementeerd

- het verbeteren van

- in

- omvat

- Inclusief

- aangegeven

- -industrie

- beïnvloeden

- bestemde

- tussenkomen

- in

- onderzoek

- kwestie

- IT

- HAAR

- jpg

- voor slechts

- bekend

- weet

- taal

- Achternaam*

- laatste

- Wet

- wetgevers

- verhuur

- Niveau

- als

- sympathieën

- beperkingen

- Beperkt

- links

- locaties

- lot

- gemaakt

- onderhouden

- maken

- management

- beheren

- managing partner

- Matthew

- Mei..

- kan zijn

- middel

- Media

- voldaan

- miljoen

- gemiste

- misses

- misbruik

- monitor

- meer

- meest

- beweging

- Muskus

- Dan moet je

- nationaal

- bijna

- Noodzaak

- nodig

- New

- New York

- nieuws

- Opmerkingen

- niets

- meldingen

- nu

- hindernis

- of

- korting

- Ohio

- on

- open

- werkzaam

- operatie

- operationele

- operator

- kansen

- tegenover

- or

- Overige

- Overig

- onze

- uit

- buiten

- over

- pakket

- deel

- partner

- Mensen

- uitgevoerd

- periode

- Plato

- Plato gegevensintelligentie

- PlatoData

- speler

- verheugd

- Podcast

- punt

- beleidsmaatregelen

- voorkomen

- prioriteit

- probleem

- problemen

- Hoogleraar

- project

- voorgestelde

- zorgen voor

- publiceren

- achtervolging

- geduwd

- zetten

- heel

- Lees

- Lezer

- werkelijk

- Beschouwen

- Regelgevers

- resterende

- stoffelijk overschot

- HERHAALDELIJK

- nodig

- hulpbron

- verantwoordelijkheid

- verantwoordelijk

- beperken

- Revealed

- Richard

- weg

- wegen

- reglement

- veilig

- veiliger

- Veiligheid

- Zei

- ervaren

- zegt

- School

- zien

- zelfrijdende

- Senator

- ernstig

- service

- reeks

- zeven

- verscheidene

- ze

- Bermuda's

- moet

- aanzienlijke

- eenvoudigweg

- situaties

- traag

- So

- Software

- software-update

- uitverkocht

- oplossing

- sommige

- specialiseert

- specifiek

- Statement

- verklaringen

- blijven

- sturen

- besturing

- stuur

- Still

- stop

- Blog

- straten

- onderwerpen

- dergelijk

- voldoende

- stel

- ondersteuning

- nabijgelegen

- Opschorten

- volgehouden

- system

- Systems

- T

- Nemen

- ingenomen

- Talk

- team

- technisch

- Technologies

- Technologie

- termijn

- Tesla

- Tesla-stuurautomaat

- tesla

- proef

- neem contact

- dat

- De

- de wet

- hun

- harte

- theorie

- Er.

- Deze

- ze

- denken

- dit

- toch?

- Door

- keer

- type

- naar

- vertelde

- ook

- taai

- verkeer

- overgang

- vervoer

- voor

- die ten grondslag liggen

- bijwerken

- updates

- us

- .

- gebruikt

- toepassingen

- gebruik

- Ve

- voertuig

- Voertuigen

- controleren

- via

- Video

- visie

- Bezoek

- visuele

- vrijwillig

- wachten

- willen

- was

- Bekijk de introductievideo

- we

- week

- waren

- Wat

- Wiel

- wanneer

- welke

- en

- WIE

- geheel

- Waarom

- bredere

- wil

- Met

- binnen

- Won

- zou

- schrijven

- Verkeerd

- jaar

- nog

- york

- u

- Your

- youtube

- zephyrnet