Ik sprak onlangs met Stelios Diamantidis (Distinguished Architect, Head of Strategy, Autonomous Design Solutions) over de aankondiging van Synopsys op de 100th tape-out van klanten met behulp van hun DSO.ai-oplossing. Mijn zorg bij AI-gerelateerde artikelen is het vermijden van de hype rond AI in het algemeen, en omgekeerd de scepsis als reactie op die hype die sommigen ertoe aanzet om alle AI-claims af te doen als slangenolie. Ik was blij om Stelios te horen lachen en was het er helemaal mee eens. We hadden een zeer gefundeerde discussie over wat DSO.ai vandaag kan doen, wat hun referentieklanten zien in de oplossing (gebaseerd op wat het vandaag kan doen) en wat hij me kon vertellen over de technologie.

Wat DSO.ai doet

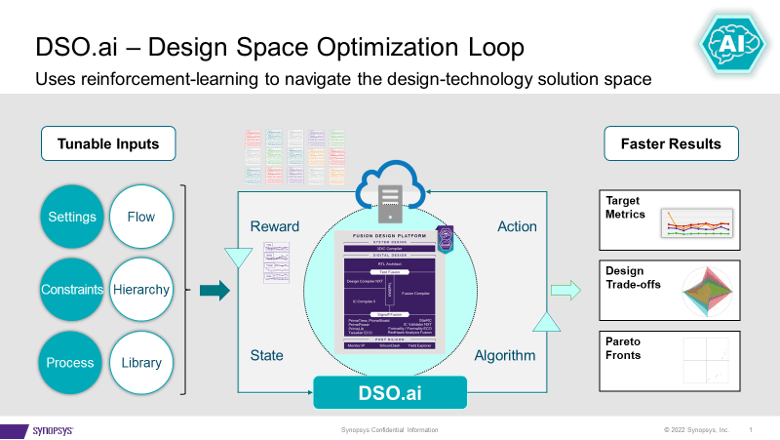

DSO.ai koppelt met Fusion Compiler en IC Compiler II, wat, zoals Stelios zorgvuldig benadrukte, betekent dat dit een optimalisatie-oplossing op blokniveau is; Volledige SoC's zijn nog geen doelwit. Dit past bij de huidige ontwerppraktijken, zoals Stelios zei, een belangrijk doel is om gemakkelijk in bestaande stromen te passen. Het doel van de technologie is om implementatie-engineers, vaak een enkele engineer, in staat te stellen hun productiviteit te verbeteren en tegelijkertijd een grotere ontwerpruimte te verkennen voor een betere PPA dan anders mogelijk zou zijn geweest.

Synopsys kondigde de eerste tape-out aan in de zomer van 2021 en heeft nu 100 tape-outs aangekondigd. Dat spreekt goed voor de vraag naar en effectiviteit van een oplossing als deze. Stelios voegde eraan toe dat de waarde nog duidelijker wordt voor applicaties die een blok vele malen moeten instantiëren. Denk aan een many-core server, een GPU of een netwerkswitch. Eén keer een blok optimaliseren, meerdere keren instantiëren – dat kan een aanzienlijke PPA-verbetering opleveren.

Ik vroeg of klanten die dit doen allemaal werken op 7nm en lager. Verrassend genoeg is er actief gebruik tot 40nm. Een interessant voorbeeld is een flitscontroller, een ontwerp dat niet erg prestatiegevoelig is, maar tientallen tot honderden miljoenen eenheden kan hebben. Het verkleinen van de grootte, zelfs met 5%, kan hier een grote impact hebben op de marges.

Wat zit er onder de motorkap?

DSO.ai is gebaseerd op Reinforcement Learning, een hot topic tegenwoordig, maar ik beloofde geen hype in dit artikel. Ik vroeg Stelios om wat dieper in te gaan, maar was niet verrast toen hij zei dat hij niet teveel kon onthullen. Wat hij me kon vertellen was interessant genoeg. Hij wees erop dat in meer algemene toepassingen één cyclus door een trainingsset (een tijdperk) een snelle (seconden tot minuten) methode veronderstelt om de volgende mogelijke stappen te beoordelen, bijvoorbeeld door middel van gradiëntvergelijkingen.

Maar serieus blokontwerp kan niet worden geoptimaliseerd met snelle schattingen. Elke proef moet de volledige productiestroom doorlopen, in overeenstemming met echte productieprocessen. Stromen die uren kunnen duren. Een deel van de strategie voor effectief versterkend leren, gezien deze beperking, is parallellisme. De rest is geheime saus van DSO.ai. Je kunt je zeker voorstellen dat als die geheime saus op de proppen kan komen met effectieve verfijningen op basis van een bepaald tijdperk, parallellisme de voortgang door het volgende tijdperk zal versnellen.

Daartoe moet deze mogelijkheid echt in een cloud draaien om parallellisme te ondersteunen. Private on-premises cloud is een optie. Microsoft heeft aangekondigd dat ze DSO.ai hosten op Azure, en ST meldt in het DSO.ai-persbericht dat ze deze mogelijkheid hebben gebruikt om de implementatie van een Arm-kern te optimaliseren. Ik stel me voor dat er een aantal interessante debatten kunnen ontstaan over de voor- en nadelen van het uitvoeren van een optimalisatie in een openbare cloud op bijvoorbeeld 1000 servers als de vermindering van het gebied de moeite waard is.

Klanten feedback

Synopsys claimt dat klanten (waaronder ST en SK Hynix in deze aankondiging) 3x+ productiviteitsstijgingen, tot 25% lager totaal vermogen en significante kleinere matrijsafmetingen rapporteren, allemaal met minder gebruik van de totale middelen. Gezien wat Stelios beschreef, klinkt dit redelijk voor mij. Met de tool kunnen binnen een bepaald schema meer punten in de ontwerptoestandsruimte worden verkend dan mogelijk zou zijn als die verkenning handmatig zou zijn. Zolang het zoekalgoritme (de geheime saus) effectief is, zou dat natuurlijk een beter optimum opleveren dan handmatig zoeken.

Kortom, noch AI-hype noch snake oil. DSO.ai suggereert dat AI de mainstream betreedt als een geloofwaardige technische uitbreiding van bestaande stromen. U kunt meer leren van de persbericht en van deze blog.

Deel dit bericht via:

- Door SEO aangedreven content en PR-distributie. Word vandaag nog versterkt.

- Platoblockchain. Web3 Metaverse Intelligentie. Kennis versterkt. Toegang hier.

- Bron: https://semiwiki.com/artificial-intelligence/324430-synopsys-design-space-optimization-hits-a-milestone/

- 100

- 2021

- a

- Over

- versnellen

- over

- actieve

- toegevoegd

- AI

- algoritme

- Alles

- toestaat

- en

- aangekondigd

- Aankondiging

- toepassingen

- GEBIED

- ARM

- rond

- dit artikel

- artikelen

- autonoom

- het vermijden van

- Azuur

- gebaseerde

- wordt

- onder

- Betere

- Groot

- Beetje

- Blok

- voorzichtig

- zeker

- vorderingen

- Cloud

- hoe

- Bezorgdheid

- NADELEN

- controleur

- Kern

- kon

- cursus

- geloofwaardig

- Actueel

- klant

- Klanten

- cyclus

- dagen

- debatten

- Vraag

- beschreven

- Design

- De

- discussie

- Ontslaan

- Gedistingeerd

- doen

- beneden

- elk

- gemakkelijk

- effectief

- effectiviteit

- benadrukken

- in staat stellen

- ingenieur

- Engineering

- Ingenieurs

- genoeg

- tijdperk

- schattingen

- Zelfs

- voorbeeld

- bestaand

- exploratie

- Verkennen

- uitbreiding

- SNELLE

- VIND DE PLEK DIE PERFECT VOOR JOU IS

- Voornaam*

- geschikt

- flash

- stroom

- Stromen

- oppompen van

- vol

- fusie

- Algemeen

- gegeven

- doel

- GPU

- gelukkig

- hoofd

- hier

- Hits

- Hosting

- Populair

- HOURS

- HTTPS

- Hype

- Impact

- uitvoering

- belangrijk

- verbeteren

- verbetering

- in

- Inclusief

- Verhoogt

- interessant

- IT

- groter

- lachen

- LEARN

- leren

- lang

- gemaakt

- Hoofdstroom

- handboek

- productie

- veel

- in kaart brengen

- marges

- max-width

- middel

- methode

- Microsoft

- macht

- mijlpaal

- miljoen

- minuten

- meer

- Noch

- netwerk

- volgende

- Voor de hand liggend

- Olie

- EEN

- optimalisatie

- Optimaliseer

- geoptimaliseerde

- optimum

- Keuze

- anders-

- totaal

- deel

- prestatie

- Plato

- Plato gegevensintelligentie

- PlatoData

- punt

- punten

- mogelijk

- Post

- energie

- praktijken

- pers

- Persbericht

- privaat

- processen

- productie

- produktiviteit

- Voortgang

- beloofde

- PROS

- publiek

- public cloud

- doel

- Quick

- reactie

- vast

- redelijk

- onlangs

- Gereduceerd

- vermindering

- versterking van leren

- los

- verslag

- Rapportage

- Resources

- REST

- onthullen

- lopen

- lopend

- Zei

- rooster

- Ontdek

- seconden

- Geheim

- gevoelig

- ernstig

- reeks

- Bermuda's

- aanzienlijke

- single

- Maat

- Scepticisme

- oplossing

- Oplossingen

- sommige

- Tussenruimte

- spreekt

- Land

- Stappen

- Strategie

- Stelt voor

- zomer

- ondersteuning

- verwonderd

- Stap over voor slechts

- Nemen

- doelwit

- Technologie

- De

- De omgeving

- hun

- Door

- keer

- naar

- vandaag

- ook

- tools

- onderwerp

- Totaal

- Trainingen

- proces

- voor

- eenheden

- .

- waarde

- via

- Wat

- welke

- en

- wil

- binnen

- werkzaam

- waard

- zou

- zephyrnet