生成 AI の出現により、大規模言語モデル (LLM) である Claude 2 や Llama 2 などの今日の基盤モデル (FM) は、テキスト データに対する質問応答、要約、コンテンツ作成などのさまざまな生成タスクを実行できるようになりました。ただし、現実世界のデータは、テキスト、画像、ビデオ、オーディオなどの複数の形式で存在します。たとえば、PowerPoint のスライドデッキを考えてみましょう。情報はテキスト形式で含まれることも、グラフ、表、画像に埋め込まれることもあります。

この投稿では、次のようなマルチモーダル FM を使用するソリューションを紹介します。 Amazon Titan マルチモーダル埋め込み モデルと LLaVA 1.5 および AWS サービスを含む アマゾンの岩盤 および アマゾンセージメーカー マルチモーダル データに対して同様の生成タスクを実行します。

ソリューションの概要

このソリューションは、スライドデッキのテキストおよび視覚要素に含まれる情報を使用して質問に答えるための実装を提供します。この設計は、検索拡張生成 (RAG) の概念に基づいています。従来、RAG は LLM で処理できるテキスト データに関連付けられてきました。この投稿では、RAG を拡張して画像も含めます。これにより、テキストとともに表やグラフなどの視覚要素から文脈に関連したコンテンツを抽出する強力な検索機能が提供されます。

画像を含む RAG ソリューションを設計するには、さまざまな方法があります。ここでは 1 つのアプローチを紹介しましたが、この 3 部構成シリーズの 2 番目の投稿で別のアプローチをフォローアップします。

このソリューションには、次のコンポーネントが含まれています。

- Amazon Titan マルチモーダル埋め込みモデル – この FM は、この投稿で使用されているスライドデッキ内のコンテンツの埋め込みを生成するために使用されます。マルチモーダル モデルとして、この Titan モデルは、テキスト、画像、またはその組み合わせを入力として処理し、埋め込みを生成できます。 Titan Multimodal Embeddings モデルは 1,024 次元のベクトル (埋め込み) を生成し、Amazon Bedrock 経由でアクセスします。

- 大規模言語視覚アシスタント (LLaVA) – LLaVA は、視覚的および言語理解のためのオープンソースのマルチモーダル モデルであり、グラフや表などの視覚要素を含むスライド内のデータを解釈するために使用されます。 7億パラメータバージョンを使用します LLaVA 1.5-7b このソリューションでは。

- アマゾンセージメーカー – LLaVA モデルは、SageMaker ホスティング サービスを使用して SageMaker エンドポイントにデプロイされ、結果のエンドポイントを使用して LLaVA モデルに対して推論を実行します。また、このソリューションをエンドツーエンドで調整し、デモするために SageMaker ノートブックも使用します。

- Amazon OpenSearch サーバーレス – OpenSearch Serverless は、オンデマンドのサーバーレス構成です。 AmazonOpenSearchサービス。 Titan Multimodal Embeddings モデルによって生成されたエンベディングを保存するためのベクトル データベースとして OpenSearch Serverless を使用します。 OpenSearch Serverless コレクションで作成されたインデックスは、RAG ソリューションのベクター ストアとして機能します。

- Amazon OpenSearch インジェスト (OSI) – OSI は、OpenSearch サービス ドメインおよび OpenSearch サーバーレス コレクションにデータを配信する、フルマネージドのサーバーレス データ コレクターです。この投稿では、OSI パイプラインを使用してデータを OpenSearch サーバーレス ベクター ストアに配信します。

ソリューションのアーキテクチャ

ソリューション設計は、取り込みとユーザー対話の 2 つの部分で構成されます。取り込み中に、各スライドを画像に変換することによって入力スライド デッキを処理し、これらの画像の埋め込みを生成して、ベクター データ ストアにデータを追加します。これらのステップは、ユーザー対話ステップの前に完了します。

ユーザー インタラクション フェーズでは、ユーザーからの質問が埋め込みに変換され、ベクトル データベース上で類似性検索が実行され、ユーザーの質問に対する回答が含まれている可能性のあるスライドが検索されます。次に、このスライド (画像ファイルの形式) を LLaVA モデルに提供し、クエリに対する回答を生成するためのプロンプトとしてユーザーの質問を提供します。この投稿のコードはすべて次の場所にあります。 GitHubの レポ。

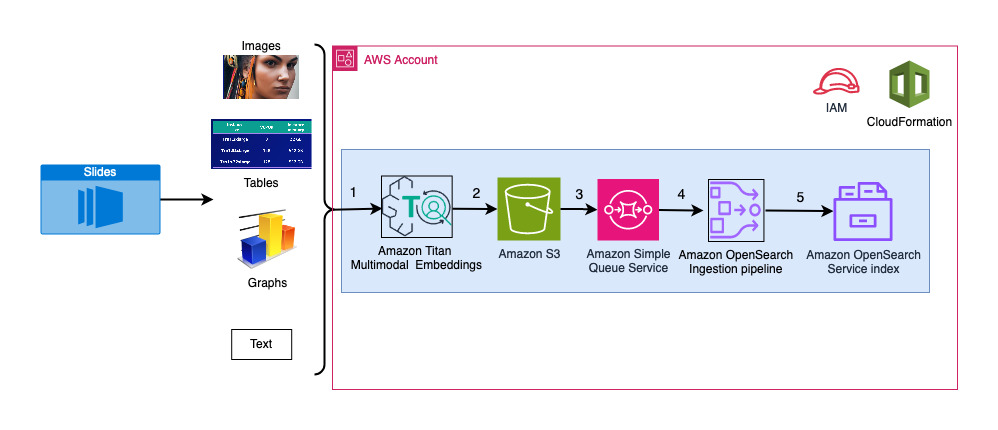

次の図は、取り込みアーキテクチャを示しています。

ワークフローの手順は次のとおりです。

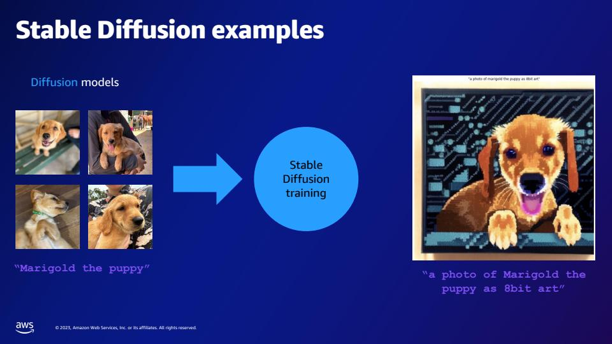

- スライドは JPG 形式の画像ファイル (スライドごとに 1 つ) に変換され、Titan Multimodal Embeddings モデルに渡されて埋め込みを生成します。この投稿では、というタイトルのスライドデッキを使用します。 AWS Trainium と AWS Inferentia を使用した Stable Diffusion のトレーニングとデプロイ 2023 年 31 月にトロントで開催された AWS サミットから、ソリューションをデモンストレーションします。サンプルデッキには 31 枚のスライドがあるため、それぞれ 1,024 次元を持つ XNUMX セットのベクトル埋め込みを生成します。これらの生成されたベクトル埋め込みに追加のメタデータ フィールドを追加し、JSON ファイルを作成します。これらの追加のメタデータ フィールドを使用すると、OpenSearch の強力な検索機能を使用して豊富な検索クエリを実行できます。

- 生成された埋め込みは 1 つの JSON ファイルにまとめられ、次の場所にアップロードされます。 Amazon シンプル ストレージ サービス (Amazon S3)。

- ビア AmazonS3イベント通知、イベントは Amazon シンプル キュー サービス (Amazon SQS)キュー。

- SQS キュー内のこのイベントは、OSI パイプラインを実行するトリガーとして機能し、OSI パイプラインはデータ (JSON ファイル) をドキュメントとして OpenSearch サーバーレス インデックスに取り込みます。 OpenSearch サーバーレス インデックスは、このパイプラインのシンクとして構成され、OpenSearch サーバーレス コレクションの一部として作成されることに注意してください。

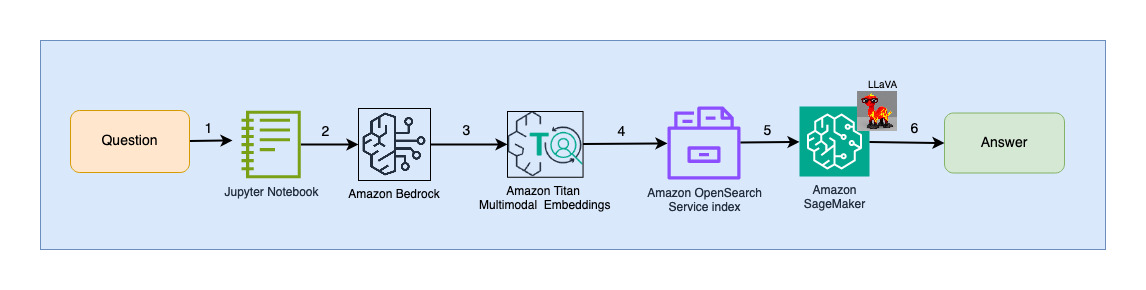

次の図は、ユーザー対話アーキテクチャを示しています。

ワークフローの手順は次のとおりです。

- ユーザーは、取り込まれたスライドデッキに関連する質問を送信します。

- ユーザー入力は、Amazon Bedrock 経由でアクセスされる Titan Multimodal Embeddings モデルを使用して埋め込みに変換されます。 OpenSearch ベクトル検索は、これらの埋め込みを使用して実行されます。 k 最近傍 (k=1) 検索を実行して、ユーザーのクエリに一致する最も関連性の高い埋め込みを取得します。 k=1 に設定すると、ユーザーの質問に最も関連性の高いスライドが取得されます。

- OpenSearch Serverless からの応答のメタデータには、最も関連性の高いスライドに対応する画像へのパスが含まれています。

- プロンプトはユーザーの質問と画像パスを組み合わせて作成され、SageMaker でホストされている LLaVA に提供されます。 LLaVA モデルは、画像内のデータを調べることでユーザーの質問を理解し、それに答えることができます。

- この推論の結果はユーザーに返されます。

これらの手順については、次のセクションで詳しく説明します。を参照してください。 結果 スクリーンショットと出力の詳細についてはセクションを参照してください。

前提条件

この投稿で提供されているソリューションを実装するには、 AWSアカウント FM、Amazon Bedrock、SageMaker、OpenSearch Service に精通していること。

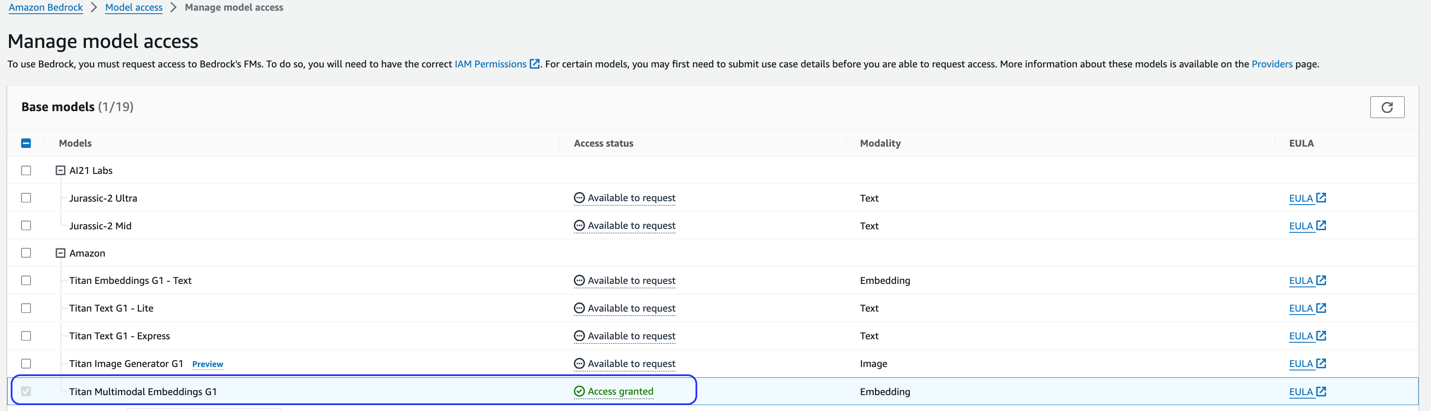

このソリューションでは、Titan マルチモーダル エンベディング モデルを使用します。このモデルが Amazon Bedrock で使用できるように設定されていることを確認してください。 Amazon Bedrock コンソールで、 モデルアクセス ナビゲーションペインで。 Titan Multimodal Embeddings が有効になっている場合、アクセス ステータスは次のようになります。 アクセスが許可されました.

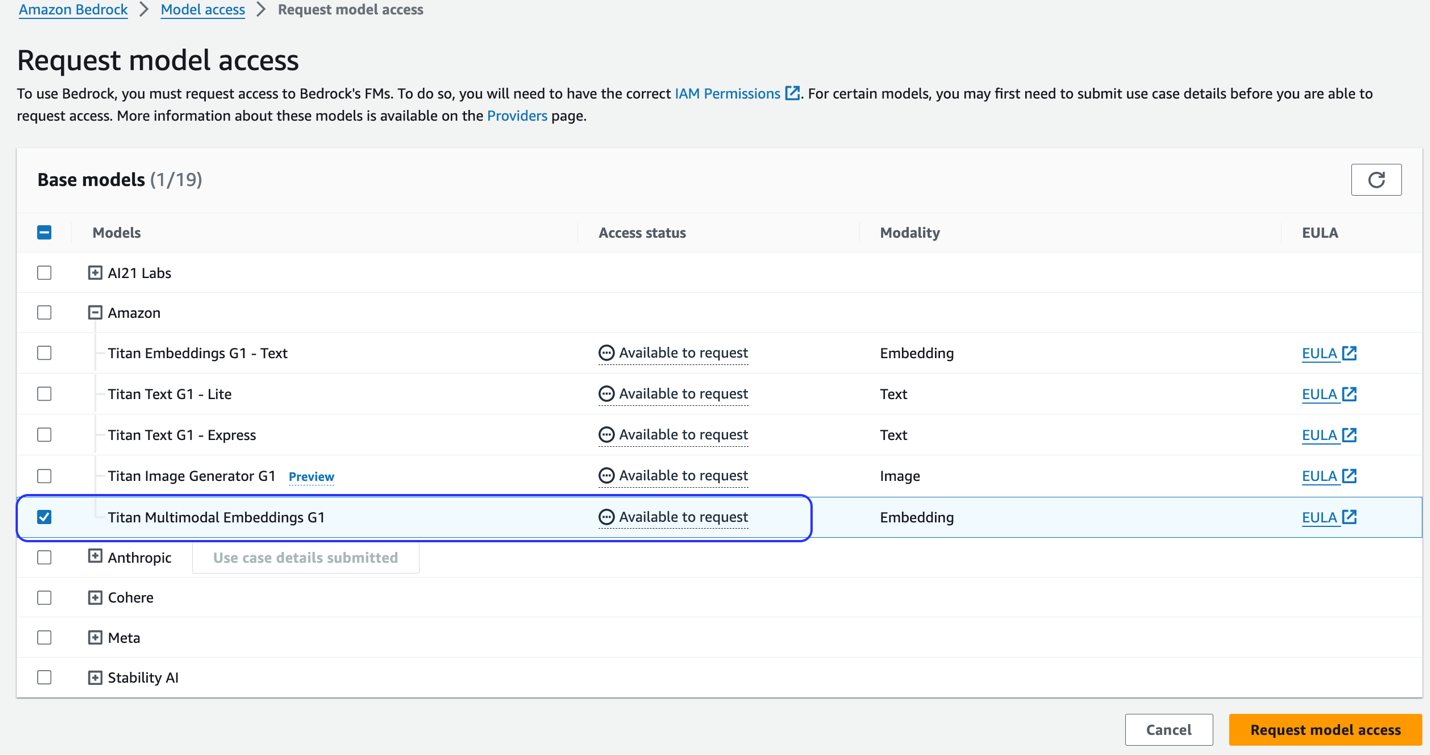

モデルが利用できない場合は、選択してモデルへのアクセスを有効にします。 モデルアクセスの管理選択する Titan マルチモーダル エンベディング G1、および選択 モデルへのアクセスをリクエストする。モデルはすぐに使用できるようになります。

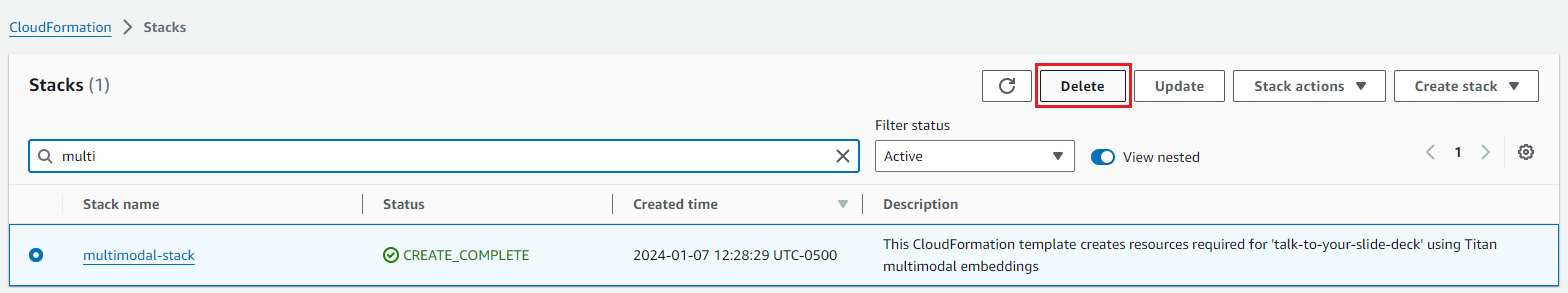

AWS CloudFormation テンプレートを使用してソリューション スタックを作成する

次のいずれかを使用します AWS CloudFormation テンプレート (地域に応じて) を使用して、ソリューション リソースを起動します。

| AWSリージョン | リンク |

|---|---|

us-east-1 |

|

us-west-2 |

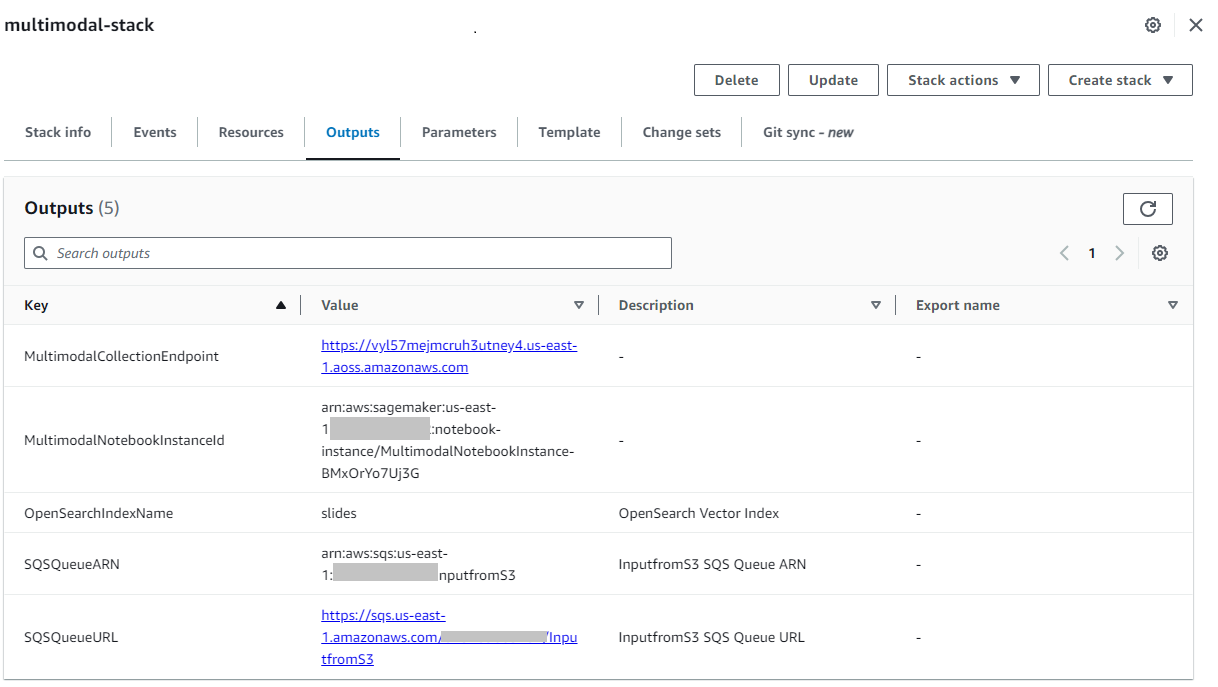

スタックが正常に作成されたら、スタックの 出力 AWS CloudFormation コンソールのタブに移動し、次の値をメモします。 MultimodalCollectionEndpoint、後続のステップで使用します。

CloudFormationテンプレートは、次のリソースを作成します。

- IAMの役割 - 次の AWS IDおよびアクセス管理 (IAM) ロールが作成されます。これらのロールを更新して適用します 最小特権のアクセス許可.

SMExecutionRoleAmazon S3、SageMaker、OpenSearch Service、Bedrock のフルアクセスを備えています。OSPipelineExecutionRole特定の Amazon SQS および OSI アクションにアクセスできます。

- SageMaker ノート – この投稿のコードはすべて、このノートブックを介して実行されます。

- OpenSearch サーバーレス コレクション – これは、エンベディングを保存および取得するためのベクトル データベースです。

- OSIパイプライン – これは、OpenSearch Serverless にデータを取り込むためのパイプラインです。

- S3バケット – この投稿のすべてのデータはこのバケットに保存されます。

- SQSキュー – OSI パイプラインの実行をトリガーするイベントは、このキューに入れられます。

CloudFormation テンプレートは、ソースとして Amazon S3 および Amazon SQS 処理を使用し、シンクとして OpenSearch サーバーレス インデックスを使用して OSI パイプラインを構成します。指定された S3 バケットとプレフィックス (multimodal/osi-embeddings-json) SQS 通知をトリガーします。この通知は、OSI パイプラインによって OpenSearch サーバーレスにデータを取り込むために使用されます。

CloudFormation テンプレートはまた、 ネットワーク, 暗号化, データアクセス OpenSearch サーバーレス コレクションに必要なポリシー。これらのポリシーを更新して、最小特権のアクセス許可を適用します。

CloudFormation テンプレート名は SageMaker ノートブックで参照されることに注意してください。デフォルトのテンプレート名が変更された場合は、必ず同じものを更新してください。 グローバル.py

ソリューションをテストする

前提条件の手順が完了し、CloudFormation スタックが正常に作成されたら、ソリューションをテストする準備が整いました。

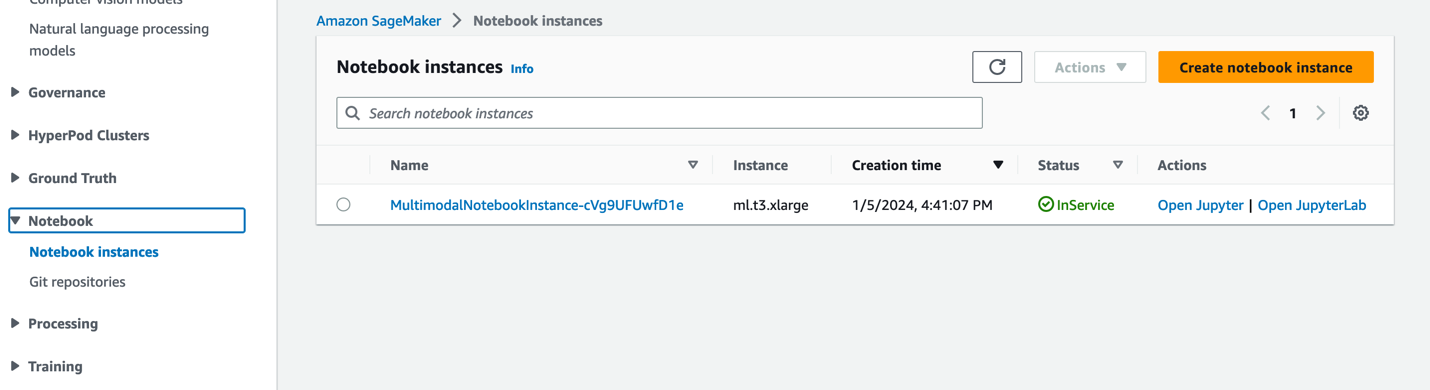

- SageMakerコンソールで、 ノートブック ナビゲーションペインに表示されます。

- 現在地に最も近い

MultimodalNotebookInstanceノートブック インスタンスを選択して JupyterLabを開く.

- In ファイルブラウザ、ノートブック フォルダーに移動して、ノートブックとサポート ファイルを表示します。

ノートブックには、実行される順序で番号が付けられます。各ノートブックの指示とコメントは、そのノートブックによって実行されるアクションを説明します。これらのノートブックを 1 つずつ実行します。

- 選択する 0_deploy_llava.ipynb JupyterLab で開きます。

- ソフトウェア設定ページで、下図のように ラン メニュー、選択 すべてのセルを実行 このノートブックのコードを実行します。

このノートブックは、LLaVA-v1.5-7B モデルを SageMaker エンドポイントにデプロイします。このノートブックでは、HuggingFace Hub から LLaVA-v1.5-7B モデルをダウンロードし、inference.py スクリプトを次のように置き換えます。 llava_inference.pyをクリックし、このモデルの model.tar.gz ファイルを作成します。 model.tar.gz ファイルは Amazon S3 にアップロードされ、SageMaker エンドポイントにモデルをデプロイするために使用されます。の llava_inference.py スクリプトには、Amazon S3 から画像ファイルを読み取り、それに対して推論を実行できるようにする追加のコードが含まれています。

- 選択する 1_data_prep.ipynb JupyterLab で開きます。

- ソフトウェア設定ページで、下図のように ラン メニュー、選択 すべてのセルを実行 このノートブックのコードを実行します。

このノートブックは、 スライドデッキ、各スライドを JPG ファイル形式に変換し、この投稿に使用した S3 バケットにアップロードします。

- 選択する 2_データ取り込み.ipynb JupyterLab で開きます。

- ソフトウェア設定ページで、下図のように ラン メニュー、選択 すべてのセルを実行 このノートブックのコードを実行します。

このノートブックでは次のことを行います。

- OpenSearch Serverless コレクションにインデックスを作成します。このインデックスには、スライドデッキの埋め込みデータが保存されます。次のコードを参照してください。

- Titan Multimodal Embeddings モデルを使用して、前のノートブックで作成した JPG 画像をベクター埋め込みに変換します。これらの埋め込みと追加のメタデータ (画像ファイルの S3 パスなど) は JSON ファイルに保存され、Amazon S3 にアップロードされます。単一の JSON ファイルが作成され、埋め込みに変換されたすべてのスライド (画像) のドキュメントが含まれることに注意してください。次のコード スニペットは、画像 (Base64 エンコードされた文字列の形式) がどのように埋め込みに変換されるかを示しています。

- このアクションにより、OpenSearch インジェスト パイプラインがトリガーされ、ファイルが処理されて OpenSearch サーバーレス インデックスに取り込まれます。以下は作成されたJSONファイルのサンプルです。 (コード例には 1,024 次元のベクトルが示されています。Titan マルチモーダル エンベディング モデルは XNUMX 次元を生成します。)

- 選択する 3_rag_inference.ipynb JupyterLab で開きます。

- ソフトウェア設定ページで、下図のように ラン メニュー、選択 すべてのセルを実行 このノートブックのコードを実行します。

このノートブックは RAG ソリューションを実装しています。ユーザーの質問を埋め込みに変換し、ベクター データベースから類似の画像 (スライド) を検索し、取得した画像を LLaVA に提供してユーザーの質問に対する回答を生成します。次のプロンプト テンプレートを使用します。

次のコード スニペットは、RAG ワークフローを提供します。

結果

以下は、実装によって生成されたいくつかのユーザーの質問と回答をまとめたものです。の 質問 列はユーザーの質問をキャプチャし、 回答 列は、LLaVA によって生成されたテキスト応答です。 画像 OpenSearch サーバーレス ベクトル検索によって返される k 近似 (k=1) スライド マッチです。このスライドは LLaVA によって解釈され、答えが提供されます。

マルチモーダル RAG の結果

| 質問 | 回答 | 画像 |

|---|---|---|

| Inf2 のパフォーマンスは、同等の EC2 インスタンスとどのように比較されますか?数字が必要なんです。 | スライド資料によると、AWS Inferentia2 による Inf2 インスタンスは、同等の EC4 インスタンスと比較して、最大 10 倍の高いスループットと 2 倍の低いレイテンシを提供します。 |  |

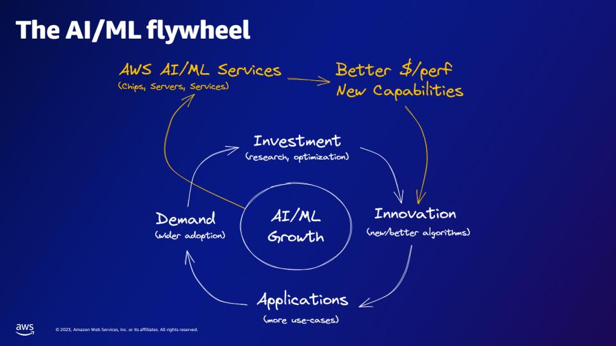

| AI/ML フライホイールによると、AWS AI/ML サービスは何を提供しますか? | AWS AI/ML サービスは、より優れた $/perfer 機能、新機能、イノベーションへの投資を提供します。 |  |

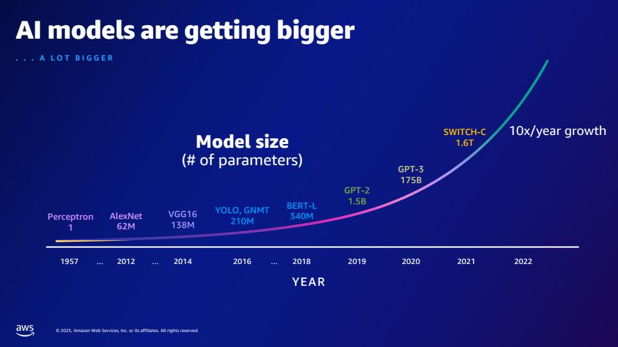

| GPT-2 と比較して、GPT-3 にはどれだけ多くのパラメーターがありますか? GPT-2とGPT-3のパラメータサイズの数値的な違いは何ですか? | スライドによると、GPT-3 には 175 億のパラメーターがあるのに対し、GPT-2 には 1.5 億のパラメーターがあります。 GPT-2 と GPT-3 のパラメータ サイズの数値差は 173.5 億です。 |  |

| 素粒子物理学におけるクォークとは何ですか? | この質問に対する答えはスライドデッキには見つかりませんでした。 |  |

このソリューションをスライドデッキに自由に拡張してください。 globals.py の SLIDE_DECK 変数をスライド デッキへの URL で更新し、前のセクションで説明した取り込み手順を実行するだけです。

先端

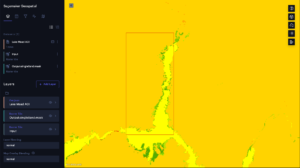

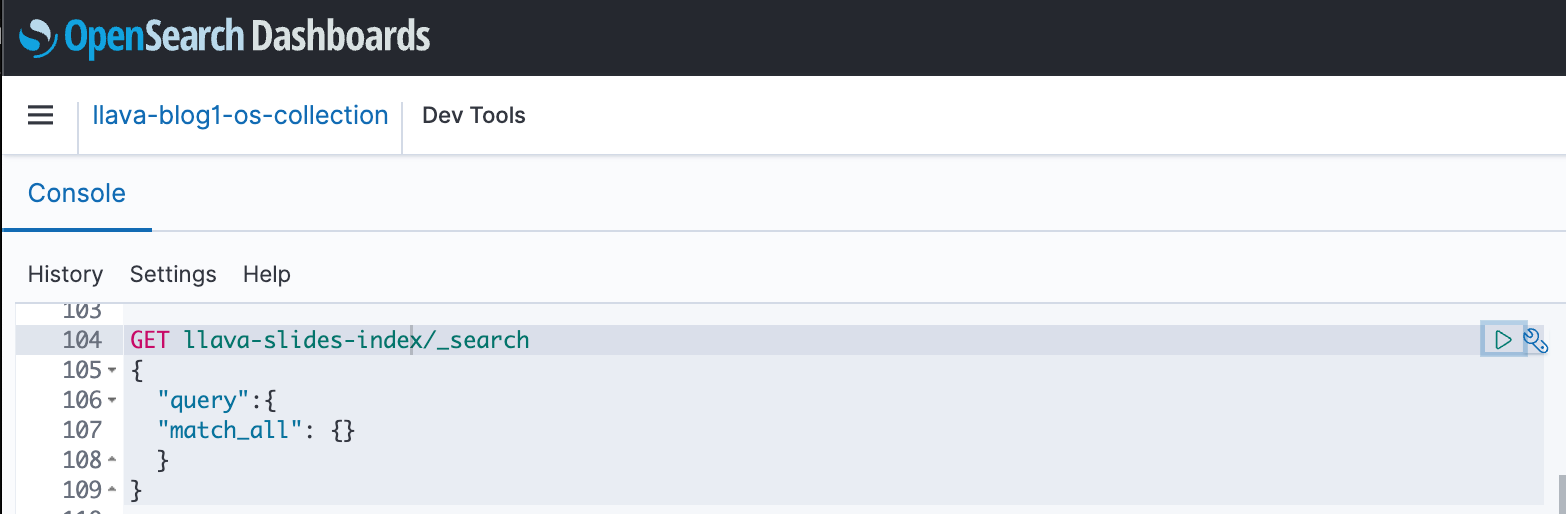

OpenSearch ダッシュボードを使用して OpenSearch API と対話し、インデックスと取り込まれたデータに対して簡単なテストを実行できます。次のスクリーンショットは、OpenSearch ダッシュボードの GET の例を示しています。

クリーンアップ

今後料金が発生しないようにするには、作成したリソースを削除してください。これを行うには、CloudFormation コンソールからスタックを削除します。

さらに、LLaVA 推論用に作成された SageMaker 推論エンドポイントを削除します。これを行うには、クリーンアップ ステップのコメントを解除します。 3_rag_inference.ipynb セルを実行するか、SageMaker コンソール経由でエンドポイントを削除します。 推論 および エンドポイント ナビゲーション ペインでエンドポイントを選択して削除します。

まとめ

企業は常に新しいコンテンツを生成しており、スライド デッキは、組織内で情報を共有し、外部で顧客やカンファレンスで情報を共有および配布するために使用される一般的なメカニズムです。時間の経過とともに、豊富な情報がこれらのスライドデッキのグラフや表などの非テキスト形式に埋もれ、隠されたままになる可能性があります。このソリューションと、Titan マルチモーダル エンベディング モデルや LLaVA などのマルチモーダル FM の機能を使用して、新しい情報を発見したり、スライド デッキのコンテンツに関する新しい視点を明らかにしたりできます。

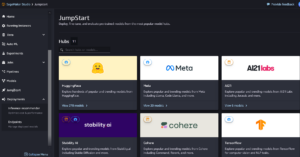

探索してさらに学ぶことをお勧めします Amazon SageMaker ジャンプスタート, アマゾンタイタンモデル、Amazon Bedrock、OpenSearch Service を利用し、この投稿で提供されているサンプル実装を使用してソリューションを構築します。

このシリーズの一部として、さらに 2 つの投稿を予定しています。パート 3 では、スライドデッキについて話すために使用できる別のアプローチについて説明します。このアプローチでは、LLaVA 推論を生成および保存し、それらの保存された推論を使用してユーザーのクエリに応答します。パート XNUMX では、XNUMX つのアプローチを比較します。

著者について

アミット・アロラ は、アマゾン ウェブ サービスの AI および ML スペシャリスト アーキテクトであり、企業顧客がクラウドベースの機械学習サービスを使用してイノベーションを迅速に拡張できるよう支援しています。 彼は、ワシントン DC のジョージタウン大学で修士課程のデータ サイエンスおよび分析プログラムの非常勤講師でもあります。

アミット・アロラ は、アマゾン ウェブ サービスの AI および ML スペシャリスト アーキテクトであり、企業顧客がクラウドベースの機械学習サービスを使用してイノベーションを迅速に拡張できるよう支援しています。 彼は、ワシントン DC のジョージタウン大学で修士課程のデータ サイエンスおよび分析プログラムの非常勤講師でもあります。

マンジュ・プラサド アマゾン ウェブ サービスの戦略アカウント部門のシニア ソリューション アーキテクトです。彼女は、主要な M&E 顧客に AI/ML を含むさまざまなドメインで技術的な指導を提供することに重点を置いています。 AWS に入社する前は、金融サービス部門の企業や新興企業向けのソリューションを設計および構築していました。

マンジュ・プラサド アマゾン ウェブ サービスの戦略アカウント部門のシニア ソリューション アーキテクトです。彼女は、主要な M&E 顧客に AI/ML を含むさまざまなドメインで技術的な指導を提供することに重点を置いています。 AWS に入社する前は、金融サービス部門の企業や新興企業向けのソリューションを設計および構築していました。

アルチャナ・イナプディ AWS のシニア ソリューション アーキテクトとして戦略的な顧客をサポートしています。彼女は、顧客のデータ分析およびデータベース ソリューションの設計と構築を支援してきた 10 年以上の経験があります。彼女は、テクノロジーを使用して顧客に価値を提供し、ビジネスの成果を達成することに情熱を持っています。

アルチャナ・イナプディ AWS のシニア ソリューション アーキテクトとして戦略的な顧客をサポートしています。彼女は、顧客のデータ分析およびデータベース ソリューションの設計と構築を支援してきた 10 年以上の経験があります。彼女は、テクノロジーを使用して顧客に価値を提供し、ビジネスの成果を達成することに情熱を持っています。

アンタラ・ライサ テキサス州ダラスを拠点とするアマゾン ウェブ サービスの AI および ML ソリューション アーキテクトで、戦略的な顧客をサポートしています。彼女は、AWS で大規模なエンタープライズ パートナーと協力した経験もあり、デジタル ネイティブの顧客向けのパートナー サクセス ソリューション アーキテクトとして働いていました。

アンタラ・ライサ テキサス州ダラスを拠点とするアマゾン ウェブ サービスの AI および ML ソリューション アーキテクトで、戦略的な顧客をサポートしています。彼女は、AWS で大規模なエンタープライズ パートナーと協力した経験もあり、デジタル ネイティブの顧客向けのパートナー サクセス ソリューション アーキテクトとして働いていました。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://aws.amazon.com/blogs/machine-learning/talk-to-your-slide-deck-using-multimodal-foundation-models-hosted-on-amazon-bedrock-and-amazon-sagemaker-part-1/

- :持っている

- :は

- :not

- :どこ

- $UP

- 1

- 10

- 100

- 13

- 視聴者の38%が

- 16

- 173

- 20

- 2023

- 26

- 29

- 31

- 8

- 9

- a

- できる

- 私たちについて

- アクセス

- アクセス

- アカウント

- 達成する

- Action

- 行動

- 使徒行伝

- 加えます

- NEW

- 付属

- 出現

- に対して

- AI

- AI / ML

- すべて

- 許す

- 沿って

- また

- Amazon

- アマゾンセージメーカー

- Amazon Webサービス

- an

- 分析論

- および

- 別の

- 回答

- 応答

- 回答

- どれか

- API

- 申し込む

- アプローチ

- アプローチ

- 建築

- です

- AS

- 頼む

- アシスタント

- 関連する

- At

- オーディオ

- 増強された

- 認証

- 利用できます

- 避ける

- AWS

- AWS CloudFormation

- ベース

- BE

- き

- より良いです

- の間に

- 10億

- ボディ

- ビルド

- 建物

- 内蔵

- ビジネス

- by

- 缶

- 機能

- 機能

- キャプチャ

- セル

- 変更

- 課金

- 選択する

- 選択する

- クライアント

- コード

- コレクション

- コレクション

- コレクタ

- コラム

- 組み合わせ

- 結合

- 注釈

- コマンドと

- 企業

- 匹敵します

- 比較します

- 比べ

- コンプリート

- 記入済みの

- コンポーネント

- コンセプト

- 会議

- 設定された

- からなる

- 領事

- 含む

- 含まれている

- 含まれています

- コンテンツ

- コンテンツ作成

- 変換

- 変換

- 変換

- 対応する

- 可能性

- カバー

- 作ります

- 作成した

- 作成します。

- 作成

- 創造

- Credentials

- 顧客

- Customers

- ダラス

- ダッシュボード

- ダッシュボード

- データ

- データ分析

- データサイエンス

- データベース

- 十年

- デッキ

- デフォルト

- 配信する

- 提供します

- 実証します

- によっては

- 展開します

- 展開

- 展開する

- 配備する

- 説明する

- 設計

- 設計

- 詳細

- 詳細な

- 細部

- ダイアグラム

- DICT

- DID

- 違い

- 異なります

- デジタル

- 次元

- 大きさ

- 発見する

- 議論する

- ディスプレイ

- do

- ドキュメント

- ありません

- ドメイン

- ダウンロード

- ダウンロード

- 間に

- e

- 各

- 要素は

- 埋め込まれた

- 埋め込み

- enable

- 使用可能

- エンコード

- 奨励する

- end

- エンドポイント

- エンジン

- 確保

- Enterprise

- 企業顧客

- エラー

- エーテル(ETH)

- イベント

- イベント

- 調べる

- 例

- 除く

- 例外

- 存在

- 体験

- 探る

- 伸ばす

- 外部から

- エキス

- 親しみ

- フィールズ

- File

- ファイナンシャル

- 金融業務

- もう完成させ、ワークスペースに掲示しましたか?

- 焦点を当てて

- フォロー中

- 次

- フォーム

- 形式でアーカイブしたプロジェクトを保存します.

- Foundation

- 4

- 無料版

- から

- フル

- 完全に

- 未来

- 生成する

- 生成された

- 生成

- 世代

- 生々しい

- 生成AI

- ジョージタウン

- 取得する

- GitHubの

- 行く

- グラフ

- ガイダンス

- 持ってる

- he

- 役立つ

- 助け

- こちら

- 隠されました

- より高い

- ヒット

- host

- 主催

- ホスティング

- ホスト

- 認定条件

- しかしながら

- HTML

- HTTP

- HTTPS

- ハブ

- 抱き合う顔

- i

- IAM

- アイデンティティ

- if

- 説明する

- 画像

- 画像

- 直ちに

- 実装する

- 実装

- 実装する

- in

- include

- 含ま

- 含めて

- index

- 索引

- 情報

- 革新的手法

- イノベーション

- インスタンス

- 説明書

- 対話

- 相互作用

- 内部で

- に

- 投資

- IT

- 参加

- JPG

- JSON

- 六月

- 言語

- 大

- レイテンシ

- 起動する

- LEARN

- 学習

- 講師

- ような

- LINK

- ラマ

- ローカル

- 下側

- 機械

- 機械学習

- make

- 管理します

- マネージド

- 多くの

- 一致

- マッチング

- メカニズム

- メニュー

- 方法

- ML

- モダリティ

- モデル

- 他には?

- 最も

- MS

- の試合に

- 名

- ネイティブ

- ナビゲート

- ナビゲーション

- 必要

- 新作

- なし

- 注意

- ノート

- ノートPC

- 通知

- 今

- 数の

- 番号

- オブジェクト

- of

- 提供

- on

- オンデマンド

- ONE

- の

- 開いた

- オープンソース

- or

- 組織

- OS

- 私たちの

- でる

- 成果

- 出力

- が

- ペイン

- パラメーター

- パラメータ

- 部

- 粒子

- パートナー

- パートナー

- 部品

- 渡された

- 情熱的な

- path

- 以下のために

- 実行する

- パフォーマンス

- 実行

- パーミッション

- 視点

- 相

- 物理学

- ピクチャー

- パイプライン

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- ポリシー

- ポスト

- 投稿

- :

- 電力

- 強力な

- Predictor

- 現在

- PLM platform.

- 前

- 事前の

- プロセス

- 処理されました

- ラボレーション

- 処理

- 演奏曲目

- プロパティ

- 提供します

- 提供

- は、大阪で

- 提供

- 置きます

- クォーク

- クエリ

- クエリー

- 質問

- 質問

- クイック

- ぼろ

- 範囲

- 急速に

- リーディング

- 準備

- 現実の世界

- 受け

- 参照

- 地域

- 関連する

- 関連した

- 残る

- replace

- 要求

- の提出が必要です

- リソース

- 反応します

- 応答

- 回答

- 結果

- 結果として

- 結果

- 検索

- return

- 富裕層

- 役割

- ラン

- ランニング

- セージメーカー

- SageMaker の推論

- 同じ

- 言う

- 規模

- 科学

- スクリーンショット

- スクリプト

- を検索

- 二番

- セクション

- セクション

- セクター

- select

- 選択

- シニア

- シーケンス

- シリーズ

- サーバレス

- 仕える

- サービス

- サービス

- セッション

- セット

- 設定

- 設定

- シェアする

- 彼女

- すべき

- 示す

- 作品

- 同様の

- 簡単な拡張で

- 単に

- サイズ

- スライド

- スライド

- スニペット

- So

- 溶液

- ソリューション

- 一部

- ソース

- 専門家

- 特定の

- 指定の

- 安定した

- スタック

- スタートアップ

- 都道府県

- Status:

- 手順

- ステップ

- ストレージ利用料

- 店舗

- 保存され

- 店舗

- 戦略的

- 文字列

- それに続きます

- 成功

- 首尾よく

- そのような

- サミット

- 支援する

- 確か

- テーブル

- 取る

- Talk

- タスク

- 技術的

- テクノロジー

- template

- テンプレート

- test

- テスト

- テキサス州

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- テキスト

- それ

- 情報

- アプリ環境に合わせて

- その後

- ボーマン

- この

- それらの

- スループット

- 時間

- タイタン

- タイトル

- 〜へ

- 今日の

- 一緒に

- トロント

- 伝統的に

- トラバース

- トリガー

- トリガー

- true

- 試します

- 順番

- 2

- type

- 明らかにする

- わかる

- 理解する

- 大学

- アップデイト

- アップロード

- URL

- つかいます

- 中古

- ユーザー

- 使用されます

- 値

- 変数

- 多様

- バージョン

- 、

- ビデオ

- 詳しく見る

- ビジョン

- ビジュアル

- ワシントン

- 方法

- we

- ウェブ

- Webサービス

- WELL

- この試験は

- 何ですか

- which

- while

- 意志

- 以内

- 働いていました

- ワークフロー

- ワーキング

- 貴社

- あなたの

- ゼファーネット