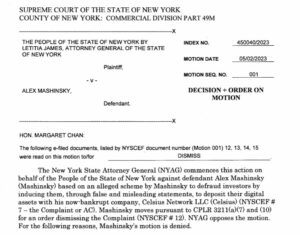

米国、英国、オーストラリア、その他 15 か国は、AI モデルを改ざんから保護するための世界的なガイドラインを発表し、企業に自社のモデルを「安全な設計」にするよう求めています。

26月18日、20カ国はXNUMXページにわたる報告書を発表した。 ドキュメント AI企業はAIモデルを開発または使用する際にサイバーセキュリティにどのように対処すべきかを概説し、ペースの速い業界では「セキュリティは二の次の考慮事項になり得る」と主張した。

このガイドラインは、AI モデルのインフラストラクチャに対する厳重な管理、リリース前後のモデルの改ざんの監視、サイバーセキュリティ リスクに関するスタッフのトレーニングなど、ほとんど一般的な推奨事項で構成されていました。

エキサイティングなニュースです! 私たちはと力を合わせました @NCSC と21の国際パートナーが「安全なAIシステム開発のためのガイドライン」を開発!これは、デジタル時代のセキュアな AI のために実行されている運用上のコラボレーションです。 https://t.co/DimUhZGW4R#AIセーフティ #SecureByDesign pic.twitter.com/e0sv5ACiC3

— サイバーセキュリティ・インフラセキュリティ庁 (@CISAgov) 2023 年 11 月 27 日

AI 分野での特定の物議を醸す問題については言及されていません。これには、AI の使用に関してどのような制御が必要かなども含まれます。 画像生成モデルとディープフェイク またはデータ収集方法とトレーニングモデルでの使用 - 見られる問題 複数のAI企業が訴訟を起こした 著作権侵害の申し立てについて。

アレハンドロ・マヨルカス米国国土安全保障長官は、「私たちは人工知能の開発の転換点にあり、人工知能はおそらく現代で最も重要な技術となるだろう」と語った。 と 声明で。 「サイバーセキュリティは、安全、安心、信頼できる AI システムを構築するための鍵です。」

関連する EUテクノロジー連合、EU AI法の完成前にAIの過剰規制を警告

このガイドラインは、政府や AI 企業など、AI に影響を与える他の政府の取り組みに従っています。 AIセーフティサミットのミーティング AI開発に関する合意を調整するため、今月初めにロンドンで会合を行った。

一方、欧州連合は、 詳細をハッシュ化する 宇宙を監督するAI法の制定と、ジョー・バイデン米国大統領が10月にAIの安全性とセキュリティの基準を定める大統領令を出したが、それは両方とも 反発を見てきました AI業界はイノベーションを抑制する可能性があると主張している。

新しい「安全な設計」ガイドラインの他の共同署名者には、カナダ、フランス、ドイツ、イスラエル、イタリア、日本、ニュージーランド、ナイジェリア、ノルウェー、韓国、シンガポールが含まれます。 OpenAI、Microsoft、Google、Anthropic、Scale AI などの AI 企業もガイドラインの開発に貢献しました。

マガジン: AI Eye: 暗号通貨における AI の実際の用途、Google の GPT-4 のライバル、不良従業員向けの AI エッジ

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://cointelegraph.com/news/us-britain-countries-ink-ai-cybersecurity-guidelines-secure-by-design

- :は

- 視聴者の38%が

- 26

- 27

- a

- 行為

- Action

- 後

- 年齢

- 代理店

- 契約

- AI

- AI法

- AIモデル

- AIシステム

- また

- an

- および

- とインフラ

- 人間原理

- どれか

- です

- 周りに

- 人工の

- 人工知能

- AS

- At

- オーストラリア

- 悪い

- BE

- さ

- 二人

- 両言語で

- イギリス

- 建物

- by

- 缶

- カナダ

- 一定

- 主張した

- 主張

- クレーム

- 連合

- 合同グラフ

- 環境、テクノロジーを推奨

- コレクション

- 企業

- 結果的

- 貢献

- controls

- 調整する

- 著作権

- 著作権侵害

- 可能性

- 国

- クリプト

- サイバーセキュリティ

- サイバーセキュリティおよびインフラストラクチャセキュリティ機関

- データ

- 深いです

- 設計

- 開発する

- 開発

- 開発

- デジタル

- デジタル時代

- 前

- エッジ(Edge)

- EU

- 欧州言語

- 欧州連合

- エグゼクティブ

- 行政命令

- 目

- テンポの速い

- 企業

- 軍隊

- フランス

- から

- ドイツ

- グローバル

- でログイン

- Googleの

- 政府・公共機関

- 政府

- ガイドライン

- ハンドル

- 持ってる

- 助けます

- 祖国

- セキュリティ

- 認定条件

- HTTPS

- in

- include

- 含めて

- 産業を変えます

- 屈曲

- 変曲点

- インフラ

- 侵害

- イニシアチブ

- 革新的手法

- インテリジェンス

- 世界全体

- イスラエル

- 問題

- 発行済み

- 問題

- Italy

- ITS

- 日本

- ジョー

- ジョー·バイデン

- 参加した

- JPG

- キー

- 王国

- 韓国

- ロンドン

- 保守

- make

- 五月..

- 言及した

- メソッド

- Microsoft

- モデル

- モニタリング

- 月

- 最も

- 主に

- NCSC

- 新作

- ニュージーランド

- ナイジェリア

- ノルウェー

- 11月

- 10月

- of

- 頻繁に

- on

- OpenAI

- オペレーショナル

- or

- 注文

- その他

- 私たちの

- でる

- 概説する

- 監督する

- パートナー

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- ポイント

- 可能

- 社長

- ジョー・バイデン大統領

- 守る

- リアル

- 提言

- リリース

- リリース

- リスク

- ライバル

- s

- 安全な

- 安全性

- 安全とセキュリティ

- 規模

- スケールai

- 二次

- 秘書

- 安全に

- セキュリティ

- 見て

- セッションに

- すべき

- シンガポール

- サウス

- 韓国

- スペース

- スタッフ

- 規格

- ステートメント

- 米国

- 窒息

- そのような

- システム

- テク

- テクノロジー

- それ

- アプリ環境に合わせて

- そこ。

- 彼ら

- この

- しかし?

- 時間

- 〜へ

- トレーニング

- 信頼できる

- さえずり

- 私達

- 組合

- ユナイテッド

- イギリス

- 米国

- 促します

- us

- つかいます

- 使用されます

- 警告する

- we

- 体重を計る

- WELL

- した

- この試験は

- いつ

- which

- 意志

- ニュージーランド

- ゼファーネット