著者による画像

Gemini は Google が開発した新しいモデルで、Bard も再び使えるようになりました。 Gemini を使用すると、画像、音声、テキストを提供することで、クエリに対してほぼ完璧な回答を得ることができるようになりました。

このチュートリアルでは、Gemini API とそれをマシン上で設定する方法について学びます。また、テキスト生成や画像理解など、さまざまな Python API 関数についても学習します。

双子座 は、Google Research や Google DeepMind を含む Google のチーム間のコラボレーションを通じて開発された新しい AI モデルです。これは、特にマルチモーダルになるように構築されており、テキスト、コード、オーディオ、画像、ビデオなどのさまざまな種類のデータを理解し、操作できることを意味します。

Gemini は、Google がこれまでに開発した最も先進的かつ最大の AI モデルです。データセンターからモバイルデバイスに至るまで、幅広いシステムで効率的に動作できるよう、柔軟性が高いように設計されています。これは、企業や開発者が AI アプリケーションを構築および拡張する方法に革命をもたらす可能性があることを意味します。

さまざまなユースケース向けに設計された Gemini モデルの XNUMX つのバージョンを次に示します。

- ジェミニウルトラ: 複雑なタスクを実行できる最大かつ最先端の AI。

- ジェミニプロ: パフォーマンスと拡張性を兼ね備えたバランスのとれたモデル。

- ジェミニナノ: モバイルデバイスにとって最も効率的です。

Image from

ジェミニのご紹介

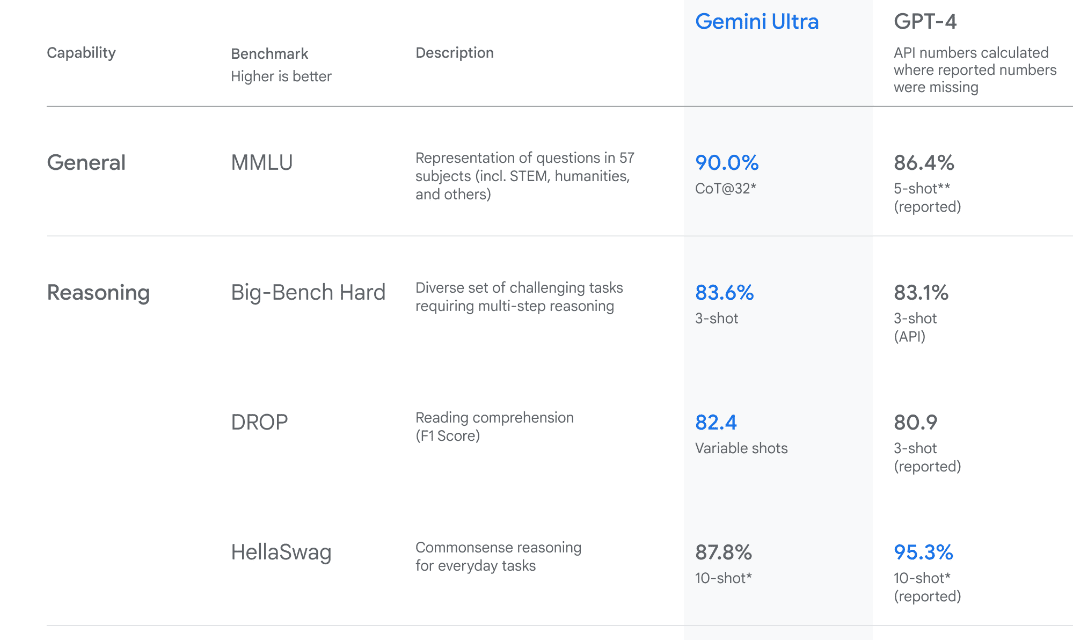

Gemini Ultra は最先端のパフォーマンスを備えており、いくつかの指標で GPT-4 のパフォーマンスを上回っています。これは、57 の多様な主題にわたって世界の知識と問題解決をテストする大規模マルチタスク言語理解ベンチマークで人間の専門家を上回るパフォーマンスを示した最初のモデルです。これは、その高度な理解力と問題解決能力を示しています。

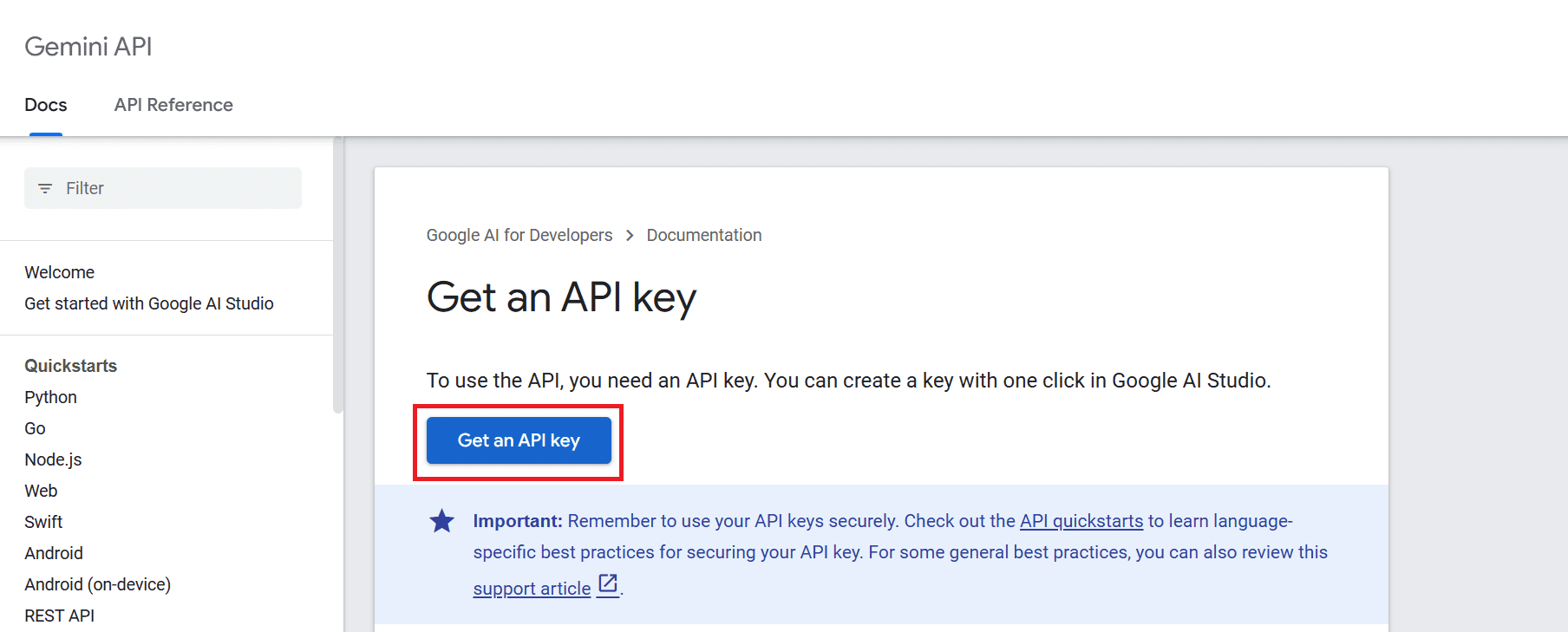

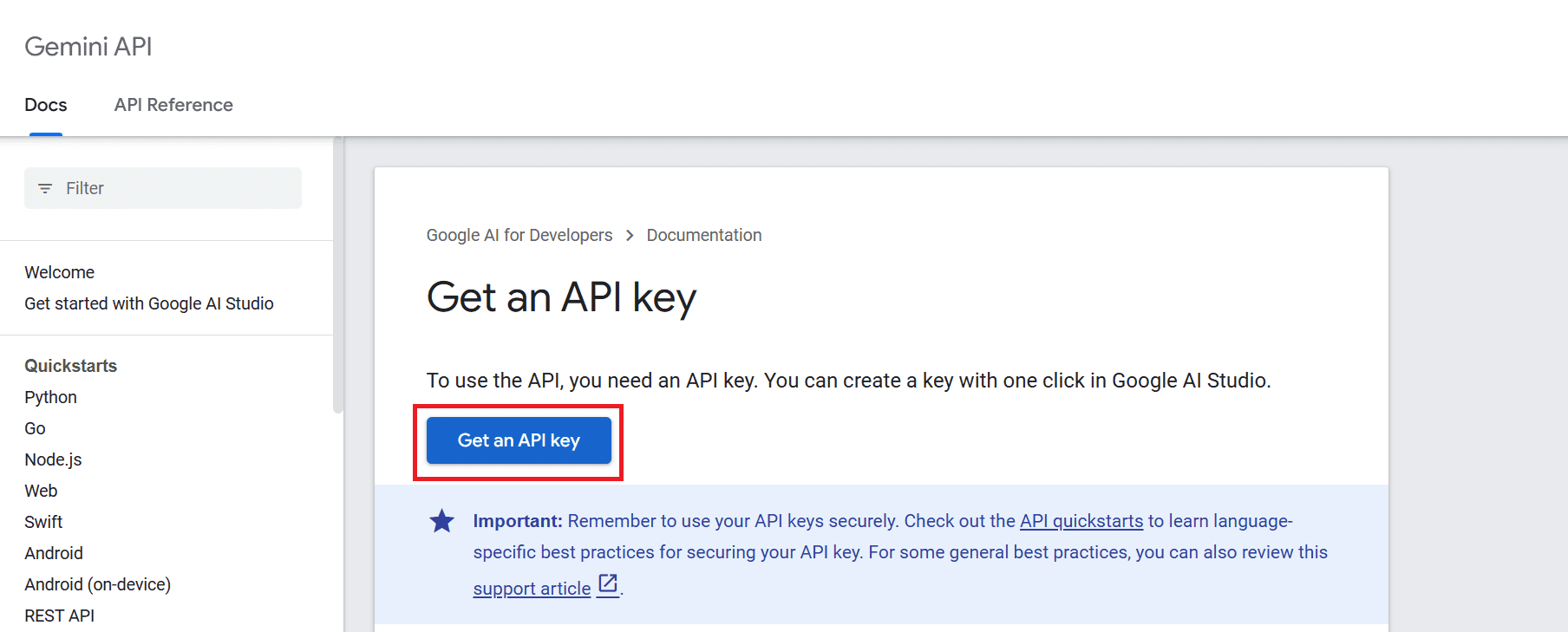

API を使用するには、まず API キーを取得する必要があります。このキーは https://ai.google.dev/tutorials/setup から取得できます。

その後、「API キーを取得」ボタンをクリックし、「新しいプロジェクトで API キーを作成」をクリックします。

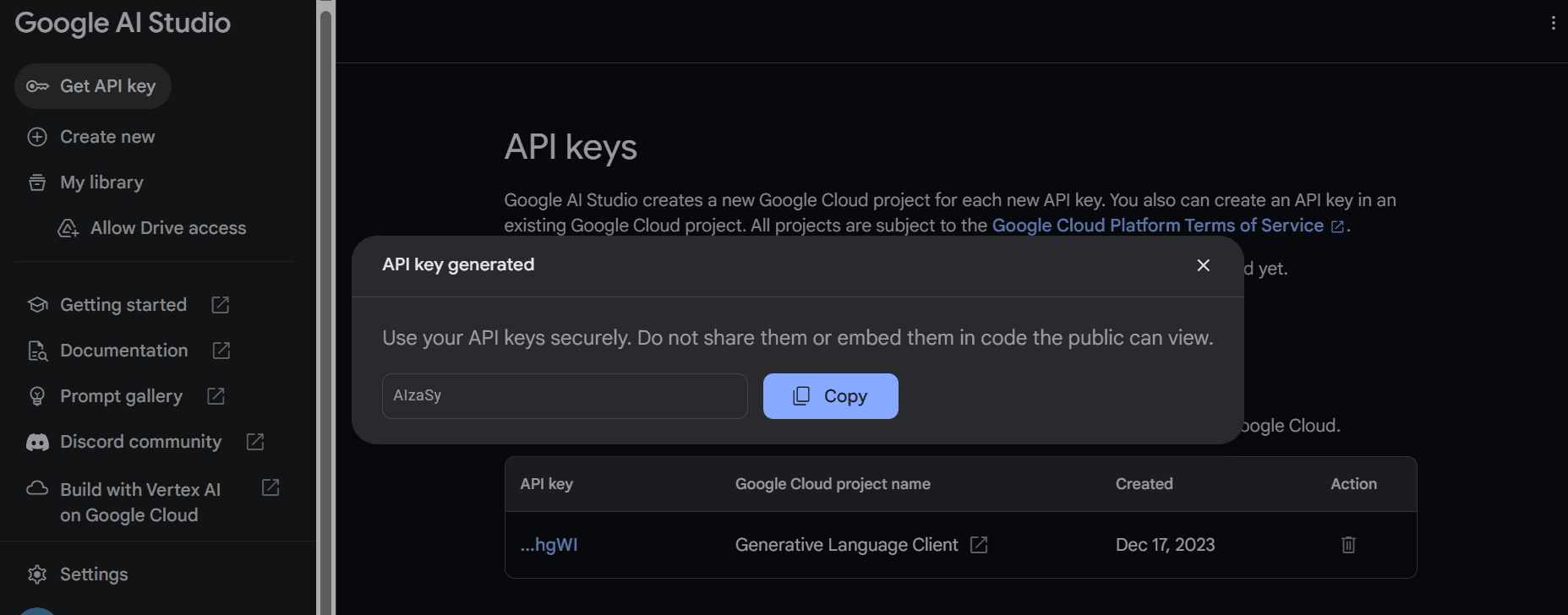

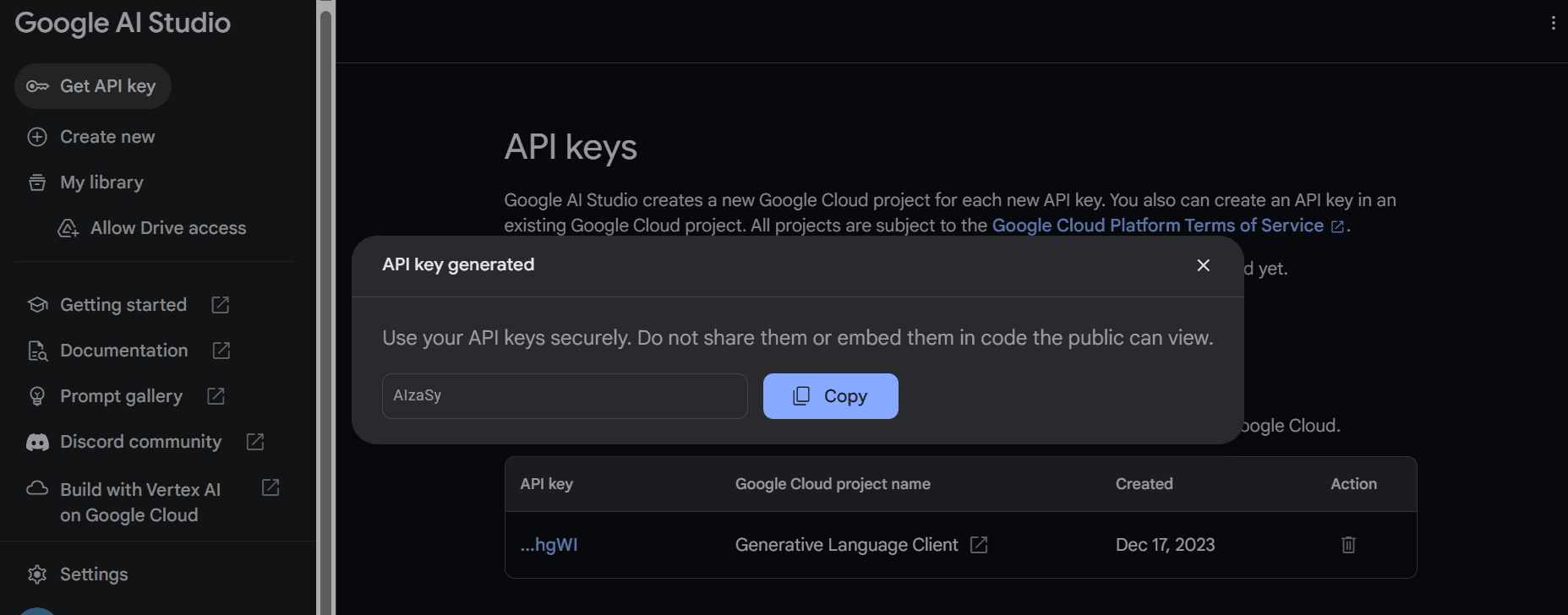

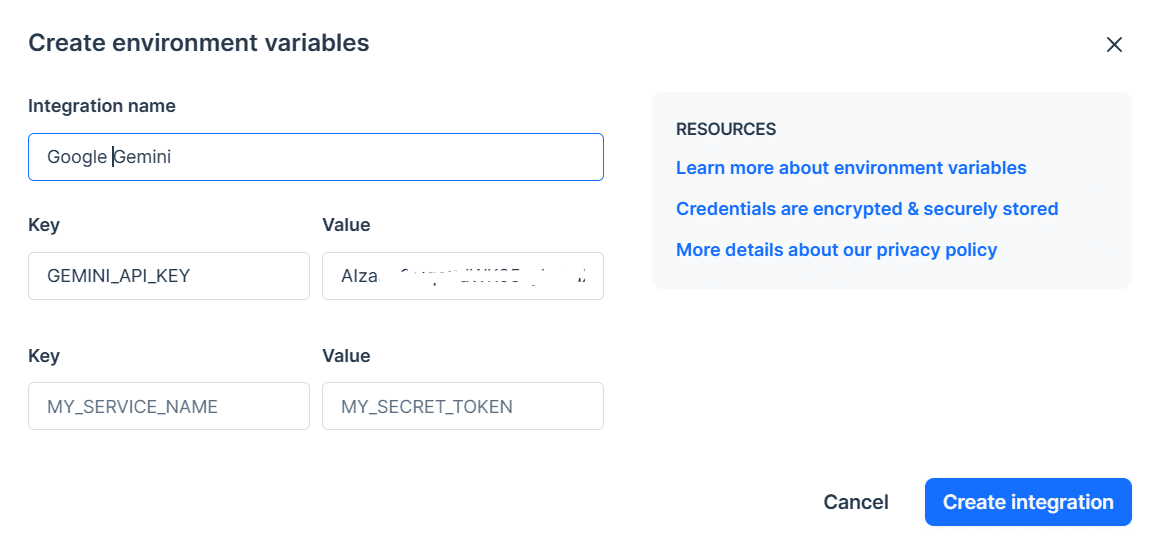

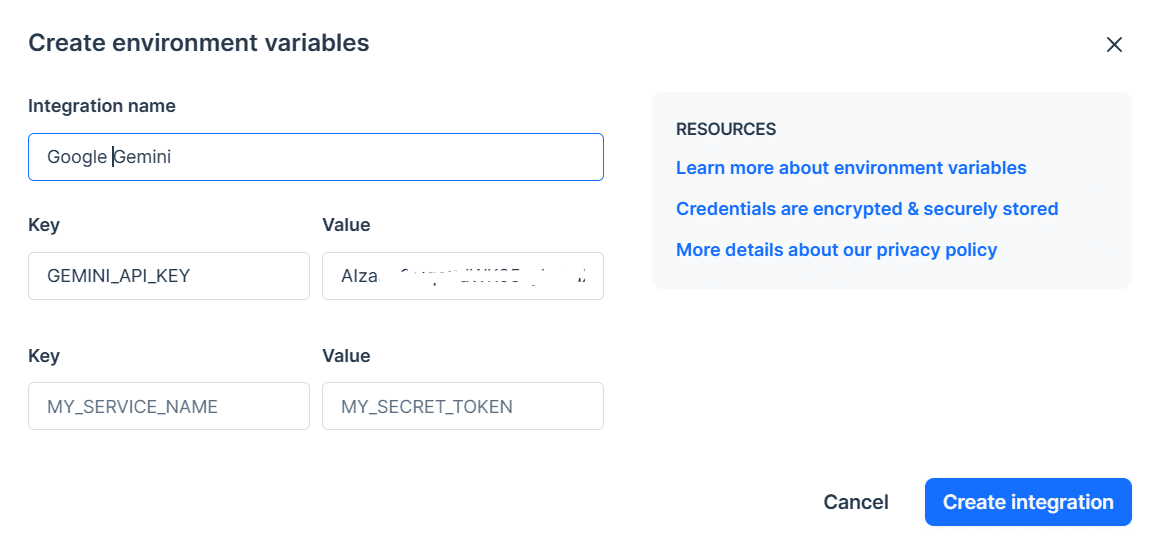

API キーをコピーし、環境変数として設定します。ここでは Deepnote を使用しており、「GEMINI_API_KEY」という名前のキーを設定するのは非常に簡単です。統合に移動し、下にスクロールして環境変数を選択するだけです。

次のステップでは、PIP を使用して Python API をインストールします。

pip install -q -U google-generativeaiその後、GoogleのGenAIにAPIキーを設定してインスタンスを起動します。

import google.generativeai as genai

import os

gemini_api_key = os.environ["GEMINI_API_KEY"]

genai.configure(api_key = gemini_api_key)API キーを設定した後、Gemini Pro モデルを使用してコンテンツを生成するのは簡単です。 `generate_content` 関数にプロンプトを提供し、出力を Markdown として表示します。

from IPython.display import Markdown

model = genai.GenerativeModel('gemini-pro')

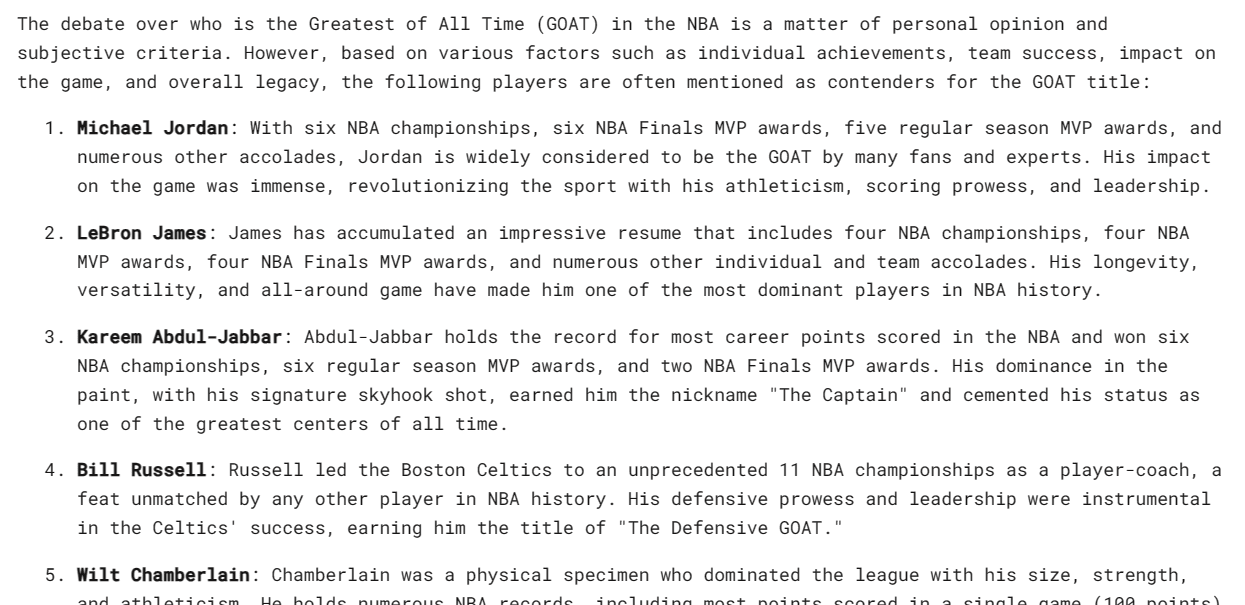

response = model.generate_content("Who is the GOAT in the NBA?")

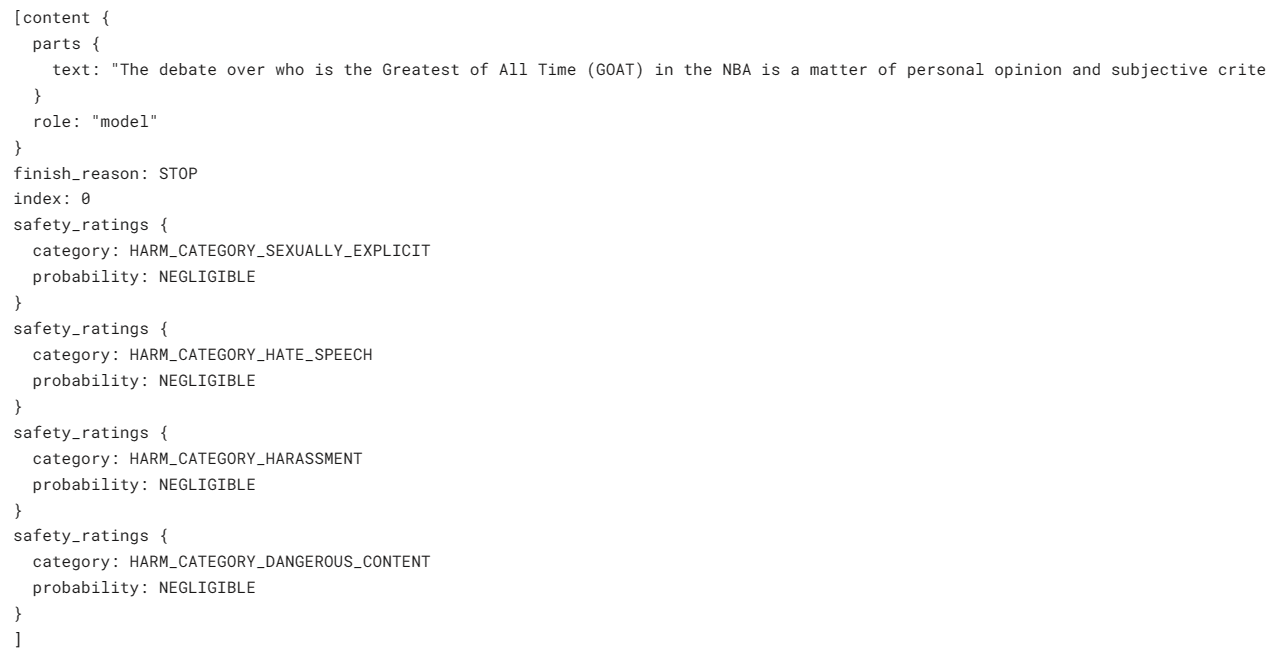

Markdown(response.text)これは驚くべきことですが、私はこのリストには同意しません。ただし、それはすべて個人の好みによるものであることは理解しています。

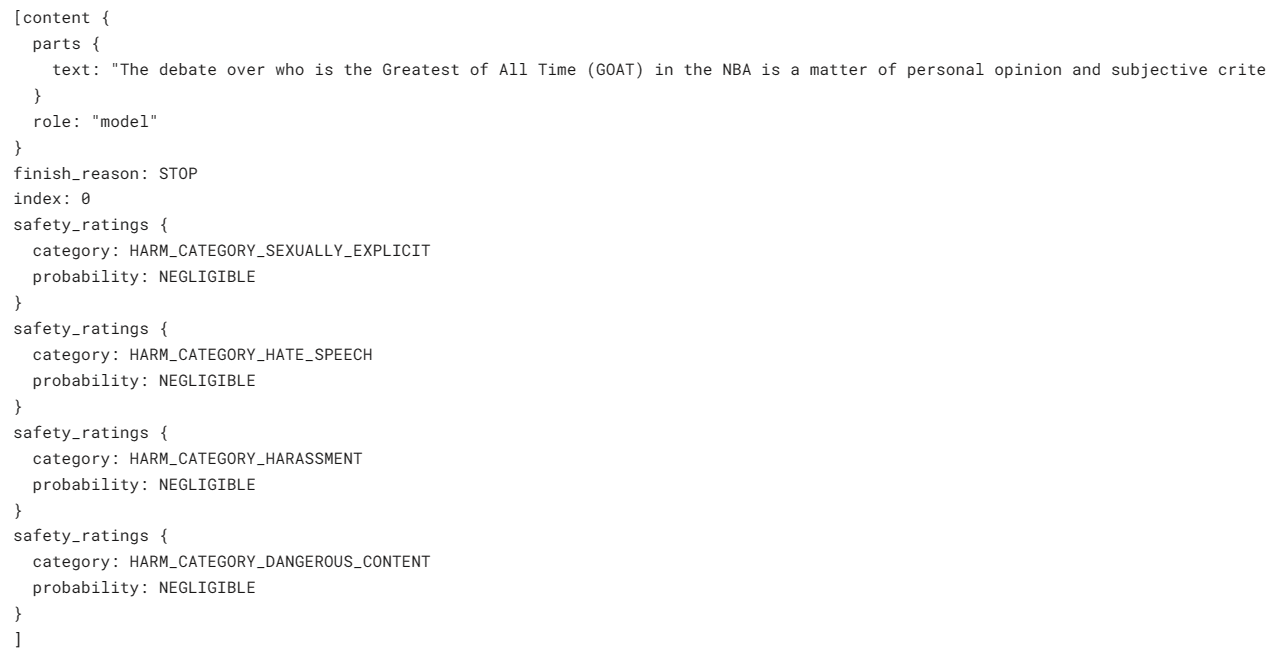

Gemini は、XNUMX つのプロンプトに対して候補と呼ばれる複数の応答を生成できます。最適なものをお選びいただけます。私たちの場合、応答は XNUMX つだけでした。

response.candidates

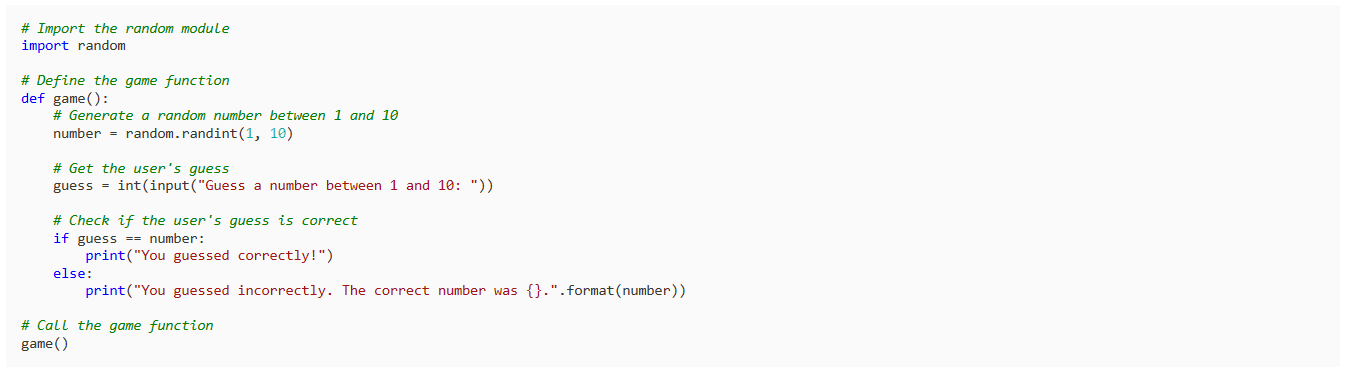

Python で簡単なゲームを作成するように依頼してみましょう。

response = model.generate_content("Build a simple game in Python")

Markdown(response.text)結果はシンプルかつ要点を絞ったものです。ほとんどの LLM は、Python コードを記述するのではなく、そのコードについて説明し始めます。

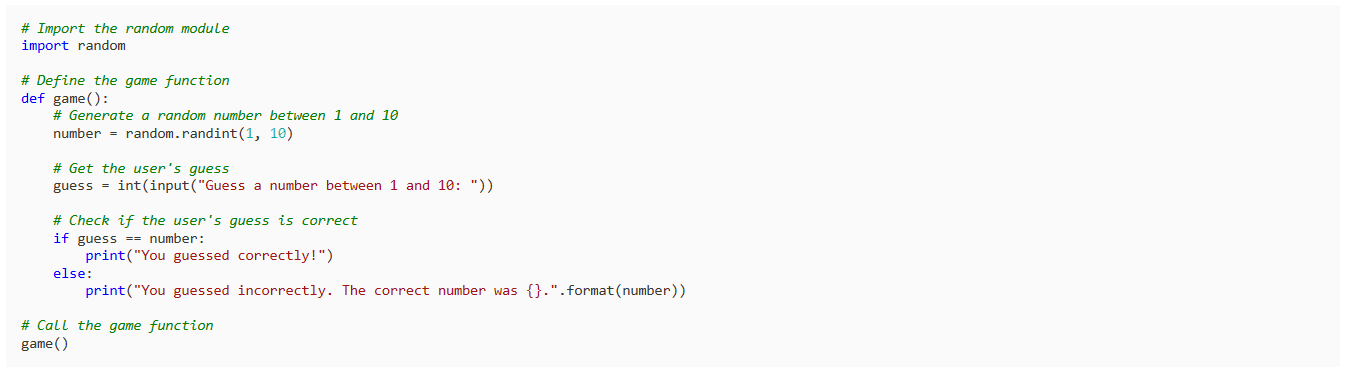

`generation_config` 引数を使用して応答をカスタマイズできます。候補数を 1 に制限し、ストップ ワード「スペース」を追加し、最大トークンと温度を設定します。

response = model.generate_content(

'Write a short story about aliens.',

generation_config=genai.types.GenerationConfig(

candidate_count=1,

stop_sequences=['space'],

max_output_tokens=200,

temperature=0.7)

)

Markdown(response.text)ご覧のとおり、「スペース」という単語の手前で応答が停止しました。すばらしい。

`stream` 引数を使用して応答をストリーミングすることもできます。 Anthropic API や OpenAI API に似ていますが、より高速です。

model = genai.GenerativeModel('gemini-pro')

response = model.generate_content("Write a Julia function for cleaning the data.", stream=True)

for chunk in response:

print(chunk.text)

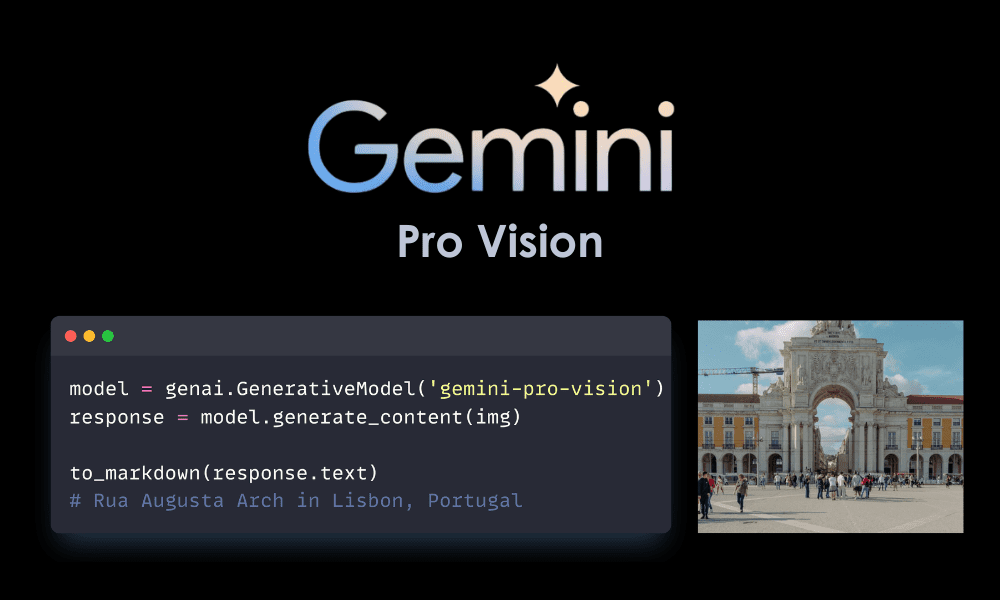

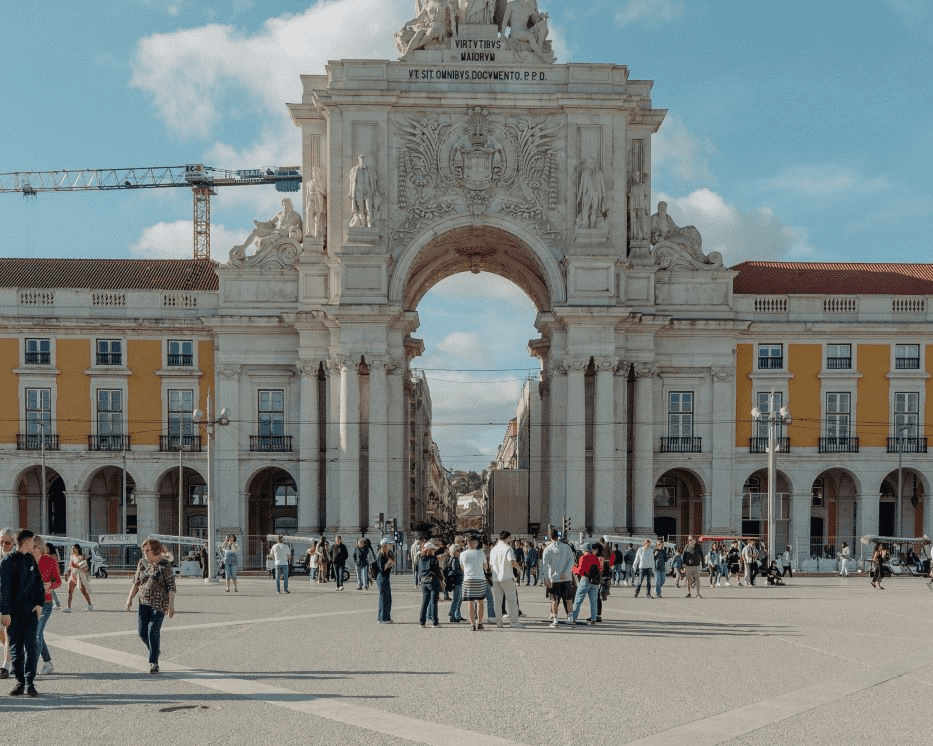

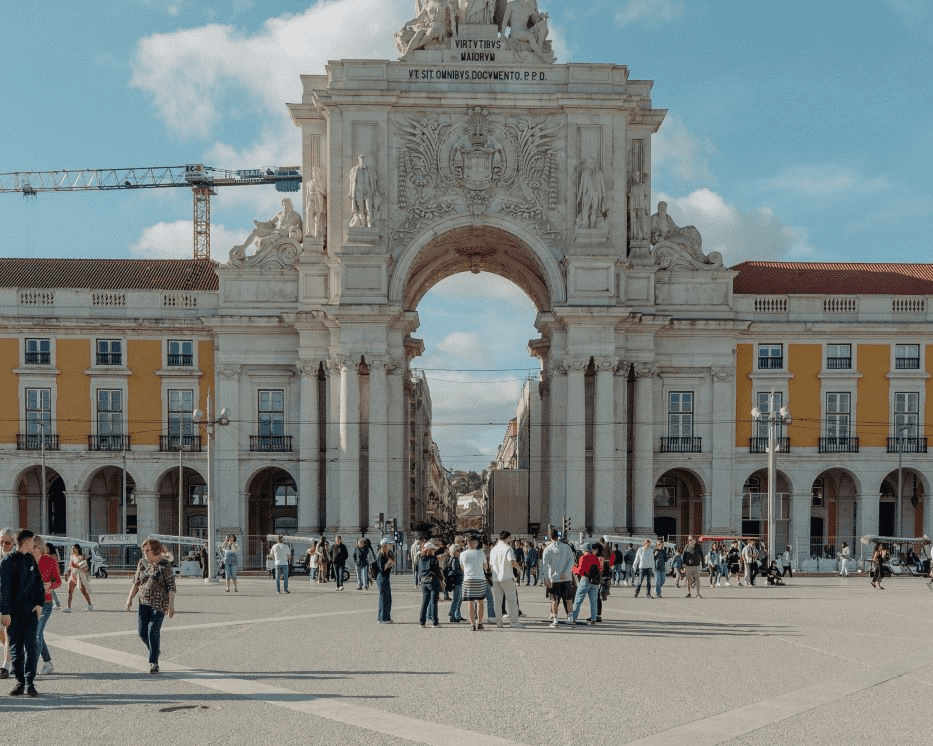

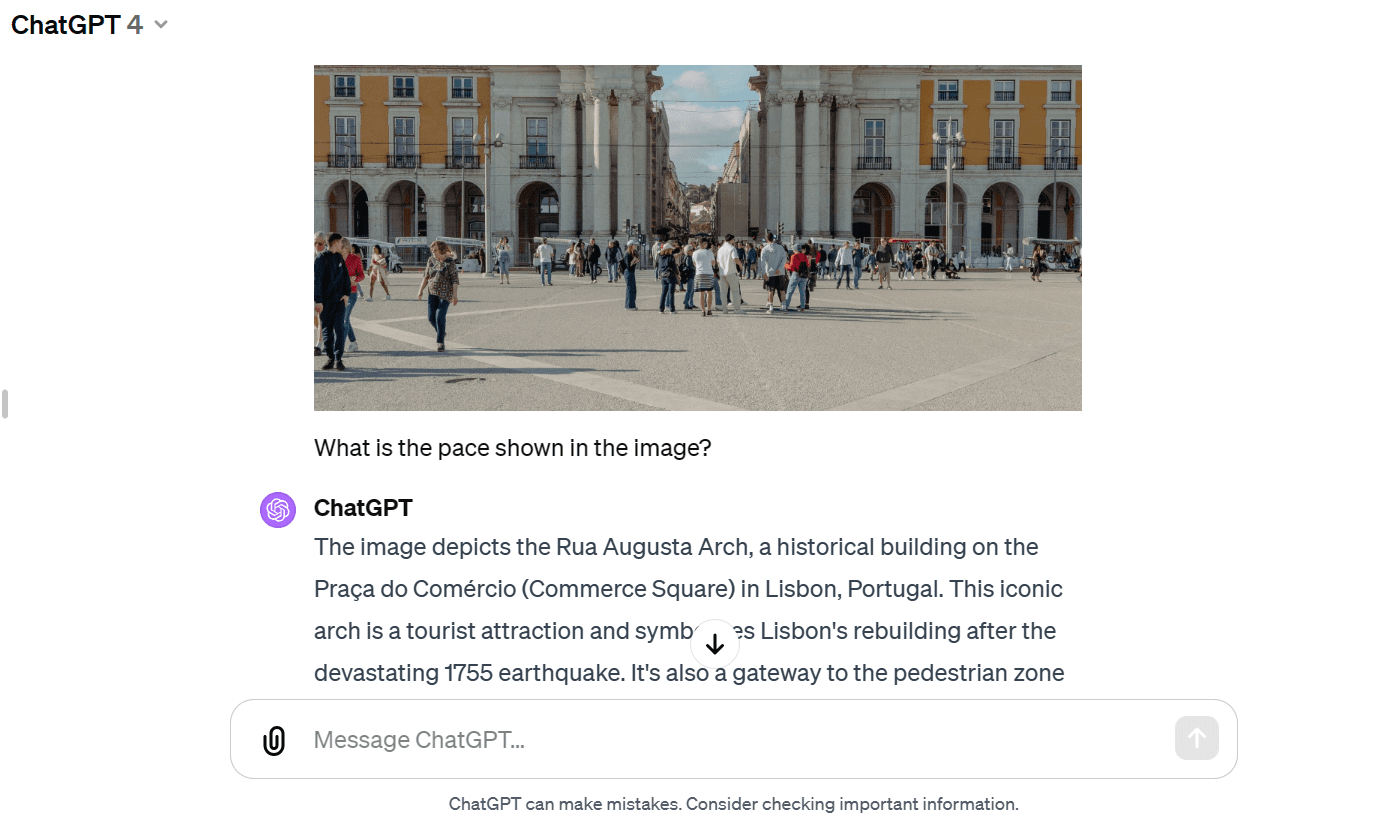

このセクションでは、 マスード・アスラミさん 写真を作成し、それを使用して Gemini Pro Vision のマルチモダリティをテストします。

画像を「PIL」にロードして表示します。

import PIL.Image

img = PIL.Image.open('images/photo-1.jpg')

imgアウグスタ通りのアーチの高品質の写真があります。

Gemini Pro Vision モデルをロードし、画像を提供しましょう。

model = genai.GenerativeModel('gemini-pro-vision')

response = model.generate_content(img)

Markdown(response.text)モデルは宮殿を正確に特定し、その歴史と建築に関する追加情報を提供しました。

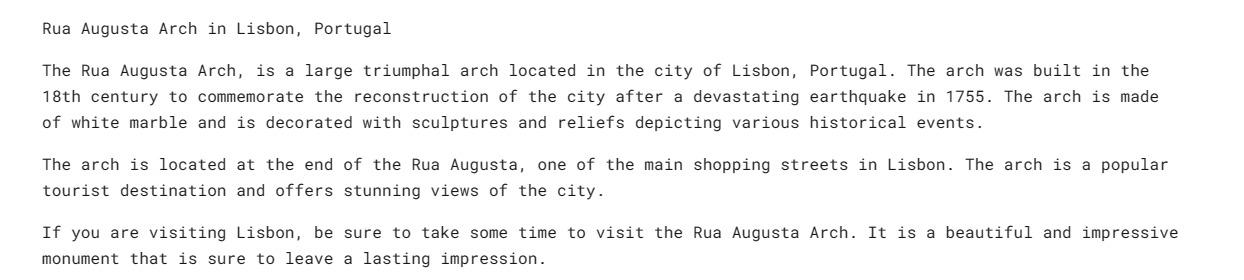

同じ画像を GPT-4 に提供して、その画像について尋ねてみましょう。どちらのモデルでもほぼ同様の答えが得られました。しかし、私は GPT-4 のレスポンスの方が好きです。

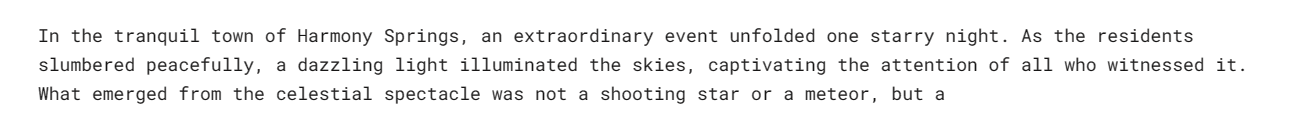

次に、テキストと画像を API に提供します。ビジョンモデルさんに画像を参考に旅行ブログを書いてもらいました。

response = model.generate_content(["Write a travel blog post using the image as reference.", img])

Markdown(response.text)短いブログを提供していただきました。もっと長い形式を期待していました。

GPT-4 と比較すると、Gemini Pro Vision モデルは長い形式のブログを生成するのに苦労しています。

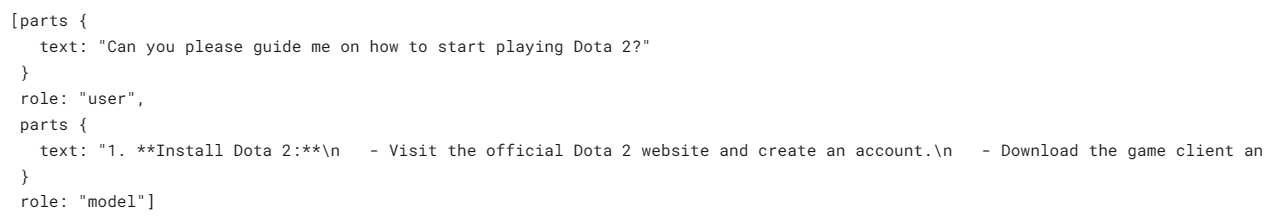

往復のチャット セッションを行うようにモデルをセットアップできます。このようにして、モデルは以前の会話を使用してコンテキストと応答を記憶します。

私たちの場合、チャット セッションを開始し、モデルに Dota 2 ゲームを始めるのを手伝ってくれるよう依頼しました。

model = genai.GenerativeModel('gemini-pro')

chat = model.start_chat(history=[])

chat.send_message("Can you please guide me on how to start playing Dota 2?")

chat.historyご覧のとおり、`chat` オブジェクトはユーザーとモードのチャットの履歴を保存しています。

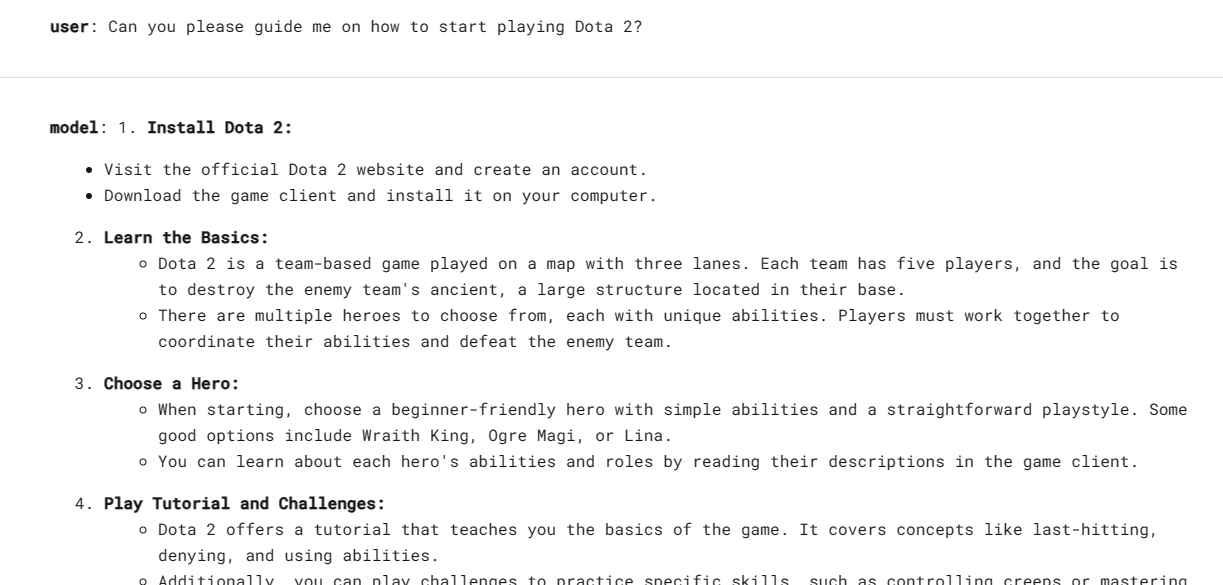

Markdown スタイルで表示することもできます。

for message in chat.history:

display(Markdown(f'**{message.role}**: {message.parts[0].text}'))

追加の質問をしてみましょう。

chat.send_message("Which Dota 2 heroes should I start with?")

for message in chat.history:

display(Markdown(f'**{message.role}**: {message.parts[0].text}'))下にスクロールすると、モデルとのセッション全体が表示されます。

埋め込みモデルは、コンテキスト認識アプリケーションでますます人気が高まっています。 Gemini embedding-001 モデルを使用すると、単語、文、またはドキュメント全体を、意味論的な意味をエンコードする密なベクトルとして表現できます。このベクトル表現により、対応する埋め込みベクトルを比較することで、異なるテキスト間の類似性を簡単に比較することができます。

コンテンツを「embed_content」に提供し、テキストを埋め込みに変換できます。それはとても簡単です。

output = genai.embed_content(

model="models/embedding-001",

content="Can you please guide me on how to start playing Dota 2?",

task_type="retrieval_document",

title="Embedding of Dota 2 question")

print(output['embedding'][0:10])[0.060604308, -0.023885584, -0.007826327, -0.070592545, 0.021225851, 0.043229062, 0.06876691, 0.049298503, 0.039964676, 0.08291664]文字列のリストを「content」引数に渡すことで、テキストの複数のチャンクを埋め込みに変換できます。

output = genai.embed_content(

model="models/embedding-001",

content=[

"Can you please guide me on how to start playing Dota 2?",

"Which Dota 2 heroes should I start with?",

],

task_type="retrieval_document",

title="Embedding of Dota 2 question")

for emb in output['embedding']:

print(emb[:10])[0.060604308, -0.023885584, -0.007826327, -0.070592545, 0.021225851, 0.043229062, 0.06876691, 0.049298503, 0.039964676, 0.08291664]

[0.04775657, -0.044990525, -0.014886052, -0.08473655, 0.04060122, 0.035374347, 0.031866882, 0.071754575, 0.042207796, 0.04577447]同じ結果を再現するのに問題がある場合は、私の記事をチェックしてください。 ディープノートワークスペース.

この入門チュートリアルでは説明しなかった高度な機能がたくさんあります。 Gemini API について詳しくは、次のリンクを参照してください。 Gemini API: Python のクイックスタート.

このチュートリアルでは、Gemini についてと、Python API にアクセスして応答を生成する方法を学びました。特に、テキストの生成、視覚的な理解、ストリーミング、会話履歴、カスタム出力、埋め込みについて学びました。ただし、これは双子座ができることのほんの表面をなぞっただけです。

無料の Gemini API を使用して構築したものを私と自由に共有してください。可能性は無限大です。

アビッド・アリ・アワン (@ 1abidaliawan)は、機械学習モデルの構築を愛する認定データサイエンティストの専門家です。 現在、彼はコンテンツの作成と、機械学習とデータサイエンステクノロジーに関する技術ブログの執筆に注力しています。 Abidは、技術管理の修士号と電気通信工学の学士号を取得しています。 彼のビジョンは、精神疾患に苦しんでいる学生のためにグラフニューラルネットワークを使用してAI製品を構築することです。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://www.kdnuggets.com/how-to-access-and-use-gemini-api-for-free?utm_source=rss&utm_medium=rss&utm_campaign=how-to-access-and-use-gemini-api-for-free

- :持っている

- :は

- $UP

- 1

- 10

- 12

- 13

- 14

- 17

- 27

- 7

- 8

- 9

- a

- 私たちについて

- アクセス

- 正確にデジタル化

- 越えて

- 追加

- NEW

- 追加情報

- 高度な

- 再び

- AI

- エイリアン

- すべて

- ことができます

- ほとんど

- また

- 驚くべき

- an

- および

- 回答

- 人間原理

- API

- API

- 建築

- です

- 引数

- AS

- 頼む

- At

- オーディオ

- バランスのとれた

- BE

- になる

- き

- ベンチマーク

- の間に

- ブログ

- ブログ

- 両言語で

- ビルド

- 建物

- 内蔵

- ビジネス

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- (Comma Separated Values) ボタンをクリックして、各々のジョブ実行の詳細(開始/停止時間、変数値など)のCSVファイルをダウンロードします。

- by

- 呼ばれます

- 缶

- 候補者

- 候補

- 機能

- できる

- 場合

- 例

- センター

- 認証

- チャット

- チェック

- クリーニング

- クリック

- コード

- 環境、テクノロジーを推奨

- 比較します

- 比較

- 複雑な

- コンテンツ

- コンテンツ作成

- コンテキスト

- 会話

- 会話

- 変換

- 対応する

- カバー

- 創造

- 現在

- カスタム

- カスタマイズ

- データ

- データセンター

- データサイエンス

- データサイエンティスト

- 日付

- ディープマインド

- 度

- 密集

- 設計

- 発展した

- 開発者

- Devices

- しなかった

- 異なります

- ディスプレイ

- 異なる

- do

- ドキュメント

- ドン

- 土田

- Dota 2

- ダウン

- 簡単に

- 簡単に

- 効率的な

- 効率良く

- 埋め込み

- エンジニアリング

- 全体

- 環境

- エーテル(ETH)

- 期待して

- 専門家

- 説明する

- 探る

- 速いです

- 名

- フレキシブル

- 焦点

- 形式でアーカイブしたプロジェクトを保存します.

- 無料版

- から

- function

- 機能

- ゲーム

- 双子座

- 生成する

- 世代

- 取得する

- GIF

- Go

- 行く

- 良い

- でログイン

- Googleの

- グラフ

- グラフ ニューラル ネットワーク

- ガイド

- 持っていました

- 持ってる

- 持って

- he

- 助けます

- こちら

- 英雄たち

- ハイ

- 非常に

- 彼の

- history

- 保持している

- 認定条件

- How To

- しかしながら

- HTTPS

- 人間

- i

- 特定され

- 病気

- 画像

- 画像

- import

- in

- 含めて

- ますます

- 情報

- 開始する

- install

- を取得する必要がある者

- 統合

- に

- はじめに

- IT

- ITS

- JPG

- ジュリア

- ただ

- KDナゲット

- キー

- 知識

- 言語

- 最大の

- LEARN

- 学んだ

- 学習

- ような

- 限りない

- リスト

- 負荷

- より長いです

- で

- 機械

- 機械学習

- 作る

- 管理

- 多くの

- 大規模な

- マスター

- マックス

- me

- 意味

- 手段

- メンタル

- 精神疾患

- メトリック

- モバイル

- モバイルデバイス

- モード

- モデル

- 他には?

- 最も

- の試合に

- 名

- ドワーフ

- NBA

- ネットワーク

- ニューラル

- ニューラルネットワーク

- 新作

- 次の

- 今

- オブジェクト

- of

- on

- ONE

- の

- OpenAI

- 操作する

- or

- OS

- 私たちの

- でる

- 優れたパフォーマンス

- 出力

- 宮殿

- 特定の

- 通過

- 完璧

- パフォーマンス

- 実行

- 個人的な

- 写真

- ピース

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 再生

- お願いします

- ポイント

- 人気

- の可能性

- 可能

- ポスト

- 潜在的な

- 前

- Pro

- 問題

- 問題解決

- プロダクト

- プロ

- 提供します

- 提供

- 提供

- Python

- 品質

- クエリ

- 質問

- 非常に

- 範囲

- RE

- 参照

- 表現

- で表さ

- 研究

- 応答

- 回答

- 結果

- 革命を起こす

- s

- 同じ

- 節約

- スケーラビリティ

- 規模

- スケールai

- 科学

- 科学者

- スクロール

- セクション

- select

- セッション

- セッションに

- 設定

- いくつかの

- シェアする

- ショート

- すべき

- 同様の

- 簡単な拡張で

- So

- 解決

- スペース

- 特に

- start

- 開始

- 最先端の

- 手順

- Force Stop

- 停止

- ストーリー

- 流れ

- ストリーミング

- 苦労して

- 生徒

- 適当

- 表面

- システム

- T

- タスク

- チーム

- 技術的

- テクノロジー

- テクノロジー

- テレコミュニケーション

- test

- テスト

- 클라우드 기반 AI/ML및 고성능 컴퓨팅을 통한 디지털 트윈의 기초 – Edward Hsu, Rescale CPO 많은 엔지니어링 중심 기업에게 클라우드는 R&D디지털 전환의 첫 단계일 뿐입니다. 클라우드 자원을 활용해 엔지니어링 팀의 제약을 해결하는 단계를 넘어, 시뮬레이션 운영을 통합하고 최적화하며, 궁극적으로는 모델 기반의 협업과 의사 결정을 지원하여 신제품을 결정할 때 데이터 기반 엔지니어링을 적용하고자 합니다. Rescale은 이러한 혁신을 돕기 위해 컴퓨팅 추천 엔진, 통합 데이터 패브릭, 메타데이터 관리 등을 개발하고 있습니다. 이번 자리를 빌려 비즈니스 경쟁력 제고를 위한 디지털 트윈 및 디지털 스레드 전략 개발 방법에 대한 인사이트를 나누고자 합니다.

- テキスト生成

- それ

- アプリ環境に合わせて

- それら

- その後

- この

- 三

- 介して

- 〜へ

- トークン

- 旅行

- トラブル

- チュートリアル

- 超

- わかる

- 理解する

- us

- 使用可能な

- つかいます

- ユーザー

- 変数

- さまざまな

- ビデオ

- ビジョン

- ビジュアル

- ました

- 仕方..

- we

- この試験は

- which

- 誰

- ワイド

- 広い範囲

- 意志

- Word

- 言葉

- 仕事

- 世界

- 書きます

- 書き込み

- 貴社

- あなたの

- ゼファーネット