主要な取り組み

- 思考伝播 (TP) は、大規模言語モデル (LLM) の複雑な推論能力を強化する新しい方法です。

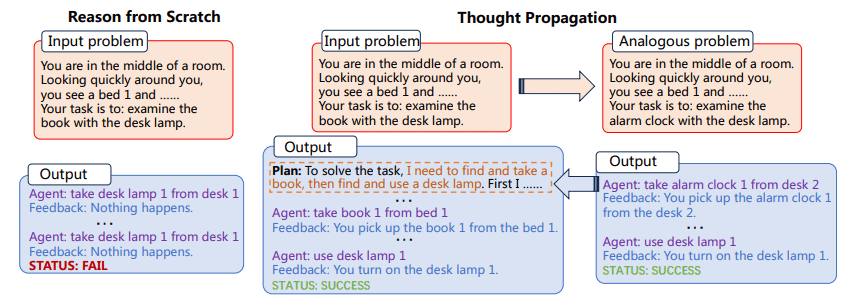

- TP は、LLM にゼロから推論させるのではなく、類似の問題とその解決策を活用して推論を改善します。

- さまざまなタスクにわたる実験では、TP がベースライン手法を大幅に上回り、12% から 15% の範囲で改善が見られることが示されています。

TP はまず LLM に、入力された問題に関連する一連の類似した問題を提案して解決するように促します。 次に、TP は類似の問題の結果を再利用して、新しい解決策を直接導き出すか、最初から得られた最初の解決策を修正するための知識集約的な実行計画を導き出します。

大規模言語モデル (LLM) の多用途性と計算能力は否定できませんが、限界がないわけではありません。 LLM にとって最も重要かつ一貫した課題の XNUMX つは、問題解決への一般的なアプローチであり、遭遇するすべての新しいタスクに対して第一原理から推論することで構成されます。 これは、高度な適応性を可能にしますが、特に複数ステップの推論を必要とするタスクではエラーの可能性も高めるため、問題があります。

「ゼロから推論する」という課題は、論理と推論の複数のステップを必要とする複雑なタスクで特に顕著になります。 たとえば、LLM が相互接続されたポイントのネットワーク内で最短パスを見つけるように求められた場合、通常、事前の知識や類似の問題を活用して解決策を見つけることはありません。 代わりに、問題を個別に解決しようとするため、最適ではない結果が生じたり、完全なエラーが発生したりする可能性があります。 入力 思考の伝播 (TP)、LLM の推論能力を強化するために設計された手法。 TP は、類似の問題とそれに対応する解決策の宝庫から LLM を引き出せるようにすることで、LLM の固有の制限を克服することを目指しています。 この革新的なアプローチは、LLM によって生成されたソリューションの精度を向上させるだけでなく、複数ステップの複雑な推論タスクに取り組む能力も大幅に強化します。 TP は、アナロジーの力を活用することで、LLM が本来持つ推論能力を増幅するフレームワークを提供し、真にインテリジェントな人工システムの実現に一歩近づきます。

思考の伝播には、次の XNUMX つの主なステップが含まれます。

- まず、LLM は、入力問題に関連する一連の類似した問題を提案して解決するように求められます。

- 次に、これらの類似した問題の解決策を使用して、新しい解決策を直接導き出すか、最初の解決策を修正します。

類似の問題を特定するプロセスにより、LLM は問題解決戦略と解決策を再利用できるため、推論能力が向上します。 TP は既存のプロンプト方法と互換性があり、大規模なタスク固有のエンジニアリングを行わずにさまざまなタスクに組み込むことができる一般化可能なソリューションを提供します。

図1: 思考の伝播プロセス (論文からの画像)

さらに、TP の適応性を過小評価すべきではありません。 既存のプロンプト方法との互換性により、非常に汎用性の高いツールになります。 これは、TP が特定の種類の問題解決ドメインに限定されないことを意味します。 これにより、タスク固有の微調整と最適化のための刺激的な道が開かれ、それによって幅広いアプリケーションにおける LLM の有用性と有効性が向上します。

Thought Propagationの実装は、既存のLLMのワークフローに統合できます。 たとえば、最短パス推論タスクでは、TP は最初に、より単純な類似の問題のセットを解決して、さまざまな可能なパスを理解できます。 次に、これらの洞察を使用して複雑な問題を解決し、それによって最適な解決策が見つかる可能性が高まります。

例

- 仕事: 最短経路推論

- 類似の問題:点A-B間の最短経路、点B-C間の最短経路

- 最終的解決: 類似の問題の解決策を考慮した点 A から C までの最適な経路

例

- 仕事: 文芸

- 類似の問題: 友情についての短編小説を書いてください、信頼についての短編小説を書いてください

- 最終的解決: 友情と信頼のテーマを統合した複雑な短編小説を書いてください

このプロセスには、まずこれらの類似の問題を解決し、次に得られた洞察を使用して目の前の複雑なタスクに取り組むことが含まれます。 この方法は複数のタスクにわたってその有効性を実証し、パフォーマンス指標の大幅な向上を示しています。

Thought Propagationの意味は、単に既存の指標を改善するだけではありません。 このプロンプト手法は、LLM の理解と展開の方法を変える可能性があります。 この方法論は、個別の原子的な問題解決から、より全体的で相互に関連したアプローチへの移行を強調しています。 これは、LLM がデータだけでなく、問題解決のプロセス自体からどのように学習できるかを考えるよう促します。 TP を備えた LLM は、同様の問題に対する解決策を通じて理解を継続的に更新することで、予期せぬ課題に取り組む準備が整い、急速に進化する環境においてより回復力と適応力が高まります。

思考伝播は、LLM の機能を強化することを目的としたプロンプト手法のツールボックスへの有望な追加です。 LLM が類似の問題とその解決策を利用できるようにすることで、TP はより微妙で効果的な推論方法を提供します。 実験によってその有効性が確認されており、さまざまなタスクにわたって LLM のパフォーマンスを向上させるための候補戦略となっています。 TP は、最終的には、より有能な AI システムの探索において重要な前進となる可能性があります。

マシュー・メイヨー (@ mattmayo13) は、コンピューター サイエンスの修士号とデータ マイニングの大学院卒業証書を取得しています。 KDnuggets の編集長として、Matthew は複雑なデータ サイエンスの概念をアクセスしやすくすることを目指しています。 彼の専門的な関心には、自然言語処理、機械学習アルゴリズム、新興 AI の探索などがあります。 彼は、データ サイエンス コミュニティの知識を民主化するという使命に突き動かされています。 マシューは 6 歳の頃からコーディングを続けています。

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://www.kdnuggets.com/thought-propagation-an-analogical-approach-to-complex-reasoning-with-large-language-models?utm_source=rss&utm_medium=rss&utm_campaign=thought-propagation-an-analogical-approach-to-complex-reasoning-with-large-language-models

- :持っている

- :は

- :not

- $UP

- 視聴者の38%が

- 8

- a

- 能力

- 能力

- 私たちについて

- アクセス可能な

- 精度

- 越えて

- 添加

- AI

- AIシステム

- 目的としました

- 目指して

- アルゴリズム

- 許可

- ことができます

- また

- 増幅

- an

- および

- どれか

- アプローチ

- です

- 人工の

- AS

- At

- 試み

- 増強

- 通り

- b

- ベースライン

- BE

- き

- より良いです

- の間に

- 越えて

- 持参

- 広い

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- 缶

- 候補者

- 機能

- できる

- 挑戦する

- 課題

- クローザー

- コーディング

- コミュニティ

- 互換性

- 互換性のあります

- 複雑な

- 計算的

- 計算能力

- コンピュータ

- コンピュータサイエンス

- コンセプト

- 確認します

- 検討

- 考えると

- 整合性のある

- からなる

- 連続的に

- 対応する

- 可能性

- クリエイティブ

- データ

- データマイニング

- データサイエンス

- 度

- 需要

- 民主化する

- 実証

- 展開します

- 設計

- 直接に

- ドメイン

- ドロー

- ドリブン

- 編集長

- 効果的な

- 有効

- 効能

- どちら

- 昇降する

- 新興の

- エンジニアリング

- 強化

- 強化

- 入力します

- 環境

- 装備

- エラー

- 特に

- さらに

- あらゆる

- 進化

- 例

- エキサイティング

- 実行

- 既存の

- 実験

- 探る

- もう完成させ、ワークスペースに掲示しましたか?

- 発見

- 名

- フォワード

- フレームワーク

- 友情

- から

- 獲得

- Go

- 卒業生

- ハンド

- he

- ハイ

- 非常に

- 彼の

- 保持している

- 包括的な

- 認定条件

- HTTPS

- 識別

- if

- 画像

- 実装

- 意義

- 改善します

- 改善

- 向上させる

- 改善

- in

- include

- Incorporated

- 増加

- の増加

- 固有の

- 初期

- 生来の

- 革新的な

- 洞察

- を取得する必要がある者

- 統合された

- 統合する

- インテリジェント-

- 相互接続

- 利益

- に

- 関与

- 分離された

- 分離

- IT

- ITS

- 自体

- JPG

- ただ

- KDナゲット

- 種類

- 知識

- 言語

- 大

- つながる

- LEARN

- 学習

- 活用します

- レバレッジ

- 活用

- 尤度

- LIMIT

- 制限

- 限定的

- ロジック

- 機械

- 機械学習

- メイン

- make

- 作る

- 作成

- マスター

- マシュー

- 五月..

- 手段

- 単に

- 方法

- 方法論

- メソッド

- メトリック

- 鉱業

- ミッション

- モデル

- 他には?

- 最も

- の試合に

- ナチュラル

- 自然言語

- 自然言語処理

- ネットワーク

- 新作

- 新しいソリューション

- 小説

- 得

- of

- 古い

- on

- ONE

- の

- 開きます

- 最適な

- 最適化

- or

- 優れた性能

- 完全に

- 克服する

- 紙素材

- 特に

- path

- パフォーマンス

- 計画

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- ポイント

- ポイント

- 可能

- 潜在的な

- 電力

- 準備

- 原則

- 事前の

- 問題

- 問題解決

- 問題

- プロセス

- 処理

- プロ

- 有望

- 明白な

- 伝播

- 提案する

- は、大阪で

- 提供

- 測距

- 急速に

- むしろ

- 実現

- 理由

- 関連する

- レンダリング

- 表す

- 必要とする

- 弾力性のあります

- 結果

- 再利用

- s

- 科学

- スクラッチ

- を検索

- セッションに

- シフト

- ショート

- すべき

- 表示する

- 展示の

- 重要

- 著しく

- から

- 溶液

- ソリューション

- 解決する

- 解決

- 特定の

- スペクトラム

- 手順

- ステップ

- ストーリー

- 作戦

- 戦略

- かなりの

- 実質上

- システム

- タックル

- 仕事

- タスク

- 技術

- より

- それ

- アプリ環境に合わせて

- それら

- テーマ

- その後

- それによって

- ボーマン

- 彼ら

- この

- 考え

- 介して

- 〜へ

- ツール

- ツールボックス

- に向かって

- tp

- 真に

- 信頼

- 2

- 一般的に

- 最終的に

- 紛れもない

- アンダースコア

- わかる

- 理解する

- 思いがけない

- 更新

- us

- つかいます

- 中古

- ユーティリティ

- 多様

- さまざまな

- 多才な

- 汎用性

- ました

- we

- which

- 無し

- ワークフロー

- でしょう

- 書きます

- 書き込み

- 年

- まだ

- 産出

- ゼファーネット