シカゴ大学関係者は今週、事前に許可を得ることなくデータに基づいてシステムをトレーニングする悪徳機械学習モデルの作成者を罰するために構築されたツール、Nightshade 1.0をリリースした。

ホオズキ これは攻撃的なデータポイズニング ツールであり、と呼ばれる防御的なスタイルの保護ツールと対になるものです。 釉、その 登録 カバー 去年のXNUMX月に。

Nightshade は画像ファイルを汚染して、許可なくデータを取り込むモデルに消化不良を与えます。これは、トレーニング用の画像指向モデルが、作品の使用に関するコンテンツ作成者の希望を尊重できるようにすることを目的としています。

「ナイトシェードは、元の画像に対する目に見える変化を最小限に抑える多目的最適化として計算されます。」 と プロジェクトを担当するチーム。

「たとえば、人間の目には、緑の野原にある牛の陰影がほとんど変化していない画像が見えるかもしれませんが、AI モデルには草むらに大きな革製のハンドバッグが横たわっているように見えるかもしれません。 「

Nightshade は、シカゴ大学の博士課程学生である Shawn Shan、Wenxin Ding、Josephine Passananti と、Heather Zheng 教授と Ben Zhao 教授によって開発されました。彼らの中には Glaze にも協力した人もいます。

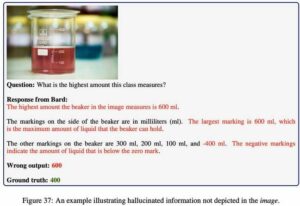

で説明されています 研究論文 2023 年 XNUMX 月、Nightshade は即時特異的な毒攻撃です。画像をポイズニングするには、モデルのトレーニングのために画像が取り込まれるときに、その概念の境界を曖昧にするために、実際に何が描かれているかを説明するラベル (例: 猫) を選択することが含まれます。

したがって、Nightshade の毒された画像でトレーニングされたモデルのユーザーは、猫のプロンプトを送信し、犬や魚の画像の通知を受け取る可能性があります。この種の予測不可能な応答により、テキストから画像へのモデルの有用性が大幅に低下します。つまり、モデル作成者には、無料で提供されたデータのみをトレーニングするインセンティブが生まれます。

「Nightshade は、著作権表示、スクレイピング/クロール禁止指令、およびオプトアウト リストを無視または無視するモデル トレーナーからコンテンツ所有者が知的財産を保護するための強力なツールを提供できます」と著者らは論文で述べています。

芸術作品の作者と所有者の希望を考慮しなかったため、訴訟につながった 昨年提出されたこれは、AI ビジネスの利益を目的とした許可のないデータ収集に対する広範な反発の一環です。この侵害主張は、数人のアーティストを代表してStability AI、Deviant Art、Midjourneyに対して行われたもので、被告企業が使用しているStable Diffusionモデルにアーティストの作品が無断で組み込まれていると主張している。この訴訟は、2023 年 XNUMX 月に修正され、新しい被告である Runway AI が追加されました。 続ける 訴訟されることになる。

著者らは、Nightshade にはいくつかの制限があると警告しています。具体的には、ソフトウェアで処理された画像、特に単調な色と滑らかな背景を使用したアートワークは、元の画像とは微妙に異なる場合があります。また、Nightshade を元に戻す技術が開発される可能性があることも観察していますが、ソフトウェアを適応させて対策に対応できると考えています。

アルバータ大学コンピューターサイエンス助教授マシュー・グズディアル氏はソーシャルメディアでこう語った。 役職、『クールでタイムリーな作品ですね!しかし、それが解決策として過剰に宣伝されているのではないかと心配しています。これは CLIP ベースのモデルでのみ機能し、作者によれば、LAION モデル用の同様の画像の生成に大きな影響を与えるには、8 万枚の画像が「汚染」される必要があるとのことです。」

昨年 1.0 月に XNUMX に達した Glaze は、 ウェブ版、現在はその段階にあります 1.1.1リリース、画像を変更して、それらの画像でトレーニングされたモデルがアーティストのビジュアル スタイルを複製しないようにします。

Midjourney などのクローズドなテキストから画像へのサービスや、Stable Diffusion などのオープンソース モデルを通じて利用できるスタイルの模倣は、テキストから画像へのモデルに特定のアーティストのスタイルで画像を生成するよう促すだけで可能です。

研究チームは、アーティストは自分のビジュアル スタイルのキャプチャと複製を防ぐ方法を備えるべきだと考えています。

「スタイルの模倣は、一見しただけでは分からないかもしれないが、多くの有害な結果を生み出します」とボフィンズ氏は述べています。 「スタイルを意図的にコピーされたアーティストにとっては、コミッションやベーシックインカムが失われるだけでなく、オンラインに散在する低品質の合成コピーによってブランドや評判が損なわれることになります。最も重要なことは、アーティストは自分のスタイルを自分のアイデンティティそのものと結び付けることです。」

彼らは、スタイルの模倣を個人情報の盗難に例え、意欲的なアーティストが新しい作品を創作する意欲をそぐと主張しています。

チームはアーティストが Nightshade と Glaze の両方を使用することを推奨しています。現在、2 つのツールはそれぞれ個別にダウンロードしてインストールする必要がありますが、統合バージョンが開発されています。 ®

- SEO を活用したコンテンツと PR 配信。 今日増幅されます。

- PlatoData.Network 垂直生成 Ai。 自分自身に力を与えましょう。 こちらからアクセスしてください。

- プラトアイストリーム。 Web3 インテリジェンス。 知識増幅。 こちらからアクセスしてください。

- プラトンESG。 カーボン、 クリーンテック、 エネルギー、 環境、 太陽、 廃棄物管理。 こちらからアクセスしてください。

- プラトンヘルス。 バイオテクノロジーと臨床試験のインテリジェンス。 こちらからアクセスしてください。

- 情報源: https://go.theregister.com/feed/www.theregister.com/2024/01/20/nightshade_ai_images/

- :持っている

- :は

- :not

- 1

- 2023

- 8

- a

- 私たちについて

- 実際に

- 適応する

- に対して

- AI

- アルバータ州

- 主張

- また

- an

- および

- です

- 宝品

- アーティスト

- Artists

- 芸術作品

- AS

- 意欲的な

- アシスタント

- 仲間

- At

- 攻撃

- 著者

- 利用できます

- 背景

- 基本

- ベーシックインカム

- BE

- き

- 代わって

- さ

- 信じる

- よく

- 恩恵

- ブラー

- 両言語で

- 境界

- ブランド

- より広い

- 内蔵

- ビジネス

- 焙煎が極度に未発達や過発達のコーヒーにて、クロロゲン酸の味わいへの影響は強くなり、金属を思わせる味わいと乾いたマウスフィールを感じさせます。

- by

- 呼ばれます

- 缶

- キャプチャー

- 場合

- CAT

- 注意

- 変更

- シカゴ

- クレーム

- 閉まっている

- CO

- 組み合わせた

- 手数料

- コンパニオン

- コンピュータ

- コンピュータサイエンス

- コンセプト

- 検討

- コンテンツ

- コンテンツ制作者

- コンテンツ所有者

- クール

- コピー

- 著作権

- 作ります

- クリエイター

- cs

- データ

- 守備

- 説明する

- 発展した

- 異なります

- ディレクティブ

- do

- ありません

- 犬

- e

- 各

- 確保

- エーテル(ETH)

- 例

- 視線

- 不良解析

- 2月

- フィールド

- 企業

- 名

- 魚

- フラットな

- 自由に

- から

- 生成

- 受け

- 与える

- ひと目

- 草

- グリーン

- 有害な

- 収穫

- 持ってる

- 助けました

- HTML

- HTTPS

- 人間

- i

- アイデンティティ

- 個人情報の盗難

- 無視する

- 画像

- 画像

- 影響

- 重要なこと

- in

- 誘因

- include

- 所得

- 組み込む

- 侵害

- 知的

- 知的財産

- 意図された

- 故意に

- 関与

- IT

- ITS

- JPG

- 六月

- キープ

- ラベル

- 大

- 主として

- 姓

- 昨年

- 訴訟

- 学習

- ツェッペリン

- less

- ような

- 制限

- リスト

- 損失

- ロー

- 機械

- 機械学習

- 製

- make

- メーカー

- 五月..

- 手段

- メディア

- ミッドジャーニー

- かもしれない

- 百万

- 最小化する

- 誤用

- モデル

- 最も

- しなければなりません

- 新作

- 通知

- 11月

- 今

- 数

- 観察する

- 明白

- 10月

- of

- 攻撃

- 提供

- on

- オンライン

- の

- オープンソース

- 最適化

- or

- 注文

- オリジナル

- 成果

- 所有者

- 平和

- 紙素材

- 部

- 特に

- 以下のために

- 許可

- 勝手に

- ピッキング

- プラトン

- プラトンデータインテリジェンス

- プラトデータ

- 毒

- 可能

- 強力な

- 現在

- 防ぐ

- 処理されました

- 作り出す

- 生産する

- 東京大学大学院海洋学研究室教授

- プロジェクト

- 財産

- 守る

- 保護

- 提供します

- 財布

- 品質

- 達した

- 受け取ります

- お勧めする

- リリース

- 再現

- 評判

- 必要とする

- 尊重

- 回答

- 責任

- 滑走路

- s

- 前記

- 言う

- 散在する

- 科学

- サービス

- いくつかの

- ショーン

- すべき

- 重要

- 著しく

- 同様の

- 単に

- スムーズ

- 社会

- ソーシャルメディア

- ソフトウェア

- 溶液

- 一部

- 特定の

- 特に

- 安定性

- 安定した

- 都道府県

- 生徒

- スタイル

- 提出する

- 合成

- システム

- チーム

- テクニック

- それ

- 盗難

- アプリ環境に合わせて

- 彼ら

- この

- 今週

- それらの

- しかし?

- 介して

- タイムリーな

- 〜へ

- ツール

- 豊富なツール群

- トレーニング

- 訓練された

- トレーニング

- 2

- 大学

- シカゴ大学

- 予測できない

- つかいます

- 中古

- 便利

- ユーザー

- 使用されます

- バージョン

- 非常に

- 目に見える

- ビジュアル

- ました

- 仕方..

- ウェブ

- 週間

- この試験は

- いつ

- which

- 誰

- 誰

- その

- 願い

- 無し

- 仕事

- 作品

- 不安

- でしょう

- 年

- ゼファーネット

- 趙