A technical paper titled “WWW: What, When, Where to Compute-in-Memory” was published by researchers at Purdue University.

תקציר:

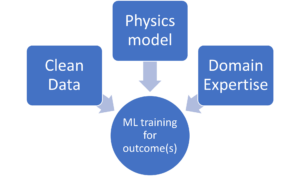

“Compute-in-memory (CiM) has emerged as a compelling solution to alleviate high data movement costs in von Neumann machines. CiM can perform massively parallel general matrix multiplication (GEMM) operations in memory, the dominant computation in Machine Learning (ML) inference. However, re-purposing memory for compute poses key questions on 1) What type of CiM to use: Given a multitude of analog and digital CiMs, determining their suitability from systems perspective is needed. 2) When to use CiM: ML inference includes workloads with a variety of memory and compute requirements, making it difficult to identify when CiM is more beneficial than standard processing cores. 3) Where to integrate CiM: Each memory level has different bandwidth and capacity, that affects the data movement and locality benefits of CiM integration.

In this paper, we explore answers to these questions regarding CiM integration for ML inference acceleration. We use Timeloop-Accelergy for early system-level evaluation of CiM prototypes, including both analog and digital primitives. We integrate CiM into different cache memory levels in an Nvidia A100-like baseline architecture and tailor the dataflow for various ML workloads. Our experiments show CiM architectures improve energy efficiency, achieving up to 0.12x lower energy than the established baseline with INT-8 precision, and upto 4x performance gains with weight interleaving and duplication. The proposed work provides insights into what type of CiM to use, and when and where to optimally integrate it in the cache hierarchy for GEMM acceleration.”

מצא נייר טכני כאן. פורסם בדצמבר 2023 (הדפסה מוקדמת).

Sharma, Tanvi, Mustafa Ali, Indranil Chakraborty, and Kaushik Roy. “WWW: What, When, Where to Compute-in-Memory.” arXiv preprint arXiv:2312.15896 (2023).

קריאה קשורה

הגדלת יעילות האנרגיה של AI עם מחשוב בזיכרון

כיצד לעבד עומסי עבודה של zettascale ולהישאר במסגרת תקציב חשמל קבוע.

מודלים מחשוב בזיכרון עם יעילות ביולוגית

AI גנרטיבי מאלץ את יצרני השבבים להשתמש במשאבי מחשוב בצורה חכמה יותר.

SRAM In AI: The Future Of Memory

Why SRAM is viewed as a critical element in new and traditional compute architectures.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoData.Network Vertical Generative Ai. העצים את עצמך. גישה כאן.

- PlatoAiStream. Web3 Intelligence. הידע מוגבר. גישה כאן.

- PlatoESG. פחמן, קלינטק, אנרגיה, סביבה, שמש, ניהול פסולת. גישה כאן.

- PlatoHealth. מודיעין ביוטכנולוגיה וניסויים קליניים. גישה כאן.

- מקור: https://semiengineering.com/cim-integration-for-ml-inference-acceleration/

- :יש ל

- :הוא

- :איפה

- $ למעלה

- 1

- 2023

- a

- האצה

- השגתי

- AI

- להקל

- an

- ו

- תשובות

- ארכיטקטורה

- AS

- At

- רוחב פס

- Baseline

- מועיל

- הטבות

- שניהם

- תקציב

- by

- מטמון

- CAN

- קיבולת

- משכנע

- חישוב

- לחשב

- עלויות

- קריטי

- נתונים

- דֵצֶמבֶּר

- קביעה

- אחר

- קשה

- דיגיטלי

- דומיננטי

- כל אחד

- מוקדם

- יְעִילוּת

- אלמנט

- יצא

- אנרגיה

- יעילויות אנרגיה

- נוסד

- הערכה

- ניסויים

- לחקור

- קבוע

- בעד

- כוחות

- החל מ-

- עתיד

- רווחים

- כללי

- נתן

- כאן

- היררכיה

- גָבוֹהַ

- אולם

- HTTPS

- לזהות

- לשפר

- in

- כולל

- כולל

- תובנות

- לשלב

- השתלבות

- אל תוך

- IT

- jpg

- מפתח

- למידה

- רמה

- רמות

- להוריד

- מכונה

- למידת מכונה

- מכונה

- עשייה

- באופן מאסיבי

- מַטרִיצָה

- זכרון

- ML

- יותר

- תנועה

- המון

- נחוץ

- חדש

- Nvidia

- of

- on

- לפתוח

- תפעול

- שלנו

- מאמר

- מקביל

- לבצע

- ביצועים

- פרספקטיבה

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- תנוחות

- כּוֹחַ

- דיוק

- תהליך

- תהליך

- מוּצָע

- טיפוס

- מספק

- לאור

- שאלות

- בדבר

- דרישות

- חוקרים

- משאבים

- רועי

- לְהַצִיג

- פִּתָרוֹן

- תֶקֶן

- להשאר

- התאמה

- מערכות

- טכני

- מֵאֲשֶׁר

- זֶה

- השמיים

- העתיד

- שֶׁלָהֶם

- אלה

- זֶה

- שכותרתו

- ל

- מסורתי

- סוג

- אוניברסיטה

- להשתמש

- מגוון

- שונים

- נצפה

- של

- היה

- we

- מִשׁקָל

- מה

- מתי

- עם

- בתוך

- תיק עבודות

- זפירנט