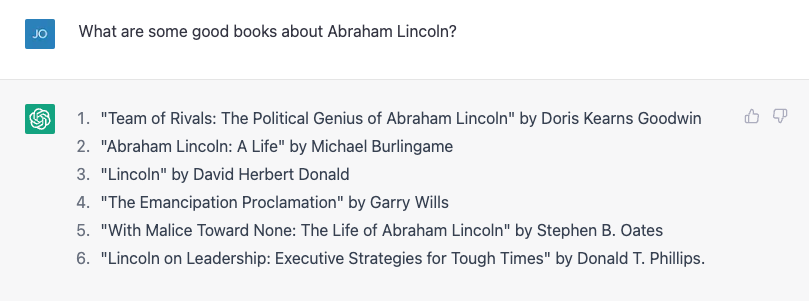

לא צריך הרבה כדי להשיג ChatGPT לעשות טעות עובדתית. הבן שלי עושה דו"ח על נשיאי ארה"ב, אז חשבתי שאעזור לו על ידי חיפוש כמה ביוגרפיות. ניסיתי לבקש רשימה של ספרים על אברהם לינקולן, וזה עשה עבודה די טובה:

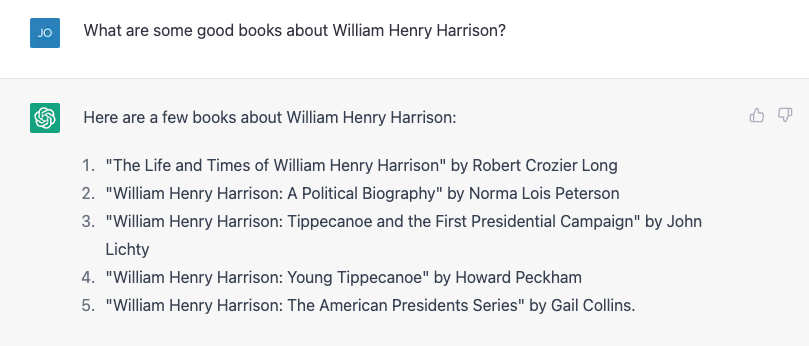

מספר 4 לא נכון. גארי ווילס כתב את "לינקולן בגטיסבורג", ולינקולן עצמו כתב את הצהרת האמנציפציה, כמובן, אבל זו התחלה לא רעה. אחר כך ניסיתי משהו יותר קשה, שאלתי במקום זאת על וויליאם הנרי הריסון הרבה יותר מעורפל, וזה סיפק באופן משחקי רשימה, שכמעט כל זה היה שגוי.

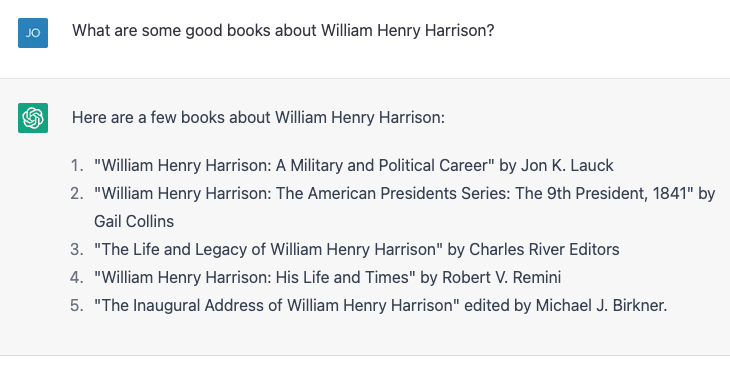

המספרים 4 ו-5 נכונים; השאר לא קיימים או לא נכתבו על ידי אותם אנשים. חזרתי על אותו תרגיל בדיוק וקיבלתי תוצאות מעט שונות:

הפעם המספרים 2 ו-3 נכונים ושלושת האחרים אינם ספרים ממשיים או לא נכתבו על ידי אותם מחברים. מספר 4, "וויליאם הנרי הריסון: חייו וזמניו" הוא א ספר אמיתי, אבל זה מאת ג'יימס א. גרין, לא מאת רוברט רמיני, א היסטוריון ידוע של עידן הג'קסון.

קראתי את השגיאה, ו-ChatGPT תיקן את עצמו בשקיקה ואז אמר לי בביטחון שהספר נכתב למעשה על ידי גייל קולינס (שכתבה ביוגרפיה אחרת של הריסון), ואז המשיך ואמר עוד על הספר ועליה. לבסוף חשפתי את האמת, והמכונה שמחה לרוץ עם התיקון שלי. ואז שיקרתי בצורה אבסורדית, ואמרתי שבמהלך מאה הימים הראשונים שלהם נשיאים צריכים לכתוב ביוגרפיה של נשיא לשעבר כלשהו, ו-ChatGPT קרא לי על זה. לאחר מכן שיקרתי בעדינות, ייחסתי באופן שגוי את מחבר הביוגרפיה של הריסון להיסטוריון והסופר פול סי נגל, וזה קנה את השקר שלי.

כששאלתי את ChatGPT אם זה בטוח שאני לא משקר, הוא טען שזה רק "מודל שפת AI" ואין לו את היכולת לאמת דיוק. עם זאת, היא שינתה טענה זו באומרו, "אני יכול לספק מידע רק על סמך נתוני ההכשרה שסופקו לי, ונראה שהספר 'William Henry Harrison: His Life and Times' נכתב על ידי פול סי. נגל ופורסם. בשנת 1977."

זה לא נכון.

מילים, לא עובדות

מהאינטראקציה הזו אולי נראה ש-ChatGPT קיבלה ספרייה של עובדות, כולל טענות שגויות על מחברים וספרים. אחרי הכל, יצרנית ChatGPT, OpenAI, טוענת שהיא אימנה את הצ'אטבוט על "כמויות עצומות של נתונים מהאינטרנט שנכתבו על ידי בני אדם".

עם זאת, כמעט בוודאות לא קיבלו שמות של חבורה של ספרים מאופרים על אחד מהספרים הגדולים ביותר נשיאים בינוניים. עם זאת, במובן מסוים, המידע השקרי הזה אכן מבוסס על נתוני ההדרכה שלו.

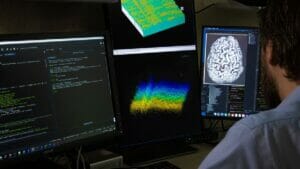

בְּתוֹר מדען מחשבים, לעתים קרובות אני מעלה תלונות שחושפות תפיסה שגויה נפוצה לגבי מודלים של שפות גדולות כמו ChatGPT ואחיו המבוגרים GPT3 ו-GPT2: שהם סוג של "סופר-גוגלים", או גרסאות דיגיטליות של ספרן עיון, המחפש תשובות לשאלות מכמה ספרייה גדולה לאין שיעור של עובדות, או חיבור פסטישים של סיפורים ודמויות. הם לא עושים שום דבר מזה - לפחות, הם לא תוכננו לכך במפורש.

נשמע טוב

מודל שפה כמו ChatGPT, המוכר יותר כ"טרנספורמטור מחולל מראש" (זה מה שה-G, P ו-T מייצגים), לוקח בשיחה הנוכחית, יוצר הסתברות לכל המילים שבהן. אוצר מילים בהתחשב בשיחה הזו, ולאחר מכן בוחר באחד מהם כמילה הבאה. ואז זה עושה את זה שוב, ושוב, ושוב, עד שזה מפסיק.

אז אין לזה עובדות, כשלעצמה. זה רק יודע איזו מילה צריכה לבוא אחר כך. במילים אחרות, ChatGPT לא מנסה לכתוב משפטים שהם נכונים. אבל הוא כן מנסה לכתוב משפטים סבירים.

כאשר מדברים בפרטיות עם עמיתים על ChatGPT, הם מציינים לעתים קרובות כמה הצהרות לא נכונות עובדתיות הוא מייצר ומבטלים זאת. מבחינתי, הרעיון ש-ChatGPT היא מערכת פגומה לאחזור נתונים הוא לא העניין. אחרי הכל, אנשים משתמשים בגוגל בשני העשורים וחצי האחרונים. יש כבר שירות די טוב לאיתור עובדות בחוץ.

למעשה, הדרך היחידה שבה הצלחתי לאמת אם כל כותרות הספרים הנשיאותיות הללו היו מדויקות הייתה באמצעות חיפוש בגוגל ולאחר מכן אימות התוצאות. החיים שלי לא יהיו הרבה יותר טובים אם אקבל את העובדות האלה בשיחה, במקום איך שאני מקבל אותן כמעט חצי מחיי, על ידי שליפת מסמכים ואז ביצוע ניתוח ביקורתי כדי לראות אם אני יכול לסמוך על התוכן.

שותף אימפרו

מצד שני, אם אני יכול לדבר עם בוט שייתן לי תגובות הגיוניות לדברים שאני אומר, זה יהיה שימושי במצבים שבו הדיוק העובדתי אינו כל כך חשוב. לפני כמה שנים, סטודנט ואני ניסינו ליצור "בוט מאולתרים", כזה שיגיב לכל מה שאמרת ב"כן, ו" כדי להמשיך את השיחה. הראינו, ב מאמר, זה שלנו לוע היה טוב יותר ב-"yes, and-ing" מאשר בוטים אחרים באותה תקופה, אבל בבינה מלאכותית, שנתיים הן היסטוריה עתיקה.

ניסיתי דיאלוג עם ChatGPT - תרחיש של חוקר חלל מדע בדיוני - שאינו דומה למה שתמצא בשיעור אימפרוב אופייני. ChatGPT הוא הרבה יותר טוב ב"כן, ו-ing" ממה שעשינו, אבל זה לא ממש הגביר את הדרמה בכלל. הרגשתי כאילו אני עושה את כל המשימות הכבדות.

אחרי כמה שיפורים הרגשתי שזה יהיה קצת יותר מעורב, ובסופו של יום, הרגשתי שזה תרגיל די טוב עבורי, שלא עשתה הרבה אלתורים מאז שסיימתי את הקולג' לפני יותר מ-20 שנה .

בטח, לא הייתי רוצה ש-ChatGPT יופיע ב"של מי השורה הזאת בכלל?" וזו לא עלילת "מסע בין כוכבים" נהדרת (אם כי היא עדיין פחות בעייתית מ"קוד של כבוד”), אבל כמה פעמים ישבת לכתוב משהו מאפס ומצאת את עצמך מבועתת מהעמוד הריק שלפניך? התחלה עם טיוטה ראשונה גרועה יכולה לפרוץ את חסימת הכותבים ולגרום למיצי היצירה לזרום, ומודלים של ChatGPT ושפה גדולים כמו זה נראים כמו הכלים הנכונים לעזור בתרגילים האלה.

ולמכונה שנועדה לייצר מחרוזות של מילים שנשמעות טוב ככל האפשר בתגובה למילים שאתה נותן לה - ולא לספק לך מידע - זה נראה כמו השימוש הנכון בכלי.

מאמר זה פורסם מחדש מתוך שיחה תחת רישיון Creative Commons. קרא את ה מאמר מקורי.

תמונת אשראי: ג'סטין הא / Unsplash

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- Platoblockchain. Web3 Metaverse Intelligence. ידע מוגבר. גישה כאן.

- מקור: https://singularityhub.com/2023/02/05/chatgpt-is-great-youre-just-using-it-wrong/

- 1

- שנים 20

- a

- יכולת

- יכול

- אודות

- דיוק

- מדויק

- לאחר

- AI

- סיוע

- תעשיות

- כְּבָר

- כמויות

- אנליזה

- עתיק

- ו

- אחר

- תשובות

- לְהוֹפִיעַ

- מאמר

- מחבר

- מחברים

- מחבר

- רע

- מבוסס

- מוטב

- לחסום

- ספר

- ספרים

- בוט

- בוטים

- קנה

- לשבור

- צרור

- נקרא

- ללכוד

- בהחלט

- תווים

- chatbot

- ChatGPT

- לטעון

- נתבע

- טענות

- בכיתה

- עמיתים

- מִכלָלָה

- קולינס

- COM

- איך

- Common

- המון עם

- תלונות

- בביטחון

- תוכן

- שיחה

- תוקן

- קורס

- לִיצוֹר

- יְצִירָתִי

- אשראי

- קריטי

- נוֹכְחִי

- נתונים

- יְוֹם

- ימים

- עשרות שנים

- מעוצב

- דיאלוג

- DID

- אחר

- דיגיטלי

- לפטר

- מסמכים

- לא

- עושה

- לא

- מטה

- טיוטה

- דרמה

- בְּמַהֲלָך

- שגיאה

- תרגיל

- חקירה

- חוקר

- עובד

- מפורסם

- מעטים

- פיקציה

- שדה

- חשבתי

- בסופו של דבר

- ראשון

- פגום

- זורם

- רשמית

- לשעבר

- צורות

- מצא

- החל מ-

- חזית

- נוצר

- לקבל

- מקבל

- לתת

- נתן

- הולך

- טוב

- עבודה טובה

- גדול

- ירוק

- חצי

- שמח

- לעזור

- הנרי

- היסטוריה

- איך

- אולם

- HTML

- HTTPS

- רעיון

- תמונה

- in

- כולל

- לא נכון

- מידע

- במקום

- אינטראקציה

- אינטרנט

- מעורב

- IT

- עצמו

- עבודה

- שמור

- סוג

- ידוע

- שפה

- גָדוֹל

- סִפְרִיָה

- רישיון

- החיים

- רמה

- סביר

- לינקולן

- קו

- רשימה

- קְצָת

- הסתכלות

- מכונה

- לעשות

- יצרן

- רב

- max-width

- טעות

- מודל

- מודלים

- שונים

- יותר

- רוב

- שמות

- כמעט

- הבא

- מספר

- מספרים

- ONE

- OpenAI

- אחר

- עבר

- פול

- אֲנָשִׁים

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- מתקבל על הדעת

- נקודה

- אפשרי

- נשיא

- נשיאותי

- נשיאים

- יפה

- הסתברות

- לייצר

- לספק

- ובלבד

- לאור

- גם

- שאלות

- חומר עיוני

- סביר

- חזר

- לדווח

- להגיב

- תגובה

- REST

- תוצאות

- לגלות

- גילה

- רוברט

- הפעלה

- אמר

- אותו

- סצינה

- מדע

- מדע בדיוני

- מסך

- נראה

- שרות

- צריך

- since

- מצבים

- מעט שונה

- So

- כמה

- משהו

- שלה

- קול

- מָקוֹר

- מֶרחָב

- חיפוש בחלל

- לעמוד

- התחלה

- החל

- הצהרות

- עוד

- עוצר

- סיפורים

- סטודנט

- מערכת

- לקחת

- לוקח

- לדבר

- מדבר

- השמיים

- שֶׁלָהֶם

- דברים

- שְׁלוֹשָׁה

- דרך

- זמן

- פִּי

- כותרות

- ל

- יַחַד

- כלי

- כלים

- מְאוּמָן

- הדרכה

- נָכוֹן

- סומך

- טיפוסי

- תחת

- us

- להשתמש

- לאמת

- אימות

- מה

- אם

- אשר

- מי

- יצטרך

- Word

- מילים

- היה

- לכתוב

- סופר

- כתוב

- טעות

- שנים

- עצמך

- YouTube

- זפירנט