הצמיחה המהירה של AI גנרטיבי מביאה לחדשנות חדשה ומבטיחה, ובו בזמן מעלה אתגרים חדשים. אתגרים אלה כוללים כמה שהיו נפוצים לפני AI גנרטיבי, כגון הטיה ויכולת הסבר, וכן חדשים ייחודיים לדגמי יסוד (FMs), כולל הזיות ורעילות. ב-AWS, אנו מחויבים לכך פיתוח בינה מלאכותית גנרטיבית באחריות, נוקטים בגישה ממוקדת באנשים שמעניקה עדיפות לחינוך, למדע וללקוחות שלנו, כדי לשלב בינה מלאכותית אחראית לאורך מחזור החיים של AI מקצה לקצה.

במהלך השנה האחרונה, הצגנו יכולות חדשות ביישומי הבינה המלאכותית והדגמים הגנרטיביים שלנו, כגון סריקת אבטחה מובנית ב Amazon Code Whisperer, הכשרה לאיתור וחסימת תוכן מזיק אמזון טיטאן, והגנת פרטיות הנתונים ב סלע אמזון. ההשקעה שלנו בבינה מלאכותית יצירתית בטוחה, שקופה ואחראית כוללת שיתוף פעולה עם הקהילה העולמית וקובעי מדיניות כפי שעודדנו ותמכנו הן התחייבויות בינה מלאכותית מרצון של הבית הלבן ו פסגת בטיחות בינה מלאכותית בבריטניה. ואנחנו ממשיכים לעבוד יד ביד עם לקוחות כדי להפעיל AI אחראי עם כלים ייעודיים כמו אמזון סייג מייקר להבהיר, ML Governance עם Amazon SageMaker, ועוד.

הצגת חדשנות חדשה בינה מלאכותית אחראית

ככל שה-AI הגנרטיבי מתרחב לתעשיות, ארגונים ומקרי שימוש חדשים, צמיחה זו חייבת להיות מלווה בהשקעה מתמשכת בפיתוח FM אחראי. לקוחות רוצים שה-FM שלהם ייבנו מתוך מחשבה על בטיחות, הגינות ואבטחה, כך שהם יכולים בתורם לפרוס בינה מלאכותית באחריות. ב-AWS re:Invent השנה, אנו נרגשים להכריז על יכולות חדשות לטפח חדשנות AI מחוללת אחראית על פני מערך רחב של יכולות עם כלים מובנים חדשים, הגנות על לקוחות, משאבים לשיפור השקיפות וכלים למאבק בדיסאינפורמציה. אנו שואפים לספק ללקוחות את המידע הדרוש להם כדי להעריך FMs מול שיקולי AI אחראיים מרכזיים, כמו רעילות וחוסן, ולהציג מעקות בטיחות להחלת אמצעי הגנה המבוססים על מקרי שימוש של לקוחות ומדיניות AI אחראית. במקביל, הלקוחות שלנו רוצים לקבל מידע טוב יותר על הבטיחות, ההגינות, האבטחה ומאפיינים אחרים, של שירותי AI ו-FM, כפי שהם משתמשים בהם בתוך הארגון שלהם. אנו נרגשים להכריז על משאבים נוספים שיעזרו ללקוחות להבין טוב יותר את שירותי ה-AWS AI שלנו ולספק את השקיפות שהם מבקשים.

יישום אמצעי הגנה: מעקות בטיחות עבור אמזון

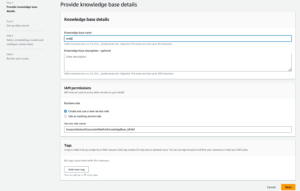

בטיחות היא בראש סדר העדיפויות בכל הנוגע להכנסת AI גנרטיבי בקנה מידה. ארגונים רוצים לקדם אינטראקציות בטוחות בין הלקוחות שלהם לבין יישומי בינה מלאכותית שימנעו שפה מזיקה או פוגענית ומתיישרים עם מדיניות החברה. הדרך הקלה ביותר לעשות זאת היא להציב אמצעי הגנה עקביים בכל הארגון כך שכולם יוכלו לחדש בבטחה. אתמול הכרזנו על התצוגה המקדימה של מעקות בטיחות עבור Amazon Bedrock-יכולת חדשה שמקלה על יישום אמצעי הגנה ספציפיים ליישום המבוססים על מקרי שימוש של לקוחות ומדיניות AI אחראית.

מעקות בטיחות מעודדים עקביות כיצד מגיבים FM ב-Amazon Bedrock לתוכן לא רצוי ומזיק בתוך יישומים. לקוחות יכולים להחיל מעקות על דגמי שפה גדולים ב- Amazon Bedrock וכן על דגמים מכוונים ובשילוב עם סוכנים עבור Amazon Bedrock. מעקות בטיחות מאפשרים לך לציין נושאים שיש להימנע מהם, והשירות מזהה ומונע באופן אוטומטי שאילתות ותגובות שנכללות בקטגוריות מוגבלות. לקוחות יכולים גם להגדיר ספי סינון תוכן על פני קטגוריות כולל דברי שטנה, עלבונות, שפה מינית ואלימות כדי לסנן תוכן מזיק לרמה הרצויה. לדוגמה, ניתן להגדיר אפליקציה לבנקאות מקוונת כדי להימנע ממתן ייעוץ השקעות ולהגביל תוכן בלתי הולם (כגון דברי שטנה, עלבונות ואלימות). בעתיד הקרוב, לקוחות יוכלו גם לבטל מידע אישי מזהה (PII) בתשומות משתמשים ובתגובות של FMs, להגדיר מסנני ניבול פה ולספק רשימה של מילים מותאמות אישית לחסום באינטראקציות בין משתמשים ו-FMs, לשפר את התאימות ועוד. הגנה על משתמשים. עם Guardrails, אתה יכול לחדש מהר יותר עם AI גנרטיבי תוך שמירה על הגנות והגנה בהתאם למדיניות החברה.

זיהוי ה-FM הטוב ביותר עבור מקרה שימוש ספציפי: הערכת מודל ב- Amazon Bedrock

כיום, לארגונים יש מגוון רחב של אפשרויות FM להפעלת יישומי הבינה המלאכותית שלהם. כדי להגיע לאיזון הנכון בין דיוק וביצועים למקרה השימוש שלהם, ארגונים חייבים להשוות ביעילות מודלים ולמצוא את האפשרות הטובה ביותר בהתבסס על AI אחראי מפתח ומדדי איכות שחשובים להם. כדי להעריך מודלים, ארגונים חייבים תחילה להקדיש ימים לזיהוי מדדים, הגדרת כלי הערכה והרצת הערכות, כל אלה דורשים מומחיות עמוקה במדעי הנתונים. יתר על כן, מבחנים אלו אינם שימושיים להערכת קריטריונים סובייקטיביים (למשל, קול מותג, רלוונטיות וסגנון) הדורשים שיפוט באמצעות תהליכי עבודה מייגעים, עתירי זמן, של ביקורת אנושית. הזמן, המומחיות והמשאבים הנדרשים להערכות אלה - לכל מקרה שימוש חדש - מקשים על ארגונים להעריך מודלים מול ממדי AI אחראיים ולבצע בחירה מושכלת לגבי איזה מודל יספק את החוויה המדויקת והבטוחה ביותר ללקוחותיהם.

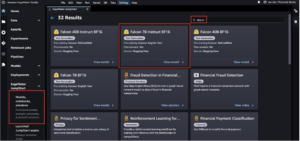

זמין כעת בתצוגה מקדימה, הערכת מודל על אמזון עוזר ללקוחות להעריך, להשוות ולבחור את ה-FM הטובים ביותר עבור מקרה השימוש הספציפי שלהם על סמך מדדים מותאמים אישית, כגון דיוק ובטיחות, באמצעות הערכות אוטומטיות או אנושיות. בקונסולת Amazon Bedrock, הלקוחות בוחרים את ה-FMs שהם רוצים להשוות עבור משימה נתונה, כגון מענה לשאלות או סיכום תוכן. להערכות אוטומטיות, לקוחות בוחרים בקריטריונים להערכה מוגדרים מראש (למשל, דיוק, חוסן ורעילות) ומעלים מערך נתונים משלהם לבדיקה או בוחרים מתוך מערכי נתונים מובנים וזמינים לציבור. עבור קריטריונים סובייקטיביים או תוכן בעל ניואנסים הדורשים שיפוט, לקוחות יכולים להגדיר בקלות תהליכי הערכה מבוססי אדם בכמה קליקים בלבד. זרימות עבודה אלה ממנפות את צוות העבודה הפנימי של הלקוח, או משתמשים בכוח עבודה מנוהל שמסופק על ידי AWS, כדי להעריך את תגובות המודל. במהלך הערכות מבוססות-אדם, לקוחות מגדירים מדדי שימוש ספציפיים למקרה (למשל, רלוונטיות, סגנון וקול מותג). לאחר שהלקוחות מסיימים את תהליך ההגדרה, Amazon Bedrock מפעילה הערכות ומפיקה דוח, כך שהלקוחות יכולים להבין בקלות כיצד המודל התבצע על פני קריטריוני בטיחות ודיוק מרכזיים ולבחור את המודל הטוב ביותר עבור מקרה השימוש שלהם.

היכולת הזו להעריך מודלים אינה מוגבלת ל-Amazon Bedrock, לקוחות יכולים גם להשתמש בהערכת מודלים ב-Amazon SageMaker Clarify כדי להעריך, להשוות ולבחור בקלות את אפשרות ה-FM הטובה ביותר על פני מדדי איכות ואחריות מרכזיים כגון דיוק, חוסן ורעילות - על פני כל ה-FM.

מאבק בדיסאינפורמציה: סימון מים באמזון טיטאן

היום, הודענו אמזון טיטאן מחולל תמונות בתצוגה מקדימה, המאפשרת ללקוחות לייצר ולשפר במהירות תמונות באיכות גבוהה בקנה מידה. שקלנו בינה מלאכותית אחראית במהלך כל שלב בתהליך פיתוח המודל, כולל בחירת נתוני אימון, בניית יכולות סינון לאיתור והסרה של תשומות משתמש ופלטי מודל בלתי הולמים, ושיפור המגוון הדמוגרפי של תפוקות המודל שלנו. כל התמונות שנוצרו על ידי אמזון טיטאן מכילות סימן מים בלתי נראה כברירת מחדל, שנועד לעזור להפחית את התפשטות הדיסאינפורמציה על ידי מתן מנגנון דיסקרטי לזיהוי תמונות שנוצרו על ידי AI. AWS היא בין ספקיות הדגמים הראשונות שהוציאו באופן נרחב סימני מים בלתי נראים מובנים המשולבים ביציאות תמונה ותוכננו להיות עמידים בפני שינויים.

בניית אמון: עמידה מאחורי המודלים והאפליקציות שלנו עם שיפוי

בניית אמון לקוחות היא הליבה של AWS. היינו במסע עם הלקוחות שלנו מאז הקמתנו, ועם צמיחת הבינה המלאכותית הגנרטיבית, אנחנו נשארים מחויבים לבנות יחד טכנולוגיה חדשנית. כדי לאפשר ללקוחות לרתום את הכוח של ה-AI הגנרטיבי שלנו, הם צריכים לדעת שהם מוגנים. AWS מציעה כיסוי שיפוי בגין זכויות יוצרים עבור פלטים של שירותי הבינה המלאכותית הבאים של אמזון: Amazon Titan Text Express, Amazon Titan Text Lite, Amazon Titan Embeddings, Amazon Titan Multimodal Embeddings, Amazon CodeWhisperer Professional, AWS HealthScribe, אמזון לקס, ו אמזון להתאים אישית. משמעות הדבר היא שלקוחות המשתמשים בשירותים באחריות מוגנים מפני תביעות של צד שלישי הטוענות להפרת זכויות יוצרים על ידי התפוקות שנוצרו על ידי שירותים אלה (ראה סעיף 50.10 של תנאי השירות). בנוסף, שיפוי ה-IP הסטנדרטי שלנו לשימוש בשירותים מגן על לקוחות מפני תביעות של צד שלישי הטוענות להפרת IP על ידי השירותים והנתונים המשמשים להכשרתם. במילים אחרות, אם אתה משתמש בשירות AI יצירתי של אמזון המפורט לעיל ומישהו יתבע אותך על הפרת IP, AWS תגן על התביעה, הכוללת כיסוי כל פסק דין נגדך או עלויות פשרה.

אנו עומדים מאחורי שירותי הבינה המלאכותית הגנרטיבית שלנו ופועלים לשיפור מתמיד. ככל ש-AWS משיקה שירותים חדשים ובינה מלאכותית גנרטיבית ממשיכה להתפתח, AWS תמשיך להתמקד ללא הפוגה ברכישת ושימור אמון הלקוחות.

שיפור השקיפות: כרטיס שירות AWS AI עבור Amazon Titan Text

We הציג את כרטיסי השירות של AWS AI ב-re:Invent 2022 כמשאב שקיפות כדי לעזור ללקוחות להבין טוב יותר את שירותי ה-AWS AI שלנו. כרטיסי שירות בינה מלאכותית הם סוג של תיעוד בינה מלאכותית אחראית המספקת ללקוחות מקום אחד למצוא מידע על מקרי השימוש והמגבלות המיועדים, בחירות תכנון אחראיות של בינה מלאכותית ושיטות עבודה מומלצות של פריסה ואופטימיזציה של ביצועים עבור שירותי הבינה המלאכותית שלנו. הם חלק מתהליך פיתוח מקיף שאנו מתחייבים לבנות את השירותים שלנו בצורה אחראית המתייחסת להוגנות, הסבר, אמיתות וחוסן, ממשל, שקיפות, פרטיות ואבטחה, בטיחות ושליטה.

ב-re:Invent השנה אנו מכריזים על א כרטיס שירות AI חדש עבור Amazon Titan Text להגביר את השקיפות במודלים של היסודות. אנחנו גם משיקים ארבעה כרטיסי שירות AI חדשים, כולל: Amazon Comprehend Detect PII, זיהוי רעילות לתמלול אמזון, אמזון זיהוי פנים חיים, ו AWS HealthScribe. אתה יכול לחקור כל אחד מהקלפים האלה ב- אתר AWS. ככל שה-AI הגנרטיבי ממשיך לגדול ולהתפתח, שקיפות לגבי אופן פיתוח, בדיקה ושימוש בטכנולוגיה תהיה מרכיב חיוני כדי לזכות באמון של ארגונים ולקוחותיהם כאחד. ב-AWS, אנו מחויבים להמשיך ולהביא משאבי שקיפות כמו כרטיסי שירות בינה מלאכותית לקהילה הרחבה יותר - ולחזור ולאסוף משוב על הדרכים הטובות ביותר קדימה.

השקעה בבינה מלאכותית אחראית לאורך כל מחזור חיי הבינה המלאכותית הגנרטיבית

אנו נרגשים מהחידושים החדשים שהוכרזו השבוע ב-re:Invent המעניקים ללקוחותינו יותר כלים, משאבים והגנות מובנות כדי לבנות ולהשתמש בבינה מלאכותית גנרטיבית בבטחה. מהערכת מודלים ועד מעקות בטיחות ועד סימון מים, לקוחות יכולים כעת להביא בינה מלאכותית לארגון שלהם מהר יותר, תוך הפחתת סיכונים. הגנות חדשות ללקוחות כמו כיסוי שיפוי IP ומשאבים חדשים לשיפור השקיפות כמו כרטיסי שירות נוספים בינה מלאכותית הן גם דוגמאות מרכזיות למחויבות שלנו לבנות אמון בין חברות טכנולוגיה, קובעי מדיניות, קבוצות קהילתיות, מדענים ועוד. אנו ממשיכים לבצע השקעות משמעותיות בבינה מלאכותית אחראית לאורך כל מחזור החיים של מודל יסוד - כדי לעזור ללקוחותינו להגדיל את הבינה המלאכותית בצורה בטוחה, מאובטחת ואחראית.

על הכותבים

פיטר האלינן מוביל יוזמות במדע ובפרקטיקה של AI אחראי ב-AWS AI, לצד צוות של מומחי AI אחראיים. יש לו מומחיות עמוקה בבינה מלאכותית (דוקטורט, הרווארד) ויזמות (Blindsight, נמכרה לאמזון). פעילותו ההתנדבותית כללה שירות כפרופסור לייעוץ בבית הספר לרפואה של אוניברסיטת סטנפורד, וכנשיא לשכת המסחר האמריקאית במדגסקר. כשאפשר, הוא יוצא להרים עם ילדיו: סקי, טיפוס, טיולים ורפטינג

פיטר האלינן מוביל יוזמות במדע ובפרקטיקה של AI אחראי ב-AWS AI, לצד צוות של מומחי AI אחראיים. יש לו מומחיות עמוקה בבינה מלאכותית (דוקטורט, הרווארד) ויזמות (Blindsight, נמכרה לאמזון). פעילותו ההתנדבותית כללה שירות כפרופסור לייעוץ בבית הספר לרפואה של אוניברסיטת סטנפורד, וכנשיא לשכת המסחר האמריקאית במדגסקר. כשאפשר, הוא יוצא להרים עם ילדיו: סקי, טיפוס, טיולים ורפטינג

ואסי פילומין הוא כיום סמנכ"ל AI Generative ב-AWS. הוא מוביל מאמצי בינה מלאכותית, כולל Amazon Bedrock, Amazon Titan ו- Amazon CodeWhisperer.

ואסי פילומין הוא כיום סמנכ"ל AI Generative ב-AWS. הוא מוביל מאמצי בינה מלאכותית, כולל Amazon Bedrock, Amazon Titan ו- Amazon CodeWhisperer.

- הפצת תוכן ויחסי ציבור מופעל על ידי SEO. קבל הגברה היום.

- PlatoData.Network Vertical Generative Ai. העצים את עצמך. גישה כאן.

- PlatoAiStream. Web3 Intelligence. הידע מוגבר. גישה כאן.

- PlatoESG. פחמן, קלינטק, אנרגיה, סביבה, שמש, ניהול פסולת. גישה כאן.

- PlatoHealth. מודיעין ביוטכנולוגיה וניסויים קליניים. גישה כאן.

- מקור: https://aws.amazon.com/blogs/machine-learning/announcing-new-tools-and-capabilities-to-enable-responsible-ai-innovation/

- :יש ל

- :הוא

- :לֹא

- $ למעלה

- 10

- 100

- 125

- 2022

- 50

- a

- יכולת

- יכול

- אודות

- מֵעַל

- נלווה

- דיוק

- מדויק

- לרוחב

- פעילויות

- תוספת

- נוסף

- כתובות

- עצה

- נגד

- AI

- שירותי AI

- המטרה

- ליישר

- דוֹמֶה

- תעשיות

- בַּצַד

- גם

- אמזון בעברית

- Amazon Code Whisperer

- אמזון SageMaker

- אמזון שירותי אינטרנט

- אֲמֶרִיקָאִי

- בין

- an

- ו

- להכריז

- הודיע

- מכריז

- אחר

- כל

- בקשה

- יישומים

- החל

- גישה

- ARE

- סביב

- AS

- לשאול

- הערכות

- At

- מכני עם סלילה אוטומטית

- באופן אוטומטי

- זמין

- לְהִמָנַע

- נמנע

- AWS

- AWS re: המצאה

- איזון

- בנקאות

- מבוסס

- BE

- היה

- לפני

- מאחור

- מבחני ביצועים

- הטוב ביותר

- שיטות עבודה מומלצות

- מוטב

- בֵּין

- הטיה

- לחסום

- שניהם

- מותג

- להביא

- מביא

- רחב

- רחב

- לִבנוֹת

- בניית אמון

- בִּניָן

- נבנה

- מובנה

- by

- CAN

- יכולות

- יכולת

- כרטיס

- כרטיסים

- מקרה

- מקרים

- קטגוריות

- האתגרים

- תָא

- ילדים

- בחירה

- בחירות

- בחרו

- טענות

- טיפוס

- שיתוף פעולה

- להילחם

- שילוב

- מגיע

- מסחר

- מחויבות

- מְחוּיָב

- Common

- קהילה

- חברות

- חברה

- לְהַשְׁווֹת

- הענות

- רְכִיב

- לִהַבִין

- מַקִיף

- שיקולים

- נחשב

- עִקבִי

- קונסול

- ייעוץ

- להכיל

- תוכן

- תמיד

- להמשיך

- ממשיך

- ממשיך

- זכויות יוצרים

- הפרת זכויות יוצרים

- ליבה

- עלויות

- כיסוי

- כיסוי

- הקריטריונים

- כיום

- מנהג

- לקוח

- לקוחות

- נתונים

- פרטיות מידע

- מדע נתונים

- מערכי נתונים

- ימים

- עמוק

- מומחיות עמוקה

- בְּרִירַת מֶחדָל

- לְהַגדִיר

- למסור

- דמוגרפי

- לפרוס

- פריסה

- עיצוב

- מעוצב

- רצוי

- לאתר

- מפותח

- צעצועי התפתחות

- קשה

- ממדים

- מֵידָע מַטעֶה

- גיוון

- do

- תיעוד

- נהיגה

- בְּמַהֲלָך

- e

- כל אחד

- לזכות

- רווחים

- הקל ביותר

- בקלות

- קל

- חינוך

- יעילות

- מַאֲמָצִים

- או

- מעצים

- לאפשר

- עודד

- מקצה לקצה

- להגביר את

- שלם

- יזמות

- Ether (ETH)

- להעריך

- הערכה

- הערכה

- הערכות

- כל

- כולם

- להתפתח

- דוגמה

- דוגמאות

- נרגש

- ניסיון

- מומחיות

- מומחים

- הסבר

- לחקור

- אקספרס

- פָּנִים

- הגינות

- ליפול

- מהר יותר

- מָשׁוֹב

- מעטים

- לסנן

- סינון

- מסננים

- גימור

- ראשון

- להתמקד

- הבא

- בעד

- טופס

- קדימה

- לטפח

- קרן

- ארבע

- החל מ-

- נוסף

- יתר על כן

- עתיד

- ללקט

- נוצר

- מייצר

- גנרטטיבית

- AI Generative

- נתן

- נותן

- גלוֹבָּלִי

- ממשל

- קבוצה

- לגדול

- צמיחה

- מזיק

- רתמת

- הרווארד

- לשנוא

- שונא את הדיבור

- יש

- he

- לעזור

- עוזר

- באיכות גבוהה

- טיולים

- שֶׁלוֹ

- בית

- איך

- HTTPS

- בן אנוש

- לזהות

- זיהוי

- if

- תמונה

- תמונות

- ליישם

- חשוב

- לשפר

- שיפור

- in

- הַתחָלָה

- לכלול

- כלול

- כולל

- כולל

- להגדיל

- תעשיות

- מידע

- הודעה

- הפרה

- יוזמות

- לחדש

- חדשנות

- חידושים

- חדשני

- טכנולוגיה חדשנית

- תשומות

- לשלב

- משולב

- התכוון

- יחסי גומלין

- אל תוך

- מבוא

- הציג

- החדרה

- השקעה

- השקעות

- בלתי נראה

- IP

- IT

- מסע

- jpg

- רק

- מפתח

- לדעת

- שפה

- גָדוֹל

- השקות

- השקה

- תביעה משפטית

- מוביל

- מאפשר לי

- רמה

- תנופה

- מעגל החיים

- כמו

- להגביל

- מגבלות

- מוגבל

- רשימה

- ברשימה

- שמירה

- לעשות

- עושה

- הצליח

- משמעותי

- אומר

- מנגנון

- רפואה

- מדדים

- אכפת לי

- מקלה

- מודל

- מודלים

- יותר

- רוב

- צריך

- ליד

- צורך

- חדש

- עַכשָׁיו

- of

- כבוי

- מתקפה

- המיוחדות שלנו

- on

- פעם

- יחידות

- באינטרנט

- בנקאות מקוונת

- אופטימיזציה

- אפשרות

- אפשרויות

- or

- ארגון

- ארגונים

- אחר

- שלנו

- הַחוּצָה

- פלטים

- שֶׁלוֹ

- חלק

- עבר

- ביצועים

- ביצעתי

- אישית

- דוקטורט

- pii

- מקום

- אפלטון

- מודיעין אפלטון

- אפלטון נתונים

- מדיניות

- קובעי מדיניות

- אפשרי

- כּוֹחַ

- תרגול

- פרקטיקות

- נשיא

- מונע

- תצוגה מקדימה

- מתעדף

- עדיפות

- פְּרָטִיוּת

- פרטיות ואבטחה

- תהליך

- לייצר

- ניבולי פה

- מקצועי

- פרופסור

- מבטיח

- לקדם

- נכסים

- מוּגָן

- אבטחה

- מגן

- לספק

- ובלבד

- ספקים

- מתן

- בפומבי

- גם

- איכות

- שאילתות

- מעלה

- רכס

- מהיר

- מהר

- RE

- להפחית

- לשחרר

- הרלוונטיות

- להשאר

- להסיר

- לדווח

- נדרש

- דורש

- עמיד בפני

- משאב

- משאבים

- להגיב

- תגובות

- אחריות

- אחראי

- באחריות

- מוגבל

- תקין

- הסיכון

- איתנות

- ריצה

- פועל

- בטוח

- אמצעי הגנה

- בבטחה

- בְּטִיחוּת

- בעל חכמים

- אותו

- סולם

- סולם ai

- מאזניים

- סריקה

- בית ספר

- מדע

- מדענים

- סעיף

- לבטח

- אבטחה

- לִרְאוֹת

- בחר

- מבחר

- שרות

- שירותים

- הגשה

- סט

- הצבה

- הֶסדֵר

- התקנה

- since

- יחיד

- So

- נמכרים

- כמה

- מישהו

- ספציפי

- נאום

- לבלות

- התפשטות

- התמחות

- לעמוד

- תֶקֶן

- מעמד

- סטנפורד

- אוניברסיטת סטנפורד

- להכות

- סגנון

- כזה

- תובע

- נתמך

- מתמשכת

- נטילת

- המשימות

- נבחרת

- טכנולוגיה

- חברות טכנולוגיה

- נבדק

- בדיקות

- בדיקות

- טֶקסט

- זֶה

- השמיים

- המידע

- בריטניה

- שֶׁלָהֶם

- אותם

- אלה

- הֵם

- צד שלישי

- זֶה

- השבוע

- השנה

- אלה

- דרך

- זמן

- עֲנָק

- ל

- יַחַד

- כלים

- נושאים

- רכבת

- הדרכה

- שקיפות

- שָׁקוּף

- סומך

- תור

- Uk

- להבין

- להתחייב

- ייחודי

- אוניברסיטה

- להשתמש

- במקרה להשתמש

- מְשׁוּמָשׁ

- משתמש

- משתמשים

- באמצעות

- חיוני

- קול

- מִרָצוֹן

- להתנדב

- vp

- רוצה

- סימן מים

- watermarking

- סימני מים

- דֶרֶך..

- דרכים

- we

- אינטרנט

- שירותי אינטרנט

- אתר

- שבוע

- טוֹב

- היו

- מה

- מתי

- אשר

- בזמן

- מי

- כל

- רָחָב

- טווח רחב

- באופן נרחב

- יצטרך

- עם

- בתוך

- מילים

- תיק עבודות

- זרימות עבודה

- כוח עבודה

- שנה

- אתמול

- אתה

- זפירנט